第2章经典最优化方法讲解

- 格式:ppt

- 大小:1.93 MB

- 文档页数:34

最优化方法讲义

哇塞,最优化方法讲义啊,这可真是个超级有趣的东西呢!

那最优化方法到底是啥呢?简单来说,就是找到一个最好的解决方案。

这就好像你在一堆糖果中找那颗最甜的,或者在一群人里找到最合适的伙伴一起完成一项任务。

它有一些具体的步骤哦!首先得明确目标,就像你要知道自己到底要找什么样的糖果。

然后呢,建立数学模型,这就像是给找糖果这件事定个规则。

接着要选择合适的算法,这就像是选择用哪种工具去挑糖果。

在这个过程中,可得注意啦!目标一定要清晰明确,不能模模糊糊的,不然怎么知道自己要找啥呀。

模型也得合理,不能乱套呀。

算法的选择更是关键,选不好可就事倍功半啦!

在这个过程中,安全性和稳定性那也是相当重要的呀!就好比你走在钢丝上,要是不安全不稳定,那随时可能掉下去。

如果在最优化的过程中出了问题,那后果可能不堪设想。

所以一定要保证每一步都稳稳当当的,不能有丝毫马虎。

那最优化方法的应用场景可多了去啦!比如在工程领域,可以让设计更合理,更高效。

在经济领域,可以让资源分配更科学。

它的优势也很明显呀,能提高效率,节省成本,还能让结果更完美。

这就好像给你配备了一把神奇的钥匙,能打开各种难题的大门。

我给你说个实际案例哈,有家工厂在生产产品的时候,通过最优化方法来安排生产流程,结果呢,生产效率大大提高了,成本降低了不少,产品质量也更好了。

这效果,简直太棒啦!这不就充分说明了最优化方法的厉害之处嘛!

所以呀,最优化方法真的是个超级棒的东西,能让我们的生活和工作变得更加美好,更加高效!。

最优化方法1. 简介最优化方法是一种通过调整变量值以最小化或最大化某个目标函数来优化系统性能的数学方法。

最优化方法广泛应用于各个领域,包括经济学、工程学、计算机科学等。

本文将介绍最优化方法的基本概念、常用算法以及其在实际问题中的应用。

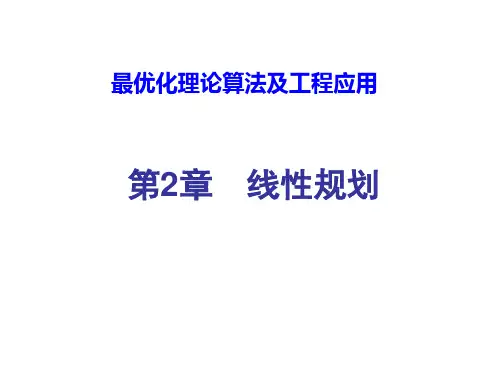

2. 最优化问题最优化问题可以分为无约束最优化和约束最优化问题。

无约束最优化问题是在没有任何限制条件的情况下,寻找使目标函数值最小或最大的变量值。

约束最优化问题则在一定的约束条件下寻找最优解。

在最优化问题中,目标函数通常是一个多元函数,而变量则是目标函数的输入参数。

最优化的目标可以是最小化或最大化目标函数的值。

常见的优化问题包括线性规划、非线性规划、整数规划等。

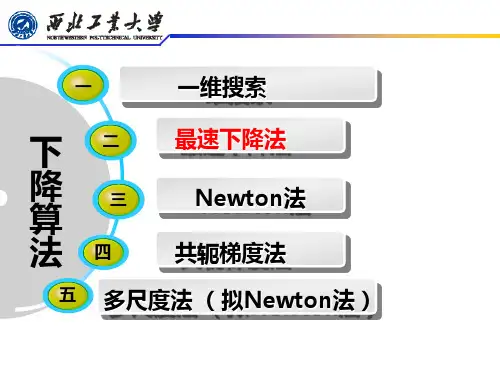

3. 常用最优化算法3.1 梯度下降法梯度下降法是最常用的最优化算法之一。

它通过计算目标函数相对于变量的梯度(即偏导数),以负梯度方向更新变量值,逐步接近最优解。

梯度下降法的优点是简单易实现,但可能收敛速度较慢,且容易陷入局部最优解。

3.2 牛顿法牛顿法是一种基于目标函数的二阶导数(即海森矩阵)信息进行更新的最优化算法。

相较于梯度下降法,牛顿法的收敛速度更快,并且对于某些非凸优化问题更具优势。

然而,牛顿法的计算复杂度较高,且可能遇到数值不稳定的问题。

3.3 共轭梯度法共轭梯度法是一种用于解决线性方程组的最优化算法。

它利用共轭方向上的信息以减少最优化问题的迭代次数。

共轭梯度法适用于大规模线性方程组的求解,并且在非线性优化问题中也得到了广泛应用。

3.4 遗传算法遗传算法是一种通过模拟生物进化过程寻找最优解的优化算法。

它通过交叉、变异等操作生成新的解,并通过适应度评估筛选出优秀的解。

遗传算法适用于搜索空间较大、复杂度较高的优化问题。

4. 最优化方法的应用最优化方法在各个领域都有广泛的应用。

在经济学领域,最优化方法可以用于优化生产资源的配置、最小化成本或最大化利润等问题。

它可以帮助决策者制定最优的决策方案,提高效益。

第2章 无约束优化计算的基本原理(Fundamental principle ofnon-constrained optimization computation )无约束优化问题 Δmin f (X )注:ma 是目标函数(objective function)x f (X )min(f (X ))=−*X 是f (X )的一个局部极小(值)点(local minimal point)Δ>*f (X )f (X )(*X (X )∀∈Ω开邻域(open neighborhood))*X 是f (X )的一个全局最小(值)点(global minimal point)Δ*f (X )f (X )≥(n X R ∀∈)§2.1最优性条件(Optimality conditions )一、必要条件对于一元可微函数()f x 在极小值点*x 有*()0′=f x ,类似的对多元函数有: 定理2-1-1 连续可微,)(X f *X 极小点⇒0)(*=∇X f ⇒≠∇0)(*X f 取)()()()()(****λλλo p X f X f p X f X f p T +∇+=+⇒−∇=2*****()()()()()()(T )f X f X f X o f X f X o λλλ=−∇⋅∇+=−∇+λ⇒当0>λ且充分小,有***()()()()*X p X f X p f X λλ+∈Ω⇒+≥可行域内 ⇒22**()()()00()0o f X o f X λλλλ−∇+≥⇒≤∇≤→⇒与∇矛盾*()0f X ≠注:①*X 是的驻点(stationary point))(X f Δ0)(*=∇X f②对满足3312)x x =−在0(0,0)T X =定理2-1-2 二阶连续可微, )(X f *X 是极小点⇒, 半正定(semi-definite)0)(*=∇X f )(*2X f ∇⇒)(X f 二阶连续可微可微⇒)(X f ⇒0)(*=∇X f )(*2X f ∇非半正定⇒, 0p ∃≠∋0)(*2<∇p X f p T ⇒)()(**X f p X f =+λ)()()()(22*2*22λλλo X f <o p X f p T ++∇+⇒λ充分小,有与)()(**X f p X f <+λ⇒*X 极小点矛盾。