Epson 机器人视觉引导标定操作指导手册

- 格式:pdf

- 大小:1.10 MB

- 文档页数:8

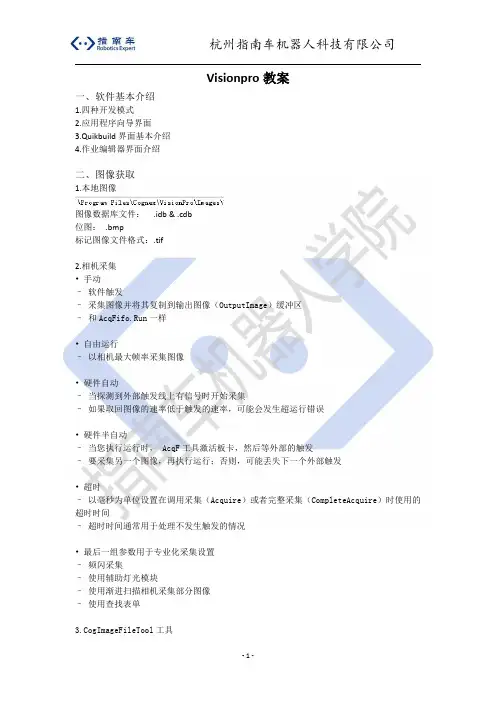

Visionpro教案一、软件基本介绍1.四种开发模式2.应用程序向导界面3.Quikbuild界面基本介绍4.作业编辑器界面介绍二、图像获取1.本地图像图像数据库文件:.idb&.cdb位图:.bmp标记图像文件格式:.tif2.相机采集•手动–软件触发–采集图像并将其复制到输出图像(OutputImage)缓冲区–和AcqFifo.Run一样•自由运行–以相机最大帧率采集图像•硬件自动–当探测到外部触发线上有信号时开始采集–如果取回图像的速率低于触发的速率,可能会发生超运行错误•硬件半自动–当您执行运行时,AcqF工具激活板卡,然后等外部的触发–要采集另一个图像,再执行运行;否则,可能丢失下一个外部触发•超时–以毫秒为单位设置在调用采集(Acquire)或者完整采集(CompleteAcquire)时使用的超时时间–超时时间通常用于处理不发生触发的情况•最后一组参数用于专业化采集设置–频闪采集–使用辅助灯光模块–使用渐进扫描相机采集部分图像–使用查找表单3.CogImageFileTool工具保存图片(.idb.cdb.bmp.tif.jpg.png)从现有文件读取图片三、图像处理工具1.Histgram工具对图像进行统计分析,生成灰度直方图及像素统计结果2.PMALign工具模板匹配工具:先训练模板,在搜索区域内搜索和模板匹配的对象训练参数:三种算法(patmax/patflex/patquick)训练模式(图像、建模)极性、粒度(粗糙粒度、精细粒度)、弹性、信息训练区域与中心原点:中心原点涉及精度问题图像掩膜器:盖住需要忽略的部分运行参数:查找概数、接受阈值角度、缩放、X缩放、Y缩放六种自由度搜索区域:在定义的搜索区域搜索模板图形:显示粗糙,显示精细显示所训练模板的特征结果显示:显示工具运行的结果添加输出终端练习:U盘定位、产品计数LSearch/PatInspect/SearchMaxCNLSearch:定位、存在或缺失、测量、检测PatInspect:将输入图像中某一区域的特征与预先训练的模型进行比较,然后俩者之间的偏差高亮显示,输出图像中的高亮部分即为图像的缺陷。

视觉导向机器人使用LabVIEW坐标标定方法视觉导向机器人使用LabVIEW坐标标定方法使用 LabVIEW 和用于 DENSO 的 ImagingLab RoboTIcs 库,机器视觉和机器人系统可以集成在一个应用程序中。

本文介绍了使用相同坐标系统在机器视觉系统和机器人系统之间进行标定的方法。

1.背景本文是用于 DENSO 的 ImagingLab RoboTIcs 库参考指南的一部分,并且假设您已经熟悉该库的基本使用方法。

如果需要回顾这些主题或阅读该机器人库的介绍,请点击上文的参考指南的链接。

2.标定机器视觉系统和机器人之间的桥梁是共享的坐标系。

机器视觉系统定位相应部位并将位置汇报给机器人,但是要指导机器人移动到该位置,系统必须将坐标转换为机器人可以接受的单位。

标定可以让机器视觉系统可以用实际世界的单位(例如毫米)报告位置,而这正是机器人的笛卡儿坐标系所使用的单位。

标定的常见方法是使用点网格。

要获得关于图像标定的进一步的信息,请参阅 NI 视觉概念手册。

您可以使用点网格对机器视觉系统进行标定,还可以对带有机器视觉系统的机器人进行标定。

在标定机器视觉系统时,您必须选择原点定义x-y 平面。

通常选择位于角落的点作为原点,然后选择行或列作为 x 轴。

为机器人创建坐标系的方法是相似的,因此您使用机器视觉系统的标定网络的原点作为机器人的原点。

方法很简单,只要将机器人移动到该点,将该位置存储为机器人控制器上的位置变量,在x 轴和y 轴中移动机器人,将这些位置作为位置变量进行存储。

您可以使用LabVIEW 或 DENSO 的教学模式存储这些位置变量。

完成这些之后,您可以使用DENSO 的教学模式根据先前所存储的三个位置变量自动计算坐标系或工作区域。

要使用DENSO 的教学模式的自动计算工具,从主屏幕选择手臂附加功能工作自动计算。

在打开的自动计算菜单中,只需选择之前存储的原点、x 轴和 x-y 平面相应的位置变量即可。

机器人控制器 控制单元 RC700RC700-A驱动单元 RC700DURC700DU-A编程软件 EPSON RC+7.0机器人 G1 G3 G6 G10 G20 系列RS 系列C4 C8 C12 系列N2 N6 系列X5 系列机器人系统安全与设置(RC700/EPSON RC+7.0)Rev.24机器人系统安全与设置(RC700 / EPSON RC+ 7.0)Rev.24Copyright 2012-2020 SEIKO EPSON CORPORATION. All rights reserved. 安全与设置(RC700 / EPSON RC+ 7.0) Rev.24 i前言感谢您购买本公司的机器人系统。

本手册记载了正确使用示教器所需的事项。

使用系统之前,请阅读本手册与相关手册,正确地进行使用。

阅读之后,请妥善保管,以便随时取阅。

保修本机及其选装部件是经过本公司严格的质量控制、测试和检查,并在确认性能满足本公司标准之后出厂交付的。

在交付产品的保修期内,本公司仅对正常使用时发生的故障进行免费修理。

(有关保修期方面的信息,请与当地销售商联系。

)但在以下情况下,将对客户收取修理费用(即使发生在保修期内):1. 因不同于使用说明书内容的错误使用以及使用不当而导致的故障与损伤。

2. 客户擅自改造或拆卸造成的故障。

3. 因调整不当/擅自修理而导致的损坏。

4. 因地震、洪水等自然灾害导致的损坏警告、注意、使用:1. 如果机器人或相关设备的使用超出本手册所述的使用条件及产品规格,将导致保修无效。

2. 本公司对因未遵守本手册记载的“警告”与“注意”而导致的任何故障或事故,甚至是人身伤害或死亡均不承担任何责任,敬请谅解。

3. 本公司不可能完全预见危险与故障发生的所有状况,此可预见性存在局限性。

因此,本手册不能警告用户所有可能的危险。

ii 安全与设置(RC700 / EPSON RC+ 7.0) Rev.24商标Microsoft、Windows及Windows标识为美国Microsoft Corporation在美国及其它国家的注册商标或商标。

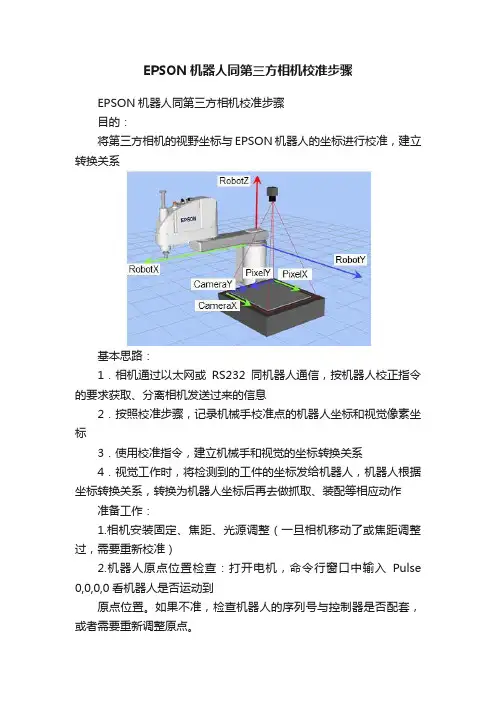

EPSON机器人同第三方相机校准步骤EPSON机器人同第三方相机校准步骤目的:将第三方相机的视野坐标与EPSON机器人的坐标进行校准,建立转换关系基本思路:1.相机通过以太网或RS232同机器人通信,按机器人校正指令的要求获取、分离相机发送过来的信息2.按照校准步骤,记录机械手校准点的机器人坐标和视觉像素坐标3.使用校准指令,建立机械手和视觉的坐标转换关系4.视觉工作时,将检测到的工件的坐标发给机器人,机器人根据坐标转换关系,转换为机器人坐标后再去做抓取、装配等相应动作准备工作:1.相机安装固定、焦距、光源调整(一旦相机移动了或焦距调整过,需要重新校准)2.机器人原点位置检查:打开电机,命令行窗口中输入Pulse 0,0,0,0看机器人是否运动到原点位置。

如果不准,检查机器人的序列号与控制器是否配套,或者需要重新调整原点。

3.制作9宫图校准板(注意4-5-6的方向是相反的,即上左->上中->上右->中右->中中->中左->下左->下中->下右)4.做作机器人工件坐标的校准工具。

一般要求末端是尖端,方便对位,可以稳固的装在Z轴或抓手上)相机安装方式:相机安装方式有以下几种:1 独立安装(相机坐标与机械手坐标不需要相互转换)2 固定安装(固定向上、固定向下)3 移动相机(J2轴移动,J4轴移动,J5J6轴移动)安装方式比较:使用固定安装,相机无法移动,拍摄范围小;但是视觉检测的时间一般可以用机器人工作的时间并列运行,节省节拍时间。

使用移动相机,相机跟随机器人移动,可以拍摄的范围大;但是视觉进行检测前,机器人必须有一定的静止时间(0.2s~0.5s);视觉进行检测时,机器人一般需要停止不动,不能进行其他工作;整体节拍时间会更长。

因为机器人本身有定位精度,使用移动相机时,视觉检测的精度一般也比使用固定相机的低。

校准步骤:每种安装方式均需要不同的校准方式。

独立安装:使用9宫格校准板,精确的测量该板9个点之间的坐标关系固定安装(固定向下)·使用九宫格校准板·机器人末端安装校准治具·示教治具末端的工具坐标T ool n·按照九宫图的顺序,机械手末端依次对准9个位置,机器人管理器中选择对应的T ool n,并保持点位置(如保持到P1到P9)·移开机器人,视觉识别九宫图上的9个点的像素坐标,同样按照九宫图顺序,将其像素坐标XY依次保存到P11-P19中。

机器人视觉导航技术的实验操作指南导语:机器人视觉导航技术是一项涵盖计算机视觉、深度学习和机器学习等领域的前沿技术。

本文将为您提供一份详细的实验操作指南,帮助您了解机器人视觉导航技术的实践应用和操作流程。

一、实验目的机器人视觉导航技术的实验操作旨在探索和验证机器人利用视觉信息进行导航和定位的能力。

通过该实验,可以深入了解机器人如何使用相机或深度传感器来感知环境,并通过图像处理和机器学习算法实现自主导航。

二、实验所需设备1. 机器人平台:选择适用的室内移动机器人平台,如Turtlebot、Pepper 等。

2. 视觉传感器:常用的选择是RGB相机或深度传感器,如Microsoft Kinect、Intel RealSense等。

3. 电脑:安装有相应开发环境和驱动程序的计算机,用于机器人控制和数据处理。

三、实验操作步骤1. 硬件配置a) 连接视觉传感器:将选择的视觉传感器与机器人平台连接,确保传感器正常工作并正确获得图像或深度数据。

b) 电脑连接:将计算机与机器人平台连接,确保能够通过命令行或GUI界面发送控制指令和接收传感器数据。

2. 软件配置a) 系统安装:根据机器人平台的要求,安装相应的操作系统和驱动程序。

b) 开发环境安装:安装机器人操作系统(如ROS),以及与机器人平台和视觉传感器兼容的软件包和库。

c) 配置文件设置:根据实验需求,进行相机或传感器的配置文件设置,包括分辨率、图像帧率等参数。

d) ROS节点设置:配置ROS节点参数和启动文件,确保机器人平台和传感器的正常通信。

3. 数据采集a) 建立地图:通过手动或自动方式,在实验环境中建立地图,记录机器人需要导航的目标地点和相关区域。

b) 数据采集:在各个目标地点和环境中,利用机器人的视觉传感器,采集图像、深度图或点云数据,并保存到计算机中。

4. 视觉导航算法实现a) 视觉数据预处理:对采集到的图像或传感器数据进行必要的预处理,如去噪、滤波和校正等。