神经网络逼近函数

- 格式:doc

- 大小:84.50 KB

- 文档页数:5

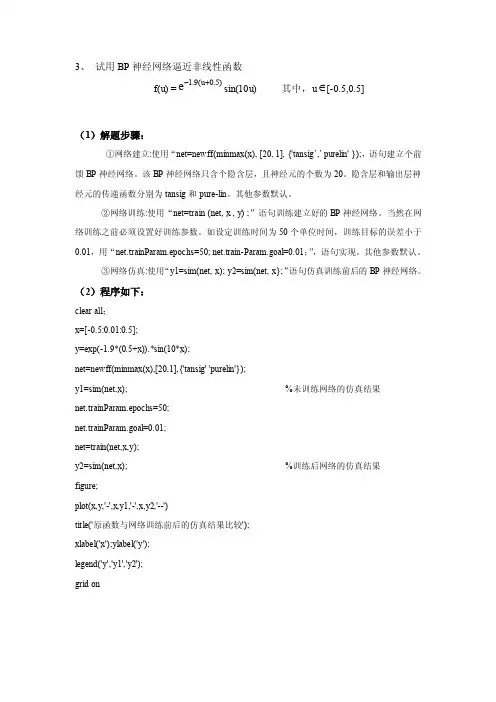

3、 试用BP 神经网络逼近非线性函数f(u) =)5.0u (9.1e+-sin(10u) 其中,u ∈[-0.5,0.5](1)解题步骤:①网络建立:使用“net=newff(minmax(x), [20, 1], {'tansig ’,’ purelin' });,语句建立个前馈BP 神经网络。

该BP 神经网络只含个隐含层,且神经元的个数为20。

隐含层和输出层神经元的传递函数分别为tansig 和pure-lin 。

其他参数默认。

②网络训练:使用“net=train (net, x , y) ;”语句训练建立好的BP 神经网络。

当然在网络训练之前必须设置好训练参数。

如设定训练时间为50个单位时间,训练目标的误差小于0.01,用“net.trainParam.epochs=50; net.train-Param.goal=0.01;”,语句实现。

其他参数默认。

③网络仿真:使用“y1=sim(net, x); y2=sim(net, x};”语句仿真训练前后的BP 神经网络。

(2)程序如下:clear all ;x=[-0.5:0.01:0.5];y=exp(-1.9*(0.5+x)).*sin(10*x);net=newff(minmax(x),[20,1],{'tansig' 'purelin'});y1=sim(net,x); %未训练网络的仿真结果 net.trainParam.epochs=50;net.trainParam.goal=0.01;net=train(net,x,y);y2=sim(net,x); %训练后网络的仿真结果 figure;plot(x,y,'-',x,y1,'-',x,y2,'--')title('原函数与网络训练前后的仿真结果比较');xlabel('x');ylabel('y');legend('y','y1','y2');grid on(3)仿真结果如图:图1图1为原函数y与网络训练前后(y1,y2)的仿真结果比较图。

卷积神经网络逼近非线性函数卷积神经网络(Convolutional Neural Network,简称CNN)是一种在深度研究领域广泛应用的神经网络模型,能够有效地逼近非线性函数。

1. 简介卷积神经网络由多个卷积层、池化层和全连接层组成。

通过卷积层和池化层的运算,CNN能够从输入数据中提取特征,并逐步抽象出更高级别的特征。

最后,通过全连接层对提取的特征进行分类或回归,实现对非线性函数的逼近。

2. 卷积层卷积层是卷积神经网络的核心部分。

通过卷积操作,卷积层能够有效地捕捉输入数据中的局部特征。

卷积操作使用一组可研究的卷积核对输入数据进行滑动窗口计算,生成卷积特征图。

卷积层可以通过增加卷积核的数量和尺寸来增加特征维度和感知野的范围,从而提取更丰富的特征。

3. 池化层池化层用于减小特征图的尺寸,减少计算量,并保留重要的特征。

最大池化是一种常用的池化操作,它通过在特定区域内选择最大值来表示该区域的特征。

池化层的使用能够提高模型的平移不变性和鲁棒性。

4. 全连接层全连接层是卷积神经网络的最后一层,用于将提取到的特征映射到最终的输出。

全连接层中的每个神经元都与前一层中的所有神经元连接,通过研究权重来实现特征的组合和分类。

全连接层的输出可以用于分类任务或回归任务,实现对非线性函数的逼近。

5. 总结卷积神经网络是一种强大的机器学习模型,能够逼近非线性函数。

通过卷积层、池化层和全连接层的组合,CNN能够自动提取输入数据中的特征,并使用这些特征进行分类或回归。

在实际应用中,我们可以通过调整网络结构和参数来优化卷积神经网络的性能,以更好地逼近非线性函数。

深度学习神经网络逼近非线性函数深度研究神经网络是一种强大的机器研究模型,被广泛应用于各个领域,包括图像识别、自然语言处理等。

它通过多层神经元来建模复杂的非线性函数关系,可以实现对非线性函数的逼近。

神经网络基础神经网络由输入层、隐藏层和输出层组成。

输入层接收输入数据,隐藏层负责对输入进行加工和提取特征,输出层则生成最终的预测结果。

每个神经元在隐藏层和输出层都会进行激活函数的运算,将线性变换后的结果转化为非线性的输出。

非线性函数逼近深度研究神经网络能够逼近非线性函数的原因在于其多层结构。

每一层的神经元都可以研究到不同级别的特征表示,通过多层的组合与堆叠,神经网络能够模拟和逼近非常复杂的非线性函数。

激活函数的重要性激活函数是神经网络中非常重要的组成部分,它引入了非线性因素,使得神经网络能够处理非线性问题。

常见的激活函数有Sigmoid函数、ReLU函数等,它们可以将线性变换的结果映射到非线性的输出,增强神经网络的表达能力。

深度研究的训练深度研究神经网络的训练过程通常使用反向传播算法。

该算法通过计算实际输出与期望输出之间的误差,然后根据误差调整神经网络的权重和偏置,以逐渐提高网络的预测准确性。

通过反复迭代训练,神经网络可以逐渐优化和逼近目标非线性函数。

应用领域深度研究神经网络广泛应用于图像识别、语音识别、自然语言处理等领域。

例如,在图像识别中,神经网络可以通过研究大量图像样本来识别物体、人脸等;在自然语言处理中,神经网络可以对文本进行分类、情感分析等任务。

深度研究神经网络的强大逼近能力使得它在这些领域具有很高的应用价值。

结论深度学习神经网络通过多层神经元和非线性激活函数的组合,能够逼近非线性函数。

它是一种强大的机器学习模型,在各个领域都有广泛的应用。

随着深度学习技术的不断发展,我们相信神经网络将会在更多领域展现出强大的能力和应用前景。

函数逼近的几种算法及其应用

一、神经网络

神经网络(neural network)是一种用于模仿人类神经系统的计算模型,它使用多层层次的神经元组成的网络结构来进行复杂的计算,并以调整连接强度的方式来实现学习。

它主要应用于图像识别、语音识别、自动驾驶、推荐系统以及机器翻译等领域。

1.应用于图像识别

2.应用于语音识别

神经网络在语音识别方面也是十分重要的,它可以识别用户说的话,并且做出相应的回应,大大提升了用户的体验。

此外,神经网络也可以用来实现语音识别,从而实现对用户语音输入的理解,从而将用户输入的文本转换成机器可以理解的文本。

3.应用于自动驾驶

神经网络也可以用于自动驾驶,例如它可以帮助自动驾驶车辆在公路上行驶,并在行驶过程中识别路面障碍物,从而避免发生危险。

rbf逼近函数代码RBF(Radial Basis Function,径向基函数)是一种常用于逼近复杂非线性函数的方法之一。

RBF 网络是一种人工神经网络,通过将输入数据映射到高维空间,并使用径向基函数进行逼近。

下面是一个简单的Python 代码示例,使用RBF 网络逼近一个非线性函数。

这里使用的是高斯径向基函数:```pythonimport numpy as npimport matplotlib.pyplot as pltfrom scipy.interpolate import Rbf# 生成一些用于逼近的数据x = np.linspace(0, 10, 100)y = np.sin(x) + 0.1 * np.random.randn(100) # 非线性函数+ 噪声# 构建RBF 模型rbf_model = Rbf(x, y, function='gaussian')# 在输入范围内生成一些点x_interp = np.linspace(0, 10, 1000)# 使用RBF 模型进行逼近y_interp = rbf_model(x_interp)# 绘制原始数据和逼近结果plt.scatter(x, y, label='Original Data')plt.plot(x_interp, y_interp, color='red', label='RBF Interpolation')plt.legend()plt.title('RBF Interpolation')plt.xlabel('X')plt.ylabel('Y')plt.show()```这个例子中,我们使用了`scipy` 库中的`Rbf` 类。

首先,我们生成了一些带有噪声的非线性数据。

然后,我们使用RBF 网络进行逼近。

函数逼近的几种算法及其应用汇总

一、函数逼近的几种算法

1、最小二乘法

最小二乘法是一种基于线性模型的函数逼近算法,它的基本假设是拟合函数的形状可以用线性模型表示,且被拟合数据存在一定的噪声存在,最小二乘法的核心思想就是最小化残差(拟合数据与模型之间的偏差)的平方和来寻找最佳拟合参数。

2、Kriging

Kriging(克里金插值)是一种基于空间相关数据的空间插值算法,它会根据空间相关性分析,通过构建模型,拟合、估计和预测空间数据之间的关系,从而实现函数逼近。

3、K近邻算法

K近邻(K Nearest Neighbors Algorithm)是一种基于实例学习的分类算法,它通过计算测试实例与训练实例之间的距离,来决定其所属的类别。

K近邻算法也可以用于函数逼近,这种方法无需训练阶段,可以快速的拟合不同的函数,而且拟合函数的过程中也不需要优化参数。

4、神经网络

神经网络是一类用于函数逼近的算法,它通过模拟人脑神经网络的连接模式,在一系列训练数据的基础上,得到一些函数的参数,从而实现函数的拟合和预测。

二、函数逼近算法的应用

1、多元线性回归

多元线性回归利用最小二乘法,可以对多元关系进行拟合。

实验二基于BP神经网络算法的函数逼近一、引言函数逼近是神经网络应用的重要领域之一、在实际问题中,我们常常需要使用一个适当的数学函数来近似描述现象与问题之间的关系。

BP神经网络作为一种常用的函数逼近方法,具有良好的逼近性能和普适性,能够对非线性函数进行逼近,并且在实际应用中已经得到了广泛的应用。

本实验将通过BP神经网络算法对给定的函数进行逼近,验证其逼近效果和性能。

二、实验目标1.理解和掌握BP神经网络算法的基本原理和步骤;2.掌握使用BP神经网络进行函数逼近的方法;3.通过实验验证BP神经网络在函数逼近中的性能。

三、实验步骤1.准备数据集选择一个待逼近的非线性函数,生成一组训练数据和测试数据。

训练数据用于训练神经网络模型,测试数据用于评估逼近效果。

2.构建神经网络模型根据待逼近的函数的输入和输出维度,确定神经网络的输入层和输出层的神经元个数,并选择适当的激活函数和损失函数。

可以根据实际情况调整隐藏层的神经元个数,并添加正则化、dropout等技术来提高模型的泛化能力。

3.初始化网络参数对于神经网络的参数(权重和偏置)进行随机初始化,通常可以采用均匀分布或高斯分布来初始化。

4.前向传播和激活函数通过输入数据,进行前向传播计算,得到网络的输出值,并通过激活函数将输出值映射到合适的范围内。

5.计算损失函数根据网络的输出值和真实值,计算损失函数的值,用于评估模型的训练效果。

6.反向传播和权重更新通过反向传播算法,计算各个参数的梯度,根据学习率和梯度下降算法更新网络的参数。

7.循环迭代训练重复以上步骤,直至达到预设的训练停止条件(如达到最大迭代次数或损失函数满足收敛条件)。

8.模型测试和评估使用测试数据评估训练好的模型的逼近效果,可以计算出逼近误差和准确度等指标来评估模型的性能。

四、实验结果通过对比逼近函数的真实值和模型的预测值,可以得到模型的逼近效果。

同时,通过计算逼近误差和准确度等指标来评估模型的性能。

RBF神经网络的函数逼近能力及其算法RBF(径向基函数)神经网络是一种用于函数逼近的非线性神经网络模型。

它具有强大的函数逼近能力,并且在许多领域中被广泛应用。

RBF神经网络由输入层、隐含层和输出层组成,其中隐含层是其核心组成部分。

隐含层包含一组径向基函数,这些函数将输入映射到一组隐含单元上。

每个隐含单元使用一个径向基函数计算输出,这个函数是以该隐含单元为中心的高斯函数。

RBF神经网络的函数逼近能力还受到其隐藏单元数量和径向基函数的选择的影响。

隐含单元的数量越多,网络的逼近能力越强,但也容易导致过拟合。

同时,选择适当的径向基函数也是至关重要的。

常见的径向基函数包括高斯函数、多项式函数和sigmoid函数,它们具有不同的特点和适用范围。

RBF神经网络的训练算法通常使用两个步骤:聚类和最小二乘法。

聚类步骤用于确定隐含单元的位置,最小化输入数据点与隐含单元之间的距离。

常用的聚类算法有K-means算法和自组织映射算法。

最小二乘法步骤用于确定径向基函数的参数,以最小化训练数据点与神经网络输出之间的误差。

这可以通过线性回归或最小二乘法来实现。

总之,RBF神经网络具有强大的函数逼近能力,可以逼近任意复杂的非线性函数。

其核心算法包括聚类和最小二乘法,通过确定隐含单元和径向基函数的参数来实现函数逼近。

这使得RBF神经网络在多个领域中得到广泛应用,包括模式识别、时间序列预测、图像处理等。

神经网络作业作业说明第一题(函数逼近):BP网络和RBF网络均是自己编写的算法实现。

BP网络均采用的三层网络:输入层(1个变量)、隐层神经元、输出层(1个变量)。

转移函数均为sigmoid函数,所以没有做特别说明。

在第1小题中贴出了BP和RBF的Matlab代码,后面的就没有再贴出;而SVM部分由于没有自己编写,所以没有贴出。

而针对其所做的各种优化或测试,都在此代码的基础上进行,相应参数的命名方式也没有再改变。

RBF网络使用了聚类法和梯度法两种来实现。

而对于SVM网络,在后面两题的分类应用中都是自己编写的算法实现,但在本题应用于函数逼近时,发现效果很差,所以后来从网上下载到一个SVM工具包LS-SVMlab1.5aw,调用里面集成化的函数来实现的,在本题函数逼近中均都是采用高斯核函数来测试的。

第二题(分类):BP网络和RBF网络都是使用的Matlab自带的神经网络工具包来实现的,不再贴出代码部分。

而SVM网络则是使用的课上所教的算法来实现的,分别测试了多项式核函数和高斯核函数两种实现方法,给出了相应的Matlab代码实现部分。

第三题:由于问题相对简单,所以就没有再使用Matlab进行编程实现,而是直接进行的计算。

程序中考虑到MATLAB处理程序的特性,尽可能地将所有的循环都转换成了矩阵运算,大大加快了程序的运行速度。

编写时出现了很多错误,常见的如矩阵运算维数不匹配,索引值超出向量大小等;有时候用了很麻烦的运算来实现了后来才知道原来可以直接调用Matlab里面的库函数来实现以及怎么将结果更清晰更完整的展现出来等等。

通过自己编写算法来实现各个网络,一来提升了我对各个网络的理解程度,二来使我熟悉了Matlab环境下的编程。

1.函数拟合(分别使用BP,RBF,SVM),要求比较三个网络。

2π.x ,05x)sin(5x)exp(y(x)4π.x ,0xsinx y(x)100.x x),1exp(y(x)100.x ,1x1y(x)≤≤-=≤≤=≤≤-=≤≤=解:(1).1001,1)(≤≤=x x x ya. BP 网络:Matlab 代码如下:nv=10; %神经元个数:10个err=0.001; %误差阈值J=1; %误差初始值N=1; %迭代次数u=0.2; %学习率wj=rand(1,nv); %输入层到隐层神经元的权值初始化wk=rand(1,nv); %隐层神经元到输出层的权值初始化xtrain=1:4:100; %训练集,25个样本xtest=1:1:100; %测试集,100个dtrain=1./xtrain; %目标输出向量,即教师%训练过程while (J>err)&&(N<100000)uj=wj'*xtrain;h=1./(1+exp(-uj)); %训练集隐层神经元输出uk=wk*h;y=1./(1+exp(-uk)); %训练集输出层实际输出delta_wk = u*(dtrain-y).*y.*(1-y)*h'; %权值调整delta_wj = u*wk.*(((dtrain-y).*y.*(1-y).*xtrain)*(h.*(1-h))'); wk = wk+delta_wk;wj = wj+delta_wj;J=0.5*sum((dtrain-y).^2); %误差计算j(N)=J;N=N+1;end%测试及显示uj=wj'*xtest;h=1./(1+exp(-uj));uk=wk*h;dtest=1./(1+exp(-uk));figuresubplot(1,2,1),plot(xtest,dtest,'ro',xtest,1./xtest);legend('y=1/x', 'network output');subplot(1,2,2),plot(xtest,1./xtest-dtest);x=1:N-1;figureplot(x,j(x));运行条件:10个神经元,误差迭代阈值为0.001.学习率为0.2。

实验一、BP及RBF神经网络逼近一、实验目的1、了解MATLAB集成开发环境2、了解MATLAB编程基本方法3、熟练掌握BP算法的原理和步骤4、掌握工具包入口初始化及调用5、加深BP、RBF神经网络对任意函数逼近的理解二、实验内容1、MATLAB基本指令和语法。

2、BP算法的MATLAB实现三、实验步骤1、熟悉MATLAB开发环境2、输入参考程序3、设置断点,运行程序,观察运行结果四、参考程序1. BP算法的matlab实现程序%lr为学习步长,err_goal期望误差最小值,max_epoch训练的最大次数,隐层和输出层初值为零lr=0.05;err_goal=0.0001;max_epoch=10000;a=0.9;Oi=0;Ok=0;%两组训练集和目标值X=[1 1;-1 -1;1 1];T=[1 1;1 1];%初始化wki,wij(M为输入节点j的数量;q为隐层节点i的数量;L为输出节点k的数量)[M,N]=size(X);q=8;[L,N]=size(T);wij=rand(q,M);wki=rand(L,q);wij0=zeros(size(wij));wki0=zeros(size(wki));for epoch=1:max_epoch%计算隐层各神经元输出NETi=wij*X;for j=1:Nfor i=1:qOi(i,j)=2/(1+exp(-NETi(i,j)))-1;endend%计算输出层各神经元输出NETk=wki*Oi;for i=1:Nfor k=1:LOk(k,i)=2/(1+exp(-NETk(k,i)))-1;endend%计算误差函数E=((T-Ok)'*(T-Ok))/2;if (E<err_goal)break;end%调整输出层加权系数deltak=Ok.*(1-Ok).*(T-Ok);w=wki;wki=wki+lr*deltak*Oi';wki0=w;%调整隐层加权系数deltai=Oi.*(1-Oi).*(deltak'*wki)';w=wij;wij=wij+lr*deltai*X';wij0=w;endepoch %显示计算次数%根据训练好的wki,wij和给定的输入计算输出X1=X;%计算隐层各神经元的输出NETi=wij*X1;for j=1:Nfor i=1:qOi(i,j)=2/(1+exp(-NETi(i,j)))-1;endend%计算输出层各神经元的输出NETk=wki*Oi;for i=1:Nfor k=1:LOk(k,i)=2/(1+exp(-NETk(k,i)))-1;endendOk %显示网络输出层的输出2、BP逼近任意函数算法的matlab实现程序⏹X=-4:0.08:4;⏹T=1.1*(1-X+2*X.^2).*exp(-X.^2./2);⏹net=newff(minmax(X),[20,1],{'tansig','purelin'});⏹net.trainParam.epochs=15000;⏹net.trainParam.goal=0.001;⏹net=train(net,X,T);⏹X1=-1:0.01:1;⏹y=sim(net,X1);⏹figure;⏹plot(X1,y,'-r',X,T,':b','LineWidth',2);3.RBF能够逼近任意的非线性函数⏹X=-4:0.08:4;⏹T=1.1*(1-X+2*X.^2).*exp(-X.^2./2);⏹net=newrb(X,T,0.002,1);⏹X1=-1:0.01:1;⏹y=sim(net,X1);⏹figure;⏹plot(X1,y,'-r',X,T,':b','LineWidth',3);五、思考题1. 将结果用图画出。

神经网络近似函数

题目:

采用神经网络逼近下列函数: 双极值型算例

9655

.0,537.0]

3,0[2/)3)(89.22.3()(max max 2==∈-+--=f x x x x x x x f 最优值

解:

)(x f 的实际图如下:

神经网络训练前:

应用newff()函数建立BP 网络结构。

隐层神经元数目n 可以改变,暂设为n=5,输出层有一个神经元。

选择隐层和输出层神经元传递函数分别为tansig 函数和purelin 函数,网络训练的算

法采用Levenberg – Marquardt算法trainlm。

因为使用newff( )函数建立函数网络时,权值和阈值的初始化是随机的,所以网络输出结构很差,根本达不到函数逼近的目的,每次运行的结果也不同。

神经网络训练后

应用train()函数对网络进行训练之前,需要预先设置网络训练参数。

将训练时间设置为500,训练精度设置为0.001,其余参数使用缺省值。

训练后得到的误差变化过程如下所示。

由上图可知,逼近结果未达到目标,为此我们增加神经元数目n=20;

仿真结果如下:

0.5

1

1.52

2.5

3

00.10.20.30.40.50.60.70.80.91 X: 0.557Y: 0.9642

原函数与网络训练后的仿真比较

x

y

y y2

至此,神经网络逼近结果符合要求。

下图是训练时间图:

从以上结果可以看出,网络训练速度很快,很快就达到了要求的精度0.001。

结论:

1.n 取不同的值对函数逼近的效果有很大的影响。

改变BP 网络隐层神经元的数目,可以改变BP 神经网络对于函数的逼近效果。

隐层神经元数目越多,则BP 网络逼近非线性函数的能力越强。

(左边n=3,右边n=20)

2.不同的精度要求,对函数的逼近效果也不同。

精度要求越高,逼近效果越好。

(左边精度为0.01,右边为0.001)

程序文本:

clear all;

x=[0:0.001:3];

y=-x.*(x.*x-3.2*x+2.89).*(x-3)/2.0;

net=newff(minmax(x),[5,1],{'tansig''purelin'},'trainlm');

y1=sim(net,x); %神经网络训练前

net.trainParam.epochs=500;

net.trainParam.goal=0.001;

net=train(net,x,y);

y2=sim(net,x);

figure;

plot(x,y,'-',x,y1,'-.',x,y2,'--');

title('原函数与神经网络训练前后的仿真比较'); xlabel('x');ylabel('y');

legend('y','y1','y2');

grid on。