Matlab PSO优化RBF的程序

- 格式:doc

- 大小:32.50 KB

- 文档页数:4

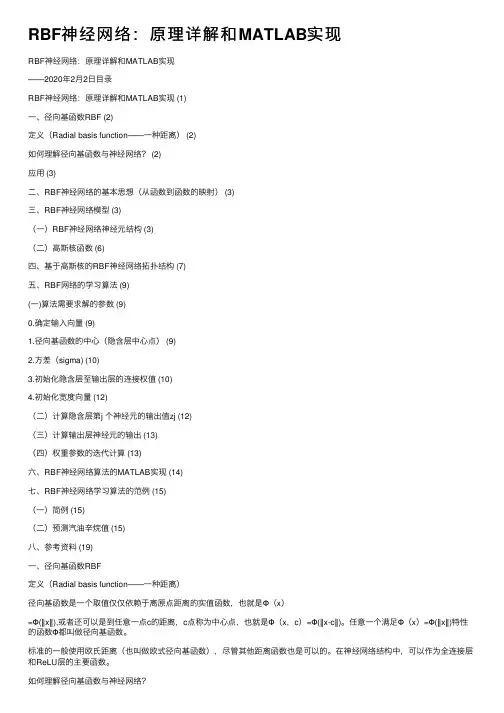

RBF神经⽹络:原理详解和MATLAB实现RBF神经⽹络:原理详解和MATLAB实现——2020年2⽉2⽇⽬录RBF神经⽹络:原理详解和MATLAB实现 (1)⼀、径向基函数RBF (2)定义(Radial basis function——⼀种距离) (2)如何理解径向基函数与神经⽹络? (2)应⽤ (3)⼆、RBF神经⽹络的基本思想(从函数到函数的映射) (3)三、RBF神经⽹络模型 (3)(⼀)RBF神经⽹络神经元结构 (3)(⼆)⾼斯核函数 (6)四、基于⾼斯核的RBF神经⽹络拓扑结构 (7)五、RBF⽹络的学习算法 (9)(⼀)算法需要求解的参数 (9)0.确定输⼊向量 (9)1.径向基函数的中⼼(隐含层中⼼点) (9)2.⽅差(sigma) (10)3.初始化隐含层⾄输出层的连接权值 (10)4.初始化宽度向量 (12)(⼆)计算隐含层第j 个神经元的输出值zj (12)(三)计算输出层神经元的输出 (13)(四)权重参数的迭代计算 (13)六、RBF神经⽹络算法的MATLAB实现 (14)七、RBF神经⽹络学习算法的范例 (15)(⼀)简例 (15)(⼆)预测汽油⾟烷值 (15)⼋、参考资料 (19)⼀、径向基函数RBF定义(Radial basis function——⼀种距离)径向基函数是⼀个取值仅仅依赖于离原点距离的实值函数,也就是Φ(x)=Φ(‖x‖),或者还可以是到任意⼀点c的距离,c点称为中⼼点,也就是Φ(x,c)=Φ(‖x-c‖)。

任意⼀个满⾜Φ(x)=Φ(‖x‖)特性的函数Φ都叫做径向基函数。

标准的⼀般使⽤欧⽒距离(也叫做欧式径向基函数),尽管其他距离函数也是可以的。

在神经⽹络结构中,可以作为全连接层和ReLU层的主要函数。

⼀些径向函数代表性的⽤到近似给定的函数,这种近似可以被解释成⼀个简单的神经⽹络。

径向基函数在⽀持向量机中也被⽤做核函数。

常见的径向基函数有:⾼斯函数,⼆次函数,逆⼆次函数等。

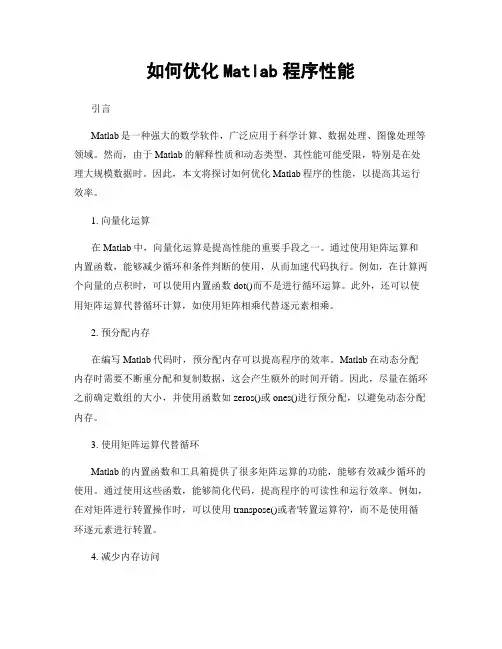

如何优化Matlab程序性能引言Matlab是一种强大的数学软件,广泛应用于科学计算、数据处理、图像处理等领域。

然而,由于Matlab的解释性质和动态类型,其性能可能受限,特别是在处理大规模数据时。

因此,本文将探讨如何优化Matlab程序的性能,以提高其运行效率。

1. 向量化运算在Matlab中,向量化运算是提高性能的重要手段之一。

通过使用矩阵运算和内置函数,能够减少循环和条件判断的使用,从而加速代码执行。

例如,在计算两个向量的点积时,可以使用内置函数dot()而不是进行循环运算。

此外,还可以使用矩阵运算代替循环计算,如使用矩阵相乘代替逐元素相乘。

2. 预分配内存在编写Matlab代码时,预分配内存可以提高程序的效率。

Matlab在动态分配内存时需要不断重分配和复制数据,这会产生额外的时间开销。

因此,尽量在循环之前确定数组的大小,并使用函数如zeros()或ones()进行预分配,以避免动态分配内存。

3. 使用矩阵运算代替循环Matlab的内置函数和工具箱提供了很多矩阵运算的功能,能够有效减少循环的使用。

通过使用这些函数,能够简化代码,提高程序的可读性和运行效率。

例如,在对矩阵进行转置操作时,可以使用transpose()或者'转置运算符',而不是使用循环逐元素进行转置。

4. 减少内存访问Matlab中的内存访问是一种相对较慢的操作,因此减少内存的访问次数是优化程序性能的关键。

可以通过使用局部变量、避免不必要的数组拷贝等方式减少内存访问。

此外,还可以通过调整数据存储的方式优化内存访问。

例如,将多维数组转换为线性存储的向量,以便减少内存访问的开销。

5. 避免重复计算在Matlab程序中,重复计算是一种常见的性能浪费。

如果某个计算结果在循环中多次使用,可以将其保存在变量中,避免重复计算。

此外,还可以通过使用函数如cumsum()、cumprod()等实现累计计算,避免重复计算累加或累乘的结果。

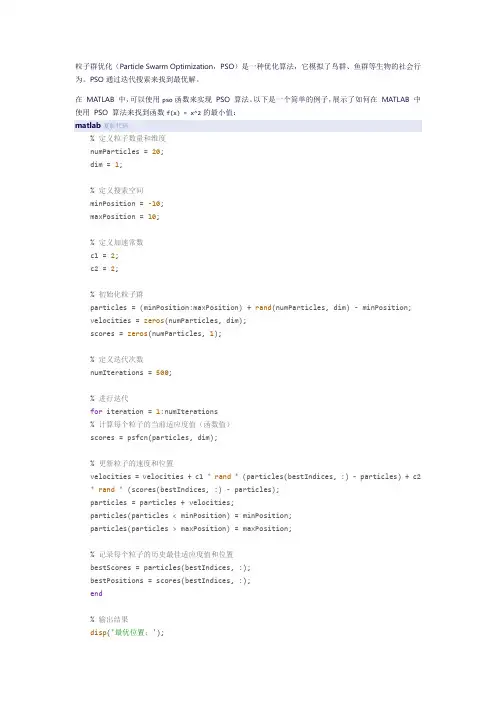

粒子群优化(Particle Swarm Optimization,PSO)是一种优化算法,它模拟了鸟群、鱼群等生物的社会行为。

PSO通过迭代搜索来找到最优解。

在MATLAB 中,可以使用pso函数来实现PSO 算法。

以下是一个简单的例子,展示了如何在MATLAB 中使用PSO 算法来找到函数f(x) = x^2的最小值:matlab复制代码% 定义粒子数量和维度numParticles = 20;dim = 1;% 定义搜索空间minPosition = -10;maxPosition = 10;% 定义加速常数c1 = 2;c2 = 2;% 初始化粒子群particles = (minPosition:maxPosition) + rand(numParticles, dim) - minPosition;velocities = zeros(numParticles, dim);scores = zeros(numParticles, 1);% 定义迭代次数numIterations = 500;% 进行迭代for iteration = 1:numIterations% 计算每个粒子的当前适应度值(函数值)scores = psfcn(particles, dim);% 更新粒子的速度和位置velocities = velocities + c1 * rand * (particles(bestIndices, :) - particles) + c2 * rand * (scores(bestIndices, :) - particles);particles = particles + velocities;particles(particles < minPosition) = minPosition;particles(particles > maxPosition) = maxPosition;% 记录每个粒子的历史最佳适应度值和位置bestScores = particles(bestIndices, :);bestPositions = scores(bestIndices, :);end% 输出结果disp('最优位置:');disp(bestPositions);disp('最优函数值:');disp(bestScores);在这个例子中,我们使用了一个简单的函数f(x) = x^2,并希望找到该函数的最小值。

pso算法matlab程序-回复主题:PSO算法MATLAB程序PSO(粒子群优化)算法是一种模拟鸟群觅食行为的优化算法,它能够在搜索空间中寻找最优解。

在本文中,将详细介绍如何使用MATLAB 编写PSO算法程序,并进行一步一步的解释。

首先,我们需要明确PSO算法的基本原理。

PSO算法通过模拟鸟群搜索食物的行为,来搜索问题的最优解。

其中,群体中的每个粒子代表一个潜在的解,而每个粒子都有自己的位置和速度。

粒子根据自身经验和整个群体的经验来调整自己的位置和速度,以寻找最优解。

接下来,我们可以开始编写MATLAB程序来实现PSO算法。

第一步,我们需要定义问题的目标函数。

目标函数是确定问题最优解的函数,根据具体问题的不同而不同。

在本文中,以最小化函数为例进行讲解。

假设我们要最小化的函数为f(x),其中x为待求解的参数。

第二步,我们需要定义粒子的初始位置和速度。

粒子的初始位置可以是随机分布在搜索空间中的任意值,而速度可以初始化为零。

我们可以使用MATLAB的随机函数来生成初始位置。

第三步,定义粒子的个体和群体最优位置。

个体最优位置是指粒子自身搜索到的最优解,而群体最优位置是根据整个群体的搜索结果得到的最优解。

第四步,编写主循环。

在主循环中,我们更新每个粒子的速度和位置,直到满足一定的停止条件。

更新速度和位置的公式如下:速度更新公式:v(t+1) = w * v(t) + c1 * rand() * (pbest - x(t)) + c2 * rand() * (gbest - x(t))位置更新公式:x(t+1) = x(t) + v(t+1)其中,v(t)表示t时刻的速度,x(t)表示t时刻的位置,w为惯性权重,c1和c2分别为加速因子1和2,pbest表示粒子的个体最优位置,gbest 表示群体最优位置。

第五步,更新个体和群体最优位置。

对于每个粒子而言,如果t时刻的位置优于个体最优位置,则更新个体最优位置;如果个体最优位置优于群体最优位置,则更新群体最优位置。

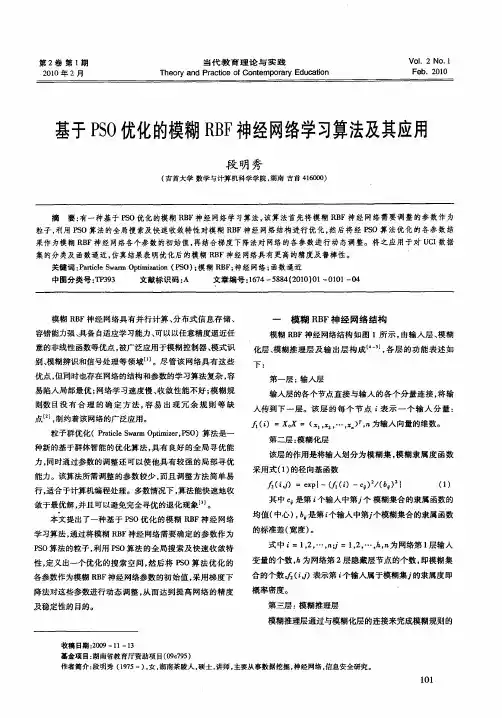

板球系统的PSO优化模糊RBF神经网络PID参数研究作者:王长正向凤红毛剑琳来源:《软件导刊》2018年第07期摘要:板球系统是一个典型的多变量、非线性控制系统。

针对板球系统在PID控制中震荡大、精度低、实时性差等问题,应用拉格朗日方程对板球系统在忽略干扰因素条件下进行数学建模,采用粒子群算法对模糊RBF神经网络初始参数进行优化,并设计RBF神经网络与模糊PID控制相结合的控制方法。

在MATALB环境下完成板球系统定位实验,仿真结果表明,经粒子群优化模糊RBF神经网络的PID参数后,提高了板球系统的定位精度,并增强了系统控制的实时性。

关键词:板球系统;粒子群算法;模糊RBF神经网络;MATLAB;PIDDOI:10.11907/rjdk.173124中图分类号:TP301文献标识码:A文章编号:1672-7800(2018)007-0014-05Abstract:Ballandplatesystemisamultivariable,nonlinearandcomplexunderactuateddynamicsystem.Accordingtothefixed-pointcontrolofballandplatesystem,weestablishthemathematicalmodeloftheLagrangeequationignoringtheinterferencefactorsofballandplate system.Aimingattheproblemsinballandplatefixed-pointcontrolsystem,suchasconcussion,lowprecisionandpoorreal-time,wedesignthecontrolmethodbycombiningRBFneuralnetworkwithfuzzyPIDcontrol,andtheinitialparametersoffuzzyRBFneuralnetworkareoptimizedbyparticleswarmoptimization.Thepositi oningcontrolsimulationexperimentofballandplatesystemiscompletedinMATLABenvironment,thesimulationresultsshowthatPIDparametersoffuzzyRBFneuralnetworkwhichoptimizedbyparticleswar moptimizationcanimprovetheprecisionoftheballandplatesystemfixed-pointcontrolandthereal-timenessofthesystem.KeyWords:ballandplatesystem;particleswarmoptimization;fuzzyRBFneuralnetwork;MATLAB;PID0引言板球系统是一个典型的非线性系统,具有强耦合、欠驱动和无约束的特点,是球杆系统的二维扩展,可用于验证控制算法的有效性。

pso算法matlab程序PSO(粒子群优化)算法是一种启发式优化算法,用于解决各种优化问题。

在Matlab中实现PSO算法可以通过以下步骤进行:1. 初始化粒子群:首先,定义需要优化的目标函数,然后确定粒子群的规模、搜索空间的范围、最大迭代次数等参数。

在Matlab中可以使用数组或矩阵来表示粒子群的位置和速度。

2. 计算适应度:根据目标函数,计算每个粒子的适应度值,以便评估其在搜索空间中的位置的好坏程度。

3. 更新粒子的速度和位置:根据PSO算法的公式,更新每个粒子的速度和位置。

这个过程涉及到调整粒子的速度和位置,使其朝着适应度更高的方向移动。

4. 更新全局最优解:在整个粒子群中找到最优的粒子,即具有最佳适应度值的粒子,然后更新全局最优解。

5. 循环迭代:重复步骤3和步骤4,直到满足停止迭代的条件(如达到最大迭代次数或达到精度要求)。

在Matlab中,可以使用循环结构和数组操作来实现上述步骤。

以下是一个简单的PSO算法的Matlab程序示例:matlab.% 定义目标函数。

function z = objective_function(x)。

z = x(1)^2 + x(2)^2; % 以x1和x2为变量的目标函数示例(可根据实际情况修改)。

% 初始化粒子群。

n = 30; % 粒子数量。

max_iter = 100; % 最大迭代次数。

c1 = 2; % 学习因子。

c2 = 2; % 学习因子。

w = 0.7; %惯性权重。

x = rand(n, 2); % 随机初始化粒子的位置。

v = rand(n, 2); % 随机初始化粒子的速度。

pbest = x; % 个体最佳位置。

pbest_val = zeros(n, 1); % 个体最佳适应度值。

gbest = zeros(1, 2); % 全局最佳位置。

gbest_val = inf; % 全局最佳适应度值。

% 迭代优化。

for iter = 1:max_iter.for i = 1:n.% 计算适应度。

pso算法 matlab程序PSO算法,即粒子群优化算法(Particle Swarm Optimization),是一种启发式优化算法,常用于解决搜索和优化问题。

在Matlab中实现PSO算法可以通过以下步骤:步骤1,初始化粒子群。

首先,需要初始化一群粒子,每个粒子都代表了搜索空间中的一个候选解。

每个粒子都有自己的位置和速度。

可以使用随机数函数在搜索空间内随机生成粒子的初始位置和速度。

步骤2,计算适应度。

接下来,需要计算每个粒子的适应度,适应度函数根据具体问题而定。

适应度函数可以是需要最小化或最大化的目标函数。

步骤3,更新粒子的速度和位置。

根据PSO算法的原理,需要根据当前位置和速度以及个体最优位置和全局最优位置来更新粒子的速度和位置。

这个过程可以通过一些数学公式来实现,通常包括学习因子、惯性权重等参数。

步骤4,更新个体和全局最优位置。

在更新粒子的过程中,需要不断更新个体最优位置和全局最优位置。

如果某个粒子找到了比之前更好的位置,就需要更新个体最优位置;如果整个粒子群中出现了更好的位置,就需要更新全局最优位置。

步骤5,重复迭代。

以上步骤需要进行多次迭代,直到满足停止迭代的条件。

通常可以设置迭代次数或者适应度达到某个阈值时停止迭代。

在Matlab中,可以使用循环结构来实现迭代过程,同时根据上述步骤编写相应的代码来实现PSO算法。

常用的Matlab函数和工具包如“fmincon”、“Global Optimization Toolbox”等也可以用来实现PSO算法。

总结来说,实现PSO算法的关键在于理解其基本原理,正确地编写粒子的更新规则和适应度函数,并进行合适的迭代和终止条件设置。

希望这些信息能帮助你在Matlab中实现PSO算法。

Matlab PSO优化RBF的程序。

找了很久,凡是能找到的都找到了。

网上就没有对的。

自己写的一直有问题。

我有个不完整的。

大家看看能不能补全:AllSamIn=[];AllSamOut=[];%前向通道数据预设global minAllSamOut;global maxAllSamOut;% 从总样本中抽取10%的样本作为测试样本,其余作为训练样本[AllSamInn,minAllSamIn,maxAllSamIn,AllSamOutn,minAllSamOut,maxAllSamOut] = premnmx(AllSamIn,AllSamOut);TesSamIn=[];TestSamOut=[];TargetOfTestSam=[]; %测试样本目标TrainSamIn=AllSamInn;TrainSamOut=AllSamOutn;%样本评估:EvaSamIn=[]; %样本评估输入EvaSamInn=tramnmx(EvaSamIn,minAllSamIn,maxAllSamIn); %归一化处理global Ptrain;Ptrain= TrainSamIn;global Ttrain;Ttrain=TrainSamOut;Ptest = TestSamIn;Ttest = TestSamOut;spread=1.2;vmax=0.5; %最大速率minerr=0.001; %适应度阈值wmax=0.90; %惯性权重的最大值wmin=0.30; %惯性权重的最小值global itmax;itmax=300; %允许的最大迭代步数c1=2; %学习因子c2=2; %学习因子for iter= 1:itmaxW(iter)=wmax-((wmax-wmin)/itmax)*iter; %惯性权重下降end%粒子在a,b之间随机初始化:a=-1;b=1;m=-1;n=1;global N; %粒子种群数目N=40;global D; %粒子群长度D=(indim+1)*hiddennum+(hiddennum+1)*outdim;%粒子群位置初始化:rand('state',sum(100*clock)); %产生0-1之间的随机数,粒子在a,b(-1,1)之间初始化X=a+(b-a)*rand(N,D,1); %产生N行D列由0-1之间的矩阵V=m+(n-m)*rand(N,D,1); %粒子群速度在m,n即-1和1之间初始化%粒子群优化RBF神经网络的适应度值global fvrec;MinFit=[]; %最小适应度BestFit=[]; %最大适应度global net; %建立一个待初始化的神经网络net=newrbe(P,T,spread);%调用fitcal函数fitness=fitcal();fvrec(:,1,1)=fitness(:,1,1);[C,I]=min(fitness(:,1,1));MinFit=[MinFit C];BestFit=[BestFit C];L(:,1,1)=fitness(:,1,1); %记录每次反复的例子的适应度函数B(1,1,1)=C; %记录粒子的最小适应函数gbest(1,:,1)=X(I,:,1); %全局极值%粒子群优化RBF神经网络的例子速度和位置计算V(:,:,2)=W(1)*V(:,:,1)+c1*rand*(pbest(:,:,1)-X(:,:,1))+c2*rand*(G(:,:,1)-X(:,:,1));%用vmax限制粒子的速度,如果V>vmax则V=vmax,如果V<-vmax则V=-vmaxfor ni=1:Nfor di=1:Dif V(ni,di,2)>vmaxV(ni,di,2)=vmax;elseif V(ni,di,2)<-vmaxV(ni,di,2)=-vmax;elseV(ni,di,2)=V(ni,di,2);endendX(:,:,2)=X(:,:,1)+V(:,:,2);%粒子群优化RBF神经网络的粒子适应度值更新fitness=fitcal(X,net,indim,hiddennum,outdim,D,Ptrain,Train,minAllSamout,maxAllSamOut);fvrec(:,1,j)=fitness(:,1,j);[C,I]=min(fitness(:,1,j));MinFit=[Minfit C];BestFit=[BestFit min(MinFit)];L(:,1,j)=fitness(:,1,j);B(1,1,j)=C;gbest(1,:,j)=X(I,;,j);[C,I]=min(B(1,1,;));%保存gbest是已经出现过的最好粒子if B(1,1,j)<=Cgbest(1,:,j)=gbest(1,:,j)elsegbest(1,:,j)=gbest(1,:,I);end%粒子群优化RBF神经网络的速度和位置更新V(:,:,j+1)=W(j)*V(:,:,j)+c1*rand*(pbest(:,:,j)-X(:,:,j))+c2*rand*(G(:,:,j)-X(:,:,j))。

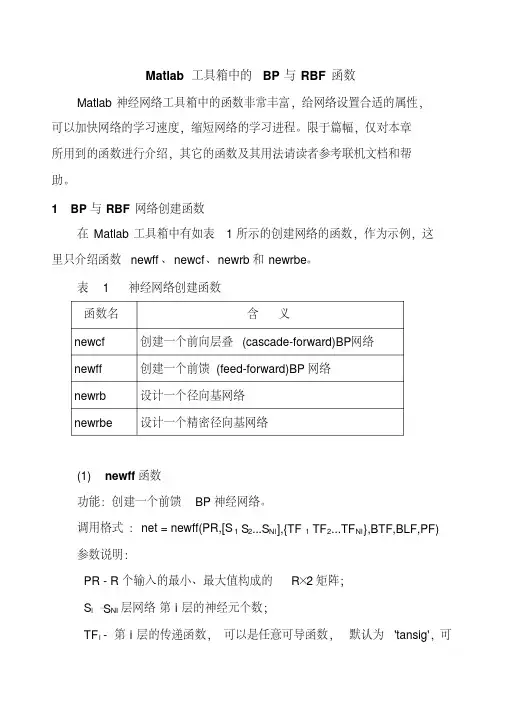

Matlab工具箱中的BP与RBF函数

Matlab神经网络工具箱中的函数非常丰富,给网络设置合适的属性,

可以加快网络的学习速度,缩短网络的学习进程。

限于篇幅,仅对本章

所用到的函数进行介绍,其它的函数及其用法请读者参考联机文档和帮

助。

1 BP与RBF网络创建函数

在Matlab工具箱中有如表1所示的创建网络的函数,作为示例,这

里只介绍函数newff、newcf、newrb和newrbe。

表 1 神经网络创建函数

函数名含义

newcf 创建一个前向层叠(cascade-forward)BP网络

newff 创建一个前馈(feed-forward)BP网络

newrb 设计一个径向基网络

newrbe 设计一个精密径向基网络

(1) newff函数

功能:创建一个前馈BP神经网络。

调用格式:net = newff(PR,[S1 S2...S Nl],{TF1 TF2...TF Nl},BTF,BLF,PF) 参数说明:

PR - R个输入的最小、最大值构成的R×2矩阵;

S i–S NI层网络第i层的神经元个数;

TF i - 第i层的传递函数,可以是任意可导函数,默认为'tansig',可。

pso算法 matlab程序PSO(粒子群优化)算法是一种启发式优化算法,它模拟了鸟群或鱼群等生物群体的行为,通过个体之间的协作和信息共享来寻找最优解。

在MATLAB中,你可以使用以下代码实现一个简单的PSO算法:matlab.function [gbest, gbestval, fitcount] = pso(func, dim, bound, particle_num, maxgen, inertia, c1, c2)。

% 初始化粒子群。

particle = rand(particle_num, dim) . (bound(2)-bound(1)) + bound(1);velocity = zeros(particle_num, dim);pbest = particle;pbestval = feval(func, pbest');[gbestval, gbestid] = min(pbestval);gbest = pbest(gbestid, :);fitcount = 0;for i = 1:maxgen.% 更新粒子群。

r1 = rand(particle_num, dim);r2 = rand(particle_num, dim);velocity = inertia velocity + c1 r1 . (pbest particle) + c2 r2 . (repmat(gbest, particle_num, 1) particle);particle = particle + velocity;% 边界处理。

particle = max(particle, repmat(bound(1), particle_num, 1));particle = min(particle, repmat(bound(2), particle_num, 1));% 更新个体最优。

基于混沌PSO算法优化RBF网络入侵检测模型王亚;熊焰;龚旭东;陆琦玮【摘要】针对网络安全中异常入侵检测,给出了一种构建最优神经网络入侵模型的方法。

采用混沌扰动改进粒子群优化算法,优化径向基函数RBF神经网络入侵模型。

把网络特征子集和RBF神经网络参数编码成一个粒子,通过粒子间的信息交流与协作快速找到全局最优粒子极值。

在KDD Cup 99数据集进行仿真实验,实验数据表明,建立了一种检测率高、速度快的网络入侵检测模型。

%For anomaly intrusion detection in network security, this paper proposes a method of establishing the optimal neural network intrusion model. It improves particle swarm optimization algorithm by chaos perturbation. And it optimizes Radial Basis Function(RBF)neural network intrusion model. The subset features of network and RBF neural network parameters are considered as a particle. It uses the inter particle exchange of information and collaboration to find the global optimal particle extremum quickly. The simulation experiment is carried out on KDD Cup99 datasets. The simulation results show that it is a high detection ratio and fast speed network intrusion detection model.【期刊名称】《计算机工程与应用》【年(卷),期】2013(000)010【总页数】4页(P84-87)【关键词】入侵检测模型;特征选择;粒子群优化算法;神经网络;混沌扰动;数据集【作者】王亚;熊焰;龚旭东;陆琦玮【作者单位】中国科技大学计算机科学与技术学院,合肥 230027; 阜阳师范学院计算机与信息学院,安徽阜阳 236037;中国科技大学计算机科学与技术学院,合肥 230027;中国科技大学计算机科学与技术学院,合肥 230027;中国科技大学计算机科学与技术学院,合肥 230027【正文语种】中文【中图分类】TP391随着人工智能和神经网络的蓬勃发展,也进入了网络安全领域的研究,如构建网络入侵检测模型,帮助研究人员对网络数据进行分析检测出网络异常。

RBF回归任务是一种常用的非线性回归方法。

它使用径向基函数(RBF)来拟合数据,并可以适用于各种复杂的非线性关系。

在Matlab中,可以通过编写相应的代码来实现RBF回归任务。

下面,将介绍RBF回归任务的基本原理以及在Matlab中的代码编写方法。

一、RBF回归任务的基本原理RBF回归任务的基本原理是利用多个径向基函数的线性组合来逼近任意非线性函数。

具体而言,对于输入空间中的每个数据点,都需要计算其与各个径向基函数中心的距离,并将这些距离作为输入传递到线性模型中进行拟合。

常用的径向基函数包括高斯函数、多孔函数等。

通过合理选择径向基函数的数量和位置,可以更好地逼近目标函数,实现对数据的准确拟合。

二、Matlab代码实现RBF回归任务在Matlab中,可以利用已有的工具包或者编写自定义函数来实现RBF回归任务。

以下是一个简单的示例代码,用于实现基于高斯函数的RBF回归任务。

```matlab生成示例数据x = -3:0.1:3;y = sin(x) + 0.1*randn(size(x));设置径向基函数的数量和位置centers = [-2 -1 0 1 2];sigma = 1;计算径向基函数的值rbf = exp(-(x - centers).^2 / (2*sigma^2));构建线性模型并拟合数据model = rbf' \ y';对新数据进行预测x_new = -2.5:0.1:2.5;rbf_new = exp(-(x_new - centers).^2 / (2*sigma^2));y_pred = rbf_new' * model;绘制结果plot(x, y, 'o', x_new, y_pred, '-');legend('原始数据', '预测结果');```在上述示例代码中,首先生成了示例数据,然后设置了径向基函数的数量和位置,计算了径向基函数的值,并利用这些值构建了线性模型。

RBF⽹络的matlab实现⼀、⽤⼯具箱实现函数拟合参考:(1)newrb()该函数可以⽤来设计⼀个近似径向基⽹络(approximate RBF)。

调⽤格式为:[net,tr]=newrb(P,T,GOAL,SPREAD,MN,DF)其中P为Q组输⼊向量组成的R*Q位矩阵,T为Q组⽬标分类向量组成的S*Q维矩阵。

GOAL为均⽅误差⽬标(Mean Squard Error Goal),默认为0.0;SPREAD为径向基函数的扩展速度,默认为1;MN为神经元的最⼤数⽬,默认为Q;DF维两次显⽰之间所添加的神经元数⽬,默认为25;ner为返回值,⼀个RBF⽹络,tr为返回值,训练记录。

⽤newrb()创建RBF⽹络是⼀个不断尝试的过程(从程序的运⾏可以看出来),在创建过程中,需要不断增加中间层神经元的和个数,知道⽹络的输出误差满⾜预先设定的值为⽌。

(2)newrbe()该函数⽤于设计⼀个精确径向基⽹络(exact RBF),调⽤格式为:net=newrbe(P,T,SPREAD)其中P为Q组输⼊向量组成的R*Q维矩阵,T为Q组⽬标分类向量组成的S*Q维矩阵;SPREAD为径向基函数的扩展速度,默认为1和newrb()不同的是,newrbe()能够基于设计向量快速,⽆误差地设计⼀个径向基⽹络。

(3)radbas()该函数为径向基传递函数,调⽤格式为A=radbas(N)info=radbas(code)其中N为输⼊(列)向量的S*Q维矩阵,A为函数返回矩阵,与N⼀⼀对应,即N的每个元素通过径向基函数得到A;info=radbas(code)表⽰根据code值的不同返回有关函数的不同信息。

包括derive——返回导函数的名称name——返回函数全称output——返回输⼊范围active——返回可⽤输⼊范围使⽤exact径向基⽹络来实现⾮线性的函数回归:%%清空环境变量clcclear%%产⽣输⼊输出数据%设置步长interval=0.01;%产⽣x1,x2x1=-1.5:interval:1.5;x2=-1.5:interval:1.5;%按照函数先求的响应的函数值,作为⽹络的输出F=20+x1.^2-10*cos(2*pi*x1)+x2.^2-10*cos(2*pi*x2);%%⽹络建⽴和训练%⽹络建⽴,输⼊为[x1;x2],输出为F。

matlab 的rbf函数编程在MATLAB中,实现RBF(径向基函数)网络的编程通常需要以下步骤:1. 导入数据,首先,你需要导入你的数据集。

可以使用MATLAB的内置函数如`csvread`或者`xlsread`来导入数据,或者直接创建一个数据矩阵。

2. 数据预处理,对于RBF网络,通常需要对数据进行标准化或归一化处理,以确保网络的训练和预测过程能够顺利进行。

3. 网络训练,使用MATLAB的神经网络工具箱(Neural Network Toolbox)中的函数,比如`newrb`(用于建立RBF网络)和`train`(用于训练网络),来训练RBF网络。

在训练之前,你需要确定RBF网络的结构,比如隐藏层节点的数量和RBF函数的类型。

4. 网络预测,训练完成后,可以使用训练好的RBF网络对新的数据进行预测。

使用`sim`函数来进行预测,传入训练好的网络和待预测的输入数据。

下面是一个简单的示例代码,用于在MATLAB中实现RBF网络的训练和预测:matlab.% 导入数据。

data = load('your_data_file.csv');% 数据预处理。

% 这里假设数据已经进行了合适的预处理。

% 定义RBF网络结构。

hiddenLayerSize = 10; % 设置隐藏层节点数量。

net = newrb(input, target, goal, spread); % 创建RBF网络。

% 网络训练。

net = train(net, input, target); % 训练RBF网络。

% 网络预测。

output = sim(net, input); % 使用训练好的网络进行预测。

在这个示例中,`input`是输入数据,`target`是对应的目标输出,`goal`是训练的目标性能,`spread`是RBF函数的扩展参数。

你需要根据你的数据和需求来调整这些参数。

需要注意的是,RBF网络的性能很大程度上取决于网络结构和参数的选择,因此在实际应用中需要进行一定的调参和验证工作。

PSO聚类和梯度算法结合的RBF神经网络优化

孟艳;潘宏侠

【期刊名称】《自动化仪表》

【年(卷),期】2011(032)002

【摘要】针对制约径向基函数RBF神经网络发展及其应用的瓶颈问题,提出一种基于粒子群优化算法PSO的改进K-means聚类思想,以确定其隐节点的数目.结合梯度算法,通过最小化目标函数调节隐节点的数据中心、宽度和输出权值,最终达到优化RBF神经网络的目的;同时,将优化后的网络应用于滚动轴承故障模式识别.试验结果表明,该方法能自适应地确定RBF神经网络隐节点的数目并调整其结构参数,使网络具有较快的收敛速度和较高的收敛精度,从而准确地识别滚动轴承的故障模式.【总页数】3页(P6-8)

【作者】孟艳;潘宏侠

【作者单位】中北大学机械工程与自动化学院,山西,太原,030051;中北大学机械工程与自动化学院,山西,太原,030051

【正文语种】中文

【中图分类】TP389.1;TP206+.3

【相关文献】

1.基于PSO与K-均值聚类算法优化结合的图像分割方法 [J], 曹帅帅; 陈雪鑫; 苗圃; 卜庆凯

2.基于改进PSO优化RBF神经网络线损计算与分析 [J], 何立强; 赵允; 于景亮

3.基于PSO优化RBF神经网络的往复式压缩机故障诊断 [J], 丁承君; 张家梁; 冯玉伯; 王鑫

4.PSO优化RBF神经网络在变形监测中的应用 [J], 邵潮京

5.基于改进PSO优化的RBF神经网络的特高压线损预测 [J], 杨建华;肖达强;张伟;余明琼;易本顺

因版权原因,仅展示原文概要,查看原文内容请购买。

clear allclc %清除命令窗口load Data-Ass2;d=data'; %求转置dat=d(1:2500,1:2);labels=d(1:2500,3);dp=[0.3 30000 0.001];[W1,b1,W2,b2,nr,dr]=solverb(53,92,dp)B = int8(A);inputNums=2; %输入层节点outputNums=1; %输出层节点许多情况下直接用1表示hideNums=10; %隐层节点数maxcount=1000; %最大迭代次数samplenum=2500; %一个计数器,无意义precision=0.001; %预设精度alpha=0.01; %学习率设定值a=0.5; %BP优化算法的一个设定值,对上组训练的调整值按比例修改error=zeros(1,maxcount+1); %error数组初始化;目的是预分配内存空间errorp=zeros(1,samplenum); %同上w=rand(hideNums,outputNums); %10*3;w表隐层到输出层的权值%求聚类中心[Idx,C]=kmeans(dat,hideNums);%X 2500*2的数据矩阵%K 表示将X划分为几类%Idx 2500*1的向量,存储的是每个点的聚类标号%C 10*2的矩阵,存储的是K个聚类质心位置%求扩展常数dd=zeros(1,10);for i=1:10dmin=10000;for j=1:10ddd=(C(i,1)-C(j,1))^2+(C(i,2)-C(j,2))^2;if(ddd<dmin&&i~=j)dmin=ddd;endenddd(i)=dmin;end%b为进行计算后隐含层的输入矩阵b=zeros(2500,10);for i=1:2500for j=1:10b(i,j)=exp( -( (dat(i,1)-C(j,1))^2+(dat(i,2)-C(j,2))^2 )/(2*dd(j)) );%dd 为扩展常数endendcount=1;while (count<=maxcount) %结束条件1迭代1000次c=1;while (c<=samplenum)%对于每个样本输入,计算输出,进行一次BP训练,samplenum为2500%o输出的值double o;o=0.0;for i=1:hideNumso=o+b(c,i)*w(i,1);end%反馈/修改;errortmp=0.0;errortmp=errortmp+(labels(c,1)-o)^2; % 第一组训练后的误差计算errorp(c)=0.5*errortmp;yitao=labels(c,1)-o; %输出层误差for i=1:hideNums %调节到每个隐藏点到输出点的权重w(i,1)=w(i,1)+alpha*yitao*b(c,i);%权值调整endc=c+1; %输入下一个样本数据end %第二个while结束;表示一次训练结束%求最后一次迭代的误差double tmp;tmp=0.0; %字串8for i=1:samplenumtmp=tmp+errorp(i)*errorp(i);%误差求和endtmp=tmp/c;error(count)=sqrt(tmp);%求迭代第count轮的误差求均方根,即精度if (error(count)<precision)%另一个结束条件break;endcount=count+1;%训练次数加1end%测试test=zeros(500,10);for i=2501:3000for j=1:10test(i-2500,j)=exp( -( (d(i,1)-C(j,1))^2+(d(i,2)-C(j,2))^2 )/(2*dd(j)) ); %dd为扩展常数endendcount=0;for i=2501:3000net=0.0;for j=1:hideNumsnet=net+test(i-2500,j)*w(j,1);endif( (net>0&&d(i,3)==1) || (net<=0&&d(i,3)==-1) ) count=count+1;endend。

Matlab PSO优化RBF的程序。

找了很久,凡是能找到的都找到了。

网上就没有对的。

自己写的一直有问题。

我有个不完整的。

大家看看能不能补全:

AllSamIn=[];

AllSamOut=[];

%前向通道数据预设

global minAllSamOut;

global maxAllSamOut;

% 从总样本中抽取10%的样本作为测试样本,其余作为训练样本

[AllSamInn,minAllSamIn,maxAllSamIn,AllSamOutn,minAllSamOut,maxAllSamOut] = premnmx(AllSamIn,AllSamOut);

TesSamIn=[];

TestSamOut=[];

TargetOfTestSam=[]; %测试样本目标

TrainSamIn=AllSamInn;

TrainSamOut=AllSamOutn;

%样本评估:

EvaSamIn=[]; %样本评估输入

EvaSamInn=tramnmx(EvaSamIn,minAllSamIn,maxAllSamIn); %归一化处理

global Ptrain;

Ptrain= TrainSamIn;

global Ttrain;

Ttrain=TrainSamOut;

Ptest = TestSamIn;

Ttest = TestSamOut;

spread=1.2;

vmax=0.5; %最大速率

minerr=0.001; %适应度阈值

wmax=0.90; %惯性权重的最大值

wmin=0.30; %惯性权重的最小值

global itmax;

itmax=300; %允许的最大迭代步数

c1=2; %学习因子

c2=2; %学习因子

for iter= 1:itmax

W(iter)=wmax-((wmax-wmin)/itmax)*iter; %惯性权重下降

end

%粒子在a,b之间随机初始化:

a=-1;

b=1;

m=-1;

n=1;

global N; %粒子种群数目

N=40;

global D; %粒子群长度

D=(indim+1)*hiddennum+(hiddennum+1)*outdim;

%粒子群位置初始化:

rand('state',sum(100*clock)); %产生0-1之间的随机数,粒子在a,b(-1,1)之间初始化

X=a+(b-a)*rand(N,D,1); %产生N行D列由0-1之间的矩阵

V=m+(n-m)*rand(N,D,1); %粒子群速度在m,n即-1和1之间初始化

%粒子群优化RBF神经网络的适应度值

global fvrec;

MinFit=[]; %最小适应度

BestFit=[]; %最大适应度

global net; %建立一个待初始化的神经网络

net=newrbe(P,T,spread);

%调用fitcal函数

fitness=fitcal();

fvrec(:,1,1)=fitness(:,1,1);

[C,I]=min(fitness(:,1,1));

MinFit=[MinFit C];

BestFit=[BestFit C];

L(:,1,1)=fitness(:,1,1); %记录每次反复的例子的适应度函数

B(1,1,1)=C; %记录粒子的最小适应函数

gbest(1,:,1)=X(I,:,1); %全局极值

%粒子群优化RBF神经网络的例子速度和位置计算

V(:,:,2)=W(1)*V(:,:,1)+c1*rand*(pbest(:,:,1)-X(:,:,1))+c2*rand*(G(:,:,1)-X(:,:,1));

%用vmax限制粒子的速度,如果V>vmax则V=vmax,如果V<-vmax则V=-vmax

for ni=1:N

for di=1:D

if V(ni,di,2)>vmax

V(ni,di,2)=vmax;

elseif V(ni,di,2)<-vmax

V(ni,di,2)=-vmax;

else

V(ni,di,2)=V(ni,di,2);

end

end

X(:,:,2)=X(:,:,1)+V(:,:,2);

%粒子群优化RBF神经网络的粒子适应度值更新

fitness=fitcal(X,net,indim,hiddennum,outdim,D,Ptrain,Train,minAllSamout,maxAllSamOut);

fvrec(:,1,j)=fitness(:,1,j);

[C,I]=min(fitness(:,1,j));

MinFit=[Minfit C];

BestFit=[BestFit min(MinFit)];

L(:,1,j)=fitness(:,1,j);

B(1,1,j)=C;

gbest(1,:,j)=X(I,;,j);

[C,I]=min(B(1,1,;));

%保存gbest是已经出现过的最好粒子

if B(1,1,j)<=C

gbest(1,:,j)=gbest(1,:,j)

else

gbest(1,:,j)=gbest(1,:,I);

end

%粒子群优化RBF神经网络的速度和位置更新

V(:,:,j+1)=W(j)*V(:,:,j)+c1*rand*(pbest(:,:,j)-X(:,:,j))+c2*rand*(G(:,:,j)-X(:,:,j))。