粒子群优化算法(PSO)

- 格式:ppt

- 大小:442.00 KB

- 文档页数:12

粒⼦群优化算法(PSO)1、粒⼦群优化算法(Partical Swarm Optimization PSO),粒⼦群中的每⼀个粒⼦都代表⼀个问题的可能解,通过粒⼦个体的简单⾏为,群体内的信息交互实现问题求解的智能性。

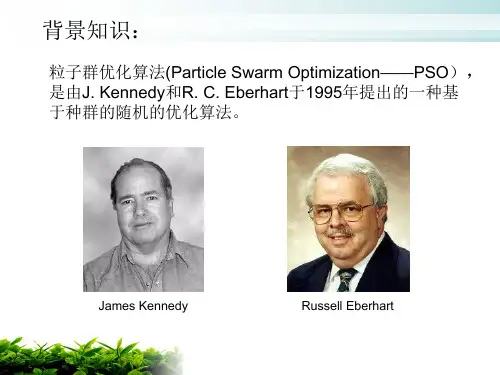

2、粒⼦群算法最早是由Eberhart和Kennedy于1995年提出,它的基本概念源于对鸟群觅⾷⾏为的研究。

设想这样⼀个场景:⼀群鸟在随机搜寻⾷物,在这个区域⾥只有⼀块⾷物,所有的鸟都不知道⾷物在哪⾥,但是它们知道当前的位置离⾷物还有多远。

最简单有效的策略?寻找鸟群中离⾷物最近的个体来进⾏搜素。

PSO算法就从这种⽣物种群⾏为特性中得到启发并⽤于求解优化问题。

⽤⼀种粒⼦来模拟上述的鸟类个体,每个粒⼦可视为N维搜索空间中的⼀个搜索个体,粒⼦的当前位置即为对应优化问题的⼀个候选解,粒⼦的飞⾏过程即为该个体的搜索过程.粒⼦的飞⾏速度可根据粒⼦历史最优位置和种群历史最优位置进⾏动态调整.粒⼦仅具有两个属性:速度和位置,速度代表移动的快慢,位置代表移动的⽅向。

每个粒⼦单独搜寻的最优解叫做个体极值,粒⼦群中最优的个体极值作为当前全局最优解。

不断迭代,更新速度和位置。

最终得到满⾜终⽌条件的最优解。

3、算法流程如下:1、初始化⾸先,我们设置最⼤迭代次数,⽬标函数的⾃变量个数,粒⼦的最⼤速度,位置信息为整个搜索空间,我们在速度区间和搜索空间上随机初始化速度和位置,设置粒⼦群规模为M,每个粒⼦随机初始化⼀个飞翔速度。

2、个体极值与全局最优解定义适应度函数,个体极值为每个粒⼦找到的最优解,从这些最优解找到⼀个全局值,叫做本次全局最优解。

与历史全局最优⽐较,进⾏更新。

3、更新速度和位置的公式4、终⽌条件(1)达到设定迭代次数;(2)代数之间的差值满⾜最⼩界限以上就是最基本的⼀个标准PSO算法流程。

和其它群智能算法⼀样,PSO算法在优化过程中,种群的多样性和算法的收敛速度之间始终存在着⽭盾.对标准PSO算法的改进,⽆论是参数的选取、⼩⽣境技术的采⽤或是其他技术与PSO的融合,其⽬的都是希望在加强算法局部搜索能⼒的同时,保持种群的多样性,防⽌算法在快速收敛的同时出现早熟收敛。

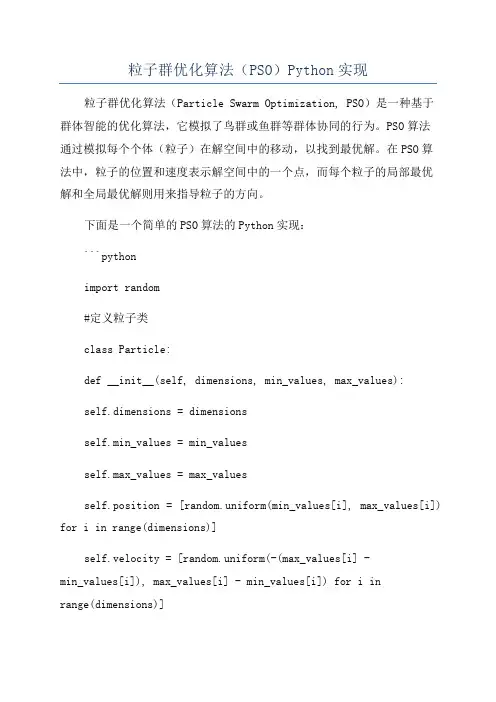

粒子群优化算法(PSO)Python实现粒子群优化算法(Particle Swarm Optimization, PSO)是一种基于群体智能的优化算法,它模拟了鸟群或鱼群等群体协同的行为。

PSO算法通过模拟每个个体(粒子)在解空间中的移动,以找到最优解。

在PSO算法中,粒子的位置和速度表示解空间中的一个点,而每个粒子的局部最优解和全局最优解则用来指导粒子的方向。

下面是一个简单的PSO算法的Python实现:```pythonimport random#定义粒子类class Particle:def __init__(self, dimensions, min_values, max_values):self.dimensions = dimensionsself.min_values = min_valuesself.max_values = max_valuesself.position = [random.uniform(min_values[i], max_values[i]) for i in range(dimensions)]self.velocity = [random.uniform(-(max_values[i] -min_values[i]), max_values[i] - min_values[i]) for i inrange(dimensions)]self.best_position = self.position.copydef update_velocity(self, global_best_position,inertia_weight, cognitive_weight, social_weight):for i in range(self.dimensions):r1 = random.randomr2 = random.randomdef update_position(self):for i in range(self.dimensions):self.position[i] += self.velocity[i]if self.position[i] < self.min_values[i]:self.position[i] = self.min_values[i]elif self.position[i] > self.max_values[i]:self.position[i] = self.max_values[i]def update_best_position(self):if objective_function(self.position) <objective_function(self.best_position):self.best_position = self.position.copy#定义目标函数(此处仅为示例,实际应用中需根据问题进行定义)def objective_function(position):return sum(position)def pso(num_particles, dimensions, min_values, max_values, num_iterations, inertia_weight, cognitive_weight, social_weight): particles = [Particle(dimensions, min_values, max_values)for _ in range(num_particles)]global_best_position = particles[0].position.copyfor _ in range(num_iterations):for particle in particles:particle.update_velocity(global_best_position,inertia_weight, cognitive_weight, social_weight)particle.update_positionparticle.update_best_positionif objective_function(particle.best_position) <objective_function(global_best_position):global_best_position = particle.best_position.copyreturn global_best_position#示例使用num_particles = 30dimensions = 2min_values = [-5, -5]max_values = [5, 5]num_iterations = 100inertia_weight = 0.5cognitive_weight = 0.8social_weight = 0.8best_position = pso(num_particles, dimensions, min_values, max_values, num_iterations, inertia_weight, cognitive_weight, social_weight)print("最优解:", best_position)print("最优值:", objective_function(best_position))```在上面的代码中,首先定义了一个`Particle`类来表示粒子。

优化算法——粒子群算法(PSO)粒子群优化算法(Particle Swarm Optimization,PSO)是一种基于鸟群智能行为的全局优化算法,最初由Kennedy和Eberhart于1995年提出。

PSO是一种启发式算法,通过模拟鸟群中鸟的群体行为来寻找问题的最优解。

PSO算法的基本思想是通过每个粒子的个体最优位置和整个群体的全局最优位置来实现过程。

在算法开始时,所有粒子根据问题的空间范围随机初始化,每个粒子具有一个速度和位置。

粒子根据自身的速度依次更新位置,并根据当前位置和历史最优位置来更新速度和个体最优位置。

整个群体通过比较个体最优位置来更新全局最优位置。

更新速度和位置的过程通过调整权重因子来实现。

PSO算法的关键是如何设置速度更新公式和适应度函数。

速度更新公式包括两个部分:粒子的个体最优位置和整个群体的全局最优位置。

粒子根据自身的速度和个体最优位置来调整速度,以向个体最优位置靠近。

同时,粒子还需要考虑整个群体的全局最优位置,以保持协作和合作。

适应度函数用于评估每个粒子的位置的好坏,它是问题特定的,需要根据具体问题来设计。

PSO算法的特点是简单、易于实现和收敛速度快。

与其他算法相比,PSO算法具有以下优势:1.不需要问题的导数信息。

PSO算法只需要计算目标函数即可,不依赖于问题的导数信息,适用于非线性和高度复杂的问题。

2.全局能力强。

通过群体的协作和合作,PSO算法具有很好的全局能力,能够找到问题的全局最优解。

3.算法参数少且易于调整。

PSO算法只有几个参数需要调整,调整参数相对简单,不需要复杂的参数优化过程。

然而,PSO算法也存在一些问题:1.容易陷入局部最优解。

由于算法的随机性和全局能力,PSO算法容易陷入局部最优解,无法找到问题的全局最优解。

为了克服这个问题,研究者提出了很多改进的PSO算法,如自适应权重PSO、混合PSO等。

2.对问题的形状和维度敏感。

PSO算法对问题形状和维度敏感,对于特定形状的问题(如凸函数),PSO算法能够找到最优解,但对于非凸函数等形状复杂的问题,可能会出现收敛速度较慢或找不到最优解的情况。

粒子群优化法-概述说明以及解释1.引言1.1 概述粒子群优化法(Particle Swarm Optimization,简称PSO)是一种用于求解优化问题的启发式算法。

它模拟了鸟群或鱼群中的群体协作行为,通过不断更新粒子的位置和速度,逐步逼近最优解。

PSO算法最早由Russell Eberhart和James Kennedy于1995年提出,并在之后的二十多年里得到了广泛应用和研究。

PSO算法是一种简单但高效的优化算法,其灵感源于群体智能中的群体行为。

它通过模拟从鸟群和鱼群等自然界中观察到的协同行为,将搜索空间中的解表示为“粒子”,每个粒子根据自己当前的位置和速度信息动态调整,并通过与其他粒子的互动来引导搜索过程。

在PSO算法中,每个粒子都有自己的位置和速度,并且能够记忆并更新自己及其他粒子的最优解。

通过不断地根据历史最优值和邻域最优值进行位置和速度的更新,粒子能够在搜索空间中逐渐找到最优解。

PSO算法具有计算简单、易于实现、收敛速度较快等优点,能够应用于解决连续优化问题、离散优化问题以及多目标优化问题等多个领域。

总的来说,粒子群优化法是一种基于群体智能的优化算法,通过模拟自然界中群体的协同行为,实现了对复杂优化问题的求解。

在实际应用中,PSO算法已经在函数优化、图像处理、机器学习、工程设计等众多领域展现出了良好的性能和广阔的应用前景。

本文将详细介绍粒子群优化法的原理和应用领域,并探讨其优势和发展前景。

1.2文章结构1.2 文章结构本文将按以下顺序展开对粒子群优化法的深入研究和讨论:1.2.1 粒子群优化法的概述首先,我们将介绍粒子群优化法的概念以及其基本原理。

我们将讨论其运作方式,了解粒子群如何模拟鸟群在搜索问题中寻找全局最优解的行为。

1.2.2 粒子群优化法的应用领域接下来,我们将探讨粒子群优化法在不同领域中的广泛应用。

粒子群优化法已被应用于许多问题领域,包括函数优化、图像处理、数据挖掘等。

粒子群算法粒子群算法(ParticleSwarmOptimization,PSO)是一种仿生算法,可以用来求解优化问题,是基于社会诱导原理以及群集智能的分布式搜索过程,其灵感来自于一群鸟类(如谷雀)在共同搜寻有害物质或食物的行为模式。

PSO是一种无视搜索空间,迭代更新搜索最优解或最近最优解的方法。

每个粒子都有一组独立的位置和速度,它们会在迭代更新中改变位置,使其位置越接近最优解,而速度则会随着历史最优解的不断更新而改变。

二、典型应用自动寻找系统最优参数是各种控制应用中最重要的问题之一,粒子群算法是解决此问题的非常有效的算法。

例如,在过滤能廉价有效的情况下,它可以有效地提取出最佳的控制系统参数,以最大限度地改善系统性能。

粒子群算法也被广泛应用于各种研究领域,如计算机视觉,社会网络分析,增强学习等。

例如,在视觉识别应用中,PSO可以用来自动调节和改变图像处理算法的参数,使其最大化全局性能;在社会网络分析中,PSO可以用来提取社区结构,它可以发现社会社区,并估计社区数量和节点划分。

三、原理粒子群算法是一种迭代搜索最优解或者最近最优解的基于模拟的搜索算法,它以群众社会诱导原理与群集智能为基础,模拟有害物质或食物搜索行为的谷雀群体。

粒子群算法的操作原理如下:首先,初始化一组搜索的粒子,采用随机位置和速度;然后,用粒子的位置和速度来求解目标函数,每一次迭代可以确定一个最优解;最后,计算粒子的最佳位置和最佳速度,并根据该最佳位置和最佳速度来更新每个粒子的位置和速度,直到满足停止条件后结束算法。

四、优缺点粒子群算法在许多优化问题上表现出色,因其具有许多优点。

例如,它计算快速、结果可靠、不容易进入局部最优解,不需要对初始参数赋值;另外,它对操作简单、可以用于多维空间等。

然而,粒子群算法也存在着一些缺点,例如在求解高维优化问题时,收敛较慢,而且容易受到设定参数的影响;另外,在搜索空间较大时,它很容易陷入局部最优解,失去全局搜索能力。

粒子群算法(PSO)详解粒子群算法(Particle Swarm Optimization,PSO)是一种优化算法,通过模拟鸟群中的行为来最优解。

它由美国社会心理学家James Kennedy和Russell Eberhart于1995年提出,被广泛应用于求解各种最优化问题。

PSO算法的基本思想是模拟一群鸟在过程中的行为,每只鸟代表一个解,在解空间中通过调整位置来最优解。

鸟群中的每只鸟都有自己的速度和位置。

整个过程可以描述为以下几个步骤:1.初始化粒子群:随机生成一群粒子的初始位置和速度。

2.计算适应度:对每个粒子,根据其位置计算适应度值。

3.更新全局最优:将最优的粒子的位置作为全局最优位置,用于引导整个群体的。

4.更新速度和位置:每个粒子根据自己的速度和群体的最优位置,更新自己的速度和位置。

5.判断停止条件:判断是否满足停止条件,如果满足则结束,否则返回第3步。

PSO算法的关键在于粒子的速度和位置的更新。

粒子的速度可以看作是粒子在解空间中的方向和速度,而粒子的位置则是根据速度来更新的。

速度和位置的更新可以通过以下公式来实现:速度更新公式:v_i(t + 1) = w * v_i(t) + c1 * rand( *(pbest_i - x_i(t)) + c2 * rand( * (gbest - x_i(t))位置更新公式:x_i(t+1)=x_i(t)+v_i(t+1)其中,v_i(t)表示第i个粒子在时刻t的速度,x_i(t)表示第i个粒子在时刻t的位置,pbest_i表示第i个粒子的个体最优位置,gbest表示全局最优位置,w、c1和c2分别为惯性权重、加速常数1和加速常数2 PSO算法的性能受到参数设置的影响,如权重因子w、加速常数c1和c2的选择,以及粒子数目等。

通常,这些参数需要通过实验进行调整来获得更好的性能。

PSO算法具有以下优点:1.算法原理简单,易于实现。

2.可以在全局和局部之间进行,有较好的收敛性和多样性。

粒子群算法求解鲁棒优化问题

粒子群优化算法(Particle(Swarm(Optimization,PSO)是一种启发式优化算法,可以用于解决鲁棒优化问题。

鲁棒优化问题是指在面对不确定性、噪声或干扰时,依然能够找到较好的解决方案的优化问题。

PSO算法的基本思想是模拟鸟群或粒子群在搜索空间中寻找最优解的过程。

每个(粒子”代表了搜索空间中的一个解,通过迭代过程不断更新粒子的位置和速度,以寻找全局最优解或局部最优解。

PSO求解鲁棒优化问题的方法:

1.适应性权重调整:在PSO算法中引入适应性权重,使得粒子在搜索过程中对于不同环境的变化具有不同的敏感度。

适应性权重可以根据问题的特点和需求来设计,使得算法更具鲁棒性。

2.种群多样性维护:维护种群的多样性有助于避免过早收敛到局部最优解。

可以通过引入多样性保持机制,如多样性促进策略或种群重启等,增加算法的鲁棒性。

3.自适应参数调节:PSO算法中的参数(如惯性权重、学习因子等)的自适应调节可以使算法更灵活地适应不同问题和环境条件。

4.鲁棒性函数设计:在目标函数中加入对于不确定性或噪声的鲁棒性评估指标,从而使PSO算法更倾向于寻找对于不确定性更加稳健的最优解。

5.多目标优化和多模态优化策略:在PSO中使用多目标优化或多模态优化的策略,使算法能够处理多个可能存在的最优解或多个子问题,增加鲁棒性。

在解决鲁棒优化问题时,结合上述方法,调整和设计PSO算法的

参数和策略,使其能够更好地适应不确定性和噪声,寻找到更加鲁棒和稳健的优化解。

标准粒⼦群算法(PSO)粒⼦群算法思想的起源粒⼦群优化(Particle Swarm Optimization, PSO)算法是Kennedy和Eberhart受⼈⼯⽣命研究结果的启发、通过模拟鸟群觅⾷过程中的迁徙和群聚⾏为⽽提出的⼀种基于群体智能的全局随机搜索算法,⾃然界中各种⽣物体均具有⼀定的群体⾏为,⽽⼈⼯⽣命的主要研究领域之⼀是探索⾃然界⽣物的群体⾏为,从⽽在计算机上构建其群体模型。

⾃然界中的鸟群和鱼群的群体⾏为⼀直是科学家的研究兴趣,⽣物学家Craig Reynolds在1987年提出了⼀个⾮常有影响的鸟群聚集模型,在他的仿真中,每⼀个个体遵循:(1) 避免与邻域个体相冲撞;(2) 匹配邻域个体的速度;(3) 飞向鸟群中⼼,且整个群体飞向⽬标。

仿真中仅利⽤上⾯三条简单的规则,就可以⾮常接近的模拟出鸟群飞⾏的现象。

1995年,美国社会⼼理学家James Kennedy和电⽓⼯程师Russell Eberhart共同提出了粒⼦群算法,其基本思想是受对鸟类群体⾏为进⾏建模与仿真的研究结果的启发。

他们的模型和仿真算法主要对Frank Heppner的模型进⾏了修正,以使粒⼦飞向解空间并在最好解处降落。

Kennedy在他的书中描述了粒⼦群算法思想的起源。

算法原理PSO从这种模型中得到启⽰并⽤于解决优化问题。

PSO 中,每个优化问题的潜在解都是搜索空间中的⼀只鸟,称之为粒⼦。

所有的粒⼦都有⼀个由被优化的函数决定的适值( fitness value) ,每个粒⼦还有⼀个速度决定它们飞翔的⽅向和距离。

然后粒⼦们就追随当前的最优粒⼦在解空间中搜索。

PSO初始化为⼀群随机粒⼦(随机解),然后通过迭代找到最优解。

在每⼀次迭代中,粒⼦通过跟踪两个极值来更新⾃⼰;第⼀个就是粒⼦本⾝所找到的最优解,这个解称为个体极值;另⼀个极值是整个种群⽬前找到的最优解,这个极值是全局极值。

另外也可以不⽤整个种群⽽只是⽤其中⼀部分作为粒⼦的邻居,那么在所有邻居中的极值就是局部极值。

一、粒子群算法概述粒子群优化算法(PSO)是一种进化计算技术(evolutionary computation),1995 年由Eberhart 博士和kennedy 博士提出,源于对鸟群捕食的行为研究。

该算法最初是受到飞鸟集群活动的规律性启发,进而利用群体智能建立的一个简化模型。

粒子群算法在对动物集群活动行为观察基础上,利用群体中的个体对信息的共享使整个群体的运动在问题求解空间中产生从无序到有序的演化过程,从而获得最优解。

PSO中,每个优化问题的解都是搜索空间中的一只鸟。

我们称之为“粒子”。

所有的粒子都有一个由被优化的函数决定的适应值(fitness value),每个粒子还有一个速度决定他们飞翔的方向和距离。

然后粒子们就追随当前的最优粒子在解空间中搜索。

PSO 初始化为一群随机粒子(随机解)。

然后通过迭代找到最优解。

在每一次迭代中,粒子通过跟踪两个”极值”来更新自己。

第一个就是粒子本身所找到的最优解,这个解叫做个体极值pBest。

另一个极值是整个种群目前找到的最优解,这个极值是全局极值gBest。

另外也可以不用整个种群而只是用其中一部分作为粒子的邻居,那么在所有邻居中的极值就是局部极值。

二、算法原理粒子群算法采用常数学习因子,及惯性权重,粒子根据如下的公式更新自己的速度和位置。

V ki=ωk V i−1i+c1r1(Q bi−Q k−1i)+c2r2(Q bg−Q k−1i)Q ki=Q k−1i+V ki三、算法步骤1、随机初始化种群中各微粒的位置和速度;2、评价个粒子的适应度,将各粒子的位置和适应度储存在各微粒的pbest(Q bi)中,将所有pbest中适应度最优的个体的位置和适应度存储在gbest(Q bg)中。

3、更新粒子的速度和位移。

V ki=ωk V i−1i+c1r1(Q bi−Q k−1i)+c2r2(Q bg−Q k−1i)Q ki=Q k−1i+V ki4、对每个微粒,与其前一个最优位置比较,如果较好,则将其作为当前的最优位置。

粒子群优化算法(PSO)介绍在频谱资源日趋紧张的今天,想要通过增加频谱宽度来提高系统容量的方式已经很难实现;同时,想在时域、频域或码域进一步提高系统容量已经十分困难。

在这种情形下,人们把目光投向了空域,期望能够从中寻觅新的源泉。

随着人们对于无线移动通信的要求愈来愈高,专门是对高速多媒体传输的迫切需求,与之相关能够提高系统容量的技术也开始受到人们的特别重视。

20世纪90年代以来,对于群体智能的研究逐渐兴起。

Eberhart和Kennedy于1995年提出的粒子群优化算法(PSO),作为一种简单有效的优化算法迅速在各个领域取得了普遍的应用。

PSO算法的思想来源是鸟群在觅食进程中表现的群体智慧。

通常单个自然生物并非是智能的,可是整个生物群体却表现出处置复杂问题的能力,这就是群体智能。

各类生物聚集成生物种群,都有其内在行为规律,而人类作为高级生物,研究并掌握了这种规律,模拟设计出各类优化算法并运用于各类问题。

类似的还有按照生物繁衍特性产生的遗传算法,对蚂蚁群落食物收集进程的模拟产生的蚁群算法。

PSO算法目前已经普遍用于函数优化、神经网络训练、模糊系统控制和其他遗传算法涉及到的应用领域。

PSO算法较之其他的优化算法实现简单,也没有许多参数需要调整。

可是它也有着收敛过快、易收敛于局部极值的现象,专门是面对高维复杂的问题时如阵列天线方向图综合问题。

人们提出了很多的改良算法,来提高PSO算法的性能。

惯性权重和紧缩因子是目前应用比较普遍的对大体粒子群算法的改良,能够改善优化性能可是收敛较慢。

文献中将粒子群算法和遗传算法在方向图综合上的应用做了比较,能够看出粒子群算法较之遗传算法有计算量小易于实现等特点,但也能够看到大体的PSO算法和遗传算法的收敛速度都不快或往往在某个局部极值停滞太久很难跳出。

粒子群优化算法(PSO粒子群优化(PSO:Particle Swarm Optimization))是一种进化计算技术(evolutionary computation)是一种有效的全局优化技术,有Eberhart 博士和kennedy博士发明。

PSO算法代码1. PSO算法简介1.1 什么是PSO算法粒子群优化算法(Particle Swarm Optimization,简称PSO)是一种基于群体智能的随机优化算法。

它通过模拟鸟群觅食时个体间的信息共享和协同行为,在搜索空间中寻找最优解。

1.2 PSO算法原理PSO算法基于群体智能和其自适应能力,具有快速、全局搜索和简单的特点。

其基本原理如下: 1. 初始化粒子群,设置群体大小、位置和速度范围等参数。

2. 评估每个粒子的适应度,根据适应度确定个体最优解。

3. 更新全局最优解和个体最优解。

4. 根据公式更新粒子的速度和位置。

5. 重复步骤2-4,直到满足停止条件。

2. PSO算法代码实现2.1 PSO算法的伪代码以下是PSO算法的伪代码:初始化粒子群的位置和速度初始化全局最优解while (满足停止条件) dofor each 粒子 in 粒子群 do计算粒子的适应度更新个体最优解更新全局最优解for each 粒子 in 粒子群 do更新粒子速度更新粒子位置end while2.2 PSO算法的Python代码实现以下是一个简单的PSO算法的Python代码实现:import randomdef f(x):# 定义适应度函数,根据具体问题进行调整return x ** 2class Particle:def __init__(self, dim):self.position = [random.uniform(-5, 5) for _ in range(dim)]self.velocity = [random.uniform(-1, 1) for _ in range(dim)]self.best_position = self.positionself.best_fitness = f(self.position[0])class PSO:def __init__(self, dim, size, max_iter):self.dim = dimself.size = sizeself.max_iter = max_iterself.population = [Particle(dim) for _ in range(size)]self.global_best_position = self.population[0].positionself.global_best_fitness = self.population[0].best_fitnessdef update_particle(self, particle):# 更新粒子速度for i in range(self.dim):particle.velocity[i] = particle.velocity[i] + 2 * random.random() * \(particle.best_position[i] - particle.position[i]) + \2 * random.random() * (self.global_best_position[i] - particle. position[i])# 更新粒子位置for i in range(self.dim):particle.position[i] = particle.position[i] + particle.velocity[i]# 更新粒子最优解fitness = f(particle.position[0])if fitness < particle.best_fitness:particle.best_position = particle.positionparticle.best_fitness = fitness# 更新全局最优解if fitness < self.global_best_fitness:self.global_best_position = particle.positionself.global_best_fitness = fitnessdef optimize(self):for _ in range(self.max_iter):for particle in self.population:self.update_particle(particle)if __name__ == '__main__':pso = PSO(dim=1, size=50, max_iter=100)pso.optimize()print("Global Best:", pso.global_best_position, pso.global_best_fitness)3. PSO算法应用实例3.1 函数最小化问题假设有一个函数 f(x) = x^2,在定义域 [-5, 5] 内寻找最小值。

粒子群优化算法(PSO)附代码PSO算法的基本思想是通过对群体中每个粒子的速度进行随机扰动,并根据当前位置和速度的信息来更新粒子的位置。

每个粒子记住自己曾经达到的最优位置,同时也会记住整个群体中达到的最优位置。

通过不断迭代,群体中的每个粒子会逐渐收敛到最优解附近。

下面给出一个简单的PSO算法的实现代码:```pythonimport randomimport numpy as npclass Particle:def __init__(self, dim, min_bound, max_bound):self.position = np.zeros(dim)self.velocity = np.zeros(dim)self.best_position = np.zeros(dim)self.min_bound = min_boundself.max_bound = max_bounddef initialize(self):for i in range(len(self.position)):self.position[i] = random.uniform(self.min_bound,self.max_bound)self.velocity[i] = random.uniform(self.min_bound,self.max_bound)self.best_position = self.position.copydef update_velocity(self, global_best_position, c1, c2, w): r1 = random.uniform(0, 1)r2 = random.uniform(0, 1)self.velocity = w * self.velocity + c1 * r1 *(self.best_position - self.position) + c2 * r2 *(global_best_position - self.position)def update_position(self):self.position = self.position + self.velocityfor i in range(len(self.position)):if self.position[i] < self.min_bound:self.position[i] = self.min_boundelif self.position[i] > self.max_bound:self.position[i] = self.max_boundclass PSO:def __init__(self, num_particles, dim, min_bound, max_bound, max_iter):self.num_particles = num_particlesself.dim = dimself.min_bound = min_boundself.max_bound = max_boundself.max_iter = max_iterself.particles = []def initialize_particles(self):for _ in range(self.num_particles):particle = Particle(self.dim, self.min_bound, self.max_bound) particle.initializeself.particles.append(particle)def optimize(self, c1, c2, w):global_best_position = Noneglobal_best_fitness = float('inf')for _ in range(self.max_iter):for particle in self.particles:fitness = self.evaluate_fitness(particle.position)if fitness < self.evaluate_fitness(particle.best_position): particle.best_position = particle.position.copyif fitness < global_best_fitness:global_best_fitness = fitnessglobal_best_position = particle.position.copyparticle.update_velocity(global_best_position, c1, c2, w)particle.update_positionreturn global_best_position, global_best_fitnessdef evaluate_fitness(self, position):#根据具体问题定义适应度函数return np.sum(position ** 2)if __name__ == "__main__":num_particles = 50dim = 10min_bound = -10max_bound = 10max_iter = 100pso = PSO(num_particles, dim, min_bound, max_bound, max_iter) pso.initialize_particlesglobal_best_position, global_best_fitness =pso.optimize(c1=2, c2=2, w=0.8)print("Global best position:", global_best_position)print("Global best fitness:", global_best_fitness)```以上代码实现了一个简单的PSO算法,最大迭代次数为100次,粒子数为50个,维度为10维。