神经网络分类器及相关改进的实现与比较

- 格式:pdf

- 大小:422.47 KB

- 文档页数:8

监督分类方法在遥感影像分类处理中的比较孙坤;鲁铁定【摘要】随着计算机解译技术的发展,遥感影像分类方法不断涌现,各种分类器分类精度不一的问题,对其应用产生了一定的影响.运用ENVI软件,采用同一地区的Landsat TM影像,通过目视解译选择相对应的训练样本和已有的验证样本进行试验,对监督分类的6种分类器(最大似然、神经元网络、支持向量机、最小距离、马氏距离、平行六面体分类方法)进行分类后的精度比较.通过对试验区的地物做分类结果的评判和比较研究,再经过分类后处理,得出分类结果的总体精度和Kappa系数.结果表明,最大似然分类方法的精度明显高于其他分类方法的精度,而对比分类影像的细部图,也优于其他分类法,即在监督分类中,最大似然分类法具有较好的分类效果.【期刊名称】《江西科学》【年(卷),期】2017(035)003【总页数】6页(P367-371,468)【关键词】ENVI;遥感影像;分类方法;总体精度;Kappa系数【作者】孙坤;鲁铁定【作者单位】东华理工大学测绘工程学院,330013,南昌;流域生态与地理环境监测国家测绘地理信息局重点实验室,330013,南昌;东华理工大学测绘工程学院,330013,南昌;流域生态与地理环境监测国家测绘地理信息局重点实验室,330013,南昌【正文语种】中文【中图分类】TU43;O344遥感技术的不断发展,已具备多波段、多时相、大尺度、多平台、周期短等众多特点,在地表覆盖信息获取、土地利用等方面突显出较大优势[1]。

而随着模式识别技术、计算机学习技术、遥感分类技术等学科的进步,作为遥感数据和遥感技术应用基础的影像分类方法也层出不穷,遥感影像分类以及影像信息获取技术取得飞跃的发展[2-3]。

当前,随着遥感卫星技术的飞速发展,遥感影像空间分辨率不断提高,更多有效的数据可以从图像中获取。

同时,不同的遥感影像卫星对图像处理有着不同的要求,如何将遥感影像准确分类显得极其重要。

第 22卷第 4期2023年 4月Vol.22 No.4Apr.2023软件导刊Software Guide一种改进一维卷积神经网络的轴承故障诊断方法潘琳鑫,巩永旺,晏生莲(盐城工学院信息工程学院,江苏盐城 224051)摘要:经典一维卷积神经网络模型诊断准确率不高且模型存在过拟合问题,难以满足轴承故障诊断时效性和准确率要求。

鉴于此,提出一种基于改进一维卷积神经网络的轴承故障诊断方法,在卷积层之后加入批量归一化层的方法以增加模型泛化能力,并采用Dropout的方法解决模型过拟合问题。

基于凯斯西储大学轴承故障数据集的实验结果显示,相比经典一维卷积神经网络,该方法可显著提升故障诊断准确率,故障诊断准确率可达99.79%,并且整个诊断过程无需手动特征提取,从而减少了特征提取过程中的损失,实现端到端的检测,具有较好的通用性。

关键词:故障诊断;卷积神经网络;深度学习;Dropout方法DOI:10.11907/rjdk.221570开放科学(资源服务)标识码(OSID):中图分类号:TP183 文献标识码:A文章编号:1672-7800(2023)004-0038-05A Bearing Fault Diagnosis Method Based on Improved One-dimensionalConvolutional Neural NetworkPAN Lin-xin, GONG Yong-wang, YAN Sheng-lian(School of Information Engineering,Yancheng institute of Technology, Yancheng 224051, China)Abstract:Aiming at solving the problems of low diagnostic accuracy and over fitting of the classical one-dimensional convolutional neural net‐work model, a bearing fault diagnosis method based on improved one-dimensional convolutional neural network is proposed. The normaliza‐tion method is used to increase the generalization ability of the model. For the problem of model over fitting, the dropout method is adopted. Fi‐nally, the proposed method is applied to the experimental data of rolling bearing failure of Case Western Reserve University. The experimental results show that compared with the classical convolutional neural network, the proposed method can improve greatly the diagnostic accuracy (as high as 99.79%). Moreover, the entire diagnosis process does not require any manual feature extraction, which can reduce the loss in the feature extraction process, and the method can realize end-to-end detection and has better versatility.Key Words:fault diagnosis; convolutional neural network; deep learning; Dropout method0 引言滚动轴承是旋转机械设备中最重要的零部件之一,在维持运动精度和提高机械效率上发挥重要作用,在复杂机械装备中有着广泛应用[1]。

卷积神经网络(CNN)一、简介卷积神经网络(Convolutional Neural Networks,简称CNN)是近年发展起来,并引起广泛重视的一种高效的识别方法。

1962年,Hubel和Wiesel在研究猫脑皮层中用于局部敏感和方向选择的神经元时发现其独特的局部互连网络结构可以有效地降低反馈神经网络的复杂性,继而提出了卷积神经网络[1](Convolutional Neural Networks-简称CNN)7863。

现在,CNN已经成为众多科学领域的研究热点之一,特别是在模式分类领域,由于该网络避免了对图像的复杂前期预处理,可以直接输入原始图像,因而得到了更为广泛的应用。

Fukushima在1980年基于神经元间的局部连通性和图像的层次组织转换,为解决模式识别问题,提出的新识别机(Neocognitron)是卷积神经网络的第一个实现网络[2]。

他指出,当在不同位置应用具有相同参数的神经元作为前一层的patches时,能够实现平移不变性1296。

随着1986年BP算法以及T-C问题[3](即权值共享和池化)9508的提出,LeCun和其合作者遵循这一想法,使用误差梯度(the error gradient)设计和训练卷积神经网络,在一些模式识别任务中获得了最先进的性能[4][5]。

在1998年,他们建立了一个多层人工神经网络,被称为LeNet-5[5],用于手写数字分类,这是第一个正式的卷积神经网络模型3579。

类似于一般的神经网络,LeNet-5有多层,利用BP算法来训练参数。

它可以获得原始图像的有效表示,使得直接从原始像素(几乎不经过预处理)中识别视觉模式成为可能。

然而,由于当时大型训练数据和计算能力的缺乏,使得LeNet-5在面对更复杂的问题时,如大规模图像和视频分类,不能表现出良好的性能。

因此,在接下来近十年的时间里,卷积神经网络的相关研究趋于停滞,原因有两个:一是研究人员意识到多层神经网络在进行BP训练时的计算量极其之大,当时的硬件计算能力完全不可能实现;二是包括SVM在内的浅层机器学习算法也渐渐开始暂露头脚。

利用证据神经网络的多分类器系统构造和红顺;韩德强;杨艺【摘要】为了充分利用数据信息进而提高分类正确率,提出一种证据神经网络的分类器,并据此构造了多分类器系统.首先将训练数据中的含混数据视为新类别——混合类,将原始的训练数据重组成含有混合类的训练数据,然后使用证据神经网络分类器系统用重组后含混合类的训练数据进行训练,对分类输出进行证据建模,并使用多种不同的证据组合规则实现多分类器融合.采用人工数据集和UCI数据集进行对比实验,结果表明:与其他采用神经网络的多分类器系统相比,采用证据神经网络的多分类器系统能有效提高分类正确率;在数据集Magic 04和Waveform2上,采用提出的多分类器系统比采用投票法的神经网络多分类器系统的分类正确率分别提高了6%和10%左右.【期刊名称】《西安交通大学学报》【年(卷),期】2018(052)011【总页数】8页(P93-99,141)【关键词】神经网络;多分类器系统;证据理论;信度函数【作者】和红顺;韩德强;杨艺【作者单位】西安交通大学电子与信息工程学院,710049,西安;中国电子科技集团公司航天信息应用技术重点实验室,050004,石家庄;西安交通大学电子与信息工程学院,710049,西安;中国电子科技集团公司航天信息应用技术重点实验室,050004,石家庄;西安交通大学机械结构强度与振动国家重点实验室,710049,西安【正文语种】中文【中图分类】TP391复杂环境或场景下,单一分类器的分类效果往往不够理想[1]。

多分类器系统[2]是应对复杂环境下模式分类问题的有效方法,已被广泛应用于图像识别[3]、语音识别[3]、医疗诊断[4]等领域。

学者们基于多分类器系统的多个层面开展了研究。

在成员分类器生成层面,已有研究方法主要有选用不同训练样本获得成员分类器[5]及基于不同的分类算法生成成员分类器[6]等。

由多个相同的分类器构成的多分类器系统,其性能并不会优于单一成员分类器[7]。

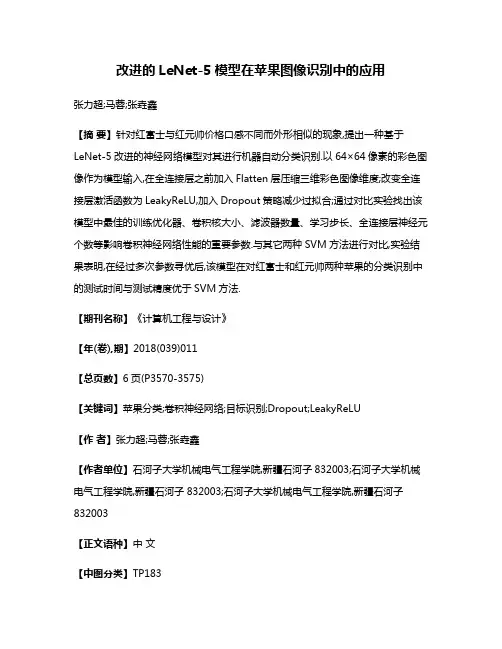

改进的LeNet-5模型在苹果图像识别中的应用张力超;马蓉;张垚鑫【摘要】针对红富士与红元帅价格口感不同而外形相似的现象,提出一种基于LeNet-5改进的神经网络模型对其进行机器自动分类识别.以64×64像素的彩色图像作为模型输入,在全连接层之前加入Flatten层压缩三维彩色图像维度;改变全连接层激活函数为LeakyReLU,加入Dropout策略减少过拟合;通过对比实验找出该模型中最佳的训练优化器、卷积核大小、滤波器数量、学习步长、全连接层神经元个数等影响卷积神经网络性能的重要参数.与其它两种SVM方法进行对比,实验结果表明,在经过多次参数寻优后,该模型在对红富士和红元帅两种苹果的分类识别中的测试时间与测试精度优于SVM方法.【期刊名称】《计算机工程与设计》【年(卷),期】2018(039)011【总页数】6页(P3570-3575)【关键词】苹果分类;卷积神经网络;目标识别;Dropout;LeakyReLU【作者】张力超;马蓉;张垚鑫【作者单位】石河子大学机械电气工程学院,新疆石河子832003;石河子大学机械电气工程学院,新疆石河子832003;石河子大学机械电气工程学院,新疆石河子832003【正文语种】中文【中图分类】TP1830 引言早期的图像识别与分类系统主要是基于用尺度不变特征变换(scale-invariant feature transform,SIFT)[1]和方向梯度直方图(histogram of oriented gradients,HOG)[2]等特征提取方法进行特征提取,再将提取到的特征作为支持向量机[3]、Adaboost[4]等分类器的输入来进行识别与分类。

然而很多特征本质上都是通过人对特定问题进行深入研究之后设计的,当问题较复杂的时候,特征的设计将十分困难。

因此,这段时期的视觉识别与分类系统大多是针对某个或某几个特定的识别任务,数据量一般不大,且泛化能力也较差。

神经网络算法的优化和改进随着科技的发展和人类对于信息处理能力的需求提升,神经网络算法成为了研究和应用的热点之一。

然而,神经网络算法中存在一些问题,例如模型的泛化能力不足、训练速度较慢等等。

因此,优化和改进神经网络算法成为了当前热门的研究方向。

本文将探讨神经网络算法的优化和改进,以及研究进展和应用前景。

一、神经网络算法中存在的问题1.泛化能力不足泛化能力是衡量神经网络算法性能的重要指标之一,它表示模型在训练集以外的数据上的表现能力。

泛化能力不足会导致模型对噪声数据等不良因素过于敏感,或者在未知数据上的预测能力较差。

2.训练速度慢神经网络算法训练的过程中,需要进行反向传播优化权重,这个过程需要大量的计算资源和时间。

训练速度慢会影响算法的实际应用效果,并且阻碍了算法的进一步发展。

3.过拟合神经网络算法的一个缺点是容易出现过拟合现象。

当模型过于复杂并且参数过多时,模型会过于拟合训练集数据,忽略了真实数据的规律性,导致泛化能力降低。

二、优化神经网络算法的思路1.改进神经网络结构神经网络模型的抽象层次较高,具体的因素比较难以分析和优化。

因此,调整神经网络结构是一种可行的思路。

例如,采用更加合适的激活函数、添加正则化项等等,这些方法可以有效提高神经网络的泛化能力。

2.优化神经网络训练方法为了加速神经网络模型的训练,可以优化反向传播和参数更新的方法。

这些方法包括使用梯度下降算法、基于批处理的训练算法以及引入振荡、动量等优化技巧,可以提高神经网络训练的速度和稳定性。

3.引入新的技术和算法优化神经网络随着计算机技术和算法的不断发展,研究人员不断提出新的方法和技术优化神经网络。

这些方法包括卷积神经网络、递归神经网络、自编码神经网络等等,在特定的场景下用于优化神经网络可以取得很好的效果。

三、神经网络算法的改进和应用神经网络算法的不断改进与完善,使其在实际应用中具有了广泛的应用前景。

以下是一些神经网络算法的具体应用场景:1.图像识别基于神经网络的图像识别算法已经成为了目前最先进的技术之一。

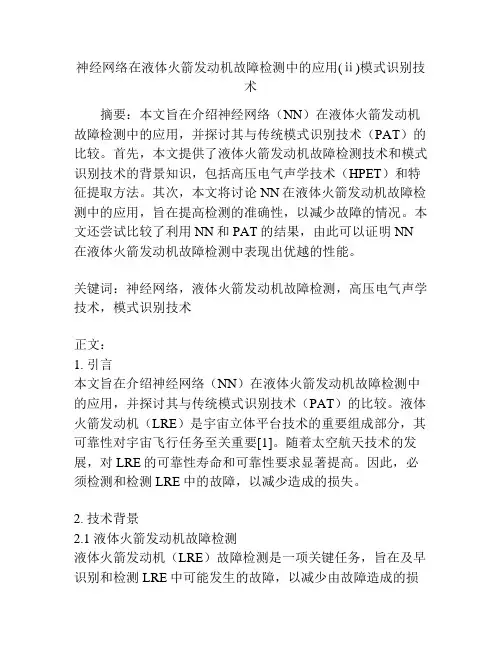

神经网络在液体火箭发动机故障检测中的应用(ⅱ)模式识别技术摘要:本文旨在介绍神经网络(NN)在液体火箭发动机故障检测中的应用,并探讨其与传统模式识别技术(PAT)的比较。

首先,本文提供了液体火箭发动机故障检测技术和模式识别技术的背景知识,包括高压电气声学技术(HPET)和特征提取方法。

其次,本文将讨论NN在液体火箭发动机故障检测中的应用,旨在提高检测的准确性,以减少故障的情况。

本文还尝试比较了利用NN和PAT的结果,由此可以证明NN 在液体火箭发动机故障检测中表现出优越的性能。

关键词:神经网络,液体火箭发动机故障检测,高压电气声学技术,模式识别技术正文:1. 引言本文旨在介绍神经网络(NN)在液体火箭发动机故障检测中的应用,并探讨其与传统模式识别技术(PAT)的比较。

液体火箭发动机(LRE)是宇宙立体平台技术的重要组成部分,其可靠性对宇宙飞行任务至关重要[1]。

随着太空航天技术的发展,对LRE的可靠性寿命和可靠性要求显著提高。

因此,必须检测和检测LRE中的故障,以减少造成的损失。

2. 技术背景2.1 液体火箭发动机故障检测液体火箭发动机(LRE)故障检测是一项关键任务,旨在及早识别和检测LRE中可能发生的故障,以减少由故障造成的损害。

目前,已经开发出了许多基于传感器的检测方法,如高压电气声学技术(HPET)[2]、声纳(SNA)[3]和光学检测技术(ODT)[4]。

其中,HPET是一种常用的技术,可以检测微小的振动,从而进行故障检测。

2.2 模式识别技术模式识别技术(PAT)是一类常用的故障检测技术,以及识别信号中的特征,从而将其分类成正常状态和故障状态。

常用的PAT方法包括小波变换(WT)[5],统计特征提取(STEF)[6],聚类方法(Clustering)[7]等。

其中,小波变换(WT)是一种常用的特征提取方法,可以有效的提取LRE振动信号的特征,用以进行故障诊断。

3. 神经网络在LRE故障检测中的应用随着神经网络技术的发展,神经网络也被用于故障检测,能够更好地提取振动信号中的特征,实现更高准确度的故障检测。

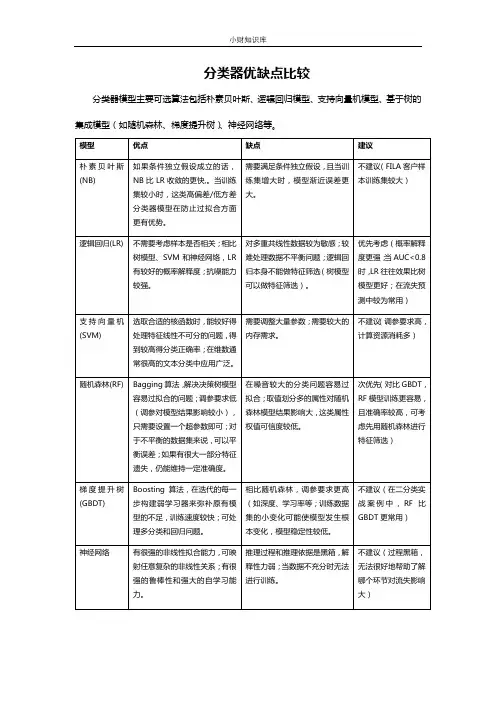

人工智能算法的优劣比较与实践案例随着人工智能技术的日益发展,各种算法应运而生,它们有着各自的优劣。

因此,我们需要对不同的算法进行比较,以便在实践中选择最合适的算法。

一、人工神经网络算法人工神经网络算法是一种通过模拟神经元间信息传递来实现学习和判断的算法。

其优点是能够自适应、自学习,处理非线性问题具有显著优势。

但其缺点也很明显:训练过程中需要处理的向量维度较高,算法收敛速度慢,且存在过拟合问题。

其实,人工神经网络的优化算法十分丰富,如反向传播算法、遗传算法、蚁群算法等,可以大大优化该算法的缺点。

值得一提的是,人工神经网络的应用十分广泛,例如在图像识别、自然语言处理等方面取得了不错的效果。

二、支持向量机算法支持向量机算法是一种二分类模型,其目的是在高维空间中寻找对分类最佳的超平面。

这种算法的优点是模型稳定、意味着数据中存在的噪声和过拟合的影响小。

同时,支持向量机算法可以有效处理非线性、高维数据,获得高精度的分类结果。

但其缺点也不可忽视,例如用于分类数据集较大时,建模复杂度较高,训练时间长。

支持向量机算法的改进方法也比较多,例如核函数和他的扩展,可以大大优化算法的性能。

应用方面,支持向量机算法在数据挖掘、数据分析等领域有着广泛的应用。

三、决策树算法决策树算法是基于树状结构所构成的分类器。

利用一系列规则递归地分割数据集,最终得到一棵分类的决策树。

其优点是模型解释易懂、快速建模、可预测性高,适用于多变量的问题。

缺点在于决策树的过度复杂度、容易陷入过拟合,且对于非平衡数据的处理能力较弱。

改进决策树算法的方法也有很多,例如集成学习算法、增强学习算法、基于代价敏感的算法等。

应用方面,决策树算法在医学诊断、金融风险分析、环境生态分类等方面有广泛的实际应用。

四、深度学习算法深度学习算法通过自动学习多层次的抽象特征来实现数据的分类任务。

该算法的优点在于精度高、适用于接收大量数据且层数较多的问题。

缺点在于数据处理和模型解释较为困难,而且需要大量算力和存储资源。

深度学习知识:卷积神经网络与循环神经网络的比较深度学习领域的两种主要神经网络模型,分别是卷积神经网络(Convolutional Neural Network,CNN)和循环神经网络(Recurrent Neural Network,RNN)。

这两种模型都是使用多层神经元结构进行数据特征提取和高级模式识别。

但它们的结构和应用领域存在很大差异。

本文将对CNN和RNN进行比较,探讨它们的优缺点和适用场景,帮助读者更好地理解深度神经网络。

一、卷积神经网络(CNN)1. CNN的基本结构CNN主要是由卷积层(Convolutional Layer)、池化层(Pooling Layer)、全连接层(Fully Connected Layer)三种层次结构组成。

在CNN中,卷积层和池化层是特征提取的主要手段,而全连接层则负责对特征进行归一化和分类。

卷积层是CNN的核心部分,其主要目的是从输入的原始图像中学习特征。

它由多个卷积核组成,每个卷积核都会在不同位置扫描整个输入图像,提取局部特征并输出为一个特征图。

卷积操作可以有效地减少输入数据的规模,并且可根据不同的感受野大小和数量灵活调整卷积核的参数。

池化层是在卷积层之后的一种降采样操作,主要是为了减少卷积特征的数据量,提高网络的计算效率和鲁棒性。

在池化操作中,对每个特征图进行固定大小的滑动窗口采样,取窗口中的最大值或平均值作为该特征图的代表。

池化层可以保留最显著的特征,提高模型的判别能力。

全连接层是在传统神经网络中常用的结构,在CNN中用于分类器构建。

它将高维的卷积特征映射到指定的目标标签空间,实现图像的识别和分类。

2. CNN的优点和适用场景(1)有效的特征提取能力:CNN对于图像、语音、自然语言处理等输入数据具有很强的特征提取能力。

基于其卷积核和池化操作的局部特征提取,可自动学习和提取抽象的特征,进而实现强大的识别和分类能力。

(2)可灵活处理高维数据:CNN可以处理高维数据,例如三维立体图像数据等。

神经网络在图像分类中的优势随着大数据时代的到来,图像分类成为了人工智能领域研究的重要方向之一。

图像分类可以实现对图像的自动识别和分类,逐渐被广泛应用于各个领域。

神经网络是实现图像分类的主流方法之一,其具有非常显著的优势。

一、大规模数据处理和处理速度神经网络通过大量的样本数据进行训练,从而能够实现对大规模数据的处理。

在图像分类中,神经网络可以处理成百上千张图像,并对这些图像进行分类和识别。

在传统的机器学习中,需要手动设计特征和分类器,而使用神经网络可以实现自动特征提取和分类器生成,且分类器有很好的效果。

此外,神经网络训练时采用的是并行计算,运算速度快,在当前硬件环境下,其处理速度是非常快的。

二、高准确率和高鲁棒性神经网络在图像分类中的准确率相对其他方法更高,这得益于其强大的学习能力。

神经网络采用反向传播算法进行优化,能够不断迭代训练,从而提高模型的准确率。

在某些情况下,与传统图像分类算法相比,神经网络准确率提高了数个百分点。

神经网络在图像分类中还具有很高的鲁棒性,它能够识别被扭曲、变形、模糊、噪声等影响的图像。

在实际应用中,往往会有很多不可控制的因素会影响图像的质量,而神经网络能够有效地应对这些问题。

三、灵活性和可扩展性神经网络在图像分类中还具有灵活性和可扩展性。

它不需要预先定义特征,而是通过训练来自动提取特征,这对于实时应用很有帮助。

此外,神经网络能够进行多类别分类,同时也能够进行标记和无标记学习。

神经网络在图像分类中还具有可扩展性。

随着数据量的增加和硬件的普及,神经网络可以很容易地扩展到更大的训练集,并且也可以使用分布式计算的方式来加速训练。

四、可解释性和可视化性神经网络在图像分类中的可解释性和可视化性也逐渐得到了研究。

通过可视化神经网络层级,可以比较直观地了解神经网络的判断过程,找出神经网络的缺陷,提高神经网络的准确率和鲁棒性。

此外,可解释性的神经网络还可以解释模型的决策,使人们对模型的结果有更多的信心。

分类问题的求解过程如下图:2.⽤pytorch的逻辑回归实现图像分类#导⼊包#损失函数和优化器import torch.nn.functional as Fimport torch.optim as optimlearning_rate=0.001loss = nn.CrossEntropyLoss()#定义交叉熵损失函数, 这个⽅法集成了softmax计算optimizer = torch.optim.SGD(linearnet.parameters(),lr=learning_rate)#SGD优化器#测试集数据评估def evaluate_accuracy(data_iter, net):acc_sum, n =0.0, 0for data in data_iter:X, y=dataX, y=X.to(device),y.to(device)acc_sum +=(net(X).argmax(dim=1)== y).float().sum().item()n += y.shape[0]return acc_sum / n#定义训练过程epochs =200def train_model(optimizer):for epoch in range(epochs):train_loss_sum, train_acc_sum, n =0.0, 0.0, 0for data in trainloader:inputs, y=datainputs, y=inputs.to(device),y.to(device)#print(inputs)y_hat = linearnet(inputs)cost = loss(y_hat, y).sum()optimizer.zero_grad()cost.backward()optimizer.step()train_loss_sum += cost.item()train_acc_sum +=(torch.argmax(y_hat, dim=1)== y).float().sum().item()n += y.shape[0]test_acc = evaluate_accuracy(testloader, linearnet)print('epoch %d, loss %.4f, train acc %.4f, test acc %.4f' % (epoch + 1, train_loss_sum / n, train_acc_sum / n, test_acc)) #调⽤函数训练数据train_model(optimizer)#结果可视化#准确度绘制import matplotlib.pyplot as plt# 绘制训练%验证的精度Trainacc=[]#请输⼊上述训练过程中保存的数据Testacc=[]##请输⼊上述训练过程中保存的数据plt.plot(Trainacc)plt.plot(Testacc)plt.title('qijiajing-Residual Block Model accuracy')plt.xlabel('Epoch')plt.ylabel('Accuracy')plt.legend(['Train acc', 'Test acc'], loc='upper left')plt.show()#loss绘制import matplotlib.pyplot as pltloss=[]plt.plot(loss)plt.xlabel('Epoch')plt.ylabel('Loss')plt.title('qijiajing-Model accuracy')我们进⾏了250次迭代,最终训练集精度稳定在43.5%左右,测试集精度稳定在41%左右,是随机猜测10%的四倍。

改进的神经网络模型在分类器设计中的应用神经网络是一种受到生物神经系统启发的机器学习算法,可以模拟人类大脑的工作方式。

近年来,随着神经网络技术的不断发展,改进的神经网络模型在分类器设计中得到了广泛的应用。

本文将探讨这些改进的神经网络模型在分类器设计中的应用,并介绍它们的优势和挑战。

一、改进的神经网络模型的介绍改进的神经网络模型是指对传统的神经网络模型进行了改进或优化的模型。

这些改进包括但不限于卷积神经网络(Convolutional Neural Network,CNN)、循环神经网络(Recurrent Neural Network,RNN)和深度神经网络(Deep Neural Network,DNN)等。

这些改进使得神经网络在处理图像、语言和声音等数据时更加高效和准确。

二、改进的神经网络模型在分类器设计中的应用1. 卷积神经网络(CNN)在图像分类中的应用CNN是一种广泛应用于图像处理领域的神经网络模型。

它的主要特点是可以自动从原始数据中提取特征,并且具有一定的位置不变性。

在图像分类任务中,CNN可以通过多层卷积和池化操作提取图像的局部特征,并通过全连接层进行分类。

这样的设计使得CNN在图像分类任务中具有较高的准确性和鲁棒性。

2. 循环神经网络(RNN)在语言分类中的应用RNN是一种适用于序列数据处理的神经网络模型。

它具有记忆功能,能够对前面的输入数据进行记忆,并将这些记忆信息用于后续的预测和分类。

在语言分类任务中,RNN可以将输入的语言序列转化为语义表示,并通过softmax函数进行分类。

由于RNN能够考虑到序列数据的上下文信息,因此在语言分类任务中具有较好的效果。

3. 深度神经网络(DNN)在声音分类中的应用DNN是一种具有多层隐含层的神经网络模型。

它通过多层非线性变换将输入数据映射到高维空间中,并通过输出层进行分类。

在声音分类任务中,DNN可以学习到声音的频谱、声调和语速等特征,并通过softmax函数进行分类。