从信息论看生活问题

——论自信息、熵和生活的密切联系

电子11-2班 201102031041

【前言】

在我看来,《信息理论与编码》是一门十分重要的课程,虽然它所占的课时比较的少,但它却与我们大学阶段的其他重要课程有着密切的联系,例如《概率论》、《通信原理》等。在学这门课的学习之初,我对这门课到底学的是什么,为什么要学它存在着许多的疑问。百度百科上对信息论是这么定义的:信息论是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。起初,我对信息熵、数据压缩等这一类名词十分的陌生,自然也不能正确的认识这门学科。而现在经过一个学期的理论学习,我对信息论有了一定的认识,虽然还未达到深入研究的状态,但我已经认识到了《信息理论与编码》这门课它本身的重要性,以及它的理论知识在当今的这个信息时代中在各个领域中起着举足轻重的作用。同时信息理论的方法,在科学、工程以及数学理论方面也得到了大量的应用。因此,我们不应该把期末考试当作学习的终点,我们不仅要学好信息论相关课程的专业知识,还应该把其中的思想应用于生活实践中, 解决生活中的实际问题。由于掌握的信息论知识还不够全面,通过翻阅书籍,查找资料,参考资料写下了此篇文章。以下,正是我对信息论与我们生活学习中比较密切方面的应用的浅薄认识,。

【正文】

(一) 自信息

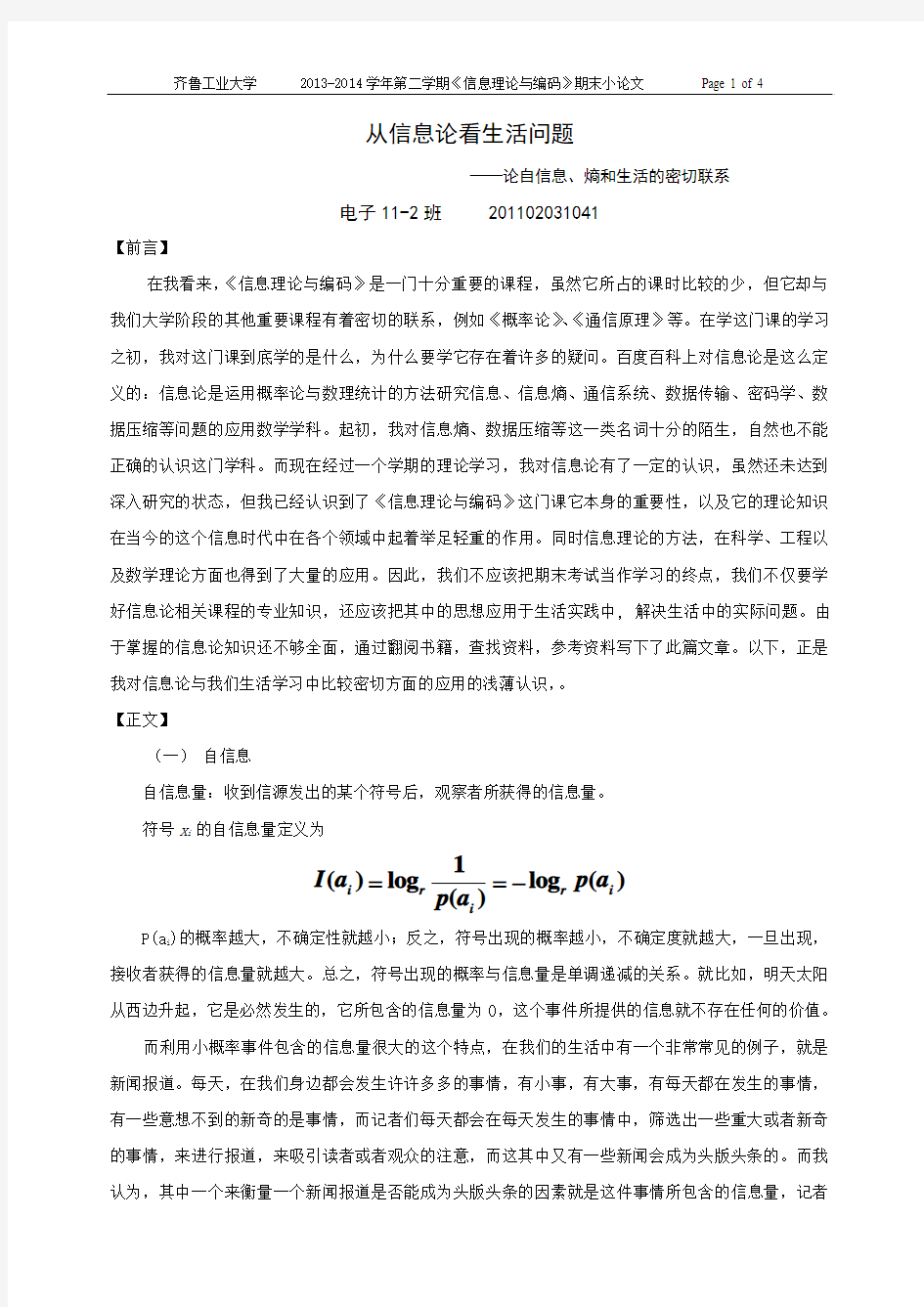

自信息量:收到信源发出的某个符号后,观察者所获得的信息量。

符号x i 的自信息量定义为

P(a i )的概率越大,不确定性就越小;反之,符号出现的概率越小,不确定度就越大,一旦出现,接收者获得的信息量就越大。总之,符号出现的概率与信息量是单调递减的关系。就比如,明天太阳从西边升起,它是必然发生的,它所包含的信息量为0,这个事件所提供的信息就不存在任何的价值。

而利用小概率事件包含的信息量很大的这个特点,在我们的生活中有一个非常常见的例子,就是新闻报道。每天,在我们身边都会发生许许多多的事情,有小事,有大事,有每天都在发生的事情,有一些意想不到的新奇的是事情,而记者们每天都会在每天发生的事情中,筛选出一些重大或者新奇的事情,来进行报道,来吸引读者或者观众的注意,而这其中又有一些新闻会成为头版头条的。而我认为,其中一个来衡量一个新闻报道是否能成为头版头条的因素就是这件事情所包含的信息量,记者

1()log log ()()i r r i i I a p a p a ==-

们会选择发生概率小,包含的信息量大的事件来进行报道,而读者观众也会选择浏览或者观看这些信息量大的新闻。

正如前一段事件的马航MH370事件,它引起了全世界的关注。从2014年3月8日凌晨2点40分,马来西亚航空公司称与一架载有239人的波音777-200飞机与管制中心失去联系,到3月24日晚10点,马来西亚总理纳吉布在吉隆坡宣布,通过技术分析马航失联航班MH370在南印度洋坠毁,在这十多天的时间里,马航MH370事件几乎抢占了所有的头版头条,各个报道底下的留言数也在上万条以上。而至今,MH370还给我们留下了许多未解之谜。那么,为什么马航事件能引起这么大的关注呢,除了它的伤亡人数引起人们的揪心,还有一个原因就是它是一个发生概率极其小的事件,包含的信息量极大的事件。首先,据统计飞机失事造成多人伤亡的事故率约为三百万分之一,它的包含的信息量很大,而在这些事故中像马航MH370这样特殊的离奇失踪事件在历史上发生的次数更是少之又少,发生的概率基本接近于零。2009年一架法航客机大西洋上空离奇失踪,直到了2012年,法国当局才声称,冰晶破坏了用于确定飞机空速的系统,导致自动驾驶仪断开,机坠入了大西洋。1979年一架载有6人的波音707飞机在从日本起飞后失踪。1990年一架从冰岛雷克雅维克起飞的波音727飞机发出遇险信息并消失,机上载有18人,这两架飞机均未找到。这些事件都和马航MH370事件一样属于极小概率的事件,发生的概率接近于0,包含的信息量也就接近于无穷在,自然在各自的年代引起了巨大的轰动。

(二) 信源的熵

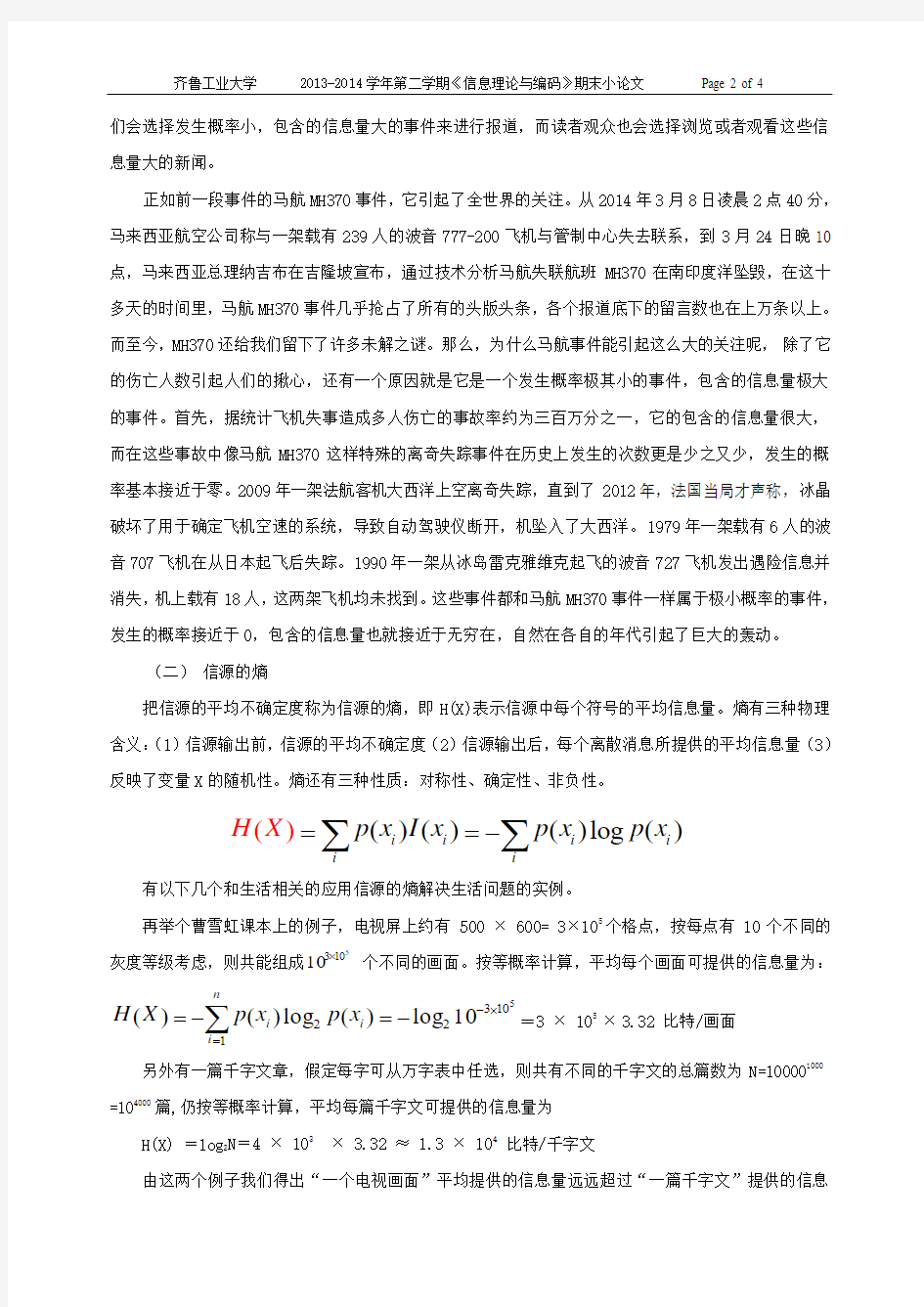

把信源的平均不确定度称为信源的熵,即H(X)表示信源中每个符号的平均信息量。熵有三种物理含义:(1)信源输出前,信源的平均不确定度(2)信源输出后,每个离散消息所提供的平均信息量(3)反映了变量X 的随机性。熵还有三种性质:对称性、确定性、非负性。

有以下几个和生活相关的应用信源的熵解决生活问题的实例。 再举个曹雪虹课本上的例子,电视屏上约有 500 × 600= 3×105个格点,按每点有 10个不同的

灰度等级考虑,则共能组成 个不同的画面。按等概率计算,平均每个画面可提供的信息量为: 510321210

log )(log )()(?-=-=-=∑n i i i x p x p X H =3 × 105 × 3.32 比特/画面

另外有一篇千字文章,假定每字可从万字表中任选,则共有不同的千字文的总篇数为N=10000

1000 =104000 篇,仍按等概率计算,平均每篇千字文可提供的信息量为

H(X) =log 2N =4 × 103 × 3.32 ≈ 1.3 × 104 比特/千字文

由这两个例子我们得出“一个电视画面”平均提供的信息量远远超过“一篇千字文”提供的信息

5

10310?()()()l (og )

)(i i i i i i

p x I x p H x p x X ==-∑∑

量。这个例子,也让我想到一个生活中很普遍的问题,当今社会,为什么那么多人喜欢看电视,却不喜欢花时间去看书,去看报纸呢?这其中的一个原因正是以上计算中所得出的结论:一个电视画面提供的平均信息量远远超过文章所提供的信息量。在如今这个科技发达的时代,人们的生活多姿多彩,很少有人能腾出时间坐在静心的看书,大多数人都会选择在相同的时间接受一些平均信息量大的事物,就比如看电视,这正是信源熵在日常生活中的一个很好的体现。

信源熵还有一个十分重要的性质即最大熵定理。离散无记忆信源输出M个不同的信息符号,当且仅当出现概率相等时,信源熵最大。

下面我们先通过一个简单的例子计算一下概率不同和等概率的时候出现的熵的值。

由此表格看出:变量的不确定性越大,熵也就越大,把它搞清楚所需要的信息量也就越大。一个系统越是有序,信息熵就越低;反之,一个系统越是混乱,信息熵就越高;当出现等概率的时候,熵最大。

而在我们的生活中,许多人喜欢看一些篮球比赛或者足球比赛,举NBA比赛的例子吧。每个人都有自己喜欢的球队,大多数人会选择观看自己喜欢球队的比赛。而在自己喜欢的球队参加的比赛中,在季前赛中大多数人都会有所选择的来收看比赛,那选择比赛的标准是什么呢?除了个人爱好外,两个球队的实力差距正式球迷们选择观看比赛的标准。试问,有谁愿意看一场实力悬殊的比赛?又有谁想看一开场就知道输赢的比赛呢?这就和信源熵的计算有很大的关系。比如,球队A在对战球队C的时候输赢概率三七分;球队B在对战球队C的时候输赢概率五五分;明显球队B的熵比球队A的熵来的大,球队B对战球队C的比赛必然比球队A在对战球队C的比赛来的精彩。而我个人是个羽毛球比赛的忠实观众,我喜欢看林丹的比赛,但在他的众多比赛中,我只会选择其中的小部分比赛,当然就包括林丹对阵李宗伟的比赛。作为羽毛球史上最优秀的男运动员,作为奥运会世锦赛双料冠军,林丹对阵普通运动员的得胜概率基本在百分之八十五以上,而对阵另外一位优秀的羽毛球运动员李宗伟的得胜概率在百分之六十五左右,而这也正是我选择观看林李大战的原因。

由以上几个例子,我们不难看出信息熵在我们的生活中有着十分广泛的应用,能够分析和解决生活中许多问题。

【总结】

当然,信息论与生活的密切联系当然不仅仅只体现在自信息和信源熵的两方面,信息论中的户信息、数据压缩、数据传输、信源编码和信道编码等知识在我们的日常生活中也有众多相关之处。我们

学习一门课,不能只是记住它的表层公式、不能仅仅背诵它的知识点,我们更应该理解它深层的含义,最好还能做到理论和实践、理论和生活相联系。总之,《信息理论与编码》这门课的学习确实令我获益匪浅,它不仅和我们的生活有密切的联系,也为我在《通信原理》的课程学习,《概率论》的考研复习中起到了一定的辅助作用。

【参考文献】

[1]曹雪虹张宗橙信息论与编码(第二版).清华大学出版社 2009

[2]Thomas M.Cover (作者), 阮吉寿 (译者), 张华 (译者)信息论基础(原书第2版) ,机械工业出版社,2008年3月;

[3] 王海燕.信息论基础[M].南京:东南大学出版社 2003

各章参考答案 2.1. (1)4.17比特 ;(2)5.17比特 ; (3)1.17比特 ;(4)3.17比特 2.2. 1.42比特 2.3. (1)225.6比特 ;(2)13.2比特 2.4. (1)24.07比特; (2)31.02比特 2.5. (1)根据熵的可加性,一个复合事件的平均不确定性可以通过多次实验逐步解除。如果我们使每次实验所获得的信息量最大。那么所需要的总实验次数就最少。用无砝码天平的一次称重实验结果所得到的信息量为log3,k 次称重所得的信息量为klog3。从12个硬币中鉴别其中的一个重量不同(不知是否轻或重)所需信息量为log24。因为3log3=log27>log24。所以在理论上用3次称重能够鉴别硬币并判断其轻或重。每次实验应使结果具有最大的熵。其中的一个方法如下:第一次称重:将天平左右两盘各放4枚硬币,观察其结果:①平衡 ②左倾 ③右倾。ⅰ)若结果为①,则假币在未放入的4枚币,第二次称重:将未放入的4枚中的3枚和已称过的3枚分别放到左右两盘,根据结果可判断出盘中没有假币;若有,还能判断出轻和重,第三次称重:将判断出含有假币的三枚硬币中的两枚放到左右两盘中,便可判断出假币。ⅱ)若结果为②或③即将左盘中的3枚取下,将右盘中的3枚放到左盘中,未称的3枚放到右盘中,观察称重砝码,若平衡,说明取下的3枚中含假币,只能判出轻重,若倾斜方向不变,说明在左、右盘中未动的两枚中其中有一枚为假币,若倾斜方向变反,说明从右盘取过的3枚中有假币,便可判出轻重。 (2)第三次称重 类似ⅰ)的情况,但当两个硬币知其中一个为假,不知为哪个时, 第三步用一个真币与其中一个称重比较即可。 对13个外形相同的硬币情况.第一次按4,4,5分别称重,如果假币在五个硬币的组里,则鉴 别所需信息量为log10>log9=2log3,所以剩下的2次称重不能获得所需的信息. 2.6. (1)215 log =15比特; (2) 1比特;(3)15个问题 2. 7. 证明: (略) 2.8. 证明: (略) 2.9. 31)(11= b a p ,121 )(21=b a p , 121 )(31= b a p , 61)()(1312= =b a b a p p , 241)()()()(33233222= ===b a b a b a b a p p p p 。 2.10. 证明: (略) 2.11. 证明: (略)

信息论基础发展史 信息论(information theory)是运用概率论与数理统计的方法研究信息、信息熵、通信系统、数据传输、密码学、数据压缩等问题的应用数学学科。是专门研究信息的有效处理和可靠传输的一般规律的科学,是研究通讯和控制系统中普遍存在着信息传递的共同规律以及研究最佳解决信息的获限、度量、变换、储存和传递等问题的基础理论。信息论将信息的传递作为一种统计现象来考虑,给出了估算通信信道容量的方法。信息传输和信息压缩是信息论研究中的两大领域。这两个方面又由信息传输定理、信源-信道隔离定理相互联系。 信息论从诞生到今天,已有五十多年历史,是在20世纪40年代后期从长期通讯实践中总结出来的,现已成为一门独立的理论科学,回顾它的发展历史,我们可以知道理论是如何从实践中经过抽象、概括、提高而逐步形成的。它是在长期的通信工程实践和理论研究的基础上发展起来的。 通信系统是人类社会的神经系统,即使在原始社会也存在着最简单的通信工具和通信系统,这方面的社会实践是悠久漫长的。电的通信系统(电信系统)已有100多年的历史了。在一百余年的发展过程中,一个很有意义的历史事实是:当物理学中的电磁理论以及后来的电子学理论一旦有某些进展,很快就会促进电信系统的创造发明或改进。 当法拉第(M.Faraday)于1820年--1830年期间发现电磁感应的基本规律后,不久莫尔斯(F.B.Morse)就建立起电报系统(1832—1835)。1876年,贝尔(A.G.BELL)又发明了电话系统。1864年麦克斯韦(Maxell)预言了电磁波的存在,1888年赫兹(H.Hertz)用实验证明了这一预言。接着1895年英国的马可尼(G.Marconi)和俄国的波波夫(A.C.ΠoΠoB)就发明了无线电通信。本世纪初(1907年),根据电子运动的规律,福雷斯特(1,Forest)发明了能把电磁波

《信息论基础》答案 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。 2.一个八进制信源的最大熵为3bit/符号 3.有一信源X ,其概率分布为1 23x x x X 1 11P 244?? ?? ? =?? ????? ,其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是 15bit 。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。若消息从放大器中输出,则该信源的绝对熵是∞;其能在每个自由度熵的最大熵是log (b-a )bit/自由度;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 2Flog (b-a )bit/s. 5. 若某一 信源X ,其平均功率受限为16w ,其概率密度函数是高斯分布时,差熵的最大值为 1 log32e 2 π;与其熵相等的非高斯分布信源的功率为16w ≥ 6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。 7、无失真信源编码的平均码长最小理论极限制为信源熵(或H(S)/logr= H r (S))。 8、当R=C 或(信道剩余度为0)时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。 10、在下面空格中选择填入数学符号“,,,=≥≤?”或“?” (1)当X 和Y 相互独立时,H (XY )=H(X)+H(X/Y)。 (2)假设信道输入用X 表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y) 《信息论基础》试卷第1页 《信息论基础》试卷答案 一、填空题(共25分,每空1分) 1、连续信源的绝对熵为 无穷大。(或()()lg lim lg p x p x dx +∞-∞ ?→∞ --?? ) 2、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。 3、无记忆信源是指 信源先后发生的符号彼此统计独立 。 4、离散无记忆信源在进行无失真变长编码时,码字长度是变化的。根据信源符号的统计特性,对概率大的符号用 短 码,对概率小的符号用 长 码,这样平均码长就可以降低,从而提高 有效性(传输速率或编码效率) 。 5、为了提高系统的有效性可以采用 信源编码 ,为了提高系统的可靠性可以采用 信道编码 。 6、八进制信源的最小熵为 0 ,最大熵为 3bit/符号 。 7、若连续信源输出信号的平均功率为1瓦特,则输出信号幅度的概率密度函数为 高斯分布(或()0,1x N 2 2 x - )时,信源具有最大熵,其值为 0.6155hart(或 1.625bit 或 1lg 22 e π)。 8、即时码是指 任一码字都不是其它码字的前缀 。 9、无失真信源编码定理指出平均码长的理论极限值为 信源熵(或H r (S)或()lg H s r ),此 时编码效率为 1 ,编码后的信息传输率为 lg r bit/码元 。 10、一个事件发生的概率为0.125,则自信息量为 3bit/符号 。 11、信源的剩余度主要来自两个方面,一是 信源符号间的相关性 ,二是 信源符号概率分布的不均匀性 。 12、m 阶马尔可夫信源的记忆长度为 m+1 ,信源可以有 q m 个不同的状态。 13、同时扔出一对均匀的骰子,当得知“两骰子面朝上点数之和为2”所获得的信息量为 lg36=5.17 比特,当得知“面朝上点数之和为8”所获得的信息量为 lg36/5=2.85 比特。 14.在下面空格中选择填入的数学符号“=,≥,≤,>”或“<” H(XY) = H(Y)+H(X ∣Y) ≤ H(Y)+H(X) 通信与网络复习笔记——通信部分 第一讲信息论 信息的度量: 不确定度 平均不确定度,熵:单位bit 定理:离散随机变量的最大熵,S表示该随机变量的取值集合 联合熵:pij 联合概率,则联合熵是 条件熵:条件概率的熵H(X|Y)=∑∑p(i,j) log p(i|j) 关系: 互信息: 互信息的理解:①X的不确定度减去观测Y后X残存的不确定度,通过观测Y帮助了解X ②Y的不确定度减去观测X后Y残存的不确定度,通过观测X帮助了解Y的信息 集合对应:并——联合熵;减——条件熵;交——互信息量 X、Y独立→互信息量为0 →H(XY)=H(x)+H(Y)→H(X|Y)=H(X) X、Y相等→互信息量=自身信息量,最大互信息→条件熵为0 信道:信息的通道。信息传输的本质就是,利用接收的结果估计发送的结果,互信息 信道容量:互信息最大值 常见信道: I)BSC 对称二进制信道,差错概率ε,信道容量C=1+εlogε+(1-ε)log(1-ε) II)高斯信道:描述信道转移的概率,加性噪声 互信息量 用到h(X|X)=0 。Gauss是最差的加性信道,h(N)最大 信道容量C=max I(X:Y)(信号自己功率受限P) 香农定理:*信号带宽W,单位时间最多2W个采样 低信噪比:C=1.44P/n0 微分熵: 给定峰值约束,规定则最大微分熵的分布是均匀分布p(X)=1/(2A); 若能量受限,最大熵是高斯分布,熵h(N)= 若随机向量映射:J是X对Y的,则 第二讲压缩编码理论 常用傅立叶变换对 ———— 带通抽样:fs≥2 fH/[fH/B] []是取整最低抽样率:2B 窄带信号 O量化 I)均匀量化:量化噪声方差 Δk=Δ=2V/L 量化噪声Δ^2/12 。还有过载噪声 最优量化分层电平在重建电平终点,重建电平在分层电平质心(用x概率密度求) 此时表示yk最小bit数 工程运用:-V~V均匀量化,不考虑过载,信噪比:/=,多一位码字6dB改善 II)非均匀量化:用于语音,经常落入的区域精度高,损失小,不常落入的区域权重低 压缩编码:取ln→均匀量化→编码;扩张解码:解码→均匀重建→扩张(做exp) 对数量化:y=1/B*lnX 则信噪比S/=3*(L/BV)^2 O PCM 脉冲编码调制 13折现A律近似,或者15折现μ律近似 PCM协议:M1~M8:M1,极性(正负);M2~M4,段落;M5~M8 每段中电平位置 第三讲数字基带传输(一) O符号映射 bit:数字传输的“基本粒子” 符号:集装箱卡车,用于承载信息,可以是物理量 常用M表示符号集合的元素数目。1个符号承载的比特: 临位最小差错映射:格雷码。相邻符号对应的比特串只差错一位。 PAM符号集合: PSK、QAM符号集合: ?? ? ???=??????)()()()(2 211 I I x q x x q x x q x X q X Λ Λ∑==I i i x q 1 1 )(?? ? ???=??????)()()()(2211 m q q q q x x x x x x X X m ΛΛ∏ =N i i x q 1 )(第1章 信息论基础 信息是物质和能量在空间和时间上分布的不均匀程度,或者说信息是关于事物运动的状态和规律。 消息是能被人们感觉器官感知的客观物质和主观思维的运动状态或存在状态。 通信系统中形式上传输的是消息,实质上传输的是信息,消息中包含信息,消息是信息的载体。 信息论是研究信息的基本性质及度量方法,研究信息的获取、传输、存储和处理的一般规律的科学。 狭义信息论 信息论研究的范畴: 实用信息论 广义信息论 信息传输系统 信息传输系统的五个组成部分及功能: 1. 信源 信源是产生消息的源。 2. 编码器 编码器是将消息变换成适合于信道传送的信号的设备。 编码器分为信源编码器和信道编码器两种。 3. 信道 信道是信息传输和存储的媒介,如光纤、电缆、无线电波等。 4. 译码器 译码器是编码器的逆变换,分为信道译码器和信源译码器。 5. 信宿 信宿是消息的接收者,可以是人,也可以是机器。 离散信源及其数学模型 离散信源—消息集X 为离散集合,即时间和空间均离散的信源。 连续信源—时间离散而空间连续的信源。波形信源—时间和空间均连续的信源。 无记忆信源—X 的各时刻取值相互独立。有记忆信源—X 的各时刻取值互相有关联。 离散无记忆信源的数学模型—离散型的概率空间: x i ∈{a 1,a 2,…,a k } 1≤i ≤I 0≤q(x i )≤1 离散无记忆N 维扩展信源的数学模型: x =x 1x 2…x N x i ∈{a 1,a 2,…,a k } 1≤i ≤N q (x )=q (x 1x 2 … x N )= 离散信道及其数学模型 离散信道—信道的输入和输出都是时间上离散、取值离散的随机序列。离散信道有时也称为数字信道。 连续信道—信道的输入和输出都是时间上离散、取值连续的随机序列,又称为模拟信道。 半连续信道—输入序列和输出序列一个是离散的,而另一个是连续的。 波形信道—信道的输入和输出都是时间上连续,并且取值也连续的随机信号。 无记忆信道—信道的输出y 只与当前时刻的输入x 有关。 有记忆信道—信道的输出y 不仅与当前时刻的输入x 有关,还与以前的输入有统计关系。 信息论基础理论与应用考试题 一﹑填空题(每题2分,共20分) 1.信息论研究的目的就是要找到信息传输过程的共同规律,以提高信息传输的 (可靠性)﹑(有效性)﹑保密性和认证性,使信息传输系统达到最优化。 (考点:信息论的研究目的) 2.电视屏上约有500×600=3×510个格点,按每点有10个不同的灰度等级考虑,则可组成5 31010?个不同的画面。按等概计算,平均每个画面可提供的信息量约为(610bit /画面)。 (考点:信息量的概念及计算) 3.按噪声对信号的作用功能来分类信道可分为 (加性信道)和 (乘性信道)。 (考点:信道按噪声统计特性的分类) 4.英文电报有32个符号(26个英文字母加上6个字符),即q=32。若r=2,N=1,即对信源S 的逐个符号进行二元编码,则每个英文电报符号至少要用 (5)位二元符号编码才行。 (考点:等长码编码位数的计算) 5.如果采用这样一种译码函数,它对于每一个输出符号均译成具有最大后验概率的那个输入符号,则信道的错误概率最小,这种译码规则称为(最大后验概率准则)或(最小错误概率准则)。 (考点:错误概率和译码准则的概念) 6.按码的结构中对信息序列处理方式不同,可将纠错码分为(分组码)和(卷积码)。 (考点:纠错码的分类) 7.码C={(0,0,0,0),(0,1,0,1),(0,1,1,0),(0,0,1,1)}是((4, 2))线性分组码。 (考点:线性分组码的基本概念) 8.定义自信息的数学期望为信源的平均自信息量,即(11()log ()log ()()q i i i i H X E P a P a P a =??==-????∑)。 信息论概念复习题 一、填空 1948年,美国数学家 香农 发表了题为“通信的数学理论”的长篇论文,从而创立了信息论。 人们研究信息论的目的是为了 高效、可靠、安全 地交换和利用各种各样的信息。 信息的 可度量性 是建立信息论的基础。 统计度量 是信息度量最常用的方法。 熵 是香农信息论最基本最重要的概念。 事物的不确定度是用时间统计发生 概率的对数 来描述的。 7、单符号离散信源一般用随机变量描述,而多符号离散信源一般用 随机矢量 描述。 8、一个随机事件发生某一结果后所带来的信息量称为自信息量,定义为 其发生概率对数的负值 。 9、自信息量的单位一般有 比特、奈特和哈特 。 10、必然事件的自信息是 0 。 11、不可能事件的自信息量是 ∞ 。 12、两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。 13、数据处理定理:当消息经过多级处理后,随着处理器数目的增多,输入消息与输出消息之间的平均互信息量 趋于变小 。 14、离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍 。 15、离散平稳有记忆信源的极限熵, =∞H ) /(lim 1 21-∞→N N N X X X X H 。 16、对于n 元m 阶马尔可夫信源,其状态空间共有 nm 个不同的状态。 17、一维连续随即变量X 在[a ,b]区间内均匀分布时,其信源熵为 log2(b-a ) 。 18、根据输入输出信号的特点,可将信道分成离散信道、连续信道、半离散或半连续 信道。 19、信道的输出仅与信道当前输入有关,而与过去输入无关的信道称为 无记忆 信道。 20、具有一一对应关系的无噪信道的信道容量C= log2n 。 21、对称信道的信道容量C= log2m-Hmi 。 22、对于离散无记忆信道和信源的N 次扩展,其信道容量CN= NC 。 24、信道编码定理是一个理想编码的存在性定理,即:信道无失真传递信息的条件是 信息率小于信道容量 。 25、信息率失真理论是量化、数模转换、频带压缩和 数据压缩 的理论基础。 26、求解率失真函数的问题,即:在给定失真度的情况下,求信息率的 极小值 。 27、单符号的失真度或失真函数d (xi ,yj )表示信源发出一个符号xi ,信宿再现yj 所引起的 误差或失真 。 28、汉明失真函数 d (xi ,yj )=? ??≠=j i j i 1 0 。 29、如果规定平均失真度D 不能超过某一限定的值D ,即:D D ≤。我们把D D ≤称为 保真度准则 。 30 、 试验信道的集合用PD 来表示,则PD= {}m j n i D D x y p i j ,,2,1,,,2,1;:)/( ==≤ 。 信息论回答了通信的两个最基本问题: (1)数据压缩的极限; (2)信道传输速率的极限; 信息、消息和信号 消息:信息的載體(能被感知和理解、進行傳遞和獲取) 信息:事物運動狀態或存在方式的不確定性的描述(香農)先驗概率:P(a i) 自信息:I(a i)=log[P-1(a i)];(信息接收的不確定性) 互信息:I(a i;b i)= log[P-1(a i)]- log[P-1(a i|b i)]; (信息接收的多少度量) (若信道無干擾,則互信息等於自信息等於0) 優點:明確的數學模型、定量計算; 缺點:有適用範圍; 信號; 通信系统的模型 通信系统的基本要求:有效、可靠、保密、认证 2. 离散信源及其信息测度 ﹣离散信源的定义:輸出信息數有限、每次只輸出一個; ﹣自信息的定义及物理意义 事件發生前:事件發生的不確定性; 事件發生后:時間含有的信息量; 信息熵的定义及物理意义,信息熵的基本性质 定義:自信息的數學期望( H(X)= -∑[ P(a i)logP(a i) ] )信源的總體信息測度 (1)每個消息所提供的平均信息量; (2)信源輸出前,信源的平均不確定性; 性質:(1)對稱性;(2)確定性; (3)非負性;(4)擴展性(可拆開); (5)可加性;[ H(XY)=H(X)+H(Y) ] (6)強可加性;[ H(XY)=H(X)+H(Y|X) ] (7)遞增性; (8)極值性; [ H(p1,p2,p3…,p q)≤H(q-1,,…, q-1)= logq ] 等概率分佈信源的平均不確定性最大,稱為最大離散熵定理; —离散无记忆信源的扩展信源 —扩展信源的熵 H(X) = NH(X) —离散平稳信源:联合概率分布与时间起点无关; 熵:联合熵 H(X1X2)=∑∑P(a i a j)logP(a i a j) 条件熵 H(X2|X1)=-∑∑P(a i a j)logP(a i|a j) 关系:H(X1X2)=H(X1)+H(X2|X1) 熵率:离散平稳信源的极限熵 = limH(X N|X1X2…X N-1) —马尔可夫信源:某一时刻的输出只与此刻信源所处的状态有关而与以前的状态及以前的输出符号都无关; —马尔可夫信源的熵:H m+1=H(X m+1|X1X2…X m) —信源剩余度 熵的相对率η= H极限/H0 信源剩余度(输出符号间依赖强度)γ= 1-η=1-H极限/H0 3. 离散信道及其信道容量 —H(X;Y)=H(X)-H(X|Y) —离散信道的数学模型 —信道矩阵性質 (1)P(a i bj)=P(a i)P(b j|a i)=P(b j)P(a i|b j); 《信息论基础》答案 一、填空题(共15分,每空1分) 1、若一连续消息通过某放大器,该放大器输出的最大瞬时电压为b,最小瞬时电压为a。 若消息从放大器中输出,则该信源的绝对熵是无穷大;其能在每个自由度熵的最 大熵是log b-a 。 2、高斯白噪声信道是指信道噪声服从正态分布,且功率谱为常数。 3、若连续信源的平均功率为 5 W,则最大熵为1.2 Iog10 e ,达到最大值的条件是高 斯信道。 4、离散信源存在剩余度的原因是信源有记忆(或输岀符号之间存在相关性)和不 等概。 5、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。 6、离散无记忆信源在进行无失真变长信源编码时,码字长度是变化的。根据信源符号 的统计特性,对概率大的符号用短码,对概率小的符号用长码,这样平均码长 就可以降低,从而提高编码效率。 7、八进制信源的最小熵为0 ,最大熵为3bit 。 8、一个事件发生概率为,则自信息量为3bit 。 9、在下面空格中选择填入数字符号“,,,”或“ <” H XY 二HY HXY HY H X 二、判断题(正确打",错误打X)(共5分,每小题1分) 1)离散无(")记忆等概信源的剩余度为0 。 2) 离散无记忆信源N次扩展源的熵是原信息熵的N倍(") 3) 互信息可正、可负、可为零。 (") 4) 信源的真正功率P 永远不会大于熵功率P ,即P P (X ) 5) 信道容量与信源输出符号的概率分布有关。 (X ) 、(5分)已知信源的概率密度函数p x如下图所示,求信源的相对熵 * p x 0.5 4 h x 2 p x log p x dx 1bit自由度 四、(15分)设一个离散无记忆信源的概率空间为P x 0.5 0.5 它们通过干扰信道,信道输出端的接收信号集为丫= 示。 试计算: (1)信源X中事件x的自信息量;(3分) (2)信源X的信息熵;(3分) (3)共熵H XY ; ( 3 分) (4)噪声熵H Y X ;(3分) (5)收到信息丫后获得的关于信源X的平均信息量。(1)I x11bit (2)H丄,丄1bit/符号 2 2,已知信道出书概率如下图所 (3 分) 第2章过程论 2.1 复习笔记 一、教学过程的本质 1.教学过程的本质 (1)关于教学过程本质的几种观点 ①认识发展说 这种观点认为,教学过程是教师有目的有计划地引导学生掌握文化科学基础知识和基本技能,发展认识能力,逐步形成辩证唯物主义世界观基础和共产主义道德品质的过程。这种观点提出了教学的认识与发展的任务,但它并没有对教学过程进行科学的抽象,因而不能完整而确切地定义教学过程。 ②双边活动说 这种观点认为,教学过程是教师的教与学生的学相结合的双边活动过程。该观点将教学过程看作一个活动过程,为进一步探讨教学过程的本质奠定了认识论的基础。但它并没有揭示教学过程中教师的教与学生的学之间的主次关系。 ③多重本质说 这种观点认为,教学过程既然是多层次、多类型的,那么教学过程的本质也应该是多级别、多类型的,从而提出教学过程有认识论、心理学、生理学、伦理学和经济学五个方面的本质。这样从多学科多角度对教学过程进行分析研究,有利于打开人们的思路,清除教学论研究中的形而上学的弊端。但是,其不足之处在于将“多方面的质”混同为“多类型的本质”, 未能从整体上对教学过程进行合理综合与深刻把握。 ④交往本质说 这种观点认为,教学过程是师生交往的过程,交往即是教学过程的本质。这种观点有助于人们认识到教学活动的社会属性,但它又忽视了教师与学生之间在认识中的相互影响,因而还是不能完全揭示教学过程的本质。 (2)本书的观点 教学过程是学生在教师的指导下,对人类已有知识经验的认识活动和改造主观世界、形成和谐发展个性的交往实践活动的统一过程。它包括认识和实践两个方面。 ①从认识方面来看,教学过程是学生在教师指导下认识世界的过程,是接受前人积累的知识经验的过程。 ②从交往实践方面来看,学校教学活动是人类实践活动形式之一。就教师来说,教学活动是教师根据一定社会的要求改造受教育者主观世界的实践活动;就学生来说,教学过程是学生在教师指导下,促进自身社会化的实践活动。 教学过程就其实质来说,是人类认识过程的一种形式,但它又是人类认识活动中的一种特殊形式,具有自己的特殊性。这种特殊性主要表现在认识和交往实践两个方面: ①从认识方面来看,教学过程是学生的一种特殊的认识过程,其特殊性表现在以下方面: 第一,学生的认识对象具有特殊性。在教学过程中,学生认识的对象以间接经验为主。 第二,学生的认识条件具有特殊性。教学过程中学生的认识活动是在教师指导下进行的。 第三,学生的认识任务具有特殊性。教学过程中学生的认识活动,不仅要掌握知识、技能,而且还要发展智力,形成科学的世界观和共产主义道德品质。 ②从交往实践方面来看,教学过程中的交往实践活动也有其特殊性。这表现在以下方面: 第一,交往实践目的的特殊性。即更好地掌握理性知识,同时将其掌握的理性知识再回 信息论基础1答案 《信息论基础》答案 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分为有记忆信源和无记忆信源两大类。 2.一个八进制信源的最大熵为3bit/符号 3.有一信源X ,其概率分布为 123x x x X 111P 2 44?? ?? ?=?? ??? ?? , 其信源剩余度为94.64%;若对该信源进行十次扩展,则每十个符号的平均信息量是 15bit 。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。若消息从放大器中输出,则该信源的绝对熵是 ∞ ;其能在每个自由度熵的最大熵是log (b-a ) bit/自由度;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 2Flog (b-a )bit/s. 5. 若某一 信源X ,其平均功率受限为 16w,其概率密度函数是高斯分布时,差熵的 最大值为1log32e π;与其熵相等的非高斯分布信2 源的功率为16w ≥ 6、信源编码的主要目的是提高有效性,信道编码的主要目的是提高可靠性。 7、无失真信源编码的平均码长最小理论极限 (S))。 制为信源熵(或H(S)/logr= H r 8、当R=C或(信道剩余度为0)时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为无失真信源编码和限失真信源编码。 10、在下面空格中选择填入数学符号“,,, =≥≤?”或“?” (1)当X和Y相互独立时,H(XY)=H(X)+H(X/Y)。 (2)假设信道输入用X表示,信道输出用Y 表示。在无噪有损信道中,H(X/Y)> 0, H(Y/X)=0,I(X;Y) 一、填空题(本大题共10小空,每小空1分,共20分) 1.按信源发出符号所对应的随机变量之间的无统计依赖关系,可将离散信源分 为 和 2.一个八进制信源的最大熵为 3.有一信源X ,其概率分布为??? ? ? ???=??? ???414 12 1 321 x x x P X ,其信源剩余度为 ;若对该信源进行十次扩展,则每十个符号的平均信息量是 。 4.若一连续消息通过放大器,该放大器输出的最大瞬间电压为b ,最小瞬时电压为a 。若消息从放大器中输出,则该信源的绝对熵是 ;其能在每个自由度熵的最大熵是 ;若放大器的最高频率为F ,则单位时间内输出的最大信息量是 . 5. 若某一 信源X ,其平均功率受限为16w ,其概率密度函数是高斯分布时,差熵的最大值为 ;与其熵相等的非高斯分布信源的功率为 6、信源编码的主要目的是 ,信道编码的主要目的是 。 7、无失真信源编码的平均码长最小理论极限制为 . 8、当 时,信源与信道达到匹配。 9、根据是否允许失真,信源编码可分为 和 。 10、在下面空格中选择填入数学符号“,,, =≥≤?”或“?” (1)当X和Y相互独立时,H(XY) H(X)+H(X/Y)。 (2)假设信道输入用X表示,信道输出用Y表示。在无噪有损信道中,H(X/Y) 0, H(Y/X) 0,I(X;Y) H(X)。 二、(8分)掷两粒骰子,各面出现的概率都是1/6,计算信息量: 1.当点数和为3时,该消息包含的信息量是多少? 2.当点数和为7是,该消息包含的信息量是多少? 3.两个点数中没有一个是1的自信息是多少? 三、(12分)设X、Y是两个相互统计独立的二元随机变量,其取-1或1的概率相等。定义另一个二元随机变量Z,取Z=YX(一般乘积)。试计算: 1.H(Y)、H(Z); 2.H(XY)、H(YZ); 3.I(X;Y)、I(Y;Z); 四、(15分)如图所示为一个三状态马尔科夫信源的转移概率矩阵 P= 11 22 11 0 22 111 424?? ? ? ? ? ? ? ??? 1.绘制状态转移图; 2.求该马尔科夫信源的稳态分布; 3.求极限熵; 五、(12分)在干扰离散对称信道上传输符号1和0,已知P(0)=1/4,P(1)=3/4, 《公共政策学》宁骚版笔记 《公共政策学》宁骚(2010最新版) 第一章公共政策学的学科要素 第二章公共政策与政策工具 第三章政策系统与公共决策体制 第四章政策过程及其理论模型 第五章政策问题与议程设定 第六章政策方案的规划与抉择 第七章公共政策执行 第八章公共政策的评估与监控 第九章公共政策的稳定、变动与终结 第十章公共政策学知识的应用 25 / 1 《公共政策学》宁骚版笔记 第一章公共政策学的学科要素 ※公共政策学:公共政策学是这样一门学科,它尽可能的运用科学方法研究公共政策的内容、过程与产出,探索其固有规律,形成系统性知识,并运用这种知识进行政策分析,进而通过公共权力机关将研究结果转化为政策实践。 ※公共政策学的学科要素有:①研究对象②概念体系③研究方法 ※政府组织即公共权力组织的决策行为,是公共政策学研究对象的核心和重点。 ※公共政策学的研究对象: (一)公共政策:作为公共政策学的研究对象的公共政策,指的是公共权力机关建立起来的包括立法、行政、司法三权在内的所有国家机构,以及一定类型的政治体制内的执政党制定和实施的政策。可以区分为三个层次: 1、具体的个别政策; 2、政策群和政策链: (1)政策群:是指国家、政府和一定类型的政治体制中的执政党某一较长时间内制定和实施的内容各异但理念同源、导向相近的政策的聚合体。 (2)政策链:是指国家、政府和一定类型的政治体制中的执政党为解决同一政策问题而先后制定的在内容上具有一致性、在形态和功能上具有差别性的一系列政策。 3、政策一般:从无数项具体的个别的政策和众多的政策群、政策链中,抽象出所有的政策的共同的本质和属性。 (二)政策系统。对政策系统的研究应予重视的四个突出问题: 1、直接的政策制定系统中决策者的类别差异; 2、公共政策的直接主体系统对对象系统的地位的相对性; 3、公共政策的直接主体与政策支持系统的地位的相对性; 4、公共政策制定系统内部的结构。有四种类型:①线性结构②职能结构③线性—参谋结构④矩阵结构 (三)政策过程:决策行为是选定目标和选取最优化方案并付诸实施的行为。决策行为是一个有一连串相互衔接的阶段、环节或程序组成的完整的政策过程;即决定做什么,做什么;政策过程是一个自始至终不断地进行选择的过程,即分析如何认定,解决问题,哪些因素对方案的实施造成影响,结果是否一致及其造成的主要原因等。 ※公共政策学的研究方法: (一)研究程序的设计: 1、提出拟研究的政策问题 2、确定假设 3、收集系统资料 4、资料分析 5、做操作性研究 6、撰写研究报告 (二)政策研究的资料收集方法: 1、一手资料的收集: (1)定量的一手资料常采用抽样调查的方式 (2)定性的一手资料收集方法:①无结构访谈法②实地观察法③非参与观察法④参与观察法2、二手资料的收集与分析方法有:①内容分析法②二次分析法③现存统计资料分析法 25 / 2 《公共政策学》宁骚版笔记 (三)公共政策的研究视角和路径: 1、公共政策的系统分析方法——政策系统的环境分析、目标分析和结构分析; 2、公共政策的矛盾分析方法 3、公共政策的历史分析方法; 4、公共政策的比较分析方法; 传播学通论背诵笔记 一、总论 1.历史上关于传播的定义大体上有共享说、劝服说、反应说三种: (1)共享说:认为传播就是信息共享的过程。 不足:人类传播是借助符号传播信息,人们共享的不是符号,而是符号所代表的意义,许多传播是无法达到共享的。 (2)劝服说:持这种观点的人认为,传播是有目的的行为,突出了传播的功利性。 不足:在传播过程中影响是相互的,传播的角色关系会发生变化,传播者和受传者有时是相互转换的,传播者在影响他人的同时,也在受他人影响。 (3)反映说:传播是一个有机体对于某种刺激的各不相同的反应。 不足:刺激反应不仅是人类的传播行为,动植物都有刺激反应问题。 2.通论的传播定义:传播是信息在时间和空间的移动和变化。 3.对通论传播定义的认识: (1)传播具有信息性质(2)传播具有可流动性和可测度: (3)信息具有可转换性 4.传播学产生的诱因和基础: (1)人类科学技术的发展(2)政治与战争的需要 (3)新闻学的发展 5.传播学的研究内容: 传播学的发展基础是20世纪崛起的行为科学和三论:信息论、系统论、控制论,三论是传播学的方法论。 6. 传播学四大奠基人和集大成者 (1)拉斯维尔(政治学家):①他首先用政治学的观点对传播进行系统的研究。②他提出了著名的5W传播模式和传播的三功能说。③他用定量语义学的方法,比较了有意义的政治符号在不同时间和地点在主要新闻机构的分布。 (2)保罗-拉扎斯菲尔德(社会学家):①他把社会学实地调查的方法和研究社会实际问题的范围扩大到传播学领域。②他是首先从受众角度研究大众传播效果的社会学家之一。③在从受众角度研究传播效果的过程中,提出了两级传播论、有限效果论和使用与满足论等著名观点。主要著作:《人民的选择》1944 (3)库尔特-卢因(社会心理学家):①他把心理学的实验方法引入社会学研究的同时,实际上也给传播学研究提供了一种有效的手段。②他对人们行为和群体的研究中,在研究大众传播媒介对个人的影响时,要充分注意社会环境和个人所属群体的作用。③他提出了著名的把关人概念,为信息流动的复杂性提供了圆满的解释。 (4)卡尔-霍夫兰(心理学家):①他较完善地把心理学控制实验的方法用于传播效果的研究。 ②他对军事教育电影的研究,为打破魔弹论的神话提供了更有价值的证据。③他注意到影响说服效果的多种因素,尤其是说服者及其发出的信息这两个因素,并提出了改善说服效果的一些列有价值的建议,为可说服性研究这个当代传播学重要课题奠定了基础。主要著作:《大众传播实验》1949 《传播与说服》1953 (5)施拉姆:①施拉姆是第一位从新闻专业角度,并把新闻学同政治学、社会学、心理学结合起来,把传播学作为一门独立学科来研究。他编著的《大众传播学》是人类历史上第一步系统提出传播学理论的奠基之作。②一生30多部传播学著作。③积极推动各国传播学者的交流,扩大传播学在教育及学术界的影响,培养众多知名学者,形成“施拉姆学派” 11.传播学源于美国的必然性: 传播学在美国产生的社会基础: (1)科学技术和通讯技术的进步 (2)文化教育事业得到空前发展,为美国大众传播业的发展提供了广泛的群众基础。 (3)美国经济发展使人口激增,向大城市大规模迁移,使美国形成具有现代意义的城市社会。传播学在美国产生的学术基础 《信息论基础》试卷答案 一、填空题(共25分,每空1分) 1、连续信源的绝对熵为 无穷大。(或()()lg lim lg p x p x dx +∞ -∞?→∞ --??) 2、离散无记忆信源在进行无失真变长信源编码时,编码效率最大可以达到 1 。 3、无记忆信源是指 信源先后发生的符号彼此统计独立 。 4、离散无记忆信源在进行无失真变长编码时,码字长度是变化的。根据信源符号的统计特性,对概率大的符号用 短 码,对概率小的符号用 长 码,这样平均码长就可以降低,从而提高 有效性(传输速率或编码效率) 。 5、为了提高系统的有效性可以采用 信源编码 ,为了提高系统的可靠性可以采用 信道编码 。 6、八进制信源的最小熵为 0 ,最大熵为 3bit/符号 。 7、若连续信源输出信号的平均功率为1瓦特,则输出信号幅度的概率密度函数为 高斯分布(或()0,1x N 2 2 x -)时,信源具有最大熵,其值为 0.6155hart(或1.625bit 或1lg 22 e π)。 8、即时码是指 任一码字都不是其它码字的前缀 。 9、无失真信源编码定理指出平均码长的理论极限值为 信源熵(或H r (S)或()lg H s r ),此时编码效率为 1 ,编码后的信息传输率为 lg r bit/码元 。 10、一个事件发生的概率为0.125,则自信息量为 3bit/符号 。 11、信源的剩余度主要来自两个方面,一是 信源符号间的相关性 ,二是 信源符号概率分布的不均匀性 。 12、m 阶马尔可夫信源的记忆长度为 m+1 ,信源可以有 q m 个不同 的状态。 13、同时扔出一对均匀的骰子,当得知“两骰子面朝上点数之和为2”所获得的信息量为 lg36=5.17 比特,当得知“面朝上点数之和为8”所获得的信息量为 lg36/5=2.85 比特。 14.在下面空格中选择填入的数学符号“=,≥,≤,>”或“<” H(XY) = H(Y)+H(X ∣Y) ≤ H(Y)+H(X) 第一张广播的诞生 第一节广播诞生的物质条件和内在因素 1,大众传播媒介:报纸,杂志,广播,电视 2,1888年,德国物理学家发现电磁炉并证明电磁波的反射,折射,衍射,绕射等性质。 3,1895年,俄国科学家波波夫和意大利科学家马可尼各自通过独立的研究,完成了无线电通讯(电报)的发明和实验,制成了最初的无线电接收机,为无线电广播的问世奠定了物质基础。19世纪末20世纪初的“无线电热”促使科学家把目光投向新的领域——利用无线电技术传送人的语言和声音,加拿大人费森登首先获得成功。 4,美国的广播电台,是世界上最早拥有广播电台的国家。第一个取得营业执照(商业执照)的电台是匹兹堡市的西屋电气公司电台,呼号为KDKA.。11月2日,KDKA广播电台开播,广播的第一个节目是报告共和党候选人哈定和民主党候选人柯克斯竞选的选票统计情况和最终结果。1926年9月成立了全国广播公司(NBC);1927年,一些较小的独立电台组合成立了哥伦比亚广播公司(CBS);1945年,在蓝色广播网的基础上,成立了美国广播公司(ABC 5,1922年12月15日,英国广播公司,BBC成立,1926年12月30日英王颁发了一项“皇家约章”解散了BBC,1927年元旦,新的英国广播公司成立,这才是现在的BBC。英国的广播制度属公私(商)并营制。 6,1921年,法国邮电部经手筹建广播电台。 7,前苏联也是世界谁管你最早建设广播事业的国家之一,前苏联广播事业的创建是同列宁的名字联系在一起的,它标志着无产阶级广播事业的起始。1921年2月18日,列宁签署委任书,任命奥斯塔利亚科夫为莫斯科中央无线电话太工程部主任,负责筹建中央广播电台,1922年5月27日,该台建成并进行了试播,8月21日正式播出,11月7日,该台被命名为“共产党国际广播电台”。 第三节 1,我国的广播事业,可以用三句话来概括: 一,步履维艰的昨天;上海是中国广播的发源地,旧中国官办广播电台始于1926年,1932年夏,“中央广播无线电台管理处”成立,1939年,国民党政府在重庆建立了对外广播台——国际广播电台。1940年12月30日,我国无线广播呼号的第一个字为X,这一天成为人民广播的创办日,1949年6月5日,中央广播事业管理处成立。 二,蓬勃发展的今天;1,我国的社会主义广播事业,1950年4月,我国正式开办了对外广播,建立了国际广播电台,呼号是“北京广播电台”。1952年4月1日,吉林省九台县有线广播站的成立,标志着我国农村有线广播网建设的开始。1958年5月1日,我国建成了第一座电台——北京电台。1986年2月1日,我国成功地发射了一颗实用广播通信卫星。 2,台湾的广播事业,台湾“中国广播公司”成立于1949年11月16日,1968年7月31日,“中国广播公司”的台北地区调频广播电台正式播音,标志着台湾广播进入调频广播时代。 3,香港的广播事业,成立于1928年6月30日。 4,澳门的广播事业,创办于1950年。 三,光明灿烂的明天 第四节 1,互联网时效性强,信息量大,实时互动,开放度高。 2,广播与互联网联姻的好处:(1)拓宽信息渠道,丰富节目内容;(2)扩大传播空间,获取更多受众;(3)改善自身局限,增强自身活力;(4)借助互动优势,得到更多反馈。 3,广播电视的数字化,主要指用数字技术取代广播电视业务操作中传统的模拟技术。 4,广播电视的数字化的基本特征是,以高度压缩信息量和离散的方式快速处理信息。 5,广播电视的数字化具有三个特点(1)频道资源由模拟时代的稀缺变为丰富;(2)高画面, 第一章传播学的产生与发展 第一节传播与传播学 引论传播与生俱来 一、传播的含义 (一)、传播和Communication Communication的第一个意思应该是沟通。 communication还有一个含义是交通。 Communication 还有一个含义,就是通讯 (二)、传播的定义: 1.共享说:持这种观点的人认为传播是传者和受者对信息的分享。施拉姆2.影响说:也就是劝服说。强调传播者传递信息的目的性和影响性。持这种观点的人认为,传播是有目的的行为,突出了传播的功利性。霍夫兰3.反应说:美国学者S〃S〃史蒂文斯认为传播是一个有机体对于某种刺激的各不相同的反应。 4.互动说:G.格伯纳:通过讯息进行的社会的相互作用。强调传播者与受传者之间通过信息传播相互作用、相互影响的双向性和互动性。 5.过程说:彼德:“大众传播就是通过某些媒介向许多人传递信息、思想和观念的过程。” 概括定义: 传播是人类通过符号和媒介交流信息以期发生相应变化的活动。 1.传播是人类的活动 2.传播是信息的交流 3.传播离不开符号和媒介 4.目的是希望发生相应的变化 (三)、传播与信息 关于信息的本质,按照香农的理论,所谓信息,就是可以减少或消除“不确定性”的内容。 二、传播学的性质与研究对象 (一)、学科定性 人类的知识分属三大门类:即自然科学,人文科学和社会科学。 (二).传播学的研究范围和研究对象 第一,按信息传、受的范围大小,传播学可分为五个研究层次,即自我传播、人际传播、群体传播、组织传播和大众传播。 第二,按传播学自身的结构可分为三个研究层次:理论,模式,研究方法(定量、定性)。 第三,按不同领域划分纵向或横向的研究层次和研究重点。纵向研究主要有:古代传播思想的整理与分析,近现代传播事业的演变等。横向研究有:信息系统——研究与信息处理有关的理论和技术性问题等。 第四,传播学研究可分为宏观研究和微观研究两个层次 (三)、学科特色:多科性边缘学科 1、社会学:研究范式和社会学方法 2、心理学:研究范式和实验法等方法 3、三论 A信息论:信源-编码-信道-译码-信宿信息论基础及答案

通信原理学习笔记

信息论基础总结

信息论基础理论与应用考试题及答案

信息论概念复习1

信息论复习笔记

信息论基础答案2

李秉德《教学论》笔记和课后题详解(过程论)【圣才出品】

信息论基础1答案

信息论试题1

公共政策学宁骚版笔记

传播学通论背诵笔记

信息论基础及答案

广播电视广告学整理笔记

郭庆光 传播学笔记考试版