自组织神经网络

- 格式:ppt

- 大小:457.50 KB

- 文档页数:25

神经网络的发展历程与应用神经网络是一种仿生的人工智能技术,它模拟了人类大脑中神经元之间的连接和信息传递方式,具有自学习和适应性强的特点。

神经网络的发展历程可以追溯到上世纪50年代,经过了长期的理论研究和应用实践,如今已经成为了人工智能领域中的重要技术之一。

本文将从神经网络的发展历程、基本模型、优化算法以及应用领域等方面进行介绍。

一、神经网络的发展历程神经网络的发展历程可以分为三个阶段,分别是感知机、多层前馈神经网络和深度学习。

1. 感知机感知机是神经网络的起源,由美国心理学家罗森布拉特于1957年提出。

感知机是一种单层神经网络,由若干感知器(Perceptron)组成。

每个感知器接收输入信号并进行加权和,然后经过一个阈值函数得到输出。

该模型的最大缺点是只能处理线性可分问题,无法解决非线性问题。

2. 多层前馈神经网络为了克服感知机的局限性,科学家们开始尝试使用多层前馈神经网络来处理非线性问题。

多层前馈神经网络由输入层、隐藏层和输出层组成。

每个神经元都有一个激活函数,用于将输入信号转换为输出。

这种结构可以处理非线性问题,并且可以通过反向传播算法来训练网络参数。

多层前馈神经网络在图像识别、语音识别、自然语言处理等领域得到了广泛应用。

3. 深度学习深度学习是指使用多层神经网络来学习高层次特征表示的一种机器学习方法。

深度学习在计算机视觉、自然语言处理等领域有着广泛的应用。

其中最著名的就是卷积神经网络(CNN)和循环神经网络(RNN)。

卷积神经网络主要用于图像识别和分类问题,循环神经网络主要用于序列预测和语言建模。

二、神经网络的基本模型神经网络的基本模型可以分为三类,分别是前馈神经网络、反馈神经网络和自组织神经网络。

1. 前馈神经网络前馈神经网络是指信息只能从输入层到输出层流动的神经网络。

其中最常用的是多层前馈神经网络,它由多个隐藏层和一个输出层组成。

前馈神经网络的训练主要使用反向传播算法。

2. 反馈神经网络反馈神经网络是指信息可以从输出层到输入层循环反馈的神经网络。

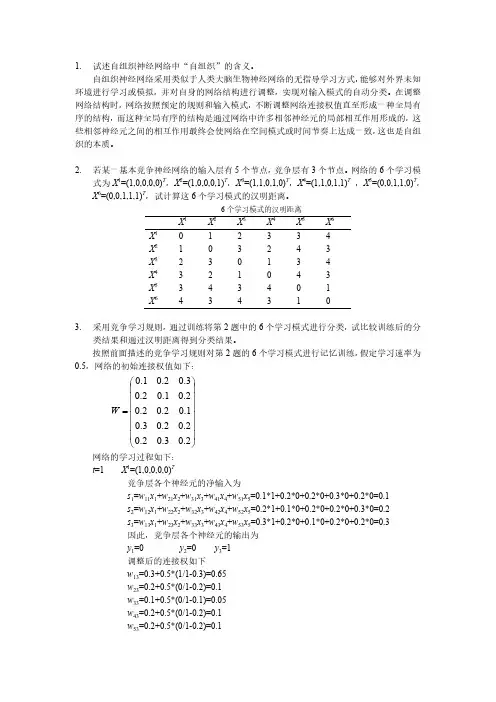

1.试述自组织神经网络中“自组织”的含义。

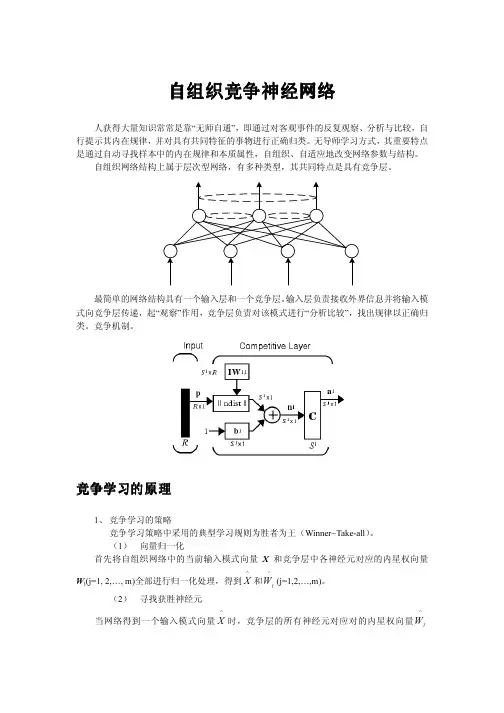

自组织神经网络采用类似于人类大脑生物神经网络的无指导学习方式,能够对外界未知环境进行学习或模拟,并对自身的网络结构进行调整,实现对输入模式的自动分类。

在调整网络结构时,网络按照预定的规则和输入模式,不断调整网络连接权值直至形成一种全局有序的结构,而这种全局有序的结构是通过网络中许多相邻神经元的局部相互作用形成的,这些相邻神经元之间的相互作用最终会使网络在空间模式或时间节奏上达成一致,这也是自组织的本质。

2. 若某一基本竞争神经网络的输入层有5个节点,竞争层有3个节点。

网络的6个学习模式为X 1=(1,0,0,0,0)T ,X 2=(1,0,0,0,1)T ,X 3=(1,1,0,1,0)T ,X 4=(1,1,0,1,1)T ,X 5=(0,0,1,1,0)T ,X 6=(0,0,1,1,1)T ,试计算这6个学习模式的汉明距离。

6个学习模式的汉明距离X 1 X 2 X 3 X 4 X 5 X 6 X 1 0 1 2 3 3 4 X 2 1 0 3 2 4 3 X 3 2 3 0 1 3 4 X 4 3 2 1 0 4 3 X 5 3 4 3 4 0 1 X 6434313. 采用竞争学习规则,通过训练将第2题中的6个学习模式进行分类,试比较训练后的分类结果和通过汉明距离得到分类结果。

按照前面描述的竞争学习规则对第2题的6个学习模式进行记忆训练,假定学习速率为0.5,网络的初始连接权值如下:⎪⎪⎪⎪⎪⎪⎭⎫⎝⎛=2.03.02.02.02.03.01.02.02.02.01.02.03.02.01.0W网络的学习过程如下:t =1 X 1=(1,0,0,0,0)T 竞争层各个神经元的净输入为 s 1=w 11x 1+w 21x 2+w 31x 3+w 41x 4+w 51x 5=0.1*1+0.2*0+0.2*0+0.3*0+0.2*0=0.1 s 2=w 12x 1+w 22x 2+w 32x 3+w 42x 4+w 52x 5=0.2*1+0.1*0+0.2*0+0.2*0+0.3*0=0.2 s 3=w 13x 1+w 23x 2+w 33x 3+w 43x 4+w 53x 5=0.3*1+0.2*0+0.1*0+0.2*0+0.2*0=0.3因此,竞争层各个神经元的输出为 y 1=0 y 2=0 y 3=1调整后的连接权如下 w 13=0.3+0.5*(1/1-0.3)=0.65 w 23=0.2+0.5*(0/1-0.2)=0.1 w 33=0.1+0.5*(0/1-0.1)=0.05 w 43=0.2+0.5*(0/1-0.2)=0.1 w 53=0.2+0.5*(0/1-0.2)=0.1t =2 X 2=(1,0,0,0,1)T 竞争层各个神经元的净输入为 s 1=w 11x 1+w 21x 2+w 31x 3+w 41x 4+w 51x 5=0.1*1+0.2*0+0.2*0+0.3*0+0.2*1=0.3 s 2=w 12x 1+w 22x 2+w 32x 3+w 42x 4+w 52x 5=0.2*1+0.1*0+0.2*0+0.2*0+0.3*1=0.5 s 3=w 13x 1+w 23x 2+w 33x 3+w 43x 4+w 53x 5=0.65*1+0.1*0+0.05*0+0.1*0+0.1*1=0.75因此,竞争层各个神经元的输出为 y 1=0 y 2=0 y 3=1 调整后的连接权如下w 13=0.65+0.5*(1/2-0.65)=0.575 w 23=0.1+0.5*(0/2-0.1)=0.05 w 33=0.05+0.5*(0/2-0.05)=0.025 w 43=0.1+0.5*(0/2-0.1)=0.05 w 53=0.1+0.5*(1/2-0.1)=0.3 t =3 X 3=(1,1,0,1,0)T 竞争层各个神经元的输入为 s 1=w 11x 1+w 21x 2+w 31x 3+w 41x 4+w 51x 5=0.1*1+0.2*1+0.2*0+0.3*1+0.2*0=0.6 s 2=w 12x 1+w 22x 2+w 32x 3+w 42x 4+w 52x 5=0.2*1+0.1*1+0.2*0+0.2*1+0.3*0=0.5 s 3=w 13x 1+w 23x 2+w 33x 3+w 43x 4+w 53x 5=0.575*1+0.05*1+0.025*0+0.05*1+0.3*0=0.675 因此,竞争层各个神经元的输出为y 1=0 y 2=0 y 3=1 调整后的连接权如下w 13=0.575+0.5*(1/3-0.575)=0.4542 w 23=0.05+0.5*(1/3-0.05)=0.1917 w 33=0.025+0.5*(0/3-0.025)=0.0125 w 43=0.05+0.5*(1/3-0.05)=0.1917 w 53=0.3+0.5*(0/3-0.3)=0.15 ……按照上述过程经过多次学习后,网络会得到如下分类结果,与通过汉明距离分析的结果完全一致。

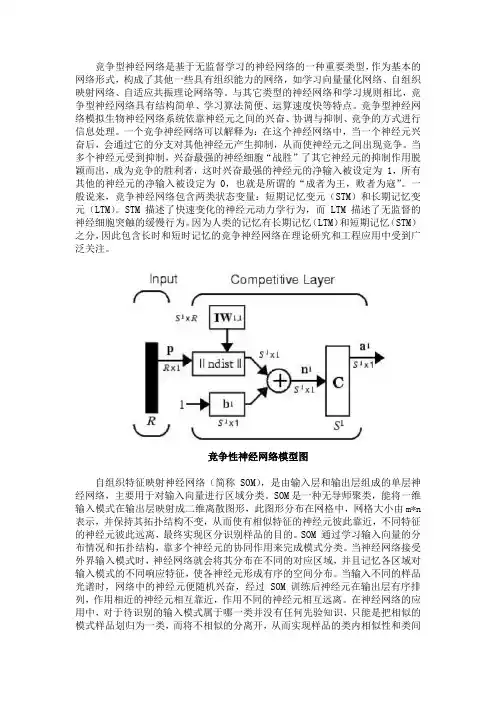

竞争型神经网络是基于无监督学习的神经网络的一种重要类型,作为基本的网络形式,构成了其他一些具有组织能力的网络,如学习向量量化网络、自组织映射网络、自适应共振理论网络等。

与其它类型的神经网络和学习规则相比,竞争型神经网络具有结构简单、学习算法简便、运算速度快等特点。

竞争型神经网络模拟生物神经网络系统依靠神经元之间的兴奋、协调与抑制、竞争的方式进行信息处理。

一个竞争神经网络可以解释为:在这个神经网络中,当一个神经元兴奋后,会通过它的分支对其他神经元产生抑制,从而使神经元之间出现竞争。

当多个神经元受到抑制,兴奋最强的神经细胞“战胜”了其它神经元的抑制作用脱颖而出,成为竞争的胜利者,这时兴奋最强的神经元的净输入被设定为 1,所有其他的神经元的净输入被设定为 0,也就是所谓的“成者为王,败者为寇”。

一般说来,竞争神经网络包含两类状态变量:短期记忆变元(STM)和长期记忆变元(LTM)。

STM 描述了快速变化的神经元动力学行为,而 LTM 描述了无监督的神经细胞突触的缓慢行为。

因为人类的记忆有长期记忆(LTM)和短期记忆(STM)之分,因此包含长时和短时记忆的竞争神经网络在理论研究和工程应用中受到广泛关注。

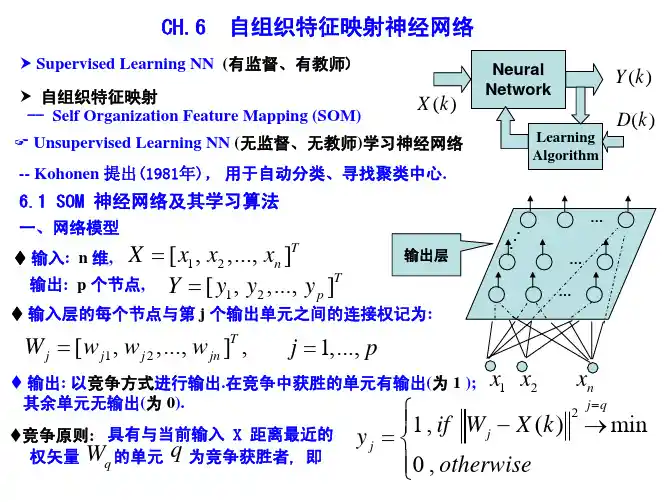

竞争性神经网络模型图自组织特征映射神经网络(简称SOM),是由输入层和输出层组成的单层神经网络,主要用于对输入向量进行区域分类。

SOM是一种无导师聚类,能将一维输入模式在输出层映射成二维离散图形,此图形分布在网格中,网格大小由m*n 表示,并保持其拓扑结构不变,从而使有相似特征的神经元彼此靠近,不同特征的神经元彼此远离,最终实现区分识别样品的目的。

SOM 通过学习输入向量的分布情况和拓扑结构,靠多个神经元的协同作用来完成模式分类。

当神经网络接受外界输入模式时,神经网络就会将其分布在不同的对应区域,并且记忆各区域对输入模式的不同响应特征,使各神经元形成有序的空间分布。

当输入不同的样品光谱时,网络中的神经元便随机兴奋,经过SOM 训练后神经元在输出层有序排列,作用相近的神经元相互靠近,作用不同的神经元相互远离。

自组织特征映射神经网络研究与应用自组织特征映射神经网络,又称Kohonen网络,在机器学习领域中具有广泛的研究和应用价值。

它是由芬兰科学家Teuvo Kohonen于1982年提出的,用来解决模式分类和聚类问题。

本文将分别从网络结构、学习规则、应用场景等多个角度来介绍自组织特征映射神经网络的研究与应用。

一、网络结构自组织特征映射神经网络是一种有两层或多层的神经元组成的全连接网络,其特点是每个神经元与输入节点全连接,但只有部分神经元与输出节点连接,这些与输出节点相连接的神经元被称作胜者神经元。

胜者神经元的选择根据输入数据与神经元之间的权值距离进行,即越接近输入数据的神经元越容易胜出。

自组织特征映射神经网络的网络结构简单,但它可以通过适当调整参数,从而实现多种复杂的函数映射。

在具体应用中,还可以采用层级结构的自组织特征映射神经网络,对于复杂的数据集,可以通过层层处理,逐步提取其更高层次的特征。

二、学习规则自组织特征映射神经网络的学习规则是基于竞争性学习的,其原理是将输入数据投影到高维空间中的低维网格上,使其可以进行分类和聚类。

其学习过程中所用的算法有两种:批处理算法和在线算法。

批处理算法在每个Epoth后,在一个批次中对全部样本进行训练,并更新权值,从而可以获得更稳定的结果,但训练时间较长。

而在线算法则是对每个样本逐个进行学习,因此训练速度较快,但结果相对不稳定。

在学习过程中,自组织特征映射神经网络会通过不断调整权值,形成特征抽取与分类能力强的模型。

其学习的结果可以通过可视化方式,将数据点在网格上的分布呈现出来,形成热图的形式,便于分析与理解。

三、应用场景自组织特征映射神经网络在数据挖掘、图像处理、生物信息学等领域都有着广泛的应用。

在图像处理领域中,可以通过自组织特征映射神经网络对图像进行压缩和分类。

在数据挖掘方面,自组织特征映射神经网络可用于数据聚类和数据可视化。

通过自组织特征映射神经网络,大量数据可以被投射到低维空间,并形成可视化热图,从而能够更好地理解数据的分布规律。

自组织映射(self-organizing feature mapping)自组织神经网络SOM(self-organization mapping net)是基于无监督学习方法的神经网络的一种重要类型。

自组织映射网络理论最早是由芬兰赫尔辛基理工大学Kohen于1981年提出的。

此后,伴随着神经网络在20世纪80年代中后期的迅速发展,自组织映射理论及其应用也有了长足的进步。

它是一种无指导的聚类方法。

它模拟人脑中处于不同区域的神经细胞分工不同的特点,即不同区域具有不同的响应特征,而且这一过程是自动完成的。

自组织映射网络通过寻找最优参考矢量集合来对输入模式集合进行分类。

每个参考矢量为一输出单元对应的连接权向量。

与传统的模式聚类方法相比,它所形成的聚类中心能映射到一个曲面或平面上,而保持拓扑结构不变。

对于未知聚类中心的判别问题可以用自组织映射来实现。

[1]自组织神经网络是神经网络最富有魅力的研究领域之一,它能够通过其输入样本学会检测其规律性和输入样本相互之间的关系,并且根据这些输入样本的信息自适应调整网络,使网络以后的响应与输入样本相适应。

竞争型神经网络的神经元通过输入信息能够识别成组的相似输入向量;自组织映射神经网络通过学习同样能够识别成组的相似输入向量,使那些网络层中彼此靠得很近的神经元对相似的输入向量产生响应。

与竞争型神经网络不同的是,自组织映射神经网络不但能学习输入向量的分布情况,还可以学习输入向量的拓扑结构,其单个神经元对模式分类不起决定性作用,而要靠多个神经元的协同作用才能完成模式分类。

学习向量量化LVQ(learning vector quantization)是一种用于训练竞争层的有监督学习(supervised learning)方法。

竞争层神经网络可以自动学习对输入向量模式的分类,但是竞争层进行的分类只取决于输入向量之间的距离,当两个输入向量非常接近时,竞争层就可能把它们归为一类。