最新决策树例题分析及解答_(1)复习课程

- 格式:ppt

- 大小:1.08 MB

- 文档页数:31

![[复习]决策树决策表练习题与参考答案](https://uimg.taocdn.com/bc70093159fb770bf78a6529647d27284b733702.webp)

1.某厂对一部分职工重新分配工作,分配原则是:

⑴年龄不满20岁,文化程度是小学者脱产学习,文化程度是中学者当电工;

⑵年龄满20岁但不足50岁,文化程度是小学或中学者,男性当钳工,女性当车工;文化程度是大专者,当技术员。

⑶年龄满50岁及50岁以上,文化程度是小学或中学者当材料员,文化程度是大专者当技术员。

要求:做出决策表。

2、试画出某企业库存量监控处理的判断树。

若库存量≤0,按缺货处理;若库存量≤库存下限,按下限报警处理;若库存量>库存下限,而又≤储备定额,则按订货处理;若库存量>库存下限,而又>储备定额,则按正常处理;若库存量≥库存上限,又>储备定额,则按上限报警处理。

3某货运站收费标准如下:

若收件地点在本省,则快件6元/公斤,慢件4元/公斤;

若收件地点在外省,则在25公斤以内(包括25公斤),快件8元/公斤,慢件6元/公斤;而超过25公斤时,快件10元/公斤,慢件8元/公斤;

画出决策表和决策树:

决策表:

优化后的结果如下所示:

决策树:

收费

本省

外省快件

慢件

快件

慢件

≤25斤

>25斤

≤25斤

>25斤

6元

4元

8元

10元

6元

8元

地点规格重量收费金额。

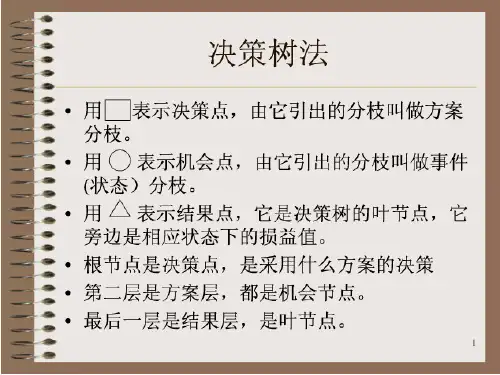

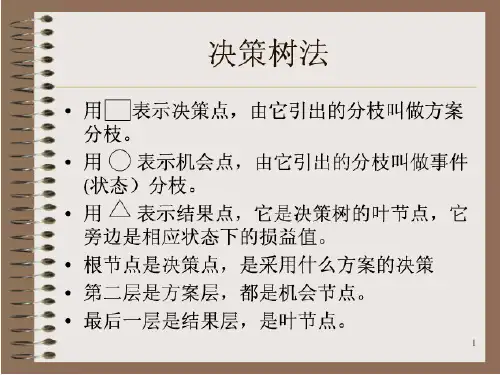

回归问题的决策树题目和解答(原创实用版)目录1.决策树的基本概念2.回归问题的决策树3.决策树的构建过程4.决策树的应用实例5.决策树的优缺点正文一、决策树的基本概念决策树是一种基本的分类和回归方法,通过将数据集分成许多子集,每个子集对应一个决策节点,直到最终得到叶子节点为止。

决策树可以分为分类决策树和回归决策树。

分类决策树主要用于分类问题,而回归决策树主要用于回归问题。

二、回归问题的决策树回归决策树主要用于解决回归问题,即预测一个连续值的问题。

在回归问题中,决策树的每个内部节点表示一个特征,每个分支表示一个决策规则,而叶子节点表示预测结果。

通过组合不同特征的预测结果,可以得到最终的回归预测值。

三、决策树的构建过程决策树的构建过程主要包括以下步骤:1.特征选择:从训练数据集中选择一个最佳特征进行划分。

最佳特征的选择可以采用信息增益、增益率、基尼指数等方法。

2.决策树生成:根据选择的特征和其对应的阈值,将训练数据集划分成不同的子集,然后对每个子集递归地重复步骤 1,直到满足停止条件(如所有样本属于同一类别、没有可选特征等)。

3.决策树剪枝:为了避免过拟合,需要对决策树进行剪枝。

剪枝方法包括预剪枝和后剪枝。

预剪枝是在构建过程中提前停止树的生长,后剪枝是在构建完整的决策树后进行简化。

四、决策树的应用实例决策树在许多领域都有广泛应用,如金融、医疗、教育、市场营销等。

例如,在房价预测中,可以使用决策树根据房屋的面积、卧室数量、距离市中心的距离等特征来预测房价。

五、决策树的优缺点1.优点:(1)易于理解和解释;(2)具有较高的预测准确性;(3)能够处理连续值和类别值;(4)可以处理缺失值。