人工神经元模型

- 格式:ppt

- 大小:653.50 KB

- 文档页数:59

人工神经元的m-p模型公式

人工神经元的M-P(McCulloch-Pitts)模型是早期神经网络模型的一种简化形式。

它描述了神经元的输入-输出关系,并被用来理解和模拟神经元的计算过程。

M-P模型的公式如下:

输入权重和输入值的加权和,以及阈值的组合称为神经元的输入电流:

I = ∑(w * x) - θ

其中:

•I 是神经元的输入电流。

•∑ 表示求和操作。

•w 是输入的权重。

•x 是对应输入的值。

•θ 是神经元的阈值。

神经元的输出可以根据以下规则确定:

如果输入电流大于或等于阈值(I ≥ θ)时,神经元的输出(y)等于1。

如果输入电流小于阈值(I < θ)时,神经元的输出(y)等于0。

这个简单的模型基于斯坦福大学的Warren McCulloch和Walter Pitts在1943年的工作,为神经元的计算过程提供了初步的数学描述。

虽然M-P模型是一个最早的神经元模型,并且较为简化,但它为后来更复杂的神经网络模型奠定了基础,并为理解神经

元的计算和信息处理提供了重要的启示。

后续发展的模型,如感知机、多层感知机和深度神经网络等,进一步扩展和改进了神经网络模型的能力。

人工神经元模型的数学表达形式人工神经元是神经网络的基本单元,它可以模拟生物神经元的基本功能。

人工神经元模型的数学表达形式是一种数学模型,用于描述神经元的输入、输出和激活函数之间的关系。

在数学表达形式中,人工神经元可以表示为以下几个要素:1. 输入:人工神经元接收来自其他神经元或外部输入的信号,每个输入都有一个对应的权重。

假设我们有n个输入,输入向量为x = (x1, x2, ..., xn),对应的权重向量为w = (w1, w2, ..., wn)。

输入和权重的乘积可以表示为x·w,表示输入和权重的内积。

2. 加权和:人工神经元将输入与对应的权重相乘,并求和得到加权和。

加权和表示为z = x·w + b,其中b是偏置项,表示人工神经元的偏置。

3. 激活函数:加权和经过激活函数进行非线性变换,得到神经元的输出。

常用的激活函数有sigmoid函数、ReLU函数等。

以sigmoid函数为例,激活函数可以表示为a = σ(z),其中σ(z) = 1 / (1 + exp(-z))。

4. 输出:经过激活函数变换后得到的输出即为人工神经元的输出。

人工神经元模型的数学表达形式可以总结为以下公式:z = x·w + ba = σ(z)其中,z表示加权和,x表示输入向量,w表示权重向量,b表示偏置项,a表示输出,σ表示激活函数。

通过调整权重和偏置项,人工神经元可以对输入信号做出不同的响应。

权重决定了各个输入对输出的影响程度,偏置项可以调整神经元的灵敏度。

人工神经元模型的数学表达形式是神经网络的基础,也是深度学习的核心。

通过组合多个神经元,可以构建复杂的神经网络,实现更加高级的任务,如图像识别、语音识别、自然语言处理等。

除了单个神经元,神经网络还包括多个层次的神经元组成的网络结构。

每一层的神经元接收上一层的输出作为输入,并将自己的输出传递给下一层。

这种层次结构的神经网络被称为前馈神经网络,是目前应用最广泛的神经网络模型之一。

人工神经元模型介绍

人工神经元模型是用来模拟生物神经元的概念,它由多个神经元构成,每个神经元可以模拟生物神经元的功能,具有输入端、输出端和用于存储

信息的权重。

它具有自适应性和记忆能力,具有许多用于检测模式、识别

特征和学习规律的应用。

人工神经元模型是一种用于处理处理非线性问题的非常有效的方法,

它可以在复杂的计算系统中实现处理环境变化、复杂信号的自动调节。

其

基本原理是:模拟生物神经元的神经元具有包括输入端、输出端和权重的

三个主要组件;输入端接收输入,经过加权处理得到输出;权重是用于存

储信息的参数;根据输入进行权重的更新以实现学习和自适应。

应用于模式识别、特征检测等复杂的计算系统中,它具有良好的调节

能力,而且可以模拟机器学习的训练过程,适应环境中的变化,这使其在

模式识别、特征检测和学习规律检测方面得以有效应用。

此外,运用人工神经元模型还可以实现神经网络的结构和性能优化,

通过人工神经元模型可以激活权重,调节神经元,从而提高神经网络的性能。

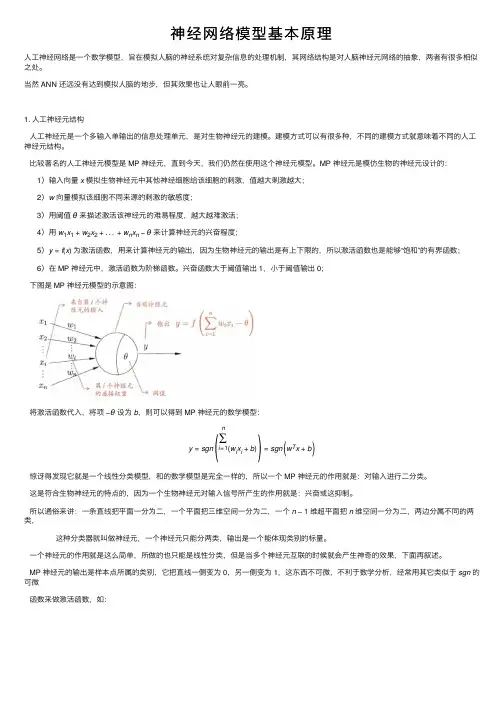

神经⽹络模型基本原理⼈⼯神经⽹络是⼀个数学模型,旨在模拟⼈脑的神经系统对复杂信息的处理机制,其⽹络结构是对⼈脑神经元⽹络的抽象,两者有很多相似之处。

当然 ANN 还远没有达到模拟⼈脑的地步,但其效果也让⼈眼前⼀亮。

1. ⼈⼯神经元结构⼈⼯神经元是⼀个多输⼊单输出的信息处理单元,是对⽣物神经元的建模。

建模⽅式可以有很多种,不同的建模⽅式就意味着不同的⼈⼯神经元结构。

⽐较著名的⼈⼯神经元模型是 MP 神经元,直到今天,我们仍然在使⽤这个神经元模型。

MP 神经元是模仿⽣物的神经元设计的: 1)输⼊向量 x 模拟⽣物神经元中其他神经细胞给该细胞的刺激,值越⼤刺激越⼤; 2)w 向量模拟该细胞不同来源的刺激的敏感度;3)⽤阈值 θ 来描述激活该神经元的难易程度,越⼤越难激活; 4)⽤ w 1x 1+w 2x 2+...+w n x n −θ 来计算神经元的兴奋程度;5)y =f (x ) 为激活函数,⽤来计算神经元的输出,因为⽣物神经元的输出是有上下限的,所以激活函数也是能够“饱和”的有界函数; 6)在 MP 神经元中,激活函数为阶梯函数。

兴奋函数⼤于阈值输出 1,⼩于阈值输出 0; 下图是 MP 神经元模型的⽰意图:将激活函数代⼊,将项 −θ 设为 b ,则可以得到 MP 神经元的数学模型:y =sgn n∑i =1(w i x i +b )=sgn w T x +b惊讶得发现它就是⼀个线性分类模型,和的数学模型是完全⼀样的,所以⼀个 MP 神经元的作⽤就是:对输⼊进⾏⼆分类。

这是符合⽣物神经元的特点的,因为⼀个⽣物神经元对输⼊信号所产⽣的作⽤就是:兴奋或这抑制。

所以通俗来讲:⼀条直线把平⾯⼀分为⼆,⼀个平⾯把三维空间⼀分为⼆,⼀个 n −1 维超平⾯把 n 维空间⼀分为⼆,两边分属不同的两类,这种分类器就叫做神经元,⼀个神经元只能分两类,输出是⼀个能体现类别的标量。

⼀个神经元的作⽤就是这么简单,所做的也只能是线性分类,但是当多个神经元互联的时候就会产⽣神奇的效果,下⾯再叙述。

人工神经元的基本结构人工神经元是人工智能领域中不可或缺的基础单元。

它是一个数学模型,用来模拟人类神经元的基本功能。

在深度学习、神经网络、自然语言处理等领域中都有应用,因此了解人工神经元的基本结构非常重要。

一、输入人工神经元的基本结构包括输入、加权(权重)、激活函数和输出四个部分。

输入是神经元接受数据的地方。

在神经网络中,通常将多个神经元连接起来,形成一个输入层。

这些神经元接受输入数据,并将其传递给下一层的神经元。

二、加权加权是人工神经元的第二个组成部分。

每个输入都与一个权重相乘,并将结果相加,得到一个加权和。

在神经网络中,这种加权和通常与其他神经元相连的加权和相加,以形成一个单独的加权和。

三、激活函数激活函数是人工神经元的第三个组成部分。

在加权和之后,激活函数处理了神经元的总输入,并生成输出。

激活函数通常是非线性的,如sigmoid、ReLU等,它们可以帮助将输入映射到输出。

激活函数的主要作用是将神经元的输出保持在一定的范围内,这样可以避免多层网络出现梯度消失或梯度爆炸等问题。

四、输出输出是人工神经元的最后一个组成部分。

输出被神经元所连接的其他神经元或神经网络中的下一个神经元所接受,作为下一轮计算的输入。

综上所述,人工神经元的基本结构包括输入、加权、激活函数和输出。

输入是神经元接收数据的地方,加权是将输入与权重相乘,并相加得到加权和,激活函数处理神经元的总输入,并生成输出,输出被连接的下一个神经元所接受。

这些组成部分通过连接形成一个神经网络,实现数据的分类、识别、预测等任务。

人工神经元模型及学习方法人工神经网络(Artificial Neural Networks,ANN)模仿大脑的神经系统,采用一种类似于大脑神经元相互连接的方式进行信息处理和学习。

人工神经元是人工神经网络的基本单元,它模拟了生物神经元的特性,并通过连接方式和权重调整来实现学习过程。

下面将详细介绍人工神经元模型及学习方法。

一、人工神经元模型1.输入部分:人工神经元接收多个输入信号,每个输入通过权重进行加权处理,并进行求和运算。

输入部分的计算公式可以表示为:$$ z = \sum_{i=1}^{n} (x_i\cdot w_i) $$其中,$x_i$表示第i个输入信号,$w_i$表示对应的权重。

2. 传输函数:传输函数是人工神经元的非线性映射函数,用于对输入部分的结果进行处理,使得输出结果可以更加符合实际需求。

常见的传输函数有sigmoid函数、ReLU函数等。

3.输出部分:传输函数的输出结果作为输出部分的输入,经过一定的处理后,作为人工神经元的最终输出。

处理方式可以是简单的二值化,也可以是连续值的输出。

二、人工神经元模型的学习方法2.无监督学习:在无监督学习中,我们使用未标记的数据来训练神经网络。

该方法主要用于聚类、降维等任务。

常见的无监督学习算法包括自组织映射算法、玻尔兹曼机算法等。

除了上述的学习方法外,还有一些其他的学习方法也值得一提。

3.强化学习:在强化学习中,模型通过与环境的交互来学习并优化自己的行为,以最大化累计奖励。

常见的强化学习算法包括Q学习算法、蒙特卡罗方法等。

4.迁移学习:迁移学习是指将已经学习好的模型应用到新的任务上,从而加速新任务的学习过程。

常见的迁移学习方法包括特征提取、网络微调等。

5.元学习:元学习是指学习如何学习的过程。

通过元学习,模型可以自动调整自己的学习策略,以适应不同的任务和环境。

以上是人工神经元模型及学习方法的简要介绍。

人工神经元模型是人工神经网络的基本单元,通过连接方式和权重调整来实现学习过程。

人工神经元模型在生物学中的应用

人工神经元模型是一种高度精密的电子装置,可以模拟生物神经元的功能。

它

由输入端、输出端和神经元本身构成,可以接受各种形式的输入信号,并生成电信号作为输出。

人工神经元模型的研究在计算机科学、人工智能、机器人技术等领域都有广泛应用,但是它在生物学领域的应用也越来越受到重视。

人工神经元模型在神经元行为的研究中有着广泛的应用。

生物神经元的行为是

非常复杂的,包括细胞膜的传导、离子通道的作用、突触的传输等等。

人工神经元模型可以模拟这些行为,帮助研究人员更好地理解神经元的运作方式。

例如,研究人员可以使用人工神经元模型来模拟神经网络中的信号传递和信息处理过程,从而更好地了解神经网络的结构和功能。

人工神经元模型还可以用于生物神经元和人工智能系统之间的交互。

研究人员

可以使用人工神经元模型构建一个基于神经网络的人工智能系统,通过输入信号和输出信号的交互模拟人体智能行为。

例如,基于神经网络的人工智能系统可以模拟人类的注意力、决策和思考等行为,从而更好地应对现实中的各种问题。

除了研究神经元行为和人工智能系统之外,人工神经元模型还可以用于控制某

些紊乱状态下的生物过程。

例如,一些疾病如心律失常、帕金森病等,由于生物神经元的失控而导致。

人工神经元模型可以模拟正常状态下神经元的运作,从而帮助研究人员开发出能够恢复神经元正常状态的治疗方案。

总的来说,人工神经元模型在生物学中发挥着越来越重要的作用,有望为人们

理解生命过程提供更多的帮助。

当然,目前该领域的研究还存在着许多困难和挑战,需要更多的科学家加入到其中,共同推动该领域的发展。