第二章距离分类器和聚类分析-Read

- 格式:doc

- 大小:434.50 KB

- 文档页数:8

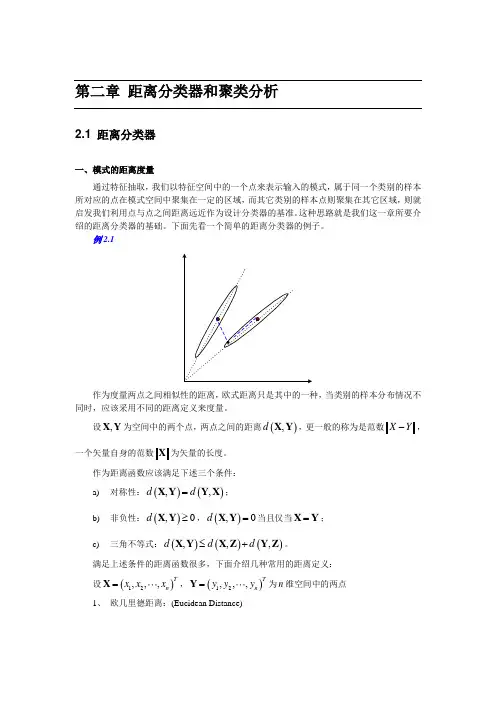

第二章 距离分类器和聚类分析2.1 距离分类器一、模式的距离度量通过特征抽取,我们以特征空间中的一个点来表示输入的模式,属于同一个类别的样本所对应的点在模式空间中聚集在一定的区域,而其它类别的样本点则聚集在其它区域,则就启发我们利用点与点之间距离远近作为设计分类器的基准。

这种思路就是我们这一章所要介绍的距离分类器的基础。

下面先看一个简单的距离分类器的例子。

例2.1作为度量两点之间相似性的距离,欧式距离只是其中的一种,当类别的样本分布情况不同时,应该采用不同的距离定义来度量。

设,X Y 为空间中的两个点,两点之间的距离(),d X Y ,更一般的称为是范数X Y -,一个矢量自身的范数X 为矢量的长度。

作为距离函数应该满足下述三个条件: a) 对称性:()(),,d d =X Y Y X ;b) 非负性:(),0d ≥X Y ,(),0d =X Y 当且仅当=X Y ; c) 三角不等式:()()(),,,d d d ≤+X Y X Z Y Z 。

满足上述条件的距离函数很多,下面介绍几种常用的距离定义: 设()12,,,Tn x x x =X ,()12,,,Tn y y y =Y 为n 维空间中的两点1、 欧几里德距离:(Eucidean Distance)()()1221,ni i i d x y =⎡⎤=-⎢⎥⎣⎦∑X Y2、 街市距离:(Manhattan Distance)()1,ni i i d x y ==-∑X Y3、 明氏距离:(Minkowski Distance)()11,mnm i i i d x y =⎡⎤=-⎢⎥⎣⎦∑X Y当2m =时为欧氏距离,当1m =时为街市距离。

4、 角度相似函数:(Angle Distance)(),T d ⋅=X YX Y X Y1nTi i i x y =⋅=∑X Y 为矢量X 和Y 之间的内积,(),d X Y 为矢量X 与Y 之间夹角的余弦。

判别分析与聚类分析的基本原理数据分析是在如今信息时代中,越来越重要的一项技能。

在数据分析的过程中,判别分析和聚类分析是两个非常重要的方法。

本文将介绍判别分析和聚类分析的基本原理,以及它们在数据分析中的应用。

一、判别分析的基本原理判别分析是一种用于分类问题的统计方法,其目的是通过学习已知类别的样本数据,来构建一个分类器,从而对未知样本进行分类。

判别分析的基本原理可以简单概括为以下几个步骤:1. 数据预处理:首先需要对数据进行预处理,包括数据清洗、缺失值处理、特征选择等,以获得更好的数据质量。

2. 特征提取:在进行判别分析之前,需要将原始数据转化为有效的特征。

特征提取的方法有很多种,常用的包括主成分分析、线性判别分析等。

3. 训练分类器:利用判别分析算法对已知类别的样本数据进行训练,建立分类模型。

常用的判别分析方法有线性判别分析、二次判别分析等。

4. 分类预测:通过训练好的分类器,对未知样本进行分类预测。

分类预测的结果可以是离散的类标签,也可以是概率值。

判别分析广泛应用于医学、金融、市场营销等领域。

例如,在医学领域,可以利用判别分析来预测疾病的状态,辅助医生做出诊断决策。

二、聚类分析的基本原理聚类分析是一种无监督学习方法,其目的是将相似的数据对象分组,使得同一组内的对象相似度较高,不同组间的相似度较低。

聚类分析的基本原理可以概括为以下几个步骤:1. 选择相似性度量:首先需要选择一个合适的相似性度量,用于评估数据对象之间的相似程度。

常用的相似性度量包括欧氏距离、曼哈顿距离等。

2. 选择聚类算法:根据具体的问题需求,选择合适的聚类算法。

常用的聚类算法有K-means、层次聚类等。

3. 确定聚类数目:根据实际问题,确定聚类的数目。

有些情况下,聚类数目事先是已知的,有些情况下需要通过评价指标进行确定。

4. 根据聚类结果进行分析:将数据对象划分到各个聚类中,并对聚类结果进行可视化和解释。

聚类分析被广泛应用于市场分析、图像处理、社交网络等领域。

基于机器学习的文本分类与聚类分析技术研究随着互联网时代的到来,海量的文本数据已经变得非常普遍。

如何从大量的数据中提取有用的信息,近年来成为了很多企业和机构需要面对的一个问题。

而文本分类和聚类分析技术则成为了解决这个问题的最佳选择之一。

本文将基于机器学习的文本分类与聚类分析技术进行深入研究。

一、文本分类技术浅析文本分类技术是现代信息处理技术的一个重要组成部分,其运用机器学习等算法对文本信息进行分析,然后将其归类至不同的类别中。

这种技术能够将海量的文本信息进行有效地分类,极大地提高了文本信息处理的效率。

文本分类算法的种类繁多,其中主要有基于特征的分类方法、基于概率的贝叶斯分类方法等。

其中,基于特征的分类方法是一种广泛应用的文本分类技术。

该方法会先从输入的文本中抽取出有用的特征向量,然后将这些特征向量放入到分类器中进行分类。

这种方法的特点是具有良好的扩展性和解释性,在实际应用中表现出了较高的精度。

二、文本聚类分析技术深入探究文本聚类是指将海量的文本信息按照特定的规则进行分类,然后将同一类别的文本信息放在一起。

该技术主要运用于数据挖掘、信息检索、知识管理等领域。

而机器学习和深度学习技术则是实现文本聚类的主要手段。

文本聚类的主要算法有层次聚类、K-Means聚类、SOM聚类等。

其中,层次聚类算法是一种比较流行的文本聚类算法。

该算法不依赖于先验的聚类数量,可以在不断的分裂和合并中完成文本聚类任务,但由于其计算复杂度较高,因此无法应用于大规模文本聚类。

相比之下,K-Means聚类算法的计算复杂度非常低,非常适合用于大规模文本聚类。

该算法将数据随机分配到聚类中心中,然后通过计算距离将其划分至其最近的聚类中心中,迭代若干次后,就可以得到最终的文本聚类结果。

三、机器学习在文本分类和聚类分析中的应用机器学习技术已经成为了文本分类和聚类分析的常用手段。

其中,机器学习算法能够通过样本学习,自动的构建出一个分类器,用于对输入的数据进行分类。

系统聚类距离系统聚类距离是一种用于衡量聚类结果的评估指标。

在机器学习和数据挖掘中,聚类是将相似的数据对象分组到同一个簇中的过程。

而系统聚类距离就是用来评估聚类结果的紧密程度和稳定性的指标。

系统聚类距离是通过计算聚类过程中不同簇的合并所产生的距离来衡量的。

具体而言,系统聚类距离考虑了每个簇的样本之间的距离以及不同簇之间的距离。

通过计算这些距离的和,可以得到一个系统聚类距离的值,用于评估聚类结果的质量。

系统聚类距离的计算可以使用不同的方法,常见的方法包括最小距离法、最大距离法、平均距离法等。

最小距离法将聚类结果的距离定义为簇内最近的两个样本的距离;最大距离法将聚类结果的距离定义为簇内最远的两个样本的距离;平均距离法将聚类结果的距离定义为簇内所有样本的距离的平均值。

系统聚类距离的值越小,表示聚类结果越紧密,簇内的样本越相似。

而值越大,则表示聚类结果越松散,簇内的样本差异性较大。

通过比较不同聚类算法的系统聚类距离,可以选择合适的算法来进行聚类分析。

在实际应用中,系统聚类距离常常用于确定最佳聚类数目。

通过比较不同聚类数目下的系统聚类距离,可以找到一个最合适的聚类数目,以获得最优的聚类结果。

除了系统聚类距离,还有其他常用的聚类评估指标,如轮廓系数、Davies-Bouldin指数等。

这些指标可以综合考虑聚类结果的紧密程度、分离程度等因素,用于评估聚类的质量。

总之,系统聚类距离是一种用于评估聚类结果的指标,通过考虑聚类过程中的簇内距离和簇间距离,来衡量聚类结果的紧密程度和稳定性。

在聚类分析中,系统聚类距离可以帮助选择合适的聚类算法和确定最佳聚类数目,以获得最优的聚类结果。

简述基于距离的分类算法一、引言基于距离的分类算法是机器学习中常用的一种分类方法,它通过计算不同样本之间的距离来确定样本之间的相似度,从而将它们分为不同的类别。

本文将从以下几个方面对基于距离的分类算法进行详细介绍。

二、基本概念1. 距离度量:在基于距离的分类算法中,需要定义不同样本之间的距离度量方法。

常用的方法有欧氏距离、曼哈顿距离、切比雪夫距离等。

2. 样本空间:指所有样本组成的空间,每个样本都可以看作该空间中一个点。

3. 样本特征:指每个样本所具有的特征或属性,如身高、体重等。

三、KNN算法KNN(K-Nearest Neighbor)算法是基于距离度量来进行分类和回归分析的一种非参数性统计方法。

它通过计算未知样本与已知样本之间的距离来找到最近邻居,并将未知样本归入与其最近邻居相同的类别中。

KNN算法具有简单易懂、效果好等优点,在实际应用中得到了广泛的应用。

四、K-means算法K-means算法是一种基于距离度量的聚类算法,它将样本空间划分为k个簇,每个簇包含距离最近的k个样本。

在算法开始时,需要随机选择k个样本作为初始中心点,然后计算所有样本与这些中心点之间的距离,并将每个样本归入距离最近的簇中。

接着重新计算每个簇的中心点,并重复以上步骤直到达到收敛条件。

K-means算法具有较高的效率和准确性,在数据挖掘和图像处理等领域得到了广泛应用。

五、DBSCAN算法DBSCAN(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的聚类算法。

它通过计算每个样本周围其他样本的密度来确定该样本所属于的簇,并将密度较小的点归为噪声点。

在DBSCAN算法中,需要定义两个参数:邻域半径和最小密度。

邻域半径表示一个点周围所包含其他点的最大距离,而最小密度表示一个簇所包含点数目的下限值。

DBSCAN算法具有处理复杂数据集、不受初始化影响等优点,在图像处理和数据挖掘等领域得到了广泛应用。

聚类算法与分类算法的区别与联系在机器学习和数据挖掘领域,聚类算法和分类算法是两个非常重要且常用的技术。

它们都是为了帮助人们对数据进行归纳和理解而设计的,但是它们又有着各自不同的特点和应用场景。

本文将从聚类算法和分类算法的定义、特点、应用以及联系与区别等方面来探讨这两种算法。

聚类算法和分类算法的定义聚类算法是一种无监督学习的方法,其目的是将数据集中的样本划分为若干个不同的类别,使得同一类别内的样本之间的相似度尽可能大,不同类别之间的相似度尽可能小。

聚类算法不需要预先知道样本的类别信息,而是通过对样本的特征进行分析和比较,来确定样本之间的相似性和差异性,从而实现对样本的聚类。

分类算法则是一种监督学习的方法,其目的是根据已有的标记样本来建立一个分类模型,然后利用这个模型对新的样本进行分类。

分类算法需要预先知道样本的类别信息,并且通过对已有样本的学习和建模来建立一个对新样本进行分类的模型。

特点分析聚类算法的特点是不需要预先知道样本的类别信息,它是一种无监督学习的方法。

聚类算法通常采用距离度量的方法来度量样本之间的相似度,比如欧氏距离、曼哈顿距离等。

聚类算法的结果是将样本划分为若干个不同的类别,但是这些类别的含义和标记是未知的。

分类算法则是一种监督学习的方法,其特点是需要已有样本的类别信息来建立分类模型。

分类算法通常采用一些统计学和概率学的方法来对样本进行建模和分类,比如朴素贝叶斯分类器、支持向量机等。

分类算法的结果是对新样本进行分类,而这个分类结果是有明确含义的。

应用场景聚类算法在实际应用中有着广泛的应用场景,比如客户细分、市场分析、社交网络分析等。

在客户细分中,可以利用聚类算法来将客户划分为不同的消费群体,从而实现个性化营销;在社交网络分析中,可以利用聚类算法来发现社交网络中的不同群体和社区结构,从而实现精准的社交推荐。

分类算法则在实际应用中被广泛应用于文本分类、图像识别、医学诊断等领域。

在文本分类中,可以利用分类算法来对文本进行自动分类和归档;在医学诊断中,可以利用分类算法来对疾病进行诊断和预测。

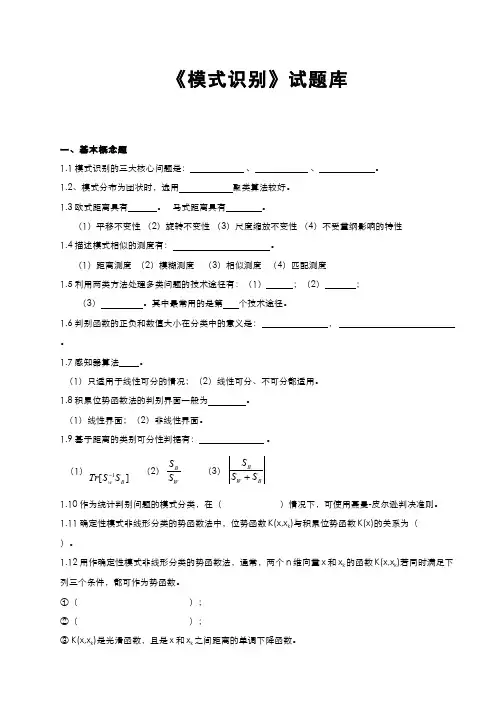

《模式识别》试题库一、基本概念题1.1 模式识别的三大核心问题是: 、 、 。

1.2、模式分布为团状时,选用 聚类算法较好。

1.3 欧式距离具有 。

马式距离具有 。

(1)平移不变性 (2)旋转不变性 (3)尺度缩放不变性 (4)不受量纲影响的特性1.4 描述模式相似的测度有: 。

(1)距离测度 (2)模糊测度 (3)相似测度 (4)匹配测度1.5 利用两类方法处理多类问题的技术途径有:(1) ;(2) ;(3) 。

其中最常用的是第 个技术途径。

1.6 判别函数的正负和数值大小在分类中的意义是: , 。

1.7 感知器算法 。

(1)只适用于线性可分的情况;(2)线性可分、不可分都适用。

1.8 积累位势函数法的判别界面一般为 。

(1)线性界面;(2)非线性界面。

1.9 基于距离的类别可分性判据有: 。

(1)1[]w B Tr S S - (2) BWS S (3) B W B S S S +1.10 作为统计判别问题的模式分类,在( )情况下,可使用聂曼-皮尔逊判决准则。

1.11 确定性模式非线形分类的势函数法中,位势函数K(x,x k )与积累位势函数K(x)的关系为( )。

1.12 用作确定性模式非线形分类的势函数法,通常,两个n 维向量x 和x k 的函数K(x,x k )若同时满足下列三个条件,都可作为势函数。

①( );②( );③ K(x,x k )是光滑函数,且是x 和x k 之间距离的单调下降函数。

1.13 散度J ij 越大,说明w i 类模式与w j 类模式的分布( )。

当w i 类模式与w j 类模式的分布相同时,J ij =( )。

1.14 若用Parzen 窗法估计模式的类概率密度函数,窗口尺寸h1过小可能产生的问题是( ),h1过大可能产生的问题是( )。

1.15 信息熵可以作为一种可分性判据的原因是: 。

1.16作为统计判别问题的模式分类,在( )条件下,最小损失判决规则与最小错误判决规则是等价的。

聚类分析学习体会聚类分析是多元统计分析中研究“物以类聚”的一种方法,用于对事物的类别尚不清楚,甚至在事前连总共有几类都不能确定的情况下进行分类的场合。

聚类分析主要目的是研究事物的分类,而不同于判别分析。

在判别分析中必须事先知道各种判别的类型和数目,并且要有一批来自各判别类型的样本,才能建立判别函数来对未知属性的样本进行判别和归类。

若对一批样品划分的类型和分类的数目事先并不知道,这时对数据的分类就需借助聚类分析方法来解决。

聚类分析把分类对象按一定规则分成组或类,这些组或类不是事先给定的而是根据数据特征而定的。

在一个给定的类里的这些对象在某种意义上倾向于彼此相似,而在不同类里的这些对象倾向于不相似。

1.聚类统计量在对样品(变量)进行分类时,样品(变量)之间的相似性是怎么度量?通常有三种相似性度量——距离、匹配系数和相似系数。

距离和匹配系数常用来度量样品之间的相似性,相似系数常用来变量之间的相似性。

样品之间的距离和相似系数有着各种不同的定义,而这些定义与变量的类型有着非常密切的关系。

通常变量按取值的不同可以分为:1.定量变量:变量用连续的量来表示,例如长度、重量、速度、人口等,又称为间隔尺度变量。

2.定性变量:并不是数量上有变化,而只是性质上有差异。

定性变量还可以再分为:⑴有序尺度变量:变量不是用明确的数量表示,而是用等级表示,例如文化程度分为文盲、小学、中学、大学等。

⑵名义尺度变量:变量用一些类表示,这些类之间既无等级关系,也无数量关系,例如职业分为工人、教师、干部、农民等。

下面主要讨论具有定量变量的样品聚类分析,描述样品间的亲疏程度最常用的是距离。

1.1.距离1. 数据矩阵设ij x 为第i 个样品的第j 个指标,数据矩阵如下表表1 数据矩阵在上表中,每个样品有p 个变量,故每个样品都可以看成是p R 中的一个点,n 个样品就是p R 中的n 个点。

在p R 中需定义某种距离,第i 个样品与第j 个样品之间的距离记为ij d ,在聚类过程中,相距较近的点倾向于归为一类,相距较远的点应归属不同的类。

聚类分析方法小结简单点说:分类是将一片文章或文本自动识别出来,按照先验的类别进行匹配,确定。

聚类就是将一组的文章或文本信息进行相似性的比较,将比较相似的文章或文本信息归为同一组的技术。

分类和聚类都是将相似对象归类的过程。

区别是,分类是事先定义好类别,类别数不变。

分类器需要由人工标注的分类训练语料训练得到,属于有指导学习范畴。

聚类则没有事先预定的类别,类别数不确定。

聚类不需要人工标注和预先训练分类器,类别在聚类过程中自动生成。

分类适合类别或分类体系已经确定的场合,比如按照国图分类法分类图书;聚类则适合不存在分类体系、类别数不确定的场合,一般作为某些应用的前端,比如多文档文摘、搜索引擎结果后聚类(元搜索)等。

分类(classification )是找出描述并区分数据类或概念的模型(或函数),以便能够使用模型预测类标记未知的对象类。

分类技术在数据挖掘中是一项重要任务,目前商业上应用最多。

分类的目的是学会一个分类函数或分类模型(也常常称作分类器),该模型能把数据库中的数据项映射到给定类别中的某一个类中。

要构造分类器,需要有一个训练样本数据集作为输入。

训练集由一组数据库记录或元组构成,每个元组是一个由有关字段(又称属性或特征)值组成的特征向量,此外,训练样本还有一个类别标记。

一个具体样本的形式可表示为:(v1,v2,...,vn; c);其中vi表示字段值,c表示类别。

分类器的构造方法有统计方法、机器学习方法、神经网络方法等等。

不同的分类器有不同的特点。

有三种分类器评价或比较尺度:1)预测准确度;2)计算复杂度;3)模型描述的简洁度。

预测准确度是用得最多的一种比较尺度,特别是对于预测型分类任务。

计算复杂度依赖于具体的实现细节和硬件环境,在数据挖掘中,由于操作对象是巨量的数据,因此空间和时间的复杂度问题将是非常重要的一个环节。

对于描述型的分类任务,模型描述越简洁越受欢迎。

另外要注意的是,分类的效果一般和数据的特点有关,有的数据噪声大,有的有空缺值,有的分布稀疏,有的字段或属性间相关性强,有的属性是离散的而有的是连续值或混合式的。

第二章 距离分类器和聚类分析2.1 距离分类器一、模式的距离度量通过特征抽取,我们以特征空间中的一个点来表示输入的模式,属于同一个类别的样本所对应的点在模式空间中聚集在一定的区域,而其它类别的样本点则聚集在其它区域,则就启发我们利用点与点之间距离远近作为设计分类器的基准。

这种思路就是我们这一章所要介绍的距离分类器的基础。

下面先看一个简单的距离分类器的例子。

例2.1作为度量两点之间相似性的距离,欧式距离只是其中的一种,当类别的样本分布情况不同时,应该采用不同的距离定义来度量。

设,X Y 为空间中的两个点,两点之间的距离(),d X Y ,更一般的称为是范数X Y -,一个矢量自身的范数X 为矢量的长度。

作为距离函数应该满足下述三个条件: a) 对称性:()(),,d d =X Y Y X ;b) 非负性:(),0d ≥X Y ,(),0d =X Y 当且仅当=X Y ; c) 三角不等式:()()(),,,d d d ≤+X Y X Z Y Z 。

满足上述条件的距离函数很多,下面介绍几种常用的距离定义: 设()12,,,Tn x x x =X ,()12,,,Tn y y y =Y 为n 维空间中的两点1、 欧几里德距离:(Eucidean Distance)()()121,ni i i d x y =⎡⎤=-⎢⎥⎣⎦∑X Y2、 街市距离:(Manhattan Distance)()1,ni i i d x y ==-∑X Y3、 明氏距离:(Minkowski Distance)()11,mnm i i i d x y =⎡⎤=-⎢⎥⎣⎦∑X Y当2m =时为欧氏距离,当1m =时为街市距离。

4、 角度相似函数:(Angle Distance)(),T d ⋅=X YX Y X Y1nTi i i x y =⋅=∑X Y 为矢量X 和Y 之间的内积,(),d X Y 为矢量X 与Y 之间夹角的余弦。

距离函数的定义形式还有很多,我们应该根据具体问题来选择一种适合的函数定义,使其能够真正反映模式之间的相似性。

定义了范数的线性空间称为赋范线性空间。

二、单个标准样本的距离分类器设有M 个类别,12,,,M ΩΩΩ,每个类别有一个标准样本12M T ,T ,,T ,现有一待识样本X ,则X 应该属于与其距离最小的标准样本代表的那一类,即:如果()0a r g m i n ,i ii d =X T ,则判别0i ∈ΩX 。

对于两类问题来说,就相当于用一个垂直平分两个标准样本点的连线的超平面将两类分开。

三、多个标准样本的距离分类器如果每个类别只有一个训练样本,则只能以这个训练样本作为标准样本来设计距离分类器。

然而一个样本很难反映出类别的总体分布,因此在实际设计中,一般都要尽可能多的搜集各个类别的样本,样本量的增加能够跟好的反映出类别的中体分布情况,这样带来的问题就是如何利用多个样本来设计距离分类器?下面介绍几种常用的方法。

1. 平均样本法此方法中,我们还希望以一个标准样本来代表每个类别,这样就可以采用单个标准样本距离分类器的准则来进行分类。

下面的问题就是如何来确定这个标准样本,这实际上就是如何利用训练样本集来进行学习的问题。

在模式识别方法中,我们将经常遇到最优化问题,下面我们就以这个简单问题来介绍一下最优化方法的一些概念。

设有M 个类别,12,,,M ΩΩΩ,第m 类有训练样本集()()(){}12,,,mm m m K X X X ,我们希望求得一个标准样本()m T,训练样本()()()()()12,,,m m m m ii i iN x x x =X 。

我们要寻找的标准样本()m T 实际上应该是一个距离训练样本集中所有样本的平均距离最小的一点,则一点最能够代表这个训练样本集。

例如,如果类别样本的分布为一个球形的话,这一点应该是球的中心。

这一条件可以用下面的函数表示:()()()()()11m K m m mi i m f d K ==-∑T X T ,此函数称为目标函数。

我们的目标就是要寻找到一个()m T,使得()()m f T最小。

以欧氏距离为例,()()()()()122111mK Nm m m ij ji j mf x t K ==⎛⎫=- ⎪⎝⎭∑∑T ,下面对()m T 的各维元素取偏导数:()()()()()()()()()()111112102mm m m K K K m m m m ijjj ij m i i i mm kf xt t x K K t ===∂⎛⎫=-⨯-=-= ⎪∂⎝⎭∑∑∑T则:()()11m K m m jij i m t x K ==∑。

以矢量形式表示:()()11m K m m i i m K ==∑T X 。

平均样本法的特点是:1、算法简单;2、每个类别只需存储一个平均样本,存储量小;3、识别时只需计算M 次距离函数,计算量小;4、对类别样本的分布描述能力不强,效果不一定很好。

在单个样本的距离分类器中,实际上我们是定义了一个未知类别模式到某一类别的距离,这个距离就是待识模式与类别标准样本之间的距离:()(),,i i d d Ω=X X T ,然后以模式与类别的距离作为分类的判据。

实际上在多个标准样本的问题中,我们还可以定义其它形式的模式与类别的距离。

2. 平均距离法已知类别i Ω的训练样本集为:()()(){}12,,,ii i i K T T T ,定义待识模式X 与类别i Ω的距离: ()()()11,,iK i i jj id d K =Ω=∑X X T然后还是以与待识模式最近的类别作为识别结果。

在平均距离法中,需要存储所有的训练样本,而且在识别时还要计算待识模式与每个训练样本的距离,所以计算量比较大。

3. 最近邻法最近邻法以与待识样本距离最近的标准样本点的类别作为分类类别。

实际上相当于定义待识模式与类别i Ω的距离:()()()1,min ,iii j j K d d ≤≤Ω=X X T最近邻法也要存储和计算所有的训练样本,同时与平均距离法相比容易受到噪声的干扰,当与X 最近点为噪声时,就会导致误识。

最近邻法的改进:平均样本法用一点代表一个类别,过分集中;最近邻法以类内的每一点代表类别,过于分散,在通常情况下可以采用折衷的办法,首先将每个类别的训练样本划分为几个子集,在各个子集中计算平均样本,每一个类别以几个子集的平均样本代表,采用最近邻法分类。

(举例:红苹果,绿苹果),这样做的好处是,一方面可以减少存储量和计算量,同时还可以减小噪声的干扰,这是在实际系统使用比较多的方法。

4. K -近邻法K -近邻法是另外一种减小噪声干扰的改进方法,它不是根据与未知样本X 最近的一个样本的类别来分类,而是根据X 最近邻的K 各样本点中多数点的类别来分类。

方法如下:a) 计算X 与所有训练样本的距离;b) 对所有的()(),i jd X T 从小到大排序;c) 统计前K 个中各类训练样本的个数i N ,1,2,,i M =,必有1Mi i N K ==∑;d) 取01arg max i i Mi N ≤≤=作为X 的类别。

K -近邻法中,K 值得选择非常重要,太大则就会变成那一类的训练样本说多就分类到哪一类,太少则容易受到噪声的影响,当1K =时,就变为了最近邻法。

2.2 聚类分析在某些问题中,我们已知的只是一个训练样本集,而不知道样本集中每个样本的类别标号,这就需要我们首先将这些样本分成若干类,然后再用分好类的样本训练出相应的分类器。

将未知类别的一组样本分成若干类的过程称为是聚类分析,也称为是无监督学习或无教师学习。

聚类分析的思路非常直观,也是根据各个带分类模式特征的相似程度来进行分类,将在特征空间中聚集在一起的样本点划分为一类。

聚类分析的方法可以分为三类:简单聚类法、系统聚类法和动态聚类法。

一、简单聚类法(试探法) 1、 最近邻规则的简单试探法设N 个待分类的模式{}12,,,N X X X ,已知一个阈值T (每个样本到其聚类中心的最大距离),分类到12,,ΩΩ,类别中心分别为12,,Z Z 。

第一步:取任意的样本i X 作为第一个聚类中心的初始值,例如:111=∈ΩZ X ;计算:2121D =-X Z ,若,21D T >,则增加一个新类别2Ω,取其中心为22=Z X ; 否则,将2X 归入以1Z 为中心的1Ω类,重新计算1212+=X X Z 。

第二步:设已有类别12,ΩΩ,其中心为12,Z Z ,计算:3131D =-X Z ,3232D =-X Z ;若,31D T >且32D T >,则增加新类别3Ω,令33=Z X ;否则,3X 属于12,Z Z 最近的类别,即03i ∈ΩX ,0312arg min i i i D ≤≤=,并重新计算0i 类的中心。

第k 步:设已有M 个类别12,,,M ΩΩΩ,其中心为12,,M Z Z Z ,计算:11k k D =-X Z ,…,kM k M D =-X Z ; 若,ki D T >,则增加新类别1M +Ω,其中心1M k +=Z X ; 否则,k X 属于12,,M Z Z Z 最近的一类,0k i ∈ΩX ,01arg min ki i Mi D ≤≤=;重新计算第0i 类的聚类中心0i Z 。

例2.2-1这种方法的好处是计算比较简单,缺点是对初始的第一个聚类中心的选择依赖性比较强,同时聚类效果还要受到阈值T 的影响。

(图3.3-2,pp64)一般在实际问题中需要对不同的初始聚类中心和不同的阈值进行试探,直到得到一个满意的聚类结果为止。

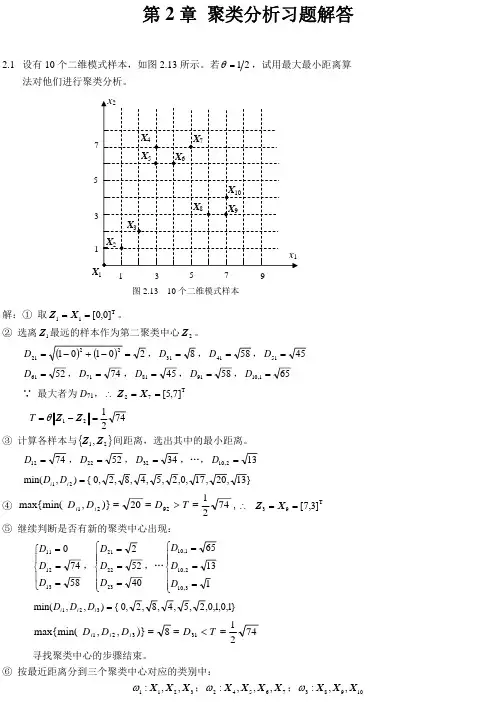

2、 最大最小距离算法最大最小距离法的思路是:在样本集中以最大距离原则选取新的聚类中心,以最小距离原则进行模式归类。

已知N 个待分类的模式{}12,,,N X X X ,阈值比例系数θ,1) 任选样本作为第一个聚类中心1Z ;2) 从样本集中选择距离1Z 最远的样本i X 作为第二个聚类中心,2i =Z X ,设定距离阈值:12T θ=-Z Z ;3) 计算未被作为聚类中心的各样本与12,Z Z 之间的距离,以其中的最小值作为该样本的距离:,1,2ij i j d j =-=X Z ,取[]12min ,,1,,i i i d d d i N ==;4) 若:1max l i i Nd d T ≤≤=>,则相应的样本l X 作为第三个聚类中心,3l =Z X ,然后转5);否则,转6);5) 设存在k 个聚类中心,计算未被作为聚类中心的各样本到各聚类中心的最小距离:[]1min ,,i i ik d d d =,然后寻找其中的最大值:1max l i i Nd d ≤≤=,如果l d T >,则1k l +=Z X ,转5);否则,转6); 6) 按照最小距离原则,将所有样本分到个类别中。