加权最小二乘法—ls

- 格式:pdf

- 大小:70.98 KB

- 文档页数:2

计量经济学期末重点知识归纳1.普通最小二乘法:已知一组样本观测值{}n i Y X i i ,2,1:),(⋯=,普通最小二乘法要求样本回归函数尽可以好地拟合这组值,即样本回归线上的点∧i Y 与真实观测点Yt 的“总体误差”尽可能地小。

普通最小二乘法给出的判断标准是:被解释变量的估计值与实际观测值之差的平方和最小。

2.广义最小二乘法GLS :加权最小二乘法具有比普通最小二乘法更普遍的意义,或者说普通最小二乘法只是加权最小二乘法中权恒取1时的一种特殊情况。

从此意义看,加权最小二乘法也称为广义最小二乘法。

3.加权最小二乘法WLS :加权最小二乘法是对原模型加权,使之变成一个新的不存在异方差性的模型,然后采用普通最小二乘法估计其参数。

4.工具变量法IV :工具变量法是克服解释变量与随机干扰项相关影响的一种参数估计方法。

5.两阶段最小二乘法2SLS, Two Stage Least Squares :两阶段最小二乘法是一种既适用于恰好识别的结构方程,以适用于过度识别的结构方程的单方程估计方法。

6.间接最小二乘法ILS :间接最小二乘法是先对关于内生解释变量的简化式方程采用普通小最二乘法估计简化式参数,得到简化式参数估计量,然后过通参数关系体系,计算得到结构式参数的估计量的一种方法。

7.异方差性Heteroskedasticity :对于不同的样本点,随机干扰项的方差不再是常数,而是互不相同,则认为出现了异方差性。

8.序列相关性Serial Correlation :多元线性回归模型的基本假设之一是模型的随机干扰项相互独立或不相关。

如果模型的随机干扰项违背了相互独立的基本假设,称为存在序列相关性。

9.多重共线性Multicollinearity :对于模型i k i i X X X Y μββββ++⋯+++=i k 22110i ,其基本假设之一是解释变量X 1,X 2,…,Xk 是相互独立的。

如果某两个或多个解释变量之间出现了相关性,则称为存在多重共线性。

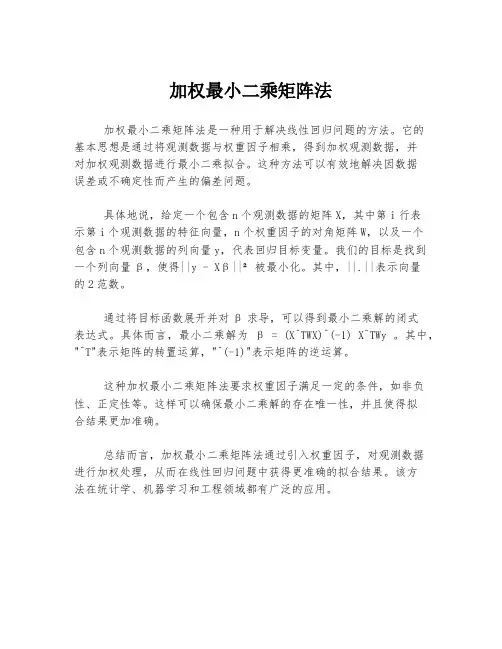

加权最小二乘矩阵法

加权最小二乘矩阵法是一种用于解决线性回归问题的方法。

它的

基本思想是通过将观测数据与权重因子相乘,得到加权观测数据,并

对加权观测数据进行最小二乘拟合。

这种方法可以有效地解决因数据

误差或不确定性而产生的偏差问题。

具体地说,给定一个包含n个观测数据的矩阵X,其中第i行表

示第i个观测数据的特征向量,n个权重因子的对角矩阵W,以及一个

包含n个观测数据的列向量y,代表回归目标变量。

我们的目标是找到一个列向量β,使得||y - Xβ||²被最小化。

其中,||.||表示向量

的2范数。

通过将目标函数展开并对β求导,可以得到最小二乘解的闭式

表达式。

具体而言,最小二乘解为β = (X^TWX)^(-1) X^TWy 。

其中,"^T"表示矩阵的转置运算,"^(-1)"表示矩阵的逆运算。

这种加权最小二乘矩阵法要求权重因子满足一定的条件,如非负性、正定性等。

这样可以确保最小二乘解的存在唯一性,并且使得拟

合结果更加准确。

总结而言,加权最小二乘矩阵法通过引入权重因子,对观测数据

进行加权处理,从而在线性回归问题中获得更准确的拟合结果。

该方

法在统计学、机器学习和工程领域都有广泛的应用。

---------------------------------------------------------------最新资料推荐------------------------------------------------------各类最小二乘法比较最小二乘法(LS)最小二乘是一种最基本的辨识方法,最小二乘法可以用于线性系统,也可以用于非线性系统;可用于离线估计和在线估计。

在随机情况下,利用最小二乘法时,并不要求观测数据提供其概率统计方法的信息,而其估计结果,却有相当好的统计特性。

但它具有两方面的缺陷:一是当模型噪声是有色噪声时,最小二乘估计不是无偏、一致估计;二是随着数据的增长,将出现所谓的数据饱和现象。

针对这两个问题,出现了相应的辨识算法,如遗忘因子法、限定记忆法、偏差补偿法、增广最小二乘、广义最小二乘、辅助变量法、二步法及多级最小二乘法等。

广义最小二乘法(GLS)广义最小二乘法(GLS)广义最小二乘法的基本思想在于引入一个所谓成形滤波器(白化滤波器),把相关噪声转化成白噪声。

优:能够克服当存在有色噪声干扰时,基本最小二乘估计的有偏性,估计效果较好,在实际中得到较好的应用。

缺:1、计算量大,每个循环要调用两次最小二乘法及一次数据滤波,2、求差分方程的参数估值,是一个非线性最优化问题,不一定总能1 / 3保证算法对最优解的收敛性。

广义最小二乘法本质上是一种逐次逼近法。

对于循环程序的收敛性还没有给出证明。

3、GLS 算法的最小二乘指标函数 J 中可能存在一个以上局部极小值,(特别在信噪比不大时,J 可能是多举的)。

GLS 方法的估计结果往往取决于所选用参数的初始估值。

参数估计初值应选得尽量接近优参数。

在没有验前信息的情况下,最小二乘估值被认为是最好的初始条件。

4、广义最小二乘法的收敛速度不是很高。

递推最小二乘法(RLS)递推最小二乘法(RLS)优点:1、无需存储全部数据,取得一组观测数据便可估计一次参数,而且都能在一个采样周期中完成,所需计算量小,占用的存储空间小。

计量经济学简答题及答案1、比较普通最小二乘法、加权最小二乘法和广义最小二乘法的异同。

答:普通最小二乘法的思想是使样本回归函数尽可能好的拟合样本数据,反映在图上就是是样本点偏离样本回归线的距离总体上最小,即残差平方和最小。

只有在满足了线性回归模型的古典假设时候,采用OLS才能保证参数估计结果的可靠性。

在不满足基本假设时,如出现异方差,就不能采用OLS。

加权最小二乘法是对原模型加权,对较小残差平方和赋予较大的权重,对较大赋予较小的权重,消除异方差,然后在采用OLS估计其参数。

在出现序列相关时,可以采用广义最小二乘法,这是最具有普遍意义的最小二乘法。

最小二乘法是加权最小二乘法的特例,普通最小二乘法和加权最小二乘法是广义最小二乘法的特列。

6、虚拟变量有哪几种基本的引入方式? 它们各适用于什么情况?答: 在模型中引入虚拟变量的主要方式有加法方式与乘法方式,前者主要适用于定性因素对截距项产生影响的情况,后者主要适用于定性因素对斜率项产生影响的情况。

除此外,还可以加法与乘法组合的方式引入虚拟变量,这时可测度定性因素对截距项与斜率项同时产生影响的情况。

7、联立方程计量经济学模型中结构式方程的结构参数为什么不能直接应用OLS估计?答:主要的原因有三:第一,结构方程解释变量中的内生解释变量是随机解释变量,不能直接用OLS来估计;第二,在估计联立方程系统中某一个随机方程参数时,需要考虑没有包含在该方程中的变量的数据信息,而单方程的OLS估计做不到这一点;第三,联立方程计量经济学模型系统中每个随机方程之间往往存在某种相关性,表现于不同方程随机干扰项之间,如果采用单方程方法估计某一个方程,是不可能考虑这种相关性的,造成信息的损失。

2、计量经济模型有哪些应用。

答:①结构分析,即是利用模型对经济变量之间的相互关系做出研究,分析当其他条件不变时,模型中的解释变量发生一定的变动对被解释变量的影响程度。

②经济预测,即是利用建立起来的计量经济模型对被解释变量的未来值做出预测估计或推算。

第49卷第5期2021年5月同济大学学报(自然科学版)JOURNAL OF TONGJI UNIVERSITY(NATURAL SCIENCE)Vol.49No.5May2021论文拓展介绍一种加权整体最小二乘估计的高效算法王建民1,2,倪福泽3,赵建军2(1.太原理工大学矿业工程学院,山西太原030024;2.成都理工大学地质灾害防治与地质环境保护国家重点实验室,四川成都610059;3.中煤(西安)航测遥感研究院有限公司,陕西西安710100)摘要:加权整体最小二乘法(WTLS)是估计errors-in-variables(EIV)模型参数严密的方法,当面临大数据集时,其计算效率有限。

针对EIV模型中设计矩阵呈现出的结构性特征,在最小二乘准则的约束条件下,通过仅给设计矩阵的随机列赋予权重,推证了适用于EIV模型参数估计的部分加权整体最小二乘法(PWTLS)。

PWTLS无需借助拉格朗日辅助法,能够精确估计EIV模型参数;另外,该算法缩减了矩阵的维数,同时在迭代过程中避免了估计设计矩阵的随机误差,从而减小了矩阵运算量,提升了计算效率。

最后以真实数据和模拟数据为例与其他7种同类算法进行对比,结果表明,PWTLS取得了与同类算法相同的精度,但计算效率显著提高,验证了算法的可行性。

关键词:整体最小二乘;变量误差模型;计算效率;坐标转换中图分类号:P207文献标志码:AAn Efficient Algorithm for Weighted Total Least Squares MethodWANG Jianmin1,2,NI Fuze3,ZHAO Jianjun2(1.College of Mining Engineering,Taiyuan University of Technology,Taiyuan030024;2.State Key Laboratory of Geohazard Prevention and Geoenvironment Protection,Chengdu University of Technology,Chengdu610059,China;3.Aerial Photogrammetry and Remote Sensing Research Institute Co.,Ltd.,Xi’an710100,China)Abstract:The weighted total least-squares(WTLS)adjustment is a rigorous method for estimating parameters in the errors-in-variables(EIV)model.However,the WTLS are not proper for larger data problem in terms of computational efficiency.Aimed at the structural characteristics of the design matrix in the EIV model,a partially weighted total least-squares(PWTLS)algorithm is proposed based on weighted least-squares(WLS)adjustment by weighting the random column of the design matrix.The PWTLS can obtain an exact solution of the EIV model without applying Lagrange multipliers in a straightforward manner.In addition,the PWTLS reduces the dimensions of the cofactor matrix and does not estimate the random error of the design matrix,as this would greatly improve the computational efficiency. Finally,real and simulated examples are used to demonstrate the accuracy and computational performance of the proposed algorithms.The results show that the PWTLS can obtain the same accuracy as the existing seven improved algorithms,but the computational efficiency is significantly improved.Key words:total least-squares;errors-in-variables;computational efficiency;coordinate transformations高斯‒马尔可夫模型在许多工程实践中得到成功应用,通常认为模型中的设计矩阵是无误差的。

10 *一般估计方法回归方程的估计在特定的条件下选择适当的估计方法会使得结果更加接近实际,更具有说服力。

满足古典线性回归模型的基本假设条件下,利用普通最小二乘法(OLS )估计出来的系数具备优良的线性无偏最小方差(BLUE )的性质。

如果一些条件不能满足,例如出现非线性模型、异方差、序列相关等情形,就无法得到这样的性质。

并且在面对因变量有影响而难以取舍或特殊的计量模型时,就需要改进估计方法以获得更加满意的估计结果。

下面依次介绍几种常见的一般估计方法:非线性最小二乘法(NLS )、广义最小二乘法(GLS )、广义矩阵法(GMM )、逐步筛选最小二乘法、对数极大似然估计法。

10.1 非线性最小二乘法最小二乘法适用的古典假设之一是回归模型是线性的,然而社会经济现象是极其复杂的,有时被解释变量与解释变量之间的关系不一定是线性的。

例如柯布.道格拉斯(Cobb-Dauglass )生产函数模型:321t t t t y L K u ααα=+ ,t=1,2,...,T (10.1.1) 对此方程(10.1.2)进行对数变换,如下式123ln ln ln t t t t y L K u ααα=+++ (10.1.2)虽然式(10.1.2)的变量是非线性形式,此时我们仍能采用估计线性模型的方法,因此模型是参数线性的。

反之,就是参数非线性的,我们就要采用非线性的估计方法。

构建下面的非线性模型:(,)t t t y f x u α=+ ,t=1,2,…,T (10.1.3)式中,y 是被解释变量,x 为解释变量(向量),t u 为误差项,α为待估计的K 维参数向量12(,,...,)k αααα'=,T 是样本个数。

此处讨论的是,f 关于参数α的导数仍含参数α本身,即参数非线性模型。

非线性最小二乘估计是要选择参数向量α的估计值ˆα使残差平方和S(ˆα)最小:[]21ˆˆ()(,)T t t t S y f x αα==-∑ (10.1.4)求解方程,对每个参数分别求偏导数并令这些偏导数为0,得到方程组:[]1ˆˆ(,)()ˆ2(,)0ˆˆT t t t t i i f x S y f x ααααα=∂∂=--=∂∂∑,i=1,2,...,k (10.1.5) 对于参数非线性模型,无法利用普通最小二乘的方法直接求解式(10.1.5)。

信号检测与估计知识点总结(2)第三章估计理论1. 估计的分类矩估计:直接对观测样本的统计特征作出估计。

参数估计:对观测样本中的信号的未知参数作出估计。

待定参数可以是未知的确定量,也可以是随机量。

点估计:对待定参量只给出单个估计值。

区间估计:给出待定参数的可能取值范围及置信度。

(置信度、置信区间) 波形估计:根据观测样本对被噪声污染的信号波形进行估计。

预测、滤波、平滑三种基本方式。

已知分布的估计分布未知或不需要分布的估计。

估计方法取决于采用的估计准则。

2. 估计器的性能评价无偏性:估计的统计均值等于真值。

渐进无偏性:随着样本量的增大估计值收敛于真值。

有效性:最小方差与实际估计方差的比值。

有效估计:最小方差无偏估计。

达到方差下限。

渐进有效估计:样本量趋近于无穷大时方差趋近于最小方差的无偏估计。

? 一致性:随着样本量的增大依概率收敛于真值。

Cramer-Rao 界:其中为Fisher 信息量。

3. 最小均方误差准则模型:假定:是观测样本,它包含了有用信号及干扰信号,其中是待估计的信号随机参数。

根据观测样本对待测参数作出估计。

最小均方误差准则:估计的误差平方在统计平均的意义上是最小的。

即使达到最小值。

此时从而得到的最小均方误差估计为:即最小均方误差准则应是观测样本Y 一定前提下的条件均值。

需借助于条)()(1αα-≥F V =????????-=2212122);,(ln );,(ln )(αααααm m y y y p E y y y p E F )(),()(t n t s t y +=θ)(t n T N ),,,(21θθθθ=),(θts {}{})?()?()?,(2θθθθθθ--=T E e E {}0)?,(?2==MSE e E d d θθθθθθθθθd Y f Y MSE )|()(??=件概率密度求解,是无偏估计。

4. 线性最小均方误差准则线性最小均方误差准则:限定参数估计结果与观测样本间满足线性关系。

Eviews估计方法汇总来源:计量经济学01最小二乘法(1)普通最小二乘估计(OLS):这是使用的最为普遍的模型,基本原理就是估计残差平方和最小化,不予赘述。

(2)加权最小二乘估计(WLS)Eviews路径:LS模型设定对话框-----optionsOLS的假设条件最为严格,其他的估计方法往往是在OLS的某些条件无法满足的前提下进行修正处理的。

WLS就是用来修正异方差问题的。

在解释变量的每一个水平上存在一系列的被解释变量值,每一个被解释变量值都有自己的分布和方差。

在同方差性假设下,OLS对每个残差平方ei^2都同等看待,即采取等权重1。

但是,当存在异方差性时,方差δi^2越小,其样本值偏离均值的程度越小,其观测值越应受到重视,即方差越小,在确定回归线时的作用应当越大;反之方差δi^2越大,其样本值偏离均值的程度越大,其在确定回归线时的作用应当越小。

WLS的一个思路就是在拟合存在异方差的模型的回归线时,对不同的δi^2区别对待。

在利用样本估计系数时依旧是使得总体残差最小化,但是WLS会给每个残差平方和一个权重wi=1/δi。

这样,当δi^2越小,wi越大;反之,δi^2越大,wi越小。

Eviews的WLS没有要求权重因子必须是1/δi。

一般纠正异方差性的方法还包括模型变换法,这种方法假定已知Var(ui)=δi^2=δ^2*f(Xi),令权重wi=f(Xi)^(1/2),用f(Xi)^(1/2)去除原模型,可知随机干扰项转换为ui/f(Xi)^(1/2),这时Var(ui)=δi^2=δ^2,即实现了同方差。

由上面的分析可知,WLS核心就是找到一个等式:Var(ui)=δi^2=δ^2*f(Xi)。

这个等式经过调整更容易理解:δ^2=δi^2/f(Xi)或δ=δi/f(Xi)^(1/2)。

δ为某一常数,权重wi=1/f(Xi)^(1/2),经过wi的加权便实现了同方差。

前面提到的特殊权重wi=1/δi,即f(Xi)=1/δi^2,这时δ=δi/f(Xi)^(1/2)=1。

lse算法公式

LSE(Least Square Estimation),也叫最小二乘估计。

其公式如下:

L(w)=12∑i=1n(w⊤xi−yi)2=w⊤X⊤−Y⊤L(w) = \frac{1}{2} \sum_{i=1}^{n} (w^\top x_i - y_i)^2 = w^\top X^\top - Y^\topL(w)=21i=1∑n(w⊤xi

−yi)2=w⊤X⊤−Y⊤

这里的12{\frac{1}{2}}21是为了微分时消去不必要的参数。

例如当特征空间的维度大于样本数时,我们无法通过少量的样本来拟合出目标函数,这就会导致过拟合。

此外,均方差损失函数(MSE)也称L2损失,其公式为:

S=∑i=1n(Yi−f(xi))2S = \sum_{i=1}^n (Y_i - f(x_i))^2S=i=1∑n(Yi−f(xi))2

MSE是最常用的回归损失函数,是求预测值与真实值之间距离的平方和,

其公式为:

MSE=∑i=1n(f(xi)−Yi)2nMSE = \frac{\sum_{i=1}^n (f(x_i) -

Y_i)^2}{n}MSE=n∑i=1n(f(xi)−Yi)2

以上内容仅供参考,建议查阅统计学、计量经济学等专业书籍或咨询专业人士,以获取更准确的信息。

加权最小二乘矩阵法加权最小二乘矩阵法(Weighted Least Squares Matrix Method)是一种线性回归分析方法,用于解决数据拟合问题。

它在传统的最小二乘法基础上,引入了权重概念,提高了对数据误差的容忍度,并在一些特定应用中取得了较好的效果。

1. 理论基础在回归分析中,我们希望找到一个线性模型来解释观测数据的变化。

最小二乘法是常见的一种线性回归方法,它通过最小化观测数据与模型预测值之间的残差平方和来求解最优解。

然而,最小二乘法的一个局限性是对所有观测数据赋予了相同的权重,即假设所有数据都具有相同的可靠性。

然而,在实际应用中,不同的数据点可能具有不同的观测误差,或者某些数据点的可靠性更高。

为了解决这个问题,加权最小二乘矩阵法引入了权重矩阵,用于衡量每个观测数据的可靠性。

通过权重矩阵,我们可以赋予不同的数据点不同的权重,以更好地反映实际情况。

2. 加权最小二乘矩阵法的求解过程加权最小二乘矩阵法的求解过程可以概括为以下几个步骤:步骤 1:建立线性模型首先,我们需要建立一个线性模型,用于描述观测数据的变化规律。

线性模型可以表示为:y=Xβ+e其中,y表示观测数据的向量,X表示设计矩阵,β表示模型参数,e表示误差向量。

步骤 2:定义权重矩阵其次,我们需要定义一个权重矩阵W,用于衡量每个观测数据的可靠性。

W是一个对角矩阵,对角线上的元素表示每个观测数据的权重。

步骤 3:求解参数估计值通过最小化加权残差平方和,可以求解出参数估计值β̂,它可以通过以下公式计算得到:β̂=(X T WX)−1X T Wy步骤 4:评估模型拟合度最后,我们可以通过计算拟合优度等指标来评估模型的拟合度。

常见的指标包括决定系数(R2)和均方根误差(RMSE)等。

3. 加权最小二乘矩阵法的应用加权最小二乘矩阵法在实际应用中具有广泛的应用,尤其适用于以下情况:•数据存在异方差性(heteroscedasticity):在这种情况下,不同数据点具有不同的观测误差,使用加权最小二乘矩阵法可以更好地处理异方差性,提高模型的拟合度。

最小二乘法参数辨识1 引言系统辨识是根据系统的输入输出时间函数来确定描述系统行为的数学模型。

现代控制理论中的一个分支。

通过辨识建立数学模型的目的是估计表征系统行为的重要参数,建立一个能模仿真实系统行为的模型,用当前可测量的系统的输入和输出预测系统输出的未来演变,以及设计控制器。

对系统进行分析的主要问题是根据输入时间函数和系统的特性来确定输出信号。

对系统进行控制的主要问题是根据系统的特性设计控制输入,使输出满足预先规定的要求。

而系统辨识所研究的问题恰好是这些问题的逆问题。

通常,预先给定一个模型类μ={M}(即给定一类已知结构的模型),一类输入信号u和等价准则J=L(y,yM)(一般情况下,J是误差函数,是过程输出y和模型输出yM的一个泛函);然后选择使误差函数J达到最小的模型,作为辨识所要求的结果。

系统辨识包括两个方面:结构辨识和参数估计。

在实际的辨识过程中,随着使用的方法不同,结构辨识和参数估计这两个方面并不是截然分开的,而是可以交织在一起进行的。

2 系统辨识的目的在提出和解决一个辨识问题时,明确最终使用模型的目的是至关重要的。

它对模型类(模型结构)、输入信号和等价准则的选择都有很大的影响。

通过辨识建立数学模型通常有四个目的。

①估计具有特定物理意义的参数有些表征系统行为的重要参数是难以直接测量的,例如在生理、生态、环境、经济等系统中就常有这种情况。

这就需要通过能观测到的输入输出数据,用辨识的方法去估计那些参数。

②仿真仿真的核心是要建立一个能模仿真实系统行为的模型。

用于系统分析的仿真模型要求能真实反映系统的特性。

用于系统设计的仿真,则强调设计参数能正确地符合它本身的物理意义。

③预测这是辨识的一个重要应用方面,其目的是用迄今为止系统的可测量的输入和输出去预测系统输出的未来的演变。

例如最常见的气象预报,洪水预报,其他如太阳黑子预报,市场价格的预测,河流污染物含量的预测等。

预测模型辨识的等价准则主要是使预测误差平方和最小。

WLS:加权最小二乘

一般最小二乘估计精度不高的原因之一是不分优劣地使用了量测值,如果对不同量测值的质量有所了解,则可用加权的方法分别对待各量测量,精度质量高的权重取大些,精度质量低的权重取小些;权W 是适当取值的正定阵。

最小二乘估计是Gauss 在1795年为测定行星轨道而提出的参数估计算法。

特点是方法简单,不必知道与被估计量任何统计信息。

假定量测信息z 可以表示为参数x 的线性函数,即

v Hx z +=,

其中()N m n ×∈ H , N m ∈ v 是一个零均值的随机向量;设()()N m N m ×∈ W 为对称正定阵(0≥W ),则如下估计

WLS T ˆˆˆˆarg min()()=−−x x z Hx W z Hx ,

称为加权最小二乘(weighted least squares ,WLS )估计;如果=W I ,则称为最小二乘(Least Squares ,LS )估计。

注意:最小二乘法的最优指标只保证了估计量测的均方误差最小。

定理 设T

H WH 可逆,则基于量测信息z 和加权矩阵W 对参数x 的WLS 估计为 WLS T 1T ˆ()−=x

H WH H Wz , 证明:因为T T T T T

min()()min(2)−−=−+x x z Hx W z Hx z Wz z WHx x H WHx , 而

()T T T T T T T T T 1

T T (2)(2)20

ˆWLS x −∂−+∂∂=−+∂=−=∴=T T z Wz z WHx x H WHx x

z Wz x H Wz x H WHx x

H Wz +2H WHx H WH H Wz (注意:,T Ax x Ax A x x

∂<>=+∂,,x y y x ∂<>=∂) 关于估计方差:

如果量测误差v 的均值为0方差为R ,则加权最小二乘估计也是无偏估计。

估计的协方差阵为

11111[]()()ˆ(()()())

T T T T T T T T T T E xx

H WH H WRWH H WH x

x x H WH H WHx H WH H Wz

H WH H Wv −−−−−==−=−=− ∵

(注意11()()T T A A −−=)

如果1

W R −=,则加权最小二乘估计又称为马尔科夫估计,此时估计的协方差阵为 11[]()T T E xx

H R H −−= 此时协方差阵最小,是WLS 估计中的最优者。

(注意两个矩阵 A ,B 比大小时,A B >指A B −正定)

最小二乘法的最优指标只保证了量测的估计均方误差最小,而并未确保估计量的估计误差达到最佳,所以估计精度不高)

例1:用一台仪器对未知确定性标量x 作r 次(直接)测量,测量值分别为1,...,r z z ,并已知测量均值为0,方差为R ,求其最小二乘估计,并估计协方差阵。

解:令1[,...,]T r Z z z =,[1,...,1]T H =,[]T E VV RI =, 此时W =I,有

11ˆ[..]r x z z r

=++ []T R E xx r

= 例2:用两台仪器对未知确定性标量x 各直接测量一次,量测分别为1z 和2z ,两台仪器测量误差均值为0,方差分别为r 和4r ,求其最小二乘估计,并估计协方差阵。

由题意,得测量方程

12z 1r ,Z=,H=,R=z 14r Z Hx V

=+⎡⎤⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦

⎣⎦

其中, 有 1221ˆ[]21115E[x ][11]R r r 1224

x z z =+⎡⎤==>⎢⎥⎣⎦ 上式说明,使用精度差一倍的两台仪器同时测量,最小二乘估计效果不如单独采用一台仪器。

但如果采用马尔科夫估计,取1W R −=,有

1221ˆ[4]54E[x ]r r 5

x z z =+=<

可见,应用马尔科夫估计,获得了较仅用一台精度高的仪器更好的效果(方差小)。

所以,增加不同的测量值,并根据其精度区别利用,能有效提高估计精度。