一元线性回归模型

- 格式:ppt

- 大小:657.50 KB

- 文档页数:17

第三章 一元线性回归模型一、预备知识(一)相关概念对于一个双变量总体,若由基础理论,变量和变量之间存在因果),(i i x y x y 关系,或的变异可用来解释的变异。

为检验两变量间因果关系是否存在、x y 度量自变量对因变量影响的强弱与显著性以及利用解释变量去预测因变量x y x ,引入一元回归分析这一工具。

y 将给定条件下的均值i x i yi i i x x y E 10)|(ββ+=(3.1)定义为总体回归函数(PopulationRegressionFunction,PRF )。

定义为误差项(errorterm ),记为,即,这样)|(i i i x y E y -i μ)|(i i i i x y E y -=μ,或i i i i x y E y μ+=)|(i i i x y μββ++=10(3.2)(3.2)式称为总体回归模型或者随机总体回归函数。

其中,称为解释变量x (explanatory variable )或自变量(independent variable );称为被解释y 变量(explained variable )或因变量(dependent variable );误差项解释μ了因变量的变动中不能完全被自变量所解释的部分。

误差项的构成包括以下四个部分:(1)未纳入模型变量的影响(2)数据的测量误差(3)基础理论方程具有与回归方程不同的函数形式,比如自变量与因变量之间可能是非线性关系(4)纯随机和不可预料的事件。

在总体回归模型(3.2)中参数是未知的,是不可观察的,统计计10,ββi μ量分析的目标之一就是估计模型的未知参数。

给定一组随机样本,对(3.1)式进行估计,若的估计量分别记n i y x i i ,,2,1),,( =10,),|(ββi i x y E 为,则定义3.3式为样本回归函数^1^0^,,ββi y ()i i x y ^1^0^ββ+=n i ,,2,1 =(3.3)注意,样本回归函数随着样本的不同而不同,也就是说是随机变量,^1^0,ββ它们的随机性是由于的随机性(同一个可能对应不同的)与的变异共i y i x i y x 同引起的。

第二章 一元线性回归模型2.1 一元线性回归模型的基本假定有一元线性回归模型(统计模型)如下, y t = β0 + β1 x t + u t上式表示变量y t 和x t 之间的真实关系。

其中y t 称被解释变量(因变量),x t 称解释变量(自变量),u t 称随机误差项,β0称常数项,β1称回归系数(通常未知)。

上模型可以分为两部分。

(1)回归函数部分,E(y t ) = β0 + β1 x t ,(2)随机部分,u t 。

图2.1 真实的回归直线这种模型可以赋予各种实际意义,居民收入与支出的关系;商品价格与供给量的关系;企业产量与库存的关系;身高与体重的关系等。

以收入与支出的关系为例。

假设固定对一个家庭进行观察,随着收入水平的不同,与支出呈线性函数关系。

但实际上数据来自各个家庭,来自同一收入水平的家庭,受其他条件的影响,如家庭子女的多少、消费习惯等等,其出也不尽相同。

所以由数据得到的散点图不在一条直线上(不呈函数关系),而是散在直线周围,服从统计关系。

“线性”一词在这里有两重含义。

它一方面指被解释变量Y 与解释变量X 之间为线性关系,即另一方面也指被解释变量与参数0β、1β之间的线性关系,即。

1ty x β∂=∂,221ty β∂=∂0 ,1ty β∂=∂,2200ty β∂=∂2.1.2 随机误差项的性质随机误差项u t 中可能包括家庭人口数不同,消费习惯不同,不同地域的消费指数不同,不同家庭的外来收入不同等因素。

所以在经济问题上“控制其他因素不变”是不可能的。

随机误差项u t 正是计量模型与其它模型的区别所在,也是其优势所在,今后咱们的很多内容,都是围绕随机误差项u t 进行了。

回归模型的随机误差项中一般包括如下几项内容: (1)非重要解释变量的省略,(2)数学模型形式欠妥, (3)测量误差等,(4)随机误差(自然灾害、经济危机、人的偶然行为等)。

2.1.3 一元线性回归模型的基本假定通常线性回归函数E(y t ) = β0 + β1 x t 是观察不到的,利用样本得到的只是对E(y t ) =β0 + β1 x t 的估计,即对β0和β1的估计。

一元回归线性模型

一元线性回归模型,又称为简单线性回归模型,是机器学习中常

用的回归模型,它是利用一个自变量X来预测因变量Y的结果。

一元

线性回归模型将样本数据映射为一条直线,如y=ax+b,其中a是斜率,b是截距,也就是说,一元线性回归模型中的参数是斜率和截距,而拟

合的直线就是根据样本数据估计出来的最佳拟合直线。

目标函数是求解参数 a 和 b,使得误差平方和最小,具体来说,

目标函数的表达式为:J(a,b)=Σi(yi-f(xi))^2,其中f(x)=ax+b,yi为观测值,xi为观测值对应的自变量。

对于一元线性回归模型,求解参数 a 和 b 的最优方法要么是直

接用梯度下降法求解,要么是用最小二乘法求解。

梯度下降法求解时,需构造损失函数,使用梯度下降法迭代更新参数,直到获得最优结果;而最小二乘法求解时,通过求解参数关于损失函数的导数,便可解出

模型参数,从而得到最优结果。

一元线性回归模型在实际应用中有很多优点,其中最重要的就是

它易于拟合和解释,它求解简单,可以很大程度上减少了计算复杂度,而且可以很好地预测因变量的值,也可以用来检验变量之间的关系。

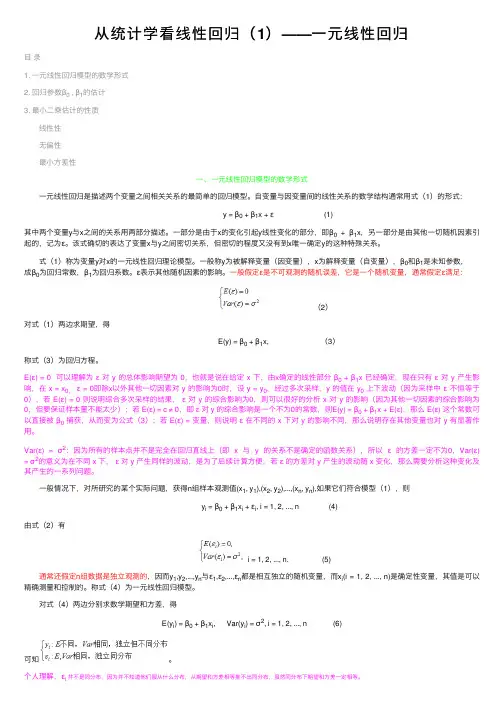

从统计学看线性回归(1)——⼀元线性回归⽬录1. ⼀元线性回归模型的数学形式2. 回归参数β0 , β1的估计3. 最⼩⼆乘估计的性质 线性性 ⽆偏性 最⼩⽅差性⼀、⼀元线性回归模型的数学形式 ⼀元线性回归是描述两个变量之间相关关系的最简单的回归模型。

⾃变量与因变量间的线性关系的数学结构通常⽤式(1)的形式:y = β0 + β1x + ε (1)其中两个变量y与x之间的关系⽤两部分描述。

⼀部分是由于x的变化引起y线性变化的部分,即β0+ β1x,另⼀部分是由其他⼀切随机因素引起的,记为ε。

该式确切的表达了变量x与y之间密切关系,但密切的程度⼜没有到x唯⼀确定y的这种特殊关系。

式(1)称为变量y对x的⼀元线性回归理论模型。

⼀般称y为被解释变量(因变量),x为解释变量(⾃变量),β0和β1是未知参数,成β0为回归常数,β1为回归系数。

ε表⽰其他随机因素的影响。

⼀般假定ε是不可观测的随机误差,它是⼀个随机变量,通常假定ε满⾜:(2)对式(1)两边求期望,得E(y) = β0 + β1x, (3)称式(3)为回归⽅程。

E(ε) = 0 可以理解为ε对 y 的总体影响期望为 0,也就是说在给定 x 下,由x确定的线性部分β0 + β1x 已经确定,现在只有ε对 y 产⽣影响,在 x = x0,ε = 0即除x以外其他⼀切因素对 y 的影响为0时,设 y = y0,经过多次采样,y 的值在 y0 上下波动(因为采样中ε不恒等于0),若 E(ε) = 0 则说明综合多次采样的结果,ε对 y 的综合影响为0,则可以很好的分析 x 对 y 的影响(因为其他⼀切因素的综合影响为0,但要保证样本量不能太少);若 E(ε) = c ≠ 0,即ε对 y 的综合影响是⼀个不为0的常数,则E(y) = β0 + β1x + E(ε),那么 E(ε) 这个常数可以直接被β0 捕获,从⽽变为公式(3);若 E(ε) = 变量,则说明ε在不同的 x 下对 y 的影响不同,那么说明存在其他变量也对 y 有显著作⽤。

一.一元线性回归模型1. 一元线性回归模型的基本假设有哪些?违背假设是否能估计?为什么? 答:①E(i V |i X )=0 随机项i V 的数学期望为0 ②Var(i V |i X )=E{[i V —E(i V )]2}=E (2i V )=2u σ③COV(i V ,j V )=E{[i V —E(i V )][j V —E(j V )]}=0 i V ,j V 相互独立不相关 ④COV(i V ,i X )=0 解释变量i X 与误差项i V 同期独立无关 ⑤i V ~N(0,2u σ) i X ,i V 服从正态分布的随机变量 违背的话可以估计 但是要对原数据适当的处理 2. 方差分析表与参数估计表的结构变差来源 平方和 自由度 均方F统计量回归 残差 ESS RSS 12n - ESS22e RSS n S -= 1(2)ESSF RSSn =-总变差 TSS1n -21y TSS n S -=―2R =ESS TSS =1—RSSTSS=2212211[()()]()()ni i i n niii i x x y y x x y y ===----∑∑∑TSS=21()nii yy =-∑ ESS=21ˆ()ni yy =-∑ RSS=21ˆ()ni i y y =-∑ Eviews 输出结果 参数估计值 估计值标准差 F 检验 Variable Coefficient Std. Error t-Statistic Prob.C (0β) (S(0ˆβ)) 0β<对0β显著 X 1β>非线性不通过R-squared Adjusted R-squaredProb(F-statistic) >方程本身不是线性的 结论:该案例结果不理想 无论从个别还是总体上原因:(1) 0β,1β个别检验不通过 (2)F 检验远远超过期望的值(>5%or>10%) (3) 2R =拟合度特别差<50%(注:2R >80%or>70%认为拟合度好)3. 回归方程的标准记法ˆi y=0β+1βi x Se=(S(0ˆβ)) (S(1ˆβ)) 22211ˆ()ˆ22nni i i i uey yn n σ==-==--∑∑2221121ˆ()2()ni u i nii e s n x x σβ===--∑∑222211ˆ()[]()Xn ii x s nx x βσ==+-∑ 111ˆˆ()t s ββ= *代表显著性大小 **代表1%下显著 *代表5%下显著 无*代表5%下不显著 4. t 检验与F 检验的步骤(1) t 检验:01:0H β=11:0H β≠Next 111ˆˆ()t s ββ=~t(n-2) Next 查t 分布表临界值2(2)t n α- α取1%或5% Next 当|t|≥2(2)t n α-拒绝原假设10β≠说明y 对x 的一元线性相关显著当|t|<2(2)t n α-不拒绝原假设10β≠说明y 对x 的一元线性相关不显著(2) F 检验:01:0H β=11:0H β≠ Next 12ESSF RSS n =-(上:回归 下:残差)=?(假设=100)Next 查F α(1,n-2) Next 当100≥F α(1,n-2)拒绝0H 说明y 对x 的一元线性相关显著当100<F α(1,n-2)不拒绝0H 说明y 对x 的一元线性相关不显著(注:统计软件用P 值进行检验P>α等价F<F α(1,n-2)此时不拒绝0H 当P<αF>F α(1,n-2)此时拒绝0H ) 二.多元线性回归模型1. 基本假设:(1) 随机误差项i V 的条件期望值为0 即E(i V |1i X …ki X )=0 (2) 随机误差项i V 的条件方差相同Var(i V |1i X …ki X )=2u σ (3) i V 之间无序列相关COV(i V ,j V )=0 (4) i V ~N(0,2u σ)(5)各种解释变量之间不存在显著的线性相关关系 2.矩阵表达式12ˆˆˆ.ˆn y y y y ⎛⎫ ⎪ ⎪= ⎪ ⎪⎝⎭ 11112211...1.....1...k k n kn x x x x x x x ⎫⎛⎪⎪ =⎪ ⎪ ⎝⎭0ˆˆ.ˆk βββ⎛⎫ ⎪= ⎪ ⎪⎝⎭ 1ˆ()()x x x y β-''= 参见P51 例3-1 3随机误差项u 的方差2u σ的最小二乘估计量221ˆ1nii X en k σ==--∑=21ˆ()1niii y yn k =---∑随机误差项i U 同方差且无序列相关 则方差协方差矩阵Var-COV(u)=E(uu ')=)(112.,...n n u E u u u u ⎛⎫⎪ ⎪ ⎪⎝⎭=2u σI4.方差分析表变差来源 平方和 自由度 均方F统计量回归 残差 ESSRSS 12n - ESS22e RSS n S -= 1(2)ESSF RSSn =-总变差 TSS1n -21y TSS n S -=―2R =ESS TSS TSS=21()n i i y y =-∑ ESS=21ˆ()n i y y =-∑ RSS=21ˆ()ni i y y =-∑ 221111(1)11RSSn n k R R TSS n k n ---=-=----- 222211ˆ()ˆ11nniiii i u ey ySe n k n k σ==-===----∑∑5. P69 8(1) 0β1β3β的个别检验不通过,2β的个别检验通过 (2)F 检验通过 对结果不满意三.违背古典假定的计量经济模型 2. 自相关D-W 检验 (1)d< L d ,u 存在一阶正自相关(2)d>4-L d ,u 存在一阶负自相关 (3)u d <d<4-u d ,不存在自相关(4)L d <d<u d ,或4-u d <d<4-L d 时,u 是否存在自相关,不能确定 4.异方差的white 检验(以二元线性模型为例) 二元线性回归模型:01122i i i i y x x u βββ=+++ ① 异方差与解释变量12,x x 的一般线性关系为:2i σ=0α+11i x α+22i x α+231i x α+242i x α+512i i x x α+i V ②<1>运用OLS 估计的式① <2>计算残差序列i并求2i<3>做2i对1i x ,2i x ,21i x ,22i x ,12i i x x 的辅助回归,即222011223142312ˆˆˆˆˆˆˆi i i i i i i e x x x x x x αααααα=+++++ ③其中2ˆi e 为2i e 的估计<4>计算估计量2nR ,n 为样本容量2R 为辅助回归的可决定系数<5>在不存在异方差的原假设下2nR 服从自由度为5的2χ分布,给定显著性水平α查2χ分布表得临界值2αχ(5) 如果2nR >2αχ(5)则拒绝原假设,表明模型中随机误差存在异方差 5.杜宾二步法:第一步求出自相关系数的估计值ˆ第二步利用ˆ进行广义差分变换 对差分模型利用OLS 求的参数0β和1β的估计值0ˆβ和1ˆβ 6.方差扩大因子检验多元回归模型中多重共线性:1x =f(x2,x3….xk) x2=f(x1,x3…xk) …xj=(x1,x2...1j x -…xk) xk=f(x1,x2….1k x -)对每个回归方程求其决定系数分别为12R ,22R (2)j R (2)k R ,在决定系数中寻求最大而接近者,比如2x R 最大,则可判定解释变量Xj 与其他解释变量的一个或多个相关程度高,因此就使回归方程式y=f(x1,x2….xk)表现高度多重共线性,计量经济学中检验多重共线性时,往往称(1-2j R )为自变量Xj 的容忍度,其倒数为方差扩大因子,记为211j jVIF R =- 当模型中全部k 个自变量所对应的方差扩大因子平均数远远大于1时就表明存在严重的多重共线性。

§4.2 一元线性回归模型及其假设条件1.理论模型y=a+bx+εX 是解释变量,又称为自变量,它是确定性变量,是可以控制的。

是已知的。

Y 是被解释变量,又称因变量,它是一个随机性变量。

是已知的。

A,b 是待定的参数。

是未知的。

2.实际中应用的模型x b a yˆˆˆ+= ,bˆ,x 是已知的,y ˆ是未知的。

回归预测方程:x b a y += a ,b 称为回归系数。

若已知自变量x 的值,则通过预测方程可以预测出因变量y 的值,并给出预测值的置信区间。

3.假设条件满足条件:(1)E (ε)=0;(2)D (εi )=σ2;(3)Cov (εi ,εj )=0,i ≠j ; (4) Cov (εi ,εj )=0 。

条件(1)表示平均干扰为0;条件(2)表示随机干扰项等方差;条件(3)表示随机干扰项不存在序列相关;条件(4)表示干扰项与解释变量无关。

在假定条件(4)成立的情况下,随机变量y ~N (a+bx ,σ2)。

一般情况下,ε~N (0,σ2)。

4.需要得到的结果a ˆ,b ˆ,σ2§4.3 模型参数的估计1.估计原理回归系数的精确求估方法有最小二乘法、最大似然法等多种,我们这里介绍最小二乘法。

估计误差或残差:y y e i i i -=,x b a y i +=,e e y y ii i i x b a ++=+= (5.3—1)误差e i 的大小,是衡量a 、b 好坏的重要标志,换句话讲,模型拟合是否成功,就看残差是否达到要求。

可以看出,同一组数据,对于不同的a 、b 有不同的e i ,所以,我们的问题是如何选取a 、b 使所有的e i 都尽可能地小,通常用总误差来衡量。

衡量总误差的准则有:最大绝对误差最小、绝对误差的总和最小、误差的平方和最小等。

我们的准则取:误差的平方和最小。

最小二乘法:令 ()()∑∑---∑======n i ni n i i x b a y y y e i i i i Q 112212 (5.3—2)使Q 达到最小以估计出a 、b的方法称为最小二乘法。