svm分类器原理

- 格式:doc

- 大小:197.00 KB

- 文档页数:5

svSV(Support Vector)是机器学习中一种重要的算法模型,广泛用于分类和回归问题。

它的原理基于统计学习理论和结构风险最小化原则,具有良好的泛化能力和较高的预测准确性。

在本文中,我们将深入探讨SV算法的原理、优化方法和应用场景。

一、SV的原理1.1 背景支持向量机(SVM,Support Vector Machine)是由Vapnik等人于1995年提出的一种监督学习算法。

它的核心思想是通过定义超平面来最大化类别间的间隔,从而实现分类。

而SV算法是SVM 在处理分类问题时的一种具体实现。

1.2 基本原理SV算法的基本原理是通过在训练数据中找到一个超平面,将不同类别的样本完全分开。

在二分类问题中,SV算法的目标是找到一个划分超平面,使得不同类别的样本尽可能地远离超平面,以增加分类的可靠性。

1.3 支持向量和间隔在SV算法中,支持向量是指离超平面最近的训练样本点。

这些支持向量对决定划分超平面的位置和方向起到关键作用。

而间隔是指超平面到支持向量的最小距离,它可以用来衡量分类器的鲁棒性和泛化能力。

1.4 核函数SV算法可以使用核函数来处理非线性分类问题。

核函数的作用是将原始特征空间映射到一个更高维的特征空间,以便能够用线性超平面来划分非线性样本。

常用的核函数有线性核函数、多项式核函数和高斯核函数等。

二、SV的优化方法2.1 函数形式SV算法通常使用凸优化问题来求解最优的超平面和间隔。

这个优化问题可以被描述为一个二次规划问题,通过求解拉格朗日对偶问题得到最优解。

2.2 SMO算法序列最小优化(Sequential Minimal Optimization,SMO)是一种常用的求解SVM优化问题的算法。

它的思想是将原问题拆分成一系列较小的子问题,并通过迭代的方式逐步求解,最终得到全局最优解。

2.3 样本权重和松弛变量在SV算法中,样本权重和松弛变量是用来调整分类器的鲁棒性和灵活性的参数。

样本权重可以控制各个样本在训练中的重要程度,而松弛变量则可以处理一些不完美的样本分类情况,使分类器具有更好的适应能力。

支持向量机简介与基本原理支持向量机(Support Vector Machine,SVM)是一种常用的机器学习算法,被广泛应用于模式识别、数据分类以及回归分析等领域。

其独特的优势在于可以有效地处理高维数据和非线性问题。

本文将介绍支持向量机的基本原理和应用。

一、支持向量机的基本原理支持向量机的基本思想是通过寻找一个最优超平面,将不同类别的数据点分隔开来。

这个超平面可以是线性的,也可以是非线性的。

在寻找最优超平面的过程中,支持向量机依赖于一些特殊的数据点,称为支持向量。

支持向量是离超平面最近的数据点,它们对于确定超平面的位置和方向起着决定性的作用。

支持向量机的目标是找到一个超平面,使得离它最近的支持向量到该超平面的距离最大化。

这个距离被称为间隔(margin),最大化间隔可以使得分类器更具鲁棒性,对新的未知数据具有更好的泛化能力。

支持向量机的求解过程可以转化为一个凸优化问题,通过求解对偶问题可以得到最优解。

二、支持向量机的核函数在实际应用中,很多问题并不是线性可分的,此时需要使用非线性的超平面进行分类。

为了解决这个问题,支持向量机引入了核函数的概念。

核函数可以将低维的非线性问题映射到高维空间中,使得原本线性不可分的问题变得线性可分。

常用的核函数有线性核函数、多项式核函数、高斯核函数等。

线性核函数适用于线性可分问题,多项式核函数可以处理一些简单的非线性问题,而高斯核函数则适用于复杂的非线性问题。

选择合适的核函数可以提高支持向量机的分类性能。

三、支持向量机的应用支持向量机在实际应用中有着广泛的应用。

在图像识别领域,支持向量机可以用于人脸识别、物体检测等任务。

在生物信息学领域,支持向量机可以用于蛋白质分类、基因识别等任务。

在金融领域,支持向量机可以用于股票市场预测、信用评估等任务。

此外,支持向量机还可以用于文本分类、情感分析、异常检测等领域。

由于其强大的分类性能和泛化能力,支持向量机成为了机器学习领域中的重要算法之一。

支持向量机的基本原理

支持向量机(Support Vector Machine, SVM)是一种二分类模型,其基本原理是找到一个最优的超平面来进行数据的划分。

其基本思想是将样本空间映射到高维特征空间,找到一个超平面使得正负样本之间的间隔最大化,从而实现分类。

具体来说,SVM的基本原理包括以下几个步骤:

1. 寻找最优超平面:将样本空间映射到高维特征空间,使得样本在特征空间中线性可分。

然后寻找一个超平面来最大化两个不同类别样本的间隔(也称为“分类间隔”)。

2. 构建优化问题:SVM通过解决一个凸二次规划问题来求解最优超平面。

该优化问题的目标是最大化分类间隔,同时限制样本的分类正确性。

3. 核函数技巧:在实际应用中,数据通常是非线性可分的。

通过引入核函数的技巧,可以将非线性问题转化为高维或无限维的线性问题。

常用的核函数有线性核、多项式核、高斯核等。

4. 寻找支持向量:在求解优化问题时,只有一部分样本点对于最优超平面的确定起到决定性作用,这些样本点被称为“支持向量”。

支持向量决定了超平面的位置。

5. 分类决策函数:在得到最优超平面后,可以通过计算样本点到超平面的距离来进行分类。

对于新的样本点,根据其距离超平面的远近来判断其所属类别。

支持向量机的基本原理可以简单概括为在高维特征空间中找到一个最优超平面,使得样本的分类间隔最大化。

通过引入核函数的技巧,SVM也可以处理非线性可分的问题。

支持向量机具有理论基础牢固、分类效果好等优点,在实际应用中得到了广泛的应用。

SVM的常用多分类算法概述摘要:SVM方法是建立在统计学习理论基础上的机器学习方法,具有相对优良的分类性能,是一种非线性分类器。

最初SVM是用以解决两类分类问题,不能直接用于多类分类,当前已经有许多算法将SVM推广到多类分类问题,其中最常用两类:OAA和OAO算法,本文主要介绍这两类常用的多分类算法。

关键词:SVM;多分类;最优化自从90年代初V. Vapnik提出经典的支持向量机理论(SVM),由于其完整的理论框架和在实际应用中取得的很多好的效果,在模式识别、函数逼近和概率密度估计领域受到了广泛的重视。

SVM方法是建立在统计学习理论基础上的机器学习方法,具有相对优良的分类性能。

SVM是一种非线性分类器。

它的基本思想是将输入空间中的样本通过某种非线性函数关系映射到一个特征空间中,使两类样本在此特征空间中线性可分,并寻找样本在此特征空间中的最优线性区分平面。

它的几个主要优点是可以解决小样本情况下的机器学习问题,提高泛化性能,解决高维问题、非线性问题,可以避免神经网络结构选择和局部极小点问题。

1. SVM方法若样本集Q={(x i,y i)|i=1,……,L}∈R d*{-1,+1}是线性可分的。

则存在分类超平面w T x+b=0,x∈R d对样本集Q中任一(x i,y i)都满足:在空间R d中样本x=(x1,…, x d)r到分类超平面的距离d=|w T*x+b|/||w||,其中||w||= .当存在x 使得w T x i+b=±1, 则图1中超平面的分类间隔margin = 2/ ‖w ‖。

使分类间隔margin 最大的超平面即为最优分类超平面。

寻找最优分类超平面的问题将转化为求如下一个二次规划问题:minΦ( w) =1/2‖w ‖满足约束条件:y i ( w T x i + b) ≥1 , i = 1 ,2 , ⋯, L采用Lagrange 乘子转换为一个对偶问题,形式如下:满足约束条件:0≤a i,i=1,……,L )其中a i为每一个样本对应的Lagrange 乘子, 根据Kuhn2Tucker 条件,这个优化的解必须满足:a i (y i [w T x i +b]-1)=0,i=1,……,L因此多数样本对应 a i将为0 ,少部分不为0 的a i对应的样本就是支持向量。

⽀持向量机模型⽀持向量机模型(SVM)是⼀个⼆分类模型,基本思想是求解能够正确划分训练数据集并且⼏何间隔最⼤的分离超平⾯,其学习策略便是间隔最⼤化,最终化为⼀个凸⼆次规划问题的求解。

SVM可分为线性可分⽀持向量机、线性⽀持向量机和⾮线性⽀持向量机。

算法推导1. 线性可分⽀持向量机引⼊函数间隔和⼏何间隔线性向量机的基本思想是硬间隔最⼤化,即:\begin{aligned} \max_{w,b} \ \ \ \ &γ\\ s.t.\ \ \ \ \ &y_i·\frac{1}{||w||} ·(w·x_i+b)≥γ,i=1,2,…,N \end{aligned}即:\begin{aligned} \max_{w,b} \ \ \ \ &\frac{ŷ}{||w||}\\ s.t.\ \ \ \ \ &y_i·(w·x_i+b)≥ŷ,i=1,2,…,N \end{aligned}取ŷ=1,得\begin{aligned} \min_{w,b} \ \ \ \ &\frac{1}{2}{||w||}^2\\ s.t.\ \ \ \ \ &y_i·(w·x_i+b)-1≥0,i=1,2,…,N \end{aligned}这是⼀个凸⼆次规划问题,通过引⼊拉格朗⽇乘⼦法,构建拉格朗⽇对偶函数,通过求其对偶函数的解,从⽽得到原始问题的最优解。

定义拉格朗⽇函数:L(w,b,α)= \frac{1}{2}{||w||}^2-\sum_{i=1}^N{α_iy_i (w·x_i+b)}+\sum_{i=1}^N{α_i}其中,α={(α_1,α_2,…,α_N)}^T为拉格朗⽇乘⼦向量,α_i≥0,i=1,2,…,N原始问题的对偶问题是极⼤极⼩问题:\max_α{\min_{w,b} L(w,b,α)}求解对偶问题求\min_{w,b} L(w,b,α)分别对w,b求偏导数并令其为0:\begin{aligned} \nabla_w L(w,b,α)=w-\sum_{i=1}^N{α_i y_i x_i}=0 \\ \nabla_b L(w,b,α)=\sum_{i=1}^N{α_i y_i}=0 \end{aligned}得\begin{aligned} w=\sum_{i=1}^N{α_i y_i x_i} \\ \sum_{i=1}^N{α_i y_i}=0 \end{aligned}代⼊拉格朗⽇函数,得L(w,b,α)= \frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N α_i α_j y_i y_j (x_i·x_j+b)-\sum_{i=1}^N{α_i y_i ((\sum_{j=1}^N{α_j y_jx_j})·x_i+b)}+\sum_{i=1}^Nα_i= -\frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N α_i α_j y_i y_j (x_i·x_j)+\sum_{i=1}^Nα_i即\min_{w,b} L(w,b,α) = -\frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N α_i α_j y_i y_j (x_i·x_j)+\sum_{i=1}^Nα_i求\min_{w,b} L(w,b,α)对α的极⼤:\max_{α}\ \ \ -\frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N α_i α_j y_i y_j (x_i·x_j)+\sum_{i=1}^Nα_is.t.\ \ \ \sum_{i=1}^N{α_i y_i}=0\ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ α_i≥0,i=1,2,…,N即:\min_{α}\ \ \ \frac{1}{2}\sum_{i=1}^N\sum_{j=1}^N α_i α_j y_i y_j (x_i·x_j)-\sum_{i=1}^Nα_is.t.\ \ \ \sum_{i=1}^N{α_i y_i}=0\ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ \ α_i≥0,i=1,2,…,N求得最优解1\alpha^x={({\alpha_1}^x,{\alpha_2}^x,…,{\alpha_N}^x)}^{T}计算w^*=\sum_{i=1}^N {α_i}^x y_i x_i并选择α^x的⼀个正分量{α_j}^x>0,计算b^x=y_i-\sum_{i=1}^N {α_i}^x y_i (x_i·x_j)求得分类决策函数:f(x)=sign(w^x·x+b^x)可知w^x,b^x只依赖训练数据中对应于{α_i}^x>0的样本点(x_i,y_i),⽽其他样本点对w^x,b^x没有影响。

简述向量机的基本原理及应用一、向量机的基本原理向量机(Support Vector Machine,简称SVM)是一种非常流行且强大的机器学习算法,广泛应用于分类和回归问题。

它基于统计学习理论中的结构风险最小化原则,通过最大化分类间隔来进行分类。

1. 支持向量机的概念在支持向量机中,将数据点看作特征空间(高维空间)中的点,将向量看作特征空间中的向量。

支持向量机通过划分特征空间,找到一个超平面(决策边界),将不同类别的数据点分开。

2. 线性可分支持向量机当数据点能够被一个超平面完全分离的时候,称为线性可分。

线性可分支持向量机的目标是找到一个最佳的超平面,使得正负样本点到该超平面的距离最大。

这个最佳的超平面称为最优划分超平面。

3. 线性不可分支持向量机在实际应用中,数据点往往不是完全线性可分的。

对于线性不可分的情况,可以使用核函数(Kernel Function)将低维非线性可分问题映射到高维空间,从而实现线性划分的目的。

二、向量机的应用支持向量机作为经典的机器学习算法,在许多领域得到了广泛的应用。

1. 图像分类支持向量机在图像分类中具有良好的性能。

通过将图像数据表示为高维向量,将其映射到特征空间中,支持向量机可以对图像进行分类,例如人脸识别和手写体数字识别。

2. 文本分类支持向量机在文本分类中也具有很高的准确率。

通过将文本数据表示为向量空间模型(Vector Space Model),将其映射到特征空间中,支持向量机可以对文本进行分类,例如垃圾邮件过滤和情感分析。

3. 金融预测支持向量机在金融预测中有广泛的应用。

对于股票市场、外汇市场和期权市场等金融市场的预测,支持向量机可以通过对历史数据的学习,预测未来的价格趋势,帮助投资者做出决策。

4. 生物信息学支持向量机在生物信息学中也得到了广泛的应用。

通过对基因序列等生物数据的分析,支持向量机可以对蛋白质结构、基因功能和突变预测等问题进行分类和预测,帮助科研人员进行生物信息学研究。

如何使用支持向量机进行多标签分类问题解决支持向量机(Support Vector Machine,SVM)是一种常用的机器学习算法,广泛应用于分类和回归问题。

在分类问题中,SVM能够有效地解决多标签分类问题,本文将介绍如何使用支持向量机进行多标签分类问题的解决。

一、多标签分类问题简介多标签分类问题是指一个样本可能同时属于多个类别的分类问题。

例如,对于一张包含猫、狗和鸟的图片,我们需要将其同时分类为“猫”、“狗”和“鸟”。

传统的分类算法通常只能处理单标签分类问题,无法应对多标签分类问题。

二、支持向量机的基本原理支持向量机是一种二分类模型,其基本原理是通过构建一个超平面,将不同类别的样本分开。

对于多标签分类问题,我们可以采用一对多(One-vs-Rest)的方法,将每个标签作为一个二分类问题进行处理。

三、数据预处理在使用支持向量机进行多标签分类问题解决之前,我们需要对数据进行预处理。

首先,需要将数据集划分为训练集和测试集。

其次,对数据进行特征提取和特征选择,以便提取出最能表征样本的特征。

四、特征编码在多标签分类问题中,标签通常是以二进制形式表示的,每个标签对应一个二进制位。

例如,对于三个标签的问题,可以用000、001、010、011等方式表示不同的标签组合。

因此,我们需要对标签进行编码,将其转化为二进制形式。

五、训练模型在训练模型之前,我们需要选择一个合适的核函数。

核函数在支持向量机中起到了非常重要的作用,能够将低维的特征映射到高维空间,从而使得样本更容易被分开。

常用的核函数包括线性核函数、多项式核函数和高斯核函数等。

六、模型评估在训练完成后,我们需要对模型进行评估。

常用的评估指标包括准确率、精确率、召回率和F1值等。

通过这些评估指标,我们可以了解模型的性能,并对其进行调优。

七、模型调优在使用支持向量机解决多标签分类问题时,我们可以通过调整参数来提高模型的性能。

常见的参数包括正则化参数C、核函数参数gamma等。

支持向量机算法原理支持向量机(SupportVectorMachine,SVM)是一种经典的机器学习算法,是指对二类分类问题,它可以确定一个最佳的线性决策边界,以最大限度地提高分类的准确率。

它将分类任务转换为一个凸二次规划问题,然后使用核函数扩展到非线性情况。

它被广泛应用于许多类型的学习任务,包括分类和回归。

1.持向量机的概念所谓支持向量机,是指一种经典的机器学习算法,用于解决二分类问题。

该算法总是朝着最大限度地改善结果的方向迭代,并将给定的数据集呈现为一个映射,以实现最佳的分类结果。

支持向量机算法的主要思想是,在样本空间中,将数据用线性分割法分为两个独立的子空间,从而获得较高的分类准确率。

2.持向量机的数学原理支持向量机的数学基础乃在于凸优化,它是在线性可分的情况下,使分类器的准确率最大化。

支持向量机算法可以将分类问题转换为一个凸二次规划问题,以求得最优解。

在这个规划问题中,我们要求最小化一个函数,使得能够将样本以最佳方式分开,以确定决策边界。

它需要求解最优化问题中的最大间隔,故而也被称之为最大间隔分类器,把这个问题的最优解称为支持向量(Support Vector)。

3.持向量机的分类a.性可分支持向量机:是用于解决线性可分的二分类问题的支持向量机,其中只有两个分类器,我们可以使用给定的数据集来找到一个线性分类器,这样就可以将样本点映射到不同的类。

b.性不可分支持向量机:是针对线性不可分的二分类问题的支持向量机,我们可以使用核函数将线性不可分的问题扩展到高维来获得线性可分的形式,这种类型的支持向量机也是使用类似的求解方法来构建的,但是通过将线性不可分的问题扩展到高维,它可以更好地描述数据。

c.分类支持向量机:是一种多类支持向量机,它可以用于解决多个分类问题,它可以用于分类要素的多分类以及多个分类分量的情况,这是一种非常有用的技术,在主机器学习任务中得到了广泛应用。

4.持向量机的优势a.持向量机算法不仅可以实现高准确率,而且运行时间短。

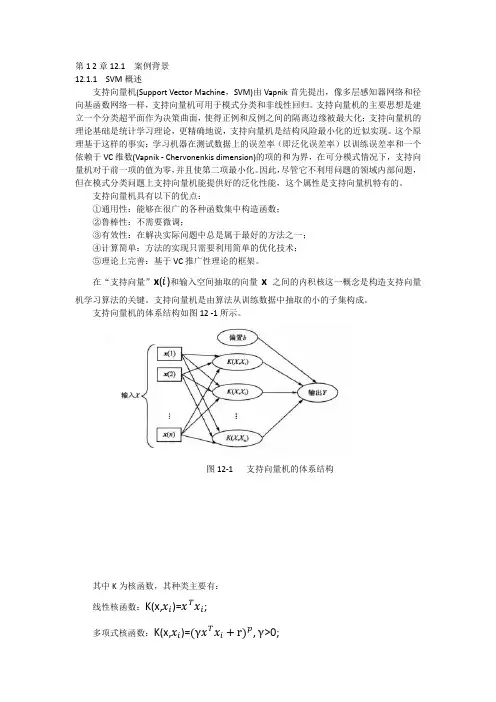

第1 2章12.1 案例背景12.1.1 SVM概述支持向量机(Support Vector Machine,SVM)由Vapnik首先提出,像多层感知器网络和径向基函数网络一样,支持向量机可用于模式分类和非线性回归。

支持向量机的主要思想是建立一个分类超平面作为决策曲面,使得正例和反例之间的隔离边缘被最大化;支持向量机的理论基础是统计学习理论,更精确地说,支持向量机是结构风险最小化的近似实现。

这个原理基于这样的事实:学习机器在测试数据上的误差率(即泛化误差率)以训练误差率和一个依赖于VC维数(Vapnik - Chervonenkis dimension)的项的和为界,在可分模式情况下,支持向量机对于前一项的值为零,并且使第二项最小化。

因此,尽管它不利用问题的领域内部问题,但在模式分类问题上支持向量机能提供好的泛化性能,这个属性是支持向量机特有的。

支持向量机具有以下的优点:①通用性:能够在很广的各种函数集中构造函数;②鲁棒性:不需要微调;③有效性:在解决实际问题中总是属于最好的方法之一;④计算简单:方法的实现只需要利用简单的优化技术;⑤理论上完善:基于VC推广性理论的框架。

在“支持向量”x(i)和输入空间抽取的向量x之间的内积核这一概念是构造支持向量机学习算法的关键。

支持向量机是由算法从训练数据中抽取的小的子集构成。

支持向量机的体系结构如图12 -1所示。

图12-1 支持向量机的体系结构其中K为核函数,其种类主要有:线性核函数:K(x,x i)=x T x i;多项式核函数:K(x,x i)=(γx T x i+r)p,γ>0;径向基核函数:K(x,x i )=exp(-γ∥x −x i ∥2), γ>0;两层感知器核函数:K(x,x i )=tanh(γx T x i+r )。

1.二分类支持向量机C - SVC 模型是比较常见的二分类支持向量机模型,其具体形式如下:1)设已知训练集:T ={(x 1,y 1),…,(x i ,y i )}∈(X ×Y )ι其中,x i ∈X =R n ,y i ∈Y ={1,-1}( i =1,2,…,ι);x i 为特征向量。

svm径向基核函数SVM(支持向量机)是一种非常有效的分类器,它使用一种称为“核函数”的技术将数据映射到高维空间中,并在该空间中找到最优的分类面。

SVM径向基核函数是一种广泛使用的核函数,它可以处理多维数据,并且具有非常好的性能和适用性。

简介SVM径向基核函数是一种基于局部相关性的分类器,它使用半径为r的函数将数据映射到高维空间中。

这个函数是一个高斯分布函数,它的形式是:k(x, x') = exp(-gamma ||x-x'||^2)其中,x和x'是数据点,gamma是参数,||x-x'||^2是向量的欧几里得距离的平方。

这个函数的意义是,两个数据点之间的距离越近,它们之间的相关性就越高。

因此,径向基函数可以用来处理非线性问题,它能够将数据点从低维空间映射到高维空间,使得它们在此空间中更容易分割。

工作原理SVM径向基核函数的工作原理是找到一个超平面,它能够将数据点分成两个不同的类别。

具体来说,这个超平面的形式是:f(x) = sign(wx+b)其中,x是数据点,w和b是SVM学习算法得到的权重和偏置量,sign()是一个符号函数,将wx+b的值映射到正或负的类别。

SVM的主要目标是找到一个最优的超平面,它与训练数据之间的间隔最大化,也就是说,它使得离超平面最近的数据点到其距离最大化。

理论上,如果数据的类别是线性可分的,那么SVM肯定可以找到一个超平面来完美地将它们分开。

但是,实际上,很多数据都是非线性可分的,这就需要使用径向基核函数将数据映射到高维空间中,然后在该空间中找到一个超平面来进行二分类任务。

在SVM训练过程中,径向基核函数的参数gamma是需要调整的。

如果gamma值太小,那么映射的空间会很大,这会导致SVM不能找到一个好的分割超平面。

如果gamma值太大,那么映射的空间会很小,这会导致SVM学习的模型过于复杂,容易出现过拟合的问题。

因此,需要通过交叉验证等方法来优化gamma参数的值。

pso-svm算法原理PSOSVM算法原理PSOSVM(Particle Swarm Optimization Support Vector Machine)是一种基于粒子群优化(PSO)的支持向量机(SVM)算法。

PSO算法是一种经典的全局优化算法,通过模拟鸟群或鱼群等生物群体行为,寻找最优解。

SVM算法是一种常用的机器学习算法,用于分类和回归问题。

PSOSVM算法结合了PSO算法的全局搜索能力和SVM算法的分类性能,能够在高维数据集中寻找到最佳的分类超平面。

下面将一步一步解释PSOSVM算法的原理。

1. 数据准备PSOSVM算法的输入是一个包含已知分类标签的训练数据集。

训练数据集由一组特征向量和相应的类标签组成。

特征向量描述了数据样本的特征,而类标签指示了每个样本的分类。

2. 初始化粒子群和SVM参数PSOSVM算法首先需要初始化粒子群,即一组粒子的初始位置和速度。

每个粒子代表了一个SVM模型的候选解。

粒子的位置表示了SVM模型的参数向量(例如权重向量和截距)的取值,而粒子的速度表示了参数向量的更新速度。

此外,初始化也需要设置PSO的参数,如惯性权重、加速度系数和迭代次数等。

这些参数决定了算法的搜索效率和精度。

3. 粒子运动和更新在PSOSVM算法中,粒子的运动可通过以下过程实现:- 计算粒子的适应度(即分类性能):根据当前粒子位置和速度,计算对应SVM模型的分类性能,通常使用交叉验证等方法评估。

- 更新粒子的最佳位置:比较当前粒子的适应度与历史最佳适应度,更新粒子的最佳位置,即当前拥有最好性能的SVM模型参数。

- 更新粒子的速度和位置:根据粒子自身的历史行为和群体最优行为,更新粒子的速度和位置。

这个过程使用加速度系数和随机数来控制粒子的移动速度和方向,以实现全局搜索。

- 限制粒子的位置和速度:为了保证SVM模型参数的可行解和避免搜索过程出现过度迭代,需要根据问题的约束条件限制粒子的位置和速度。

SVM入门介绍1.SVM的简介支持向量机(Support Vector Machine)提出时间、人物:1995年、Cortes和Vapnik优势:它在解决小样本、非线性及高维模式识别中表现出许多特有的优势,并能够推广应用到函数拟合等其他机器学习问题中原理基础:支持向量机方法是建立在统计学习理论的VC维理论(问题的复杂程度,VC维越高,一个问题就越复杂)和结构风险最小原理基础上的,根据有限的样本信息在模型的复杂性(即对特定训练样本的学习精度Accuracy)和学习能力(即无错误地识别任意样本的能力)之间寻求最佳折衷,以期获得最好的推广能力(或称泛化能力)。

真实风险:由两部分内容刻画一是经验风险,代表了分类器在给定样本上的误差;二是置信风险,代表了我们在多大程度上可以信任分类器在未知文本上分类的结果。

小样本:并不是样本的绝对数量少(实际上,对任何算法来说,更多的样本几乎总是能带来更好的效果),而是说与问题的复杂度比起来,SVM算法要求的样本数是相对比较少的。

非线性:指SVM擅长应付样本数据线性不可分的情况,主要通过松弛变量(也有人叫惩罚变量)和核函数技术来实现,这一部分是SVM的精髓。

高维模式识别:指样本维数很高。

由于SVM 产生的分类器很简洁,用到的样本信息很少(仅仅用到那些称之为“支持向量”的样本),使得即使样本维数很高,也不会给存储和计算带来大麻烦。

2.S VM之线性分类器线性分类器,如图所示(二维空间里仅有两类样本的分类问题):图之解释:C1和C2是要区分的两个类别,中间的直线就是一个分类函数,它可以将两类样本完全分开。

一般的,如果一个线性函数能够将样本完全正确的分开,就称这些数据是线性可分的,否则称为非线性可分的。

线性函数:一维空间里→一个点,二维空间里→一条直线三维空间里→一个平面如果不关注空间的维数,这种线性函数还有一个统一的名称—超平面(Hyper Plane)!一个线性函数是一个实值函数(即函数的值是连续的实数),而我们的分类问题需要离散的输出值,例如用1表示某个样本属于类别C1,而用0表示不属于,这时只需在实值函数的基础上附加一个阈值即可,通过分类函数执行时得到的值大于还是小于这个阈值来确定类别归属。

SVM拉格朗日乘子法引言支持向量机(Support Vector Machine,SVM)是一种具有广泛应用的非线性分类器。

其核心思想是通过构造一个最优的超平面,将不同类别的样本尽可能地分开。

在SVM的训练过程中,拉格朗日乘子法被广泛应用于解决优化问题。

SVM基本原理SVM的核心思想是在样本空间中找到一个超平面,将不同类别的样本分隔开。

对于二分类问题,我们可以定义超平面为:w⋅x+b=0其中,w是法向量,x是样本特征向量,b是截距。

对于线性可分的情况,我们可以找到无穷多个超平面,但是我们需要寻找一个最优的超平面,使得两个不同类别的样本距离该超平面的间隔最大。

这个间隔称为“间隔最大化”(maximum margin)。

函数间隔和几何间隔给定一个样本点(x i,y i),其中x i是样本特征向量,y i是样本的类别标签(y i∈{−1,1}),函数间隔f(x i)=y i(w⋅x i+b)。

若将超平面w⋅x+b=0按比例缩放,函数间隔的值也会相应地缩放。

为了消除可缩放性带来的影响,我们引入几何间隔(geometric margin),几何间隔定义为:γi=f(x i)∥w∥其中∥w∥是超平面的范数。

优化问题SVM的优化问题可以表达为:min w,b 12∥w∥2s.t. y i(w⋅x i+b)−1≥0,∀i这是一个二次优化问题,同时存在的不等式约束使得问题的求解变得困难。

为了解决这个优化问题,我们引入拉格朗日乘子法。

拉格朗日乘子法拉格朗日乘子法是一种优化方法,用于解决包含等式约束和不等式约束的优化问题。

它通过构造一个拉格朗日函数,将主问题转化为一个无约束优化问题。

对于我们的SVM优化问题,我们可以定义拉格朗日函数为:L(w,b,α)=12∥w∥2−∑αini=1[y i(w⋅x i+b)−1]其中,αi是拉格朗日乘子,用于对不等式约束进行惩罚。

通过求解拉格朗日函数的极小极大问题,我们可以得到原优化问题的最优解。

SVM⽀持向量机算法-原理篇本篇来介绍SVM 算法,它的英⽂全称是Support Vector Machine,中⽂翻译为⽀持向量机。

之所以叫作⽀持向量机,是因为该算法最终训练出来的模型,由⼀些⽀持向量决定。

所谓的⽀持向量,也就是能够决定最终模型的向量。

SVM 算法最初是⽤来解决⼆分类问题的,⽽在这个基础上进⾏扩展,也能够处理多分类问题以及回归问题。

1,SVM 算法的历史早在1963 年,著名的前苏联统计学家弗拉基⽶尔·⽡普尼克在读博⼠期间,就和他的同事阿列克谢·切尔沃宁基斯共同提出了⽀持向量机的概念。

但由于当时的国际环境影响,他们⽤俄⽂发表的论⽂,并没有受到国际学术界的关注。

直到 20 世纪 90 年代,⽡普尼克随着移民潮来到美国,⽽后⼜发表了 SVM 理论。

此后,SVM 算法才受到应有的重视。

如今,SVM 算法被称为最好的监督学习算法之⼀。

2,线性可分的 SVMSVM 算法最初⽤于解决⼆分类问题,下⾯我们以最简单的⼆维平⾯上的,线性可分的数据点来介绍⽀持向量机。

假设平⾯上有⼀些不同颜⾊的圆圈,这些圆圈是线性可分的,也就是可⽤⼀条直线分开。

如下:现在想在平⾯上画出⼀条直线,将这些圆圈分开。

通过观察,你很容易就能画出⼀条直线,如下:但是这样的直线会有很多,它们都能正确的划分两类圆圈,就像下⾯这幅图中的⼀样:那么哪条直线才是最好的呢?通过⾁眼我们⽆法找到那条最好的直线。

但是就上图中的三条直线⽽⾔,明显你会觉得中间那条红线,会⽐两侧的两条线要更好。

因为,如果有⼀些圆圈往中间靠拢,那么两侧的那两条直线就不能将两种圆圈划分开了。

⽽中间那条直线依然可以划分两种圆圈。

如下:因此,中间那条红线会⽐两侧的两条直线更好,更安全。

虽然通过⾁眼我们能知道哪条直线更好,但是怎样才能找到最好的那条直线呢?⽽ SVM 算法就可以帮我们找到那条最好的直线。

3,找到最好的直线下⾯我们来看下如何找到最好的那条直线。

支持向量机算法公式支持向量机(Support Vector Machine,SVM)是一种分类和回归分析的机器学习算法。

其目标是将不同的类别分开,以最大限度地提高分类的准确性。

SVM通过构建一个决策边界(决策平面)来实现分类。

决策边界是在将两个或多个不同的类别分开的空间中绘制的一条线或面。

SVM算法选择最大边缘(Margin)的边际超平面作为决策边界。

Margin是指分类器边界与分类器最近样本点之间的距离。

SVM算法的数学公式如下:对于样本 $(x_i, y_i), i = 1,2,...,n$,其中 $x_i$ 为样本特征向量, $y_i$ 为样本类别,其中 $y_i \in \{-1, +1\}$。

我们要找到如下形式的超平面:$$w^Tx + b = 0$$其中 $w$ 为超平面的法向量, $b$ 为超平面截距。

超平面将所有 $\{(x_i, y_i)\}$ 划分为两个部分,用 $\haty_i$ 来表示样本被分类之后的类别,那么:$$\hat y_i = \begin{cases} +1, & w^Tx_i+b > 0\\ -1, &w^Tx_i+b < 0 \end{cases} $$那么超平面分类器的分类结果可以表示为:$$f(x) = sign(w^Tx+b)$$其中 $sign$ 表示符号函数。

接下来,我们对 SVM 策略进行数学描述:1. 限制 $\{x_i\}$ 到超平面两侧,确保分类正确,即:$$\begin{cases}w^Tx_i+b \geq 1, & y_i = +1\\w^Tx_i+b \leq -1, & y_i = -1 \end{cases} $$2. 使 Margin 最大,即:$$Margin = \frac{2}{||w||}$$最终的目标优化问题可以表示为:$$\max_{w,b} \frac{2}{||w||}$$ $$s.t. \quad y_i(w^Tx_i+b) \geq 1, i=1,2,...,n$$由于最大化 $\frac{2}{||w||}$ 等价于最小化$\frac{1}{2}||w||^2$,因此可以用二次规划来求解该问题。

1、 数据分类算法基本原理 数据分类是数据挖掘中的一个重要题目。数据分类是指在已有分类的训练数据的基础上,根据某种原理,经过训练形成一个分类器;然后使用分类器判断没有分类的数据的类别。注意,数据都是以向量形式出现的,如<0.4, 0.123, 0.323,…>。 支持向量机是一种基于分类边界的方法。其基本原理是(以二维数据为例):如果训练数据分布在二维平面上的点,它们按照其分类聚集在不同的区域。基于分类边界的分类算法的目标是,通过训练,找到这些分类之间的边界(直线的――称为线性划分,曲线的――称为非线性划分)。对于多维数据(如N维),可以将它们视为N维空间中的点,而分类边界就是N维空间中的面,称为超面(超面比N维空间少一维)。线性分类器使用超平面类型的边界,非线性分类器使用超曲面。 线性划分如下图:可以根据新的数据相对于分类边界的位置来判断其分类。注意,我们一般首先讨论二分类问题,然后再拓展到多分类问题。以下主要介绍二分类问题。

2、 支持向量机分类的基本原理 支持向量机是基于线性划分的。但是可以想象,并非所有数据都可以线性划分。如二维空间中的两个类别的点可能需要一条曲线来划分它们的边界。支持向量机的原理是将低维空间中的点映射到高维空间中,使它们成为线性可分的。再使用线性划分的原理来判断分类边界。在高维空间中,它是一种线性划分,而在原有的数据空间中,它是一种非线性划分。 但是讨论支持向量机的算法时,并不是讨论如何定义低维到高维空间的映射算法(该算法隐含在其“核函数”中),而是从最优化问题(寻找某个目标的最优解)的角度来考虑的。 3、 最优化问题 我们解决一个问题时,如果将该问题表示为一个函数f(x),最优化问题就是求该函数的极小值。通过高等数学知识可以知道,如果该函数连续可导,就可以通过求导,计算导数=0的点,来求出其极值。但现实问题中,如果f(x)不是连续可导的,就不能用这种方法了。最优化问题就是讨论这种情况。 求最优解的问题可以分为两种:(1)无约束最优问题;(2)有约束最优问题。

无约束最优算法可以表达为:min()xfx。可以用数值计算方法中的牛顿法、最速梯度下降法等,通过多次循环,求得一次近似的最优解。 有约束问题,一般表达为:

min()..()0{1,2,,}nxifxxEstxim

4、 线性可分的二分类问题 线性可分的二分类问题是指:原数据可以用一条直线(如果数据只有二维)或一个超平面划分开。用一个多维空间中的超平面将数据分隔为两个类有三种基本方法: (1) 平方最近点法:用两类点中最近的两点连线的平分线作为分类线(面) (2) 最大间隔法:求分类面,使分类边界的间隔最大。分类边界是值从分类面分别向两个类的点平移,直到遇到第一个数据点。两个类的分类边界的距离就是分类间隔。

分类平面表示为:()0wxb。注意,x是多维向量。分类间隔的倒数为:

212w。所以该最优化问题表达为:

2,1min,2..(())1)1,1,,wb

ii

w

stywxbil

其中的约束是指:要求各数据点(,)iixy到分类面的距离大于等于1。其中,i

y

为数据的分类。 (3) 线性支持向量分类机:

1111()0.1min(),2..00lllijijijjijjliiiiwxbyyxxsty

分类面:要求:

据此求出*(最优解,算法另述)后: **1liiiiwyax,*1()ljiiijibyyxx

说明:线性支持向量机是基于最大间隔法的。该问题是一个二次规划问题,使用拉格朗日函数合并优化问题和约束,再使用对偶理论,得到上述的分类优化问题。需要注意的是,该问题仍然是一个有约束的最优化问题。 5、 线性不可分问题

2,1min||||, (1.2.1)2s.t.(())1,1,, (1.2.2)wb

ii

wywxbil

(1)线性软间隔分类机 基本思路:由于样本线性不可分,原来对间隔的要求不能达到。引入松弛变量ξi,使约

束条件弱化为:(())1)1iiiywxb。但是,我们仍然希望该松弛变量ξi最小化(如果ξi=0,则就是原线性硬间隔分类机)。于是,在优化目标函数中使用惩罚参数C来引入对ξi最小化的目标。这样,该分类机的模型为:

2,1()0.1min,2..(())1)1,1,,liwbiiiiwxbwCstywxbil

分类面:要求:

以此为原问题,其对偶问题为: 1111***111min(),2..00,()lllijijijjijjliiiilliiijiiijiiyyxxstyCwyaxbyyxx

(2)非线性硬间隔分类机 基本思路是:可以将低维空间中的曲线(曲面)映射为高维空间中的直线或平面。数据

经这种映射后,在高维空间中是线性可分的。设映射为:()xx,则高维空间中的线性支持向量机模型为:

1111()0.1min(()()),2..00lllijijijjijjliiiiwxbyyxxstyC

分类面:要求:

需要注意的是,由于数据被映射到高维空间,()()ijxx的计算量比ijxx大得多。此时引入了所谓“核函数”: (,)()()ijijKxxxx

由上式可见,核函数的作用是,在将x映射到高维空间的同时,也计算了两个数据的在高维空间的内积,使计算量回归到ijxx的量级。 (3)非线性软间隔分类机(C-支持向量分类机) 非线性硬间隔分类机虽然将训练数据映射到高维空间中,但核函数的选择只有几种,它们并不能保证在任何情况下都可以将训练数据映射到足够高的维度,以使它们成为线性可分的。因此,有理由在此基础上引入线性软间隔分类机中的松弛变量。这样,原问题为:

112,1{(,),(,)} ()()0. 1min,2..(())1)1,1,,llii

liwbiiiiTxyxyxxwxbwCstywxbil

映射: 其中:分类面:,

其对偶问题为: 1111**1**1min(,),2..00(,)()sgn(,)lllijijijjijjliiiiljiiijiiiiyyKxxstyCbyyKxxfxyKxxb

这种支持向量机是最常用的。 (4)ν-支持向量机分类机 C-支持向量机中的惩罚参数C难以选取。选择大的C是强调最小化训练错误;选择较小的C是强调最大化分类间隔。 ν-支持向量机分类机的原始问题:

2,,,111 min,2..(()), 0, 1,, 0liwbiiiiiwlstywxbil

其对偶问题为: 1111**1**11min(,),2..0101(,)(,),2()sgn(,)llijijijijliiiiliiliiijikiliiiiyyKxxstylbyKxxKxxjkfxyKxxb

一个正类样本,一个负类样本

6、 多分类问题 (1) 一类对余类方法: 建立将一类与其余类分开的支持向量机。如,训练数据有M类,则需要建立M个支持向量机。识别x分类时,选择gj(x)最大的分类:

1()sgn(()),[1,]()(,)jjljjjiiiifxgxjMgxyKxxb

或者:计算两个最大的g的差,作为置信度。如果Δg>θ,则选择g最大的类;反之,拒绝分类。 (2) 成对分类 建立M个类中任意两个类之间的分类器,共M(M-1)/2个分类器。识别x分类时采用投票方法,得票最多的类为x的最终分类。 7、 支持向量模型的求解 从上述各种支持向量机的对偶问题表示可以看出,它们都是约束优化问题。即在一定的约束下,求解最优(极小)。 约束优化问题一般都转换为无约束优化问题进行求解。光滑无约束问题的求解方法一般有梯度下降法、牛顿法等。非光滑无约束问题可以转换为近似的光滑无约束问题。

8、 整理svmlib (1) 输入、输出方便(数据格式); (2) 可以在各种情况下使用(库) (3) 方便修改svm算法 (4) SVM实验由KNN人员进行。