神经网络与回归方法分析(数学建模)

- 格式:doc

- 大小:1000.50 KB

- 文档页数:25

基于神经网络的回归模型优化技术研究一、引言神经网络是一种能够通过对输入数据的学习,来自动发现数据特征,并进行预测和分类的可调节函数逼近器。

被广泛应用于各种领域的模型构建和数据分析。

在实际应用中,回归模型是神经网络的重要组成部分,其可以有效地拟合不同经验数据中的趋势,并对未知点进行精准的预测。

然而,优化回归模型在实际应用中面临诸多困难,需要综合考虑多种因素,提高网络的泛化能力和拟合能力。

二、基于神经网络的回归模型基于神经网络的回归模型主要就是将神经网络的输出映射到某个实数或实数域上,从而实现对于连续性的因变量进行预测的功能。

在回归模型中,我们假设有一个输入向量x和一个输出向量y,神经网络通过学习x和y之间的映射关系,建立输入x到输出y的函数模型。

三、回归模型优化技术研究为了优化回归模型,我们需要对模型进行深入分析和探究,从多种因素入手优化。

以下是回归模型优化技术的具体研究。

1、特征选择正确选择特征是优化回归模型的首要问题。

特征的选择考虑到特征之间的相关性,以及特征对结果的影响。

此外,需要注意特征数量,过多的特征会导致维度灾难。

2、超参数的选择超参数的选择影响到神经网络的拟合能力和泛化能力。

超参数的选择一般包括激活函数的选择、学习率的设置、网络深度与宽度、正则化与损失函数等。

3、早停法早停法是避免神经网络过拟合的一种方法。

通过计算交叉验证误差和训练误差来决定何时停止训练。

当两个误差的差值达到设定的阈值时,停止训练。

4、改进算法改进算法主要包括改进训练算法和改进权值初始化算法。

改进算法能够在保证模型精度的同时,提高训练速度。

5、模型融合模型融合是将多个不同的模型进行组合,降低训练误差和测试误差。

模型融合可以通过堆叠或投票的方法实现。

6、数据集预处理数据集预处理是通往高精度预测模型的必要途径。

包括缺失数据的填充、数值型数据的标准化、类别型数据的编码等。

四、实验结果分析我们在UCI数据集上进行了实验,结果表明,选取10个特征,使用ReLU激活函数,Adam作为优化算法,使用L1正则化和Batch Normalization等技术,最终获得了86.23%的测试集精度。

神经网络在非线性回归中的应用摘要:本文主要介绍了神经网络在非线性回归中的应用,实例证明其回归效果优于传统的回归方法。

但是标准BP算法具有收敛速度慢、易陷入局部极小点等缺陷,于是又介绍一种改进的神经网络学习算法,并进行了仿真,证明了该算法的有效性。

关键词:非线性回归;神经网络; BP算法The application of Neural Network inNonlinear-RegressionYingli Tang(Computer Science and Technology ,School of Information ,Shanghai Ocean University,China) Abstract:This paper mainly introduces the application of neural net in nonlinear regression,examples show its regression effect is superior to the traditional regression method.But the standard BP algorithm has show convergence speed,easy to fail into local minimum point and other defects,so introduced an improved neural net learning algorithm and a simulation was carried out,it prove the effectiveness of the proposed algorithm.Keywords: non-linear regression; neural net;BP algorithm1引言回归分析就是确立和分析某种响应(因变量Y)和重要因素(对响应有影响的自变量X)之间的函数关系。

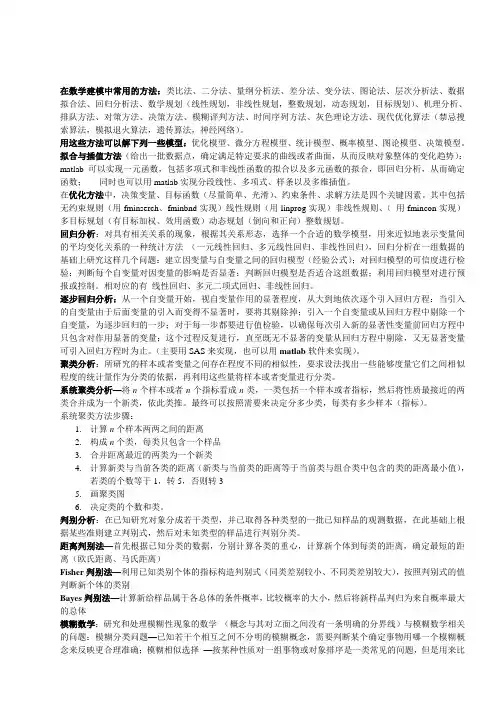

在数学建模中常用的方法:类比法、二分法、量纲分析法、差分法、变分法、图论法、层次分析法、数据拟合法、回归分析法、数学规划(线性规划,非线性规划,整数规划,动态规划,目标规划)、机理分析、排队方法、对策方法、决策方法、模糊评判方法、时间序列方法、灰色理论方法、现代优化算法(禁忌搜索算法,模拟退火算法,遗传算法,神经网络)。

用这些方法可以解下列一些模型:优化模型、微分方程模型、统计模型、概率模型、图论模型、决策模型。

拟合与插值方法(给出一批数据点,确定满足特定要求的曲线或者曲面,从而反映对象整体的变化趋势):matlab可以实现一元函数,包括多项式和非线性函数的拟合以及多元函数的拟合,即回归分析,从而确定函数;同时也可以用matlab实现分段线性、多项式、样条以及多维插值。

在优化方法中,决策变量、目标函数(尽量简单、光滑)、约束条件、求解方法是四个关键因素。

其中包括无约束规则(用fminserch、fminbnd实现)线性规则(用linprog实现)非线性规则、(用fmincon实现)多目标规划(有目标加权、效用函数)动态规划(倒向和正向)整数规划。

回归分析:对具有相关关系的现象,根据其关系形态,选择一个合适的数学模型,用来近似地表示变量间的平均变化关系的一种统计方法(一元线性回归、多元线性回归、非线性回归),回归分析在一组数据的基础上研究这样几个问题:建立因变量与自变量之间的回归模型(经验公式);对回归模型的可信度进行检验;判断每个自变量对因变量的影响是否显著;判断回归模型是否适合这组数据;利用回归模型对进行预报或控制。

相对应的有线性回归、多元二项式回归、非线性回归。

逐步回归分析:从一个自变量开始,视自变量作用的显著程度,从大到地依次逐个引入回归方程:当引入的自变量由于后面变量的引入而变得不显著时,要将其剔除掉;引入一个自变量或从回归方程中剔除一个自变量,为逐步回归的一步;对于每一步都要进行值检验,以确保每次引入新的显著性变量前回归方程中只包含对作用显著的变量;这个过程反复进行,直至既无不显著的变量从回归方程中剔除,又无显著变量可引入回归方程时为止。

数学建模:用线性回归模型进行预测分析1. 概述数学建模是一种利用数学方法和技巧来解决实际问题的过程。

其中,线性回归模型是最常用的预测分析方法之一,旨在建立一个线性关系来解释自变量(特征)与因变量(目标)之间的关系。

2. 线性回归模型基本原理线性回归模型是基于线性假设,即自变量与因变量之间存在线性关系。

它通过最小化残差平方和来估计自变量对因变量的影响,并确定最佳拟合直线。

2.1 数据集准备在构建线性回归模型之前,需要准备好相关数据集。

数据集应包含自变量和因变量,其中自变量可以是多维的。

2.2 模型训练使用训练集上的数据来训练线性回归模型。

训练过程通过求解最小二乘法方程得到一组最佳参数值。

2.3 模型评价为了评估线性回归模型的准确性,需要使用测试集上的数据进行预测,并计算预测值与真实值之间的误差。

常用指标包括均方误差(MSE)和决定系数(R-squared)等。

3. 线性回归模型的应用场景线性回归模型可以应用于各种预测分析场景。

以下是一些常见的应用场景:3.1 经济学线性回归模型在经济学中常用于预测经济指标,例如GDP、通货膨胀率等。

通过建立一个线性关系,可以帮助经济学家进行政策制定和市场分析。

3.2 市场营销线性回归模型可以用于市场营销领域的广告效果预测、顾客购买意愿预测等。

通过分析不同因素对销售额的影响,可以制定更有效的市场推广策略。

3.3 医疗研究线性回归模型在医疗研究领域广泛应用。

它可以用来预测患者治疗效果、药物剂量与效果之间的关系等,为医生提供决策支持。

4. 线性回归模型的优缺点线性回归模型具有以下几个优点: - 易于理解和解释,模型结果可以直接转化为解释性语言。

- 计算速度快,适用于大规模数据集。

- 可以通过添加交互项和多项式特征来扩展模型的适应能力。

然而,线性回归模型也存在一些缺点: - 对于非线性关系的建模效果较差。

- 对异常值和离群点敏感。

- 对特征之间的相关性较为敏感,可能导致多重共线性问题。

摘要Hopfield神经网络是神经网络发展历史上的一个重要发展阶段,它成功地解决了TSP计算难题。

Hopfield神经网络是一种反馈型神经网络,它的稳定形态比前向型网络要繁杂得多。

Hopfield神经网络分为离散型和连续型两种网络模型,Hopfield神经网络模型具有高效性和稳定性,但是Hopfield神经网络算法是一种贪心算法,是通过寻找局部最优解来达到全局解,但是这个全局解不一定为全局最优解,所以本文尝试对此进行改进,以达到最优解,避免不足之处。

本文介绍了Hopfield神经网络在数学建模中的应用,运用Hopfield神经网络算法求解智能RGV的动态调度优化问题。

关键词:Hopfield神经网络算法;TSP问题;智能RGV动态调度。

目录1 引言………………………………………………………………………………P12 Hopfield神经网络的基本理论…………………………………………………P1 2.1 离散型Hopfield神经网络算法的定义及特性………………………………P1 2.2 连续型Hopfield神经网络算法的定义及特性………………………………P32.3 Hopfield网络当前的研究成果………………………………………………P53 Hopfield神经网络在数学建模中的应用…………………………………… P6 3.1Hopfield神经网络求解TSP…………………………………………………P6 3.2 应用举例:智能RGV的动态调度优化研究…………………………………P7 3.2.1问题重述……………………………………………………………………P8 3.2.2问题分析…………………………………………………………………… P9 3.2.3问题假设……………………………………………………………………P10 3.2.4符号说明……………………………………………………………………P10 3.2.5模型的建立与求解…………………………………………………………P12 3.2.6检验模型的实用性和算法有效性…………………………………………P163.2.7模型的评价与推广…………………………………………………………P164 Hopfield神经网络的发展展望………………………………………………P17致谢…………………………………………………………………………………P17 参考文献……………………………………………………………………………P18 附录A Hopfield神经网络模型代码…………………………………………… P19Hopfield神经网络算法在数学建模中的应用1 引言Hopfield神经网络是神经网络发展历史上的一个重要的里程碑。

基于神经网络和相关性分析的数学建模思路分享神经网络是一种由人工神经元构成的系统,模拟了生物神经系统的工作方式。

相关性分析是一种数学方法,用于确定变量之间的关联程度。

将这两种方法相结合,可以建立一个能够对数据进行分析和预测的数学模型。

首先,需要明确研究的问题。

例如,我们可以考虑一个销售数据的问题,目标是预测销售额与其他变量之间的相关性。

第二步是收集数据。

我们需要收集与销售相关的数据,例如销售额、广告投入、季节因素等。

这些数据应该包括足够多的样本,以便建立准确的模型。

接下来,我们将使用神经网络来建立一个预测模型。

神经网络由多个层次组成,每个层次包含多个神经元。

每个神经元通过与其他神经元进行连接,并通过非线性函数进行计算,以生成模型的输出。

我们可以通过训练神经网络,使其在给定输入下能够产生预测输出。

神经网络的训练可以通过反向传播算法来实现。

该算法通过将模型的预测结果与实际结果进行比较,并根据比较结果来更新模型的权重。

重复这个过程,直到模型的预测结果接近实际结果为止。

在训练神经网络之后,我们可以使用相关性分析来评估模型的准确性。

相关性分析可以通过计算相关系数来实现,例如皮尔逊相关系数和斯皮尔曼相关系数。

相关系数的取值范围为-1到1,接近1表示正相关,接近-1表示负相关,接近0表示无相关性。

最后,我们可以使用模型进行预测和分析。

通过输入新的数据,我们可以使用训练好的神经网络模型来预测未来的销售额,并根据相关性分析来评估其他变量对销售额的影响。

总结起来,基于神经网络和相关性分析的数学建模思路包括:明确问题、收集数据、构建神经网络模型、训练模型、评估模型准确性、预测和分析。

这种方法能够处理多变量之间的复杂关系,并提供准确的预测结果。

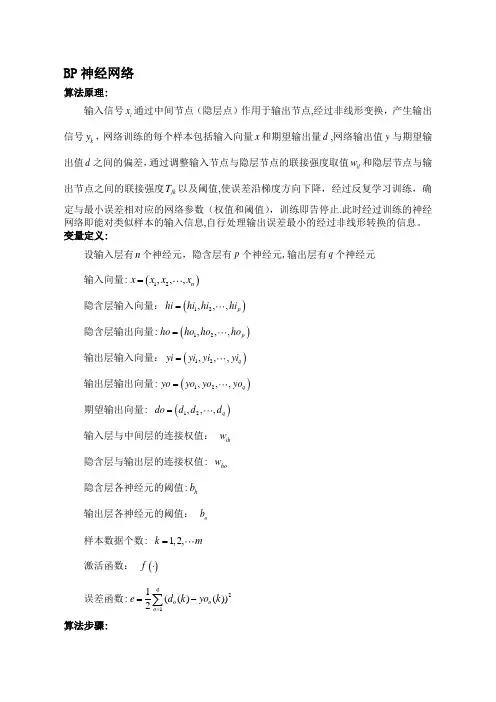

BP 神经网络算法原理:输入信号i x 通过中间节点(隐层点)作用于输出节点,经过非线形变换,产生输出信号k y ,网络训练的每个样本包括输入向量x 和期望输出量d ,网络输出值y 与期望输出值d 之间的偏差,通过调整输入节点与隐层节点的联接强度取值ij w 和隐层节点与输出节点之间的联接强度jk T 以及阈值,使误差沿梯度方向下降,经过反复学习训练,确定与最小误差相对应的网络参数(权值和阈值),训练即告停止.此时经过训练的神经网络即能对类似样本的输入信息,自行处理输出误差最小的经过非线形转换的信息。

变量定义:设输入层有n 个神经元,隐含层有p 个神经元,输出层有q 个神经元 输入向量:()12,,,n x x x x =隐含层输入向量:()12,,,p hi hi hi hi = 隐含层输出向量:()12,,,p ho ho ho ho = 输出层输入向量:()12,,,q yi yi yi yi = 输出层输出向量:()12,,,q yo yo yo yo =期望输出向量: ()12,,,q do d d d =输入层与中间层的连接权值: ih w 隐含层与输出层的连接权值: ho w 隐含层各神经元的阈值:h b 输出层各神经元的阈值: o b 样本数据个数: 1,2,k m =激活函数: ()f ⋅误差函数:211(()())2qo o o e d k yo k ==-∑算法步骤:Step1.网络初始化 。

给各连接权值分别赋一个区间(—1,1)内的随机数,设定误差函数e ,给定计算精度值ε和最大学习次数M 。

Step2。

随机选取第k 个输入样本()12()(),(),,()n x k x k x k x k =及对应期望输出()12()(),(),,()q d k d k d k d k =oStep3。

计算隐含层各神经元的输入()1()()1,2,,nh ih i h i hi k w x k b h p ==-=∑和输出()()(())1,2,,h h ho k f hi k h p ==及输出层各神经元的输入()1()()1,2,po ho h o h yi k w ho k b o q ==-=∑和输出()()(())1,2,,o o yo k f yi k o p ==Step4。

数学建模常用模型方法总结无约束优化线性规划连续优化非线性规划整数规划离散优化组合优化数学规划模型多目标规划目标规划动态规划从其他角度分类网络规划多层规划等…运筹学模型(优化模型)图论模型存储论模型排队论模型博弈论模型可靠性理论模型等…运筹学应用重点: ①市场销售②生产计划③库存管理④运输问题⑤财政和会计⑥人事管理⑦设备维修、更新和可靠度、项目选择和评价⑧工程的最正确化设计⑨计算器和讯息系统⑩城市管理优化模型四要素:①目标函数②决策变量③约束条件④求解方法(MATLAB--通用软件 LINGO--专业软件)聚类分析、主成分分析因子分析多元分析模型判别分析典型相关性分析对应分析多维标度法概率论与数理统计模型假设检验模型相关分析回归分析方差分析贝叶斯统计模型时间序列分析模型决策树逻辑回归传染病模型马尔萨斯人口预测模型微分方程模型人口预测控制模型经济增长模型Logistic 人口预测模型战争模型等等。

灰色预测模型回归分析预测模型预测分析模型差分方程模型马尔可夫预测模型时间序列模型插值拟合模型神经网络模型系统动力学模型(SD)模糊综合评判法模型数据包络分析综合评价与决策方法灰色关联度主成分分析秩和比综合评价法理想解读法等旅行商(TSP)问题模型背包问题模型车辆路径问题模型物流中心选址问题模型经典 NP 问题模型路径规划问题模型着色图问题模型多目标优化问题模型车间生产调度问题模型最优树问题模型二次分配问题模型模拟退火算法(SA)遗传算法(GA)智能算法蚁群算法(ACA)(启发式)常用算法模型神经网络算法蒙特卡罗算法元胞自动机算法穷举搜索算法小波分析算法确定性数学模型三类数学模型随机性数学模型模糊性数学模型。

多元回归与神经网络的应用摘要本文主要是通过整理分析数据,以得出题目中所给出的i x 与j y 的函数关系.由于数据并不是很充足,我们选择了所有数据为样本数据和部分数据为验证数据。

我们首先采用了多元回归方法,由于数据之间并没有明显的线性或者其它函数关系,模型很难选择,得到的结论对于1y 来说残值偏大,效果很差,于是我们引用了BP 神经网络,经过选择合适的参数,多次训练得到合适的网络,拟合得到了相对精确的结果,并进行了验证,最后将三种模型进行了对比。

关键字: 多元线性回归 多元非线性回归 最小二乘法 牛顿法 BP 神经网络1.问题重述现实生活中,由于客观事物内部规律的复杂性及人们认识程度的限制,人们常收集大量的数据,基于数据的统计分析建立合乎基本规律的数学模型,然后通过计算得到的模型结果来解决实际问题.回归分析法和神经网络是数学建模中常用于解决问题的有效方法.本文要解决的主要问题是:通过对所给数据的分析,分别用回归方法或神经网络来确立x i 与y i之间的函数关系,并验证结论。

2.问题分析题目要求我们使用神经网络或回归方法来做相关数据处理,相比较之下,我们对回归方法比较熟悉,所以首先选取了回归方法。

得到相关函数,并分析误差,再利用神经网络模型建立合理的网络,进行误差分析并和前者比较,得出合理的结论。

3.符号说明4.模型建立与求解4.1多元回归方法它是研究某个变量与另一些变量的函数关系.主要内容是从一组样本数据出发,通过合理分析得到正确的函数关系,建立相应的表达式,并通过相关软件处理得到相应的系数。

4.1.1多元线性回归方法1.回归模型的一般形式为:Y=01122...m m X X X ββββε+++++其中01,,...,m βββ是待估计参数,e 是随机误差即残差。

残差ε服从均数为0,方差为2σ的正态分布。

这就是线性回归的数学模型。

12Y y y ⎧⎫⎪⎪=⎨⎬⎪⎪⎩⎭,X =1114491494501504111x x x x xx ⎛⎫ ⎪ ⎪⎪⎪ ⎪ ⎪ ⎪⎝⎭,01234ββββββ⎛⎫⎪ ⎪⎪ ⎪= ⎪ ⎪ ⎪⎪ ⎪⎝⎭,12εεε⎛⎫= ⎪⎪⎝⎭, 那么多元线性回归数学模型可也写成矩阵形式:Y X βε=+ 其中ε的分量是独立的。

2.参数β的最小二乘估计.为了估计参数β,我们采用最小二乘估计法.设014,,...,b b b 分别是参数014,,...,βββ的最小二乘估计,则回归方程为^01144...y b b x b x =+++由最小二乘法知道,014,,...,b b b 应使得全部观察值y α与回归值^y α的偏差平方和Q 达到最小,即使2^Q y y ααα=⎛⎫-∑⎪⎝⎭=最小所以Q 是014,,...,b b b 的非负二次式,最小值一定存在。

根据微积分中的极值原理,014,,...,b b b 应是下列正规方程组的解:^^20,20,j jQQ y yb y y x b αααααααδδδδ⎛⎫ ⎪=--= ⎪⎝⎭⎛⎫ ⎪=--= ⎪⎝⎭∑⎧⎨⎩∑显然,正规方程组的系数矩阵是对称矩阵,用A 来表示,则'A X X =,则其右端常数项矩阵B 亦可以用矩阵X 和Y 来表示:'B X Y =,所以可以得到回归方程的回归系数:()11''b A B X X X Y --==3.由于利用偏回归方程和i Q 可以衡量每个变量在回归中所起的作用大小(即影响程度),设h S 是p 个变量所引起的回归平方和,1hS 是(p-1)个变量所引起的回归平方和(即除去i x ),则偏回归平方和i Q 为12*pj j h j ij iii jhb Q b S Sb B B c==-=-=∑∑就是去掉变量i x 后,回归平方和所减少的量。

4.建立模型453423121x b x b x b x b b y i ⨯+⨯+⨯+⨯+=5.模型的求解我们通过MATLAB ,求得其回归系数,并最终得到i x 与i y 的函数关系:1234112342339.849916.811411.548967.541415.5485,164.55800.1874 1.797629.972812.4426,y x x x x y x x x x ⎧=-++-⎪⎨=-+-++⎪⎩ 同时通过MATLAB 可以得出i x 与i y 的误差结果如下:由此,我们可得出结论,采用多元线性回归得出的函数关系对于1y 残差太大,效果很差,对于2y 的拟合也并不是很完美。

4.1.2非线性回归方法1.数据标准化我们选用的是非线性模型LSE 的Gauss-Newton 算法:采用Z-score 标准化法,即对序列12,,...,m x x x 进行变换:iisx x y --=, (1其中,11Nii Nx x -==∑,2111N i s i N x x =-=-⎛⎫-∑ ⎪⎝⎭,则构成新序列,均值为0,方差为1.。

首先考虑单参数的非线性回归模型: (),iiifx Yβε=+其残差平方和函数为()()21,N i S i i f Y X ββ==-⎡⎤∑⎣⎦要使()S β取极小值,则令其一阶导数为0,来求β.一个近似的方法是用Taylor 近似展开来代替。

设β的初值为1β,则在1β点附近函数有近似Taylor 展式:()()()()111,,,iiidfff d X X X βββββββ≈+-可以求的其导数值,简记为: ()()11,iidfd X Z ββββ=∣则()()()()()()221111111,.NNi i S i i i i i f Y X Z Y Z ββββββββ====⎡⎤⎡⎤----∑∑⎢⎥⎣⎦⎣⎦即为线性回归()()11.iii Z Y βββε=+的残差和.上式被称为拟线性模型.其最小二乘估计是)()()]()([)()()(1~'111'1211111~2ββββββββY Z Z Z Z Z Y ni ini ii-===⋅=∑∑如果我们有β的初值,就可以得到另一个新值,进而可以得到一个序列,写出一个迭代表达式,即1n β+与nβ的关系。

若在迭代过程中有1n β+=nβ,即()S β的一阶导数为0,此时()S β取得一个极值。

为了避免迭代时间过长或迭代来回反复,可以引入进步长控制函数nt,'11[Z()Z()]nn n n n n dSt d ββββββ-+=-'1'2[Z()Z()]()[Y (X,)]n n n n n n t Z f βββββ-=--nt由计算机程序根据误差自动调整.上述算法一般称为Gauss-Newton 算法.2.建立非线性回归模型:采用多元二次多项式函数 设函数:22112233445161271381492102312211241231334144y b b x b x b x b x b x b x x b x x b x x b x b x x b x x b x b x x b x=++++++++++++++通过Gauss-Newton 算法和MATLAB 计算最终得出以下结果:212341121221314223243342412212575.940129.457127.81901597.99601695.57780.87100.466535.3093 2.1549 1.289824.79770.912131.894694.336757.08592483.447814.5988 5.8585y x x x x x x x x x x x x x x x x x x x x y x x =--+-++--+-++++-=--234112221314223243342412.5802302.89100.48880.09558.72100.49710.2123 3.04590.141024.6923 5.203310.1871x x x x x x x x x x x x x x x x x x ⎧⎪⎪⎪⎪⎪⎨+-++⎪⎪⎪+-+--+-⎪⎪+⎩通过MATLAB 编写相应程序所得结果如下:12,y y的残差图由图可以明显看出误差很大,拟合效果不好。

综合多元非线性和多元线性这两种模型,我们可以发现y1并不适合这两种模型,y2模拟相对较好,但误差并没有足够小,不再我们的预期效果之内。

于是我们采用了BP 神经网络。

4.2神经网络4.2.1模型的原理BP (Back Propagation)神经网络是一种多层前馈神经网络。

其由输入层、中间层、输出层组成的阶层型神经网络,中间层可扩展为多层。

相邻层之间各神经元进行全连接,而每层各神经元之间无连接,网络按有教师示教的方式进行学习,当一对学习模式提供给网络后,各神经元获得网络的输入响应产生连接权值(Weight ),隐含层神经元将传递过来的信息进行整合,通常还会在整合过程添加一个阈值,这是模仿生物学中神经元必须达到一定阈值才会触发的原理。

输入层神经元数量由输入样本的维数决定,输出层神经元数量由输出样本的维数决定,隐藏层神经元合理选择。

然后按减小希望输出与实际输出误差的方向,从输出层经各中间层逐层修正各连接权,回到输入层。

此过程反复交替进行,直至网络的全局误差趋向给定的极小值,即完成学习的过程。

BP 网络的核心是数学中的“负梯度下降”理论,即BP 的误差调整方向总是沿着误差下降最快的方向进行。

.相关传递函数(或激励函数):阈值型(一般只用于简单分类的MP 模型中)0,0()1,0x f x x <⎧=⎨>=⎩线性型(一般只用于输入和输出神经元) ()f x x = S 型(常用于隐含层神经元)1()1xf x e -=+ 或 1()1x x e f x e ---=+BP 神经网络模型通常还会在激励函数的变量中耦合一个常数以调整激励网络的输出幅度。

4.2.2 模型的建立与求解步骤1、准备训练网络的样本我们此次的BP网络是一个4输入2输出的网络,如下表所示:步骤2、确定网络的初始参数步骤3、初始化网络权值和阈值因为是4个输入因子8个隐含层神经元,则第一层与第二层之间的权值w(t)ij ⨯的随机数矩阵:为84[-0.044 0.325 -0.099 0.149-0.031 0.180 0.332 0.3500.2393 0.364 0.206 0.1870.1475 0.248 0.394 0.322-0.005 0.191 0.163 0.269 0.1475 0.307 0.139 0.192 -0.026 0.339 0.300 0.023 -0.072 0.394 0.013 0.233]神经网络的阈值是用来激活神经元而设置的一个临界值,有多少个神经元就会有多少个阈值,则第二层神经元的阈值(t)ij B 为81⨯ 的矩阵: [-0.0580.212 0.230 0.264 0.345 0.391 0.284 0.190]T同理,第二层与第三层之间的权值(t)jk w 为28⨯ 的随机数矩阵: [0.364 -0.091 0.331 0.322 0.176 -0.084 0.081 0.144 0.190 -0.039 0.142 0.004 0.214 0.20 -0.075 -0.003] 同理,第三层阈值(t)jk B 为21⨯ 的矩阵:[-0.038 0.002] 步骤4、计算第一层神经元的输入与输出假设第一层神经元中放置的是线性函数,所以网络第一层输入和输出都等于实际输入样本的值, 所以第一层输出值1O =X 。