隐马尔可夫模型

- 格式:doc

- 大小:113.00 KB

- 文档页数:7

隐马尔可夫模型可以解决哪些问题

隐马尔可夫模型(Hidden Markov Model, HMM)是一种时序数据的概率模型,它通过观察到的序列来推断隐含的状态序列。

它最大的特点就是它是一个生成模型,也就是说它从观测序列出发,去推断隐含状态序列。

隐马尔可夫模型可以用来解决很多问题,例如:

1. 语音识别:HMM 可以用来识别不同语音,并将其转换为文本。

2. 文本分类:HMM 可以用于对文本进行分类,以便将文本归类到不同的类别中。

3. 语言建模:HMM 可以用来建模不同的语言,以便根据语言的结构来判断句子的正确性。

4. 文字识别:HMM 可以用于识别手写文字,并将其转换为文本。

5. 生物信息学:HMM 可以用来分析 DNA 序列,以发现基因、调控因子和其他特征。

隐马尔可夫模型的基本用法隐马尔可夫模型(HiddenMarkovModel,HMM)是一种用于描述随机过程的概率模型,它在自然语言处理、语音识别、生物信息学、金融分析等领域得到了广泛应用。

本文将介绍隐马尔可夫模型的基本概念、数学表达、参数估计、解码算法等内容,希望对读者理解和应用该模型有所帮助。

一、隐马尔可夫模型的基本概念隐马尔可夫模型是一个二元组(Q, O, A, B, π),其中:Q = {q1, q2, …, qN}是状态集合,表示模型中可能出现的所有状态;O = {o1, o2, …, oT}是观测集合,表示模型中可能出现的所有观测;A = [aij]是状态转移矩阵,其中aij表示从状态i转移到状态j的概率;B = [bj(k)]是观测概率矩阵,其中bj(k)表示在状态j下观测到k的概率;π = [πi]是初始状态概率向量,其中πi表示模型开始时处于状态i的概率。

隐马尔可夫模型的基本假设是:每个时刻系统处于某一状态,但是我们无法观测到该状态,只能观测到该状态下产生的某个观测。

因此,我们称该状态为隐状态,称观测为可观测状态。

隐马尔可夫模型的任务就是根据观测序列推断出最有可能的隐状态序列。

二、隐马尔可夫模型的数学表达隐马尔可夫模型的数学表达可以用贝叶斯公式表示:P(O|λ) = ∑Q P(O|Q, λ)P(Q|λ)其中,O表示观测序列,Q表示隐状态序列,λ表示模型参数。

P(O|Q, λ)表示在给定隐状态序列Q和模型参数λ的条件下,观测序列O出现的概率;P(Q|λ)表示在给定模型参数λ的条件下,隐状态序列Q出现的概率。

P(O|λ)表示在给定模型参数λ的条件下,观测序列O出现的概率。

根据贝叶斯公式,我们可以得到隐状态序列的后验概率:P(Q|O,λ) = P(O|Q,λ)P(Q|λ)/P(O|λ)其中,P(O|Q,λ)和P(Q|λ)可以通过模型参数计算,P(O|λ)可以通过前向算法或后向算法计算。

隐马尔可夫模型之baum-welch算法详解隐马尔可夫模型(Hidden Markov Model, HMM)是一种用于建模时序数据的概率图模型。

它是一种具有隐状态的动态贝叶斯网络,通常用于处理具有序列结构的数据,如语音识别、手写识别、生物信息学等领域。

在HMM中,观测数据是由一个隐藏的马尔可夫链生成的,而观测数据的生成过程对应了状态序列的隐马尔可夫链。

在HMM中,我们通常根据观测数据,来估计模型参数,这就需要用到一种十分重要的算法——baumwelch算法。

baumwelch算法是一种用于估计HMM 参数的迭代算法,它通过最大化观测数据的似然函数,来更新HMM的状态转移概率和观测概率。

接下来,我们将详细介绍baumwelch算法的原理和步骤,希望能帮助读者更好地理解这一重要的算法。

1. HMM的基本概念在介绍baumwelch算法之前,我们首先需要了解HMM的基本概念。

HMM由三组参数组成:初始状态概率向量π、状态转移概率矩阵A和观测概率矩阵B。

其中,π表示初始时各隐藏状态出现的概率,A表示各隐藏状态之间转移的概率,B表示各隐藏状态生成各观测符号的概率。

HMM模型可以用一个三元组(π, A, B)来表示,给定模型参数和观测数据,我们希望通过估计π, A, B来对模型进行学习和优化。

2. baumwelch算法的原理baumwelch算法是一种迭代算法,用于估计HMM的参数。

它基于期望最大化(EM)算法的思想,通过不断迭代,逐步优化模型的参数,使得模型的似然性函数最大化。

baumwelch算法的核心思想是通过E步骤计算期望值,M步骤更新模型参数,反复迭代直至收敛。

具体来说,baumwelch算法分为两个主要步骤:E步骤(期望步骤)和M步骤(最大化步骤)。

在E步骤中,我们需要计算在当前模型下观测数据对应的隐藏状态序列的期望值,而在M步骤中,我们利用这些期望值来更新模型的参数。

3. baumwelch算法的步骤接下来,我们将详细介绍baumwelch算法的具体步骤:步骤一:初始化HMM模型参数首先,我们需要对HMM模型的参数进行初始化。

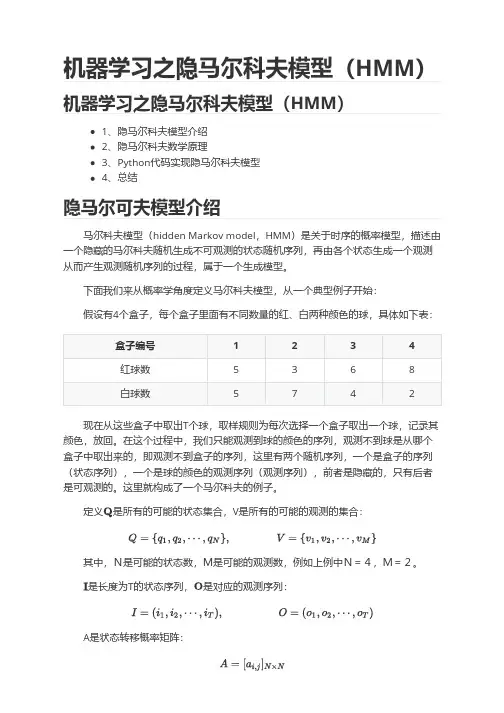

机器学习之隐马尔科夫模型(HMM)机器学习之隐马尔科夫模型(HMM)1、隐马尔科夫模型介绍2、隐马尔科夫数学原理3、Python代码实现隐马尔科夫模型4、总结隐马尔可夫模型介绍马尔科夫模型(hidden Markov model,HMM)是关于时序的概率模型,描述由一个隐藏的马尔科夫随机生成不可观测的状态随机序列,再由各个状态生成一个观测从而产生观测随机序列的过程,属于一个生成模型。

下面我们来从概率学角度定义马尔科夫模型,从一个典型例子开始:假设有4个盒子,每个盒子里面有不同数量的红、白两种颜色的球,具体如下表:盒子编号1234红球数5368白球数5742现在从这些盒子中取出T个球,取样规则为每次选择一个盒子取出一个球,记录其颜色,放回。

在这个过程中,我们只能观测到球的颜色的序列,观测不到球是从哪个盒子中取出来的,即观测不到盒子的序列,这里有两个随机序列,一个是盒子的序列(状态序列),一个是球的颜色的观测序列(观测序列),前者是隐藏的,只有后者是可观测的。

这里就构成了一个马尔科夫的例子。

定义是所有的可能的状态集合,V是所有的可能的观测的集合:其中,N是可能的状态数,M是可能的观测数,例如上例中N=4,M=2。

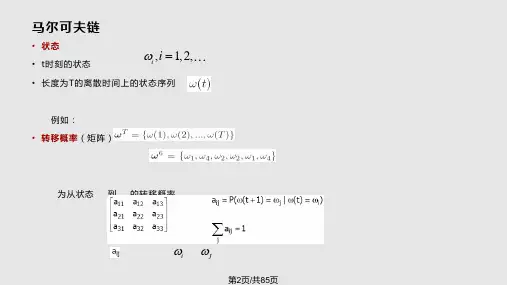

是长度为T的状态序列,是对应的观测序列:A是状态转移概率矩阵:其中, 是指在时刻处于状态的条件下在时刻转移到状态的概率。

B是观测概率矩阵:其中, 是指在时刻处于状态的条件下生成观测的概率。

是初始状态概率向量:其中, 是指在时刻=1处于状态的概率。

由此可得到,隐马尔可夫模型的三元符号表示,即称为隐马尔可夫模型的三要素。

由定义可知隐马尔可夫模型做了两个基本假设:(1)齐次马尔科夫性假设,即假设隐藏的马尔科夫链在任意时刻的状态只和-1状态有关;(2)观测独立性假设,观测只和当前时刻状态有关;仍以上面的盒子取球为例,假设我们定义盒子和球模型:状态集合: = {盒子1,盒子2,盒子3,盒子4}, N=4观测集合: = {红球,白球} M=2初始化概率分布:状态转移矩阵:观测矩阵:(1)转移概率的估计:假设样本中时刻t处于状态i,时刻t+1转移到状态j 的频数为那么转台转移概率的估计是:(2)观测概率的估计:设样本中状态为j并观测为k的频数是那么状态j观测为k的概率, (3)初始状态概率的估计为S个样本中初始状态为的频率。

隐马尔可夫模型(Hidden Markov Model, HMM)是一种用于建模时序数据的统计模型,它在气象预测中有着广泛的应用。

随着气候变化对人类社会造成的影响日益凸显,气象预测对于减少自然灾害和保障人民生命财产安全变得愈发重要。

在这篇文章中,我们将探讨隐马尔可夫模型在气象预测中的使用技巧。

首先,隐马尔可夫模型的基本原理是什么?HMM是一种用于描述不可观测状态的概率模型,它假设系统中存在着一些无法直接观测到的状态,而这些状态会影响到我们能够观测到的数据。

在气象预测中,我们可以将天气状态视作隐含状态,而观测到的气象数据(如温度、湿度、风速等)则视作观测状态。

通过对历史气象数据的分析,我们可以建立隐马尔可夫模型,从而预测未来的天气状态。

其次,HMM在气象预测中的使用技巧是什么?首先,我们需要选择合适的观测数据和隐含状态。

在气象预测中,我们可以选择温度、湿度、风速等数据作为观测数据,而将晴、阴、雨、雪等天气状态作为隐含状态。

其次,我们需要对观测数据和隐含状态之间的转移概率和发射概率进行建模。

转移概率表示在给定隐含状态下,系统转移到另一个隐含状态的概率;而发射概率表示在给定隐含状态下,系统观测到某个特定的观测状态的概率。

通过对历史数据的统计分析,我们可以估计这些概率,从而建立隐马尔可夫模型。

另外,HMM在气象预测中还需要考虑到观测数据的特点和隐含状态之间的关联。

在气象预测中,观测数据通常具有一定的时序相关性,而隐含状态之间也存在着一定的转移规律。

因此,在建立HMM模型时,我们需要考虑到观测数据的时序特点,并且需要对隐含状态之间的转移规律进行合理的建模。

这样才能够更准确地预测未来的天气状态。

另外,HMM在气象预测中还需要考虑到观测数据的质量和隐含状态的多样性。

在气象预测中,观测数据往往受到各种因素的影响,比如仪器故障、环境变化等,因此观测数据可能存在着一定的误差。

在建立HMM模型时,我们需要对观测数据进行质量评估,并且需要考虑到观测数据的不确定性。

神经网络人工神经网络(Artificial Neural Networks,简写为ANNs)也简称为神经网络(NNs)或称作连接模型(Connection Model),它是一种模范动物神经网络行为特征,进行分布式并行信息处理的算法数学模型。

这种网络依靠系统的复杂程度,通过调整内部大量节点之间相互连接的关系,从而达到处理信息的目的。

隐马尔可夫模型隐马尔可夫模型(Hidden Markov Model,HMM)作为一种统计分析模型,创立于20世纪70年代。

80 年代得到了传播和发展,成为信号处理的一个重要方向,现已成功地用于语音识别,行为识别,文字识别以及故障诊断等领域。

隐马尔可夫模型是马尔可夫链的一种,它的状态不能直接观察到,但能通过观测向量序列观察到,每个观测向量都是通过某些概率密度分布表现为各种状态,每一个观测向量是由一个具有相应概率密度分布的状态序列产生。

所以,隐马尔可夫模型是一个双重随机过程----具有一定状态数的隐马尔可夫链和显示随机函数集。

自20世纪80年代以来,HMM被应用于语音识别,取得重大成功。

到了90年代,HMM还被引入计算机文字识别和移动通信核心技术“多用户的检测”。

近年来,HMM在生物信息科学、故障诊断等领域也开始得到应用。

1. 评估问题。

给定观测序列O=O1O2O3…Ot和模型参数λ=(A,B,π),怎样有效计算某一观测序列的概率,进而可对该HMM做出相关评估。

例如,已有一些模型参数各异的HMM,给定观测序列O=O1O2O3…Ot,我们想知道哪个HMM模型最可能生成该观测序列。

通常我们利用forward算法分别计算每个HMM 产生给定观测序列O的概率,然后从中选出最优的HMM模型。

这类评估的问题的一个经典例子是语音识别。

在描述语言识别的隐马尔科夫模型中,每个单词生成一个对应的HMM,每个观测序列由一个单词的语音构成,单词的识别是通过评估进而选出最有可能产生观测序列所代表的读音的HMM而实现的。

隐马尔可夫模型实例什么是隐马尔可夫模型?隐马尔可夫模型(Hidden Markov Model,HMM)是一种用于建模序列数据的概率图模型。

它在很多领域有着广泛的应用,例如语音识别、自然语言处理、生物信息学等。

隐马尔可夫模型能够描述一个系统在不同状态之间的转移以及每个状态下观测到不同的符号的概率。

隐马尔可夫模型由两个主要部分组成:状态序列和观测序列。

其中,状态序列是隐藏的,而观测序列是可见的。

状态序列和观测序列之间存在一个转移矩阵,描述了从一个状态转移到另一个状态的概率。

同时,每个状态对应着一个观测符号的概率分布。

隐马尔可夫模型的基本原理隐马尔可夫模型基于马尔可夫过程,认为当前状态只与前一个状态有关,与更早的状态无关。

模型假设当系统处于某个状态时,观测到的符号仅与该状态有关,与其他状态无关。

隐马尔可夫模型的核心思想是使用观测符号序列来推断状态序列。

通过观测到的符号序列,我们可以估计最可能的状态序列,以及观测到的符号是由哪个状态生成的概率。

模型中的参数包括初始状态分布、状态转移矩阵和观测符号概率分布。

通过这些参数,可以使用前向算法、后向算法和维特比算法等方法来进行模型的训练和推断。

隐马尔可夫模型的实例应用语音识别隐马尔可夫模型在语音识别中有着重要应用。

语音信号可以被看作是一个连续的观测序列,隐藏的状态序列表示语音的词语或音素序列。

通过训练隐马尔可夫模型,可以建立声学模型和语言模型,实现对语音信号的识别。

自然语言处理在自然语言处理领域,隐马尔可夫模型可以用于词性标注、命名实体识别等任务。

通过将不同词性或实体类别作为状态,将观测到的词语序列作为观测序列,可以建立一个标注模型,用于对文本进行标注。

生物信息学隐马尔可夫模型在生物信息学中也有广泛应用。

例如,在基因识别中,DNA序列可以看作是一个观测序列,而相应的蛋白质编码区域可以看作是一个隐藏的状态序列。

通过训练模型,可以对DNA序列进行分析和识别。

隐马尔可夫模型的训练与推断隐马尔可夫模型的训练可以通过监督学习和非监督学习两种方法进行。

隐马尔可夫模型三个基本问题及算法隐马尔可夫模型(Hien Markov Model, HMM)是一种用于建模具有隐藏状态和可观测状态序列的概率模型。

它在语音识别、自然语言处理、生物信息学等领域广泛应用,并且在机器学习和模式识别领域有着重要的地位。

隐马尔可夫模型有三个基本问题,分别是状态序列概率计算问题、参数学习问题和预测问题。

一、状态序列概率计算问题在隐马尔可夫模型中,给定模型参数和观测序列,计算观测序列出现的概率是一个关键问题。

这个问题通常由前向算法和后向算法来解决。

具体来说,前向算法用于计算给定观测序列下特定状态出现的概率,而后向算法则用于计算给定观测序列下前面状态的概率。

这两个算法相互协作,可以高效地解决状态序列概率计算问题。

二、参数学习问题参数学习问题是指在给定观测序列和状态序列的情况下,估计隐马尔可夫模型的参数。

通常采用的算法是Baum-Welch算法,它是一种迭代算法,通过不断更新模型参数来使观测序列出现的概率最大化。

这个问题的解决对于模型的训练和优化非常重要。

三、预测问题预测问题是指在给定观测序列和模型参数的情况下,求解最可能的状态序列。

这个问题通常由维特比算法来解决,它通过动态规划的方式来找到最可能的状态序列,并且在很多实际应用中都有着重要的作用。

以上就是隐马尔可夫模型的三个基本问题及相应的算法解决方法。

在实际应用中,隐马尔可夫模型可以用于许多领域,比如语音识别中的语音建模、自然语言处理中的词性标注和信息抽取、生物信息学中的基因预测等。

隐马尔可夫模型的强大表达能力和灵活性使得它成为了一个非常有价值的模型工具。

在撰写这篇文章的过程中,我对隐马尔可夫模型的三个基本问题有了更深入的理解。

通过对状态序列概率计算问题、参数学习问题和预测问题的深入探讨,我认识到隐马尔可夫模型在实际应用中的重要性和广泛适用性。

隐马尔可夫模型的算法解决了许多实际问题,并且在相关领域有着重要的意义。

隐马尔可夫模型是一种强大的概率模型,它的三个基本问题和相应的算法为实际应用提供了重要支持。

隐马尔可夫模型

维基百科,自由的百科全书

跳转到:导航, 搜索

隐马尔可夫模型状态变迁图(例子)

x—隐含状态

y—可观察的输出

a—转换概率(transition probabilities)

b—输出概率(output probabilities)

隐马尔可夫模型(Hidden Markov Model,HMM)是统计模型,它用来描述一个含有隐含未知参数的马尔可夫过程。

其难点是从可观察的参数中确定该过程的隐含参数。

然后利用这些参数来作进一步的分析,例如模式识别。

在正常的马尔可夫模型中,状态对于观察者来说是直接可见的。

这样状态的转换概率便是全部的参数。

而在隐马尔可夫模型中,状态并不

是直接可见的,但受状态影响的某些变量则是可见的。

每一个状态在可能输出的符号上都有一概率分布。

因此输出符号的序列能够透露出状态序列的一些信息。

目录

[隐藏]

∙ 1 马尔可夫模型的演化

∙ 2 使用隐马尔可夫模型

o 2.1 具体实例

o 2.2 隐马尔可夫模型的应用

∙ 3 历史

∙ 4 参见

∙ 5 注解

∙ 6 参考书目

∙7 外部连接

[编辑]马尔可夫模型的演化

上边的图示强调了HMM的状态变迁。

有时,明确的表示出模型的演化也是有用的,我们用x(t1)与x(t2)来表达不同时刻t1和t2的状态。

在这个图中,每一个时间块(x(t), y(t))都可以向前或向后延伸。

通常,时间的起点被设置为t=0 或t=1.

另外,最近的一些方法使用Junction tree算法来解决这三个问题。

[编辑]具体实例

假设你有一个住得很远的朋友,他每天跟你打电话告诉你他那天作了什么.你的朋友仅仅对三种活动感兴趣:公园散步,购物以及清理房间.他选择做什么事情只凭天气.你对于他所住的地方的天气情况并不了解,但是你知道总的趋势.在他告诉你每天所做的事情基础上,你想要猜测他所在地的天气情况.

你认为天气的运行就像一个马尔可夫链.其有两个状态 "雨"和"晴",但是你无法直接观察它们,也就是说,它们对于你是隐藏的.每天,你的朋友有一定的概率进行下列活动:"散步", "购物", 或 "清理".

因为你朋友告诉你他的活动,所以这些活动就是你的观察数据.这整个系统就是一个隐马尔可夫模型HMM.

你知道这个地区的总的天气趋势,并且平时知道你朋友会做的事情.也就是说这个隐马尔可夫模型的参数是已知的.你可以用程序语言(Python)写下来:

states = ('Rainy', 'Sunny')

observations = ('walk', 'shop', 'clean')

start_probability = {'Rainy': 0.6, 'Sunny': 0.4}

transition_probability = {

'Rainy' : {'Rainy': 0.7, 'Sunny': 0.3},

'Sunny' : {'Rainy': 0.4, 'Sunny': 0.6},

}

emission_probability = {

'Rainy' : {'walk': 0.1, 'shop': 0.4, 'clean': 0.5},

'Sunny' : {'walk': 0.6, 'shop': 0.3, 'clean': 0.1},

}

在这些代码中,start_probability代表了你对于你朋友第一次给你打电话时的天气情况的不确定性(你知道的只是那个地方平均起来下雨多些).在这里,这个特定的概率分布并非平衡的,平衡概率应该接近(在给定变迁概率的情况下){'Rainy': 0.571, 'Sunny': 0.429}< transition_probability表示基于马尔可夫链模型的天气变迁,在这个例子中,如果今天下雨,那么明天天晴的概率只有30%.代码emission_probability表示了你朋友每天作某件事的概率.如果下雨,

有 50% 的概率他在清理房间;如果天晴,则有60%的概率他在外头散步.

这个例子在Viterbi算法页上有更多的解释。

[编辑]隐马尔可夫模型的应用

1.^ Rabiner, p. 258

2.^ Durbin

∙/roger/HiddenMarkovModels/html_de v/main.html

∙J. Li, A. Najmi, R. M. Gray, Image classification by a two dimensional hidden Markov model, IEEE Transactions on Signal Processing, 48(2):517-33, February 2000.。