参数的最小二乘法估计

- 格式:doc

- 大小:718.00 KB

- 文档页数:17

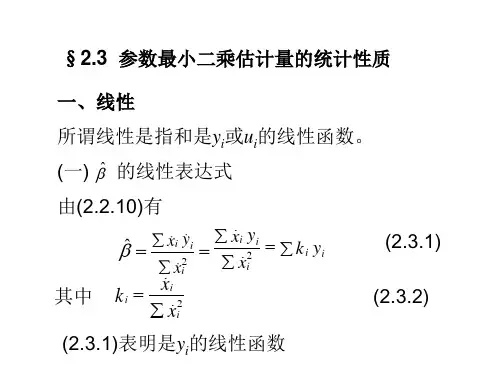

§2.2一元线性回归模型的参数估计一、一元线性回归模型的基本假设二、参数的普通最小二乘估计(OLS)三、参数估计的最大或然法(ML)四、最小二乘估计量的性质五、参数估计量的概率分布及随机干扰项方差的估计单方程计量经济学模型分为两大类:线性模型和非线性模型•线性模型中,变量之间的关系呈线性关系•非线性模型中,变量之间的关系呈非线性关系一元线性回归模型:只有一个解释变量i i i X Y μββ++=10i=1,2,…,nY 为被解释变量,X 为解释变量,β0与β1为待估参数,μ为随机干扰项回归分析的主要目的是要通过样本回归函数(模型)SRF尽可能准确地估计总体回归函数(模型)PRF。

估计方法有多种,其中最广泛使用的是普通最小二乘法(ordinary least squares,OLS)。

为保证参数估计量具有良好的性质,通常对模型提出若干基本假设。

注:实际这些假设与所采用的估计方法紧密相关。

一、线性回归模型的基本假设假设1、解释变量X是确定性变量,不是随机变量;假设2、随机误差项μ具有零均值、同方差和不序列相关性:E(μi)=0i=1,2,…,nVar(μi)=σμ2i=1,2,…,nCov(μi,μj)=0i≠j i,j=1,2,…,n假设3、随机误差项μ与解释变量X之间不相关:Cov(X i,μi)=0i=1,2,…,n假设4、μ服从零均值、同方差、零协方差的正态分布μi~N(0,σμ2)i=1,2,…,n注意:1、如果假设1、2满足,则假设3也满足;2、如果假设4满足,则假设2也满足。

以上假设也称为线性回归模型的经典假设或高斯(Gauss)假设,满足该假设的线性回归模型,也称为经典线性回归模型(Classical Linear Regression Model,CLRM)。

二、参数的普通最小二乘估计(OLS)给定一组样本观测值(X i ,Y i )(i=1,2,…n )要求样本回归函数尽可能好地拟合这组值.普通最小二乘法(Ordinary least squares,OLS )给出的判断标准是:二者之差的平方和∑∑+-=-=ni i i n i X Y Y Y Q 121021))ˆˆ(()ˆ(ββ最小。

8.2.1一元线性回归模型1.生活经验告诉我们,儿子的身高与父亲的身高相关.一般来说,父亲的身高较高时,儿子的身高通常也较高.为了进一步研究两者之间的关系,有人调查了14名男大学生的身高及其父亲的身高,得到的数据如表1所示.编号1234567891011121314父亲身高/cm 174 170 173 169 182 172 180 172 168 166 182 173 164 180 儿子身高/cm 176 176 170 170 185 176 178 174 170 168 178 172 165 182从图上看,散点大致分布在一条直线附近根据我们学过的整理数据的方法:相关系数r =0.886.父亲身高/cm180 175 170 165 160160 165 170 175180 185 190 ·· ·· · · · 儿子身高/cm· · · · ·185 1).问题1:可以得到什么结论?由散点图的分布趋势表明儿子的身高与父亲的身高线性相关,通过相关系数可知儿子的身高与父亲的身高正线性相关,且相关程度较高.2).问题2:是否可以用函数模型来刻画?不能,因为不符合函数的定义.这其中还受其它因素的影响.3).问题3:那么影响儿子身高的其他因素是什么?影响儿子身高的因素除父亲的身外,还有母亲的身高、生活的环境、饮食习惯、营养水平、体育锻炼等随机的因素,儿子身高是父亲身高的函数的原因是存在这些随机的因素.4).问题4: 你能否考虑到这些随机因素的作用,用类似于函数的表达式,表示儿子身高与父亲身高的关系吗?用x表示父亲身高,Y表示儿子的身高,用e表示各种其它随机因素影响之和,称e为随机误差, 由于儿子身高与父亲身高线性相关,所以Y=bx+a.考虑随机误差后,儿子的身高可以表示为:Y=bx+a+e由于随机误差表示大量已知和未知的各种影响之和,它们会相互抵消,为使问题简洁,可假设随机误差e的均值为0,方差为与父亲身高无关的定值 . 2σ2即E e D eσ:()0,().==我们称①式为Y 关于x 的一元线性回归模型,其中,Y 称为因变量或响应变量,x 称为自变量或解释变量 . a 称为截距参数,b 称为斜率参数;e 是Y 与bx+a 之间的随机误差.2,()0,().Y bx a e E e D e σ=++⎧⎨==⎩① 2、一元线性回归模型如果用x 表示父亲身高,Y 表示儿子的身高,e 表示随机误差.假定随机误差e 的均值为0,方差为与父亲身高无关的定值 ,则它们之间的关系可以表示为2σ4.问题5:你能结合具体实例解释产生模型①中随机误差项的原因吗?产生随机误差e的原因有:(1)除父亲身高外,其他可能影响儿子身高的因素,比如母亲身高、生活环境、饮食习惯和锻炼时间等.(2)在测量儿子身高时,由于测量工具、测量精度所产生的测量误差.(3)实际问题中,我们不知道儿子身高和父亲身高的相关关系是什么,可以利用一元线性回归模型来近似这种关系,这种近似关系也是产生随机误差e的原因.8.2.2一元线性回归模型参数的最小二乘法估计二、自主探究问题1.为了研究两个变量之间的相关关系, 我们建立了一元线性回归模型表达式 刻画的是变量Y 与变量x 之间的线性相关关系,其中参数a 和b 未知,我们如何通过样本数据估计参数a 和b?2,()0,().Y bx a e E e D e σ=++⎧⎨==⎩问题2.我们怎样寻找一条“最好”的直线,使得表示成对样本数据的这些散点在整体上与这条直线最“接近”?从成对样本数据出发,用数学的方法刻画“从整体上看,各散点与蓝色直线最接近”利用点到直线y=bx+a 的“距离”来刻画散点与该直线的接近程度,然后用所有“距离”之和刻画所有样本观测数据与该直线的接近程度.父亲身高/cm180 175 170 165 160160 165 170 175180 185 190 ·· ·· · · · 儿子身高/cm· · · · ·185 父亲身高/cm180 175 170 165 160160 165 170 175 180 185 190·· ·· · · · 儿子身高/cm· · · · ·185设满足一元线性回归模型的两个变量的n 对样本数据为(x 1,y 1),(x 2,y 2),…,(x n ,y n )父亲身高/cm180 175170165 160160165 170 175 180 185 190·· · · · · · 儿子身高/cm· ·· · · 185()()(1,2,3,,-).i i i i i i i i i i i y bx a e i n y bx a e e x y x bx a =++=⋅⋅⋅+=+由),得(显然越小,表示点,与点,的距离越小,()0,.i i i x y =即样本数据点离直线y=bx+a 的竖直距离越小,如上图特别地,当e 时,表示点在这条直线上1-)ni i i y bx a =+∑因此可用(来刻画各样本观测数据与直线y=bx+a 的整体接近程度.()iix y ,y=bx+a()i i x bx a +,·[]21(,)()ni i i Q a b y bx a ==-+∑残差平方和: 即求a ,b 的值,使Q ( a ,b )最小残差:实际值与估计值之间的差值,即 使Q 取得最小值,当且仅当b 的取值为121()()()nii i nii xx y y b xx ==--=-∑∑b.,ˆ,ˆ的最小二乘估计叫做求得a b a b(,).x y 经验回顾直线必经过的符号相同与相关系数r b ˆ最小二乘法我们将 称为Y 关于x 的经验回归方程,也称经验回归函数或经验回归公式,其图形称为经验回归直线,这种求经验回归方程的方法叫最小二乘法.ˆˆˆy bxa =+12111=i ni n22i ni n x x y y ˆb ,x x ˆˆa x y x y x xy b .i i i i i i ΣΣx )n ΣΣ(()()n ====⎧--⎪=⎪⎨-⎪⎪--=⎩-问题2:依据用最小二乘估计一元线性回归模型参数的公式,求出儿子身高Y 关于父亲身高x 的经验回归方程.儿子的身高不一定会是177cm ,这是因为还有其他影响儿子身高的因素,回归模型中的随机误差清楚地表达了这种影响,父亲的身高不能完全决定儿子的身高,不过,我们可以作出推测,当父亲的身高为176cm 时,儿子身高一般在177cm 左右.当x=176时, ,如果一位父亲身高为176cm,他儿子长大后身高一定能长到177cm 吗?为什么?177y ≈083928957ˆy .x .=+的意义?∧b残差的定义,e a bx Y ++=一元线性回归模型,,Y y 对于通过观测得响应到的数据称量为变观测值ˆ,y通过经验回归方程得到称为预报值的ˆ.ˆey y =-残观测值减去预报值称为即差判断模型拟合的效果:残差分析问题3:儿子身高与父亲身高的关系,运用残差分析所得的一元线性回归模型的有效性吗?残差图:作图时纵坐标为残差,横坐标可以选为样本编号,或身高数据或体重估计值等,这样作出的图形称为残差图.从上面的残差图可以看出,残差有正有负,残差点比较均匀地分布在横轴的两边,可以判断样本数据基本满足一元线性回归模型对于随机误差的假设.所以,通过观察残差图可以直观判断样本数据是否满足一元线性回归模型的假设,从而判断回归模型拟合的有效性.所以,只有图(4)满足一元线性回归模型对随机误差的假设图(1)显示残差与观测时间有线性关系,应将时间变量纳入模型; 图(2)显示残差与观测时间有非线性关系,应在模型中加入时间的非线性函数部分; 图(3)说明残差的方差不是一个常数,随观测时间变大而变大图(4)的残差比较均匀地集中在以横轴为对称轴的水平带状区域内.根据一元线性回归模型中对随机误差的假定,残差应是均值为0,方差为 的随机变量的观测值.2σ观察以下四幅残差图,你认为哪一个残差满足一元线性回归模型中对随机误差的假定?1.残差等于观测值减预测值2.残差的平方和越小越好;3.原始数据中的可疑数据往往是残差绝对值过大的数据;4. 对数据刻画效果比较好的残差图特征:残差点比较均匀的集中在水平带状区域内.归纳小结(残差图中带状越窄,精度越高)1.关于残差图的描述错误的是( )A.残差图的横坐标可以是样本编号B.残差图的横坐标也可以是解释变量或预报变量C.残差点分布的带状区域的宽度越窄相关指数越小D.残差点分布的带状区域的宽度越窄残差平方和越小C 三、巩固提升2.根据如下样本数据:得到的经验回归方程为 ,则( ) A. >0, >0B. >0, <0C. <0, >0D. <0, <0 x 2 3 4 5 6 Y42.5-0.5-2-3a $a $a $a$$b $b$b$b $$ybx a =+$ B3.某种产品的广告支出费用x(单位:万元)与销售额Y(单位:万元)的数据如表:已知Y 关于x 的经验回归方程为 =6.5x+17.5,则当广告支 出费用为5万元时,残差为________. x 2 4 5 6 8Y 30 40 60 50 70$y当x=5时, =6.5×5+17.5=50,表格中对应y=60,于是残差为60-50=10.$y10一元线性回归模型的应用例1.经验表明,对于同一树种,一般树的胸径(树的主干在地面以上1.3m处的直径)越大,树就越高.由于测量树高比测量胸径困难,因此研究人员希望由胸径预测树高.在研究树高与胸径之间的关系时,某林场收集了某种树的一些数据如下表所示,试根据这些数据建立树高关于胸径的经验回归方程.编号 1 2 3 4 5 6胸径/cm 18.1 20.1 22.2 24.4 26.0 28.3树高/m 18.8 19.2 21.0 21.0 22.1 22.1编号7 8 9 10 11 12胸径/cm 29.6 32.4 33.7 35.7 38.3 40.2树高/m 22.4 22.6 23.0 24.3 23.9 24.7dh· · ·· · · · · · · · · 解: 以胸径为横坐标,树高为纵坐标作散点图如下:散点大致分布在一条从左下角到右上角的直线附近,表明两个变量线性相关,并且是正相关,因此可以用一元线性回归模型刻画树高与胸径之间的关系.0.249314.84h d =+··· ·· · · · · · · · 用d 表示胸径,h 表示树高,根据据最小二乘法,计算可得经验回归方程为0.249314.84h d =+根据经验回归方程,由胸径的数据可以计算出树高的预测值(精确到0.1)以及相应的残差,如下表所示.编号胸径/cm 树高观测值/m 树高预测值/m 残差/m1 18.1 18.8 19.4 -0.62 20.1 19.2 19.9 -0.73 22.2 21.0 20.4 0.64 24.4 21.0 20.9 0.15 26.0 22.1 21.3 0.86 28.3 22.1 21.9 0.27 29.6 22.4 22.2 0.28 32.4 22.6 22.9 -0.39 33.7 23.0 23.2 -0.210 35.7 24.3 23.7 0.611 38.3 23.9 24.4 -0.512 40.2 24.7 24.9 -0.2以胸径为横坐标,残差为纵坐标,作残差图,得到下图.30252015-1.0-0.5 0.0 0.5 1.0· · · · · · · 残差/m· · · ·· 354045胸径/cm观察残差表和残差图,可以看到残差的绝对值最大是0.8,所有残差分布在以横轴为对称轴、宽度小于2的带状区域内 .可见经验回归方程较好地刻画了树高与胸径的关系,我们可以根据经验回归方程由胸径预测树高.编号1 2 3 4 5 6 7 8 年份 1896 1912 1921 1930 1936 1956 1960 1968 记录/s 11.8010.6010.4010.3010.2010.1010.009.95例2.人们常将男子短跑100m 的高水平运动员称为“百米飞人”.下表给出了1968年之前男子短跑100m 世界纪录产生的年份和世界纪录的数据.试依据这些成对数据,建立男子短跑100m 世界纪录关于纪录产生年份的经验回归方程以成对数据中的世界纪录产生年份为横坐标,世界纪录为纵坐标作散点图,得到下图在左图中,散点看上去大致分布在一条直线附近,似乎可用一元线性回归模型建立经验回归方程.将经验回归直线叠加到散点图,得到下图:76913031.4902033743.0ˆ1+-=t y用Y 表示男子短跑100m 的世界纪录,t 表示纪录产生的年份 ,利用一元线性回归模型来刻画世界纪录和世界纪录产生年份之间的关系 . 根据最小二乘法,由表中的数据得到经验回归方程为:从图中可以看到,经验回归方程较好地刻画了散点的变化趋势,请再仔细观察图形,你能看出其中存在的问题吗?你能对模型进行修改,以使其更好地反映散点的分布特征吗?仔细观察右图,可以发现散点更趋向于落在中间下凸且递减的某条曲线附近.回顾已有的函数知识,可以发现函数y=-lnx的图象具有类似的形状特征注意到100m短跑的第一个世界纪录产生于1896年, 因此可以认为散点是集中在曲线y=f(t)=c1+c2ln(t-1895)的周围,其中c1、c2为未知参数,且c2<0.y=f(t)=c1+c2ln(t-1895)这是一个非线性经验回归函数,如何利用成对数据估计参数c1、c2令x=ln(t-1895),则Y=c2x+c1对数据进行变化可得下表:编号 1 2 3 4 5 6 7 8 年份/t 1896 1912 1921 1930 1936 1956 1960 1968 x 0.00 2.83 3.26 3.56 3.71 4.11 4.17 4.29 记录/s 11.80 10.60 10.40 10.30 10.20 10.10 10.00 9.95将x=ln(t-1895)代入:得 8012653.114264398.0ˆ2+-=x y上图表明,经验回归方程对于成对数据具有非常好的拟合精度.将经验回归直线叠加到散点图,得到下图: 8012653.114264398.0ˆ2+-=x y8012653.11)1895ln(4264398.0ˆ2+--=t y经验回归方程为对于通过创纪录时间预报世界纪录的问题,我们建立了两个回归模型,得到了两个回归方程,你能判断哪个回归方程拟合的精度更好吗?8012653.114264398.0ˆ2+-=x y① 2ˆ0.4264398ln(1895)11.8012653y t =--+② 我们发现,散点图中各散点都非常靠近②的图象, 表明非线性经验回归方程②对于原始数据的拟合效果远远好于经验回归方程①.(1).直接观察法.在同一坐标系中画出成对数据散点图、非线性经验回归方程②的图象(蓝色)以及经验回归方程①的图象(红色).28212811ˆ,ˆQ Q (()0.004)0.669i i i i eu ===≈=≈∑∑8012653.114264398.0ˆ2+-=x y① 2ˆ0.4264398ln(1895)11.8012653yt =--+②(2).残差分析:残差平方和越小,模型拟合效果越好.Q 2明显小于Q 1,说明非线性回归方程的拟合效果 要优于线性回归方程.R 2越大,表示残差平方和越小,即模型的拟合效果越好 R 2越小,表示残差平方和越大,即模型的拟合效果越差. 21212ˆ()11()n i i nii i y y y y R ==-=-=--∑∑残差平方和。

最小二乘法参数估计量推导最小二乘法,这个名字听上去挺高深的,其实就是一种简单而强大的数学工具,广泛应用于数据分析中。

今天,我们就来聊聊这玩意儿到底是怎么一回事。

1. 什么是最小二乘法最小二乘法其实就是在做“找差距”的工作。

假设你有一堆数据点,比如说你测量了一系列的温度和对应的电力消耗,你的目标是找到一条最能贴合这些数据点的直线。

这条直线就像是你为数据“量体裁衣”的结果。

1.1. 基本思想最小二乘法的核心思想就是:找到一条直线,使得每一个数据点到这条直线的距离(叫做“残差”)的平方和最小。

这个“平方和”就像是把所有的偏差加起来,让它们不再那么“任性”。

1.2. 为什么用“平方”?那为什么要把这些偏差平方呢?因为平方能有效地放大大的误差,这样我们就不容易忽视它们。

就像打麻将,偏差大的牌更容易被看见,才能让我们在游戏中更精准地调整策略。

2. 数学推导好啦,接下来我们就来捋一捋这个过程。

咱们还是从简单的说起:假设你有一组数据点(x₁, y₁)、(x₂, y₂)、……、(xₙ, yₙ),而你要找的是一条直线y = β₀ + β₁x。

这条直线就是我们的“理想之线”。

2.1. 定义目标函数我们的目标就是最小化所有这些点到直线的距离平方和。

用数学的语言来描述,就是要最小化目标函数:[ S(beta_0, beta_1) = sum_{i=1}^n (y_i beta_0 beta_1 x_i)^2 ]。

这里面,(y_i beta_0 beta_1 x_i)就是每一个点到直线的距离,平方了之后就能让误差更加明显。

2.2. 求导数为了找到最小值,我们需要对目标函数进行求导数,然后让导数等于零。

这个过程就像是找到山顶的最低点一样。

我们分别对β₀和β₁求偏导数,然后设定这些偏导数为零,得到两个方程:[ frac{partial S}{partial beta_0} = 0 ]。

[ frac{partial S}{partial beta_1} = 0 ]。

最小二乘估计的推导最小二乘估计是一种常用的参数估计方法,尤其在统计学和经济学领域得到广泛应用。

它的推导涉及到一些数学推理和统计原理,我将在本文中逐步解释和展示最小二乘估计的推导过程,并探讨其应用和优势。

1. 引言最小二乘估计是一种通过最小化观测值与预测值之间的差异来估计参数的方法。

它的基本思想是找到一组参数值,使得观测值与对应的预测值之间的平方差最小化。

这种方法在数据分析和回归分析中非常有用,因为它能够提供可靠的参数估计和预测模型。

2. 最小二乘估计的基本原理最小二乘估计的推导涉及到线性回归模型,即因变量Y与自变量X之间的线性关系。

假设我们有n个观测值,表示为(Xi,Yi),i=1,2,...,n。

我们的目标是找到一条直线Y=aX+b,使得所有观测值到这条直线的距离之和最小化。

距离的平方和可以表示为:S = Σ(Yi - (aXi + b))²我们的目标是最小化这个平方和。

为了找到最优的参数估计,我们需要找到使得S最小的a和b的值。

3. 最小化平方和我们可以通过对S求导,令导数等于零,来求解a和b的值。

具体地,我们分别对a和b求导,并令导数等于零:∂S/∂a = -2ΣXi(Yi - (aXi + b)) = 0∂S/∂b = -2Σ(Yi - (aXi + b)) = 0通过求解以上两个方程,我们可以得到最小二乘估计的闭合解:a = (ΣXiYi - n X̄Ȳ) / (ΣXi² - n X̄²)b = Ȳ - a X̄其中,X̄和Ȳ分别表示X和Y的均值,Σ表示求和符号。

4. 应用和优势最小二乘估计在实际应用中具有广泛的用途。

在经济学中,我们可以通过最小二乘估计来估计需求曲线和供给曲线的参数,从而预测市场的走势和变化。

在统计学中,最小二乘估计可以用于拟合数据并构建预测模型。

它是最经典的回归分析方法之一,可用于解释和预测变量之间的关系。

最小二乘估计具有一些优势。

最小二乘估计随着空间技术的发展,人类的活动开始进入了太空,对航天器(包括人造地球卫星、宇宙飞船、空间站和空间探测器等)的观测手段和轨道确定提出了很高的精度要求。

在计算技术高速发展的推动下,各种估计理论也因此引入到轨道估计方法中。

大约在1795年高斯在他那著名的星体运动轨道预报研究工作中提出了最小二乘法。

最小二乘法就成了估计理论的奠基石。

最小二乘估计不涉及观测数据的分布特性,它的原理不复杂,数学模型和计算方法也比较简单,编制程序不难,所以它颇受人们的重视,应用相当广泛。

对于严格的正态分布数据,最小二乘估值具有最优一致无偏且方差最小的特性。

实践证明,在没有粗差的情况下,大部分测量数据基本上符合正态分布。

这是最小二乘估计至今仍作为估计理论核心的基础。

最早的轨道确定就是利用最小二乘法,用全部观测数据确定某一历元时刻的轨道状态的“最佳”估值,即所谓的批处理算法定轨。

长期以来,在整个天体力学领域之中,各种天体的定轨问题,几乎都是采用这一方法。

卫星精密定轨的基本原理为:利用含有误差的观测资料和不精确的数学模型,通过建立观测量与卫星状态之间的数学关系,参数估计得到卫星状态及有关参数的最佳估值。

参数估计的基本问题就是对一个微分方程并不精确知道的动力学过程,用不精确的初始状态X0和带有误差的观测资料,求解其在某种意义下得卫星运动状态的“最佳”估值X。

常用的参数估计方法有两种,最小二乘法和卡尔曼滤波方法。

最小二乘法是在得到所有的观测数据之后,利用这些数据来估计初始时刻状态量的值,由于用到的观测数据多、计算方法具有统计特性,因此该方法精度高。

卡尔曼滤波在观测数据更新后,利用新的观测数据对状态量进行改进得到这一观测时刻的状态量,卡尔曼滤波适用于实时处理。

卫星精密定轨输运高精度的事后数据处理,通常采用最小二乘法进行参数估计。

记观测量的权阵为P。

利用加权最小二乘法计算总的观测方程方程y二Hx0•;,得x =(H T PH)JH T py卫星的参考状态为X; = X0 x0在精密定轨的过程中,由于状态方程和观测方程在线性化过程中会产生误差,上式的解算需要通过不断的迭代。

关于指数分布的参数的最小二乘方估计指数分布(Exponential Distribution)属于连续概率分布,由卡尔古德(Kolmogorov)提出,被广泛应用于数学统计。

它的概率密度函数为f(x;λ),其中λ > 0是形态参数。

指数分布的最小二乘法(Least Squares Estimation,LSE)可以帮助我们估计出概率密度函数的形态参数λ。

最小二乘法是一种用来估计概率模型参数的统计方法,它将所有模型给定时观测误差的平方和最小化,从而实现参数估计。

式(1)是最小二乘估计求解模型参数的一般迭代形式,其中n是观测数据中的样本数,x_i和y_i分别是第i个样本的输入向量和输出向量。

LSE(λ) = min λ {∑_(i=1)^n (y_i -f(x_i; λ))^2} (1)用最小二乘估计法来估计指数分布的形态参数λ,首先要测量观测数据中的样本量,与之相配置的输入向量和输出向量,进而根据(1)式计算出形态参数λ。

关于求解模型参数的具体步骤可以参照:(1)根据实验数据集计算出指数分布定义域中的样本点;(2)根据指数分布的定义和实验数据,将x和y分别作为样本的输入向量和输出向量,分别令x_i表示实验数据中的i个样本(i = 1,2… n),将模型中的形态参数令为λ;(3)根据指数分布概率密度函数,构造模型容器f(x; λ),通过最小二乘估计求出模型参数λ,即可得出LSE(λ)的值;(4)检验模型的结果,查看实验数据是否符合指数分布的概率密度函数f(x;λ),确定是否满意估计结果。

最小二乘方法是一种常用的参数估计方法,用来估计指数分布的形态参数λ,可以很好地有效识别出模型的参数,通过求解式(1)可以估计出概率密度函数最优参数,帮助我们更好地分析数据。

最小二乘法求解参数

最小二乘法来估计参数,就是使得实际值与估计值的差距的平方最小。

β可以被已知的未知数计算得到是无偏估计的值。

但是用最小二乘法可以得到最好的线性无偏估计量,因为变异比较小。

所以这种方法就是最稳定的最通用的方法。

如果只有一个β1,也就是只有y与x1,则使用两样本t检验和回归分析是一样的。

因为两样本t检验就可以计算β的置信区间,因此也可以在该回归方程中。

另一种估计参数方法是最大似然函数,用此法估计参数值是一样的,但是仅对于y是连续值情况。

采用最小二乘估计式可以得到简单线性回归模型参数的估计量。

但是估计量参数与总体真实参数的接近程度如何。

在工程物理、化学工程、生物医学、统计学、经济学、信号处理、自动化、测绘学等领域中,许多问题都可归结为求解矩阵方程Ax=b 的问题。

通过计算机仿真说明了在模型中所有变量均具有不可忽略的误差时,全最小二乘法得到的参数估计更接近。

除了线性均方估计外,最小二乘估计是另一种不需要任何先验知识的参数估计方法,最小二乘估计不需要先验统计特性,适用范围更广。

、、。

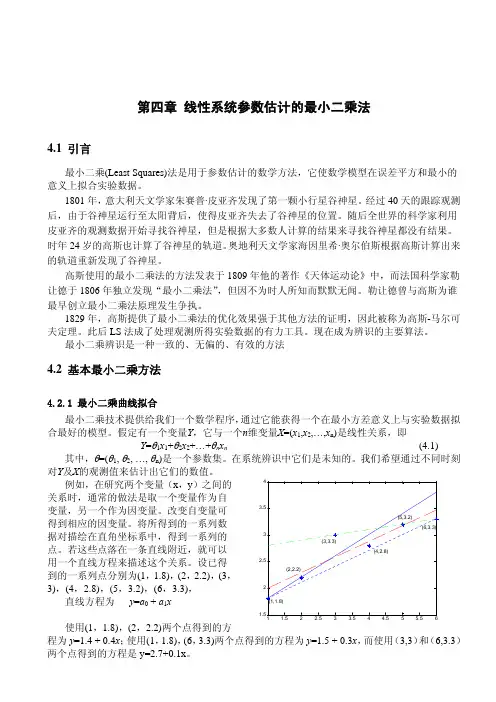

第四章 最小二乘法与组合测量§1概述最小二乘法是用于数据处理和误差估计中的一个很得力的数学工具。

对于从事精密科学实验的人们来说,应用最小乘法来解决一些实际问题,仍是目前必不可少的手段。

例如,取重复测量数据的算术平均值作为测量的结果,就是依据了使残差的平方和为最小的原则,又如,在本章将要用最小二乘法来解决一类组合测量的问题。

另外,常遇到用实验方法来拟合经验公式,这是后面一章回归分析方法的内容,它也是以最小二乘法原理为基础。

最小二乘法的发展已经经历了200多年的历史,它最先起源于天文和大地测量的需要,其后在许多科学领域里获得了广泛应用,特别是近代矩阵理论与电子计算机相结合,使最小二乘法不断地发展而久盛不衰。

本章只介绍经典的最小二乘法及其在组合测量中的一些简单的应用,一些深入的内容可参阅专门的书籍和文献。

§2最小二乘法原理最小二乘法的产生是为了解决从一组测量值中寻求最可信赖值的问题。

对某量x 测量一组数据n x x x ,,,21 ,假设数据中不存在系统误差和粗大误差,相互独立,服从正态分布,它们的标准偏差依次为:n σσσ ,,21记最可信赖值为x ,相应的残差x x v i i -=。

测值落入),(dx x x i i +的概率。

dx v P i i ii )2exp(2122σπσ-=根据概率乘法定理,测量n x x x ,,,21 同时出现的概率为n i ii ni i dx v P P )]()(21exp[)2(12∑-∏=∏=σπσ 显然,最可信赖值应使出现的概率P 为最大,即使上式中页指数中的因子达最小,即∑=iii Min v 22σ权因子:22o i i w σσ=即权因子i w ∝21iσ,则2[]i i wvv wv Min ==∑再用微分法,得最可信赖值x11ni ii nii w xx w===∑∑ 即加权算术平均值这里为了与概率符号区别,以i ω表示权因子。

矩估计与最小二乘估计

矩估计和最小二乘估计是经典的参数估计方法。

矩估计是指通过样本矩来估计总体参数,最小二乘估计是指通过最小化误差平方和来估计总体参数。

在矩估计中,我们首先确定需要估计的参数的矩的阶数。

然后,我们使用样本矩与总体矩之间的差异来估计参数。

例如,对于正态分布,我们可以使用样本均值和样本方差来估计总体均值和总体方差。

最小二乘估计中,我们要先建立一个模型,然后通过最小化预测值与实际值之间的误差平方和来估计模型参数。

例如,对于一条直线模型,我们可以通过最小化所有数据点到直线的距离的平方和来估计直线的斜率和截距。

两种方法都有其优点和缺点。

矩估计不需要对样本的分布做出假设,但是有时候可能会估计出偏差较大的参数。

最小二乘估计需要建立一个模型,但是可以通过非线性最小二乘估计来处理非线性模型。

总之,矩估计和最小二乘估计都是非常有用的参数估计方法,根据具体问题的不同,选择适合的方法可以更准确地估计总体参数。

- 1 -。

运用最小二乘法进行土木工程中混凝土容重的识别设实测某一施工阶段主梁m 个节段的挠度为向量R ,如公式(1)中所示。

[](1),(2),,()TR R R R m =⋅⋅⋅ (1)其中,R (1),R (2),……R (m )分别表示第1节段、第2节段、……、第m 个节段前端的挠度;该施工节段对应的理想状态的理论计算挠度(模型中的结果)为: [](1),(2),,()T C C C C m =⋅⋅⋅ (2)其中,C (1),C (2),……C (m )分别表示第1节段、第2节段、……、第m 个节段前端的计算挠度值,可以通过前后两个施工阶段的变形差得到;那么,R 与C 之前肯定存在一定的偏差,从而形成一误差向量S ,表达式如(3)、(4)所示:[](1),(2),()T S S S S m =⋅⋅⋅ (3)S C R =- (4)其中,S (1)=C (1)-R (1),S (2)=C (2)-R (2),……,S (m )=C (m )-R (m ),也即将对应节段的理论值与实际值相减;设待识别的参数为:[(1),(2),()]T n θθθθ= (5)其中,n 为参数误差识别的项数,而θ为参数的误差量。

由于θ引起的各节段挠度误差为向量s :[](1),(2),,()Ts s s s m =⋅⋅⋅ (6) s φθ= (7) 1111n m mn φφφφφ⎛⎫ ⎪ ⎪ ⎪⎝⎭= (8) 其中,φ为从参数误差θ到s 的一个线性转换矩阵,令向量θ为单位向量的时候,也即在模型中取参数的变化为单位1的变化,这样,就可以通过s 的变化得到φ的具体数值。

定义残差ε为:S s S εφθ=-=- (9) 残差包含了测量误差、参数估计误差及系统误差等因素在内。

从而可以得到:S φθε=+ (10) 方差:()()T T J S S εεφθφθ==-- (11)当0J θ∂=∂,即1()0T T S θφφφ--=时,J 达到最小,因此,θ的最小二乘估计为: ^1()T T S θφφφ-= (12)由于各个参数对于结构的影响各不相同,因此,在求算θ的最小二乘估计时,再引入重要性系数,即权重系数Λ。

第四章最小二乘法与组合测量§1概述最小二乘法是用于数据处理和误差估计中的一个很得力的数学工具。

对于从事精密科学实验的人们来说,应用最小乘法来解决一些实际问题,仍是目前必不可少的手段。

例如,取重复测量数据的算术平均值作为测量的结果,就是依据了使残差的平方和为最小的原则,又如,在本章将要用最小二乘法来解决一类组合测量的问题。

另外,常遇到用实验方法来拟合经验公式,这是后面一章回归分析方法的内容,它也是以最小二乘法原理为基础。

最小二乘法的发展已经经历了200多年的历史,它最先起源于天文和大地测量的需要,其后在许多科学领域里获得了广泛应用,特别是近代矩阵理论与电子计算机相结合,使最小二乘法不断地发展而久盛不衰。

本章只介绍经典的最小二乘法及其在组合测量中的一些简单的应用,一些深入的内容可参阅专门的书籍和文献。

§2最小二乘法原理最小二乘法的产生是为了解决从一组测量值中寻求最可信赖值的问题。

对某量x 测量一组数据n x x x ,,,21 ,假设数据中不存在系统误差和粗大误差,相互独立,服从正态分布,它们的标准偏差依次为:n σσσ ,,21记最可信赖值为x ,相应的残差x x v i i -=。

测值落入),(dx x x i i +的概率。

根据概率乘法定理,测量n x x x ,,,21 同时出现的概率为显然,最可信赖值应使出现的概率P 为最大,即使上式中页指数中的因子达最小,即权因子:22oi iw σσ=即权因子i w ∝21i σ,则再用微分法,得最可信赖值x11ni ii nii w xx w===∑∑即加权算术平均值这里为了与概率符号区别,以i ω表示权因子。

特别是等权测量条件下,有:以上最可信赖值是在残差平方和或加权残差平方和为最小的意义下求得的,称之为最小二乘法原理。

它是以最小二乘方而得名。

为从一组测量数据中求得最佳结果,还可使用其它原理。

例如(1)最小绝对残差和法:Min v i =∑ (2)最小最大残差法:Min v i =max (3)最小广义权差法:Min v v i i =-m in m ax以上方法随着电子计算机的应用才逐渐引起注意,但最小二乘法便于解析,至今仍用得最广泛。

§3.线性参数最小二乘法先举一个实际遇到的测量问题,为精密测定三个电容值:321,,x x x 采用的测量方案是,分别等权、独立测得323121,,,x x x x x x ++,列出待解的数学模型。

1x =0.32x =-0.4 1x +3x =0.52x +3x =-0.3这是一个超定方程组,即方程个数多于待求量个数,不存在唯一的确定解,事实上,考虑到测量有误差,记它们的测量误差分别为4321,,,v v v v ,按最小二乘法原理∑=Min vi2分别对321,,x x x 求偏导数,令它们等于零,得如下的确定性方程组。

(1x -0.3)+(1x +3x -0.5)=0 (2x +0.4)+(2x +3x +0.3)=0 (1x +3x -0.5)+(2x +3x +0.3)=0可求出唯一解1x =0.325,2x =-0.425,3x =0.150这组解称之为原超定方程组的最小二乘解。

以下,一般地讨论线性参数测量方程组的最小二乘解及其精度估计。

一、正规方程组设线性测量方程组的一般形式为: 即式中,有n 个直接测得值n y y y ,,,21 ,t 个待求量t x x x ,,,21 。

n>t,各i y 等权,无系统误差和粗大误差。

固i y 含有测量误差,每个测量方程都不严格成立,故有相应的测量残差方程组i y 实测值j x 待估计量,最佳估计值,最可信赖值∑=tj j ijx a1最可信赖的“y ”值。

按最小二乘法原理,待求的j x 应满足上式分别对j x 求偏导数,且令其等于零,经推导得⎪⎪⎭⎪⎪⎬⎫=+++=+++=+++][][][][][][][][][][][][22112222211211221111a x a a x a a x a a a x a a x a a x a a a x a a x a a x a a t t t t t t t t t t 正规方程组式中,j a ,y 分别为如下列向量][k l a a 和][y a j 分别为如下两列向量的内积: ][k l a a =nk nl k l k l a a a a a a +++ 2211 ][y a j =n nj j j y a y a y a +++ 2211正规方程组有如下特点:(1)主对角线系数是测量方程组各列系数的平方和,全为正数。

(2)其它系数关于主对角线对称(3)方程个数等于待求量个数,有唯一解。

由此可见,线性测量方程组的最小二乘解归结为对线性正规方程组的求解。

为了便于进一步讨论问题,下面借助矩阵工具给出正规方程组的矩阵形式。

记列向量 和n ×t 阶矩阵 则测量方程组可记为:AX =Y ——一般意义下的方程组测量残差方程组记为当估计出的j x 已经是最可信赖的值,则AX 是i y 的最佳结果。

最小二乘原理记为 利用矩阵的导数及其性质有令()0x∂=∂T V V ,得正规方程组的矩阵形式。

展开系数矩阵T A A 和列向量T A L ,可得代数形式的正规方程组。

上述①②和矩阵的导数有关,因此,我们来分析“矩阵最小二乘法”。

二、矩阵最小二乘法 1.矩阵的导数设n t ⨯阶矩阵。

1112121222122()()t i t ij t ni n nt a a a A a a a a A A A a a a ⎛⎫⎪=== ⎪ ⎪⎝⎭)n 阶列向量(n+1阶矩阵)V 和t 阶列向量XV 与X 的转置(行向量)记为T V 与T X . 关于向量X 的标量函数。

定义如下几个导数。

(1)矩阵对标量x 的导数矩阵内A 元素ij a 是x 的函数,对矩阵AX 的导数,定义为各元素对x 的导数,构成新的导数矩阵。

若ij a 是变量x 的函数,则定义()ij da d dx dx=A(E-1) (2)标量函数对向量的导数标量函数ϕ,对列向量X 的导数,等于标量函数ϕ对向量X 的组成元素(1)i x i t =~的导数组成的列向量(行向量的转置)12()Tty y y y x x x x ∂∂∂∂=∂∂∂∂(E-2)标量函数ϕ,对行向量T X 的导数,等于标量函数ϕ对向量X 的组成元素(1)i x i t =~的导数组成的行向量。

21()()T T t y y y y yx x x x x∂∂∂∂∂==∂∂∂∂∂(E-3) (3)行(列)向量对列(行)向量的导数行向量T V 对列向量X 的导数等于行向量各组成元素,对列向量各组成元素分别求得11112221n n i n n t t v v x x v v v v v x x x x x xv v x x ∂∂⎛⎫ ⎪∂∂ ⎪ ⎪∂∂∂∂∂∂ ⎪∂∂== ⎪∂∂∂∂ ⎪ ⎪∂∂ ⎪ ⎪∂∂⎝⎭TV(E-4) 11122121()t TT n t T T Tn n it v v x x v v v v v x x x x x v v x x ∂∂⎛⎫ ⎪∂∂ ⎪ ⎪∂∂⎛⎫∂∂∂∂∂ ⎪∂∂== ⎪ ⎪∂∂∂∂∂⎝⎭ ⎪ ⎪∂∂ ⎪ ⎪∂∂⎝⎭=T T V V X X (E-5)关于矩阵的导数有如下性质: (1)矩阵A 和B 乘积对标量x 的导数()d d d dx dx dx=+AB B AA B (E-6) (2)常数阵的导数为零矩阵。

0d dx=A(E-7) (3)向量关于自身转置向量的导数为单位方阵。

I ∂=∂T TX dX=X dX (E-8)(4)向量与向量转置乘积的导数()∂∂∂∂T TV V V =2V x x (E-9) ()2∂∂=∂∂T T T T V V V V X X(E-10) (5)关于常数矩阵与向量乘积的导数()∂=∂T X A A X (E-11) ()∂∂T T TA X =A X(E-12) ()∂∂∂∂T TV V AV =2AV X X(E-13) ()∂∂∂∂T TT TV AV =2V A X X(E-14) 利用(E-1)、(E-4)、和(E-5)三个定义式,容易证明式(E-6)、(E-7)、(E-8)、和(E-11)、(E-11)成立。

①以下证明式(E-9)注意到式(E-2)和式(E-4)即, 标量对列向量求导12()Ttx x x x ϕϕϕϕ∂∂∂∂=∂∂∂∂(E-2) 行向量对列向量求导111112221()n n Tn n t t v v x x v v v v v x x v v x x ∂∂⎛⎫⎪∂∂ ⎪ ⎪∂∂∂∂∂∂ ⎪∂∂== ⎪∂∂∂∂ ⎪ ⎪∂∂ ⎪ ⎪∂∂⎝⎭V X X XX(E-4) 式(E-9)左11112122()22n n i i n nt t v v v v x x v x v v v v xx ∂∂⎛⎫++ ⎪∂∂ ⎪∂⎪==∂⎪∂∂ ⎪++ ⎪∂∂⎝⎭∑类似地,可以证得式(E-10)成立。

②再证明式(E-13)注意到T V AV 是关于x 的标量函数,由式(E-2)知,只需证明由于1211121121212()()n n i i i Tn iin n n nn i i i v v v a a a x x x V v v v x v v v a a a x x x ∂∂∂⎛⎫ ⎪∂∂∂ ⎪∂⎪=∂ ⎪∂∂∂ ⎪⎪∂∂∂⎝⎭AV 11111111n ni i n n nnn n i i v v a v a v x x v v a v a v x ax α∂∂⎛⎫++ ⎪∂∂⎪ ⎪=⎪∂ ⎪++ ⎪∂⎝⎭=11111111n n iin n n nn n i nv v a v a v x x v v a v a v x x ∂∂⎛⎫++⎪∂∂ ⎪ ⎪ ⎪∂∂ ⎪++ ⎪∂∂⎝⎭所以式(E-13)左()+2i i i AV x x x ∂∂∂===∂∂∂右T T T V V AV V AV 2.正规方程设线性测量方程组与基残差方程组分别为AX =Y (E-15) L AX =V -(E-16)式中A 为n t ⨯阶常数矩阵,X 为t 阶待求向量,L 是已知的n 阶的测量向量,(注意12,,n l l l 均是已测量所得),V 是n 阶残差向量。

由最小二乘原理 求()2∂∂=∂∂T TV V V V X X(矩阵性质(E-9)式) 注意到式(E-7)即常数阵的导数为零矩阵。

注意到式(E-11)即()∂=∂T X A A X,故所以 令()0∂=∂T V V X得正规方程组的矩阵形式 T T A A X =A L (E-18)当T A A 满秩的情形,可求出1()-=T T X A A A L (E-19)一般地,可从式(E-15)出发,用稳定的数值解法,计算A 的广义逆阵1A -得1A -=X L (E-20)要进一步去研究此问题,可参阅有关近代矩阵分析及其数值方法的专着 3.待求量X 的协方差矩阵。