第十一章 条件随机场

- 格式:pdf

- 大小:2.64 MB

- 文档页数:60

条件随机场的基础知识条件随机场(Conditional Random Field,简称CRF)是一种概率图模型,常用于序列标注、自然语言处理、计算机视觉等领域。

它是一种无向图模型,用于建模输入序列和输出序列之间的关系。

本文将介绍条件随机场的基础知识,包括定义、特点、参数表示和推断算法等内容。

一、定义条件随机场是给定一组输入序列X的条件下,对应的输出序列Y的联合概率分布模型。

它假设输出序列Y是给定输入序列X的马尔可夫随机场,即满足马尔可夫性质。

条件随机场的定义如下:P(Y|X) = 1/Z(X) * exp(∑k∑lλkTk(yi-1, yi, X, i) +∑m∑nμnUn(yi, X, i))其中,Y表示输出序列,X表示输入序列,Tk和Un是特征函数,λk和μn是对应的权重参数,Z(X)是归一化因子。

二、特点条件随机场具有以下几个特点:1. 无向图模型:条件随机场是一种无向图模型,图中的节点表示输出序列的标签,边表示标签之间的依赖关系。

2. 局部特征:条件随机场的特征函数是局部的,只依赖于当前位置和相邻位置的标签。

3. 马尔可夫性质:条件随机场假设输出序列是给定输入序列的马尔可夫随机场,即当前位置的标签只与前一个位置的标签有关。

4. 概率模型:条件随机场是一种概率模型,可以计算输出序列的概率分布。

三、参数表示条件随机场的参数表示方式有两种:全局参数和局部参数。

1. 全局参数:全局参数表示整个条件随机场的权重参数,对所有特征函数都起作用。

2. 局部参数:局部参数表示每个特征函数的权重参数,只对对应的特征函数起作用。

四、推断算法条件随机场的推断算法主要包括前向-后向算法和维特比算法。

1. 前向-后向算法:前向-后向算法用于计算给定输入序列X的条件下,输出序列Y的边缘概率分布P(yi|X)。

它通过前向和后向两个过程,分别计算前缀和后缀的边缘概率。

2. 维特比算法:维特比算法用于求解给定输入序列X的条件下,输出序列Y的最优路径。

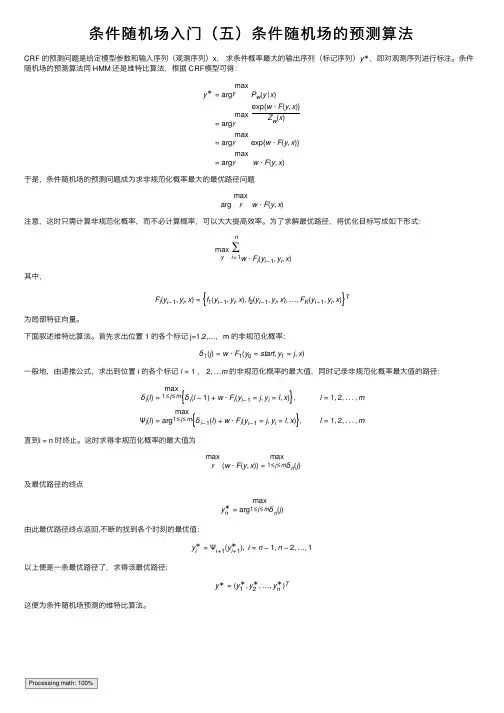

条件随机场⼊门(五)条件随机场的预测算法CRF 的预测问题是给定模型参数和输⼊序列(观测序列)x , 求条件概率最⼤的输出序列(标记序列)y ∗,即对观测序列进⾏标注。

条件随机场的预测算法同 HMM 还是维特⽐算法,根据 CRF 模型可得:y ∗=arg max y P w (y |x )=arg max yexp{w ⋅F (y ,x )}Z w (x )=arg max y exp{w ⋅F (y ,x )}=arg max y w ⋅F (y ,x )于是,条件随机场的预测问题成为求⾮规范化概率最⼤的最优路径问题arg max y w ⋅F (y ,x )注意,这时只需计算⾮规范化概率,⽽不必计算概率,可以⼤⼤提⾼效率。

为了求解最优路径,将优化⽬标写成如下形式:max y n ∑i =1w ⋅F i (y i −1,y i ,x )其中,F i (y i −1,y i ,x )=f 1(y i −1,y i ,x ),f 2(y i −1,y i ,x ),…,F K (y i −1,y i ,x )T为局部特征向量。

下⾯叙述维特⽐算法。

⾸先求出位置 1 的各个标记 j=1,2,…,m 的⾮规范化概率:δ1(j )=w ⋅F 1(y 0=start ,y 1=j ,x )⼀般地,由递推公式,求出到位置 i 的各个标记 l =1,2,…m 的⾮规范化概率的最⼤值,同时记录⾮规范化概率最⼤值的路径:δi (l )=max 1≤j ≤m δi (l −1)+w ⋅F i (y i −1=j ,y i =l ,x ), l =1,2,...,m Ψi (l )=arg max 1≤j ≤m δi −1(l )+w ⋅F i (y i −1=j ,y i =l ,x ),l =1,2,...,m 直到i = n 时终⽌。

这时求得⾮规范化概率的最⼤值为max y (w ⋅F (y ,x ))=max 1≤j ≤m δn (j )及最优路径的终点y ∗n =arg max 1≤j ≤m δn (j )由此最优路径终点返回,不断的找到各个时刻的最优值:y ∗i =Ψi +1(y ∗i +1), i =n −1,n −2,…,1以上便是⼀条最优路径了,求得该最优路径:y ∗=(y ∗1,y ∗2,…,y ∗n )T 这便为条件随机场预测的维特⽐算法。

条件随机场(Conditional Random Field, CRF)是一种用于序列标注和结构化预测的概率图模型。

它在自然语言处理、计算机视觉等领域有着广泛的应用,如命名实体识别、分词、词性标注等任务。

CRF模型的性能很大程度上取决于特征的选择和抽取。

本文将结合实际案例,探讨CRF模型中特征选择与抽取的一些技巧和注意事项。

数据准备首先,我们需要准备好用于训练和测试的数据。

在NLP任务中,通常会使用已经标注好的语料库作为数据集。

一个常见的做法是将数据集分为训练集和测试集,以便评估模型的性能。

另外,为了减少模型过拟合的风险,还可以使用交叉验证的方法。

特征选择在CRF模型中,特征选择是非常重要的一步。

特征的选择应该充分考虑到任务的领域知识和实际需求。

以命名实体识别为例,可以考虑选择词性、词性组合、前后词性等特征。

此外,还可以考虑上下文信息、词性转移概率等特征。

需要注意的是,特征的数量不能过多,否则会导致模型的复杂度过高,训练时间过长。

特征抽取特征抽取是将原始数据转化为模型可以处理的特征表示形式。

在NLP任务中,常用的特征抽取方法包括词袋模型、TF-IDF、word embedding等。

在CRF模型中,一般会将输入序列转化为特征向量序列。

需要注意的是,特征抽取过程中要考虑到数据的稀疏性和维度灾难问题。

可以通过降维、特征选择等方法来解决这些问题。

特征模板在CRF模型中,特征模板是描述特征之间关系的一种形式。

特征模板的设计直接影响到模型的性能。

在实际应用中,往往需要根据具体任务和数据的特点来设计特征模板。

以命名实体识别为例,可以设计包括当前词的特征、上下文特征、前缀和后缀特征等多种特征模板。

需要注意的是,特征模板的数量不宜过多,否则会导致模型复杂度过高。

实例分析下面我们以中文分词任务为例,来看一下特征选择与抽取在CRF模型中的具体应用。

假设我们有一段中文文本“我爱北京天安门”,需要对其进行分词。

首先,我们可以选择一些基本的特征,如词本身、词性等。

条件随机场相关的方法全文共四篇示例,供读者参考第一篇示例:条件随机场(Conditional Random Fields, CRF)是一种统计建模方法,常用于序列标注、自然语言处理和计算机视觉等领域。

CRF的主要优势是可以利用上下文信息进行建模,以及可以处理由于标签之间的依赖关系导致的标签歧义问题。

本文将介绍一些与条件随机场相关的方法,包括CRF的基本概念、CRF的训练和推断算法、以及CRF 在自然语言处理和计算机视觉中的应用。

一、CRF的基本概念CRF是一种概率图模型,用于对序列数据进行建模。

在CRF中,我们需要定义一个特征函数集合,每个特征函数表示输入序列和输出标签之间的依赖关系。

给定一个输入序列X和对应的输出标签序列Y,我们可以定义CRF的概率分布为:P(Y|X) = 1/Z(X) * exp(∑wi*fi(Y,X))其中Z(X)是规范化因子,使得条件概率分布P(Y|X)的所有可能取值的总和等于1;wi是特征函数fi的权重。

二、CRF的训练和推断算法CRF的训练过程通常使用最大似然估计或最大熵准则,通过利用训练数据集的标注信息来学习特征函数的权重。

CRF的推断过程通常使用近似推断算法,如维特比算法或前向-后向算法,来寻找给定输入序列X的最优输出标签序列Y。

三、CRF在自然语言处理中的应用在自然语言处理领域,CRF常用于词性标注、命名实体识别、句法分析等任务。

通过利用上下文信息和标签之间的依赖关系,CRF可以在这些任务中取得更好的性能。

四、CRF在计算机视觉中的应用条件随机场是一种强大的概率建模方法,可以用于序列标注、自然语言处理、计算机视觉等各种领域。

通过使用CRF,我们可以充分利用上下文信息和标签之间的依赖关系,从而提高模型的性能和泛化能力。

希望本文介绍的与条件随机场相关的方法能够对读者有所帮助。

第二篇示例:条件随机场(Conditional Random Field, CRF)是一种用于序列标注问题的概率模型,它在自然语言处理、计算机视觉、生物信息学等领域都有广泛的应用。

条件随机场知识整理(超长文!)最近用条件随机场完成了一个任务,效果不错,总结起来感觉收获很大,我来给大家谈谈有关条件随机场的理论和有关的落地方案。

理论有关条件随机场的理论,其实大量材料都讲的很完整,嗯,我用的是完整,因为难度真的不低,下面简单总结一下我看的比较好的材料。

•《统计学习方法》第二版,李航。

这应该是有关条件随机场完整的解释了。

•条件随机场(CRF):https:///Scythe666/article/details/82021692。

整个有关知识的链路解释的都比较清楚。

当然,我肯定不是放了资料就走的,我来说说我对CRF的理解线路,角度可能比较特别,可供大家协助理解,当然的,有关细节知识还要靠大家仔细啃的。

大量的材料都是从概率无向图,向条件随机场的角度去讨论,但是我比较喜欢从条件随机场,尤其是线性链条件随机场的概念出发理解,然后引入团和概率无向图的因子分解来解释和处理;理解这两个概念后,用HC定理解释其参数化形式、简化形式和矩阵形式,这样一来,整个条件随机场的运作就会比较明显了在此基础上,概率图的三大问题就会迎刃而解——概率问题、参数估计问题和预测问题。

条件随机场的概念条件随机场其实定义不是特别难。

简单地说,对于特定位置的Y,他在已知特征且Y相邻点的条件下的概率,与已知条件且不与Y相邻点的条件下的概率,是相同的。

这个概念能在线性链条件随机场上能体现的更加清晰。

相邻和不相邻的概念非常清晰,对于Y(t),相邻的其实就是Y(t-1)和Y(t+1),其他的就是不相邻的。

看图。

其实理解了条件随机场的定义,但是不够,要做预测我们是需要知道P(y|x)的直接关系,不能依赖y的上下文,因此我们要进行分解,要进行分解,我们引入图论里面团的概念,从而推导出条件随机场的多种形式。

条件随机场的形式Hammersley-Clifford定理直接给出:在导出条件随机场的参数化形式之前,来继续看看里面的势函数,即上面提到的严格正函数,一般地,使用指数函数。

自然语言处理(NLP)是人工智能领域中的一个重要分支,其研究的核心问题之一就是命名实体识别(NER)。

命名实体识别是指识别文本中具有特定意义的实体,如人名、地名、组织机构名等。

在NLP中,命名实体识别是一项基础性任务,对于许多应用场景都有着重要的意义。

在本文中,我们将介绍几种常见的命名实体识别模型。

一、条件随机场(CRF)条件随机场是一种概率图模型,常用于序列标注问题,如命名实体识别。

CRF模型能够利用上下文信息来提高实体识别的准确性,其模型结构能够捕捉实体之间的依赖关系,从而更好地识别实体边界。

CRF模型在命名实体识别任务中表现出色,尤其是在标注数据较为充分的情况下,可以达到较高的准确率和召回率。

然而,CRF模型也存在一些问题,比如对于长距离依赖关系的建模能力有限,同时需要大量标注数据进行训练。

二、循环神经网络(RNN)循环神经网络是一种能够处理序列数据的神经网络模型,常用于自然语言处理任务中。

在命名实体识别任务中,RNN模型能够通过学习上下文信息来识别实体,其记忆性能使得其能够捕捉长距离的依赖关系。

然而,传统的RNN模型存在梯度消失或梯度爆炸等问题,导致其在长序列数据上的训练效果不佳。

为了解决这一问题,人们提出了一系列的改进模型,如长短时记忆网络(LSTM)和门控循环单元(GRU),这些模型在命名实体识别任务中取得了显著的性能提升。

三、注意力机制(Attention)注意力机制是一种能够学习对输入数据进行加权处理的机制,常用于处理序列数据。

在命名实体识别任务中,注意力机制能够帮助模型更好地关注关键信息,从而提高实体识别的准确性。

基于注意力机制的模型,如Transformer模型,在NLP领域取得了巨大成功,其在命名实体识别任务中也表现出色。

四、深度学习与迁移学习近年来,深度学习技术的发展为命名实体识别任务带来了新的机遇。

深度学习模型能够从大规模数据中学习特征表示,从而提高命名实体识别的性能。

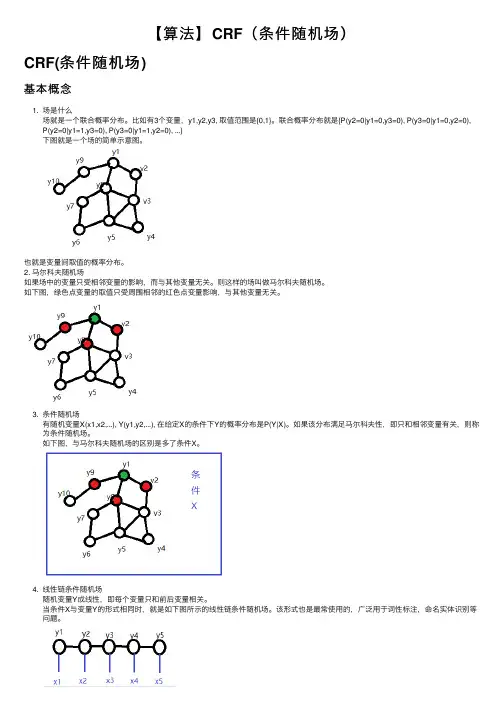

【算法】CRF(条件随机场)CRF(条件随机场)基本概念1. 场是什么场就是⼀个联合概率分布。

⽐如有3个变量,y1,y2,y3, 取值范围是{0,1}。

联合概率分布就是{P(y2=0|y1=0,y3=0), P(y3=0|y1=0,y2=0), P(y2=0|y1=1,y3=0), P(y3=0|y1=1,y2=0), ...}下图就是⼀个场的简单⽰意图。

也就是变量间取值的概率分布。

2. 马尔科夫随机场如果场中的变量只受相邻变量的影响,⽽与其他变量⽆关。

则这样的场叫做马尔科夫随机场。

如下图,绿⾊点变量的取值只受周围相邻的红⾊点变量影响,与其他变量⽆关。

3. 条件随机场有随机变量X(x1,x2,...), Y(y1,y2,...), 在给定X的条件下Y的概率分布是P(Y|X)。

如果该分布满⾜马尔科夫性,即只和相邻变量有关,则称为条件随机场。

如下图,与马尔科夫随机场的区别是多了条件X。

4. 线性链条件随机场随机变量Y成线性,即每个变量只和前后变量相关。

当条件X与变量Y的形式相同时,就是如下图所⽰的线性链条件随机场。

该形式也是最常使⽤的,⼴泛⽤于词性标注,命名实体识别等问题。

对于词性标注来说,x就是输⼊语句的每⼀个字,y就是输出的每个字的词性。

线性链条件随机场的表⽰设\(P(Y|X)\)是线性链条件随机场,则在给定\(X\)的取值\(x\)的情况下,随机变量\(Y\)取值为\(y\)的条件概率可以表达为:\[P(y|x)=\frac{1}{Z(x)}exp\left(\sum_{i,k}{\lambda_kt_k(y_{i-1}, y_i,x,i)}+\sum_{i,l}\mu_ls_l(y_i,x,i)\right) \]\[Z(x)=\sum_yexp\left(\sum_{i,k}{\lambda_kt_k(y_{i-1}, y_i,x,i)}+\sum_{i,l}\mu_ls_l(y_i,x,i)\right) \]\(i\): 表⽰当前位置下标\(t_k()\):表⽰相邻两个输出间的关系,是转移特征函数。

条件分布定义及其在随机过程中的应用在概率论中,条件分布是指在给定一些信息或事件时,随机变量的概率分布。

简单地说,条件分布是指事件发生的条件下,其他事件发生的概率。

条件分布在随机过程中有很多应用,本文将对条件分布的定义及其在随机过程中的应用进行深入讨论。

一、条件分布的定义条件分布的定义可以由条件概率来推导。

设A、B是两个事件,且P(B)>0,则在事件B发生的条件下事件A的条件概率为:P(A|B) = P(AB) / P(B)其中,P(AB)表示事件A和B同时发生的概率,P(B)表示事件B发生的概率。

如果X和Y是两个随机变量,P(Y=y)>0,则在Y=y的条件下X的条件概率为:P(X=x|Y=y) = P(X=x,Y=y) / P(Y=y)其中,P(X=x,Y=y)表示X=x和Y=y同时发生的概率,P(Y=y)表示随机变量Y=y的概率。

进一步地,可以得到X的条件分布函数:F(x|Y=y) = P(X≤x|Y=y)X的条件概率密度函数f(x|Y=y)则由条件分布函数求导得到:f(x|Y=y) = d/dx F(x|Y=y)二、条件分布的特性条件分布具有以下一些特性:1. 相互独立性:如果X和Y是独立的,则P(X=x|Y=y) =P(X=x)。

2. 概率归一性:条件概率和等于1,即∑ P(X=x|Y=y) = 1。

3. 乘法公式:由条件概率的定义可以得到乘法公式:P(X=x,Y=y) = P(Y=y|X=x)P(X=x)4. 全期望公式:设X和Y是两个随机变量,则:E(X) = E[E(X|Y)]其中,E(X|Y)表示在Y条件下X的期望。

三、条件分布的应用条件分布在随机过程中有很多应用,本节将讨论其中的一些应用。

1. 马尔可夫性质在马尔可夫链中,当前状态只与前一状态有关,在这种情况下,当前状态的条件分布只与前一状态有关。

具体地说,可以得到下面的等式:P(Xn+1 = j|Xn=i,Xn-1=k,Xn-2=l,…,X0) = P(Xn+1=j|Xn=i)其中,Xn表示第n个状态,Xn+1表示第n+1个状态,i、j、k、l是两个状态之间的节点。

条件随机场条件随机场(Conditional Random Fields,CRF)是一种概率图模型,常用于序列标注问题。

它是基于给定输入序列的条件下,对输出序列进行建模的方法。

CRF的设计使得它特别适用于自然语言处理和计算机视觉等领域的序列标注任务。

设输入序列为X,输出序列为Y,我们的目标是根据输入序列X预测输出序列Y。

CRF将标注问题建模为一个条件概率模型P(Y,X),即给定输入序列X下输出序列Y的条件概率分布。

CRF的核心思想是将标注问题转化为一个由输入序列和输出序列共同决定的全局能量最小化问题。

在CRF中,输出序列Y的概率分布由特征函数的线性组合表示,特征函数是关于输入序列X和输出序列Y的函数。

特征函数可以根据问题的特定需求来设计。

经典的特征函数有:1.状态特征函数:描述当前状态下的输出特征,例如当前词的词性标记。

2.转移特征函数:描述相邻状态之间的输出特征,例如当前词的词性标记和下一个词的词性标记之间的转移特征。

3.开始特征函数和结束特征函数:描述开始和结束状态的输出特征。

CRF的核心是定义全局能量函数,其通过特征函数的线性组合来度量给定输入序列X和输出序列Y的不匹配程度。

全局能量函数可以表示为以下形式:E(Y,X)=∑F_k(Y,X)∙w_k其中,F_k(Y,X)表示第k个特征函数,w_k表示对应的权重。

全局能量函数越小,意味着输出序列Y的概率越大。

在CRF中,我们通过最大熵原理来确定权重w_k。

最大熵原理认为模型在给定输入序列X下的条件下,应当满足的约束是使得模型的熵达到最大。

我们使用拉格朗日乘子法来求解权重w_k,以最小化目标函数。

在训练阶段,我们使用训练数据来估计CRF模型的参数(即权重w_k)。

常用的参数估计方法有最大似然估计和最大正则化似然估计。

在预测阶段,给定一个新的输入序列X,我们可以使用动态规划算法(如前向-后向算法)来求解输出序列的最优解。

动态规划算法可以高效地计算全局能量函数。

随机场、马尔可夫随机场、条件随机场最近看视觉显著性方面的文章,看到一篇2011年2月的PAMI文章Learning to Detect a Salient Object,论文提出一种基于条件随机场(CRF)的特征组合方法将显著目标提取问题看做二值标记问题来解决。

之前没有接触过条件随机场,经过两天的学习,现在总结一下并巩固梳理:(1)随机场:在概率论中, 由样本空间Ω = {0, 1, ..., G 1}n取样构成的随机变量Xi所组成的S= {X1, ..., Xn}。

若对所有的ω∈Ω下式均成立,则称π为一个随机场。

一些已有的随机场如:马尔可夫随机场(MRF), 吉布斯随机场(GRF), 条件随机场(CRF), 和高斯随机场。

随机场包含两个要素:位置(site),相空间(phase space)。

当给每一个位置中按照某种分布随机赋予相空间的一个值之后,其全体就叫做随机场。

我们不妨拿种地来打个比方。

“位置”好比是一亩亩农田;“相空间”好比是种的各种庄稼。

我们可以给不同的地种上不同的庄稼,这就好比给随机场的每个“位置”,赋予相空间里不同的值。

所以,俗气点说,随机场就是在哪块地里种什么庄稼的事情。

(2)马尔科夫(Markov)性质:马尔可夫链是随机变量X1, … , Xn 的一个数列。

这些变量的范围,即他们所有可能取值的集合,被称为“状态空间”,而Xn 的值则是在时间n 的状态。

如果Xn+1 对于过去状态的条件概率分布仅是Xn 的一个函数,则这里x 为过程中的某个状态。

上面这个恒等式可以被看作是马尔可夫性质。

马尔可夫链的在很多应用中发挥了重要作用,例如,谷歌所使用的网页排序算法(PageRank)就是由马尔可夫链定义的。

通俗说,离当前因素比较遥远(这个遥远要根据具体情况自己定义)的因素对当前因素的性质影响不大。

简单说,就叫健忘。

拿天气来打个比方。

如果我们假定天气是马尔可夫的,其意思就是我们假设今天的天气仅仅与昨天的天气存在概率上的关联,而与前天及前天以前的天气没有关系。

条件随机场(Conditionalrandomfield,CRF)本⽂简单整理了以下内容:(⼀)马尔可夫随机场(Markov random field,⽆向图模型)简单回顾(⼆)条件随机场(Conditional random field,CRF)这篇写的⾮常浅,基于 [1] 和 [5] 梳理。

感觉 [1] 的讲解很适合完全不知道什么是CRF的⼈来⼊门。

如果有需要深⼊理解CRF的需求的话,还是应该仔细读⼀下⼏个英⽂的tutorial,⽐如 [4] 。

(⼀)马尔可夫随机场简单回顾概率图模型(Probabilistic graphical model,PGM)是由图表⽰的概率分布。

概率⽆向图模型(Probabilistic undirected graphical model)⼜称马尔可夫随机场(Markov random field),表⽰⼀个联合概率分布,其标准定义为:设有联合概率分布 P(V) 由⽆向图 G=(V, E) 表⽰,图 G 中的节点表⽰随机变量,边表⽰随机变量间的依赖关系。

如果联合概率分布 P(V) 满⾜成对、局部或全局马尔可夫性,就称此联合概率分布为概率⽆向图模型或马尔可夫随机场。

设有⼀组随机变量 Y ,其联合分布为 P(Y) 由⽆向图 G=(V, E) 表⽰。

图 G 的⼀个节点v\in V表⽰⼀个随机变量Y_v,⼀条边e\in E就表⽰两个随机变量间的依赖关系。

1. 成对马尔可夫性(pairwise Markov property)设⽆向图 G 中的任意两个没有边连接的节点 u 、v ,其他所有节点为 O ,成对马尔可夫性指:给定Y_O的条件下,Y_u和Y_v条件独⽴P(Y_u,Y_v|Y_O)=P(Y_u|Y_O)P(Y_v|Y_O)2. 局部马尔可夫性(local)设⽆向图 G 的任⼀节点 v ,W 是与 v 有边相连的所有节点,O 是 v 、W 外的其他所有节点,局部马尔可夫性指:给定Y_W的条件下,Y_v和Y_O条件独⽴P(Y_v,Y_O|Y_W)=P(Y_v|Y_W)P(Y_O|Y_W)当P(Y_O|Y_W)>0时,等价于P(Y_v|Y_W)=P(Y_v|Y_W,Y_O)如果把等式两边的条件⾥的Y_W遮住,P(Y_v)=P(Y_v|Y_O)这个式⼦表⽰Y_v和Y_O独⽴,进⽽可以理解这个等式为给定条件Y_W下的独⽴。