LDA线性判别分析报告

- 格式:ppt

- 大小:1.56 MB

- 文档页数:16

线性判别分析(LinearDiscriminantAnalysis,LDA)⼀、LDA的基本思想线性判别式分析(Linear Discriminant Analysis, LDA),也叫做Fisher线性判别(Fisher Linear Discriminant ,FLD),是模式识别的经典算法,它是在1996年由Belhumeur引⼊模式识别和⼈⼯智能领域的。

线性鉴别分析的基本思想是将⾼维的模式样本投影到最佳鉴别⽮量空间,以达到抽取分类信息和压缩特征空间维数的效果,投影后保证模式样本在新的⼦空间有最⼤的类间距离和最⼩的类内距离,即模式在该空间中有最佳的可分离性。

如下图所⽰,根据肤⾊和⿐⼦⾼低将⼈分为⽩⼈和⿊⼈,样本中⽩⼈的⿐⼦⾼低和⽪肤颜⾊主要集中A组区域,⿊⼈的⿐⼦⾼低和⽪肤颜⾊主要集中在B组区域,很显然A组合B组在空间上明显分离的,将A组和B组上的点都投影到直线L上,分别落在直线L的不同区域,这样就线性的将⿊⼈和⽩⼈分开了。

⼀旦有未知样本需要区分,只需将⽪肤颜⾊和⿐⼦⾼低代⼊直线L的⽅程,即可判断出未知样本的所属的分类。

因此,LDA的关键步骤是选择合适的投影⽅向,即建⽴合适的线性判别函数(⾮线性不是本⽂的重点)。

⼆、LDA的计算过程1、代数表⽰的计算过程设已知两个总体A和B,在A、B两总体分别提出m个特征,然后从A、B两总体中分别抽取出、个样本,得到A、B两总体的样本数据如下:和假设存在这样的线性函数(投影平⾯),可以将A、B两类样本投影到该平⾯上,使得A、B两样本在该直线上的投影满⾜以下两点:(1)两类样本的中⼼距离最远;(2)同⼀样本内的所有投影距离最近。

我们将该线性函数表达如下:将A总体的第个样本点投影到平⾯上得到投影点,即A总体的样本在平⾯投影的重⼼为其中同理可以得到B在平⾯上的投影点以及B总体样本在平⾯投影的重⼼为其中按照Fisher的思想,不同总体A、B的投影点应尽量分开,⽤数学表达式表⽰为,⽽同⼀总体的投影点的距离应尽可能的⼩,⽤数学表达式表⽰为,,合并得到求从⽽使得得到最⼤值,分别对进⾏求导即可,详细步骤不表。

LDA线性判别分析报告LDA线性判别分析(Linear Discriminant Analysis)是一种经典的线性分类方法。

它的目的是通过线性投影将数据从高维空间降维到低维空间,并在降维后的空间中寻找最佳的分类边界。

LDA在模式识别和机器学习领域有广泛的应用,特别在人脸识别、语音识别等领域取得了较好的效果。

LDA是一种有监督的降维方法,它在降维的同时将数据的类别信息考虑进去。

具体来说,LDA的目标是使得同一类别的数据点尽量聚集在一起,不同类别之间的距离尽量拉大。

这样一来,在降维后的空间中,可以更容易找到线性分类边界,从而提高分类的准确度。

LDA的思想基于以下两个假设:1.数据符合高斯分布。

LDA假设每个类别的数据点都符合高斯分布,且各个类别的协方差矩阵相同。

2.数据点是独立的。

LDA假设不同类别的数据点之间是独立的。

LDA的步骤如下:1.计算各个类别的均值向量。

对于有N个类别的数据,每个类别的均值向量可以通过计算平均值得到。

2.计算类内散度矩阵(Sw)和类间散度矩阵(Sb)。

类内散度矩阵衡量了同一类别数据点之间的差异,可以通过计算每个类别内部数据点和对应的均值向量之间的协方差矩阵的和来求得。

类间散度矩阵衡量了不同类别数据点之间的差异,可以通过计算不同类别均值向量之间的协方差矩阵的加权和来求得。

3.解LDA的优化问题。

LDA的目标是最大化类间散度矩阵与类内散度矩阵的比值,可以通过对Sw的逆矩阵与Sb的乘积进行特征值分解得到最佳投影方向。

4.选取投影方向。

根据上一步骤求得的特征值,选择最大的k个特征值对应的特征向量,这些特征向量构成了投影矩阵W。

其中k为降维后的维度,通常比原本的维度小。

LDA的优点在于它能充分利用类别信息,提高分类的准确度。

同时,LDA计算简单且直观,对数据的分布并没有太多的假设要求。

然而,LDA 也有一些限制。

首先,LDA假设数据符合高斯分布,这对于一些非线性数据是不适用的。

其次,LDA是一种线性分类方法,对于非线性问题可能效果不佳。

《具有L_q-正则项的稀疏线性判别分析及主成分分析》篇一具有L_q-正则项的稀疏线性判别分析与主成分分析的高质量范文一、引言随着数据科学和机器学习领域的快速发展,线性判别分析(LDA)和主成分分析(PCA)已成为处理高维数据的重要工具。

然而,在实际应用中,由于数据集的复杂性,这些传统方法有时难以处理过拟合和噪声问题。

为了解决这些问题,本文提出了一种具有L_q-正则项的稀疏线性判别分析方法,旨在提高算法的稳定性和解释性。

本文将首先介绍这一方法的理论基础,并比较其与传统的LDA和PCA方法的差异和优势。

二、背景知识2.1 线性判别分析(LDA)线性判别分析是一种常用的降维方法,通过将高维数据投影到低维空间,以实现数据的分类和可视化。

其主要思想是寻找一个投影方向,使得同类样本的投影点尽可能接近,不同类样本的投影点尽可能远离。

2.2 主成分分析(PCA)主成分分析是一种无监督的降维方法,通过寻找数据集中的主成分(即方差最大的方向),将高维数据投影到低维空间。

其主要目的是去除数据中的冗余信息,提取出最能代表数据特征的主成分。

三、L_q-正则项的稀疏线性判别分析3.1 方法介绍为了解决传统LDA和PCA在处理高维数据时可能出现的过拟合和噪声问题,本文提出了一种具有L_q-正则项的稀疏线性判别分析方法。

该方法在优化目标中引入了L_q-正则项,使得模型在保持分类性能的同时,能够自动学习到数据的稀疏表示,从而降低过拟合风险。

3.2 算法实现本方法的具体实现包括以下步骤:首先,根据数据的标签信息构建类内散布矩阵和类间散布矩阵;然后,在优化目标中引入L_q-正则项,通过求解带约束的优化问题得到投影矩阵;最后,将高维数据投影到低维空间,得到降维后的数据表示。

四、实验与分析4.1 实验设置为了验证本方法的有效性,我们在多个公开数据集上进行了实验。

实验中,我们将本方法与传统的LDA和PCA方法进行了比较,评估了各种方法的分类性能和降维效果。

判别分析实验报告判别分析实验报告一、引言判别分析是一种常用的统计分析方法,广泛应用于数据挖掘、模式识别、生物信息学等领域。

本实验旨在通过对一个真实数据集的分析,探讨判别分析在实际问题中的应用效果。

二、数据集介绍本实验使用的数据集是一份关于肿瘤患者的临床数据,包括患者的年龄、性别、肿瘤大小、转移情况等多个变量。

我们的目标是根据这些变量,建立一个判别模型,能够准确地预测患者是否患有恶性肿瘤。

三、数据预处理在进行判别分析之前,我们首先对数据进行预处理。

这包括数据清洗、缺失值处理、异常值检测等步骤。

通过对数据的观察和分析,我们发现有部分数据存在缺失值,需要进行处理。

我们选择使用均值替代缺失值的方法进行处理,并对替代后的数据进行了异常值检测。

四、判别模型建立在本实验中,我们选择了线性判别分析(LDA)作为判别模型的建立方法。

LDA 是一种经典的判别分析方法,通过将数据投影到低维空间中,使得不同类别的样本在投影后的空间中能够更好地区分开来。

我们使用Python中的scikit-learn 库来实现LDA算法。

五、模型评估为了评估建立的判别模型的性能,我们将数据集划分为训练集和测试集。

使用训练集对模型进行训练,并使用测试集进行模型的评估。

我们选择了准确率、精确率、召回率和F1值等指标来评估模型的性能。

经过多次实验和交叉验证,我们得到了一个较为稳定的模型,并对其性能进行了详细的分析和解释。

六、结果与讨论经过模型评估,我们得到了一个在测试集上准确率为85%的判别模型。

该模型在预测恶性肿瘤时具有较高的精确率和召回率,说明了其在实际应用中的可行性和有效性。

但同时我们也发现,该模型在预测良性肿瘤时存在一定的误判率,可能需要进一步优化和改进。

七、结论本实验通过对一个真实数据集的判别分析,验证了判别分析方法在预测恶性肿瘤的应用效果。

通过建立判别模型,并对其性能进行评估,我们得到了一个在测试集上具有较高准确率的模型。

然而,我们也发现了该模型在预测良性肿瘤时存在一定的误判率,需要进一步的改进和优化。

线性判别分析LDA点x 0到决策⾯g (x )=w T x +w 0的距离:r =g (x )‖⼴义线性判别函数因任何⾮线性函数都可以通过级数展开转化为多项式函数(逼近),所以任何⾮线性判别函数都可以转化为⼴义线性判别函数。

Fisher LDA(线性判别分析)Fisher准则的基本原理找到⼀个最合适的投影轴,使两类样本在该轴上投影之间的距离尽可能远,⽽每⼀类样本的投影尽可能紧凑,从⽽使两类分类效果为最佳。

分类:将 d 维分类问题转化为⼀维分类问题后,只需要确定⼀个阈值点,将投影点与阈值点⽐较,就可以做出决策。

未知样本x的投影点 y= w ^{* T} x .1. 计算各类样本均值向量:m_i={1\over N_i}\sum_{X\in w_i}X,\quad i=1,22. 计算样本类内离散度矩阵S_i 和总类内离散度矩阵S_w .(w ithin scatter matrix)S_i=\sum_{X\in w_i}(X-m_i)(X-m_i)^T,\quad i=1,2 \\ S_w=S_1+S_23. 计算样本类间离散度矩阵S_b=(m_1-m_2)(m_1-m_2)^T .(b etween scatter matrix)4. 求向量w^*.定义Fisher准则函数:J_F(w)={w^TS_bw\over w^TS_ww}J_F 取最⼤值时w^*=S_w^{-1}(m_1-m_2)Fisher准则函数推导:投影之后点y= w ^{T} x ,y对应的离散度矩阵为\tilde S_w,\tilde S_b ,则⽤以评价投影⽅向w的函数为J_F(w)={\tilde S_b\over \tilde S_w}={w^TS_b\ w\over w^TS_w\ w}5. 将训练集内所有样本进⾏投影:y=(w^*)^TX6. 计算在投影空间上的分割阈值,较常⽤的⼀种⽅式为:y_0={N_1\widetilde {m_1}+N_2\widetilde{m_2}\over N_1+N_2}7. 对于给定的测试X,计算它在w^*上的投影点y=(w^*)^TX 。

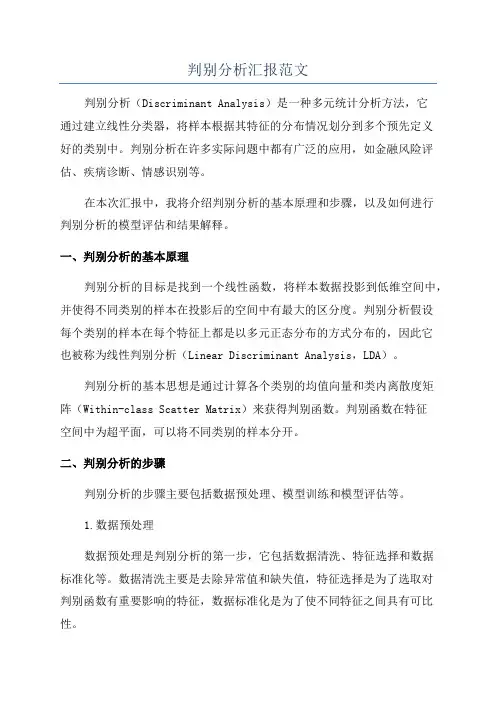

判别分析汇报范文判别分析(Discriminant Analysis)是一种多元统计分析方法,它通过建立线性分类器,将样本根据其特征的分布情况划分到多个预先定义好的类别中。

判别分析在许多实际问题中都有广泛的应用,如金融风险评估、疾病诊断、情感识别等。

在本次汇报中,我将介绍判别分析的基本原理和步骤,以及如何进行判别分析的模型评估和结果解释。

一、判别分析的基本原理判别分析的目标是找到一个线性函数,将样本数据投影到低维空间中,并使得不同类别的样本在投影后的空间中有最大的区分度。

判别分析假设每个类别的样本在每个特征上都是以多元正态分布的方式分布的,因此它也被称为线性判别分析(Linear Discriminant Analysis,LDA)。

判别分析的基本思想是通过计算各个类别的均值向量和类内离散度矩阵(Within-class Scatter Matrix)来获得判别函数。

判别函数在特征空间中为超平面,可以将不同类别的样本分开。

二、判别分析的步骤判别分析的步骤主要包括数据预处理、模型训练和模型评估等。

1.数据预处理数据预处理是判别分析的第一步,它包括数据清洗、特征选择和数据标准化等。

数据清洗主要是去除异常值和缺失值,特征选择是为了选取对判别函数有重要影响的特征,数据标准化是为了使不同特征之间具有可比性。

2.模型训练模型训练是判别分析的核心步骤,它主要包括计算均值向量和类内离散度矩阵、计算类间离散度矩阵(Between-class Scatter Matrix)和求解广义特征值问题等。

通过这些步骤可以得到判别函数的系数,进而得到判别函数。

3.模型评估模型评估是为了评估判别函数的性能和判别模型的准确性。

常用的模型评估指标包括分类准确率、召回率、精确率和F1值等。

通过这些指标可以对判别函数的预测结果进行评估。

三、判别分析的模型评估和结果解释判别分析的模型评估可以通过交叉验证等方法来进行。

交叉验证可以将数据集划分为训练集和测试集,并使用训练集来训练判别模型,在测试集上对模型进行评估。

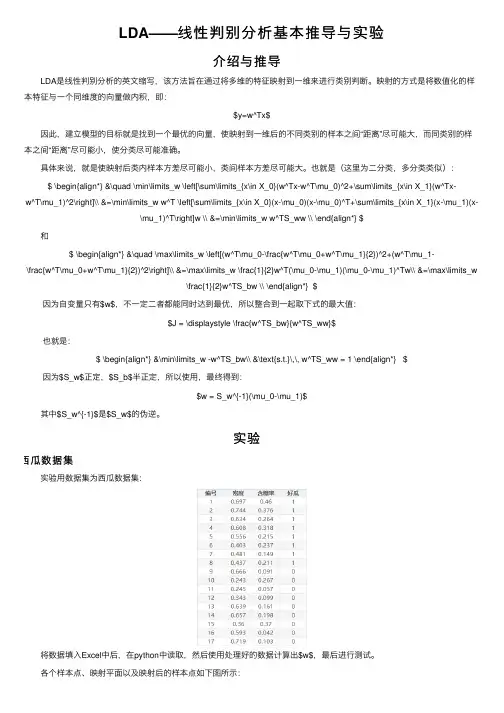

LDA——线性判别分析基本推导与实验介绍与推导 LDA是线性判别分析的英⽂缩写,该⽅法旨在通过将多维的特征映射到⼀维来进⾏类别判断。

映射的⽅式是将数值化的样本特征与⼀个同维度的向量做内积,即:$y=w^Tx$ 因此,建⽴模型的⽬标就是找到⼀个最优的向量,使映射到⼀维后的不同类别的样本之间“距离”尽可能⼤,⽽同类别的样本之间“距离”尽可能⼩,使分类尽可能准确。

具体来说,就是使映射后类内样本⽅差尽可能⼩,类间样本⽅差尽可能⼤。

也就是(这⾥为⼆分类,多分类类似):$ \begin{align*} &\quad \min\limits_w \left[\sum\limits_{x\in X_0}(w^Tx-w^T\mu_0)^2+\sum\limits_{x\in X_1}(w^Tx-w^T\mu_1)^2\right]\\ &=\min\limits_w w^T \left[\sum\limits_{x\in X_0}(x-\mu_0)(x-\mu_0)^T+\sum\limits_{x\in X_1}(x-\mu_1)(x-\mu_1)^T\right]w \\ &=\min\limits_w w^TS_ww \\ \end{align*} $ 和$ \begin{align*} &\quad \max\limits_w \left[(w^T\mu_0-\frac{w^T\mu_0+w^T\mu_1}{2})^2+(w^T\mu_1-\frac{w^T\mu_0+w^T\mu_1}{2})^2\right]\\ &=\max\limits_w \frac{1}{2}w^T(\mu_0-\mu_1)(\mu_0-\mu_1)^Tw\\ &=\max\limits_w\frac{1}{2}w^TS_bw \\ \end{align*} $ 因为⾃变量只有$w$,不⼀定⼆者都能同时达到最优,所以整合到⼀起取下式的最⼤值:$J = \displaystyle \frac{w^TS_bw}{w^TS_ww}$ 也就是:$ \begin{align*} &\min\limits_w -w^TS_bw\\ &\text{s.t.}\,\, w^TS_ww = 1 \end{align*} $ 因为$S_w$正定,$S_b$半正定,所以使⽤,最终得到:$w = S_w^{-1}(\mu_0-\mu_1)$ 其中$S_w^{-1}$是$S_w$的伪逆。

判别分析--线性判别分析(LDA)应⽤案例1 线性判别分析执⾏线性判别分析可使⽤lda()函数,且该函数有三种执⾏形式,依次尝试使⽤。

(1)公式formula格式我们使⽤nmkat变量作为待判别变量,其他剩余的变量作为特征变量,根据公式nmkat~使⽤训练集数据来运⾏lda()函数:library(MASS)library("MASS")fitlda1<-lda(nmkat~.,datatrain) #以公式格式执⾏判别分析names(fitlda1) #查看lda输出项名称结果分析:我们看到,可以根据lda()函数得到10项输出结果,分别为执⾏过程中所使⽤的先验概率prior、数据集中各类别的样本量counts、各变量在每⼀类别中的均值 means等。

fitlda1$prior #查看本次执⾏过程中所使⽤的先验概率fitlda1$counts #查看数据集datatrain中各类别的样本量结果分析:由于我们在之前的抽样过程中采⽤的是nmkat各等级的等概率分层抽样⽅式,因此如上各类别的先验概率和样本量在5个等级中都是相等的。

具体的,5类的先验概率都为0.2,之和为1,且训练集中每⼀类都抽出了144个样本。

fitlda1$means结果分析:在如上的均值输出结果中,我们可以看到⼀些很能反映现实情况的数据特征。

⽐如,对于占地⾯积wfl变量,它明显随着租⾦nmkat的升⾼⽽逐步提⾼,我们看到在租⾦为等级1(少于500马克)时,占地⾯积的均值仅为55.53平⽅⽶,⽽对于租⾦等级5(租⾦不低于1150 马克),平均占地⾯积则达到了92.24平⽅⽶。

⾯积越⼤的房屋租⾦越贵,这是⼗分符合常识的。

执⾏fitlda1可直接将判别结果输出。

(2)数据框data.frame及矩阵matrix格式由于这两种函数格式的主体参数都为x与grouping,我们放在⼀起实现,程序代码如下:fitlda2<-lda(datatrain[,-12],datatrain[,12])#设置属性变量(除第12个变量nmkat外)与待判别变量(第12个变量nmkat)的取值fitlda22.判别规则可视化我们⾸先使⽤plot()直接以判别规则fit_ldal为对象输出图形,如下图所⽰:plot(fitlda1)结果分析:从图可以看到,在所有4个线性判别式(Linear Discriminants,即 LD)下1⾄5这5个类别的分布情况,不同类别样本已⽤相应数字标出。

LDA线性判别分析

LDA线性判别分析

给定训练集,设法将样例投影到⼀条直线上,使得同类样例的投影点尽可能的近,异类样例点尽可能的远,对新样本进⾏分类的时候,将新样本同样的投影,再根据投影得到的位置进⾏判断,这个新样本的类别

LDA⼆维⽰意图。

⽤‘+’表⽰正类“-”表⽰负类,两个投影,实⼼三⾓形和圆表⽰投影中⼼

⼆分类:

给定数据集

:第类的样本集合

:第类的均值向量

:第类的协⽅差矩阵

将数据投影在直线上,则两类样本的中⼼点在直线上的投影分别为和

将所有的样本点投影到直线上之后,两类样本的协⽅差为 和

由于直线是⼀维空间,因此 和均为实数

为了把两类分的⽐较开于是有两个⽅⾯考虑

1、同类抱团更加紧密

2、不同类分的开

为了让同类的样本尽可能的接近,就让同类样本的投影点协⽅差尽可能的⼩,

于是有

让他们尽可能的⼩

为了两类分的开:

于是有了两类的投影中⼼尽可能的远离

要尽可能的⼤,这样就可以得到它的优化⽬标函数,使她最⼤就ok

定义两个符号

类内散度矩阵:

类间散度矩阵

于是得到了要优化的下式,最后需要优化的⽬标,使之最⼤化即可,求取。