多元回归分析实例

- 格式:doc

- 大小:61.00 KB

- 文档页数:2

多元线性回归分析范例多元线性回归是一种用于预测因变量和多个自变量之间关系的统计分析方法。

它假设因变量与自变量之间存在线性关系,并通过拟合一个多元线性模型来估计因变量的值。

在本文中,我们将使用一个实际的数据集来进行多元线性回归分析的范例。

数据集介绍:我们选取的数据集是一份汽车销售数据,包括了汽车的价格(因变量)和多个与汽车相关的特征(自变量),如车龄、行驶里程、汽车品牌等。

我们的目标是通过这些特征来预测汽车的价格。

数据集包括了100个样本。

数据集的构成如下:车龄(年),行驶里程(万公里),品牌,价格(万元)----------------------------------------5,10,A,153,5,B,207,12,C,10...,...,...,...建立多元线性回归模型:我们首先需要将数据集划分为自变量矩阵X和因变量向量y。

其中,自变量矩阵X包括了车龄、行驶里程和品牌等特征,因变量向量y包括了价格。

在Python中,我们可以使用NumPy和Pandas库来处理和分析数据。

我们可以使用Pandas的DataFrame来存储数据集,并使用NumPy的polyfit函数来拟合多元线性模型。

首先,我们导入所需的库并读取数据集:```pythonimport pandas as pdimport numpy as np#读取数据集data = pd.read_csv('car_sales.csv')```然后,我们将数据集划分为自变量矩阵X和因变量向量y:```python#划分自变量矩阵X和因变量向量yX = data[['车龄', '行驶里程', '品牌']]y = data['价格']```接下来,我们使用polyfit函数来拟合多元线性模型。

我们将自变量矩阵X和因变量向量y作为输入,并指定多项式的次数(线性模型的次数为1):```python#拟合多元线性模型coefficients = np.polyfit(X, y, deg=1)```最后,我们可以使用拟合得到的模型参数来预测新的样本。

多元线性回归分析的实例研究多元线性回归是一种经典的统计方法,用于研究多个自变量对一个因变量的影响关系。

在实际应用中,多元线性回归分析可以帮助我们理解多个因素对一些现象的综合影响,并通过构建模型来进行预测和决策。

本文将以一个假想的房价分析为例,详细介绍多元线性回归分析的步骤、数据解释以及结果分析。

假设我们想要研究一个城市的房价与面积、房龄和地理位置之间的关系。

我们收集了100个房源的数据,包括房价(因变量)、面积(自变量1)、房龄(自变量2)和地理位置(自变量3)。

下面是我们的数据:序号,房价(万元),面积(平方米),房龄(年),地理位置(距市中心距离,公里)----,------------,--------------,----------,--------------------------------1,150,120,5,22,200,150,8,63,100,80,2,104,180,130,10,55,220,160,12,3...,...,...,...,...100,250,180,15,1首先,我们需要对数据进行描述性统计分析。

通过计算平均值、标准差、最小值、最大值等统计量,可以初步了解数据的分布和变异程度。

然后,我们需要进行回归模型的拟合。

回归模型可以表示为:房价=β0+β1*面积+β2*房龄+β3*地理位置+ε其中,β0、β1、β2、β3是待估计的回归系数,ε是模型的误差项。

回归系数表示自变量对因变量的影响大小和方向。

为了估计回归系数,我们可以使用最小二乘法。

最小二乘法通过找到一组回归系数,使得实际观测值与模型预测值之间的平方误差最小化。

在本例中,我们可以使用统计软件进行回归模型的拟合和参数估计。

假设我们得到的回归模型如下:房价=100+1.5*面积-5*房龄+10*地理位置接着,我们需要对回归模型进行评价和解释。

首先,我们可以计算回归模型的决定系数(R^2),它表示因变量的变异中能够被模型解释的比例。

多元回归分析案例下面以一个实际案例来说明多元回归分析的应用。

假设我们是一家电商公司,希望了解哪些因素会影响网站用户购买商品的金额。

为了回答这个问题,我们收集了以下数据:每位用户购买的商品金额(因变量),用户的年龄、性别和收入水平(自变量)。

首先,我们需要构建一个多元回归模型。

由于因变量是连续型变量,我们可以选择使用线性回归模型。

模型的形式可以表示为:购买金额=β0+β1×年龄+β2×性别+β3×收入水平+ε其中,β0是截距,β1、β2和β3是自变量的系数,ε是误差项。

接下来,我们需要对数据进行预处理。

首先,将性别变量转换为虚拟变量,比如用0表示男性,1表示女性。

然后,我们可以使用逐步回归方法,逐步选择自变量,以确定哪些变量对因变量的解释最显著。

在实际操作中,我们可以使用统计软件,比如SPSS或R来进行多元回归分析。

下面是一个用R进行多元回归分析的示例代码:```R#导入数据data <- read.csv("data.csv")#转换性别变量为虚拟变量data$gender <- as.factor(data$gender)#构建多元回归模型model <- lm(购买金额 ~ 年龄 + 性别 + 收入水平, data=data)#执行逐步回归step_model <- step(model)#显示结果summary(step_model)```通过运行这段代码,我们可以得到每个自变量的系数估计值、显著性水平、拟合优度等统计结果。

这些结果可以帮助我们理解各个自变量对于购买金额的影响程度以及它们之间的相对重要性。

在实际应用中,多元回归分析可以帮助我们识别哪些因素对于一些特定的因变量具有显著影响。

通过控制其他自变量,我们可以解释每个自变量对因变量的独立贡献,并用于预测因变量的值。

总之,多元回归分析是一种强大的统计工具,可以应用于各个领域,帮助我们理解和预测自变量对因变量的影响。

多元线性回归分析案例1. 引言多元线性回归分析是一种用于探究多个自变量与一个连续型因变量之间关系的统计分析方法。

本文将以一个虚构的案例来介绍多元线性回归分析的应用。

2. 背景假设我们是一家电子产品制造公司,我们想了解哪些因素会对产品销售额产生影响。

为了解决这个问题,我们收集了一些数据,包括产品的价格、广告费用、竞争对手的产品价格和销售额。

3. 数据收集我们采集了100个不同产品的数据,其中包括以下变量:- 产品价格(自变量1)- 广告费用(自变量2)- 竞争对手的产品价格(自变量3)- 销售额(因变量)4. 数据分析为了进行多元线性回归分析,我们首先需要对数据进行预处理。

我们检查了数据的缺失情况和异常值,并进行了相应的处理。

接下来,我们使用多元线性回归模型来分析数据。

模型的方程可以表示为:销售额= β0 + β1 × 产品价格+ β2 × 广告费用+ β3 × 竞争对手的产品价格+ ε其中,β0、β1、β2、β3是回归系数,ε是误差项。

5. 结果解释我们使用统计软件进行回归分析,并得到了以下结果:- 回归系数的估计值:β0 = 1000, β1 = 10, β2 = 20, β3 = -5- 拟合优度:R² = 0.8根据回归系数的估计值,我们可以解释模型的结果:- β0表示当产品价格、广告费用和竞争对手的产品价格都为0时,销售额的估计值为1000。

- β1表示产品价格每增加1单位,销售额平均增加10单位。

- β2表示广告费用每增加1单位,销售额平均增加20单位。

- β3表示竞争对手的产品价格每增加1单位,销售额平均减少5单位。

拟合优度R²的值为0.8,说明模型可以解释销售额的80%变异程度。

这意味着模型对数据的拟合程度较好。

6. 结论根据我们的多元线性回归分析结果,我们可以得出以下结论:- 产品价格、广告费用和竞争对手的产品价格对销售额有显著影响。

多元线性回归分析案例多元线性回归分析是统计学中常用的一种分析方法,它可以用来研究多个自变量对因变量的影响,并建立相应的数学模型。

在实际应用中,多元线性回归分析可以帮助我们理解变量之间的关系,预测未来的趋势,以及制定相应的决策。

本文将通过一个实际案例来介绍多元线性回归分析的基本原理和应用方法。

案例背景。

假设我们是一家电子产品制造公司的市场营销团队,我们想要了解产品销量与广告投入、产品定价和市场规模之间的关系。

我们收集了过去一年的数据,包括每个月的产品销量(千台)、广告投入(万元)、产品定价(元/台)和市场规模(亿人)。

数据分析。

首先,我们需要对数据进行描述性统计分析,以了解各变量的分布情况和相关性。

我们计算了产品销量、广告投入、产品定价和市场规模的均值、标准差、最大最小值等统计量,并绘制了相关性矩阵图。

通过分析发现,产品销量与广告投入、产品定价和市场规模之间存在一定的相关性,但具体的关系还需要通过多元线性回归分析来验证。

多元线性回归模型。

我们建立了如下的多元线性回归模型:\[Sales = \beta_0 + \beta_1 \times Advertising + \beta_2 \times Price + \beta_3 \times MarketSize + \varepsilon\]其中,Sales表示产品销量,Advertising表示广告投入,Price表示产品定价,MarketSize表示市场规模,\(\beta_0, \beta_1, \beta_2, \beta_3\)分别为回归系数,\(\varepsilon\)为误差项。

模型验证。

我们利用最小二乘法对模型进行参数估计,并进行了显著性检验和回归诊断。

结果表明,广告投入、产品定价和市场规模对产品销量的影响是显著的,模型的拟合效果较好。

同时,我们还对模型进行了预测能力的验证,结果表明模型对未来产品销量的预测具有一定的准确性。

决策建议。

—多元线性回归分析案例多元线性回归分析是一种广泛使用的统计分析方法,用于研究多个自变量对一个因变量的影响程度。

在实际应用中,多元线性回归可以帮助我们理解变量之间的相互关系,并预测因变量的数值。

下面我们将以一个实际案例来介绍多元线性回归分析的应用。

假设我们是一家电子产品制造商,我们想研究影响手机销量的因素,并尝试通过多元线性回归模型来预测手机的销量。

我们选择了三个自变量作为影响因素:广告投入、价格和市场份额。

我们收集了一段时间内的数据,包括这三个因素以及对应的手机销量。

现在我们将利用这些数据来进行多元线性回归分析。

首先,我们需要将数据进行预处理和清洗。

我们检查数据的完整性和准确性,并去除可能存在的异常值和缺失值。

然后,我们对数据进行描述性统计分析,以了解数据的整体情况和变量之间的关系。

接下来,我们将建立多元线性回归模型。

我们将销量作为因变量,而广告投入、价格和市场份额作为自变量。

通过引入这些自变量,我们可以预测手机销量,并分析它们对销量的影响程度。

为了进行回归分析,我们需要估计模型的系数。

这可以通过最小二乘法来实现,该方法将使得模型的预测结果与实际观测值之间的残差平方和最小化。

接下来,我们将进行统计检验,以确定自变量对因变量的显著影响。

常见的统计指标包括回归系数的显著性水平、t值和p值。

在我们的案例中,假设多元线性回归模型的方程为:销量=β0+β1×广告投入+β2×价格+β3×市场份额+ε。

其中,β0、β1、β2和β3为回归系数,ε为误差项。

完成回归分析后,我们可以进行模型的诊断和评估。

我们可以检查模型的残差是否呈正态分布,以及模型的拟合程度如何。

此外,我们还可以通过交叉验证等方法评估模型的准确性和可靠性。

最后,我们可以利用训练好的多元线性回归模型来进行预测。

通过输入新的广告投入、价格和市场份额的数值,我们可以预测手机的销量,并根据预测结果制定相应的市场策略。

综上所述,多元线性回归分析是一种强大的统计工具,可用于分析多个自变量对一个因变量的影响。

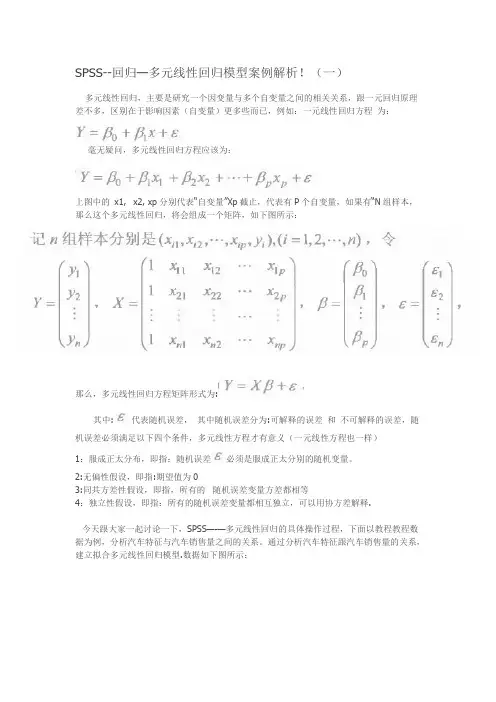

SPSS--回归—多元线性回归模型案例解析!(一)多元线性回归,主要是研究一个因变量与多个自变量之间的相关关系,跟一元回归原理差不多,区别在于影响因素(自变量)更多些而已,例如:一元线性回归方程为:毫无疑问,多元线性回归方程应该为:上图中的x1, x2, xp分别代表“自变量”Xp截止,代表有P个自变量,如果有“N组样本,那么这个多元线性回归,将会组成一个矩阵,如下图所示:那么,多元线性回归方程矩阵形式为:其中:代表随机误差,其中随机误差分为:可解释的误差和不可解释的误差,随机误差必须满足以下四个条件,多元线性方程才有意义(一元线性方程也一样)1:服成正太分布,即指:随机误差必须是服成正太分别的随机变量。

2:无偏性假设,即指:期望值为03:同共方差性假设,即指,所有的随机误差变量方差都相等4:独立性假设,即指:所有的随机误差变量都相互独立,可以用协方差解释.今天跟大家一起讨论一下,SPSS—-—多元线性回归的具体操作过程,下面以教程教程数据为例,分析汽车特征与汽车销售量之间的关系。

通过分析汽车特征跟汽车销售量的关系,建立拟合多元线性回归模型.数据如下图所示:点击“分析”——回归——线性——进入如下图所示的界面:将“销售量”作为“因变量"拖入因变量框内,将“车长,车宽,耗油率,车净重等10个自变量拖入自变量框内,如上图所示,在“方法”旁边,选择“逐步”,当然,你也可以选择其它的方式,如果你选择“进入”默认的方式,在分析结果中,将会得到如下图所示的结果:(所有的自变量,都会强行进入)如果你选择“逐步”这个方法,将会得到如下图所示的结果:(将会根据预先设定的“F统计量的概率值进行筛选,最先进入回归方程的“自变量”应该是跟“因变量”关系最为密切,贡献最大的,如下图可以看出,车的价格和车轴跟因变量关系最为密切,符合判断条件的概率值必须小于0.05,当概率值大于等于0.1时将会被剔除)“选择变量(E)" 框内,我并没有输入数据,如果你需要对某个“自变量”进行条件筛选,可以将那个自变量,移入“选择变量框”内,有一个前提就是:该变量从未在另一个目标列表中出现!,再点击“规则”设定相应的“筛选条件”即可,如下图所示:点击“统计量"弹出如下所示的框,如下所示:在“回归系数”下面勾选“估计,在右侧勾选”模型拟合度“ 和”共线性诊断“ 两个选项,再勾选“个案诊断”再点击“离群值”一般默认值为“3",(设定异常值的依据,只有当残差超过3倍标准差的观测才会被当做异常值)点击继续。

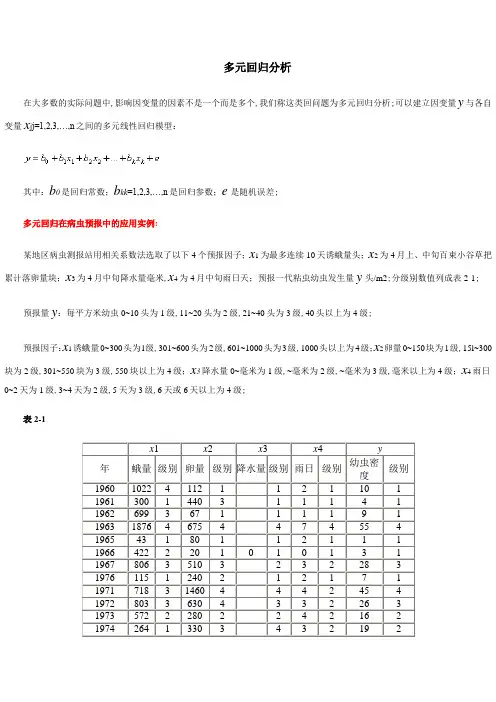

多元回归分析在大多数的实际问题中,影响因变量的因素不是一个而是多个,我们称这类回问题为多元回归分析;可以建立因变量y与各自变量x j j=1,2,3,…,n之间的多元线性回归模型:其中:b0是回归常数;b k k=1,2,3,…,n是回归参数;e是随机误差;多元回归在病虫预报中的应用实例:某地区病虫测报站用相关系数法选取了以下4个预报因子;x1为最多连续10天诱蛾量头;x2为4月上、中旬百束小谷草把累计落卵量块;x3为4月中旬降水量毫米,x4为4月中旬雨日天;预报一代粘虫幼虫发生量y头/m2;分级别数值列成表2-1;预报量y:每平方米幼虫0~10头为1级,11~20头为2级,21~40头为3级,40头以上为4级;预报因子:x1诱蛾量0~300头为l级,301~600头为2级,601~1000头为3级,1000头以上为4级;x2卵量0~150块为1级,15l~300块为2级,301~550块为3级,550块以上为4级;x3降水量0~毫米为1级,~毫米为2级,~毫米为3级,毫米以上为4级;x4雨日0~2天为1级,3~4天为2级,5天为3级,6天或6天以上为4级;表2-1x1 x2 x3 x4 y年蛾量级别卵量级别降水量级别雨日级别幼虫密度级别1960 1022 4 112 1 1 2 1 10 1 1961 300 1 440 3 1 1 1 4 1 1962 699 3 67 1 1 1 1 9 1 1963 1876 4 675 4 4 7 4 55 4 1965 43 1 80 1 1 2 1 1 1 1966 422 2 20 1 0 1 0 1 3 1 1967 806 3 510 3 2 3 2 28 3 1976 115 1 240 2 1 2 1 7 1 1971 718 3 1460 4 4 4 2 45 4 1972 803 3 630 4 3 3 2 26 3 1973 572 2 280 2 2 4 2 16 2 1974 264 1 330 3 4 3 2 19 2数据保存在“”文件中;1准备分析数据在SPSS数据编辑窗口中,创建“年份”、“蛾量”、“卵量”、“降水量”、“雨日”和“幼虫密度”变量,并输入数据;再创建蛾量、卵量、降水量、雨日和幼虫密度的分级变量“x1”、“x2”、“x3”、“x4”和“y”,它们对应的分级数值可以在SPSS数据编辑窗口中通过计算产生;编辑后的数据显示如图2-1;图2-1或者打开已存在的数据文件“”;2启动线性回归过程单击SPSS主菜单的“Analyze”下的“Regression”中“Linear”项,将打开如图2-2所示的线性回归过程窗口;图2-2 线性回归对话窗口3 设置分析变量设置因变量:用鼠标选中左边变量列表中的“幼虫密度y”变量,然后点击“Dependent”栏左边的向右拉按钮,该变量就移到“Dependent”因变量显示栏里;设置自变量:将左边变量列表中的“蛾量x1”、“卵量x2”、“降水量x3”、“雨日x4”变量,选移到“IndependentS”自变量显示栏里;设置控制变量: 本例子中不使用控制变量,所以不选择任何变量;选择标签变量: 选择“年份”为标签变量;选择加权变量: 本例子没有加权变量,因此不作任何设置;4回归方式本例子中的4个预报因子变量是经过相关系数法选取出来的,在回归分析时不做筛选;因此在“Method”框中选中“Enter”选项,建立全回归模型;5设置输出统计量单击“Statistics”按钮,将打开如图2-3所示的对话框;该对话框用于设置相关参数;其中各项的意义分别为:图2-3 “Statistics”对话框①“Regression Coefficients”回归系数选项:“Estimates”输出回归系数和相关统计量;“Confidence interval”回归系数的95%置信区间;“Covariance matrix”回归系数的方差-协方差矩阵;本例子选择“Estimates”输出回归系数和相关统计量;②“Residuals”残差选项:“Durbin-Watson”Durbin-Watson检验;“Casewise diagnostic”输出满足选择条件的观测量的相关信息;选择该项,下面两项处于可选状态:“Outliers outside standard deviations”选择标准化残差的绝对值大于输入值的观测量;“All cases”选择所有观测量;本例子都不选;③其它输入选项“Model fit”输出相关系数、相关系数平方、调整系数、估计标准误、ANOVA表;“R squared change”输出由于加入和剔除变量而引起的复相关系数平方的变化;“Descriptives”输出变量矩阵、标准差和相关系数单侧显著性水平矩阵;“Part and partial correlation”相关系数和偏相关系数;“Collinearity diagnostics”显示单个变量和共线性分析的公差;本例子选择“Model fit”项;6绘图选项在主对话框单击“Plots”按钮,将打开如图2-4所示的对话框窗口;该对话框用于设置要绘制的图形的参数;图中的“X”和“Y”框用于选择X轴和Y轴相应的变量;图2-4“Plots”绘图对话框窗口左上框中各项的意义分别为:•“DEPENDNT”因变量;•“ZPRED”标准化预测值;•“ZRESID”标准化残差;•“DRESID”删除残差;•“ADJPRED”调节预测值;•“SRESID”学生氏化残差;•“SDRESID”学生氏化删除残差;“Standardized Residual Plots”设置各变量的标准化残差图形输出;其中共包含两个选项:“Histogram”用直方图显示标准化残差;“Normal probability plots”比较标准化残差与正态残差的分布示意图;“Produce all partial plot”偏残差图;对每一个自变量生成其残差对因变量残差的散点图;本例子不作绘图,不选择;7 保存分析数据的选项在主对话框里单击“Save”按钮,将打开如图2-5所示的对话框;图2-5 “Save”对话框①“Predicted Values”预测值栏选项:Unstandardized 非标准化预测值;就会在当前数据文件中新添加一个以字符“PRE_”开头命名的变量,存放根据回归模型拟合的预测值;Standardized 标准化预测值;Adjusted 调整后预测值;. of mean predictions 预测值的标准误;本例选中“Unstandardized”非标准化预测值;②“Distances”距离栏选项:Mahalanobis: 距离;Cook’s”: Cook距离;Leverage values: 杠杆值;③“Prediction Intervals”预测区间选项:Mean: 区间的中心位置;Individual: 观测量上限和下限的预测区间;在当前数据文件中新添加一个以字符“LICI_”开头命名的变量,存放预测区间下限值;以字符“UICI_”开头命名的变量,存放预测区间上限值;Confidence Interval:置信度;本例不选;④“Save to New File”保存为新文件:选中“Coefficient statistics”项将回归系数保存到指定的文件中;本例不选;⑤“Export model information to XML file”导出统计过程中的回归模型信息到指定文件;本例不选;⑥“Residuals” 保存残差选项:“Unstandardized”非标准化残差;“Standardized”标准化残差;“Studentized”学生氏化残差;“Deleted”删除残差;“Studentized deleted”学生氏化删除残差;本例不选;⑦“Influence Statistics” 统计量的影响;“DfBetas”删除一个特定的观测值所引起的回归系数的变化;“Standardized DfBetas”标准化的DfBeta值;“DiFit” 删除一个特定的观测值所引起的预测值的变化;“Standardized DiFit”标准化的DiFit值;“Covariance ratio”删除一个观测值后的协方差矩隈的行列式和带有全部观测值的协方差矩阵的行列式的比率;本例子不保存任何分析变量,不选择;8其它选项在主对话框里单击“Options”按钮,将打开如图2-6所示的对话框;图2-6 “Options”设置对话框①“Stepping Method Criteria”框用于进行逐步回归时内部数值的设定;其中各项为:“Use probability of F”如果一个变量的F值的概率小于所设置的进入值Entry,那么这个变量将被选入回归方程中;当变量的F值的概率大于设置的剔除值Removal,则该变量将从回归方程中被剔除;由此可见,设置“Use probability of F”时,应使进入值小于剔除值;“Ues F value”如果一个变量的F值大于所设置的进入值Entry,那么这个变量将被选入回归方程中;当变量的F值小于设置的剔除值Removal,则该变量将从回归方程中被剔除;同时,设置“Use F value”时,应使进入值大于剔除值;本例是全回归不设置;②“Include constant in equation”选择此项表示在回归方程中有常数项;本例选中“Include constant in equation”选项在回归方程中保留常数项;③“Missing Values”框用于设置对缺失值的处理方法;其中各项为:“Exclude cases listwise”剔除所有含有缺失值的观测值;“Exchude cases pairwise”仅剔除参与统计分析计算的变量中含有缺失值的观测量;“Replace with mean”用变量的均值取代缺失值;本例选中“Exclude cases listwise”;9提交执行在主对话框里单击“OK”,提交执行,结果将显示在输出窗口中;主要结果见表2-2至表2-4;10 结果分析主要结果:表2-2表2-2 是回归模型统计量:R 是相关系数;R Square 相关系数的平方,又称判定系数,判定线性回归的拟合程度:用来说明用自变量解释因变量变异的程度所占比例;Adjusted R Square 调整后的判定系数;Std. Error of the Estimate 估计标准误差;表2-3表2-3 回归模型的方差分析表,F值为,显著性概率是,表明回归极显著;表2-4分析:建立回归模型:根据多元回归模型:把表6-9中“非标准化回归系数”栏目中的“B”列系数代入上式得预报方程:预测值的标准差可用剩余均方估计:回归方程的显著性检验:从表6-8方差分析表中得知:F统计量为,系统自动检验的显著性水平为;F,4,11值为,F,4,11 值为,F,4,11 值为;因此回归方程相关非常显著;F值可在Excel中用FINV 函数获得;回代检验需要作预报效果的验证时,在主对话框图6-8里单击“Save”按钮,在打开如图3-6所示对话框里,选中“Predicted Values”预测值选项栏中的“Unstandardized”非标准化预测值选项;这样在过程运算时,就会在当前文件中新添加一个“PRE_1”命名的变量,该变量存放根据回归模型拟合的预测值;然后,在SPSS数据窗口计算“y”与“PRE_1”变量的差值图2-7,本例子把绝对差值大于视为不符合,反之则符合;结果符合的年数为15年,1年不符合,历史符合率为%;图2-7多元回归分析法可综合多个预报因子的作用,作出预报,在统计预报中是一种应用较为普遍的方法;在实际运用中,采取将预报因子和预报量按一定标准分为多级,用分级尺度代换较大的数字,更能揭示预报因子与预报量的关系,预报效果比采用数量值统计方法有明显的提高,在实际应用中具有一定的现实意义;。

多元回归模型分析案例多元回归模型分析是一种重要的数据分析技术,它可用于解决一系列实际问题,如预测商品消费量、预测股票市场行情等。

本文将以一个简单的案例来说明如何利用多元回归模型来分析数据,以便发现有用的信息,并更好地了解因果关系。

假设一家商店想要预测它的销售额,并且想了解它的销售额与其他变量之间的关系。

接下来,我们以该商店的历史销售数据建立一个多元回归模型,预测未来销售额,并分析它与其他变量之间的关系。

首先,需要收集有关商店历史销售数据的所有信息,包括产品的价格、促销活动的有效性等。

然后,使用统计软件将这些数据分析成矩阵,并将这些变量作为自变量,而销售额作为因变量。

然后,使用多元线性回归的算法,对收集的数据进行分析和处理,并建立一个具有最佳拟合度的多元回归模型。

回归模型中,各变量之间的关系可以通过相关系数来衡量,其中正相关系数表示两个变量增大时,另一变量也会增大;反之,负相关系数表示两个变量增大时,另一变量则下降。

根据统计分析,可以得出每一个变量与销售额之间的相关性。

通过观察变量与销售额之间的关系,我们可以清楚地了解到每一个变量对销售额影响的程度,以及它们之间的因果关系。

此外,建立的多元回归模型还可用于预测未来的销售情况。

将未来的变量值带入模型,即可得出推测的未来销售额,方便商店更好地制定销售计划和预算。

当然,预测的准确程度取决于多元回归模型的准确性。

本文以一个简单的案例介绍了如何使用多元回归模型来分析数据,以更好地了解因果关系,以及用于预测未来销售情况。

多元回归模型分析是一种重要的数据分析技术,被广泛用于现实生活中的实际问题的解决。

但要记住,多元回归分析的结果仅供参考,最后的决策仍应根据实际情况,由实际决策者综合评估。

多元回归分析SPSS案例

一、案例背景

一所大学学术部门进行了一项有关学生毕业的调查,主要是为了探讨

学生毕业的影响因素,通过这个调查,大学试图及早发现潜在的学术发展

问题,从而改善学术教育和服务质量。

调查采用SPSS软件分析,将来自

一所大学学生的有关信息作为研究目标,本研究的研究对象为大学学生。

二、研究目的

1、探索影响大学生毕业的主要因素;

2、研究各变量对大学生毕业的影响程度;

3、提出适合大学学生的毕业提升策略。

三、研究变量

本研究采用多元线性回归分析方法,研究变量有:(1)身体健康程

度(即体检结果);(2)现金流(即家庭收入);(3)家庭教育水平;(4)学习成绩;(5)家庭状况,即与家庭成员的关系;(6)个人情感

状况;(7)考试作弊。

四、研究方法

1、获取研究数据:

通过与学校协商,确定调查对象,以及采集问卷的方法(如发放问卷、网络调查等),以获取有关学生毕业的数据;

2、数据处理:

清洗数据,将数据分类进行处理,去除无关信息;

3、多元回归分析:

计算自变量与因变量之间的线性关系,分析变量间关系,建立多元回归模型;。

多元线性回归方法及其应用实例多元线性回归方法(Multiple Linear Regression)是一种广泛应用于统计学和机器学习领域的回归分析方法,用于研究自变量与因变量之间的关系。

与简单线性回归不同,多元线性回归允许同时考虑多个自变量对因变量的影响。

多元线性回归建立了自变量与因变量之间的线性关系模型,通过最小二乘法估计回归系数,从而预测因变量的值。

其数学表达式为:Y=β0+β1X1+β2X2+...+βnXn+ε,其中Y是因变量,Xi是自变量,βi是回归系数,ε是误差项。

1.房价预测:使用多个自变量(如房屋面积、地理位置、房间数量等)来预测房价。

通过建立多元线性回归模型,可以估计出各个自变量对房价的影响权重,从而帮助房产中介或购房者进行房价预测和定价。

2.营销分析:通过分析多个自变量(如广告投入、促销活动、客户特征等)与销售额之间的关系,可以帮助企业制定更有效的营销策略。

多元线性回归可以用于估计各个自变量对销售额的影响程度,并进行优化。

3.股票分析:通过研究多个自变量(如市盈率、市净率、经济指标等)与股票收益率之间的关系,可以辅助投资者进行股票选择和投资决策。

多元线性回归可以用于构建股票收益率的预测模型,并评估不同自变量对收益率的贡献程度。

4.生理学研究:多元线性回归可应用于生理学领域,研究多个自变量(如年龄、性别、体重等)对生理指标(如心率、血压等)的影响。

通过建立回归模型,可以探索不同因素对生理指标的影响,并确定其重要性。

5.经济增长预测:通过多元线性回归,可以将多个自变量(如人均GDP、人口增长率、外商直接投资等)与经济增长率进行建模。

这有助于政府和决策者了解各个因素对经济发展的影响力,从而制定相关政策。

在实际应用中,多元线性回归方法有时也会面临一些挑战,例如共线性(多个自变量之间存在高度相关性)、异方差性(误差项方差不恒定)、自相关(误差项之间存在相关性)等问题。

为解决这些问题,研究人员提出了一些改进和扩展的方法,如岭回归、Lasso回归等。

多元线性回归实例分析报告多元线性回归是一种用于预测目标变量和多个自变量之间关系的统计分析方法。

它可以帮助我们理解多个自变量对目标变量的影响,并通过建立回归模型进行预测。

本文将以一个实例为例,详细介绍多元线性回归的分析步骤和结果。

假设我们研究了一个电子产品公司的销售数据,并想通过多元线性回归来预测销售额。

我们收集了以下数据:目标变量(销售额)和三个自变量(广告费用、产品种类和市场规模)。

首先,我们需要对数据进行探索性分析,了解数据的分布、缺失值等情况。

我们可以使用散点图和相关系数矩阵来查看变量之间的关系。

通过绘制广告费用与销售额的散点图,我们可以观察到一定的正相关关系。

相关系数矩阵可以用来度量变量之间的线性关系的强度和方向。

接下来,我们需要构建多元线性回归模型。

假设目标变量(销售额)与三个自变量(广告费用、产品种类和市场规模)之间存在线性关系,模型可以表示为:销售额=β0+β1*广告费用+β2*产品种类+β3*市场规模+ε其中,β0是截距,β1、β2和β3是回归系数,ε是误差项。

我们可以使用最小二乘法估计回归系数。

最小二乘法可以最小化目标变量的预测值和实际值之间的差异的平方和。

通过计算最小二乘估计得到的回归系数,我们可以建立多元线性回归模型。

在实际应用中,我们通常使用统计软件来进行多元线性回归分析。

通过输入相应的数据和设置模型参数,软件会自动计算回归系数和其他统计指标。

例如,我们可以使用Python的statsmodels库或R语言的lm函数来进行多元线性回归分析。

最后,我们需要评估回归模型的拟合程度和预测能力。

常见的评估指标包括R方值和调整R方值。

R方值可以描述自变量对因变量的解释程度,值越接近1表示拟合程度越好。

调整R方值考虑了模型中自变量的个数,避免了过度拟合的问题。

在我们的实例中,假设我们得到了一个R方值为0.8的多元线性回归模型,说明模型可以解释目标变量80%的方差。

这个模型还可以用来进行销售额的预测。

多元回归分析实例假设我们要研究一些公司员工的薪水与几个因素之间的关系,这几个因素包括员工的工作年限、教育程度和工作绩效评分。

我们希望通过多元回归分析来确定这些因素对员工薪水的影响。

为了进行多元回归分析,我们首先需要收集数据。

我们从该公司的员工数据库中随机选择了100个员工的数据,包括他们的薪水、工作年限、教育程度和工作绩效评分。

接下来,我们使用软件进行多元回归分析。

假设我们使用多元线性回归模型来建立模型,其中薪水是因变量,工作年限、教育程度和工作绩效评分是自变量。

模型可以表示为:薪水=β0+β1*工作年限+β2*教育程度+β3*工作绩效评分+ε其中,β0、β1、β2和β3是模型的系数,表示每个自变量对应的影响程度,ε表示误差项。

我们使用最小二乘法来估计模型的系数。

最小二乘法通过将真实值和模型预测值之间的平方差最小化来确定系数的值。

通过软件运行回归分析,我们可以得到系数的估计值。

假设我们得到的回归结果如下:薪水=3000+500*工作年限+1000*教育程度+200*工作绩效评分根据回归结果,我们可以解读系数的意义。

工作年限系数为500,表示每增加一年的工作年限,员工的薪水平均增加500元。

教育程度系数为1000,表示每提高一个学历水平,员工的薪水平均增加1000元。

工作绩效评分系数为200,表示每提高一个绩效评分,员工的薪水平均增加200元。

同时,我们还需要进行统计检验来确定变量之间的显著性。

通过计算t值和p值,我们可以确定变量之间的关系是否统计显著。

在这个例子中,假设工作年限和教育程度的t值和p值都小于0.05,说明它们与薪水之间的关系是显著的。

而工作绩效评分的t值和p值大于0.05,说明它与薪水之间的关系不显著。

最后,我们还可以计算模型的拟合优度,来评估模型的好坏。

常用的拟合优度指标有R方和调整R方。

R方表示模型解释变量方差的比例,调整R方通过引入自由度的惩罚项来修正R方的偏倚。

通过以上步骤,我们可以完成这个多元回归分析的实例。

多元回归分析案例数据多元回归分析是一种统计分析方法,它可以用来研究多个自变量对因变量的影响。

在实际应用中,多元回归分析可以帮助我们理解不同因素之间的关系,预测因变量的数值,并进行因素的影响比较等。

本文将通过一个实际案例来介绍多元回归分析的应用,以及如何利用案例数据进行多元回归分析。

案例背景。

假设我们是一家电子产品公司的市场营销部门,我们想要了解电子产品销售额与广告投入、产品定价和季节因素之间的关系。

为了实现这一目标,我们收集了一年的销售数据,并记录了每个月的广告投入、产品定价和销售额等信息。

数据分析。

首先,我们需要对收集的数据进行分析和处理。

我们可以利用统计软件,如SPSS、R或Python等,对数据进行多元回归分析。

在进行分析前,我们需要对数据进行数据清洗,包括缺失值处理、异常值处理等。

接下来,我们可以建立多元回归模型,以销售额作为因变量,广告投入、产品定价和季节因素作为自变量,进行回归分析。

模型解释。

通过多元回归分析,我们可以得到各个自变量对销售额的影响程度,以及它们之间的相互影响关系。

比如,我们可以得出广告投入每增加一单位,销售额增加的数量;产品定价每增加一单位,销售额的变化情况;季节因素对销售额的影响等。

这些信息可以帮助我们更好地理解销售额的变化规律,为市场营销策略的制定提供依据。

结果预测。

除了对现有数据进行分析外,多元回归分析还可以用来进行结果预测。

通过建立的回归模型,我们可以输入不同的自变量数值,预测对应的销售额。

这对于制定销售计划、预测市场需求等方面具有重要意义。

结论。

通过对多元回归分析案例数据的分析,我们可以得出不同自变量对销售额的影响程度和影响关系,为市场营销决策提供科学依据。

同时,多元回归分析还可以用来进行结果预测,帮助我们更好地制定营销策略和销售计划。

因此,多元回归分析在实际应用中具有重要的意义,可以帮助企业更好地理解市场和预测销售情况。

在本文中,我们通过一个实际案例介绍了多元回归分析的应用,以及如何利用案例数据进行多元回归分析。

农民收入影响因素的多元回归分析自改革开放以来,虽然中国经济平均增长速度为9.5 % ,但二元经济结构给经济发展带来的问题仍然很突出。

农村人口占了中国总人口的70 %多,农业产业结构不合理,经济不发达,以及农民收入增长缓慢等问题势必成为我国经济持续稳定增长的障碍。

正确有效地解决好“三农”问题是中国经济走出困境,实现长期稳定增长的关键。

其中,农民收入增长是核心,也是解决“三农”问题的关键。

本文力图应用适当的多元线性回归模型,对有关农民收入的历史数据和现状进行分析,寻找其根源,探讨影响农民收入的主要因素,并在此基础上对如何增加农民收入提出相应的政策建议。

一、回归模型的建立(1)数据的收集根据实际的调查分析,我们在影响农民收入因素中引入3个解释变量。

即:X2-财政用于农业的支出的比重,X3-乡村从业人员占农村人口的比重,X4 -农作物播种面积1991223.2510.2650.92149585.8 1992233.1910.0551.53149007.1 1993265.679.4951.86147740.7 1994335.169.252.12148240.6 1995411.298.4352.41149879.3 1996460.688.8253.23152380.6 1997477.968.354.93153969.2 1998474.0210.6955.84155705.7 1999466.88.2357.16156372.8 2000466.167.7559.33156299.9 2001469.87.7160.62155707.9 2002468.957.1762.02154635.5 2003476.247.1263.721524152004499.399.6765.64153552.6 2005521.27.2267.59155487.7(1)回归模型的构建Y i=1+2X2+3X3+4X4+u i二、回归模型的分析(1)多重共线性检验系数a(2)模型异方差的检验异方差产生的原因有:数据质量原因、模型设定原因。

多元线性回归模型的案例分析在实际生活中,多元线性回归模型可以广泛应用于各个领域。

以下是一个案例分析,以说明多元线性回归模型的应用。

案例:房价预测背景:城市的房地产公司想要推出一款房屋估价服务,帮助人们预测房屋的销售价格。

他们收集了一些相关数据,如房屋的面积、房间的数量、地理位置等因素,并希望通过建立一个多元线性回归模型来实现房价的预测。

步骤:1.数据收集:收集相关数据。

在本案例中,我们收集到了50个样本数据,每个样本包含了房屋的面积、房间的数量和房屋的销售价格。

2.数据预处理:对数据进行预处理,包括缺失值处理、异常值处理等。

在本案例中,我们假设数据已经经过清洗,没有缺失值和异常值。

3.特征选择:选择合适的特征变量。

在本案例中,我们选择房屋的面积和房间的数量作为特征变量,房屋的销售价格作为目标变量。

4.模型建立:建立多元线性回归模型。

根据特征变量和目标变量的关系,建立多元线性回归方程。

在本案例中,假设多元线性回归方程为:房价=β0+β1×面积+β2×房间数量+ε,其中β0、β1和β2分别为回归系数,ε为误差项。

5.模型训练:使用样本数据对模型进行训练。

通过最小二乘法等方法,估计出回归系数的取值。

6.模型评估:评估模型的性能。

通过计算模型的均方误差(MSE)、决定系数(R²)等指标,评估模型的拟合效果和预测能力。

7.模型应用:将模型用于房价的预测。

当有新的房屋数据输入时,通过模型的预测方程,可以得到该房屋的预测销售价格。

通过上述步骤,我们可以建立一个多元线性回归模型,并通过该模型对房价进行预测。

这个模型可以帮助房地产公司提供房价估价服务,也可以帮助购房者了解合理的房价范围。

某农场负责人认为早稻收获量(y :单位为kg/公顷)与春季降雨(x 1:单位为mm )和春季温度(x 2:单位为℃)有一定的联系,通过7组试验获得了相关的数据。

利用Excel 得到下面的回归结果(α=0.1):

方差分析表

(2)写出早稻收获量与春季降雨量、春季温度的多元线性回归方程,并解释各回归系数的意义。

(3)检验回归方程的线性关系是否显著? (4)检验各回归系数是否显著?

(5)计算判定系数2

R ,并解释它的实际意义。

(6)计算估计标准误差Se ,并解释它的实际意义。

(每个空格为0.5分)

-----3分 2、设总体回归模型为Y =1

2

1

2x x

αεββ+

++

估计回归方程为y

ˆ=1

2

1

2ˆˆˆx x αβ

β++,由EXCEL 输出结果可知,y

ˆ=120.3914.92218.45-++x x ,回归系数1

ˆβ

的意义指在温度不变的条件下,当降雨量每增加1mm ,早稻收获量平均增加14.92kg/公顷;回归系数

2

ˆβ

的意义指在降雨量不变的条件下,

当温度增加1℃,早稻收获量平均增加218.45kg/公顷。

---5分

3、由于p 值=0.000075<α=0.05,则拒绝原假设,即表明回归方程的线性关系是显著的。

---2分

4、由于各回归系数的P 值均小于α(0.05),所以各回归系数是显著的。

---2分 5、

2

13878495.67

0.9914000000

=

==SSR SST R

,表示早稻收获量的总变异中有99%的部分可以由降雨量、温度的联合变动来解释。

---4分

6、

174.29=

===e S (k 为自变量个数),是总体回归模型

中随机扰动项ε的标准差的无偏估计量,用来衡量回归方程拟合程度的分析指标,e

S

越大,

拟合程度越低;e

S

越小,拟合程度越高. ---4分。