多元线性回归方程的检验、预测

- 格式:ppt

- 大小:1.21 MB

- 文档页数:37

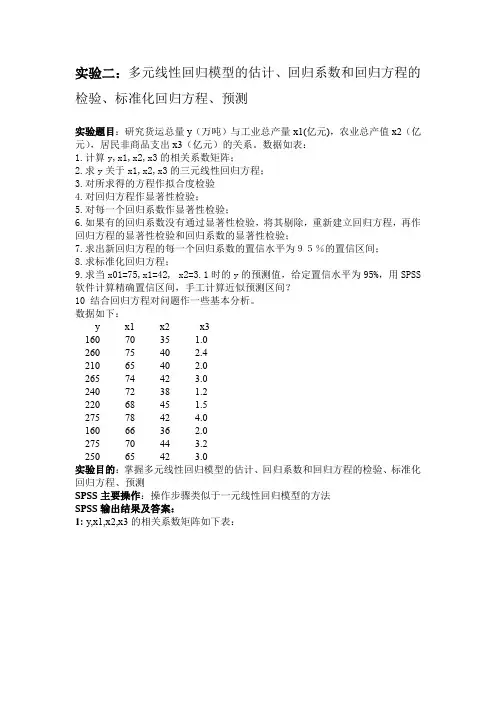

实验二:多元线性回归模型的估计、回归系数和回归方程的检验、标准化回归方程、预测实验题目:研究货运总量y(万吨)与工业总产量x1(亿元),农业总产值x2(亿元),居民非商品支出x3(亿元)的关系。

数据如表:1.计算y,x1,x2,x3的相关系数矩阵;2.求y关于x1,x2,x3的三元线性回归方程;3.对所求得的方程作拟合度检验4.对回归方程作显著性检验;5.对每一个回归系数作显著性检验;6.如果有的回归系数没有通过显著性检验,将其剔除,重新建立回归方程,再作回归方程的显著性检验和回归系数的显著性检验;7.求出新回归方程的每一个回归系数的置信水平为95%的置信区间;8.求标准化回归方程;9.求当x01=75,x1=42, x2=3.1时的y的预测值,给定置信水平为95%,用SPSS 软件计算精确置信区间,手工计算近似预测区间?10 结合回归方程对问题作一些基本分析。

数据如下:y x1 x2 x31607035 1.02607540 2.42106540 2.02657442 3.02407238 1.22206845 1.52757842 4.01606636 2.02757044 3.22506542 3.0实验目的:掌握多元线性回归模型的估计、回归系数和回归方程的检验、标准化回归方程、预测SPSS主要操作:操作步骤类似于一元线性回归模型的方法SPSS输出结果及答案:1:y,x1,x2,x3的相关系数矩阵如下表:由上述输出结果知:y=-348.280+3.754x1+7.101x2+12.447x3 3模型汇总b模型R R 方调整 R 方标准估计的误差1 .898a.806 .708 23.44188a. 预测变量: (常量), 居民非商品支出X3(亿元), 工业总产值X1(亿元), 农业总产值X2(亿元)。

b. 因变量: 货运总量Y(万吨)由上述输出结果知:调整R square=0.708,拟合的较好4Anova b模型平方和df 均方 F Sig.1 回归13655.370 3 4551.790 8.283 .015a残差3297.130 6 549.522总计16952.500 9a. 预测变量: (常量), 居民非商品支出X3(亿元), 工业总产值X1(亿元), 农业总产值X2(亿元)。

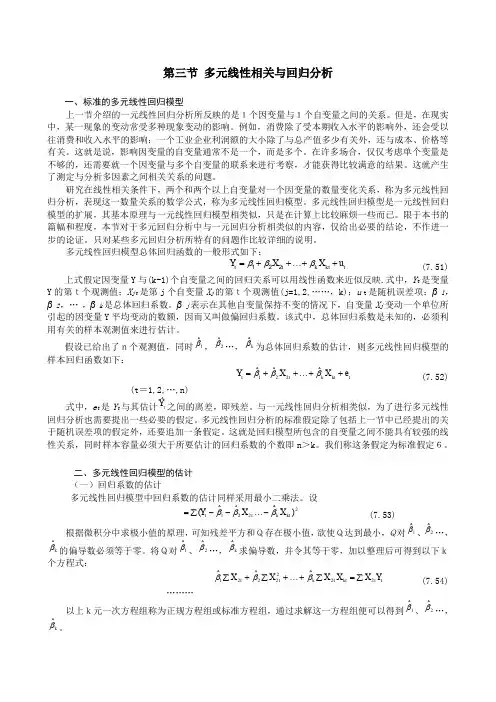

第三节 多元线性相关与回归分析一、标准的多元线性回归模型上一节介绍的一元线性回归分析所反映的是1个因变量与1个自变量之间的关系。

但是,在现实中,某一现象的变动常受多种现象变动的影响。

例如,消费除了受本期收入水平的影响外,还会受以往消费和收入水平的影响;一个工业企业利润额的大小除了与总产值多少有关外,还与成本、价格等有关。

这就是说,影响因变量的自变量通常不是一个,而是多个。

在许多场合,仅仅考虑单个变量是不够的,还需要就一个因变量与多个自变量的联系来进行考察,才能获得比较满意的结果。

这就产生了测定与分析多因素之间相关关系的问题。

研究在线性相关条件下,两个和两个以上自变量对一个因变量的数量变化关系,称为多元线性回归分析,表现这一数量关系的数学公式,称为多元线性回归模型。

多元线性回归模型是一元线性回归模型的扩展,其基本原理与一元线性回归模型相类似,只是在计算上比较麻烦一些而已。

限于本书的篇幅和程度,本节对于多元回归分析中与一元回归分析相类似的内容,仅给出必要的结论,不作进一步的论证。

只对某些多元回归分析所特有的问题作比较详细的说明。

多元线性回归模型总体回归函数的一般形式如下:t kt k t t u X X Y ++⋯++=βββ221 (7.51)上式假定因变量Y 与(k-1)个自变量之间的回归关系可以用线性函数来近似反映.式中,Y t 是变量Y 的第t个观测值;X jt 是第j 个自变量X j 的第t个观测值(j=1,2,……,k);u t 是随机误差项;β1,β2,… ,βk 是总体回归系数。

βj 表示在其他自变量保持不变的情况下,自变量X j 变动一个单位所引起的因变量Y 平均变动的数额,因而又叫做偏回归系数。

该式中,总体回归系数是未知的,必须利用有关的样本观测值来进行估计。

假设已给出了n个观测值,同时1ˆβ,2ˆβ…,k βˆ为总体回归系数的估计,则多元线性回归模型的样本回归函数如下:t kt k t t e X X Y ++⋯++=βββˆˆˆ221 (7.52)(t =1,2,…,n)式中,e t 是Y t 与其估计t Y ˆ之间的离差,即残差。

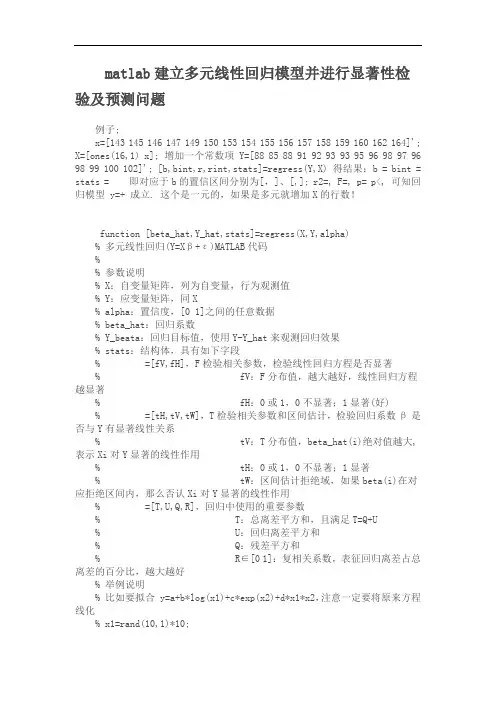

matlab建立多元线性回归模型并进行显著性检验及预测问题例子;x=[143 145 146 147 149 150 153 154 155 156 157 158 159 160 162 164]';X=[ones(16,1) x]; 增加一个常数项 Y=[88 85 88 91 92 93 93 95 96 98 97 9698 99 100 102]'; [b,bint,r,rint,stats]=regress(Y,X) 得结果:b = bint = stats = 即对应于b的置信区间分别为[,]、[,]; r2=, F=, p= p<, 可知回归模型 y=+ 成立. 这个是一元的,如果是多元就增加X的行数!function [beta_hat,Y_hat,stats]=regress(X,Y,alpha)% 多元线性回归(Y=Xβ+ε)MATLAB代码%% 参数说明% X:自变量矩阵,列为自变量,行为观测值% Y:应变量矩阵,同X% alpha:置信度,[0 1]之间的任意数据% beta_hat:回归系数% Y_beata:回归目标值,使用Y-Y_hat来观测回归效果% stats:结构体,具有如下字段% =[fV,fH],F检验相关参数,检验线性回归方程是否显著% fV:F分布值,越大越好,线性回归方程越显著% fH:0或1,0不显著;1显著(好)% =[tH,tV,tW],T检验相关参数和区间估计,检验回归系数β是否与Y有显著线性关系% tV:T分布值,beta_hat(i)绝对值越大,表示Xi对Y显著的线性作用% tH:0或1,0不显著;1显著% tW:区间估计拒绝域,如果beta(i)在对应拒绝区间内,那么否认Xi对Y显著的线性作用% =[T,U,Q,R],回归中使用的重要参数% T:总离差平方和,且满足T=Q+U% U:回归离差平方和% Q:残差平方和% R∈[0 1]:复相关系数,表征回归离差占总离差的百分比,越大越好% 举例说明% 比如要拟合 y=a+b*log(x1)+c*exp(x2)+d*x1*x2,注意一定要将原来方程线化% x1=rand(10,1)*10;% x2=rand(10,1)*10;% Y=5+8*log(x1)+*exp(x2)+*x1.*x2+rand(10,1); % 以上随即生成一组测试数据% X=[ones(10,1) log(x1) exp(x2) x1.*x2]; % 将原来的方表达式化成Y=Xβ,注意最前面的1不要丢了% [beta_hat,Y_hat,stats]=mulregress(X,Y,%% 注意事项% 有可能会出现这样的情况,总的线性回归方程式显著的=1),% 但是所有的回归系数却对Y的线性作用却不显著=0),产生这种现象的原意是% 回归变量之间具有较强的线性相关,但这种线性相关不能采用刚才使用的模型描述,% 所以需要重新选择模型%C=inv(X'*X);Y_mean=mean(Y);% 最小二乘回归分析beta_hat=C*X'*Y; % 回归系数βY_hat=X*beta_hat; % 回归预测% 离差和参数计算Q=(Y-Y_hat)'*(Y-Y_hat); % 残差平方和U=(Y_hat-Y_mean)'*(Y_hat-Y_mean); % 回归离差平方和T=(Y-Y_mean)'*(Y-Y_mean); % 总离差平方和,且满足T=Q+UR=sqrt(U/T); % 复相关系数,表征回归离差占总离差的百分比,越大越好[n,p]=size(X); % p变量个数,n样本个数% 回归显著性检验fV=(U/(p-1))/(Q/(n-p)); % 服从F分布,F的值越大越好fH=fV>finv(alpha,p-1,n-p); % H=1,线性回归方程显著(好);H=0,回归不显著% 回归系数的显著性检验chi2=sqrt(diag(C)*Q/(n-p)); % 服从χ2(n-p)分布tV=beta_hat./chi2; % 服从T分布,绝对值越大线性关系显著tInv=tinv+alpha/2,n-p);tH=abs(tV)>tInv; % H(i)=1,表示Xi对Y显著的线性作用;H(i)=0,Xi 对Y的线性作用不明显% 回归系数区间估计tW=[-chi2,chi2]*tInv; % 接受H0,也就是说如果在beta_hat(i)对应区间中,那么Xi与Y线性作用不明显stats=struct('fTest',[fH,fV],'tTest',[tH,tV,tW],'TUQR',[T,U,Q,R]) ;。

利用多元线性回归分析进行预测多元线性回归是一种重要的统计分析方法,它可以使用多个自变量来预测一个连续的因变量。

在实际生活中,多元线性回归分析广泛应用于各个领域,如经济学、金融学、医学研究等等。

本文将介绍多元线性回归分析的基本原理、应用场景以及注意事项,并通过实例来展示如何进行预测。

首先,我们来了解一下多元线性回归的基本原理。

多元线性回归建立了一个线性模型,它通过多个自变量来预测一个因变量的值。

假设我们有p个自变量(x1, x2, ..., xp)和一个因变量(y),那么多元线性回归模型可以表示为:y = β0 + β1*x1 + β2*x2 + ... + βp*xp + ε其中,y是我们要预测的因变量值,β0是截距,β1, β2, ..., βp是自变量的系数,ε是误差项。

多元线性回归分析中,我们的目标就是求解最优的系数估计值β0, β1, β2, ..., βp,使得预测值y与实际观测值尽可能接近。

为了达到这个目标,我们需要借助最小二乘法来最小化残差平方和,即通过最小化误差平方和来找到最佳的系数估计值。

最小二乘法可以通过求解正规方程组来得到系数估计值的闭式解,也可以通过梯度下降等迭代方法来逼近最优解。

多元线性回归分析的应用场景非常广泛。

在经济学中,它可以用来研究经济增长、消费行为、价格变动等问题。

在金融学中,它可以用来预测股票价格、利率变动等。

在医学研究中,它可以用来研究疾病的风险因素、药物的疗效等。

除了以上领域外,多元线性回归分析还可以应用于市场营销、社会科学等各个领域。

然而,在进行多元线性回归分析时,我们需要注意一些问题。

首先,我们需要确保自变量之间不存在多重共线性。

多重共线性可能会导致模型结果不准确,甚至无法得出可靠的回归系数估计。

其次,我们需要检验误差项的独立性和常态性。

如果误差项不满足这些假设,那么回归结果可能是不可靠的。

此外,还需要注意样本的选取方式和样本量的大小,以及是否满足线性回归的基本假设。

多元线性回归分析及其应用一、本文概述《多元线性回归分析及其应用》这篇文章旨在深入探讨多元线性回归分析的基本原理、方法以及在实际应用中的广泛运用。

文章首先将对多元线性回归分析的基本概念进行阐述,包括其定义、特点以及与其他统计分析方法的区别。

随后,文章将详细介绍多元线性回归分析的数学模型、参数估计方法以及模型的检验与优化。

在介绍完多元线性回归分析的基本理论后,文章将重点探讨其在各个领域的应用。

通过具体案例分析,展示多元线性回归分析在解决实际问题中的强大作用,如经济预测、市场研究、医学统计等。

文章还将讨论多元线性回归分析在实际应用中可能遇到的问题,如多重共线性、异方差性等,并提出相应的解决方法。

文章将对多元线性回归分析的发展趋势进行展望,探讨其在大数据时代背景下的应用前景以及面临的挑战。

通过本文的阅读,读者可以全面了解多元线性回归分析的基本理论、方法以及实际应用,为相关领域的研究与实践提供有力支持。

二、多元线性回归分析的基本原理多元线性回归分析是一种预测性的建模技术,它研究的是因变量(一个或多个)和自变量(一个或多个)之间的关系。

这种技术通过建立一个包含多个自变量的线性方程,来预测因变量的值。

这个方程描述了因变量如何依赖于自变量,并且提供了自变量对因变量的影响的量化估计。

在多元线性回归分析中,我们假设因变量和自变量之间存在线性关系,即因变量可以表示为自变量的线性组合加上一个误差项。

这个误差项表示了模型中未能解释的部分,通常假设它服从某种概率分布,如正态分布。

多元线性回归模型的参数估计通常通过最小二乘法来实现。

最小二乘法的基本思想是通过最小化预测值与实际值之间的残差平方和来求解模型的参数。

这个过程可以通过数学上的最优化方法来完成,例如梯度下降法或者正规方程法。

除了参数估计外,多元线性回归分析还需要进行模型的诊断和验证。

这包括检查模型的拟合优度(如R方值)、检验自变量的显著性(如t检验或F检验)、评估模型的预测能力(如交叉验证)以及检查模型的假设是否成立(如残差的正态性、同方差性等)。

多元回归分析结果解读一、多元回归分析简介用回归方程定量地刻画一个应变量与多个自变量间的线性依存关系,称为多元回归分析(multiple linear regression),简称多元回归(multiple regression)。

多元回归分析是多变量分析的基础,也是理解监督类分析方法的入口!实际上大部分学习统计分析和市场研究的人的都会用回归分析,操作也是比较简单的,但能够知道多元回归分析的适用条件或是如何将回归应用于实践,可能还要真正领会回归分析的基本思想和一些实际应用手法!回归分析的基本思想是:虽然自变量和因变量之间没有严格的、确定性的函数关系,但可以设法找出最能代表它们之间关系的数学表达形式。

二、多元回归线性分析的运用具体地说,多元线性回归分析主要解决以下几方面的问题。

(1)确定几个特定的变量之间是否存在相关关系,如果存在的话,找出它们之间合适的数学表达式;(2)根据一个或几个变量的值,预测或控制另一个变量的取值,并且可以知道这种预测或控制能达到什么样的精确度;(3)进行因素分析。

例如在对于共同影响一个变量的许多变量(因素)之间,找出哪些是重要因素,哪些是次要因素,这些因素之间又有什么关系等等。

在运用多元线性回归时主要需要注意以下几点:首先,多元回归分析应该强调是多元线性回归分析!强调线性是因为大部分人用回归都是线性回归,线性的就是直线的,直线的就是简单的,简单的就是因果成比例的;理论上讲,非线性的关系我们都可以通过函数变化线性化,就比如:Y=a+bLnX,我们可以令t=LnX,方程就变成了Y=a+bt,也就线性化了。

第二,线性回归思想包含在其它多变量分析中,例如:判别分析的自变量实际上是回归,尤其是Fisher线性回归方程;Logistics回归的自变量也是回归,只不过是计算线性回归方程的得分进行了概率转换;甚至因子分析和主成分分析最终的因子得分或主成分得分也是回归算出来的;当然,还有很多分析最终也是回归思想!第三:什么是“回归”,回归就是向平均靠拢。

多元线性回归分析多元线性回归分析是一种常用的统计方法,用于研究多个自变量与因变量之间的关系。

它可以帮助我们理解多个因素对于一个目标变量的影响程度,同时也可以用于预测和解释因变量的变化。

本文将介绍多元线性回归的原理、应用和解读结果的方法。

在多元线性回归分析中,我们假设因变量与自变量之间存在线性关系。

具体而言,我们假设因变量是自变量的线性组合,加上一个误差项。

通过最小二乘法可以求得最佳拟合直线,从而获得自变量对因变量的影响。

多元线性回归分析的第一步是建立模型。

我们需要选择一个合适的因变量和若干个自变量,从而构建一个多元线性回归模型。

在选择自变量时,我们可以通过领域知识、经验和统计方法来确定。

同时,我们还需要确保自变量之间没有高度相关性,以避免多重共线性问题。

建立好模型之后,我们需要对数据进行拟合,从而确定回归系数。

回归系数代表了自变量对因变量的影响大小和方向。

通过最小二乘法可以求得使残差平方和最小的回归系数。

拟合好模型之后,我们还需要进行模型检验,以评估模型拟合的好坏。

模型检验包括对回归方程的显著性检验和对模型的拟合程度进行评估。

回归方程的显著性检验可以通过F检验来完成,判断回归方程是否显著。

而对模型的拟合程度进行评估可以通过判断决定系数R-squared的大小来完成。

解读多元线性回归结果时,首先需要看回归方程的显著性检验结果。

如果回归方程显著,说明至少一个自变量对因变量的影响是显著的。

接下来,可以观察回归系数的符号和大小,从中判断自变量对因变量的影响方向和相对大小。

此外,还可以通过计算标准化回归系数来比较不同自变量对因变量的相对重要性。

标准化回归系数表示自变量单位变化对因变量的单位变化的影响程度,可用于比较不同变量的重要性。

另外,决定系数R-squared可以用来评估模型对观测数据的拟合程度。

R-squared的取值范围在0到1之间,越接近1说明模型对数据的拟合越好。

但需要注意的是,R-squared并不能反映因果关系和预测能力。

多元线性回归模型的检验1多元性回归模型与一元线性回归模型一样,在得到参数的最小二乘法的估计值之后,也需要进行必要的检验与评价,以决定模型是否可以应用;1、拟合程度的测定;与一元线性回归中可决系数r2相对应,多元线性回归中也有多重可决系数r2,它是在因变量的总变化中,由回归方程解释的变动回归平方和所占的比重,R2越大,回归方各对样本数据点拟合的程度越强,所有自变量与因变量的关系越密切;计算公式为:其中,2.估计标准误差估计标准误差,即因变量y的实际值与回归方程求出的估计值之间的标准误差,估计标准误差越小,回归方程拟合程度越程;其中,k为多元线性回归方程中的自变量的个数;3.回归方程的显著性检验回归方程的显著性检验,即检验整个回归方程的显著性,或者说评价所有自变量与因变量的线性关系是否密切;能常采用F检验,F统计量的计算公式为:根据给定的显著水平a,自由度k,n-k-1查F分布表,得到相应的临界值Fa,若F > Fa,则回归方程具有显著意义,回归效果显著;F < Fa,则回归方程无显著意义,回归效果不显著;4.回归系数的显著性检验在一元线性回归中,回归系数显著性检验t检验与回归方程的显著性检验F检验是等价的,但在多元线性回归中,这个等价不成立;t检验是分别检验回归模型中各个回归系数是否具有显著性,以便使模型中只保留那些对因变量有显著影响的因素;检验时先计算统计量ti;然后根据给定的显著水平a,自由度n-k-1查t分布表,得临界值ta或ta / 2,t > t − a或ta / 2,则回归系数bi与0有显著关异,反之,则与0无显著差异;统计量t的计算公式为:其中,Cij是多元线性回归方程中求解回归系数矩阵的逆矩阵x'x − 1的主对角线上的第j 个元素;对二元线性回归而言,可用下列公式计算:其中,5.多重共线性判别若某个回归系数的t检验通不过,可能是这个系数相对应的自变量对因变量的影平不显著所致,此时,应从回归模型中剔除这个自变量,重新建立更为简单的回归模型或更换自变量;也可能是自变量之间有共线性所致,此时应设法降低共线性的影响;多重共线性是指在多元线性回归方程中,自变量之彰有较强的线性关系,这种关系若超过了因变量与自变量的线性关系,则回归模型的稳定性受到破坏,回归系数估计不准确;需要指出的是,在多元回归模型中,多重共线性的难以避免的,只要多重共线性不太严重就行了;判别多元线性回归方程是否存在严惩的多重共线性,可分别计算每两个自变量之间的可决系数r2,若r2 > R2或接近于R2,则应设法降低多重线性的影响;亦可计算自变量间的相关系数矩阵的特征值的条件数k = λ1 / λpλ1为最大特征值,λp为最小特征值,k<100,则不存在多重点共线性;若100≤k≤1000,则自变量间存在较强的多重共线性,若k>1000,则自变量间存在严重的多重共线性;降低多重共线性的办法主要是转换自变量的取值,如变绝对数为相对数或平均数,或者更换其他的自变量;检验当回归模型是根据动态数据建立的,则误差项e也是一个时间序列,若误差序列诸项之间相互独立,则误差序列各项之间没有相关关系,若误差序列之间存在密切的相关关系,则建立的回归模型就不能表述自变量与因变量之间的真实变动关系;检验就是误差序列的自相关检验;检验的方法与一元线性回归相同;。

多元线性回归模型及其应用摘要多元线性回归研究一个因变量、与两个或两个以上自变量的回归,是反映一种现象或事物的数量依多种现象或事物的数量的变动而相应地变动的规律。

建立多个变量之间线性或非线性数学模型数量关系式的统计方法。

多元线性回归模型主要分为建模、基本假设、检验、预测等。

检验是建立模型的核心,包括拟合检验、F 检验、T 检验。

本文采用2005-2006年全国财政支出数据和2005年全国各地生产总值数据,建立多元线性回归模型,预测2006年全国各地生产总值,并与实际数据分析比较。

建模使用了SPSS 和MATLAB 软件。

1.引言在回归分析中,如果有两个或两个以上的自变量,就称为多元回归。

事实上,一种现象常常是与多个因素相联系的,由多个自变量的最优组合共同来预测或估计因变量,比只用一个自变量进行预测或估计更有效,更符合实际。

因此多元线性回归比一元线性回归的实用意义更大。

在实际经济问题中,一个变量往往受到多个变量的影响。

因此本文运用多元线性回归模型分析2005年全国各地财政支出对生产总值的影响,并对2006年生产总值进行预测,将预测值与实际数据进行比较,从而体现多元线性回归模型预测的准确性。

2.模型建立2.1准备数据本文选取2005年我国31个省、市、自治区的地区生产总值和13个重要支出项,分别是:1x 为基本建设支出,2x 为企业挖潜改造资金,3x为科技三项费用,4x 为农业支出,5x 为农林水利气象等部门事业费,6x为工业交通部门事业费,7x 为流动部门事业费,8x 为教育事业费,9x 为科学事业费,10x为卫生经费,11x 为行政管理费,12x 为公检法司支出,13x 为城市维护费。

y 为地区生产总值。

(数据单位为:万元)2.2建模将13个重要支出项设为自变量,用)13,,1(,,21 =p x x x p 表示;将地区生产总值y 设为因变量。

采用最小二乘法拟合一个多元线性回归模型,采用数学软表2.1因而y 对13个自变量的线性回归方程为:13121110987654321953.40696.55111.46360.81117.62639.50668.188590.11767.43598.95032.6681.26770.25892.4182809ˆx x x x x x x x x x x x x y+++--+-+---+--= (2.1)2.3模型检验首先,对模型(2.1)进行拟合优度的检验,采用数学软件SRSS 计算样2R 2R 表2.2 模型汇总由表2.2可知,模型(2.1)拟合效果很好。

回归分析预测方法回归分析是一种统计学方法,用于研究自变量和因变量之间的关系,并使用这种关系来预测未来的观测数据。

在回归分析中,自变量被用来解释因变量的变化,并且可以使用回归方程来预测因变量的值。

回归分析有多种类型,例如简单线性回归、多元线性回归、多项式回归以及非线性回归等。

其中,简单线性回归是最简单且最常用的回归模型之一、它假设自变量和因变量之间存在线性关系,可以用一条直线来拟合数据。

回归方程的形式可以表示为:Y=β0+β1X+ε,其中Y是因变量,X是自变量,β0和β1是回归系数,ε是误差项。

多元线性回归是简单线性回归的扩展,它允许多个自变量来预测因变量。

回归方程的形式可以表示为:Y=β0+β1X1+β2X2+...+βnXn+ε,其中n是自变量的数量。

多项式回归适用于自变量和因变量之间的关系非线性的情况。

通过将自变量的幂次添加到回归方程中,可以通过拟合曲线来逼近数据。

非线性回归适用于因变量和自变量之间的关系不能通过简单的线性模型来解释的情况。

这种情况下,可以使用其他函数来拟合数据,例如指数函数、对数函数、幂函数等。

在进行回归分析之前,需要满足一些假设。

首先,自变量和因变量之间需要存在一定的关系。

其次,误差项需要满足正态分布和独立性的假设。

最后,自变量之间应该有一定的独立性,避免多重共线性的问题。

回归分析的步骤通常包括数据收集、数据预处理、模型建立、模型评估和模型使用等。

在数据收集和预处理阶段,需要收集并整理自变量和因变量的数据,并对数据进行处理,如缺失值处理和异常值处理等。

在模型建立阶段,需要根据问题的背景和数据的特点选择适当的回归模型,并使用统计软件进行参数估计。

在模型评估阶段,需要对模型进行检验,如检验回归系数的显著性、残差分析和模型的拟合程度等。

最后,在模型使用阶段,可以使用回归方程来预测未来的观测数据,或者进行因素分析和结果解释等。

回归分析预测方法的应用广泛,并且被广泛应用于各个领域,如经济学、金融学、社会科学以及医学等。