回归分析

- 格式:ppt

- 大小:752.00 KB

- 文档页数:24

回归分析及其应用数据分析是现代社会的重要组成部分,它可以帮助我们更好地理解问题,并提出更有针对性的解决方案。

回归分析是数据分析中最常用的一种方法之一,本文将介绍回归分析以及其在实际应用中的具体操作。

一、回归分析的概念回归分析是指利用统计方法来描述两个或多个变量之间相互关系的一种方法。

在回归分析中,通常将一个变量称为自变量,另一个变量称为因变量。

回归分析的目的是通过对自变量和因变量之间关系的研究来对未来的变量值进行预测。

二、回归分析的原理回归分析的基本原理是确定两个或多个变量之间的函数关系。

这个关系可以用一种数学函数形式来表示,如线性模型: y = a + bx (其中a和b是常数,y是因变量,x是自变量)。

通过拟合这一函数,我们可以得到自变量和因变量之间的关系,并预测未来的变量值。

三、回归分析的应用在实际应用中,回归分析具有广泛的应用领域。

以下是回归分析的几个经典案例:1.金融预测:利用回归分析,通过研究过去的数据来预测未来的股票价格波动。

2.销售预测:通过回归分析确定销售量与价格、市场份额、广告支出等自变量之间的关系,根据这个模型来预测未来的销售量。

3.人力资源管理:回归分析可以用于确定员工绩效与工资、教育水平、经验等自变量之间的关系,这有助于优化人力资源管理。

4.医疗研究:在医药领域,回归分析可以用于确定疾病与基因、年龄、性别等自变量之间的关系,从而为疾病的预防和治疗提供依据。

四、回归分析的步骤回归分析的具体步骤可以分为以下几个:1.确定研究问题在进行回归分析之前,需要明确研究问题,了解自变量与因变量之间的关系。

2.收集数据收集有关自变量和因变量之间关系的数据。

3.数据预处理对数据进行清洗、缺失值处理、异常值检测等预处理操作。

4.模型选择根据数据的特点,选择适合的回归模型。

5.模型拟合对收集到的数据进行回归分析,得到模型的系数以及相关的统计指标。

6.模型诊断对回归分析结果进行研究并进行模型诊断,确定模型是否合理。

统计学中的回归分析在统计学中,回归分析是一种重要的数据分析方法。

它用于探索自变量与因变量之间的关系,帮助我们理解变量之间的相互作用以及预测未来的趋势。

本文将介绍回归分析的基本概念、原理和应用。

一、回归分析的基本概念回归分析是通过建立数学模型来描述自变量与因变量之间的关系。

自变量是我们在问题中感兴趣的变量,而因变量是我们想要预测或解释的变量。

回归分析可以帮助我们确定自变量如何影响因变量,并找到最佳的拟合曲线或平面来描述这种关系。

回归分析的基本假设是,自变量与因变量之间存在线性关系,并且观测误差服从正态分布。

基于这个假设,我们可以使用最小二乘法来拟合回归模型,使得观测值与预测值之间的残差平方和最小化。

二、回归分析的原理1. 简单线性回归简单线性回归是最基本的回归分析方法,用于研究只包含一个自变量和一个因变量的情况。

我们可以通过绘制散点图来观察两个变量之间的关系,并使用最小二乘法拟合一条直线来描述这种关系。

2. 多元线性回归多元线性回归适用于包含多个自变量和一个因变量的情况。

通过拟合一个多元线性模型,我们可以同时考虑多个自变量对因变量的影响,并研究它们之间的相互作用。

3. 非线性回归非线性回归用于描述自变量与因变量之间的非线性关系。

在这种情况下,我们可以根据问题的特点选择适当的非线性回归模型,并使用最小二乘法进行参数估计。

三、回归分析的应用回归分析在各个领域都有广泛的应用。

以下是一些常见的应用示例:1. 经济学中的回归分析经济学家常常使用回归分析来研究经济现象。

例如,他们可以通过回归分析来研究GDP与各种经济指标之间的关系,以及利率、通胀率等因素对经济增长的影响。

2. 医学研究中的回归分析医学研究中的回归分析可以用于探索治疗方法与患者恢复速度之间的关系。

通过收集患者的相关数据,如年龄、性别、治疗时间等,可以建立多元线性回归模型来预测患者的康复时间。

3. 市场营销中的回归分析市场营销人员可以利用回归分析来确定产品价格与销量之间的关系。

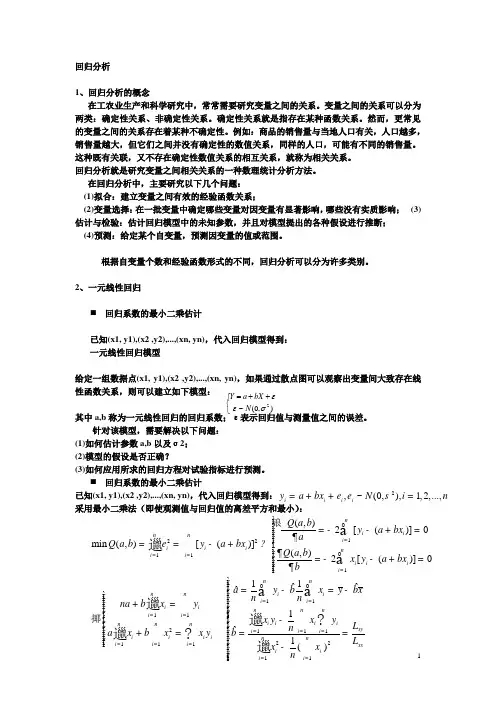

回归分析1、回归分析的概念在工农业生产和科学研究中,常常需要研究变量之间的关系。

变量之间的关系可以分为两类:确定性关系、非确定性关系。

确定性关系就是指存在某种函数关系。

然而,更常见的变量之间的关系存在着某种不确定性。

例如:商品的销售量与当地人口有关,人口越多,销售量越大,但它们之间并没有确定性的数值关系,同样的人口,可能有不同的销售量。

这种既有关联,又不存在确定性数值关系的相互关系,就称为相关关系。

回归分析就是研究变量之间相关关系的一种数理统计分析方法。

在回归分析中,主要研究以下几个问题: (1)拟合:建立变量之间有效的经验函数关系; (2)变量选择:在一批变量中确定哪些变量对因变量有显著影响,哪些没有实质影响; (3)估计与检验:估计回归模型中的未知参数,并且对模型提出的各种假设进行推断; (4)预测:给定某个自变量,预测因变量的值或范围。

根据自变量个数和经验函数形式的不同,回归分析可以分为许多类别。

2、一元线性回归⏹ 回归系数的最小二乘估计已知(x1, y1),(x2 ,y2),...,(xn, yn),代入回归模型得到: 一元线性回归模型给定一组数据点(x1, y1),(x2 ,y2),...,(xn, yn),如果通过散点图可以观察出变量间大致存在线性函数关系,则可以建立如下模型:其中a,b 称为一元线性回归的回归系数;ε表示回归值与测量值之间的误差。

针对该模型,需要解决以下问题: (1)如何估计参数a,b 以及σ2; (2)模型的假设是否正确?(3)如何应用所求的回归方程对试验指标进行预测。

⏹ 回归系数的最小二乘估计已知(x1, y1),(x2 ,y2),...,(xn, yn),代入回归模型得到: 采用最小二乘法(即使观测值与回归值的离差平方和最小):⎩⎨⎧++=),0(~2σεεN bX a Y 2,~(0,),1,2,...,i i i i y a bx N i n e e s =++=1221111112111(,)2[()]0min (,)[()](,)2[()]011ˆˆˆn i i n n i i i i n i i i i i i n i i n n i i ii i n n n i i i ii i i Q a b y a bx a Q a b y a bx Q a b x y a bx b a y b x y n n na b x y a x b x x y e ==========ì锒ï=--+=ïï¶ï==-+ íï¶ï=--+=ïï¶ïî=-=-ìïï+=ïïï揶íïï+=ïïïîå邋åå邋邋1111221ˆ1n i n n n i i i ixy i i i nn xxbx x y x y L n b L ====ìïïïïïïïïí-ïï==ïïïå邋⏹ 回归系数估计量的性质⏹ 样本相关系数及其显著性检验显然:样本相关系数R 的符号决定于Lxy ,因此与相关系数b 的符号一致。

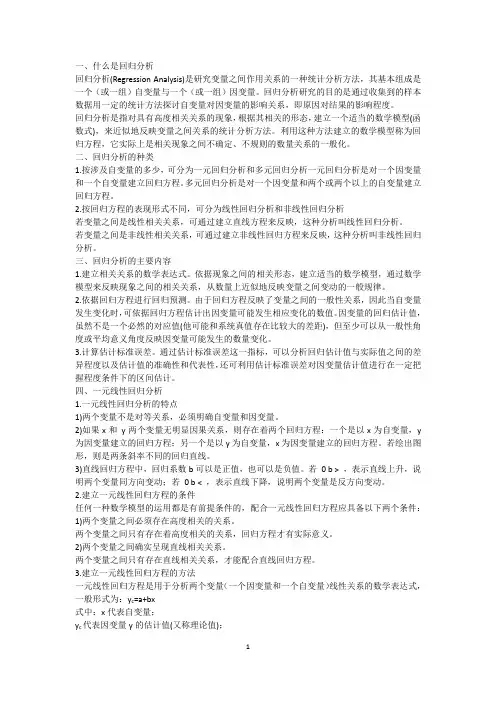

一、什么是回归分析回归分析(Regression Analysis)是研究变量之间作用关系的一种统计分析方法,其基本组成是一个(或一组)自变量与一个(或一组)因变量。

回归分析研究的目的是通过收集到的样本数据用一定的统计方法探讨自变量对因变量的影响关系,即原因对结果的影响程度。

回归分析是指对具有高度相关关系的现象,根据其相关的形态,建立一个适当的数学模型(函数式),来近似地反映变量之间关系的统计分析方法。

利用这种方法建立的数学模型称为回归方程,它实际上是相关现象之间不确定、不规则的数量关系的一般化。

二、回归分析的种类1.按涉及自变量的多少,可分为一元回归分析和多元回归分析一元回归分析是对一个因变量和一个自变量建立回归方程。

多元回归分析是对一个因变量和两个或两个以上的自变量建立回归方程。

2.按回归方程的表现形式不同,可分为线性回归分析和非线性回归分析若变量之间是线性相关关系,可通过建立直线方程来反映,这种分析叫线性回归分析。

若变量之间是非线性相关关系,可通过建立非线性回归方程来反映,这种分析叫非线性回归分析。

三、回归分析的主要内容1.建立相关关系的数学表达式。

依据现象之间的相关形态,建立适当的数学模型,通过数学模型来反映现象之间的相关关系,从数量上近似地反映变量之间变动的一般规律。

2.依据回归方程进行回归预测。

由于回归方程反映了变量之间的一般性关系,因此当自变量发生变化时,可依据回归方程估计出因变量可能发生相应变化的数值。

因变量的回归估计值,虽然不是一个必然的对应值(他可能和系统真值存在比较大的差距),但至少可以从一般性角度或平均意义角度反映因变量可能发生的数量变化。

3.计算估计标准误差。

通过估计标准误差这一指标,可以分析回归估计值与实际值之间的差异程度以及估计值的准确性和代表性,还可利用估计标准误差对因变量估计值进行在一定把握程度条件下的区间估计。

四、一元线性回归分析1.一元线性回归分析的特点1)两个变量不是对等关系,必须明确自变量和因变量。

什么是回归分析?

回归分析是一种统计学方法,用于探索和建立变量之间的关系。

它主要用于预测一个或多个自变量对因变量的影响。

回归分析可以

确定这些变量之间的线性关系,并利用这些关系进行预测和解释。

在回归分析中,自变量是独立变量,可以通过实验或观察进行

测量。

因变量则是依赖于自变量的变量。

回归分析的目标是通过对

自变量和因变量之间的关系进行建模,来预测和解释因变量的变化。

回归分析可以应用于各种领域和问题,例如经济学、金融学、

社会科学等。

它可以帮助研究人员了解不同变量之间的关系,并使

用这些关系进行预测和决策。

回归分析有多种方法,如简单线性回归、多元线性回归、逻辑

回归等。

每种方法都有自己的假设和计算方法。

研究人员需要根据

具体的问题和数据选择适当的方法进行分析。

总而言之,回归分析是一种重要的统计学工具,可以探索和建

立变量之间的关系,并利用这些关系进行预测和解释。

它在许多领

域中都有广泛的应用,可以帮助研究人员进行深入的数据分析和决策支持。

第七章回归分析前几章所讨论的内容,其目的在于寻求被测量的最佳值及其精度。

在生产和科学实验中,还有另一类问题,即测量与数据处理的目的并不在于获得被测量的估计值,而是为了寻求两个变量或多个变量之间的内在关系,这就是本章所要解决的主要问题。

表达变量之间关系的方法有散点图、表格、曲线、数学表达式等,其中数学表达式能较客观地反映事物的内在规律性,形式紧凑,且便于从理论上作进一步分析研究,对认识自然界量与量之间关系有着重要意义。

而数学表达式的获得是通过回归分析方法完成的。

第一节回归分析的基本概念一、函数与相关在生产和科学实验中,人们常遇到各种变量。

从贬值辩证唯物主义观点来看,这些变量之间是相互联系、互相依存的,它们之间存在着一定的关系。

人们通过实践,发现变量之间的关系可分为两种类型:1.函数关系(即确定性关系)数学分析和物理学中的大多数公式属于这种类型。

如以速度v作匀速运动的物体,走过的距离s与时间t之间,有如下确定的函数关系:s=vt若上式中的变量有两个已知,则另一个就可由函数关系精确地求出。

2.相关关系在实际问题中,绝大多数情况下变量之间的关系不那么简单。

例如,在车床上加工零件,零件的加工误差与零件的直径之间有一定的关系,知道了零件直径可大致估计其加工误差,但又不能精确地预知加工误差。

这是由于零件在加工过程中影响加工误差的因素很多,如毛坯的裕量、材料性能、背吃刀量、进给量、切削速度、零件长度等等,相互构成一个很复杂的关系,加工误差并不由零件直径这一因素所确定。

像这种关系,在实践中是大量存在的,如材料的抗拉强度与其硬度之间;螺纹零件中螺纹的作用中径与螺纹中径之间;齿轮各种综合误差与有关单项误差之间;某些光学仪器、电子仪器等开机后仪器的读数变化与时间之间;材料的性能与其化学成分之间等等。

这些变量之间既存在着密切的关系,又不能由一个(或几个)变量(自变量)的数值精确地求出另一个变量(因变量)的数值,而是要通过试验和调查研究,才能确定它们之间的关系,我们称这类变量之间的关系为相关关系。

回归分析回归分析(Regression Analysis )是研究因变量y 和自变量x 之间数量变化规律,并通过一定的数学表达式来描述这种关系,进而确定一个或几个自变量的变化对因变量的影响程度。

简约地讲,可以理解为用一种确定的函数关系去近似代替比较复杂的相关关系,这个函数称为回归函数,在实际问题中称为经验公式。

回归分析所研究的主要问题就是如何利用变量X ,Y 的观察值(样本),对回归函数进行统计推断,包括对它进行估计及检验与它有关的假设等。

在SPSS 中的“Analyze ”菜单下的“Regression ”项是专门用于回归分析的过程组。

单击该项,将打开“Regression ”的右拉式菜单,菜单包含如下几项:1.Linear 线性回归。

2.Curve Estimation 曲线估计。

3.Binary Logistic 二元逻辑分析。

4.Multinomial Logistic 多元逻辑分析。

5.Ordinal 序数分析。

6.Probit 概率分析。

7.Nonlinear 非线性估计。

8.Weight Estimation 加权估计。

9.2-Stage Least Squares 两段最小二乘法。

本课程将介绍其中的“Linear ”、“Curve Estimation ”和“Nonlinear ”项过程的应用。

一元回归分析在数学关系式中只描述了一个变量与另一个变量之间的数量变化关系,则称其为一元回归分析。

其回归模型为i i i bx a y ε++=,y 称为因变量,x 称为自变量,ε称为随机误差,a ,b 称为待估计的回归参数,下标i 表示第i 个观测值。

若给出a 和b 的估计量分别为b aˆ,ˆ则经验回归方程:ii x b a y ˆˆˆ+=,一般把i i i y y e ˆ-=称为残差, 残差i e 可视为扰动ε的“估计量”。

例:湖北省汉阳县历年越冬代二化螟发蛾盛期与当年三月上旬平均气温的数据如表1-1,分析三月上旬平均温度与越冬代二化螟发蛾盛期的关系。

回归分析方法总结全面回归分析是一种统计分析方法,用于研究自变量与因变量之间的关系。

它可以帮助我们了解自变量对因变量的影响程度,以及预测因变量的值。

回归分析有多种方法和技术,本文将对几种常用的回归分析方法进行总结和介绍。

1. 简单线性回归分析简单线性回归分析是回归分析的最基本形式,用于研究单个自变量与因变量之间的关系。

它假设自变量与因变量之间存在线性关系,并且通过拟合一条直线来描述这种关系。

简单线性回归分析使用最小二乘法来估计直线的参数,最小化观测值与模型预测值之间的差异。

2. 多元线性回归分析多元线性回归分析是回归分析的一种拓展形式,用于研究多个自变量与因变量之间的关系。

它假设各个自变量与因变量之间存在线性关系,并通过拟合一个多元线性模型来描述这种关系。

多元线性回归分析使用最小二乘法来估计模型的参数。

3. 逻辑回归分析逻辑回归分析是回归分析的一种特殊形式,用于研究二分类变量与一系列自变量之间的关系。

它通过拟合一个Logistic函数来描述二分类变量与自变量之间的概率关系。

逻辑回归分析可以用于预测二分类变量的概率或进行分类。

4. 多项式回归分析多项式回归分析是回归分析的一种变体,用于研究自变量与因变量之间的非线性关系。

它通过引入自变量的高次项来拟合一个多项式模型,以描述非线性关系。

多项式回归分析可以帮助我们探索自变量与因变量之间的复杂关系。

5. 非线性回归分析非线性回归分析是回归分析的一种广义形式,用于研究自变量与因变量之间的非线性关系。

它通过拟合一个非线性模型来描述这种关系。

非线性回归分析可以用于分析复杂的现象或数据,但需要更复杂的参数估计方法。

6. 岭回归分析岭回归分析是回归分析的一种正则化方法,用于处理自变量之间存在共线性的情况。

共线性会导致参数估计不稳定或不准确,岭回归通过加入一个正则化项来缩小参数估计的方差。

岭回归分析可以帮助我们在共线性存在的情况下得到更可靠的结果。

7. 主成分回归分析主成分回归分析是回归分析的一种降维方法,用于处理高维数据或自变量之间存在相关性的情况。

七种常见的回归分析什么是回归分析?回归分析是⼀种预测性的建模技术,它研究的是因变量(⽬标)和⾃变量(预测器)之间的关系。

这种技术通常⽤于预测分析,时间序列模型以及发现变量之间的因果关系。

例如,司机的鲁莽驾驶与道路交通事故数量之间的关系,最好的研究⽅法就是回归。

回归分析是建模和分析数据的重要⼯具。

在这⾥,我们使⽤曲线/线来拟合这些数据点,在这种⽅式下,从曲线或线到数据点的距离差异最⼩。

我会在接下来的部分详细解释这⼀点。

我们为什么使⽤回归分析?如上所述,回归分析估计了两个或多个变量之间的关系。

下⾯,让我们举⼀个简单的例⼦来理解它:⽐如说,在当前的经济条件下,你要估计⼀家公司的销售额增长情况。

现在,你有公司最新的数据,这些数据显⽰出销售额增长⼤约是经济增长的2.5倍。

那么使⽤回归分析,我们就可以根据当前和过去的信息来预测未来公司的销售情况。

使⽤回归分析的好处良多。

具体如下:1.它表明⾃变量和因变量之间的显著关系;2.它表明多个⾃变量对⼀个因变量的影响强度。

回归分析也允许我们去⽐较那些衡量不同尺度的变量之间的相互影响,如价格变动与促销活动数量之间联系。

这些有利于帮助市场研究⼈员,数据分析⼈员以及数据科学家排除并估计出⼀组最佳的变量,⽤来构建预测模型。

我们有多少种回归技术?有各种各样的回归技术⽤于预测。

这些技术主要有三个度量(⾃变量的个数,因变量的类型以及回归线的形状)。

我们将在下⾯的部分详细讨论它们。

对于那些有创意的⼈,如果你觉得有必要使⽤上⾯这些参数的⼀个组合,你甚⾄可以创造出⼀个没有被使⽤过的回归模型。

但在你开始之前,先了解如下最常⽤的回归⽅法:1. Linear Regression线性回归它是最为⼈熟知的建模技术之⼀。

线性回归通常是⼈们在学习预测模型时⾸选的技术之⼀。

在这种技术中,因变量是连续的,⾃变量可以是连续的也可以是离散的,回归线的性质是线性的。

线性回归使⽤最佳的拟合直线(也就是回归线)在因变量(Y)和⼀个或多个⾃变量(X)之间建⽴⼀种关系。

统计学中的回归分析回归分析是统计学中一种重要的数据分析方法,用于研究自变量和因变量之间的关系。

通过回归分析,我们可以探索并量化自变量对因变量的影响程度。

在本文中,我们将介绍回归分析的基本概念、原理以及应用,并分析其在统计学中的重要性。

一、回归分析的基本概念与原理回归分析是一种可以预测因变量值的统计方法。

一般来说,我们将自变量和因变量表示为数学模型中的变量,并通过回归分析来建立他们之间的关系。

最常见的回归分析方法是线性回归,它假设自变量和因变量之间存在线性关系。

线性回归的基本原理是通过最小化预测值和观测值的差异来确定自变量对因变量的影响。

回归分析利用已知数据集来拟合一个线性模型,并通过模型中的回归系数来量化自变量对因变量的影响。

回归系数表示自变量每单位变化对因变量的预期变化。

二、回归分析的应用领域回归分析在统计学中有广泛的应用,以下是其中几个重要的应用领域:1. 经济学:回归分析被广泛用于经济学研究中,以了解经济变量之间的关系。

例如,通过回归分析可以研究收入与消费之间的关系,为经济决策提供依据。

2. 社会科学:回归分析在社会科学研究中也得到了广泛应用。

例如,通过回归分析可以研究教育水平与收入之间的关系,分析各种社会因素对人们行为的影响。

3. 医学研究:回归分析被广泛用于医学研究中,以分析各种因素对健康状况的影响。

例如,通过回归分析可以研究饮食习惯与患病风险之间的关系。

4. 金融领域:回归分析在金融领域也得到了广泛应用。

例如,通过回归分析可以研究利率、汇率等因素对股票市场的影响,为投资决策提供参考。

三、回归分析的重要性回归分析在统计学中扮演着重要的角色,具有以下几个重要性:1. 揭示变量间的关系:通过回归分析,我们可以揭示不同变量之间的关系。

通过量化自变量对因变量的影响,我们可以了解其具体作用,并用于预测和决策。

2. 预测和模型建立:回归分析可以用于预测未来的因变量值。

通过建立回归模型,我们可以根据自变量的取值来预测因变量的值,为决策和规划提供依据。

回归分析名词解释回归分析是一种用于研究变量之间关系的统计方法。

它用于确定一个或多个自变量与一个因变量之间的关系模型,并通过此模型预测未知变量的值。

回归分析的目标是寻找自变量与因变量之间的最佳拟合线性关系。

在简单线性回归中,只有一个自变量和一个因变量,而多元线性回归则允许多个自变量和一个因变量。

回归分析包括以下几个关键概念:1. 自变量:自变量是研究者感兴趣的解释性变量。

它们被认为对因变量产生影响。

2. 因变量:因变量是研究者希望预测或解释的变量。

它们是回归分析的主要焦点。

3. 拟合线:拟合线表示自变量和因变量之间的关系。

回归分析试图找到一条最佳拟合线,以最好地表示数据。

4. 斜率:回归方程中的斜率表示因变量以自变量的单位变化时的变化量。

它反映了自变量对因变量的影响程度。

5. 截距:回归方程中的截距表示当自变量为零时,因变量的预测值。

它有助于解释因变量的基本水平。

回归分析的方法基于最小二乘法,试图最小化实际观测值与拟合线之间的误差。

通过计算残差(实际观测值与拟合线之间的差异)的平方和,回归分析可以确定最佳拟合线。

回归分析的应用广泛,可以用于各种领域中的数据分析和预测,如经济学、社会科学、医学等。

它可以帮助研究者了解变量之间的关系,并预测未来的观测值。

同时,回归分析的结果也可以用于制定决策、优化资源分配和评估政策效果。

然而,回归分析也有一些限制。

例如,它假设自变量和因变量之间的关系是线性的,而现实世界中的关系可能更为复杂。

此外,回归分析还要求数据符合一些假设,如正态分布和同方差性。

因此,在使用回归分析之前,研究者需要仔细检查数据的适用性和假设的满足程度。

综上所述,回归分析是一种用于研究变量之间关系的统计方法。

通过寻找最佳拟合线性关系,回归分析可以帮助预测和解释因变量,并在各种领域中应用广泛。

你应该要掌握的7种回归分析方法回归分析是一种常用的数据分析方法,用于研究自变量与因变量之间的关系。

在实际应用中,有许多不同的回归分析方法可供选择。

以下是应该掌握的7种回归分析方法:1. 简单线性回归分析(Simple Linear Regression):简单线性回归是回归分析中最简单的方法之一、它是一种用于研究两个变量之间关系的方法,其中一个变量是自变量,另一个变量是因变量。

简单线性回归可以用来预测因变量的值,基于自变量的值。

2. 多元线性回归分析(Multiple Linear Regression):多元线性回归是在简单线性回归的基础上发展起来的一种方法。

它可以用来研究多个自变量与一个因变量之间的关系。

多元线性回归分析可以帮助我们确定哪些自变量对于因变量的解释最为重要。

3. 逻辑回归(Logistic Regression):逻辑回归是一种用于预测二分类变量的回归分析方法。

逻辑回归可以用来预测一个事件发生的概率。

它的输出是一个介于0和1之间的概率值,可以使用阈值来进行分类。

4. 多项式回归(Polynomial Regression):多项式回归是回归分析的一种扩展方法。

它可以用来研究变量之间的非线性关系。

多项式回归可以将自变量的幂次作为额外的变量添加到回归模型中。

5. 岭回归(Ridge Regression):岭回归是一种用于处理多重共线性问题的回归分析方法。

多重共线性是指自变量之间存在高度相关性的情况。

岭回归通过对回归系数进行惩罚来减少共线性的影响。

6. Lasso回归(Lasso Regression):Lasso回归是另一种可以处理多重共线性问题的回归分析方法。

与岭回归不同的是,Lasso回归通过对回归系数进行惩罚,并使用L1正则化来选择最重要的自变量。

7. Elastic Net回归(Elastic Net Regression):Elastic Net回归是岭回归和Lasso回归的结合方法。