双目视觉传感器的工作原理

- 格式:docx

- 大小:3.29 KB

- 文档页数:2

双目视觉传感器的工作原理

双目视觉传感器是一种模仿人类双眼视觉系统的传感器,通过两个相互独立的摄像头来获取环境中的信息,并通过计算机算法将这些信息整合在一起,实现深度感知和三维重建。

其工作原理可以简单分为成像、匹配和计算三个步骤。

双目视觉传感器中的两个摄像头分别拍摄同一场景,由于两个摄像头之间的距离已知,因此在成像阶段可以通过两个摄像头拍摄到的图像来获取场景的深度信息。

这两个图像经过预处理后,会被传输到计算机中进行处理。

接下来是匹配阶段,双目视觉传感器会通过计算机算法将两个图像中的对应像素点进行匹配,找出它们在空间中的位置关系。

这个过程可以通过特征点匹配、立体匹配等方法来实现,通过精确的匹配算法,可以获取到像素点之间的视差信息,从而计算出物体的深度。

最后是计算阶段,通过已知的摄像头间距、匹配像素点的视差信息以及相机的内外参数等信息,可以利用三角测量法来计算出场景中物体的三维坐标信息。

通过这种方式,双目视觉传感器可以实现对环境中物体距离的准确感知,为机器人导航、环境建模、物体识别等应用提供重要支持。

双目视觉传感器的工作原理借鉴了人类双眼视觉系统的原理,通过两个摄像头协同工作,实现了对环境的立体感知和深度重建。

它在

机器人、自动驾驶、安防监控等领域有着广泛的应用,为智能设备的发展提供了强大的支持。

随着计算机视觉和人工智能技术的不断发展,双目视觉传感器的应用前景将更加广阔,为人类社会的进步和发展带来更多的可能性。

双目摄像头的工作原理双目摄像头是一种常见的计算机视觉设备,其工作原理是通过两个摄像头捕捉场景中的图像,并通过计算两个摄像头之间的距离和角度信息,以模拟人眼的视觉功能。

下面我们将详细介绍双目摄像头的工作原理。

一、双目摄像头的构成双目摄像头由两个摄像头、一个图像处理器和一个计算单元组成,其中摄像头是负责采集场景的两个映像的装置,一个图像处理器负责将二维图像转换成深度三维图像。

计算单元则是负责在得到三维图像后进行数据处理和分析。

二、双目摄像头的工作原理在实际使用中,双目摄像头通常会将两个摄像头间距离设为一定的值,这个值也叫做摄像头的基线,并且每个摄像头都会拍摄场景中的一个不同角度的图像。

在图像处理之前,需要对相机进行标定,即找出两个摄像头对应图像中相同的或有规律的点的位置关系,并通过这些点来确定两个摄像头之间的距离和角度信息。

1. 视差原理在单个摄像头图像中,物体距离摄像头越远,则其在图像中所占像素大小就越小,而在双目摄像头中,由于两个摄像头的位置不同,因此拍摄到的同一物体在两个图像上所占像素大小也是不同的。

这个大小差异就叫做视差。

视差原理就是利用这个视差信息计算出物体的距离。

2. 立体成像原理双目摄像头同时拍摄到的两个图像就像人的两只眼睛一样。

通过对两个图像的处理,可以得到一个“立体图片”,也就是一张三维深度图像。

立体成像原理就是通过对两个图像的匹配来确定物体在场景中的位置。

3. 三角测量原理通过视差和立体成像原理,可以计算出物体在相机坐标系下的位置,但是由于不同相机的坐标系不同,所以需要将相机坐标系转换成世界坐标系。

这一步需要用到三角测量原理,即通过一组已知的平面三角形来确定各个相机坐标系之间的关系。

三、双目摄像头的应用双目摄像头在工业、医疗、安防、教育等领域都有广泛的应用,比如:1. 工业机器人和自动化生产线的视觉引导和定位。

2. 医疗图像拍摄,如体表和内窥镜的检测。

3. 安防监控系统的三维视觉分析,如人脸识别、行为识别等。

双目相机成像原理1. 介绍双目相机是一种通过两个摄像机同时获取场景图像的设备,它模拟了人眼的视觉系统,能够实现对三维场景的深度感知和测量。

双目相机广泛应用于计算机视觉、机器人导航、虚拟现实等领域。

本文将深入探讨双目相机的成像原理。

2. 单目成像原理在了解双目相机之前,我们首先需要了解单目相机的成像原理。

单目相机通过一个摄像机获取场景图像,其成像原理主要由以下几个方面组成:2.1 光学系统单目相机的光学系统由镜头和光圈组成,镜头负责将入射的光线聚焦到成像平面上,光圈则用于控制进入相机的光线量。

2.2 图像传感器图像传感器是单目相机的核心部件,一般采用CCD或CMOS技术制造。

它由一系列光敏元件组成,能够将光线转化为电信号,并存储为数字图像。

2.3 曝光和快门曝光和快门是指控制图像传感器对光线的敏感程度和感光时间的参数。

曝光时间越长,图像亮度越高;而快门时间越短,图像的运动模糊程度越低。

2.4 像素像素是图像传感器上的最小光敏单元,它记录了场景中的颜色和亮度信息。

图像的分辨率取决于相机的像素数量,像素越多,图像细节越丰富。

3. 双目成像原理3.1 立体视觉双目成像的核心概念是立体视觉。

立体视觉是人类利用两只眼睛同时观察场景来获取深度和距离信息的能力,双目相机模仿了这一过程。

通过将两个摄像机分别放置在一定距离内,可以得到两张稍有差异的图像。

3.2 视差视差是双目成像中的关键概念,它指两个摄像机观察同一点时图像中对应点的像素位置差异。

根据视差原理,通过计算视差大小可以得到场景中不同点的深度信息。

3.3 标定双目相机的标定是确定两个摄像机之间的几何关系以及摄像机内外参数的过程。

常见的标定方法有张正友标定法、Tsai标定法等。

通过标定,可以建立一对像素与实际三维空间点之间的映射关系。

3.4 视差图与深度图视差图是指通过计算双目图像中的视差得到的二维图像。

视差图可以直观地显示出场景中不同点的深度差异。

深度图则是通过视差图进一步计算得到的三维场景深度信息。

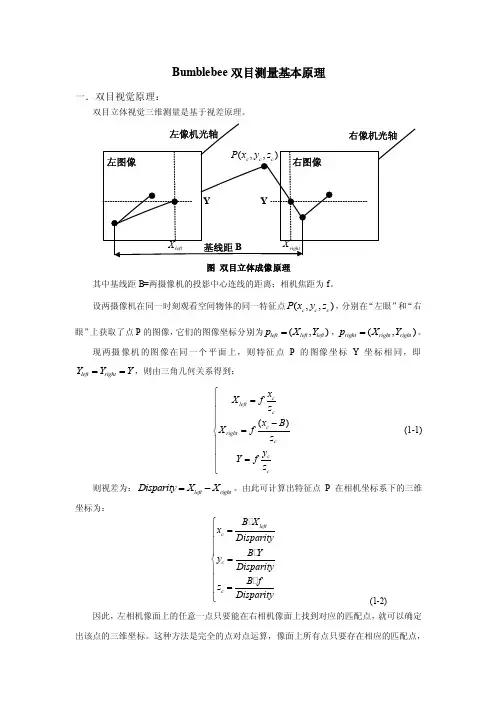

Bumblebee 双目测量基本原理一.双目视觉原理:双目立体视觉三维测量是基于视差原理。

图 双目立体成像原理其中基线距B=两摄像机的投影中心连线的距离;相机焦距为f 。

设两摄像机在同一时刻观看空间物体的同一特征点(,,)c c c P x y z ,分别在“左眼”和“右眼”上获取了点P 的图像,它们的图像坐标分别为(,)left left left p X Y =,(,)right right right p X Y =。

现两摄像机的图像在同一个平面上,则特征点P 的图像坐标Y 坐标相同,即left right Y Y Y ==,则由三角几何关系得到:()c left c c right c c c x X f z x B X f z y Y f z ⎧=⎪⎪⎪-=⎨⎪⎪=⎪⎩ (1-1)则视差为:left right Disparity X X =-。

由此可计算出特征点P 在相机坐标系下的三维坐标为:left c c c B X x Disparity B Y y Disparity B f z Disparity ⎧=⎪⎪⎪=⎨⎪⎪=⎪⎩ (1-2)因此,左相机像面上的任意一点只要能在右相机像面上找到对应的匹配点,就可以确定出该点的三维坐标。

这种方法是完全的点对点运算,像面上所有点只要存在相应的匹配点,就可以参与上述运算,从而获取其对应的三维坐标。

二.立体视觉测量过程1.图像获取(1) 单台相机移动获取(2) 双台相机获取:可有不同位置关系(一直线上、一平面上、立体分布)2.相机标定:确定空间坐标系中物体点同它在图像平面上像点之间的对应关系。

(1)内部参数:相机内部几何、光学参数(2)外部参数:相机坐标系与世界坐标系的转换3.图像预处理和特征提取预处理:主要包括图像对比度的增强、随机噪声的去除、滤波和图像的增强、伪彩色处理等;特征提取:常用的匹配特征主要有点状特征、线状特征和区域特征等4.立体匹配:根据对所选特征的计算,建立特征之间的对应关系,将同一个空间物理点在不同图像中的映像点对应起来。

光流法双目测速的原理光流法双目测速是一种常用的计算机视觉算法,它基于光学的原理,通过对图像序列的处理,可以实现对目标在相机坐标系中的运动速度的估计。

这种方法在机器视觉、自动驾驶、智能交通等领域具有广泛应用。

首先,让我们来了解一下光流法双目测速的原理。

光流法是利用相邻帧图像中目标的像素移动关系来计算速度的一种方法。

光流法的基本假设是相邻帧图像中的像素点强度保持不变。

根据这个假设,我们可以通过计算相邻帧图像中的像素点位置的变化,来估计目标的速度。

具体实现上,首先我们需要通过双目相机获取一对相邻帧的图像。

然后,我们通过在相邻帧图像中的对应像素点上绘制光流向量,来描述像素在相邻帧中的移动关系。

光流向量的大小和方向表示了像素移动的速度和方向。

通过计算相邻帧中所有像素点的光流向量,我们就可以得到目标的整体运动速度。

为了准确计算光流向量,通常采用不同的算法,例如基于相关性、梯度和误差优化等方法。

这些算法可以在相邻帧中搜索一致的像素点,进而求解光流向量。

此外,还可以通过图像金字塔技术来提高算法的效果,即利用图像的多层次分辨率进行光流计算。

光流法双目测速的优势在于其计算简单、实时性好,并且能够充分利用双目相机提供的深度信息。

通过双目相机获取的图像,可以得到目标在三维空间中的位置坐标,从而实现对目标的准确测速。

另外,这种方法对光照、背景等变化具有一定的鲁棒性。

在实际应用中,光流法双目测速可以广泛应用于车辆速度监测、行人追踪、物体跟踪等场景。

通过对目标的速度进行实时监测,可以帮助实现自动驾驶、智能交通和安防监控等领域的相关应用。

此外,该方法还可以结合其他传感器和算法,进一步提高测速的准确性和可靠性。

综上所述,光流法双目测速利用图像序列中的像素移动关系来计算目标的运动速度。

它基于相邻帧图像中的光流向量来估计速度,通过双目相机获取的深度信息可以实现测速的准确性。

该方法在机器视觉领域具有重要的研究意义和应用价值。

未来,随着计算机视觉技术的不断发展,光流法双目测速有望进一步提高其准确性和适用性,为智能交通和自动驾驶等领域的发展带来更多可能。

双目成像原理(一)双目成像双目成像是计算机视觉领域中常用的一项技术,它模拟了人眼的双目视觉原理,通过两个摄像头拍摄同一物体,从而获得三维信息,实现深度感知和立体显示。

本文将从浅入深地介绍双目成像的相关原理。

单目成像的局限性在讲双目成像前,我们需要先了解一下单目成像的局限性。

单目成像是指使用一台摄像机拍摄同一物体,得到二维图像信息。

单目成像的缺陷在于,它无法获得物体的深度信息,只能得到二维信息,这就限制了它在很多场景下的应用,比如虚拟现实、机器人视觉、自动驾驶等领域。

双目成像原理双目成像是通过两个摄像机同时拍摄同一物体并记录下不同的角度和距离信息,从而得到三维立体信息的一种技术。

它的原理可以简述为:1.两个摄像头同时拍摄同一物体,得到两张图片。

2.将两张图片进行匹配,找出对应的像素。

3.根据两个摄像头之间的距离及像素的匹配关系,确定每个像素在三维空间中的位置。

4.利用三维数据创建虚拟场景,并将其展示在二维屏幕上,实现立体显示。

双目成像的优势相比单目成像,双目成像的优势主要在于:1.获得了物体的深度信息,可以实现深度感知,更加精准地识别物体,提高了识别准确率。

2.三维立体感更强,可以实现真正的立体显示,增加了用户体验。

3.实现立体成像的多种方式,可以根据场景需求自由选择不同方式,提高了适用性。

双目成像的应用双目成像在计算机视觉领域有着广泛的应用,例如:1.智能摄像头:可以通过双目成像技术实现智能分析、目标跟踪和人脸识别等功能。

2.虚拟现实:可以通过双目成像技术实现更加真实的虚拟现实体验,增加用户沉浸感。

3.自动驾驶:可以通过双目成像技术实现精准的障碍物检测和跟踪,提高自动驾驶安全性。

4.机器人视觉:可以通过双目成像技术实现机器人的环境感知和路径规划等功能。

双目成像的不足之处双目成像也有其局限性,主要表现在以下几个方面:1.双目成像需要使用两个相机同时进行拍摄,因此成本较高。

2.双目成像依赖于相机之间的距离和角度,因此在不同的场景下需要对相机进行不同的调整,调整不好会影响成像效果。

双目视觉传感器的工作原理

双目视觉传感器是一种模拟人类双眼的视觉系统,通过两个摄像头同时获取不同角度的图像信息,然后通过计算机算法将这些信息融合在一起,从而实现深度感知和立体视觉。

这种技术模仿了人类双眼之间的差异,利用这种差异来计算物体的距离和位置。

双目视觉传感器的工作原理可以简单概括为以下几个步骤:

1.图像获取:双目视觉系统由两个摄像头组成,分别位于一定距离内,这两个摄像头同时拍摄同一场景的图像。

由于摄像头之间的距离不同,拍摄到的图像会略有差异。

2.图像预处理:获取到的图像需要经过预处理,包括去噪、色彩校正、图像配准等步骤。

这些预处理操作可以提高后续深度计算的准确性和稳定性。

3.立体匹配:通过计算机算法对两个图像进行匹配,找到对应的像素点。

这个过程称为立体匹配,通过匹配可以得到不同图像之间的对应关系,从而计算出物体的深度信息。

4.深度计算:通过立体匹配得到的对应关系,可以计算出物体在空间中的距离和位置。

这些深度信息可以帮助机器人、自动驾驶汽车等智能设备进行环境感知和导航。

双目视觉传感器的工作原理基于人类双眼视觉的原理,利用双目之

间的差异来获取立体信息。

相比单目视觉系统,双目视觉系统能够更准确地感知物体的距离和位置,从而更好地应用于各种智能设备中。

总的来说,双目视觉传感器通过模拟人类双眼视觉系统,利用双目之间的差异来获取立体信息,从而实现物体的深度感知和立体视觉。

这种技术在机器人、自动驾驶汽车、智能监控等领域有着广泛的应用前景,可以帮助设备更准确地感知和理解周围环境,实现更智能的功能。

halcon双目测距原理Halcon是一款强大的计算机视觉开发平台,广泛应用于工业自动化、机器人、品质检测等领域。

在其中,双目测距作为一项重要的技术,被广泛应用于三维重建、机器人导航、物体检测和位置定位等方面。

双目测距是指通过两个相互平行的相机,通过分析相机拍摄到的物体图像之间的位移关系,在图像上计算出物体的三维坐标。

这样的技术有助于解决单目视觉无法准确估计物体大小和深度的问题。

双目测距的原理主要基于视差法,即通过对比左右两幅图像上的像素颜色值差异来计算物体的深度。

视差是指在双目摄像头所拍摄的图像中,同一物体在左右两幅图像上的像素点之间的水平偏移量。

根据视差,可以通过三角测量原理推导出物体的距离。

在识别物体之前,首先需要进行立体标定。

立体标定是根据摄像机内外参数来对两个相机进行标定,以便后续的深度计算。

求解相机的内外参数可以通过标定棋盘格的方法进行。

标定棋盘格时,需要将棋盘格放置在不同位置,并利用两个相机分别拍摄图像。

通过分析棋盘格图像上的角点坐标,可以求解出摄像机的内参矩阵、畸变参数和外参矩阵。

在标定完成后,可以开始进行双目测距的计算。

首先,通过两个相机同时拍摄同一场景的图像,得到左右两幅图像。

然后,通过立体匹配算法,在两幅图像之间搜索对应的像素点。

立体匹配算法可以分为区域匹配算法和特征匹配算法两种。

区域匹配算法是基于图像亮度的像素级匹配。

该算法首先选取一定大小的区域,在左图像上找到对应的右图像的区域,并计算两个区域之间的亮度差异。

通过找到使亮度差异最小的区域,确定两个像素点之间的匹配关系。

特征匹配算法是基于图像特征的点级匹配。

该算法通过检测图像中的特征点,如角点、边缘点等,然后在两幅图像中寻找对应的特征点。

通过特征点之间的关系,确定两个像素点之间的匹配关系。

在确定了左右图像上的匹配关系后,可以计算视差。

视差的计算可以通过像素级或子像素级的方法进行。

像素级的视差计算是将图像上的像素点直接的水平偏移量作为视差值,而子像素级的计算则是通过对比两个像素点之间的灰度值的差异,来对视差进行精确的估计。

双目测距原理

双目测距原理是一种利用视差来测量距离的测距原理。

双目测距是指通过两只眼睛的视觉,来获取物体的距离信息,从而计算出物体到观察者的距离。

双目测距原理是一种被称为立体视觉的视觉原理,这种原理利用视差来表示物体距离观察者的距离。

视差是指两只眼睛看到的物体位置的差异。

当物体离观察者越近,两只眼睛看到的物体位置差异越大,反之距离越远,两只眼睛看到的物体位置差异越小。

双目测距原理是一种非常有用的测距原理,它可以用来测量物体的距离,也可以用来判断物体的大小,从而更好地表达自然环境中物体的位置关系。

同时,它也可以用来检测物体的运动,从而判断物体的速度和方向。

双目测距原理的应用十分广泛,它可以用来帮助人们精准地测量物体的距离,也可以用来改善人们的视觉能力,更好地把握物体的大小、位置和运动状态。

同时,它还可以用来开发各种计算机视觉应用,从而更好地控制机器人等设备。

总之,双目测距原理是一种利用视差来测量距离的测距原理。

它可以用来帮助人们准确地测量物体的距离,也可以用来提高人们的视觉能力,以及用于各种计算机视觉应用的开发。

视觉传感器原理

视觉传感器原理:

①光学成像首先物体发出或反射光线经过镜头汇聚成像于感光元件表面相当于缩小版现实世界投影;

②光电转换CCDCMOS等半导体材料制成像素点阵列当受到光照激发后会产生相应电信号强度与光强成正比;

③信号读取每一行每一列像素依次被扫描其电压值被放大量化后通过AD转换器变成计算机可识别数字形式;

④图像处理软件算法对采集到原始数据进行去噪增强分割等预处理操作以便后续特征提取分类识别等工作;

⑤特征提取基于颜色纹理形状运动等多种线索定位目标对象关键点轮廓区域为下一步分析提供依据;

⑥模式识别运用统计学习深度神经网络等技术从海量样本中学习规律构建模型最终实现对未知样本分类回归;

⑦反馈控制将视觉系统嵌入工业机器人无人驾驶汽车等智能体中实时感知环境变化指导其做出恰当反应;

⑧多传感器融合单一传感器存在局限性如光照敏感遮挡遗漏等将视觉与激光雷达毫米波雷达等互补信息结合可弥补不足;

⑨三维重建通过双目视觉结构光飞行时间法等主动被动手段获取场景深度信息进而重建出物体表面几何模型;

⑩动态跟踪当目标物体发生位姿变化时需采用卡尔曼滤波粒子滤波等方法估计其运动轨迹预测未来状态;

⑪场景理解不仅仅停留在物体层面更深层次理解场景语义关系如道路分割行人意图理解等;

⑫持续进化随着硬件性能提升算法理论突破视觉传感器正向着更高分辨率更快帧率更强环境适应性方向发展。

双目视觉传感器的工作原理

双目视觉传感器是一种能够模拟人眼视觉的传感器,它可以通过两个摄像头来获取物体的三维信息。

其工作原理类似于人眼,即通过两个不同位置的视角,通过计算两个视角之间的差异来推测物体的深度信息。

在双目视觉传感器中,两个摄像头的位置和朝向是非常关键的。

它们的位置应该相对固定,且朝向应该是向前的,这样才能够最大限度地模拟人眼视觉。

一般来说,双目视觉传感器会对两个摄像头进行校准,以确保它们的位置和朝向是准确的。

当双目视觉传感器开始工作时,它会同时捕捉两个摄像头所看到的图像。

然后,它会将这些图像传输到计算机上进行处理。

在处理过程中,计算机会先对两个图像进行匹配,以找出它们之间的共同点。

然后,它会计算两个摄像头之间的差异,以推测物体的深度信息。

具体来说,计算机会首先对两个图像进行校准,以确保它们的比例和角度是相同的。

然后,它会使用一种称为立体匹配的算法来找出两个图像之间的共同点。

这个算法会比较两个图像中的像素,以找出它们之间的相似之处。

一旦找到了共同点,计算机就可以计算出它们之间的距离。

在计算距离时,计算机会使用三角测量法。

具体来说,它会将两个摄像头和物体之间的三角形进行计算,以推测物体的深度信息。

这

个过程中,计算机会使用一些基本的三角函数,如正弦、余弦和正切。

通过这些函数,计算机可以准确地计算出物体的深度信息。

总的来说,双目视觉传感器的工作原理非常类似于人眼。

它使用两个摄像头来模拟人眼的视觉,然后通过计算机进行处理和分析。

这种传感器可以广泛应用于机器人、自动驾驶和虚拟现实等领域,因为它可以准确地获取物体的深度信息,从而实现更加精确的控制和交互。