第九章 SPSS的线性回归分析

- 格式:ppt

- 大小:1.08 MB

- 文档页数:62

第9章SPSS线性回归分析1.线性回归分析概述线性回归分析是一种广泛应用于统计学和数据分析领域的方法,它用于研究自变量与因变量之间的线性关系。

线性回归模型基于一条直线的假设,通过最小化残差平方和来估计各个回归系数,并利用这些系数进行预测和推断。

SPSS是一款强大的统计分析软件,提供了丰富的功能和工具,使得线性回归分析变得更加简单和高效。

2.数据准备在进行线性回归分析之前,需要准备好相关的数据。

SPSS可以导入各种类型的数据文件,包括Excel、CSV等格式。

在导入数据之后,可以对数据进行预处理,如缺失值处理、异常值处理等。

3.构建线性回归模型在SPSS中,构建线性回归模型非常简单。

首先选择“回归”菜单下的“线性”选项,然后将所需要的自变量和因变量选择到相应的框中。

SPSS还提供了多种方法来选择自变量,如逐步回归、逐步回归法等。

选择好自变量之后,点击“确定”按钮,即可得到回归模型结果。

4.分析回归模型在得到回归模型结果之后,需要对模型进行分析。

SPSS提供了丰富的结果输出,包括参数估计值、显著性检验、模型拟合度等。

需要注意的是,线性回归模型的可靠性需要通过一系列统计检验进行验证,如F统计量、t统计量、残差分析等。

5.模型诊断6.预测与推断线性回归模型可以用于预测和推断,SPSS也提供了相应的功能。

在SPSS中可以输入自变量的数值,从而得到相应的因变量预测值。

此外,SPSS还可以进行参数估计的推断,包括置信区间和假设检验等。

7.扩展与应用除了简单的线性回归模型,SPSS还支持复杂的线性回归模型,如多重回归分析、多元回归分析等。

此外,SPSS还可以进行模型的改进和优化,如加入交互项、非线性变换等。

这些扩展功能在实际应用中非常有用,可以提高模型的解释力和预测能力。

总结:本章介绍了SPSS中的线性回归分析方法,包括模型构建、结果分析、模型诊断、预测与推断等。

SPSS提供了丰富的功能和工具,使得线性回归分析变得更加简单和高效。

第九章 SPSS的线性回归分析线性回归分析是一种常用的统计方法,用于探索自变量与因变量之间的线性关系。

在SPSS中,进行线性回归分析可以帮助研究者了解变量之间的关系,并预测因变量的数值。

本文将介绍如何在SPSS中进行线性回归分析,并解释如何解释结果。

一、数据准备。

在进行线性回归分析之前,首先需要准备好数据。

在SPSS中,数据通常以数据集的形式存在,可以通过导入外部文件或手动输入数据来创建数据集。

确保数据集中包含自变量和因变量的数值,并且数据的质量良好,没有缺失值或异常值。

二、进行线性回归分析。

在SPSS中进行线性回归分析非常简单。

首先打开SPSS软件,然后打开已经准备好的数据集。

接下来,依次点击“分析”-“回归”-“线性”,将自变量和因变量添加到相应的框中。

在“统计”选项中,可以选择输出各种统计信息,如残差分析、离群值检测等。

点击“确定”按钮后,SPSS会自动进行线性回归分析,并生成相应的结果报告。

三、解释结果。

线性回归分析的结果报告包括了各种统计信息和图表,需要仔细解释和分析。

以下是一些常见的统计信息和图表:1. 相关系数,线性回归分析的结果报告中通常包括了自变量和因变量之间的相关系数,用来衡量两个变量之间的线性关系强度。

相关系数的取值范围为-1到1,接近1表示两个变量呈正相关,接近-1表示呈负相关,接近0表示无相关。

2. 回归系数,回归系数用来衡量自变量对因变量的影响程度。

回归系数的符号表示自变量对因变量的影响方向,系数的大小表示影响程度。

在结果报告中,通常包括了回归系数的估计值、标准误、t值和显著性水平。

3. 残差分析,残差是因变量的观测值与回归方程预测值之间的差异,残差分析可以用来检验回归模型的拟合程度。

在结果报告中,通常包括了残差的分布图和正态概率图,用来检验残差是否符合正态分布。

4. 变量间关系图,在SPSS中,可以生成自变量和因变量之间的散点图和回归直线图,用来直观展示变量之间的线性关系。

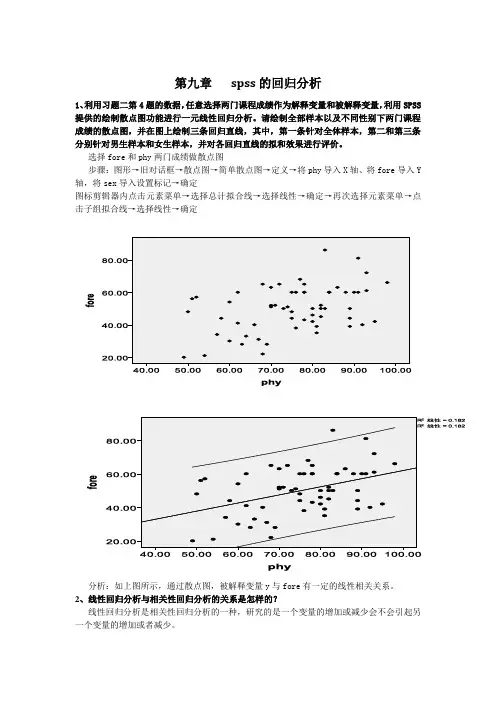

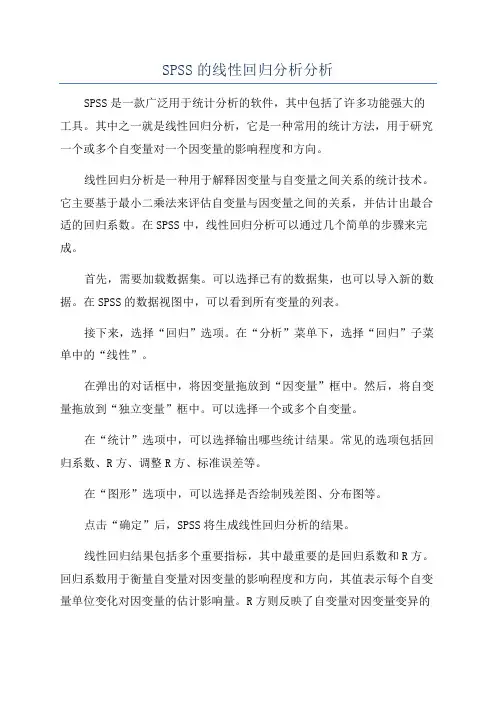

第九章spss的回归分析1、利用习题二第4题的数据,任意选择两门课程成绩作为解释变量和被解释变量,利用SPSS 提供的绘制散点图功能进行一元线性回归分析。

请绘制全部样本以及不同性别下两门课程成绩的散点图,并在图上绘制三条回归直线,其中,第一条针对全体样本,第二和第三条分别针对男生样本和女生样本,并对各回归直线的拟和效果进行评价。

选择fore和phy两门成绩做散点图步骤:图形→旧对话框→散点图→简单散点图→定义→将phy导入X轴、将fore导入Y 轴,将sex导入设置标记→确定图标剪辑器内点击元素菜单→选择总计拟合线→选择线性→确定→再次选择元素菜单→点击子组拟合线→选择线性→确定分析:如上图所示,通过散点图,被解释变量y与fore有一定的线性相关关系。

2、线性回归分析与相关性回归分析的关系是怎样的?线性回归分析是相关性回归分析的一种,研究的是一个变量的增加或减少会不会引起另一个变量的增加或者减少。

3、为什么需要对线性回归方程进行统计检验?一般需要对哪些方面进行检验?线性回归方程能够较好地反映被解释变量和解释变量之间的统计关系的前提是被解释变量和解释变量之间确实存在显著的线性关系。

回归方程的显著性检验正是要检验被解释变量和解释变量之间的线性关系是否显著,用线性模型来描述他们之间的关系是否恰当。

一般包括回归系数的检验,残差分析等。

4、SPSS多元线性回归分析中提供了哪几种解释变量筛选策略?包括向前筛选策略、向后筛选策略和逐步筛选策略。

5、先收集到若干年粮食总产量以及播种面积、使用化肥量、农业劳动人数等数据,请利用建立多元线性回归方程,分析影响粮食总产量的主要因素。

数据文件名为“粮食总产量.sav”。

步骤:分析→回归→线性→粮食总产量导入因变量、其余变量导入自变量→确定结果如图:Variables Entered/Removed bModel Variables Entered Variables Removed Method1 农业劳动者人数(百万人),总播种面积(万公顷), 风灾面积比例(%), 粮食播种面积(万公顷), 施用化肥量(kg/公顷), 年份a. Entera. All requested variables entered.b. Dependent Variable: 粮食总产量(y万吨)ANOVA bModel Sum of Squares df Mean Square F Sig.1 Regression 2.025E9 6 3.375E8 414.944 .000aResidual 2.278E7 28 813478.405Total 2.048E9 34a. Predictors: (Constant), 农业劳动者人数(百万人), 总播种面积(万公顷), 风灾面积比例(%),粮食播种面积(万公顷), 施用化肥量(kg/公顷), 年份b. Dependent Variable: 粮食总产量(y万吨)Coefficients aModel UnstandardizedCoefficients StandardizedCoefficientst Sig.B Std. Error Beta1 (Constant) -613605.817 230903.867 -2.657 .013年份304.688 119.427 .402 2.551 .016粮食播种面积(万公顷) .736 .782 .053 .942 .354总播种面积(万公顷) 1.939 .650 .111 2.984 .006施用化肥量(kg/公顷) 141.077 11.186 .755 12.612 .000风灾面积比例(%) -307.209 51.870 -.174 -5.923 .000-5.121 22.286 -.038 -.230 .820 农业劳动者人数(百万人)a. Dependent Variable: 粮食总产量(y万吨)分析:如以上4个表所示,影响程度来由大到小依次是风灾面积、使用化肥量、总播种面积和年份。

SPSS的线性回归分析分析SPSS是一款广泛用于统计分析的软件,其中包括了许多功能强大的工具。

其中之一就是线性回归分析,它是一种常用的统计方法,用于研究一个或多个自变量对一个因变量的影响程度和方向。

线性回归分析是一种用于解释因变量与自变量之间关系的统计技术。

它主要基于最小二乘法来评估自变量与因变量之间的关系,并估计出最合适的回归系数。

在SPSS中,线性回归分析可以通过几个简单的步骤来完成。

首先,需要加载数据集。

可以选择已有的数据集,也可以导入新的数据。

在SPSS的数据视图中,可以看到所有变量的列表。

接下来,选择“回归”选项。

在“分析”菜单下,选择“回归”子菜单中的“线性”。

在弹出的对话框中,将因变量拖放到“因变量”框中。

然后,将自变量拖放到“独立变量”框中。

可以选择一个或多个自变量。

在“统计”选项中,可以选择输出哪些统计结果。

常见的选项包括回归系数、R方、调整R方、标准误差等。

在“图形”选项中,可以选择是否绘制残差图、分布图等。

点击“确定”后,SPSS将生成线性回归分析的结果。

线性回归结果包括多个重要指标,其中最重要的是回归系数和R方。

回归系数用于衡量自变量对因变量的影响程度和方向,其值表示每个自变量单位变化对因变量的估计影响量。

R方则反映了自变量对因变量变异的解释程度,其值介于0和1之间,越接近1表示自变量对因变量的解释程度越高。

除了回归系数和R方外,还有其他一些统计指标可以用于判断模型质量。

例如,标准误差可以用来衡量回归方程的精确度。

调整R方可以解决R方对自变量数量的偏向问题。

此外,SPSS还提供了多种工具来检验回归方程的显著性。

例如,可以通过F检验来判断整个回归方程是否显著。

此外,还可以使用t检验来判断每个自变量的回归系数是否显著。

在进行线性回归分析时,还需要注意一些统计前提条件。

例如,线性回归要求因变量与自变量之间的关系是线性的。

此外,还需要注意是否存在多重共线性,即自变量之间存在高度相关性。

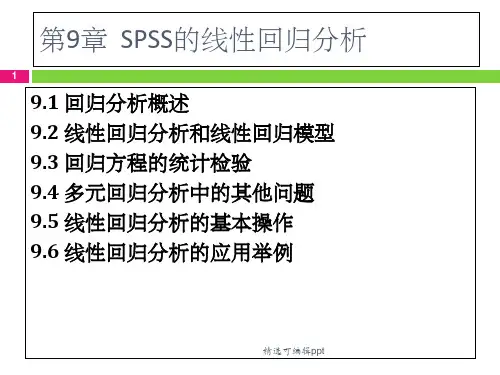

第9章SPSS的线性回归分析第9章SPSS的线性回归分析学习⽬标1.掌握线型回归分析的主要⽬标,了解回归⽅程的最⼩⼆乘法估计的基本设计思路。

2.熟练掌握线性回归分析的具体操作,能够读懂基本分析结果,掌握计算结果之间的数量关系,并能够写出回归⽅程、对回归⽅程进⾏各种统计检验。

3.了解多元线性回归分析哦那个⾃变量筛选的主要策略,能够结合筛选策略对相应分析进⾏说明。

4.了解SPSS残差分析和多重共线性检验的基本操作,并能够分析结果。

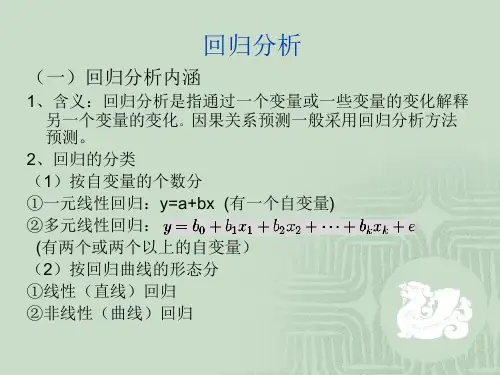

9.1 回归分析概述9.1.1 什么是回归分析回归分析是⼀种应⽤极为⼴泛的数量分析⽅法。

它⽤于分析事物间的统计关系,侧重考虑变量之间的数量变化规律,并通过回归⽅程的形式描述和反应这种关系,帮助⼈们准确把握受其他⼀个或多个变量影响的程度,进⽽为预测提供科学依据。

“回归”⼀词是英国统计学家F·Galton在研究⽗亲⾝⾼和其成年⼉⼦的⾝⾼关系时提出的。

从⼤量的⽗亲⾝⾼和其成年⼉⼦数据的散点图中,F·Galton天才地发现了⼀条贯穿其中的直线,它能够描述⽗亲⾝⾼和其成年⼉⼦⾝⾼之间的关系,并可⽤于预测某⾝⾼⽗亲其成年⼉⼦的平均⾝⾼。

他的研究发现:如果⽗亲的⾝⾼很⾼,那么她的⼉⼦也会⽐较⾼,但不会像他⽗亲那么⾼;如果⽗亲的⾝⾼很矮,那么她的⼉⼦也会⽐较矮,但不会像他⽗亲那么矮。

他们会趋向于⼦辈⾝⾼的平均值。

F·Galton将这种现象称为“回归”,将那条贯穿于系的数量分析关系的数量分析⽅法称为回归分析。

正如上述F·Galton研究⽗亲⾝⾼与⼉⼦⾝⾼关系问题那样,回归分析的核⼼⽬的是找到回归线,涉及包括如何得到回归线、如何描述回归线、回归线是否可⽤于预测等问题。

9·1·2 如何得到回归线利⽤样本数据获得回归线通常可采⽤两类⽅法:第⼀,局部平均法;第⼆,函数拟合。

⼀、局部平均局部平均的含义可借⽤⽗亲和⼉⼦的⾝⾼关系的例⼦来理解。

如果收集到n对⽗亲和⼉⼦⾝⾼的数据(x i,y i)(i=1,2,…,n),可以对它们绘制散点图、计算基本描述统计量。

《统计分析与SPSS的应用(第五版)》(薛薇)课后练习答案第9章SPSS的线性回归分析1、利用第2章第9题的数据,任意选择两门课程成绩作为解释变量和被解释变量,利用SPSS 提供的绘制散点图功能进行一元线性回归分析。

请绘制全部样本以及不同性别下两门课程成绩的散点图,并在图上绘制三条回归直线,其中,第一条针对全体样本,第二和第三条分别针对男生样本和女生样本,并对各回归直线的拟和效果进行评价。

选择fore和phy两门成绩体系散点图步骤:图形→旧对话框→散点图→简单散点图→定义→将fore导入Y轴,将phy导入X轴,将sex导入设置标记→确定。

接下来在SPSS输出查看器中,双击上图,打开图表编辑在图表编辑器中,选择“元素”菜单→选择总计拟合线→选择线性→应用→再选择元素菜单→点击子组拟合线→选择线性→应用。

分析:如上图所示,通过散点图,被解释变量y(即:fore)与解释变量phy有一定的线性关系。

但回归直线的拟合效果都不是很好。

2、请说明线性回归分析与相关分析的关系是怎样的?相关分析是回归分析的基础和前提,回归分析则是相关分析的深入和继续。

相关分析需要依靠回归分析来表现变量之间数量相关的具体形式,而回归分析则需要依靠相关分析来表现变量之间数量变化的相关程度。

只有当变量之间存在高度相关时,进行回归分析寻求其相关的具体形式才有意义。

如果在没有对变量之间是否相关以及相关方向和程度做出正确判断之前,就进行回归分析,很容易造成“虚假回归”。

与此同时,相关分析只研究变量之间相关的方向和程度,不能推断变量之间相互关系的具体形式,也无法从一个变量的变化来推测另一个变量的变化情况,因此,在具体应用过程中,只有把相关分析和回归分析结合起来,才能达到研究和分析的目的。

线性回归分析是相关性回归分析的一种,研究的是一个变量的增加或减少会不会引起另一个变量的增加或减少。

3、请说明为什么需要对线性回归方程进行统计检验?一般需要对哪些方面进行检验?检验其可信程度并找出哪些变量的影响显著、哪些不显著。

第9章_SPSS的线性回归分析线性回归是一种用于建立两个或更多变量之间关系的统计方法,它能够预测一个因变量(因变量)与一个或多个自变量之间的线性关系。

SPSS是一种功能强大的数据分析软件,可用于执行线性回归分析。

一、线性回归的基本概念在开始进行线性回归分析之前,我们需要了解一些基本概念。

1.因变量(Y):被预测或感兴趣的变量,也称为被解释变量。

2.自变量(X):用于预测因变量的变量,也称为解释变量。

3.回归系数:描述因变量与自变量之间关系的数值。

4.截距:在自变量为0时,因变量的期望值。

5.残差:观测值与回归线之间的差异,用于衡量模型的拟合程度。

SPSS提供了执行线性回归分析的功能。

下面是执行线性回归分析的步骤。

步骤1:打开SPSS软件并导入数据。

你可以使用菜单栏中的“文件”选项来导入数据。

步骤2:选择“回归”选项。

在菜单栏中选择“分析”>“回归”>“线性”。

步骤3:指定因变量和自变量。

将因变量和自变量从可用变量列表中移动到相应的框中。

步骤4:设置模型选项。

在“模型”选项卡中,你可以选择不同的分析方法,例如,输入法或后退法,并设置显著性水平。

步骤5:点击“确定”按钮运行分析。

SPSS将执行线性回归分析,并在输出窗口中显示结果。

三、解释SPSS输出结果SPSS的线性回归分析结果通常由多个表格组成。

下面是一些常见的结果和如何解释它们的示例。

1.相关系数矩阵:显示因变量和自变量之间的关系。

相关系数的值范围从-1到1,接近1表示强正相关,接近-1表示强负相关。

2.模型概括:显示回归方程的参数估计值、标准误差和显著性。

3.回归系数表:显示每个自变量的回归系数、标准误差、t值和显著性。

4.显著性检验:显示自变量是否对因变量有显著影响的统计检验结果。

5.拟合优度统计量:显示模型适合数据的程度。

常用的拟合优度统计量有R平方值和调整的R平方值。

R平方值介于0和1之间,值越接近1表示模型拟合得越好。

四、解释回归方程回归方程用于预测因变量的值。