2020年多元线性回归logistic回归

- 格式:ppt

- 大小:1.31 MB

- 文档页数:87

logistic回归和线性回归1.输出:线性回归输出是连续的、具体的值(如具体房价123万元)回归逻辑回归的输出是0~1之间的概率,但可以把它理解成回答“是”或者“否”(即离散的⼆分类)的问题分类2.假设函数线性回归:θ数量与x的维度相同。

x是向量,表⽰⼀条训练数据逻辑回归:增加了sigmoid函数逻辑斯蒂回归是针对线性可分问题的⼀种易于实现⽽且性能优异的分类模型,是使⽤最为⼴泛的分类模型之⼀。

sigmoid函数来由假设某件事发⽣的概率为p,那么这件事不发⽣的概率为(1-p),我们称p/(1-p)为这件事情发⽣的⼏率。

取这件事情发⽣⼏率的对数,定义为logit(p),所以logit(p)为因为logit函数的输⼊取值范围为[0,1](因为p为某件事情发⽣的概率),所以通过logit函数可以将输⼊区间为[0,1]转换到整个实数范围内的输出,log函数图像如下将对数⼏率记为输⼊特征值的线性表达式如下:其中,p(y=1|x)为,当输⼊为x时,它被分为1类的概率为hθ(x),也属于1类别的条件概率。

⽽实际上我们需要的是给定⼀个样本的特征输⼊x,⽽输出是⼀个该样本属于某类别的概率。

所以,我们取logit函数的反函数,也被称为logistic函数也就是sigmoid函数ϕ(z)中的z为样本特征与权重的线性组合(即前⾯的ΘT x)。

通过函数图像可以发现sigmoid函数的⼏个特点,当z趋于正⽆穷⼤的时候,ϕ(z)趋近于1,因为当z趋于⽆穷⼤的时候,e^(-z)趋于零,所以分母会趋于1,当z趋于负⽆穷⼤的时候,e^(-z)会趋于正⽆穷⼤,所以ϕ(z)会趋于0。

如在预测天⽓的时候,我们需要预测出明天属于晴天和⾬天的概率,已知根天⽓相关的特征和权重,定义y=1为晴天,y=-1为⾬天,根据天⽓的相关特征和权重可以获得z,然后再通过sigmoid函数可以获取到明天属于晴天的概率ϕ(z)=P(y=1|x),如果属于晴天的概率为80%,属于⾬天的概率为20%,那么当ϕ(z)>=0.8时,就属于⾬天,⼩于0.8时就属于晴天。

[转载]logistic回归模型总结logistic回归模型是最成熟也是应用最广泛的分类模型,通过学习和实践拟通过从入门、进阶到高级的过程对其进行总结,以便加深自己的理解也为对此有兴趣者提供学习的便利。

一、有关logistic的基本概念logistic回归主要用来预测离散因变量与一组解释变量之间的关系最常用的是二值型logistic。

即因变量的取值只包含两个类别例如:好、坏;发生、不发生;常用Y=1或Y=0表示X 表示解释变量则P(Y=1|X)表示在X的条件下Y=1的概率,logistic回归的数学表达式为:log(p/1-p)=A+BX =L其中p/1-p称为优势比(ODDS)即发生与不发生的概率之比可以根据上式反求出P(Y=1|X)=1/(1+e^-L)根据样本资料可以通过最大似然估计计算出模型的参数然后根据求出的模型进行预测下面介绍logistic回归在SAS中的实现以及输出结果的解释二、logistic回归模型初步SAS中logistic回归输出结果主要包括预测模型的评价以及模型的参数预测模型的评价与多元线性回归模型的评价类似主要从以下几个层次进行(1)模型的整体拟合优度主要评价预测值与观测值之间的总体一致性。

可以通过以下两个指标来进行检验1、Hosmer-Lemeshowz指标HL统计量的原假设Ho是预测值和观测值之间无显著差异,因此HL指标的P-Value的值越大,越不能拒绝原假设,即说明模型很好的拟合了数据。

在SAS中这个指标可以用LACKFIT选项进行调用2、AIC和SC指标即池雷准则和施瓦茨准则与线性回归类似AIC和SC越小说明模型拟合的越好(2)从整体上看解释变量对因变量有无解释作用相当于多元回归中的F检验在logistic回归中可以通过似然比(likelihood ratiotest)进行检验(3)解释变量解释在多大程度上解释了因变量与线性回归中的R^2作用类似在logistic回归中可以通过Rsquare和C统计量进行度量在SAS中通过RSQ来调用Rsquare,C统计量自动输出(4)模型评价指标汇总<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">统计量<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">趋势<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">拟合<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">作用SAS<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">调用命令<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">备注AIC<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">、SC<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越小<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越好<td width="197" valign="top" style="width:117.9pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">类似与多元回归中的残差平方和<td width="177" valign="top" style="width:106.3pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">模型自动输出<td width="123" valign="top" style="width:73.75pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">似然比卡方<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越大<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越好<td width="197" valign="top" style="width:117.9pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">类似与多元回归中的回归平方和<td width="177" valign="top" style="width:106.3pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">自动输出<td width="123" valign="top" style="width:73.75pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt">P<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">值越小越好RSQUARE<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越大<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越好<td width="197" valign="top" style="width:117.9pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">类似与多元回归中的R^2<td width="177" valign="top" style="width:106.3pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">用RSQ<span style="font-family:宋体;mso-ascii-font-family:Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">选项调用<td width="123" valign="top" style="width:73.75pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt">C<span style="font-family:宋体;mso-ascii-font-family: Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">统计量<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越大<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越好<td width="197" valign="top" style="width:117.9pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">度量观测值和条件预测的相对一致性<td width="177" valign="top" style="width:106.3pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">自动输出<td width="123" valign="top" style="width:73.75pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt">HL<span style="font-family:宋体;mso-ascii-font-family: Calibri;mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">统计量<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越小<td valign="top" style="border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">越好<td width="197" valign="top" style="width:117.9pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt"><span style="font-family:宋体;mso-ascii-font-family:Calibri; mso-ascii-theme-font:minor-latin;mso-fareast-font-family:宋体;mso-fareast-theme-font:minor-fareast;mso-hansi-font-family:Calibri;mso-hansi-theme-font:minor-latin">度量观测值和预测值总体的一致性<td width="177" valign="top" style="width:106.3pt;border-top:none;border-left:none;border-bottom:solid windowtext 1.0pt;border-right:solid windowtext 1.0pt;mso-border-top-alt:solid windowtext .5pt;mso-border-left-alt:solid windowtext .5pt;mso-border-alt:solid windowtext .5pt;padding:0cm 5.4pt 0cm 5.4pt">。

logistic回归与多元线性回归区别及若干问题讨论logistic回归与多元线性回归区别及若干问题讨论1多重线性回归(MultipleLinearRegression)Logistic回归(LogisticRegression)概念多重线性回归模型可视为简单直线模型的直接推广,具有两个及两个以上自变量的线性模型即为多重线性回归模型。

属于概率型非线性回归,是研究二分类(可扩展到多分类)观察结果与一些影响因素之间关系的一种多变量分析方法。

变量的特点应变量:1个;数值变量(正态分布)自变量:2个及2个以上;最好是数值变量,也可以是无序分类变量、有序变量。

应变量:1个;二分类变量(二项分布)、无序/有序多分类变量自变量:2个及2个以上;数值变量、二分类变量、无序/有序多分类变量总体回归模型LogitP=(样本)偏回归系数含义表示在控制其它因素或说扣除其它因素的作用后(其它所有自变量固定不变的情况下),某一个自变量变化一个单位时引起因变量Y变化的平均大小。

表示在控制其它因素或说扣除其它因素的作用后(其它所有自变量固定不变的情况下),某一因素改变一个单位时,效应指标发生与不发生事件的概率之比的对数变化值(logitP的平均变化量),即lnOR。

适用条件LINE:1、L:线性——自变量X与应变量Y之间存在线性关系;2、I:独立性——Y 值相互独立,在模型中则要求残差相互独立,不存在自相关;3、N:正态性——随机误差(即残差)e服从均值为零,方差为2的正态分布;4、E:等方差——对于所有的自变量X,残差e的方差齐。

观察对象(case)之间相互独立;若有数值变量,应接近正态分布(不能严重偏离正态分布);二分类变量服从二项分布;要有足够的样本量;LogitP与自变量呈线性关系。

第十一章 多元线性回归与logistic 回归一、教学大纲要求(一)掌握内容1.多元线性回归分析的概念:多元线性回归、偏回归系数、残差。

2.多元线性回归的分析步骤:多元线性回归中偏回归系数及常数项的求法、多元线性回归的应用。

3.多元线性回归分析中的假设检验:建立假设、计算检验统计量、确定P 值下结论。

4.logistic 回归模型结构:模型结构、发病概率比数、比数比。

5.logistic 回归参数估计方法。

6.logistic 回归筛选自变量:似然比检验统计量的计算公式;筛选自变量的方法。

(二)熟悉内容 常用统计软件(SPSS 及SAS )多元线性回归分析方法:数据准备、操作步骤与结果输出。

(三)了解内容 标准化偏回归系数的解释意义。

二、教学内容精要(一) 多元线性回归分析的概念将直线回归分析方法加以推广,用回归方程定量地刻画一个应变量Y 与多个自变量X 间的线形依存关系,称为多元线形回归(multiple linear regression ),简称多元回归(multiple regression )基本形式:01122ˆk kY b b X b X b X =+++⋅⋅⋅+ 式中Y ˆ为各自变量取某定值条件下应变量均数的估计值,1X ,2X ,…,k X 为自变量,k 为自变量个数,0b 为回归方程常数项,也称为截距,其意义同直线回归,1b ,2b ,…, k b 称为偏回归系数(partial regression coefficient ),j b 表示在除j X 以外的自变量固定条件下,j X 每改变一个单位后Y 的平均改变量。

(二) 多元线性回归的分析步骤Y ˆ是与一组自变量1X ,2X ,…,kX 相对应的变量Y 的平均估计值。

多元回归方程中的回归系数1b ,2b ,…, k b 可用最小二乘法求得,也就是求出能使估计值Yˆ和实际观察值Y 的残差平方和22)ˆ(∑∑-=Y Y e i 为最小值的一组回归系数1b ,2b ,…, k b 值。

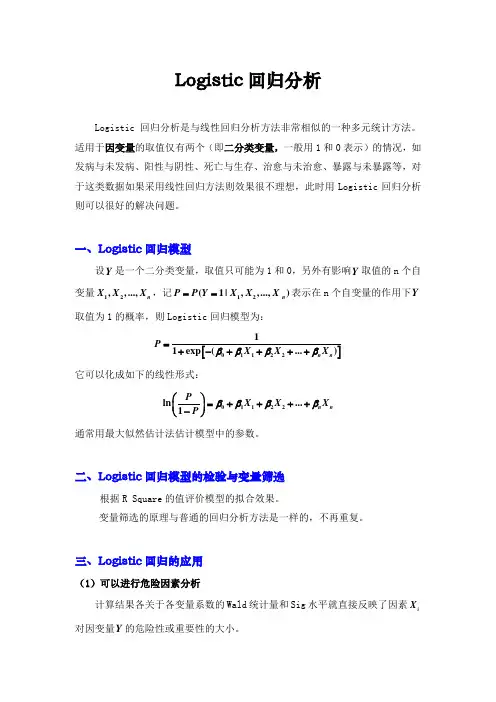

Logistic 回归分析Logistic 回归分析是与线性回归分析方法非常相似的一种多元统计方法。

适用于因变量的取值仅有两个(即二分类变量,一般用1和0表示)的情况,如发病与未发病、阳性与阴性、死亡与生存、治愈与未治愈、暴露与未暴露等,对于这类数据如果采用线性回归方法则效果很不理想,此时用Logistic 回归分析则可以很好的解决问题。

一、Logistic 回归模型设Y 是一个二分类变量,取值只可能为1和0,另外有影响Y 取值的n 个自变量12,,...,n X X X ,记12(1|,,...,)n P P Y X X X ==表示在n 个自变量的作用下Y 取值为1的概率,则Logistic 回归模型为:[]0112211exp (...)n n P X X X ββββ=+-++++它可以化成如下的线性形式:01122ln ...1n n P X X X P ββββ⎛⎫=++++ ⎪-⎝⎭通常用最大似然估计法估计模型中的参数。

二、Logistic 回归模型的检验与变量筛选根据R Square 的值评价模型的拟合效果。

变量筛选的原理与普通的回归分析方法是一样的,不再重复。

三、Logistic 回归的应用(1)可以进行危险因素分析计算结果各关于各变量系数的Wald 统计量和Sig 水平就直接反映了因素i X 对因变量Y 的危险性或重要性的大小。

(2)预测与判别Logistic回归是一个概率模型,可以利用它预测某事件发生的概率。

当然也可以进行判别分析,而且可以给出概率,并且对数据的要求不是很高。

四、SPSS操作方法1.选择菜单2.概率预测值和分类预测结果作为变量保存其它使用默认选项即可。

例:试对临床422名病人的资料进行分析,研究急性肾衰竭患者死亡的危险因素和统计规律。

Logistic回归分析.sav解:在SPSS中采用Logistic回归全变量方式分析得到:(1)模型的拟合优度为0.755。

因变量是定性变量的回归分析—L o g i s t i c回归分析TYYGROUP system office room 【TYYUA16H-TYY-TYYYUA8Q8-因变量是定性变量的回归分析—Logistic 回归分析一、 从多元线性回归到Logistic 回归例 这是200个不同年龄和性别的人对某项服务产品的认可的数据.其中: 年龄是连续变量,性别是有男和女(分别用1和0表示)两个水平的定性变量,而变量“观点”则为包含认可(用1表示)和不认可(用0表示)两个水平的定性变量。

从这张图可以看出什么呢?从这张图又可以看出什么呢?这里观点是因变量, 只有两个值;所以可以把它看作成功概率为p 的Bernoulli 试验的结果.但是和单纯的Bernoulli 试验不同,这里的概率p 为年龄和性别的函数. 必须应用Logistic 回归。

二、 多元线性回归不能应用于定性因变量的原因首先,多元线性回归中使用定性因变量严重违反本身假设条件,即:因变量只能取两个值时,对于任何给定的自变量值,e 本身也只能取两个值。

这必然会违背线性回归中关于误差项e 的假设条件。

其次,线性概率概型及其问题:由于因变量只有两个值;所以可以把它看作成功概率p ,取值范围必然限制在0—1的区间中,然而线性回归方程不能做到。

另外概率发生的情况也不是线性的。

三、 Logistic 函数Logistic 的概率函数定义为:我们将多元线性组合表示为:于是,Logistic 概率函数表示为:经过变形,可得到线性函数:这里, 事件发生概率=P (y=1)事件不发生概率=1-P (y=0) 发生比:Ω=-=pp odds 1)( 对数发生比:)(log )1(ln )log(p it p p odds =⎥⎦⎤⎢⎣⎡-= 这样,就可将logistic 曲线线性化为:从P 到logit P 经历了两个步骤变换过程:第一步:将p 转换成发生比,其值域为0到无穷第二步:将发生比换成对数发生比,其值域科为[]∞+∞-经过转换, 将P →logit P,在将其作为回归因变量来解释就不再有任何值域方面的限制了,即可线性化!四、 Logistic 回归系数的意义以logit P 方程的线性表达式来解释回归系数,即:在logistic 回归的实际研究中,通常不是报告自变量对P 的作用,而是报告自变量对logit P 的作用。

第十一章 多元线性回归与logistic 回归一、教学大纲要求(一)掌握内容1.多元线性回归分析的概念:多元线性回归、偏回归系数、残差。

2.多元线性回归的分析步骤:多元线性回归中偏回归系数及常数项的求法、多元线性回归的应用。

3.多元线性回归分析中的假设检验:建立假设、计算检验统计量、确定P 值下结论。

4.logistic 回归模型结构:模型结构、发病概率比数、比数比。

5.logistic 回归参数估计方法。

6.logistic 回归筛选自变量:似然比检验统计量的计算公式;筛选自变量的方法。

(二)熟悉内容 常用统计软件(SPSS 及SAS )多元线性回归分析方法:数据准备、操作步骤与结果输出。

(三)了解内容 标准化偏回归系数的解释意义。

二、教学内容精要(一) 多元线性回归分析的概念将直线回归分析方法加以推广,用回归方程定量地刻画一个应变量Y 与多个自变量X 间的线形依存关系,称为多元线形回归(multiple linear regression ),简称多元回归(multiple regression )基本形式:01122ˆk kY b b X b X b X =+++⋅⋅⋅+ 式中Y ˆ为各自变量取某定值条件下应变量均数的估计值,1X ,2X ,…,k X 为自变量,k 为自变量个数,0b 为回归方程常数项,也称为截距,其意义同直线回归,1b ,2b ,…, k b 称为偏回归系数(partial regression coefficient ),j b 表示在除j X 以外的自变量固定条件下,j X 每改变一个单位后Y 的平均改变量。

(二) 多元线性回归的分析步骤Y ˆ是与一组自变量1X ,2X ,…,kX 相对应的变量Y 的平均估计值。

多元回归方程中的回归系数1b ,2b ,…, k b 可用最小二乘法求得,也就是求出能使估计值Yˆ和实际观察值Y 的残差平方和22)ˆ(∑∑-=Y Y e i 为最小值的一组回归系数1b ,2b ,…, k b 值。

逻辑回归(logisticregression)和线性回归(linearregression)序号逻辑回归线性回归模型归类离散选择法模型回归分析数值类型⼆元⼀元或多元公式P(Y=1│X=x)=exp(x'β)/(1+exp(x'β))逻辑回归Logit模型(Logit model,也译作“评定模型”,“分类评定模型”,⼜作Logistic regression,“逻辑回归”)是离散选择法模型之⼀,Logit模型是最早的离散选择模型,也是⽬前应⽤最⼴的模型。

是社会学、⽣物统计学、临床、数量⼼理学、计量经济学、市场营销等统计实证分析的常⽤⽅法。

Logit模型的应⽤⼴泛性的原因主要是因为其概率表达式的显性特点,模型的求解速度快,应⽤⽅便。

当模型选择集没有发⽣变化,⽽仅仅是当各变量的⽔平发⽣变化时(如出⾏时间发⽣变化),可以⽅便的求解各选择枝在新环境下的各选择枝的被选概率。

根据Logit模型的IIA特性,选择枝的减少或者增加不影响其他各选择之间被选概率⽐值的⼤⼩,因此,可以直接将需要去掉的选择枝从模型中去掉,也可将新加⼊的选择枝添加到模型中直接⽤于预测。

Logit模型这种应⽤的⽅便性是其他模型所不具有的,也是模型被⼴泛应⽤的主原因之⼀。

线性回归线性回归是利⽤数理统计中的回归分析,来确定两种或两种以上变量间相互依赖的定量关系的⼀种统计分析⽅法,运⽤⼗分⼴泛。

分析按照⾃变量和因变量之间的关系类型,可分为线性回归分析和⾮线性回归分析。

在统计学中,线性回归(Linear Regression)是利⽤称为线性回归⽅程的最⼩平⽅函数对⼀个或多个⾃变量和因变量之间关系进⾏建模的⼀种回归分析。

这种函数是⼀个或多个称为回归系数的模型参数的线性组合。

只有⼀个⾃变量的情况称为简单回归,⼤于⼀个⾃变量情况的叫做多元回归。

(这反过来⼜应当由多个相关的因变量预测的多元线性回归区别,[引⽂需要],⽽不是⼀个单⼀的标量变量。

logistic回归与线性回归的⽐较可以参考如下⽂章第⼀节中说了,logistic 回归和线性回归的区别是:线性回归是根据样本X各个维度的Xi的线性叠加(线性叠加的权重系数wi就是模型的参数)来得到预测值的Y,然后最⼩化所有的样本预测值Y与真实值y'的误差来求得模型参数。

我们看到这⾥的模型的值Y是样本X各个维度的Xi的线性叠加,是线性的。

Y=WX (假设W>0),Y的⼤⼩是随着X各个维度的叠加和的⼤⼩线性增加的,如图(x为了⽅便取1维):然后再来看看我们这⾥的logistic 回归模型,模型公式是:,这⾥假设W>0,Y与X各维度叠加和(这⾥都是线性叠加W)的图形关系,如图(x为了⽅便取1维):我们看到Y的值⼤⼩不是随X叠加和的⼤⼩线性的变化了,⽽是⼀种平滑的变化,这种变化在x的叠加和为0附近的时候变化的很快,⽽在很⼤很⼤或很⼩很⼩的时候,X叠加和再⼤或再⼩,Y值的变化⼏乎就已经很⼩了。

当X各维度叠加和取⽆穷⼤的时候,Y趋近于1,当X各维度叠加和取⽆穷⼩的时候,Y趋近于0.这种变量与因变量的变化形式就叫做logistic变化。

(注意不是说X各个维度和为⽆穷⼤的时候,Y值就趋近1,这是在基于W>0的基础上,(如果W<0,n那么Y趋近于0)⽽W是根据样本训练出来,可能是⼤于0,也可能是⼩0,还可能W1>0,W2<0…所以这个w值是样本⾃动训练出来的,也因此不是说你只要x1,x2,x3…各个维度都很⼤,那么Y值就趋近于1,这是错误的。

凭直觉想⼀下也不对,因为你连样本都还没训练,你的模型就有⼀个特点:X很⼤的时候Y就很⼤。

这种强假设肯定是不对的。

因为可能样本的特点是X很⼤的时候Y就很⼩。

)所以我们看到,在logistic回归中,X各维度叠加和(或X各维度)与Y不是线性关系,⽽是logistic关系。

⽽在线性回归中,X各维度叠加和就是Y,也就是Y与X就是线性的了。