动态最近邻聚类算法的优化研究

- 格式:pdf

- 大小:307.50 KB

- 文档页数:4

基于人工神经网络的聚类算法优化研究随着科技的不断发展,人工智能成为了当今社会一个备受关注的热点话题。

其中,人工神经网络作为一种重要的技术,受到了越来越多的关注和研究。

而在人工神经网络应用领域中,聚类算法优化也成为了一个重要的研究课题。

那么,本文便将基于人工神经网络的聚类算法优化进行深入探讨。

一、人工神经网络基础人工神经网络是一种由多个神经元相互连接组成的网络,其结构与生物神经系统相似。

通过学习与训练,人工神经网络可以模拟人类的智能行为,并对大量数据进行分类、预测、识别等操作。

而人工神经网络训练过程中使用的算法和方法,则对于聚类算法优化而言尤为重要。

二、聚类算法优化研究聚类算法是机器学习中的一个重要领域,它主要通过对样本进行分组或分簇,对数据进行分类和分析。

聚类算法优化则是针对现有聚类算法进行改进和优化,提升其运行效率和准确性。

传统的聚类算法中,K-means算法是一种著名的聚类算法。

它通过计算样本之间的欧几里得距离,将样本依据距离远近分组。

但是,K-means算法具有计算量大,对初始值敏感以及易陷入局部最小值等问题。

为此,研究人员提出了一系列基于人工神经网络的聚类算法。

例如,自组织特征映射(SOM)算法、基于ART神经网络的聚类算法等。

这些算法的出现,旨在优化传统聚类算法的问题,并提高聚类效果和精度。

具体来说,这些新算法能够通过不同的神经元之间的相互作用,学习样本的非线性特征,并能够自适应地调整分组结果。

三、优化研究案例为了更好的说明基于人工神经网络的聚类算法优化的具体应用,我们举一个实际的例子。

研究人员曾对美国著名的湾流飞机的大量数据进行聚类分析,探讨其工作状态下性能和健康状况的影响因子。

在传统聚类算法下,所得到的聚类结果效果不佳。

于是,研究人员采用基于单层神经网络和基于ART神经网络的聚类算法,并将两种算法结果进行比较。

实验结果表明,采用基于ART神经网络的方法所得到的分组结果比传统K-means算法更优,能够更好地揭示湾流飞机性能和健康状况的关联因素。

数据挖掘中聚类算法研究综述随着数据量的不断增加,数据挖掘成为了探索数据背后规律的一种重要方法。

而聚类算法作为数据挖掘中的一种基本技术,其在数据分析、模式识别、生物信息学、社交网络分析等领域都有着广泛的应用。

本文就对数据挖掘中的聚类算法进行了研究和总结,旨在对聚类算法的原理、特点、应用等方面进行探讨。

一、聚类算法的基本原理聚类算法是指将一组对象划分为若干个组或类,使得组内对象之间的相似度尽可能大,组间对象之间的相似度尽可能小,从而达到数据分类和分析的目的。

聚类算法的基本原理包括以下三个方面:1. 相似度度量:聚类算法的基础在于相似度度量,即将每个对象之间的相似度进行计算。

相似度度量可以采用欧几里得距离、曼哈顿距离、余弦相似度等多种方法。

2. 聚类分配:聚类分配是指将每个对象划分到合适的聚类中。

聚类分配可以通过最近邻法、k-means算法等实现。

3. 聚类更新:聚类更新是指对各个聚类进行调整,使得聚类内对象之间的相似度尽可能大,聚类间对象之间的相似度尽可能小。

聚类更新可以采用层次聚类法、DBSCAN算法等。

二、聚类算法的分类根据聚类算法的不同特点和应用场景,可以将聚类算法分为以下几种类型:1. 基于距离的聚类算法:包括最近邻法、k-means算法、k-medoid 算法等。

2. 基于密度的聚类算法:包括DBSCAN算法、OPTICS算法等。

3. 基于层次的聚类算法:包括凝聚层次聚类法、分裂层次聚类法等。

4. 基于模型的聚类算法:包括高斯混合模型聚类、EM算法等。

三、聚类算法的应用聚类算法在各种领域中都有着广泛的应用,包括数据分析、模式识别、社交网络分析、生物信息学等。

下面简单介绍一下聚类算法在这些领域中的应用:1. 数据分析:聚类算法可以对数据进行分类和分组,从而提取出数据中的规律和趋势,帮助人们更好地理解和利用数据。

2. 模式识别:聚类算法可以对图像、声音、文本等数据进行分类和分组,从而实现对数据的自动识别和分类。

RBF 网络基函数中心选取算法的研究朱明星1,张德龙21(安徽大学自动化系,安徽合肥 230039)2(安徽大学电子工程与信息科学系,安徽合肥 230039)摘 要:首先介绍R BF 网络基函数中心的随机选取算法,然后研究自组织学习算法选取R BF 基函数中心方法,最后给出一种最近邻聚类学习算法。

通过系统辨识的实例仿真,对几种算法进行了深入分析与详细比较。

关键词:基函数中心;HC M 算法;konhonen 算法;最近邻聚类算法中图分类号:TP183 文献标识码:A 文章编号:1000-2162(2000)01-0072-07在信号处理、模式识别等系统中,多层前馈网络是应用较为广泛的模型。

但是大部分图1 R BF 神经网络拓扑图基于反向传播的多层前馈网络的学习算法必须基于某种非线性优化技术的缺点,计算量大、学习速度慢。

径向基函数神经网络(Radial Basis FunctionNeural Netw ork )理论为多层前馈网络的学习提供了一种新颖而有效的手段。

RBF 网络不仅具有良好的推广能力,而且计算量少,学习速度一般也比其它算法快得多。

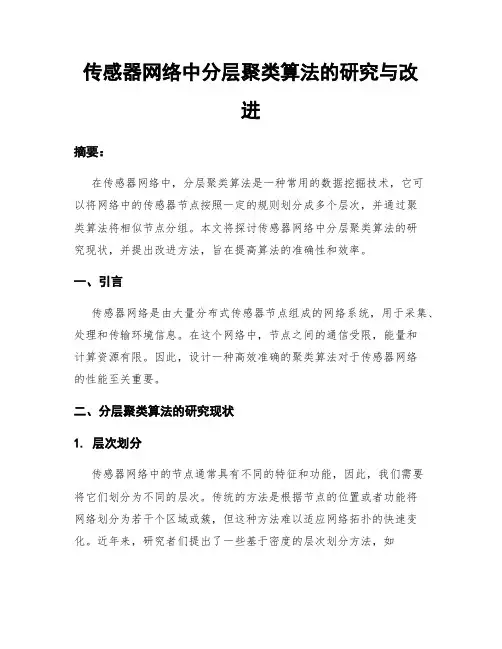

RBF 神经网络拓扑图如图1所示[1]。

RBF 网络从输入空间到隐含空间的变换是非线性的,而从隐含层空间到输出层空间的变换则是线性的。

这是一种前馈网络的拓扑结构,隐含层的单元是感受野单元,每个感受野单元的输出为ωi =R i (x =exp (-‖x -c i ‖2/σ2i ))(1)式中x 是输入模式,c i 是隐层第i 个高斯函数的中心,σi 是第i 个隐单元的归一化参数,即为高斯函数的宽度,i =1,…,n h ,n h ,为隐单元的个数。

隐层将输入空间映射到一个新空间,输出层在该新空间中实现线性组合器,可调节参数就是该线性组合器的权。

RB F 网络的输出为:收稿日期:1999-08-16基金项目:安徽省教委自然科学基金资助项目(98JL026)作者简介:朱明星(1968-),男,安徽金寨人,讲师.2000年3月第24卷第1期安徽大学学报(自然科学版)Journal of Anhui University Natural Science Edition March 2000V ol.24N o.1 f(x)=∑nhi=1w i R i(x)∑nhi=1R i(x)(2)w i是从第i个隐单元到输出单元的连接权。

传感器网络中分层聚类算法的研究与改进摘要:在传感器网络中,分层聚类算法是一种常用的数据挖掘技术,它可以将网络中的传感器节点按照一定的规则划分成多个层次,并通过聚类算法将相似节点分组。

本文将探讨传感器网络中分层聚类算法的研究现状,并提出改进方法,旨在提高算法的准确性和效率。

一、引言传感器网络是由大量分布式传感器节点组成的网络系统,用于采集、处理和传输环境信息。

在这个网络中,节点之间的通信受限,能量和计算资源有限。

因此,设计一种高效准确的聚类算法对于传感器网络的性能至关重要。

二、分层聚类算法的研究现状1. 层次划分传感器网络中的节点通常具有不同的特征和功能,因此,我们需要将它们划分为不同的层次。

传统的方法是根据节点的位置或者功能将网络划分为若干个区域或簇,但这种方法难以适应网络拓扑的快速变化。

近年来,研究者们提出了一些基于密度的层次划分方法,如DBSCAN和OPTICS算法。

这些方法能够根据节点的密度分布将网络划分为不同的层次,提高了网络的灵活性和适应性。

2. 层次聚类在网络划分完毕后,我们需要进行聚类分析,将相似的节点分组。

层次聚类是一种常用的方法,它通过计算节点之间的相似度或距离,将节点逐层聚类。

然而,在传感器网络中,节点的数据量庞大,传输和计算的成本很高。

因此,我们需要优化聚类算法,减少计算和通信开销。

三、改进方法1. 基于密度的分布式聚类算法传统的层次聚类算法需要全局信息,这对于分布式传感器网络来说是不现实的。

因此,我们可以使用基于密度的分布式聚类算法,如DBSCAN-D算法。

该算法将网络划分成多个局部区域,并在每个区域内执行聚类分析,然后将结果汇总,得到全局的聚类结果。

这种方法不仅降低了通信和计算的开销,还能够应对网络拓扑的动态变化。

2. 节点合并策略在传感器网络中,节点之间的距离可能存在较大的误差,导致聚类结果不准确。

为了解决这个问题,我们可以引入节点合并策略,在聚类过程中根据节点之间的距离和相似度,动态地选择是否合并节点。

最近邻方法是一种常见的机器学习算法,它被广泛应用于模式识别、数据挖掘和推荐系统等领域。

在这篇文章中,我们将深入探讨最近邻方法的原理、应用和局限性,以便更好地理解这一方法。

1. 最近邻方法的原理最近邻方法是一种基于实例的学习算法,它的核心思想是通过计算样本之间的距离来进行分类或回归预测。

在分类问题中,最近邻方法会找到离目标样本最近的K个训练样本,然后根据它们的类别进行投票决定目标样本的类别。

而在回归问题中,最近邻方法会找到离目标样本最近的K个训练样本,然后根据它们的值进行加权平均来预测目标样本的值。

最近邻方法的优点在于简单易懂,适用于多种类型的数据,但它也有一些局限性,比如对噪声和维度灾难敏感。

2. 最近邻方法的应用最近邻方法在各种领域都有广泛的应用。

在模式识别领域,最近邻方法常被用于人脸识别、手写字体识别等任务。

在数据挖掘领域,最近邻方法常被用于聚类分析、异常检测等任务。

在推荐系统领域,最近邻方法常被用于基于用户的协同过滤推荐算法。

这些应用充分展示了最近邻方法的灵活性和强大性。

3. 最近邻方法的局限性尽管最近邻方法有诸多优点,但它也存在一些局限性。

最近邻方法对数据中的噪声和异常值非常敏感,这会导致它在一些情况下表现不稳定。

最近邻方法在处理高维数据时会遇到维度灾难的问题,因为随着维度的增加,样本之间的距离会变得越来越稀疏,导致算法性能下降。

另外,最近邻方法在处理大规模数据时效率较低,因为需要计算目标样本与所有训练样本之间的距离。

4. 个人观点和理解从个人角度来看,我认为最近邻方法是一种简单而有效的机器学习算法,它能够基于实例进行快速学习并进行准确的预测。

然而,我们也需要认识到它的局限性,比如对噪声和维度灾难的敏感性,以及在大规模数据下的效率低下。

在实际应用中,我们可能需要结合其他方法来克服这些问题,或者对最近邻方法进行改进和优化。

总结最近邻方法是一种强大的机器学习算法,它在模式识别、数据挖掘和推荐系统等领域都有着广泛的应用。

基于最近邻算法的推荐系统技术研究随着互联网的快速发展,网络广告越来越重要,而推荐系统则成为了一个越来越重要的领域。

基于最近邻算法的推荐系统技术成为了推荐系统中的主流算法之一。

本文将从基本概念、设计模式、实现方式以及优化探讨最近邻算法在推荐系统中应用的技术研究。

基本概念最近邻算法,即KNN算法,是一种机器学习算法,属于无监督学习算法。

它使用训练样本近邻的标量信息对未知样本进行分类和回归预测。

通常以欧氏距离作为相似性度量。

KNN算法可以用于增强推荐系统中的个性化推荐功能。

在推荐系统中,它的输入是用户-物品-评价矩阵,输出是最优的用户-物品-评价推荐结果。

它还有两种不同的应用:用户至用户(user-to-user)协同过滤和物品至物品(item-to-item)协同过滤。

设计模式对于基于最近邻算法的推荐系统技术,有许多不同的设计模式可供选择,包括用户至用户协同过滤、物品至物品协同过滤和混合协同过滤,并且还可以采用加权的最近邻算法(WKNN),它对相似度中使用的忽略度和距离进行了加权。

通过结合不同的设计模式,可以大大提高推荐系统的精度和性能。

实现方式在实现基于最近邻算法的推荐系统技术时,您需要选择一个适合自己的开发工具,就像Python、R、Java、C++等。

通常,数据的预处理是最关键的一个步骤,可以采取特征选择和降维技术来减少特征空间的维度。

同时,您还可以使用优化的算法来计算每个用户之间的相似度。

例如,为了减少运算量,可以使用高效的迭代算法,例如Singular Value Decomposition(SVD)算法(SVD),这是一种典型的奇异值分解方法。

此外,还可以采用分布式处理方法来处理大规模数据,例如MapReduce等分布式计算框架。

优化探讨基于最近邻算法的推荐系统技术已经被证明在实践中有效,但是还有一些问题需要解决。

首先,由于缺乏可用信息,与现有物品相似的没有评价历史的新物品不能被推荐。

解决这个问题的策略包括推广新物品,将新物品与与之相似的现有物品合并或使用混合推荐系统。

聚类分析的算法优化与改进近年来,随着大数据技术的发展和普及,聚类分析被广泛应用于各个领域,如金融、医疗、物流等。

聚类分析是将一组相似的数据样本归为一类,不同类别的数据样本之间的相似度较低,同一类别的数据样本之间的相似度较高。

聚类分析的目的是在大量数据样本中寻找数据样本之间的关联性,发现隐藏在样本背后的规律性和特征。

然而,在聚类分析的实际应用中存在一些问题。

例如,聚类结果不稳定、计算效率低下等。

这些问题的出现,往往是由于聚类算法本身的缺陷造成的。

因此,优化和改进聚类算法是非常必要的。

首先,聚类算法的优化可以从数据预处理方面入手。

通常,聚类算法应该在数据预处理后进行。

例如,对于缺失数据的处理,可以采用插值、删除或替换等方法。

对于异常值的处理,可以采用离群点处理方法。

对于数据归一化,可以采用标准化或缩放等方法。

其次,聚类算法的优化也可以从相似度度量方面入手。

通常,相似度度量指的是聚类算法采用的距离度量方法。

常见的距离度量方法有欧氏距离、曼哈顿距离、闵可夫斯基距离等。

每种距离度量方法有其特点和适用的场景。

选择合适的距离度量方法对聚类算法的效果至关重要。

最后,聚类算法的改进可以从聚类结果的评估方面入手。

通常,评估聚类结果需要采用有效性指标,例如轮廓系数、DB指数、Dunn指数等。

这些指标可以用来评估聚类结果的准确度和稳定性。

通过评估聚类结果,可以不断改进聚类算法,提高算法的准确性和稳定性。

综上所述,聚类算法的优化和改进可以从多个方面入手,例如数据预处理、相似度度量和聚类结果评估。

在实际应用过程中,我们应该根据具体的场景和需求选择合适的优化和改进方法,以达到最好的聚类效果。

结合自然和共享最近邻的密度峰值聚类算法柏锷湘1+,罗可1,罗潇21.长沙理工大学计算机与通信工程学院,长沙4101142.国网上海电力公司,上海200000+通信作者E-mail:****************摘要:基于快速搜索和寻找密度峰值聚类算法(DPC )具有无需迭代且需要较少参数的优点,但其仍然存在一些缺点:需要人为选取截断距离参数;在流形数据集上的处理效果不佳。

针对这些问题,提出一种密度峰值聚类改进算法。

该算法结合了自然和共享最近邻算法,重新定义了截断距离和局部密度的计算方法,并且算法融合了候选聚类中心计算概念,通过算法选出不同的候选聚类中心,然后以这些候选中心为新的数据集,再次开始密度峰值聚类,最后将剩余的点分配到所对应的候选中心点所在类簇中。

改进的算法在合成数据集和UCI 数据集上进行验证,并与K -means 、DBSCAN 和DPC 算法进行比较。

实验结果表明,提出的算法在性能方面有明显提升。

关键词:密度峰值聚类算法;自然最近邻;共享最近邻文献标志码:A中图分类号:TP301Peak Density Clustering Algorithm Combining Natural and Shared Nearest NeighborBAI Exiang 1+,LUO Ke 1,LUO Xiao 21.School of Computer and Communication Engineering,Changsha University of Science and Technology,Changsha 410114,China2.State Grid Shanghai Municipal Electric Power Company,Shanghai 200000,ChinaAbstract:The clustering by fast search and find of density peaks (DPC)has the advantages of no iteration and fewer parameters,but it still has some shortcomings:the need to manually select the cutoff distance parameter and the processing effect is not good on the manifold data set.In response to these problems,an improved density peak clustering algorithm is proposed.The algorithm combines the natural and shared nearest neighbor algorithm,redefines the calculation method of cut-off distance and local density.It integrates the concept of candidate cluster center calculation,selects different candidate cluster centers through the algorithm,uses these candidate centers as a new data set,and starts density peak clustering again.Finally,the remaining points are assigned to the clusters where the corresponding candidate center points are located.The improved algorithm is verified on the synthetic data set and UCI data set rows,and compared with the K -means,DBSCAN (density-based algorithm for discovering clusters in large spatial databases with noise)and DPC algorithm.Experimental results show that the algorithm proposed in this paper has significant improvement in performance.Key words:density peak clustering algorithm;natural nearest neighbor;shared nearest neighbor计算机科学与探索1673-9418/2021/15(05)-0931-10doi:10.3778/j.issn.1673-9418.2006060基金项目:国家自然科学基金(11671125,51707013)。

近邻聚类算法近邻聚类算法(Nearest Neighbor Clustering)是一种常用的数据聚类方法,它基于数据点之间的相似度度量,将相似的数据点分为同一类别。

该算法的基本思想是通过计算数据点之间的距离或相似度,将距离较近的数据点划分为同一类别。

近邻聚类算法的步骤如下:1. 数据预处理:首先,需要对原始数据进行预处理,包括数据清洗、特征选择和特征缩放等。

数据预处理的目的是提高数据的质量和减少噪音的影响。

2. 计算相似度:接下来,我们需要计算数据点之间的相似度。

相似度可以通过计算数据点之间的距离或使用相似度度量方法(如余弦相似度)来获得。

常用的距离度量方法包括欧氏距离、曼哈顿距离和闵可夫斯基距离等。

3. 构建邻居图:根据相似度计算结果,我们可以构建一个邻居图。

邻居图是一个无向图,其中每个数据点作为一个节点,相似度高于一定阈值的数据点之间会存在边。

邻居图的构建可以通过设置邻居数量或相似度阈值来控制。

4. 寻找聚类中心:在邻居图中,我们可以通过寻找聚类中心来划分数据点的聚类。

聚类中心可以通过计算数据点到其他数据点的平均距离或相似度来获得。

一种常用的方法是选取邻居图中度最大的节点作为聚类中心。

5. 分配数据点:接下来,我们将每个数据点分配给距离最近的聚类中心。

这一步可以通过计算数据点与每个聚类中心的距离或相似度来完成。

数据点将被分配到与其最近的聚类中心所属的类别。

6. 聚类结果评估:最后,我们需要对聚类结果进行评估。

常用的评估指标包括紧密度(Compactness)和分离度(Separation)。

紧密度衡量了聚类内部的紧密程度,分离度衡量了不同聚类之间的分离程度。

评估指标越高,表示聚类结果越好。

近邻聚类算法的优点是简单易实现,不需要事先确定聚类数量,适用于数据集较大且聚类结构不明显的情况。

然而,该算法的效果受到数据点之间相似度计算的影响,对噪音和异常值敏感。

近邻聚类算法在实际应用中具有广泛的应用价值。

FCM-VKNN聚类算法的研究的报告,800字FCM-VKNN聚类算法的研究报告本报告主要介绍FCM-VKNN (Fuzzy C-Means and Voronoi K-Nearest Neighbors)聚类算法。

它是一种基于模糊c-means聚类和Voronoi k-近邻算法的结合,以降低算法复杂度的新颖的聚类算法。

本文将从算法的原理出发,对其工作原理、优缺点、应用示例等方面进行深入探讨。

FCM-VKNN聚类算法是一种基于模糊c-means(FCM)和Voronoi K-近邻(VKNN)算法的结合,它融合了模糊c-means聚类算法和Voronoi k-近邻算法的优势,并削弱了它们的不足之处。

此外,它可以提高算法的精度和效率。

首先, FCM-VKNN算法在进行聚类时,会使用模糊c-means 算法来计算每个样本的模糊质点值,即隶属度。

然后,算法会通过Voronoi K-近邻算法计算每个样本的Voronoi空间,找出它们的最近邻,用于计算这些样本的误差和更新模糊质点值。

最后,通过聚类中心更新,算法可以分配样本点到最小化其损失函数的最佳聚类中心。

相比模糊C-means聚类算法,FCM-VKNN聚类算法具有四个显著优势:(1)它可以有效抵抗噪声及样本离群;(2)它可以更精确地选择聚类中心;(3)它可以提高算法的精度和效率;(4)它可以有效地处理高维数据集。

在实际应用中,FCM-VKNN聚类算法可以广泛应用于文本聚类、生物信息学中基因芯片数据的聚类分析、图像分割和对抗生成网络(GANs)中的聚类网络等领域。

总之,FCM-VKNN聚类算法在聚类性能和算法复杂度方面取得了显著的改进,它相比于其他基于模糊c-means和Voronoi k-近邻算法的聚类算法具有更好的聚类能力和更高的效率。

因此,FCM-VKNN聚类算法可以有效地解决聚类问题,为大量实际领域提供精度和性能可靠的解决方案,并有望在未来具有更多的应用。

机器学习技术中的聚类算法与模型优化方法机器学习技术是当今科技领域的热门话题,其应用广泛涵盖了许多领域,比如自然语言处理、图像识别、推荐系统等。

聚类算法作为机器学习中的一种重要技术,被广泛应用于数据挖掘、分析和分类等研究领域。

本文将介绍聚类算法的基本原理以及模型优化方法。

聚类算法是一种将数据集中的对象按照相似性进行分组的方法。

它能够将相似的样本归为一类,从而得到数据集的分布情况,帮助我们了解数据集特征和结构。

常见的聚类算法包括K均值聚类、层次聚类和DBSCAN等。

K均值聚类算法是一种简单且常用的聚类算法。

它将数据集划分为K个簇,每个簇由其内部的样本组成,簇内的样本之间相似度较高,而簇间的样本相似度较低。

该算法的基本思想是通过迭代的方式不断更新簇的质心,使得簇内样本的相似度最大化。

层次聚类是一种基于树结构的聚类算法。

它将数据集按照不同层次进行划分,从而构建出一个层次结构。

具体地,在每一次迭代中,层次聚类算法将距离最近的两个样本合并到一个簇中,直到所有的样本都被划分到一个簇。

该算法能够生成一颗聚类树,通过剪枝操作可以得到不同层次的聚类结果。

DBSCAN算法是一种基于密度的聚类算法。

它通过定义样本点的邻域半径和邻域内样本点的最小数量来确定样本的核心对象,并根据核心对象之间的密度连接进行聚类划分。

与K均值聚类和层次聚类不同的是,DBSCAN不需要事先确定聚类的个数,能够自动识别出数据集中的离群点。

在聚类算法中,模型的优化是一个重要的问题。

因为聚类算法的性能直接影响到后续的数据分析和应用结果。

有许多方法可以用于聚类模型的优化,其中之一是使用特征选择和降维。

特征选择是从原始数据集中选择对聚类任务最有用的特征子集。

通过选择重要特征,可以降低数据维度,减少数据集的噪声和冗余信息,提高聚类算法的性能。

常见的特征选择方法包括方差阈值法、相关系数法和基于模型的方法等。

降维是将高维数据映射到低维空间的过程。

通过降维,可以减少数据集的复杂性,提高聚类算法的效率和准确性。

最近邻规则聚类算法

最近邻规则聚类算法通常指的是最近邻分类算法中的一种。

这种算法基于样本点之间的相似性度量,将每个样本点分配到与其最近邻的簇中。

虽然最近邻算法主要用于分类问题,但可以通过对其进行适当的修改来实现聚类。

以下是最近邻规则聚类算法的基本步骤:

1.数据集:首先,选择要聚类的数据集,其中包含了待分类或聚类的样本数据。

2.距离度量:确定样本点之间的距离或相似性度量。

通常使用的距离度量包括欧氏距离、曼哈顿距离、闵可夫斯基距离等。

这个距离度量用于衡量两个样本点之间的相似性。

3.最近邻分类:对于每个样本点,找到与其最近的邻居。

这些邻居的数量可以通过预先指定的参数(如K值)来确定。

4.簇分配:将每个样本点分配到与其最近邻的簇中。

这样,样本点将被聚类到具有相似性的簇中。

5.结果输出:输出聚类结果,即每个样本点所属的簇。

需要注意的是,最近邻规则聚类算法的效果可能会受到异常值的影响,并且在处理大型数据集时可能会面临计算复杂度较高的问题。

因此,在实际应用中,可能需要对算法进行适当的优化或考虑其他聚类算法,如K均值聚类、层次聚类等。

KNN算法的改进方法K近邻算法是机器学习中常用的一种分类算法。

KNN算法具有简单易懂、易于实现、无需训练等优点,但在处理大量数据时,算法的计算量会变得非常大,同时又会存在维度灾难和样本不平衡等问题。

为了解决这些问题,研究人员提出了许多改进的KNN 算法。

改进方法一:KD-Tree算法K近邻算法基于距离度量来进行分类,传统的KNN算法需要计算每个测试样本与所有已知样本之间的距离,随着样本数量的增加,计算的时间复杂度会呈指数级增长,这样就会导致算法无法简单高效地应用于大规模数据的处理中。

针对这种问题,研究人员提出了KD-Tree算法。

KD-Tree是一种树形数据结构,可以有效地减少样本到测试样本的距离计算量,从而提升算法的分类效率。

具体来说,KD-Tree 算法通过递归的方式将已知样本空间划分成多个区域,每个区域的划分方式采用平行于坐标轴的超平面。

当一个测试样本要被分类时,算法首先确定它在KD-Tree上所处的叶子节点,然后只需要计算测试样本与该叶子节点内的已知样本之间的距离,从而大大减少了计算量。

改进方法二:基于核函数的KNN算法传统的KNN算法只考虑了样本之间的欧几里得距离或曼哈顿距离等常见距离度量,忽略了样本之间的非线性关系。

因此,该算法在处理非线性分类问题时可能会出现一定的局限性。

针对这一问题,研究人员提出了基于核函数的KNN算法。

核函数是一种数学技巧,用于将非线性映射变成线性映射。

基于核函数的KNN算法通过对样本进行非线性映射,将样本从低维空间映射到高维空间,从而使得在高维空间中欧式距离近的样本在低维空间中也保持足够的相似性。

同时,算法还采用加权投票的方式以获得更好的分类结果。

改进方法三:SMOTE算法传统的KNN算法针对样本不平衡问题,在数据预处理阶段通常会采用欠采样或过采样等方法来平衡样本。

欠采样方法常常会丢失重要的信息,而过采样方法则可能会引入噪声或重复样本数据。

为了解决这一问题,研究人员提出了SMOTE算法。

电力物联网中基于聚类的任务卸载在线优化方法夏元轶;滕昌志;曾锃;张瑞;王思洋【期刊名称】《计算机技术与发展》【年(卷),期】2024(34)6【摘要】随着电力物联网(electric Internet of Things,eIoT)技术的快速发展,海量电力设备在网络边缘环境中产生了丰富的数据。

移动边缘计算(Mobile Edge Computing,MEC)技术在靠近终端设备的位置部署边缘代理可以有效减少数据处理延迟,这使其非常适用于延迟敏感的电力物联网场景。

然而,目前的大多数研究没有考虑到部分边缘终端设备也可以作为代理设备提供计算服务,造成了资源浪费。

为了充分利用移动边缘计算过程中边缘代理以及边缘终端设备的计算能力,提出了一种基于设备聚类的任务卸载方案。

首先,基于分层DBSCAN(hierarchical density-based spatial clustering of applications with noise)算法,对系统中的静态和动态边缘设备进行聚类。

其次,将任务卸载问题建模为多臂老虎机(Multi-Armed Bandits,MAB)模型,目标为最小化卸载延迟。

再次,提出了一种基于自适应置信上限算法的算法来寻找簇内与簇间的卸载策略。

最后,仿真结果表明,该方案在平均延迟方面表现出了更好的性能,并且设备簇的存活时间延长了10%~20%。

【总页数】7页(P66-72)【作者】夏元轶;滕昌志;曾锃;张瑞;王思洋【作者单位】国网江苏省电力有限公司信息通信分公司;南京邮电大学通信与信息工程学院【正文语种】中文【中图分类】TP391【相关文献】1.基于计算卸载的电力物联网能效优化研究2.面向电力物联网的5G移动边缘计算任务卸载方法3.基于电力物联网的边缘计算任务卸载优化4.基于深度Q学习的电力物联网任务卸载研究5.基于卸载策略的物联网边缘计算任务调度优化因版权原因,仅展示原文概要,查看原文内容请购买。