数学建模 司守奎11第11章 偏最小二乘回归分析

- 格式:ppt

- 大小:1.33 MB

- 文档页数:49

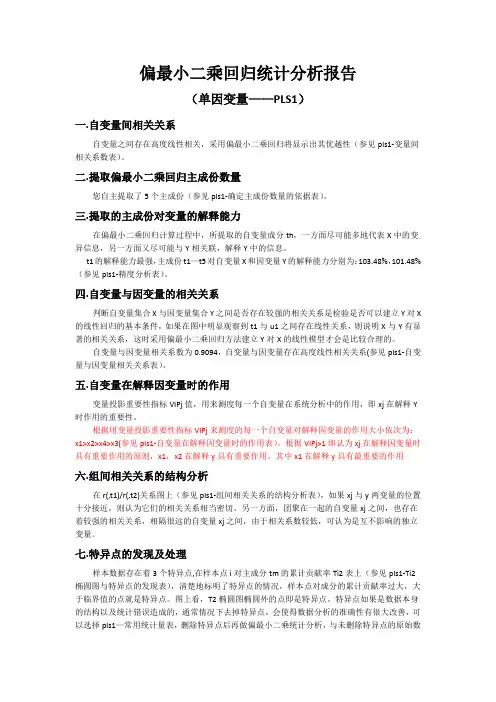

偏最小二乘回归统计分析报告(单因变量——PLS1)一.自变量间相关关系自变量之间存在高度线性相关,采用偏最小二乘回归将显示出其优越性(参见pls1-变量间相关系数表)。

二.提取偏最小二乘回归主成份数量您自主提取了5个主成份(参见pls1-确定主成份数量的依据表)。

三.提取的主成份对变量的解释能力在偏最小二乘回归计算过程中,所提取的自变量成分th,一方面尽可能多地代表X中的变异信息,另一方面又尽可能与Y相关联,解释Y中的信息。

t1的解释能力最强,主成份t1—t5对自变量X和因变量Y的解释能力分别为:103.48%,101.48%(参见pls1-精度分析表)。

四.自变量与因变量的相关关系判断自变量集合X与因变量集合Y之间是否存在较强的相关关系是检验是否可以建立Y对X 的线性回归的基本条件,如果在图中明显观察到t1与u1之间存在线性关系,则说明X与Y有显著的相关关系,这时采用偏最小二乘回归方法建立Y对X的线性模型才会是比较合理的。

自变量与因变量相关系数为0.9094,自变量与因变量存在高度线性相关关系(参见pls1-自变量与因变量相关关系表)。

五.自变量在解释因变量时的作用变量投影重要性指标VIPj值,用来测度每一个自变量在系统分析中的作用,即xj在解释Y 时作用的重要性。

根据用变量投影重要性指标VIPj来测度的每一个自变量对解释因变量的作用大小依次为:x1>x2>x4>x3(参见pls1-自变量在解释因变量时的作用表)。

根据VIPj>1即认为xj在解释因变量时具有重要作用的原则,x1,x2在解释y具有重要作用。

其中x1在解释y具有最重要的作用六.组间相关关系的结构分析在r(,t1)/r(,t2)关系图上(参见pls1-组间相关关系的结构分析表),如果xj与y两变量的位置十分接近,则认为它们的相关关系相当密切。

另一方面,团聚在一起的自变量xj之间,也存在着较强的相关关系,相隔很远的自变量xj之间,由于相关系数较低,可认为是互不影响的独立变量。

偏最小二乘回归结果解读-回复步骤一:介绍偏最小二乘回归偏最小二乘回归(Partial Least Squares Regression,简称PLSR)是一种经典的回归方法,常用于统计建模和数据分析中。

它可以处理多个自变量之间存在共线性的情况,同时也可以寻找到与因变量相关性最大的信息。

PLSR方法的核心思想是将原始自变量的空间通过线性变换映射到一个新的空间,使得原始自变量和因变量在新空间中的相关性最大化。

这个映射过程基于对原始自变量和因变量之间的协方差矩阵进行分解,得到多个相互正交的潜在变量。

这些潜在变量被称为PLS因子或者主成分,它们的个数通常小于原始自变量的个数。

步骤二:数据准备在进行PLSR分析之前,需要准备一组用于构建回归模型的数据。

这组数据通常包含两个部分:自变量X和因变量Y。

自变量X是一个m×n的矩阵,其中m为样本数量,n为自变量个数;因变量Y是一个m×1的向量。

确保数据的质量和准确性对后续的模型构建和结果解释非常重要。

步骤三:模型构建PLSR模型的构建分为两个阶段:训练阶段和预测阶段。

在训练阶段,使用训练数据集来计算PLS因子,并建立PLSR模型。

在预测阶段,使用测试数据集来评估模型的性能。

训练阶段的具体步骤如下:1. 中心化:对自变量X和因变量Y进行中心化处理,即对每个变量减去其均值,确保数据的均值为0。

2. 标准化:对中心化后的自变量X和因变量Y进行标准化处理,即对每个变量除以其标准差,确保数据的方差为1。

3. PLSR建模:通过奇异值分解(Singular Value Decomposition,简称SVD)对中心化和标准化后的X和Y进行分解,得到PLS模型的系数矩阵。

步骤四:结果解释PLSR模型构建完成后,就可以进行结果解释的分析了。

常用的结果解释方法有:1. PLSR负荷图:负荷图可以帮助我们理解变量与PLS因子之间的关系。

在负荷图中,每个自变量和因变量都用一个箭头表示,箭头的长度表示变量与该PLS因子的相关性。

回归分析是一种统计方法,用于研究自变量与因变量之间的关系。

在实际应用中,常常会遇到变量间存在多重共线性或高维数据的情况,这时偏最小二乘回归模型(PLS回归)就显得尤为重要。

本文将介绍偏最小二乘回归模型的应用技巧,帮助读者更好地理解和运用这一方法。

一、偏最小二乘回归模型的原理偏最小二乘回归模型是一种降维技术,它可以在解决多重共线性和高维数据问题时发挥作用。

其原理是将自变量和因变量在低维空间中表示,通过保留最大的协方差信息来建立预测模型。

与传统的多元线性回归相比,PLS回归可以更好地处理变量间的多重共线性,适用于高度相关的自变量或多元回归中自变量数量远远大于样本量的情况。

二、数据预处理在进行偏最小二乘回归分析之前,数据预处理是非常重要的一步。

首先,需要对数据进行标准化处理,使得所有的自变量和因变量都具有相同的尺度。

其次,对于存在缺失值或异常值的数据,需要进行适当的处理,以提高模型的稳定性和准确性。

最后,如果数据存在较大的噪声或离群点,可以考虑进行平滑处理或异常值检测,以减小数据中的随机误差。

三、变量选择在建立偏最小二乘回归模型时,变量选择是至关重要的一步。

PLS回归可以通过提取主成分的方式,自动选择对预测目标最为重要的自变量,减少不必要的信息冗余。

但在实际应用中,为了更好地理解模型,我们还是需要对变量进行合理的选择和筛选。

可以借助相关性分析、方差膨胀因子等方法,选取与因变量相关性较高且相互独立的自变量,以提高模型的解释性和预测准确性。

四、模型诊断建立偏最小二乘回归模型后,模型诊断是评估模型拟合效果和稳定性的重要手段。

可以利用残差分析、交叉验证等方法,检验模型的预测能力和稳健性。

另外,对于模型中存在的共线性问题,可以通过方差膨胀因子、特征值等指标进行诊断,及时调整模型结构,以提高模型的解释力和预测精度。

五、模型解释偏最小二乘回归模型不仅可以用于预测建模,还可以用于变量的重要性排序和解释。

在模型解释方面,可以利用变量负荷图、VIP值等方法,识别对因变量影响最大的自变量,并对其进行解释和解读。

应 用 数 学M ATHE M ATIC A APP LIC AT A2004,17(增):140~143Ξ偏最小二乘回归的应用效果分析申艳,刘次华(华中科技大学数学系,武汉430074)摘要:本文介绍了偏最小二乘回归(P LS)的建模方法,比较了P LS与普通最小二乘回归(O LS)及主成分回归的应用效果,并总结了P LS回归的基本特点.关键词:多重共线性;偏最小二乘回归;最小二乘回归;主成分回归中图分类号:O212.1 AMS(2000)主题分类:62J05文献标识码:A 文章编号:100129847(2004)增20140204、社会经济生活、科学研究等各个领域中,经常要对数据进行分析、拟合及预测,多元线性回归便是常用的方法之一.一般采用普通最小二乘方法估计回归系数,可以使残差平方和达到最小,但当自变量之间存在多重共线性时,最小二乘估计方法往往失效,不仅增大了模型误差,而且使模型丧失稳健性.为消除系统中的多重共线性,常采用主成分回归的方法,但采用主成分分析提取的主成分,虽然能较好地概括自变量系统中的信息,却带进了许多无用的噪声,从而对因变量缺乏解释能力.近年来发展起来的偏最小二乘回归(P LS)研究的焦点是多因变量对多因变量回归建模,能在自变量之间存在多重共线性的条件下进行建模,更易于辨识系统信息与噪声,对因变量也有较强的解释能力.考虑q个变量y1,…,y q与p个自变量x1,…,x p的建模问题.偏最小二乘回归的基本思想是首先在自变量集中提取第一成分t1(t1是x1,…,x p的线性组合,且尽可能多地携带原自变量集中的变异信息);同时在因变量集中也提取第一成分u1,并要求t1与u1相关程度达最大,然后建立因变量y1,…,y q与t1的回归方程,如果回归方程已达到满意的精度,则算法终止.否则继续第二成分的提取,直到能达到满意的精度为止.若最终对自变量集提取了l个成分t1,…,t l,偏最小二乘回归将通过建立y1,…,y q与t1,…,t l的回归方程式得出y1,…,y q与自变量x1,…,x p的回归方程式,即偏最小二乘回归方程式.首先将数据做标准化处理.记X=(x1,…,x p)n×p经标准化处理后的数据矩阵为E0= (E01,…,E0p)n×p,Y=(y1,…,y q)经标准化处理后的数据矩阵为F0=(F01…F0q)n×q第一步,记t1是E0的第一成分,t1=E0w1,w1是E0的第一个轴,且‖w1‖=1,记u1是F0的第一成分,u1=F0c1,c1是F0的第一个轴,且‖c1‖=1.如果要求t1,u1能分别很好地代表X 与Y中的数据变异信息,根据主成分分析原理,我们要求t1与u1标准差Var(t1),V(u1)趋于最大.另一方面t1对u1要有最大的解释能力,由典型相关分析的思路,t1与u1的相关度应达Ξ收稿日期:2004205213作者简介:申艳,女,讲师,华中科技大学数学系硕士,研究方向:概率与数理统计.到最大值,即r (t 1,u 1)→max ,综合起来就是要求t 1与u 1的协方差达到最大,即C ov (t 1,u 1)=Var (t 1)Var (u 1)r (t 1,u 1)→max ,也就是在‖w 1‖=1,‖c 1‖=1的约束条件下求w T 1E T 0F 0c 1的最大值.采用拉格朗日算法,记s =w T 1E Γ0F 0c 1-λ1(w T 1w 1-1)-λ2(c T1c 1-1),对s 分别求关于w 1,c 1,λ1和λ2的偏导,并令之为零,可以推出E T 0F 0F T 0E 0w 1=θ21w 1,F T 0E 0E T 0F 0c 1=θ21c 1,这里记θ1=2λ1=2λ2=w T 1E T0F 0c 1,容易看出θ1正是优化问题的目标函数值(要求θ1取最大值),w 1是对应于矩阵E T 0F 0F T 0E 0的最大特征值θ21的单位特征向量,c 1是对应于矩阵F T 0E 0E T 0F 0的最大特征值θ21的单位特征向量.求得w 1和c 1后,即可得成分t 1=E 0w 1,u 1=F 0c 1,然后,分别求E 0和F 0对t 1,u 1的三个回归方程E 0=t 1p T 1+E 1,F 0=u 1q T 1+F 31,F 0=t 1r T1+F 1,式中回归系数p 1=E T 0t 1‖t 1‖2,q 1=F T 0u 1‖u 1‖2,r 1=F T0t 1‖t 1‖2,而E 1,F 31,F 1分别是三个回归方程的残差矩阵.第二步用残差矩阵E 1和F 1取代E 0和F 0,用同样的方法求第二个轴w 2和c 2以及第二个成分t 2,u 2.如此计算下去,如果X 的秩是l ,则存在l 个成分t 1,t 2,…,t l ,使得E 0=t 1p T1+…+t l p T l ,F 0=t 1r T 1+…+t l r Tl +F l ,由于t 1,t 2,…,t l 均可以表示成E 01…E 0P 的线性组合,因此可得y 3k =F 0k ,关于x 3j =E 0j 的回归方程式,即y 3k =a k 1x 31+…+a kp x 3p +F lk ,k =1,2,…,q.一般情况下,偏最小二乘回归并不需要选用存在的l 个成分t 1,t 2,…,t l 来建立回归式,而像主成分分析一样,只选用前m 个成分(m ≤l ),即可得到预测能力较好的回归模型.下面讨论确定抽取成分个数m 的两种常用方法.(1)“舍2交叉验证法”:每次舍去第i 个观测(i =1,…,n ),用余下的n -1个观测按偏最小二乘回归方法建模,并考虑抽取h 个成分后拟合的回归式,然后把舍去的第i 个观测点代入所拟合的回归方程式,得到y j 在第i 个观测点上的预测值^y j (-i )(h ).对于每一个i =1,2,…,n ,重复以上测试,可得y j (j =1,2,…,q )的预测残差平方和为PR ESS j (h )=∑ni =1(yij-^y j (-i )(h ))2,(j=1,2,…,q ),Y =(y 1,…,y q )的预测残差平方和为PR ESS (h )=∑qj-1PRESS j(h ).对抽取成分个数h 从1到A 逐个计算Y 的预测残差平方和PR ESS (h ),然后选取使Y 的预测残差平方和达到最小的h ,取m =h.(2)“Q 2h ”验证法:同方法(1)先算出Y =(y 1,…,y q )的预测残差平方和为PR ESS (h )=∑qj-1PRESS j(h ).另外,再采用所有的样本点,拟合含h 个成分的回归方程,记yj在第i 个样本点的预测值为^y ji (h ),则可定义y j 的残差平方和为SS j (h )=∑n i =1(yij-^y ji (h ))2,Y =(y 1,…,y q )的残差平方和为SS (h )=∑qj -1SS j(h ).对于全部因变量Y ,成分th的交叉有效性可定义为Q 2h =1-PR ESS (h )SS (h -1),Q 2h ≥0.097时,表明加入成分能改善模型质量,否则不能.下面我们考察大学生的高考成绩对其大学成绩的影响.选取某高校学生的5门高考成绩141增刊 申艳等:偏最小二乘回归的应用效果分析为自变量X=(x1,x2,x3,x4,x5),其中x12语文,x22数学,x32英语,x42政治,x52历史.并以他们大学第一学期的高等数学成绩为因变量Y.对数据进行标准化处理,建立高考成绩对高等数学的P LS回归模型,有关数据见表1,表2.表1 成分与自变量的相关系数表t1t2t3t4t5E01-0.36740.76290.43190.1979-0.2392E020.8477-0.19340.10820.48080.0330E030.90370.12330.2718-0.25790.1669E040.35820.7693-0.34350.07290.3956E050.44510.4844-0.6779-0.1701-0.2807Y0.72120.20520.0657-0.02790.0002由表1可以看出,第一成分t1与自变量E02,E03的相关系数很高,因此t1是一个体现自变量系统中数学和英语的因子.表2 高等数学的P LS回归模型的精度分析表成分t1t2t3t4t5RdX0.39930.29220.16990.07420.0643累积RdX0.39930.69160.85150.9357 1.000RdY0.52010.04210.00430.00080.000累积RdY0.52010.56220.56650.56130.5673PRESS9.47129.846310.572911.064811.20044RdX=1p∑pj=1r2(x j,t h)表示成分t h对X的解释能力,RdY=1q∑qk=1r2(y k,t h)表示成分t h对Y的解释能力.由表2可以看出,第一主成分解释了自变量系统中39.93%的变异信息,同时解释了因变量系统中52.01%的变异信息,这反映出数学,英语对因变量系数的贡献最大.另一方面,当h=1时,预测残差平方和最小(PR ESS=9.4712),因此我们用第一成分t1来建立P LS 回归模型,对高等数学有较好的观测能力.P LS回归模型是F0=0.0454E01+0.3000E02+0.3725E03-0.0663E04+0.2019E05 为了比较P LS回归与最小二乘回归(O LS),主成分回归(PCR)的回归效果,建立其它几种回归关于高考成绩对高等数学的回归模型如下:1.普通最小二乘回归方程:F0=0.1153E01+0.2442E02+0.5045E03-0.0062E04+0.2210E05 2.主成分回归方程:(1)用两个主成分建立的回归方程:F0=-0.2370E01+0.5356E02+0.6058E03-0.1131E04+0.4659E05 (2)用三个主成分建立的回归方程:F0=0.0857E01+0.5917E02+0.6753E03-0.1155E04+0.3812E05回归系数的大小表示相关程度的高低,或者贡献率的高低.这三个模型回归系数的性质是一致的,都反映出数学,英语对因变量系数的贡献最大,与我们的定性认识比较符合.但从回归模型的预测残差平方和PRESS(下表)241应 用 数 学 2004O LSRPCR (2)PCR (3)P LSR PRESS15.224413.123112.78999.4712可以发现偏最小二乘回归的PRESS 最小,说明由偏最小二乘回归方程拟合的方程对样本点的变动而引起的扰动误差影响最小,可见偏最小二乘回归模型最理想.特别当自变量之间存在严重多重相关性时,P LS 方法的优越性更能充分显示出来.偏最小二乘回归有如下基本特点:(1)P LS 对数据拟合及预测精度和稳定性均高于最小二乘回归(O LS )与主成分回归.(2)P LS 回归可以较好地处理O LS 难以解决的问题.当自变量之间存在严重多重相关性时,使用O LS 无法建立模型.然而P LS 却能利用对系统中的数据信息进行分解和筛选,提取对因变量解释最强的综合变量,识别系统中的噪声,建立适当的模型.另一方面,O LS 建模时的样本数不宜太少,一般要求为拟合项的两倍以上,而P LS 回归却能在自变量多,样本数少的情况下建立精度较高的模型.(2)P LS 回归在建模的过程中集中了O LS 回归、主成分分析、典型相关分析三者的特点.因此在分析结果中,除了可以提供一个更为合理的回归模型外,还可以同时完成一些类似于主成分分析和典型相关分析的研究内容,提供更丰富、深入的一些信息.参考文献:[1] 罗永泰,李小妹.高考入学成绩对后续课程影响的统计分析[J ].数理统计与管理,1996,15(2):14~16.[2] 王惠文.偏最小二乘回归方法及其应用[M].北京:国防工业出版社,1999.[3] 何小群.回归分析与经济数据建模[M].北京:中国人民大学出版社,1997.[4] 茆诗松,王静龙.高等数理统计[M].高等教育出版社,2000.Analysis of Applied E ffect of P artial Least Squares R egressionSHEN Yan ,LIU Ci 2hua(Mathematics Department ,Huazhong Univer sity o f Science and Technology ,Wuhan 430074,China )Abstract :In the paper ,we introduced how to build partial least squares regression m odel and com 2pared the applied effect of P LS with O LS and PCR.K ey w ords :Partial least squares regression ;Multi 2correlation ;O LSR341增刊 申艳等:偏最小二乘回归的应用效果分析。

回归分析中的偏最小二乘回归模型构建技巧回归分析是统计学中常用的一种分析方法,它可以用来探讨自变量和因变量之间的关系。

在实际应用中,偏最小二乘回归模型(partial least squares regression,简称PLS回归)是一种非常重要的回归分析方法,尤其适用于解决多重共线性和高维数据的问题。

本文将介绍在回归分析中构建偏最小二乘回归模型的一些技巧和注意事项。

数据预处理在进行偏最小二乘回归模型构建之前,数据预处理是非常关键的一步。

首先,需要对数据进行标准化处理,以便将不同变量的尺度统一,从而避免变量之间的尺度影响模型的建立。

其次,对数据进行缺失值处理,通常采用均值、中位数或者插值法来填补缺失值,确保数据的完整性和准确性。

另外,对于异常值的处理也是必不可少的,可以采用箱线图或者3σ原则来识别异常值,并进行相应的处理。

变量选择在构建偏最小二乘回归模型时,变量选择是一个至关重要的环节。

通常情况下,变量的选择可以采用逐步回归法、岭回归法或者LASSO回归法等方法。

此外,还可以利用主成分分析(principal component analysis,简称PCA)来对变量进行降维处理,从而减少模型的复杂度和提高模型的解释性。

在进行变量选择时,需要注意避免过拟合的问题,因此可以采用交叉验证的方法来评估模型的稳定性和泛化能力。

模型建立在进行偏最小二乘回归模型的建立时,需要根据实际问题和数据特点来选择合适的模型类型。

通常情况下,可以选择线性回归模型、多项式回归模型或者逻辑回归模型等。

此外,还可以根据实际情况进行交互项的添加和变量的转换,以提高模型的拟合度和预测能力。

在模型建立的过程中,需要不断地进行模型诊断和验证,确保模型的稳健性和准确性。

模型评估在构建偏最小二乘回归模型后,需要对模型进行充分的评估和验证。

通常可以采用R方值、均方误差(mean squared error,简称MSE)或者交叉验证误差来评估模型的拟合度和预测能力。

偏最小二乘回归方法1 偏最小二乘回归方法(PLS)背景介绍在经济管理、教育学、农业、社会科学、工程技术、医学和生物学中,多元线性回归分析是一种普遍应用的统计分析与预测技术.多元线性回归中,一般采用最小二乘方法(Ordinary Least Squares :OLS)估计回归系数,以使残差平方和达到最小,但当自变量之间存在多重相关性时,最小二乘估计方法往往失效.而这种变量之间多重相关性问题在多元线性回归分析中危害非常严重,但又普遍存在。

为消除这种影响,常采用主成分分析(principal Components Analysis :PCA)的方法,但采用主成分分析提取的主成分,虽然能较好地概括自变量系统中的信息,却带进了许多无用的噪声,从而对因变量缺乏解释能力。

最小偏二乘回归方法(Partial Least Squares Regression:PLS)就是应这种实际需要而产生和发展的一种有广泛适用性的多元统计分析方法。

它于1983年由S.Wold和C.Albano等人首次提出并成功地应用在化学领域。

近十年来,偏最小二乘回归方法在理论、方法和应用方面都得到了迅速的发展,己经广泛地应用在许多领域,如生物信息学、机器学习和文本分类等领域。

偏最小二乘回归方法主要的研究焦点是多因变量对多自变量的回归建模,它与普通多元回归方法在思路上的主要区别是它在回归建模过程中采用了信息综合与筛选技术。

它不再是直接考虑因变量集合与自变量集合的回归建模,而是在变量系统中提取若干对系统具有最佳解释能力的新综合变量(又称成分),然后对它们进行回归建模.偏最小二乘回归可以将建模类型的预测分析方法与非模型式的数据内涵分析方法有机地结合起来,可以同时实现回归建模、数据结构简化(主成分分析)以及两组变量间的相关性分析(典型性关分析),即集多元线性回归分析、典型相关分析和主成分分析的基本功能为一体.下面将简单地叙述偏最小二乘回归的基本原理。

偏最小二乘回归方法1 偏最小二乘回归方法(PLS)背景介绍在经济管理、教育学、农业、社会科学、工程技术、医学和生物学中,多元线性回归分析是一种普遍应用的统计分析与预测技术。

多元线性回归中,一般采用最小二乘方法(Ordinary Least Squares :OLS)估计回归系数,以使残差平方和达到最小,但当自变量之间存在多重相关性时,最小二乘估计方法往往失效。

而这种变量之间多重相关性问题在多元线性回归分析中危害非常严重,但又普遍存在。

为消除这种影响,常采用主成分分析(principal Components Analysis :PCA)的方法,但采用主成分分析提取的主成分,虽然能较好地概括自变量系统中的信息,却带进了许多无用的噪声,从而对因变量缺乏解释能力。

最小偏二乘回归方法(Partial Least Squares Regression:PLS)就是应这种实际需要而产生和发展的一种有广泛适用性的多元统计分析方法。

它于1983年由S.Wold和C.Albano等人首次提出并成功地应用在化学领域。

近十年来,偏最小二乘回归方法在理论、方法和应用方面都得到了迅速的发展,己经广泛地应用在许多领域,如生物信息学、机器学习和文本分类等领域。

偏最小二乘回归方法主要的研究焦点是多因变量对多自变量的回归建模,它与普通多元回归方法在思路上的主要区别是它在回归建模过程中采用了信息综合与筛选技术。

它不再是直接考虑因变量集合与自变量集合的回归建模,而是在变量系统中提取若干对系统具有最佳解释能力的新综合变量(又称成分),然后对它们进行回归建模。

偏最小二乘回归可以将建模类型的预测分析方法与非模型式的数据内涵分析方法有机地结合起来,可以同时实现回归建模、数据结构简化(主成分分析)以及两组变量间的相关性分析(典型性关分析),即集多元线性回归分析、典型相关分析和主成分分析的基本功能为一体。

下面将简单地叙述偏最小二乘回归的基本原理。

偏最小二乘回归是一种新型的多元统计数据分析方法,它与1983年由伍德和阿巴诺等人首次提出。

近十年来,它在理论、方法和应用方面都得到了迅速的发展。

密西根大学的弗耐尔教授称偏最小二乘回归为第二代回归分析方法。

偏最小二乘回归方法在统计应用中的重要性主要的有以下几个方面:(1)偏最小二乘回归是一种多因变量对多自变量的回归建模方法。

(2)偏最小二乘回归可以较好地解决许多以往用普通多元回归无法解决的问题。

在普通多元线形回归的应用中,我们常受到许多限制。

最典型的问题就是自变量之间的多重相关性。

如果采用普通的最小二乘方法,这种变量多重相关性就会严重危害参数估计,扩大模型误差,并破坏模型的稳定性。

变量多重相关问题十分复杂,长期以来在理论和方法上都未给出满意的答案,这一直困扰着从事实际系统分析的工作人员。

在偏最小二乘回归中开辟了一种有效的技术途径,它利用对系统中的数据信息进行分解和筛选的方式,提取对因变量的解释性最强的综合变量,辨识系统中的信息与噪声,从而更好地克服变量多重相关性在系统建模中的不良作用。

(3)偏最小二乘回归之所以被称为第二代回归方法,还由于它可以实现多种数据分析方法的综合应用。

由于偏最小二乘回归在建模的同时实现了数据结构的简化,因此,可以在二维平面图上对多维数据的特性进行观察,这使得偏最小二乘回归分析的图形功能十分强大。

在一次偏最小二乘回归分析计算后,不但可以得到多因变量对多自变量的回归模型,而且可以在平面图上直接观察两组变量之间的相关关系,以及观察样本点间的相似性结构。

这种高维数据多个层面的可视见性,可以使数据系统的分析内容更加丰富,同时又可以对所建立的回归模型给予许多更详细深入的实际解释。

一、偏最小二乘回归的建模策略\原理\方法1.1建模原理设有 q 个因变量{q y y ,...,1}和p 自变量{p x x ,...,1}。

为了研究因变量和自变量的统计关系,我们观测了n 个样本点,由此构成了自变量与因变量的数据表X={p x x ,...,1}和.Y={q y y ,...,1}。

回归分析是一种重要的统计分析方法,用于研究两个或多个变量之间的关系。

在回归分析中,偏最小二乘回归模型是一种常用的数据建模技术,它可以很好地处理多重共线性和高维数据的问题。

本文将介绍偏最小二乘回归模型的构建技巧,帮助读者更好地理解和应用这一方法。

1. 数据预处理在构建偏最小二乘回归模型之前,首先需要对数据进行预处理。

数据预处理包括数据清洗、缺失值处理、异常值处理等步骤。

清洗数据可以提高模型的准确性和稳定性,避免噪声对模型的影响。

缺失值处理可以采用插补法或删除法,具体方法取决于数据的特点和缺失值的数量。

异常值处理可以通过箱线图或3σ原则等方法识别和处理异常值。

数据预处理是构建偏最小二乘回归模型的第一步,对模型的建立和结果的解释具有重要意义。

2. 变量选择在构建偏最小二乘回归模型时,需要选择适当的自变量和因变量。

变量选择的目的是提高模型的解释力和预测力,避免过拟合和模型复杂度过高。

可以利用相关性分析、主成分分析、因子分析等方法进行变量选择,得到具有代表性和独立性的变量集合。

在选择自变量和因变量时,还需要考虑领域知识和实际问题,确保模型的可解释性和实用性。

3. 建立模型偏最小二乘回归模型是一种非参数回归模型,它可以处理多重共线性和高维数据的问题。

在建立偏最小二乘回归模型时,首先需要对数据进行中心化和标准化处理,使得变量具有相同的尺度和均值。

然后利用偏最小二乘法对数据进行降维和建模,得到回归系数和模型拟合优度等参数。

在建立模型时,需要进行交叉验证和模型诊断,评估模型的稳定性和预测性能。

4. 模型评估偏最小二乘回归模型的评估包括模型拟合度、预测效果和变量重要性等方面。

可以利用拟合优度指标(如R方、调整R方等)评估模型的拟合效果,判断模型是否能够解释自变量对因变量的变化。

预测效果可以通过交叉验证、留一法等方法评估模型的预测能力,验证模型在未知数据上的泛化能力。

变量重要性可以通过回归系数、变量重要性指标等方法评估自变量对因变量的影响程度,从而确定关键因素和影响因素。