典型判别分析与贝叶斯判别的区别

- 格式:doc

- 大小:87.50 KB

- 文档页数:4

判别分析判别分析是用以判别个体所属群体的一种统计方法。

最常用的判别方法:距离判别法、Bayes 判别法、Fisher 判别法。

1、距离判别法最为直观,其想法简单自然,就是计算新样品x 到各组的距离,然后将该样品判为离它距离最近的那一组。

定义:设组π的均值为μ,协方差矩阵为∑,x 是一个样品(样本),称()()μμπ-∑'-=-x x x d 1),(为x 到总体π的马氏距离或统计距离。

判别准则:不妨假设有k 组,记为k ππ...1,,均值分别为k μμ...1,,协方差矩阵分别为k ∑∑...,1,,若),(min ),(212i ki l x d x d ππ≤≤=,则判断x 来自第l 组。

注1:若k ∑==∑...1,上述准则可以化简,如果不确定是否相等,可两种情况都试试,那种规则误判概率小选哪种。

注2:实际中k μμ...1,以及k ∑∑...,1,均未知,用估计量代替。

2、Bayes 判别法(1)最大后验概率准则设有k 个组k ππ...1,,且组i π的概率密度为()x f i ,样品x 来自组i π的先验概率为,,...,1,k i p i =且.11=∑=ki i p 利用Bayes 理论,x 属于i π的后验概率(即当样品x 已知时,它属于i π的先验概率)为()().,...,2,1,)(1k i x f p x f p x P k j j j i i i ==∑=π最大后验概率法是采用如下的判别规则:()x P x P x l ji l l πππ≤≤=∈1max )(,若. (2)最小平均误判代价准则()()()()∑∑≠=≤≤≠==∈ki j j j j k i j k l j j j l j i c x f p j l c x f p x 111m i n ,若π,其中)(j i c 表示将来自j π的x 判为i π的代价。

例:设有321,,πππ三个组,欲判别某样品0x 属于何组,已知()()().4.2,63.0,10.0,30.0,65.0,05.0030201321======x f x f x f p p p 计算:()()004.04.230.063.065.010.005.010.005.0)(1111=⨯+⨯+⨯⨯==∑=k j j j x f p x f p x P π ()361.02=x P π()635.03=x P π假定误判代价矩阵为95.4110063.065.020010.005.0:305.36504.230.01010.005.0:239.51604.230.02063.065.0:1=⨯⨯+⨯⨯==⨯⨯+⨯⨯==⨯⨯+⨯⨯=l l l 3、Fisher 判别基本思想:先对原始数据进行降维,然后对新数据使用距离判别法进行判别。

贝叶斯统计与经典统计比较贝叶斯方法是由英国学者Bayes在其发表的论文《论有关的机遇问题的求解》中提出来的,并且在和经典学派的争论中发展起来。

经典统计在发展成熟的同时也逐渐暴露出了一些问题,而不少学者对两统计学派的比较研究中发现,相比于经典统计方法,贝叶斯统计方法在直观性、易于理解等很多方面更具有优势。

一、基本理论的差异1.概率的解释不同一直以来,经典统计学派对贝叶斯统计的主要批评在于贝叶斯统计在概率理解上的“主观性”。

经典统计学认为概率必须是“客观的”,这可以用大量重复试验之后的频率去解释,而不能主观臆断。

贝叶斯统计是完全同意概率公理化,但认为概率也可以用经验确定,一些事件的概率在大量重复试验中去获得是不现实的,而我们可以根据对此事件的了解和积累的经验做出此事件发生可能性的判断。

2.统计推断利用的信息不同贝叶斯统计与经典统计在统计推断最主要的不同在于贝叶斯统计运用先验信息。

经典统计学的统计推断是基于总体信息和样本信息。

总体信息即总体分布或总体所属分布族中包含的信息,包括总体认识、参数范围、变量的方式和特征等;样本信息是从总体中抽取的样本中所包含的信息,这是最“新鲜”的信息。

而贝叶斯统计方法在此基础上还利用了先验信息,先验信息主要来源于经验和历史资料。

3.样本和总体参数的利用与认识不同经典统计中把样本看作来自具有一定概率分布的总体,而总体中的参数是普通的未知变量;相反,贝叶斯统计把任何一个未知的参数都看作是随机变量,都有不确定性,用一个概率分布去描述这个未知的参数,在统计推断中只利用已经出现的数据,即样本信息,这就是贝叶斯统计中的“条件观点”,即只靠考已经出现的数据(样本观测值),而认为未出现的数据与推断无关。

基于在样本利用方式上的差异,使得贝叶斯统计不承认经典统计中的“无偏性”这一评判标准。

三、点估计与区间估计1.贝叶斯定理与似然函数贝叶斯定理是贝叶斯统计学的理论基础,贝叶斯公式的密度函数表示形式为:θ为模型的参数向量,x表示为数据向量,即样本观察值,其中,函数 p(x |θ)集中了总体信息和样本信息,被称为似然函数,它是未知参数θ的函数。

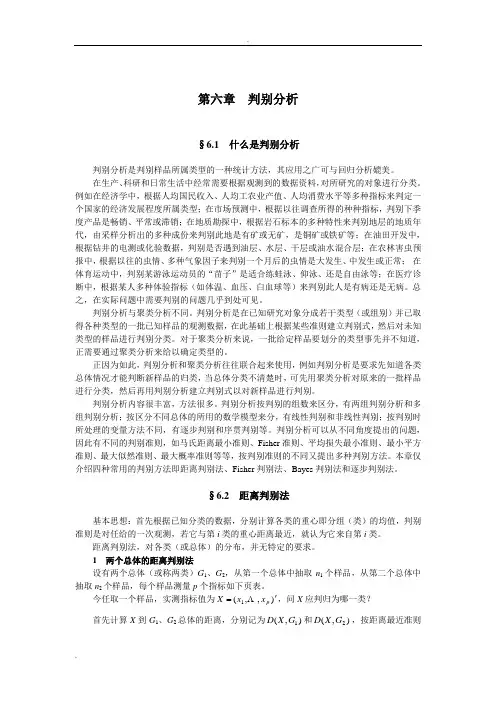

第六章 判别分析§6.1 什么是判别分析判别分析是判别样品所属类型的一种统计方法,其应用之广可与回归分析媲美。

在生产、科研和日常生活中经常需要根据观测到的数据资料,对所研究的对象进行分类。

例如在经济学中,根据人均国民收入、人均工农业产值、人均消费水平等多种指标来判定一个国家的经济发展程度所属类型;在市场预测中,根据以往调查所得的种种指标,判别下季度产品是畅销、平常或滞销;在地质勘探中,根据岩石标本的多种特性来判别地层的地质年代,由采样分析出的多种成份来判别此地是有矿或无矿,是铜矿或铁矿等;在油田开发中,根据钻井的电测或化验数据,判别是否遇到油层、水层、干层或油水混合层;在农林害虫预报中,根据以往的虫情、多种气象因子来判别一个月后的虫情是大发生、中发生或正常; 在体育运动中,判别某游泳运动员的“苗子”是适合练蛙泳、仰泳、还是自由泳等;在医疗诊断中,根据某人多种体验指标(如体温、血压、白血球等)来判别此人是有病还是无病。

总之,在实际问题中需要判别的问题几乎到处可见。

判别分析与聚类分析不同。

判别分析是在已知研究对象分成若干类型(或组别)并已取得各种类型的一批已知样品的观测数据,在此基础上根据某些准则建立判别式,然后对未知类型的样品进行判别分类。

对于聚类分析来说,一批给定样品要划分的类型事先并不知道,正需要通过聚类分析来给以确定类型的。

正因为如此,判别分析和聚类分析往往联合起来使用,例如判别分析是要求先知道各类总体情况才能判断新样品的归类,当总体分类不清楚时,可先用聚类分析对原来的一批样品进行分类,然后再用判别分析建立判别式以对新样品进行判别。

判别分析内容很丰富,方法很多。

判别分析按判别的组数来区分,有两组判别分析和多组判别分析;按区分不同总体的所用的数学模型来分,有线性判别和非线性判别;按判别时所处理的变量方法不同,有逐步判别和序贯判别等。

判别分析可以从不同角度提出的问题,因此有不同的判别准则,如马氏距离最小准则、Fisher 准则、平均损失最小准则、最小平方准则、最大似然准则、最大概率准则等等,按判别准则的不同又提出多种判别方法。

判别分析--费希尔判别、贝叶斯判别、距离判别判别分析⽐较理论⼀些来说,判别分析就是根据已掌握的每个类别若⼲样本的数据信息,总结出客观事物分类的规律性,建⽴判别公式和判别准则;在遇到新的样本点时,再根据已总结出来的判别公式和判别准则,来判断出该样本点所属的类别。

1 概述三⼤类主流的判别分析算法,分别为费希尔(Fisher)判别、贝叶斯(Bayes)判别和距离判别。

具体的,在费希尔判别中我们将主要讨论线性判别分析(Linear Discriminant Analysis,简称LDA)及其原理⼀般化后的衍⽣算法,即⼆次判别分析(Quadratic Discriminant Analysis,简称QDA);⽽在贝叶斯判别中将介绍朴素贝叶斯分类(Naive Bayesian Classification)算法;距离判别我们将介绍使⽤最为⼴泛的K最近邻(k-Nearest Neighbor,简称kNN)及有权重的K最近邻( Weighted k-Nearest Neighbor)算法。

1.1 费希尔判别费希尔判别的基本思想就是“投影”,即将⾼维空间的点向低维空间投影,从⽽简化问题进⾏处理。

投影⽅法之所以有效,是因为在原坐标系下,空间中的点可能很难被划分开,如下图中,当类别Ⅰ和类别Ⅱ中的样本点都投影⾄图中的“原坐标轴”后,出现了部分样本点的“影⼦”重合的情况,这样就⽆法将分属于这两个类别的样本点区别开来;⽽如果使⽤如图8-2中的“投影轴”进⾏投影,所得到的“影⼦”就可以被“类别划分线”明显地区分开来,也就是得到了我们想要的判别结果。

原坐标轴下判别投影轴下判别我们可以发现,费希尔判别最重要的就是选择出适当的投影轴,对该投影轴⽅向上的要求是:保证投影后,使每⼀类之内的投影值所形成的类内离差尽可能⼩,⽽不同类之间的投影值所形成的类间离差尽可能⼤,即在该空间中有最佳的可分离性,以此获得较⾼的判别效果。

对于线性判别,⼀般来说,可以先将样本点投影到⼀维空间,即直线上,若效果不明显,则可以考虑增加⼀个维度,即投影⾄⼆维空间中,依次类推。

《数据分析与SPSS软件应用》试卷(附参考答案)一、填空题(每空2分,共20分)1. 统计分析所使用的数据按照其测量精度,可以分为四种类型,分别是定性数据、定序数据、和。

2. SPSS中可以进行变量转换的命令有。

3. 多选项二分法是将设置为一个SPSS变量,而多选项分类法是将设置为SPSS变量。

4. 进行两独立样本群均值比较前,首先要验证的是。

5. 协方差分析中,对协变量的要求是数值型,多个协变量间互相独立和。

6. 多配对样本的柯克兰Q检验适用的数据类型为。

7. 衡量定距变量间的线性关系常用相关系数。

8.常用来刻画回归直线对数据拟合程度的检验统计量指标为。

二、选择题(每小题2分,共20分)1. 在SPSS中,以下哪种不属于SPSS的基本运行方式?()A 完全窗口菜单方式B 批处理命令方式C 程序运行方式D 混合运行方式2. 设置变量属性时,不属于SPSS提供的变量类型的是()A 数值型B 科学计数型C 分数型D 字符型3. 数据的描述统计分析结果显示偏度值为-1.3,则下列对数据分布状态说法正确的是()A 左偏B 正偏C 与正态分布一致D 可能存在极大值4. 若原假设与备择假设为:H0:μ1=μ2 H1:μ1≤μ2,则:()A 应使用右侧单尾检验B 应使用左侧单尾检验C 应使用双尾检验D 无法检验5. 下列哪个不是单因素方差分析的基本假定?()A 各总体的均值相等B 各总体相互独立C 样本来自于正态总体D 各总体的方差相等6. 两个配对样本的Wilcoxon符号秩检验所对应的参数检验方法是?()A 两个独立总体均值差的检验B 两个配对总体均值差的检验C 一个总体均值的检验D 单因素方差分析7. 皮尔逊简单相关系数为1,说明()A 两变量之间不存在线性相关关系B 两变量之间是负相关关系C 两变量之间存在完全的线性相关关系D 两变量之间具有高度相关性8.下列说法正确的是()A回归分析是以变量之间存在函数关系为前提的B回归分析是对具有相关关系的两个变量进行统计分析的一种常用方法C 回归分析中自变量个数只能为一个D 回归分析是反应确定性问题的统计分析方法9.以下关于聚类分析的叙述中错误的是()A 聚类分析的目的在于将事物按其特性分成几个聚类,使同一类内的事物具有高度相似性B 不同聚类的事物则具有高度的异质性C 对于衡量相似性,只能使用距离的工具D 建立聚类的方法,有层次聚类法和快速聚类法10. 关于因子分析,错误的说法是()A 适用于多变量、大样本B 原变量间不必要存在高度的相关性C定类和定序变量不适合做因子分析D 因子得分可以作为新变量存储在数据表格中三、判断题(每小题2分,共20分)1. SPSS中可将”.”用于变量命名,且”.”可以位于变量名末尾。

距离判别法、贝叶斯判别法和费歇尔判别法的比较分析距离判别法、贝叶斯判别法和费歇尔判别法是三种常见的判别方法,用于对数据进行分类和判别。

本文将对这三种方法进行比较分析,探讨它们的原理、特点和适用范围,以及各自的优势和局限性。

1. 距离判别法距离判别法是一种基于样本间距离的判别方法。

它的核心思想是通过计算待分类样本与各个已知类别样本之间的距离,将待分类样本归入距离最近的类别。

距离判别法常用的距离度量有欧氏距离、曼哈顿距离和马氏距离等。

优势:- 简单直观,易于理解和实现。

- 不依赖于概率模型,适用于各种类型的数据。

- 对异常值不敏感,具有较好的鲁棒性。

局限性:- 忽略了各个特征之间的相关性,仅考虑样本间的距离,可能导致分类效果不佳。

- 对数据的分布假设较强,对非线性分类问题表现较差。

- 对特征空间中的边界定义不明确。

2. 贝叶斯判别法贝叶斯判别法是一种基于贝叶斯理论的判别方法。

它通过建立样本的概率模型,计算待分类样本的后验概率,将其归入后验概率最大的类别。

贝叶斯判别法常用的模型包括朴素贝叶斯和高斯混合模型等。

优势:- 考虑了样本的先验概率和类条件概率,能够更准确地对样本进行分类。

- 可以灵活应用不同的概率模型,适用范围广。

- 在样本量不充足时,具有较好的鲁棒性和泛化能力。

局限性:- 对特征分布的假设较强,对非线性和非正态分布的数据表现较差。

- 需要估计大量的模型参数,对数据量要求较高。

- 对特征空间中的边界定义不明确。

3. 费歇尔判别法费歇尔判别法是一种基于特征选择的判别方法。

它通过选择能够最好地区分不同类别的特征,建立判别函数进行分类。

费歇尔判别法常用的特征选择准则有卡方检验、信息增益和互信息等。

优势:- 基于特征选择,能够提取最具有判别性的特征,减少了特征维度,提高了分类性能。

- 不对数据分布做假设,适用于各种类型的数据。

- 可以灵活选择不同的特征选择准则,满足不同的需求。

局限性:- 特征选择的结果可能受到特征相关性和重要性的影响,选择不准确会导致分类效果下降。

1.多元分析研究的是多个随机变量及其相互关系的统计总体。

2.多元统计中常用的统计量有:样本均值、样本方差、样本协方差和样本相关系数。

3.协方差和相关系数仅仅是变量间离散程度的一种度量,并不能刻画变量间可能存在的关联程度。

4.人们通过各种实践,发现变量之间的相互关系可以分成相关和不相关两种类型。

5.总离差平方和可以分解为回归离差平方和和剩余离差平方和两个部分,各自的自由度为p 和n-p-1,其中回归离差平方和在总离差平方和中所占比重越大,则线性回归效果越显著。

7.偏相关系数是指多元回归分析中,当其他变量固定后,给定的两个变量之间的的相关系数。

8.Spss中回归方程的建模方法有一元线形回归、多元线形回归、岭回归、多对多线形回归等。

9.主成分分析是通过适当的变量替换,使新变量成为原变量的综合变量,并寻求相关性的一种方法。

10.主成分分析的基本思想是:设法将原来众多具有一定相关性(比如P个指标),重新组合成一组新的互相无关的综合指标来代替原来的指标。

11.主成分的协方差矩阵为对角矩阵。

12.主成分表达式的系数向量是相关系数矩阵的特征向量。

13.原始变量协方差矩阵的特征根的统计含义是原始数据的相关系数。

14.原始数据经过标准化处理,转化为均值为0 ,方差为1 的标准值,且其协方差矩阵与相关系数矩阵相等。

15.样本主成分的总方差等于1 。

16.变量按相关程度为,在相关性很强程度下,主成分分析的效果较好。

17.在经济指标综合评价中,应用主成分分析法,则评价函数中的权数为方差贡献度。

19.因子分析是把每个原始变量分解为两部分因素,一部分是公共因子,另一部分为特殊因子。

20.变量共同度是指因子载荷矩阵中第i行元素的平方和。

21.公共因子方差与特殊因子方差之和为 1 。

22.聚类分析是建立一种分类方法,它将一批样哂或变量按照它们在性质上的亲疏程度进行科学的分类。

23.Q型聚类法是按样品进行聚类,R型聚类法是按变量进行聚类。

距离判别法、贝叶斯判别法和费歇尔判别法的异同引言在模式识别领域,判别分析是一种常用的方法,用于将数据样本划分到不同的类别中。

距离判别法、贝叶斯判别法和费歇尔判别法是判别分析中常见的三种方法。

本文将对这三种方法进行比较,探讨它们的异同。

一、距离判别法距离判别法是一种基于距离度量的判别分析方法。

它的基本思想是通过计算样本点与各个类别中心的距离,将样本划分到距离最近的类别中。

常见的距离判别法有欧氏距离判别法和马氏距离判别法。

1. 欧氏距离判别法欧氏距离判别法是一种简单直观的距离判别方法。

它通过计算样本点与各个类别中心之间的欧氏距离,将样本划分到距离最近的类别中。

算法步骤如下: 1. 计算各个类别的中心点,即各个类别样本点的均值向量。

2. 对于给定的待判样本点,计算其与各个类别中心点的欧氏距离。

3. 将待判样本点划分到距离最近的类别中。

2. 马氏距离判别法马氏距离判别法考虑了各个类别的协方差矩阵,相比于欧氏距离判别法更加准确。

它通过计算样本点与各个类别中心之间的马氏距离,将样本划分到距离最近的类别中。

算法步骤如下: 1. 计算各个类别的中心点,即各个类别样本点的均值向量。

2. 计算各个类别的协方差矩阵。

3. 对于给定的待判样本点,计算其与各个类别中心点之间的马氏距离。

4. 将待判样本点划分到距离最近的类别中。

二、贝叶斯判别法贝叶斯判别法是一种基于贝叶斯理论的判别分析方法。

它的基本思想是通过计算后验概率,将样本划分到具有最高后验概率的类别中。

常见的贝叶斯判别法有贝叶斯最小错误率判别法和贝叶斯线性判别法。

1. 贝叶斯最小错误率判别法贝叶斯最小错误率判别法是一种理论上最优的判别方法。

它通过计算后验概率,将样本划分到具有最高后验概率的类别中。

算法步骤如下: 1. 计算各个类别的先验概率。

2. 计算给定样本点在各个类别下的条件概率。

3. 计算给定样本点在各个类别下的后验概率。

4. 将待判样本点划分到具有最高后验概率的类别中。

典型判别分析与贝叶斯判别的区别1.原理不同典型判别是根据方差分析思想,进行投影,将原来一个维度空间的自变量组合投影到另一维度空间,寻找一个由原始变量组成的线性函数使得组间差异和组内差异的比值最大化。

根据样本点计算判别函数,计算判别函数到各类中心的欧式距离,取距离最小的类别。

贝叶斯判别是是利用已知的先验概率去推证将要发生的后验概率,就是计算每个样本的后验概率及其判错率,用最大后验概率来划分样本的分类并使得期望损失达到最小2.前提条件不同典型判别不考虑样本的具体分布,只求组间差异和组内差异的比值最大化贝叶斯判别从样本的多元分布出发,充分利用多元正态分布的概率密度提供的信息计算后验概率,因此需要样本数据服从多元正态分布,方差齐性等。

3.产生的判别函数不同典型判别根据K类最多产生K-1个判别函数贝叶斯判别根据K类最多可产生K个判别函数先验概率在判别分析中的作用1.所谓先验概率,就是用概率来描述人们事先对所研究的对象的认识的程度,是根据以往经验和分析得到的概率。

所谓后验概率,就是根据具体资料、先验概率、特定的判别规则所计算出来的概率。

它是对先验概率修正后的结果,它是更接近于实际情况的概率估计。

贝叶斯(BAYES)判别思想是根据先验概率求出后验概率,并依据后验概率分布作出统计推断2.样品的先验概率对预测有一定的作用,反应样本分布的总体趋向性。

被判断的个案应该属于先验概率最大总体的概率应该高一些,贝叶斯考虑了先验概率的影响提高判别的敏感度,同时利用先验概率可以求出后验概率(基于平均损失函数)和误判率,从而进行判别分析,充分利用数据的概率密度分布,判别效率高。

样品归于概率大的类别。

3.这样使误判平均损失最小。

既考虑到不同总体出现机会的差异、各错误判断造成损失的不同,又充分尊重了每个总体的分布状态判别准则的评价刀切法:基本思想是每次剔除训练样本中的一个样本,利用其余容量的训练样本建立判别函数,再用所建立的判别函数对删除的那个样本做判别,对训练样本中的每个样品重复上述步骤,已其误判的比例作为误判概率的估计。

数据分析知识:数据分析中的判别分析方法数据分析中的判别分析方法数据分析是计算机科学领域的一个重要分支,随着互联网和大数据时代的到来,数据分析得到了越来越广泛的应用。

判别分析方法是数据分析中的一种常见方法,本文将对判别分析方法做进一步的介绍和分析。

一、判别分析的概念和应用判别分析方法是指将数据按照某种标准分成不同的类别或群组,从而对事物进行认识、分析和判断的一种方法。

判别分析广泛应用于各个领域,如生物学、医学、社会科学等,尤其在人工智能、机器学习等领域,是一个热门话题。

判别分析法的最主要的目的是让我们可以用特定的方法,合理地对某些事物进行分类和判别。

例如,我们可以根据一些属性,对客户进行不同的分类,如购买能力、消费需求等。

二、判别分析的方法和步骤1.数据预处理数据预处理是判别分析的第一步,包括数据清理、数据集成、数据变换和数据规约等。

这一步的目的是去除数据中的异常或错误,减少冗余和重复信息,提高数据的质量和可靠性。

2.特征提取特征提取是指从原始数据中提取有价值的特征,用于判别分类。

例如,通过分析个人的收入、年龄、教育程度等属性,可以提取出客户群体的特征,从而进行分类和判别。

3.判别模型训练建立数据模型是判别分析的核心环节,通过训练模型,让计算机可以自动识别不同的数据类别,提高分类的准确性和效率。

4.模型评价和优化模型评价是指对判别模型进行评估和优化,以达到更好的分类效果。

常用的评价方法包括准确率、召回率和F1值等。

三、判别分析的模型和分类方法判别分析的模型包括贝叶斯判别分析(Bayesian Discriminant Analysis)、线性判别分析(Linear Discriminant Analysis)、二次判别分析(Quadratic Discriminant Analysis)等。

其中,贝叶斯判别分析是基于统计学原理的判别分析方法,可以通过先验概率和条件概率,对数据进行分类和判别。

贝叶斯模型是一种基于概率的模型,特别适用于大规模数据和高维数据的分类和判别。

判别分析及其应用判别分析研究方法是根据已知对象的某些观测指标和所属类别来判断未知对象所属类别的一种统计学方法。

与聚类分析有所不同的是:判别分析法首先需要对所研究对象进行分类,进一步选择若干对观测对象能够较全面地描述的变量,建立判别函数。

对一个未确定类别的个案只要将其代入判别函数就可以判断它属于哪一类总体。

星系团成员星系和星团成员星的确定,变星与非变星的界定都会用到相关的数据分析方法。

判别分析除了应用于确定样本所属分类外,还可用来检验由其他分类方法得到的分类系统的分类效果,并纠正错分的个体,也可以确定样品各个参量的判别能力。

1、判别分析的基本原理判别分析的问题可以这样来描述。

已知n个总体,其分布函数分别为:F (x), F (x), F (x),…F (x)每一个总体都是一个p维函数。

对于给定的样品x,我们应通过判别函数(判别准则),来决定该样品应属于这n个总体中的哪一个总体。

2、判别函数教育过程中,我们往往要对各种教育数据进行分类。

例如,对学生的成绩分类、对学生的能力分类、对教师的教学水平分类等等。

对于每一位学生的数据,对于每一位教师的数据,应如何决定它所属的类别,这是一种判别问题。

为了决定某一样品所属的类别,其实质是决定判别函数。

根据样品给定的多变量数据,由判别函数来决定该样品所属的类别,即样品的类别是属于样品的多变量数据,其类别是由判别函数所决定的。

设某班的学生经过八门课的考试,现需要根据考试的结果对学生的学习情况进行分类。

根据学生的开始成绩,可将学生分为四类:优秀(A)、良好(B)、及格(C)、不及格(D)。

为了决定每一位学生的成绩类别,拟以八门课的平均成绩为准,且按:进行分类。

上式即为一判别函数,代入任何一个样本即可得到样本所属分类。

3、判别分析与聚类分析判别分析与聚类分析都要求对样本进行分类,但二者的分析内容和要求是不一样的。

聚类分析是给定了一定数量的样品,但这些样品应该划分成怎样的类别还不清楚,需要通过聚类分析来决定。

贝叶斯统计与经典统计的区别摘要:21世纪,贝叶斯统计打破经典统计独树一帜的局面,已经开始应用到各个领域,但是两个学派存在着很多争论。

本文从经典统计和贝叶斯统计在基础理论方面是否利用先验信息,在基本性质方面是否把参数当做随机变量、是否重视未出现的样本信息、对概率的理解的不同以及在点估计、区间估计等方面等来分析它们的区别,并比较分析了他们在统计推断中的优缺点。

关键词:贝叶斯统计,经典统计,先验信息,点估计,区间估计,假设检验一、贝叶斯统计和经典统计基本理论的区别统计推断所依据的信息不同:经典统计,即基于总体信息、样本信息所进行的统计推断。

它的基本观点是:把数据看成是来自具有一定概率分布的总体,所研究的对象是这个总体而不局限于数据本身。

而贝叶斯统计是基于总体信息、样本信息、先验信息进行的统计推断。

它最基本的观点是:任一个未知量?%a 都可以看做是一个随机变量,应用一个概率分布去描述对 ?%a的未知状况。

这个概率分布是在抽样前就有的关于?%a的先验信息的概率陈述。

经典统计和贝叶斯统计最主要的区别就是在于是否利用了先验信息。

贝叶斯推断是基于总体信息、样本信息、先验信息,而经典统计推断只依赖于总体信息和样本信息。

二、贝叶斯统计和经典统计的基本性质不同:1.对概率的理解不同经典统计学派认为经典统计学是用大量实验来确定概率、是”客观的”、是符合科学要求的,认为贝叶斯统计的确定的概率是”主观的”,因此至多只对个人决策有用。

贝叶斯学派认为引入主观概率及由此确定的先验分布,首先至少可以把概率与数理统计的研究与应用的范围扩大到大量不能重复的随机现象中来,其次,主观概率的确定也不是随意的,而是要求当事人对所考查的时间有比较透彻的了解,甚至是这一行的专家,在这个基础上确定的主观概率就能符合实际。

2.使用样本信息上也有差异贝叶斯学派重视已出现的样本观察值,而对尚未发生的样本观察值不予考虑,贝叶斯学派很重视先验信息的收集、挖掘和加工,使它数量化,形成先验分布,参加到统计推断中来,以提高统计推断的质量。

典型判别分析与贝叶斯判别的区别

1.原理不同

典型判别是根据方差分析思想,进行投影,将原来一个维度空间的自变量组合投影到另一维度空间,寻找一个由原始变量组成的线性函数使得组间差异和组内差异的比值最大化。

根据样本点计算判别函数,计算判别函数到各类中心的欧式距离,取距离最小的类别。

贝叶斯判别是是利用已知的先验概率去推证将要发生的后验概率,就是计算每个样本的后验概率及其判错率,用最大后验概率来划分样本的分类并使得期望损失达到最小

2.前提条件不同

典型判别不考虑样本的具体分布,只求组间差异和组内差异的比值最大化

贝叶斯判别从样本的多元分布出发,充分利用多元正态分布的概率密度提供的信息计算后验概率,因此需要样本数据服从多元正态分布,方差齐性等。

3.产生的判别函数不同

典型判别根据K类最多产生K-1个判别函数

贝叶斯判别根据K类最多可产生K个判别函数

先验概率在判别分析中的作用

1.所谓先验概率,就是用概率来描述人们事先对所研究的对象的认识的程度,是根据以往经验和分析得到的概率。

所谓后验概率,就是根据具体资料、先验概率、特定的判别规则所计算出来的概率。

它是对先验概率修正后的结果,它是更接近于实际情况的概率估计。

贝叶斯(BAYES)判别思想是根据先验概率求出后验概率,并依据后验概率分布作出统计推断

2.样品的先验概率对预测有一定的作用,反应样本分布的总体趋向性。

被判断的个案应该属于先验概率最大总体的概率应该高一些,贝叶斯考虑了先验概率的影响提高判别的敏感度,同时利用先验概率可以求出后验概率(基于平均损失函数)和误判率,从而进行判别分析,充分利用数据的概率密度分布,判别效率高。

样品归于概率大的类别。

3.这样使误判平均损失最小。

既考虑到不同总体出现机会的差异、各错误判断造成损失的不同,又充分尊重了每个总体的分布状态

判别准则的评价

刀切法:基本思想是每次剔除训练样本中的一个样本,利用其余容量的训练样本建立判别函数,再用所建立的判别函数对删除的那个样本做判别,对训练样本中的每个样品重复上述步骤,已其误判的比例作为误判概率的估计。

判别分析结果

Eigenvalues

a First 2 canonical discriminant functions were used in the analysis.

1.判别函数的特征根,方差百分比,累计方差百分比

本例中提取了两个判别函数,绝大多数信息在第一个判别函数上。

Wilks' Lambda

2.对判别函数的显著性检验,第一步是两个函数的总体检验,是有意义的,说明第一个函数肯定有意义,然后对第二个函数进行检验,发现没有意义

Standardized Canonical Discriminant Function Coefficients

3.标准化典型判别函数系数表f=0.367zx1+0.573zx2+0.667zx3+0.349zx4,判别函数方程的标

准化系数就是判别权重,可以确定各变量对结果的作用大小,可以看出x3对y的影响最大,自变量的重要性:X3>X2>X1>X4

Structure Matri

Function

1 2

x3 .659(*) .278

x1 .205(*) .166

x2 .659 -.710(*)

x4 .307 .460(*)

4.典型判别得分与自变量之间的相关系数,可以看出第一判别函数主要与x3,x1相关,另

外两个与第二判别函数相关,自变量对第一判别函数的贡献:

Canonical Discriminant Function Coefficients

x3 .178 .157

x4 .036 .054

(Constant) -8.246 5.165

Unstandardized coefficients

5. 原始变量的典型判别函数,式中有常数项

F1=0.007x1+0.039x2+0.178x3+0.036x4-8.246

Functions at Group Centroids

Unstandardized canonical discriminant functions evaluated at group means 6. 典型判别函数在各组的重心,各组判别得分的均值向量。

Classification Processing Summary

Processed 15

Excluded Missing or out-of-range

group codes

At least one missing

discriminating variable

Used in Output 15

1. 分类处理综合表

各类的先验概率表

Classification Function Coefficients

Fisher's linear discriminant functions

分类函数系数表,即贝叶斯判别函数

产生3个分类函数

Z1=-72.581+0.122x1+0.751x2+0.711x3+0.126x4,同理得到Z2,Z3,将新的样本值代入计算Z1,Z2,Z3,最大的为样本的分类

刀切考核中输出每个例子,是针对贝叶斯函数的。