7估计的优良性标准

- 格式:pdf

- 大小:82.87 KB

- 文档页数:1

估计量优良性的若干判别准则作者 李晓辉 指导老师 胡学平摘要 未知参数的估计通常有很多种,一个好的估计量应该在多次观测中,其观测值围绕被估计参数的真值摆动.为正确评价估计量,要建立判别估计量好坏的标准.本文主要总结估计量优良性的若干判别准则,如无偏性、有效性、一致性等。

通过本文的研究,进一步了解了估计量优良性的一些判别准则,为今后学习打下了基础。

关键词 无偏性 一致性 有效性 一致最小方差无偏估计 均方误差1 引言对于估计量优良性的研究,国内外更多的是将其依托于一个具体的实验或具体的实际问题中去进行比较研究,如在1982年《数学杂志》中,刘学圃写了一篇名为《一类平稳时间序列谱密估计量的优良性质》文章,又如在《统计与信息论坛》中,写了一篇《系统样本差估计量的优良性》,所以说对其的研究更多的是依据于是研究中,通过其试验来体现一个估计量的优良性.当然,单纯对于优良性的研究国内有一篇很是经典的文章—王力宾的《对估计量优劣性评价标准的研究》,他在此文中比较详细地介绍了若干判别准则,大致上分为两类:一类是小样本估计量优良性的若干判别准则,另一类是大样本估计量优良性的判别准则。

他也同样在文中详细地叙述了两类之间的联系.其实,一直以来,我国的统计工作者,一直都是把无偏性,有效性,一致性看作是评价估计量优良性的三大标准,但对于其实用性并未进行过较为系统的研究.评价一个估计量的好坏,不能仅仅依据一次试验的结果,而必须由多次试验的结果来衡量.这是因为估计量是样本的函数,是随机变量。

由不同的观测结果,就会求得不同的参数估计值.因此一个好的估计,应在多次试验中体现出优良性.对于一个特定的应用,选择好的估计量与许多因素有关系,最基本的考虑因素就是选择一个好的数据模型,它的复杂性应该足以描述数据的基本特征,但是与此同时要简单的足以允许估计量是最佳的且易于实现.举个简单的例子,对于信号的处理问题,选择一个合适的估计量要从易于现实的最佳估计量开始.如果这种寻找没有效果,那么就应该考察准最佳估计量.对于同一参数,用不同的估计法得到的点估计量不一定相同,那么用哪一种估计法好呢?并且,人们总是希望估计量能代替真实参数.为正确评价估计量,要建立判别估计量好坏的标准.根据不同的要求,评价估计量可以有各种各样的标准.所以,对于一个估计量的优良性进行判别显得尤为重要.对于估计量优良性若干判别准则的研究,为了以后我们进一步的学习和工作都奠定了良好的基础.2 判别优良性的准则 2.1 估计量的无偏性 2.1.1无偏估计量的定义及定理定义 设()n,ξ,,ξξT θ 21ˆ=是未知参数θ的一个估计量,若 ()Θθθ, θE ∈∀=ˆ则称()n,ξ,,ξξT θ 21ˆ=为θ的无偏估计量. 在这里我们要接触一个新的名词:统计量,到底什么是统计量,下面我们来简单介绍一下统计量的定义.统计量 是统计理论中用来对数据进行分析、检验的变量。

估计的优良性同一个未知参数的估计量有很多种,即使是使用最大似然估计,样本量不一样。

估计量也不相同,什么样的估计量最好呢?这就涉及到估计量的优良性标准。

从直观上看,自然是估计量被估计的量越接近越好。

但“接近”二字含义不很简单,有深入研究的必要。

设X 的密度函数(,)f x θ,其中()12,,,,m θθθθ=∈ΘΘL 是R m 中的非空集合。

设()g θ是θ的函数,X 1,X 2,…,X n 是X的样本。

所谓()g θ的估计量,是指样本的函数()1,,n X X ϕL 。

ϕ的不同选择就得到不同的估计量。

直观上看,()()1,,n X X g ϕθ−L 越小,ϕ就越好,但是()1,,n X X ϕL 的值是依赖于样本的,它本身是随机变量,而()g θ是未知的,所以评价估计量的优劣不很简单,需要衡量优良性的标准,当然这种标准不是唯一的,从不同角度出发可提出不同的标准。

定义2.1 设()g θ的估计量()1,,n X X ϕL 满足:对一切估计量()1,,n X X ψL 有 ()()M M θθϕψ≤(一切θ)则称ϕ是()g θ的最小均方误差估计。

定义 2.2 设()1,,n X X ϕL 是()g θ的无偏估计,且对一切无偏估计()1,,n X X ψL 均有()()M M θθϕψ≤(一切θ),则称ϕ是()g θ的(一致)最小方差无偏估计。

“最小方差无偏估计”就是一种最优的估计量,可惜它有时并不存在。

有时无偏性标准显得不合理(参看后面的例子)。

还有别的优良性标准,如贝叶斯标准,minimax 标准等等,这里不介绍了(参看第七章)。

怎样得到(一致)最小方差无偏估计呢?这不是容易的事,需要具体问题具体分析,没有一个普遍适用的公式。

但在50年代形成的Blackwell-Lehmann-Scheffe 理论对于寻求最小方差无偏估计 有重要的指导作用。

这个理论的严密论述涉及到测试论等较深的数学工具,这里只从方法的角度作一粗浅介绍,为此称介绍有广泛重要意义的概念——充分统计量。

优良估计量的标准在统计学中,估计量是指用样本数据来估计总体参数的量。

而优良的估计量则是指能够准确、稳定地估计总体参数的估计量。

那么,什么样的估计量才能被称为优良估计量呢?本文将从无偏性、有效性、一致性三个方面来探讨优良估计量的标准。

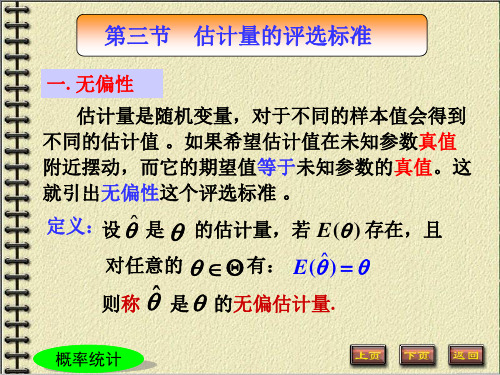

首先,一个优良的估计量应该是无偏的。

无偏性是指在重复抽样的情况下,估计量的期望值等于总体参数的真值。

换句话说,无偏估计量不会偏离总体参数的真实值。

如果一个估计量是有偏的,那么它的期望值将不等于总体参数的真值,因此无法成为优良的估计量。

因此,无偏性是衡量估计量优良程度的重要标准之一。

其次,一个优良的估计量应该是有效的。

有效性是指估计量的方差越小越好。

换句话说,对于两个估计量来说,如果它们都是无偏的,但其中一个的方差更小,那么我们就说这个估计量比另一个更有效。

因为方差小意味着估计值更加稳定,更接近总体参数的真实值。

因此,一个优良的估计量应该具有较小的方差,以提高估计的准确性和稳定性。

最后,一个优良的估计量应该是一致的。

一致性是指当样本容量逐渐增大时,估计量趋向于总体参数的性质。

换句话说,无论样本容量大小如何,估计量都能够稳定地接近总体参数的真实值。

如果一个估计量不是一致的,那么在样本容量增大时,估计值可能会偏离总体参数的真实值,从而无法成为一个优良的估计量。

综上所述,一个优良的估计量应该具有无偏性、有效性和一致性三个标准。

只有同时满足这三个标准的估计量,才能被称为优良的估计量。

在实际应用中,我们需要根据具体的问题和数据特点来选择合适的估计量,以确保我们能够准确地估计总体参数。

希望本文能够帮助读者更好地理解优良估计量的标准,并在实践中运用这些标准进行统计推断。

估计的优良性

同一个未知参数的估计量有很多种,即使是使用最大似然估计,样本量不一样。

估计量也不相同,什么样的估计量最好呢?这就涉及到估计量的优良性标准。

从直观上看,自然是估计量被估计的量越接近越好。

但“接近”二字含义不很简单,有深入研究的必要。

设X 的密度函数(,)f x θ,其中()12,,,,m θθθθ=∈ΘΘL 是R m 中的非空集合。

设()g θ是θ的函数,X 1,X 2,…,X n 是X的样本。

所谓()g θ的估计量,是指样本的

函数()1,,n X X ϕL 。

ϕ的不同选择就得到不同的估计量。

直观上看,

()()1,,n X X g ϕθ−L 越小,ϕ就越好,但是()1,,n X X ϕL 的值是依赖于样本的,它本身是随机变量,而()g θ是未知的,所以评价估计量的优劣不很简单,需要衡量优良性的标准,当然这种标准不是唯一的,从不同角度出发可提出不同的标准。

定义2.1 设()g θ的估计量()1,,n X X ϕL 满足:对一切估计量()1,,n X X ψL 有 ()()M M θθϕψ≤(一切θ)

则称ϕ是()g θ的最小均方误差估计。

定义 2.2 设()1,,n X X ϕL 是()g θ的无偏估计,且对一切无偏估计()1,,n X X ψL 均有()()M M θθϕψ≤(一切θ),则称ϕ是()g θ的(一致)最小方差无偏估计。

“最小方差无偏估计”就是一种最优的估计量,可惜它有时并不存在。

有时无偏性标准显得不合理(参看后面的例子)。

还有别的优良性标准,如贝叶斯标准,minimax 标准等等,这里不介绍了(参看第七章)。

怎样得到(一致)最小方差无偏估计呢?这不是容易的事,需要具体问题具体分析,没有一个普遍适用的公式。

但在50年代形成的Blackwell-Lehmann-Scheffe 理论对于寻求最小方差无偏估计 有重要的指导作用。

这个理论的严密论述涉及到测试论等较深的数学工具,这里只从方法的角度作一粗浅介绍,为此称介绍有广泛重要意义的概念——充分统计量。