SLAM

- 格式:pdf

- 大小:446.26 KB

- 文档页数:3

SLAM(Simultaneous Localization and Mapping)即同时定位与地图构建,它是指在未知环境中,通过移动机器人进行感知和运动控制,实现机器人自身位置的估计和地图的构建。

SLAM问题可以用一组运动方程和观测方程来描述。

下面是常见的基于激光雷达的2D SLAM的运动方程和观测方程:

1. 运动方程:

- 里程计运动模型:通常使用简化的运动模型(如平移运动模型或增量式旋转运动模型),将机器人的运动表示为里程计度量值。

具体形式如下:

x_t = x_{t-1} + delta_x

y_t = y_{t-1} + delta_y

theta_t = theta_{t-1} + delta_theta

2. 观测方程:

- 激光雷达观测模型:通过激光雷达测量环境中的障碍物,可以获得一系列距离和角度观测值。

观测模型将这些观测值映射到机器人坐标系或世界坐标系中,以获得障碍物在地图中的位置信息。

具体形式如下:

z_t = h(x_t) + epsilon

在上述方程中,x_t、y_t和theta_t分别表示机器人在时间t的位置和姿态(方向),delta_x、delta_y和delta_theta表示机器人的增量运动,z_t表示激光雷达的观测值,

h(x_t)表示观测模型将机器人位置映射到地图坐标系中的函数,epsilon表示观测误差。

需要注意的是,SLAM问题是一个非线性的问题,通常需要使用滤波器(如扩展卡尔曼滤波器或粒子滤波器)来进行状态估计和地图构建。

在实际应用中,还可能根据具体情况引入其他传感器数据和环境模型,以提高定位和地图构建的精度与鲁棒性。

slam方案随着人工智能技术的迅猛发展,同步定位与地图构建(Simultaneous Localization and Mapping, SLAM)成为了当今研究的热点之一。

SLAM是指在未知环境中,通过一种自主构建地图的方法,同时实现机器人的定位,从而使机器人能够在未知环境中进行导航和路径规划。

本文将介绍SLAM方案的原理、应用以及其在实际场景中的挑战。

一、SLAM原理SLAM方案的核心原理是利用传感器获取环境信息,并结合机器人运动信息进行建图和定位。

具体来说,SLAM方案通常会使用激光雷达、相机、惯性测量单元(IMU)等传感器来获取环境信息和机器人的运动信息。

通过不断地采集传感器数据,SLAM方案可以根据机器人的移动轨迹和传感器数据估计机器人的位置,并构建出当前环境的地图。

SLAM方案的核心思想是建立一个由特征点或网格表示的地图。

在运动过程中,机器人根据传感器获取的新数据与已知的地图进行比对,通过最小化地图与实际观测之间的误差,更新地图的信息,并获得机器人的准确定位。

通过不断地迭代这个过程,SLAM方案可以实现高精度的定位和地图构建。

二、SLAM应用SLAM方案在许多领域都有重要应用,特别是在自动驾驶、无人机和机器人领域。

以下是SLAM方案应用的几个典型案例:1. 自动驾驶:自动驾驶汽车需要准确的定位和地图信息才能进行路径规划和导航。

SLAM方案可以通过激光雷达和相机等传感器获取车辆周围环境的信息,并实时更新地图和定位信息,为自动驾驶汽车提供精准的导航和避障能力。

2. 无人机导航:无人机需要在无人机导航系统中实时获取环境信息和定位信息,以进行精确的飞行控制。

SLAM方案可以将无人机配备的传感器数据与地面地图进行融合,实现无人机在未知环境中的自主飞行和避障。

3. 机器人路径规划:SLAM方案可以帮助机器人实现在未知环境中的路径规划。

机器人可以通过激光雷达和相机等传感器获取环境信息,实时更新地图和定位信息,并根据地图信息规划最优路径,实现自主导航和完成指定任务。

slam精度测评指标SLAM(Simultaneous Localization and Mapping)技术是机器人、自动驾驶和增强现实等领域中的重要技术之一。

在实际应用中,SLAM 的精度直接影响着应用效果和用户体验。

因此,对SLAM的精度进行测评是非常必要的。

SLAM的精度测评指标主要包括以下几个方面:1. 位姿精度:即机器人在空间中的位置和姿态的精度。

在测评中,通常使用平均欧式误差(Mean Euclidean Error)和平均角度误差(Mean Angular Error)来衡量位姿精度,这些指标的数值越小,表示机器人在空间中的定位和姿态越准确。

2. 地图精度:即构建出的环境地图的精度。

对于二维SLAM,通常使用地图准确程度(Map Accuracy)和覆盖率(Map Coverage)来评估地图的精度;对于三维SLAM,通常使用点云密度(Point Cloud Density)和准确程度(Map Accuracy)来评估地图的精度。

3. 实时性:即SLAM系统在实时运行过程中的响应速度。

在测评中,通常使用帧率(Frame Rate)和处理时间(Processing Time)来评估实时性,这些指标的数值越高,表示SLAM系统的实时性越强。

4. 鲁棒性:即SLAM系统在面对各种异常情况(如光照变化、遮挡和传感器故障等)时的性能表现。

在测评中,通常使用错误率(Error Rate)和失败次数(Failure Number)来评估鲁棒性,这些指标的数值越低,表示SLAM系统的鲁棒性越好。

5. 可扩展性:即SLAM系统对于加入新传感器或新功能的适应能力。

在测评中,通常使用拓展性(Extensibility)和可移植性(Portability)来评估可扩展性,这些指标的数值越高,表示SLAM系统的可扩展性越强。

综合以上指标,可以建立一个完整的SLAM精度测评体系。

当然,不同的应用场景可能会偏重某些指标,比如自动驾驶场景可能更关注位姿精度和实时性,而增强现实场景可能更关注地图精度和鲁棒性。

slam重定位方法Slam重定位方法1. 简介随着自主导航机器人和增强现实技术的发展,SLAM (Simultaneous Localization and Mapping)重定位方法变得越来越重要。

SLAM重定位旨在通过机器视觉和激光扫描等传感器数据,实现机器人在未知环境中的定位和地图构建。

2. SLAM重定位方法的分类类别一:基于特征点的方法基于特征点的SLAM重定位方法主要通过提取场景中的关键特征点,并与先前记录的地图进行匹配。

以下是几种常见的方法:•传统关键点匹配方法:根据特征描述子的相似度进行匹配,常用的算法包括SIFT、SURF和ORB等。

•基于BoW(Bag of Words)的方法:将特征描述子表示为词包,通过匹配词包的相似性来确定位姿。

•基于直方图的方法:以特征点的分布直方图为特征,通过直方图相似性度量进行匹配。

类别二:基于深度学习的方法近年来,深度学习技术的兴起为SLAM重定位带来了新的方法。

以下是几种基于深度学习的SLAM重定位方法:•基于深度神经网络的方法:利用卷积神经网络(CNN)或循环神经网络(RNN)等深度学习模型,直接从图像中学习定位和地图结构。

•基于生成对抗网络(GAN)的方法:通过对抗训练,生成逼真的场景图像,并与实际场景进行匹配。

•基于自编码器的方法:通过自编码器学习图像特征表示,实现定位匹配。

类别三:基于图优化的方法基于图优化的SLAM重定位方法将传感器数据抽象为图的节点和边,通过最小化误差函数,优化机器人位姿和地图模型。

以下是几种常见的方法:•基于最小二乘法的方法:利用最小二乘法建立误差模型,通过迭代优化参数,实现精确的位姿估计和地图构建。

•基于因子图的方法:将SLAM问题建模为因子图,在因子图上进行消息传递和推理,优化机器人位姿和地图拓扑结构。

•基于非线性优化的方法:利用非线性优化算法,如高斯牛顿法或Levenberg-Marquardt算法,解决SLAM重定位问题。

slam 重定位成功标准

SLAM(Simultaneous Localization and Mapping)重定位成功的标准有多种,具体的标准会因所使用的算法和场景而有所不同。

以下是一些常见的重定位成功标准:

1. 定位精度:重定位后得到的位姿与实际位姿之间的误差是否在可接受的范围内。

通常会设定一个阈值,如果误差小于该阈值,则认为重定位成功。

2. 地图匹配:重定位后的地图是否与之前的地图匹配。

如果匹配,则认为重定位成功。

3. 关键帧匹配:在SLAM中,关键帧是用于描述场景的重要帧。

重定位后,关键帧是否与之前的关键帧匹配。

如果匹配,则认为重定位成功。

4. 特征匹配:通过特征点进行位姿估计和地图构建。

重定位后,特征点是否与之前的特征点匹配。

如果匹配,则认为重定位成功。

5. 回环检测:一种特殊类型的重定位,用于检测是否回到了之前访问过的位置。

如果成功检测到回环,则认为重定位成功。

需要注意的是,这些标准并不是互相独立的,它们可能会相互影响。

在实际应用中,通常会综合考虑这些标准来判断重定位是否成功。

SLAM算法引言。

SLAM(Simultaneous Localization and Mapping)算法是一种用于同时定位和建图的技术,它在无人驾驶、机器人导航和增强现实等领域有着广泛的应用。

随着计算机视觉和机器学习技术的不断发展,SLAM算法也在不断演进和改进。

本文将从传统的SLAM算法出发,介绍其基本原理和发展历程,然后探讨现代SLAM算法的发展趋势和应用前景。

传统SLAM算法。

传统的SLAM算法主要基于激光雷达、摄像头和惯性测量单元等传感器数据,通过特征点提取、匹配和优化等步骤来实现地图构建和定位。

其中,基于激光雷达的SLAM算法通常采用粒子滤波、扩展卡尔曼滤波或图优化等方法来实现定位和建图,而基于视觉的SLAM算法则主要依赖于特征点的跟踪和三维重建来实现定位和建图。

传统SLAM算法在实际应用中取得了一定的成果,但也存在着数据处理复杂、实时性差和鲁棒性不足等问题。

现代SLAM算法。

随着深度学习和神经网络技术的兴起,现代SLAM算法开始引入深度学习模型来提高地图构建和定位的精度和鲁棒性。

例如,基于深度学习的SLAM算法可以利用卷积神经网络来提取特征点和描述子,使用循环神经网络来实现时序信息的建模,或者通过生成对抗网络来实现地图的增量更新和修正。

这些技术的引入使得SLAM算法在复杂环境下的定位和建图能力得到了显著提升,同时也为SLAM算法的实时性和鲁棒性带来了新的可能性。

SLAM算法的发展趋势。

未来,随着传感器技术的不断进步和计算能力的提升,SLAM算法将迎来更加广阔的发展空间。

一方面,基于多传感器融合的SLAM算法将成为发展的重点,不仅可以利用激光雷达、摄像头和惯性测量单元等传感器数据,还可以引入声纳、毫米波雷达和超宽带等传感器数据,从而实现对复杂环境的更加准确的定位和建图。

另一方面,基于深度学习和神经网络的SLAM算法将继续发展,不仅可以利用现有的深度学习模型来提高定位和建图的精度和鲁棒性,还可以进一步探索新的深度学习模型和算法,以应对更加复杂和动态的环境。

slam方法框架 随着机器人技术的发展,同时也伴随着对环境感知和定位的需求不断增加。

SLAM (Simultaneous Localization and Mapping,即同时定位与地图构建)作为一种解决机器人定位和地图构建问题的集成方法,已被广泛应用于机器人系统中。

本文将详细介绍SLAM的方法框架,包括传感器、定位、地图构建和优化等步骤,旨在帮助读者全面了解SLAM方法的实现过程。

一、传感器选择: SLAM方法的第一步是选择合适的传感器。

传感器的选择取决于具体应用场景和需求。

常见的传感器包括激光器、摄像头、惯性测量单元(IMU)等。

激光器具有较高的测量精度,可以提供距离和角度信息。

摄像头可以获取图像信息,通过图像处理算法提取特征点用于定位和地图构建。

IMU用于测量机器人的加速度和角速度等信息。

根据实际需求,选择合适的传感器组合。

定位是SLAM方法的核心步骤之一。

机器人通过对自身位置的估计,能够确定其在地图中的位置,从而实现对环境的感知和导航。

常见的定位算法有激光定位算法、视觉定位算法和惯性导航算法等。

激光定位算法通过激光雷达扫描环境,利用地图和传感器数据进行位置匹配;视觉定位算法通过摄像头获取图像信息,然后与已知的地标进行匹配;惯性导航算法通过IMU获取机器人的加速度和角速度信息,通过积分计算机器人的位姿。

根据应用场景和实际需求,选择合适的定位算法。

三、地图构建: 地图构建是SLAM方法的另一个核心步骤。

通过将机器人在运动过程中获取的环境信息进行融合,可以构建出精确的地图,为机器人的感知和导航提供基础。

常见的地图构建算法有基于激光数据的栅格地图构建算法、基于视觉信息的稠密地图构建算法和基于稀疏地图的建图算法等。

栅格地图构建算法将环境划分成网格,利用激光数据进行地图构建;稠密地图构建算法通过图像处理算法对图像进行特征提取和匹配,然后恢复出稠密地图;稀疏地图构建算法利用传感器数据,将环境信息以稀疏的方式储存。

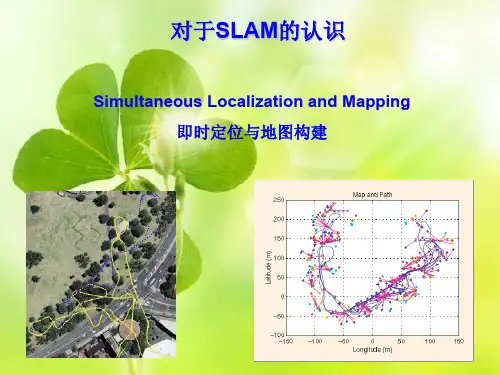

slam算法原理SLAM(Simultaneous Localization and Mapping)算法是机器人领域中比较重要的技术之一,它可以实时地构建场景的三维地图,并同时确定机器人在场景中的位置并做出相应的移动,即在不需要外界任何其他信息的情况下,完成自主导航的任务。

SLAM算法是机器人自主导航中最关键的部分之一,主要涉及到机器人的定位和地图创建。

SLAM算法的主要目的是通过对机器人感知的传感数据进行处理,实时地构建机器人所在环境的地图,同时用地图来确定机器人的位置。

这一过程需要利用机器人自身的传感器来获取环境和位置的信息,从而实现机器人的智能化运动和精准导航。

SLAM算法的核心是实现机器人运动轨迹和感知数据的融合。

在SLAM算法中,机器人使用激光雷达等传感器来获取周围环境的信息。

通过这些传感器获取的环境信息,可以构建环境的三维地图。

在构建地图的同时,SLAM算法需要确定机器人的位置以及机器人运动轨迹,这样才能建立出一张准确的地图。

SLAM算法主要包括两个部分:前端算法和后端算法。

前端算法主要研究如何通过机器人传感器感知到的数据,提取出环境信息,并且根据这些信息构建环境地图。

这一过程包括传感器数据的处理,地图数据的存储,环境信息的展示等。

后端算法主要研究如何根据机器人运动轨迹和感知数据来优化地图的精度和更新速度。

它包括对环境地图的建模,建图过程中的误差分析和校正以及实时地更新地图。

SLAM算法还需要考虑机器人自身的定位问题。

定位问题可以分为绝对定位和相对定位两种。

绝对定位是指确定机器人在全局坐标系中的位置,在机器人刚开始运动或运动过程中出现较大误差时,需要使用绝对定位来确定机器人在全局坐标系中的位置。

相对定位是指在机器人已经有一定的地图信息时,通过对机器人的运动轨迹进行分析,确定机器人在地图中的相对位置。

在实际应用中,常使用的SLAM算法有基于视觉的单目SLAM算法、基于激光雷达的2D和3DSLAM算法以及基于深度学习的SLAM算法等。

SLAM方案1. 引言SLAM(Simultaneous Localization and Mapping)是一种常用的机器人导航技术,它能够在未知环境中同时进行定位和地图构建。

SLAM方案是指实现SLAM技术的具体方案和实现方法。

本文将介绍一种基于激光雷达的SLAM方案,包括其原理、算法和应用。

2. 原理SLAM方案的原理是通过机器人上搭载的传感器(如激光雷达)获取环境信息,然后利用这些信息进行自我定位和地图构建。

具体而言,SLAM方案通过以下几个步骤实现:2.1. 数据获取:机器人通过激光雷达等传感器获取环境的三维点云数据。

2.2. 特征提取:从点云数据中提取关键的特征点,如角点和边缘点。

2.3. 路标建立:利用特征点建立路标,记录其在地图中的位置。

2.4. 运动估计:通过对连续两帧特征点的匹配,估计机器人的运动。

2.5. 地图优化:利用运动估计的结果对地图进行优化,得到更准确的地图信息。

2.6. 自我定位:根据优化后的地图和当前的传感器数据,实现机器人的自我定位。

3. 算法以激光雷达为例,常用的SLAM算法包括EKF-SLAM(Extended Kalman Filter SLAM)、FastSLAM、ORB-SLAM等。

这些算法在SLAM方案中发挥着关键作用。

3.1. EKF-SLAM:EKF-SLAM算法是一种基于扩展卡尔曼滤波器的SLAM算法。

它通过对机器人状态和地图的高斯分布进行递归估计,实现了自我定位和地图构建。

3.2. FastSLAM:FastSLAM算法是一种基于粒子滤波器的SLAM算法。

它通过将机器人的状态表示为一组粒子,并利用重采样过程实现对机器人状态的更新。

3.3. ORB-SLAM:ORB-SLAM算法是一种基于特征点的视觉SLAM算法。

它利用ORB特征点进行环境地图的构建和机器人的自我定位。

4. 应用SLAM方案在现实生活中有着广泛的应用,包括自动驾驶、无人机导航、机器人救援等领域。

语义SLAM1. 引言语义SLAM(Simultaneous Localization and Mapping)是一种结合了语义理解和地图构建的技术,旨在提高机器人在未知环境中的定位和导航能力。

传统的SLAM方法主要依赖于几何信息进行地图构建和机器人定位,但在复杂的真实世界环境中,仅凭几何信息有时无法满足应用需求。

因此,引入语义信息成为了提升SLAM系统性能的重要途径。

本文将介绍语义SLAM的基本概念、关键技术以及应用场景,并对其未来发展进行展望。

2. 语义SLAM基本概念2.1 SLAMSLAM是一种同时实现机器人自身定位和环境地图构建的技术。

通过使用传感器获取环境信息,并将其与机器人自身运动信息相结合,实现对机器人位置和周围环境的估计。

传统SLAM方法主要基于几何特征(如点云、视觉特征等)进行地图构建和定位。

2.2 语义理解语义理解是指机器对自然语言或其他形式表达的内容进行理解和处理。

通过识别文本、语音或图像中的实体、事件、关系等语义信息,使机器能够理解用户意图并进行相应的处理。

2.3 语义SLAM语义SLAM是在传统SLAM基础上引入语义信息的一种扩展。

它不仅利用几何特征构建地图和定位机器人,还使用语义信息来增强地图的表达能力和机器人对环境的理解能力。

通过将语义信息与几何信息相结合,提高机器人在未知环境中的定位精度和导航能力。

3. 语义SLAM关键技术3.1 传感器融合语义SLAM需要使用多种传感器获取环境信息,如激光雷达、摄像头、深度相机等。

将不同传感器获取到的数据进行融合,可以提高地图构建和定位的准确性。

同时,融合多个传感器的数据还可以增强对环境中物体的识别和理解能力。

3.2 特征提取与匹配在语义SLAM中,需要从传感器数据中提取特征,并将其与已知地图或先前观测到的特征进行匹配。

通过匹配特征点或特征描述子,可以实现机器人位置的估计和地图的更新。

同时,利用语义信息对特征进行分类和标记,可以提高对环境中物体的识别和理解能力。

SLAMSLAM的发展历程(WIKI)SLAM(即Simultaneous Localization and Mapping,即同时定位与地图构建)是机器人技术中的一项关键技术,能够让机器人在未知环境中实现自主导航和地图构建。

SLAM的发展历程可以追溯到20世纪80年代以来,经历了多个重要的里程碑。

1986年,K. Arulampalam等人提出了第一个概率形式的SLAM算法。

该算法使用了卡尔曼滤波(Kalman Filter)和扩展卡尔曼滤波(Extended Kalman Filter)方法来解决机器人定位和地图构建问题。

随后,SLAM开始引起学术界的广泛关注,并成为机器人研究领域的重要课题。

1999年,SLAM的一个重要突破是由Hugh Durrant-Whyte教授和John J. Leonard教授提出的基于粒子滤波(Particle Filter)的方法。

这个方法通过使用一系列粒子对机器人的状态进行估计,以解决非线性因素和噪声的问题。

这一方法的引入使得SLAM的准确性和鲁棒性得到了显著提高。

2002年,Sebastian Thrun等人在斯坦福大学进行的“达西”(DARPA Grand Challenge)比赛中,首次成功地将SLAM技术应用于自动驾驶汽车。

他们使用激光雷达传感器进行地图构建和定位,实现了汽车的自主导航。

这个重大突破引发了SLAM在自动驾驶领域的广泛应用。

2024年,Andrew Davison教授提出了基于并行运算的实时图像SLAM方法。

他使用直接法(Direct Method)通过对连续帧图像之间的像素值进行匹配,实现了在实时情况下对摄像头的定位和地图构建。

这个方法的创新性在于不需要使用特征点,极大地提高了SLAM的鲁棒性和实时性。

随着硬件技术的不断进步,传感器的发展也推动了SLAM的进一步发展。

激光雷达、摄像头、惯性测量单元等传感器的使用使得SLAM在不同应用场景中得到了广泛使用。

slam运作的流程SLAM(Simultaneous Localization and Mapping)是一种用于实现机器人或无人驾驶车辆等自主定位和建图的技术。

下面我将从多个角度全面详细地解释SLAM的运作流程。

1. 传感器数据获取,SLAM系统首先通过各种传感器(如激光雷达、摄像头、惯性测量单元等)获取环境的传感器数据。

这些数据可以包括距离、角度、图像等信息。

2. 特征提取与跟踪,SLAM系统会对传感器数据进行特征提取,例如提取图像中的角点或边缘特征,或者从激光雷达数据中提取地面点或障碍物点。

然后,系统会跟踪这些特征,以便在后续的定位和建图过程中使用。

3. 运动估计,SLAM系统会根据传感器数据和特征的变化,估计机器人的运动。

这可以通过使用运动模型(如里程计)来实现,也可以通过比较连续帧之间的特征变化来计算。

4. 数据关联,SLAM系统会将传感器数据和特征与先前的数据进行关联,以确定它们之间的联系。

这可以通过计算特征之间的匹配度、利用运动模型进行数据关联等方式来实现。

5. 地图更新,SLAM系统会根据已关联的数据,更新机器人的地图。

这可以是二维的栅格地图、三维的点云地图或拓扑地图等形式。

地图的更新可以通过将新的特征点添加到地图中,或者通过优化地图的表示来实现。

6. 定位更新,SLAM系统会根据已关联的数据和更新的地图,更新机器人的定位。

这可以通过使用滤波器(如扩展卡尔曼滤波器)或优化算法(如非线性优化)来实现。

7. 循环检测和闭环修复,SLAM系统会检测是否存在循环路径,并尝试修复闭环。

这可以通过比较先前观测到的地图和当前观测到的地图来实现。

闭环修复可以通过图优化等方法来调整地图和机器人的轨迹,以提高整体的一致性。

8. 整体优化,在SLAM的过程中,系统可能会进行多次的迭代优化,以提高地图的精度和机器人的定位准确性。

这可以通过非线性优化算法(如图优化)来实现,以最大程度地减小定位误差和地图重建误差。

超全SLAM技术及应用介绍SLAM (simultaneous localization and mapping),也称为CML (Concurrent Mapping and Localization), 即时定位与地图构建,或并发建图与定位。

问题可以描述为:将一个机器人放入未知环境中的未知位置,是否有方法让机器人一边逐步描绘出此环境完全的地图,所谓完全的地图〔a consistent map〕是指不受障碍行进到房间可进入的每个角落。

SLAM最早由Smith、Self和Cheeseman于1988年提出。

由于其重要的理论与应用价值,被很多学者认为是实现真正全自主移动机器人的关键。

词语解释Simultaneous Localization and MappingSimultaneous Localization and Mapping, 同步定位与建图。

SLAM问题可以描述为: 机器人在未知环境中从一个未知位置开始移动,在移动过程中根据位置估计和地图进行自身定位,同时在自身定位的根底上建造增量式地图,实现机器人的自主定位和导航。

Scanning Laser Acoustic MicroscopeScanning Laser Acoustic Microscope, 激光扫描声学显微镜。

激光扫描声学显微镜是一种强有力的广泛应用于诸如工业用材料和生物医学领域的无损检测工具,其使用的频率范围为10MHz ~ 500MHz。

Lymphocyte Activation MoleculeLymphocyte Activation Molecule, 医学用语。

Supersonic Low Altitude MissileSLAM — Supersonic Low Altitude Missile〔超音速低空导弹〕的缩写,是美国的一项导弹研制方案。

Symmetrically Loaded Acoustic ModuleSLAM是Symmetrically Loaded Acoustic Module的英文缩写 [1] ,中文意思是平衡装载声学模块。

slam是什么意思中文翻译slam表达的意思有很多种,那么你知道slam做动词,名词和形容词分别都有哪些意思吗?下面店铺为大家带来slam的英语意思和例句,欢迎大家参考学习!slam作名词的意思猛击;猛然关闭的声音slam作动词的意思砰然关上;猛力打击,碰撞slam的英语音标英[slæm] 美[slæm]slam的用法:现在分词: slamming过去式: slammed过去分词: slammedslam的英语例句1. They won the Grand Slam in 1990.他们1990年赢得了大满贯。

2. She let the door slam.她听任门砰地关上。

3. I heard the door slam behind him.我听见他随手砰地把门关上了。

4. Politically, this issue is a slam dunk for the party.在政治上,这一议题是这个党的一张胜券。

5. They were surprised by the slam of a car door.关汽车门时发出的声音使他们很吃惊.6. The slam of the shutter awoke me.百叶窗砰的一声把我惊醒了.7. It's my first Grand Slam and I was hoping to make a good impression.那是我首次参加大奖赛,我当时希望能表现出色.8. A seagull swooped down in front of her car, causing her to slam on the brakes.一只海鸥突然扑到她的车前,她急忙猛踩刹车。

9. I was relieved to hear the front door slam.听见前门砰的一声关上了,我松了一口气。

10. South will still be one trick short of the slam.南要打成小满贯仍缺少一墩.11. Why should you slam the window?你干吗要使劲关窗户呢 ?12. The woman shut the trapdoor with a slam.这位女主妇砰的一声关上活板门.13. He answer was to slam the door.他猛力关门做为回报.14. He threw his books down with a slam.他砰然一声将书摔在桌上.15. I heard someone slam the door.我听到有人砰地一声把门关上了.。

1.SLAM算法框架

SLAM算法的核心分为三个步骤:

1.预处理。

例如,对激光雷达原始数据所优化,剔除一些有问题的数据,或者进行滤波。

2.匹配。

也就是说把当前这一个局部环境的点云数据在已经建立地图上寻找到对应的位置。

3.地图融合。

将这一轮来自激光雷达的新数据拼接到原始地图当中,最终完成地图的更新。

细化来说,主要包含以下模块:

•sensor data process

•Visual Odometry,前端优化/定位,针对视觉SLAM

•Backend(Optimization),后端/全局优化,例如GraphSLAM,Cartographer里的SPA •Mapping,常见有Matrix and Topologic map两种形式,各有优缺

•Loop cloure detection,回环检测,进一步减少累计误差

一个基本的基于激光雷达的SLAM系统流程如图1所示。

系统需要的采集信息包含激光雷达扫描信息和里程计信息(或者是IMU)。

然后利用卡尔曼滤波(EKF)等方法融合激光雷达扫描信息和里程计信息,得到环境地图。

常用的基于激光雷达的SLAM算法有Gmapping,hector SLAM,Cartographer。

图1Laser SLAM流程图

2.Cartographer算法

Cartographer,中文直译为建图者,是Google开源的一个ROS系统支持的2D和3D SLAM 库。

开发人员可以用这个库实现二维和三维定位及制图功能。

其SLAM算法结合了来自多个传感器(比如,LIDAR、IMU和摄像头)的数据,同步计算传感器的位置并绘制传感器周围的环境。

开源Cartographer还搭配有开源机器人操作系统(ROS),使得该技术库更易于

部署到机器人、无人驾驶、无人机等系统。

2.1Cartographer算法原理

Cartographer的主要内容包含融合多传感器数据的局部submap创建和用于闭环检测的scan match策略的实现,系统框架如图4所示。

闭环检测是用来消除局部构图过程中产生的累积误差。

用于闭环检测的基本单元是submap。

一个submap是由一定数量的laser scan构成。

将一个laser scan插入其对应的submap时,会基于submap已有的laser scan及其它传感器数据估计其在该submap中的最佳位置。

submap的创建在短时间内的误差累积被认为是足够小的。

然而随着时间推移,越来越多的submap被创建后,submap间的误差累积则会越来越大。

因此需要通过闭环检测适当的优化这些submap的位姿进而消除这些累积误差,这就将问题转化成一个位姿优化问题。

当一个submap的构建完成时,也就是不会再有新的laser scan插入到该submap时,该submap就会加入到闭环检测中。

闭环检测会考虑所有的已完成创建的submap。

当一个新的laser scan加入到地图中时,如果该laser scan的估计位姿与地图中某个submap的某个laser scan的位姿比较接近的话,那么通过某种scan match策略就会找到该闭环。

Cartographer中的scan match策略通过在新加入地图的laser scan的估计位姿附近取一个窗口,进而在该窗口内寻找该laser scan的一个可能的匹配,如果找到了一个足够好的匹配,则会将该匹配的闭环约束加入到位姿优化问题中。

图2Cartographer算法框架

2.2Cartographer库函数

Cartographer是一个独立的C++函数库。

同时,如果想要快速搭建SLAM系统,Google 也提供了ROS封装好的算法包。

Getting start with ROS

刚开始接触SLAM时,即使对算法原理非常熟悉,但编写复杂代码仍然是非常费劲的。

相比从一砖一瓦建筑大厦,不如通过充分利用现成的算法包,建立SLAM系统,快速实现SLAM功能。

通过使用Cartographer_ROS算法包,可以站在一个较高的视角上认识SLAM 的工作过程。

下载链接请见https://google-cartographer-ros.readthedocs.io/en/latest/。

Getting start without ROS

如果想要了解详细的算法代码,或是改进算法原理,可以使用Cartographer的C++库函。

有关码解读文档,可参见https://google-cartographer.readthedocs.io/en/latest/index.html。

另外,关于算法的介绍可参考论文:W.Hess,D.Kohler,H.Rapp,and D.Andor,Real-Time Loop Closure in2D LIDAR SLAM,in Robotics and Automation(ICRA),2016IEEE International Conference on.IEEE,2016.pp.1271–1278.

Cartographer ROS for TurtleBots

如果是在TurtleBots上搭建SLAM系统,Cartographer团队也提供了Cartographer SLAM for TurtleBots via Cartographer ROS,可参见https://google-cartographer-ros-for-turtlebots.readthedocs.io/en/latest/)。

Cartographer_Turtlebot 提供了很多资源,包含kobuki,kinect,hokuyo等,十分方便调用,通过熟悉这一套系统框架,

能够极大地减少代码工程量。