信息论基础第1章

- 格式:pdf

- 大小:737.43 KB

- 文档页数:24

第一章信息的定性描述第一节对信息的初步认识一. 信息社会当今,世界上信息革命的热潮一浪高过一浪。

近年来,移动电话、个人电脑和网络用户正以高于摩尔定律的速度迅猛增长。

人们都在谈论着信息社会、信息革命和网络时代,信息似乎成了个很时髦的字眼儿。

就连中国人平常打招呼的话“你吃饭了吗?”也被有些人改成“你上网了吗?”但这绝不是什么赶时髦,也绝不是什么偶然现象,而是社会发展的必然趋势。

因为在信息社会里,人们最关心的是信息问题,而不是吃饭问题。

“民以食为天”的信条将会逐渐被“民以信为天”所代替。

社会学家和未来学家普遍认为,20世纪末和21世纪初,是信息革命爆发的时期。

一些新技术的突破和新产业的出现,使社会生产力发生了新的飞跃,人们的生活也发生了新的变化,人类社会正在进入信息化社会。

所谓信息化社会,就是以信息产业为中心,使社会生产、生活和经济都发展起来的社会。

在这种社会中,◆信息成了比物质或能源更为重要的资源,◆对信息产业成了重要的产业。

◆从事信息工作者成了主要的劳动者。

◆信息和知识成了生产力发展的决定因素。

二. 信息的普遍性其实,信息并不是什么新鲜东西,信息无时不在,无处不有。

人们生活在信息的海洋里,天天都要通过自己的感觉器官感受各种外界信息。

例如,衣食住行,读书看报,听广播,看电视等等。

人们要进行社会活动就需要有信息交流。

例如,除了书信、电话、电报之外,天天都要同许多人交谈、交往。

人们还要进行信息处理和存储。

例如,要把观察、接收到的大量事物、数据和资料进行分类、分析、整理和纪录。

不仅如此,信息也是人类自身进化的一个基本条件。

恩格斯对于人类的进化过程,曾有过这样一段极其精彩的描述:“……这些猿类,大概是首先由于它们生活方式的影响……渐渐直立行走……手变得自由了……随着手的发展,随着劳动而开始的人对自然的统治,在每一个新的发展中扩大了人的眼界。

……另一方面,劳动的发展必然促使社会成员更加紧密地互相结合起来,因为它使互相帮助和共同协作的场合增多了,并且使每个人都清楚地意识到这种共同协作的好处。

《信息论基础》习题答案第一章信息与信息的度量-1 解:根据题意,“没有不及格”或“pass”的概率为因此当教师通知某甲“没有不及格”后,甲获得信息在已知“pass”后,成绩为“优”(A),“良”(B),“中”(C)和“及格”(D)的概率相同:为确定自己的成绩,甲还需信息1-2 解:该锁共可设个数值,开锁号码选取每一个值的概率都相同,所以-3 解:由于每个汉字的使用频度相同,它们有相同的出现概率,即因此每个汉字所含的信息量为每个显示方阵能显示种不同的状态,等概分布时信息墒最大,所以一个显示方阵所能显示的最大信息量是显示方阵的利用率或显示效率为-4 解:第二次发送无误收到,因此发、收信息量相等,均为第一次发出的信息量为第一次传送的信息量为两次发送信息量之差:-5 解:由信息熵定义,该信源输出的信息熵为消息ABABBA所含的信息量为消息FDDFDF所含的信息量为6位长消息序列的信息量期望值为三者比较为-6 解:由信息熵定义,该信源输出的信息熵为消息ABABBA所含的信息量为消息FDDFDF所含的信息量为6位长消息序列的信息量期望值为三者比较为-7 解:X和Y的信息熵分别为因传输无误,信宿收到的信息等于发送信息。

因此当第一个字符传送结束后,两信宿收到信息量等于发送的信息量,即整个序列发送结束后,由于符号间独立,两信宿收到的总信息量是平均每次(每个符号)发送(携带)的信息为-8 解:(a) 根据扑克牌的构成,抽到“红桃”、“人头”、“红桃人头”的概率分别为13/52=1/4、12/52=3/13和3/52,所以当告知抽到的那张牌是:“红桃”、“人头”和“红桃人头”时,由信息量定义式(1-5),所得到的信息各是(b) 在52张扑克牌中,共有红人头6张(3张红桃,3张方块),因此在已知那张牌是红人头,为确切地知道是哪张牌,还需要信息。

-9 解:一个二元信息所含的最大信息熵是确定的,所以当以2或5为底时,最大信息熵相同,即1 bit = (该信息量单位)或 1 (该信息量单位) = 2.33 bits同理, 1 nat = 0.62 (该信息量单位)或 1(该信息量单位) = 1.61 nats。

信息论基础第二版习题答案信息论是一门研究信息传输和处理的学科,它的基础理论是信息论。

信息论的基本概念和原理被广泛应用于通信、数据压缩、密码学等领域。

而《信息论基础》是信息论领域的经典教材之一,它的第二版是对第一版的修订和扩充。

本文将为读者提供《信息论基础第二版》中部分习题的答案,帮助读者更好地理解信息论的基本概念和原理。

第一章:信息论基础1.1 信息的定义和度量习题1:假设有一个事件发生的概率为p,其信息量定义为I(p) = -log(p)。

求当p=0.5时,事件的信息量。

答案:将p=0.5代入公式,得到I(0.5) = -log(0.5) = 1。

习题2:假设有两个互斥事件A和B,其概率分别为p和1-p,求事件A和B 同时发生的信息量。

答案:事件A和B同时发生的概率为p(1-p),根据信息量定义,其信息量为I(p(1-p)) = -log(p(1-p))。

1.2 信息熵和条件熵习题1:假设有一个二进制信源,产生0和1的概率分别为p和1-p,求该信源的信息熵。

答案:根据信息熵的定义,信源的信息熵为H = -plog(p) - (1-p)log(1-p)。

习题2:假设有两个独立的二进制信源A和B,产生0和1的概率分别为p和1-p,求两个信源同时发生时的联合熵。

答案:由于A和B是独立的,所以联合熵等于两个信源的信息熵之和,即H(A,B) = H(A) + H(B) = -plog(p) - (1-p)log(1-p) - plog(p) - (1-p)log(1-p)。

第二章:信道容量2.1 信道的基本概念习题1:假设有一个二进制对称信道,其错误概率为p,求该信道的信道容量。

答案:对于二进制对称信道,其信道容量为C = 1 - H(p),其中H(p)为错误概率为p时的信道容量。

习题2:假设有一个高斯信道,信道的信噪比为S/N,求该信道的信道容量。

答案:对于高斯信道,其信道容量为C = 0.5log(1 + S/N)。

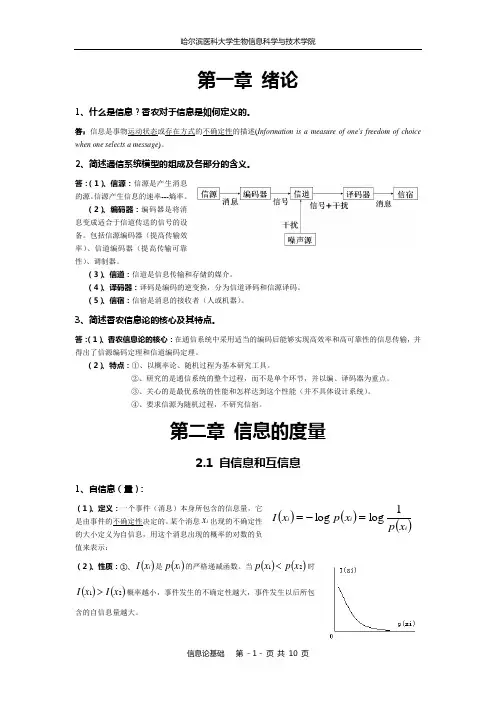

第一章 绪论1、什么是信息?香农对于信息是如何定义的。

答:信息是事物运动状态或存在方式的不确定性的描述(Information is a measure of one's freedom of choice when one selects a message )。

2、简述通信系统模型的组成及各部分的含义。

答:(1)、信源:信源是产生消息的源。

信源产生信息的速率---熵率。

(2)、编码器:编码器是将消息变成适合于信道传送的信号的设备。

包括信源编码器(提高传输效率)、信道编码器(提高传输可靠性)、调制器。

(3)、信道:信道是信息传输和存储的媒介。

(4)、译码器:译码是编码的逆变换,分为信道译码和信源译码。

(5)、信宿:信宿是消息的接收者(人或机器)。

3、简述香农信息论的核心及其特点。

答:(1)、香农信息论的核心:在通信系统中采用适当的编码后能够实现高效率和高可靠性的信息传输,并得出了信源编码定理和信道编码定理。

(2)、特点:①、以概率论、随机过程为基本研究工具。

②、研究的是通信系统的整个过程,而不是单个环节,并以编、译码器为重点。

③、关心的是最优系统的性能和怎样达到这个性能(并不具体设计系统)。

④、要求信源为随机过程,不研究信宿。

第二章 信息的度量2.1 自信息和互信息1、自信息(量):(1)、定义:一个事件(消息)本身所包含的信息量,它是由事件的不确定性决定的。

某个消息i x 出现的不确定性的大小定义为自信息,用这个消息出现的概率的对数的负值来表示: (2)、性质:①、()i x I是()i x p 的严格递减函数。

当()()21x p x p <时()()21x I x I >概率越小,事件发生的不确定性越大,事件发生以后所包含的自信息量越大。

()()()i i i x p x p x I 1loglog =-=②、极限情况下,当()0=i x p 时()∞→i x I ;当()1=i x p 时,()0→i x I 。