稀疏矩阵svd分解 简化算法

- 格式:docx

- 大小:15.04 KB

- 文档页数:2

矩阵奇异值分解算法及应用改进分析矩阵奇异值分解(Singular Value Decomposition, SVD)是一种常用的矩阵分解方法。

在大数据处理、图像处理、推荐系统等领域都有广泛的应用。

本文将介绍SVD的基本原理,并对其应用进行改进分析。

一、矩阵奇异值分解的基本原理矩阵奇异值分解是将一个矩阵分解为三个矩阵相乘的形式。

设M 是一个m行n列的实数矩阵,那么SVD可表示为以下形式:M=UΣV^T其中,U是一个m行m列的正交矩阵,Σ是一个m行n列的对角矩阵,V^T是一个n行n列的正交矩阵。

对角矩阵Σ的对角线元素称为奇异值,代表了原始矩阵在相应方向上的信息量。

在矩阵奇异值分解中,U矩阵是原始矩阵M乘以其转置M^T的特征向量组成的矩阵,V矩阵是M^T乘以M的特征向量组成的矩阵。

特征向量的选择保证了矩阵的正交性,而奇异值的排序表明了它们的重要性,排序靠前的奇异值所对应的特征向量往往包含了较多的信息。

二、SVD的应用改进分析1. 矩阵降维和压缩在大数据处理中,往往需要对高维稀疏矩阵进行降维和压缩。

通过SVD分解后,可以选择保留较小的奇异值和对应的特征向量,从而实现对矩阵的降维和压缩。

降维和压缩后的矩阵占用更小的存储空间,便于后续的计算和处理。

2. 推荐系统在推荐系统中,SVD可以被用于对用户和物品之间的关系进行建模。

通过对用户-物品评分矩阵进行SVD分解,可以得到用户和物品的隐含特征向量。

利用这些特征向量,可以给用户推荐未曾接触过的物品。

3. 图像处理SVD也被广泛应用于图像压缩和去噪领域。

通过对图像矩阵进行SVD分解,可以得到图像的主要特征分量。

如果舍弃一些较小的奇异值和对应的特征向量,可以实现对图像的降噪和压缩。

4. 数据挖掘SVD还可以用于数据挖掘中的降维和特征提取。

通过保留较大的奇异值和对应的特征向量,可以提取出数据中最重要的特征,并减少数据的维度,从而提高后续的数据挖掘效果和计算效率。

三、结论矩阵奇异值分解是一种重要的矩阵分解方法,具有广泛的应用前景。

K-SVD算法学习1:稀疏表示:考虑线性等式,或者是线性逼近。

,这里的D是 的矩阵。

称为字典(字典学习中),测量矩阵(压缩感知中),权重矩阵(多任务学习中),其中。

中的每一列称为原子。

其模型为等价于当然其中 可以用其最优凸近似 来近似替代进行求解。

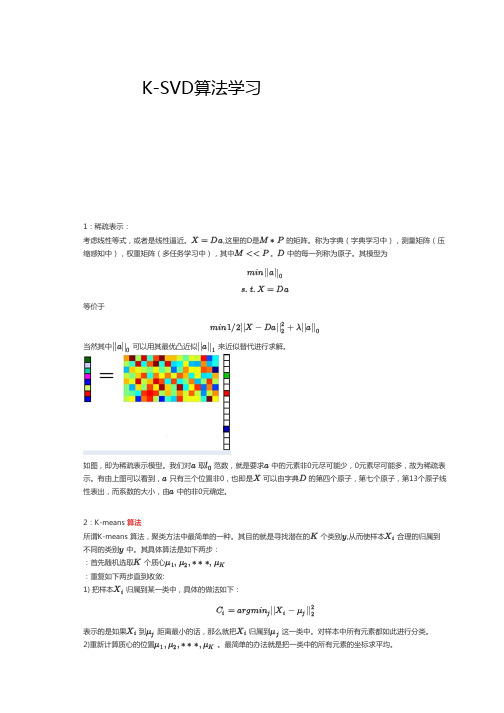

如图,即为稀疏表示模型。

我们对 取 范数,就是要求 中的元素非0元尽可能少,0元素尽可能多,故为稀疏表示。

有由上图可以看到, 只有三个位置非0,也即是 可以由字典 的第四个原子,第七个原子,第13个原子线性表出,而系数的大小,由 中的非0元确定。

2:K-means 算法所谓K-means 算法,聚类方法中最简单的一种。

其目的就是寻找潜在的 个类别,从而使样本 合理的归属到不同的类别 中。

其具体算法是如下两步::首先随机选取 个质心:重复如下两步直到收敛:1)把样本 归属到某一类中,具体的做法如下:表示的是如果 到 距离最小的话,那么就把 归属到 这一类中。

对样本中所有元素都如此进行分类。

2)重新计算质心的位置 。

最简单的办法就是把一类中的所有元素的坐标求平均。

d 法e斯X =Da M ∗P M <<P D min ||a ||0s .t .X =Damin 1/2||X −Da |+λ||a ||22|0||a ||0||a ||1a l 0a a X D a K y X i y K ,,∗∗∗,μ1μ2μKX i =argmi ||−|C i n j X i μj |22X i μj X i μj ,,∗∗∗,μ1μ2μK其实K-means也是一中稀疏表示:对于样本元素,目的是找到其距离最近的质心 。

其解决如下优化问题: 字典中含有 个原子或者说是质心。

对于样本 ,约束要求的是,找到对应的稀疏表示 ,只有一个原子被选中,也即是稀疏表示 中只有一个元素不为0。

那么样本样本 即属于相应的质心。

近似模型如下: 3:K-svd算法K-means算法是字典中只有一个原子被选中,也就是这个元素只由一个原子来表示。

《基于低秩稀疏矩阵分解的探地雷达杂波抑制方法》篇一一、引言探地雷达(Ground Penetrating Radar, GPR)是一种用于探测地下目标的技术。

在GPR的信号处理中,杂波抑制是一个重要的环节。

由于地下环境的复杂性,GPR接收到的信号常常受到各种杂波的干扰,这些杂波会严重影响对地下目标的准确探测和识别。

为了解决这一问题,本文提出了一种基于低秩稀疏矩阵分解的探地雷达杂波抑制方法。

该方法能够有效地从GPR信号中分离出目标信号和杂波信号,从而提高GPR探测的准确性和可靠性。

二、低秩稀疏矩阵分解原理低秩稀疏矩阵分解是一种信号处理方法,它能够有效地将混合信号分解成多个独立的成分。

在探地雷达信号处理中,低秩部分通常代表地下目标的反射信号,而稀疏部分则代表杂波和其他噪声。

通过将这两种成分进行分离,可以实现杂波抑制的目标。

低秩稀疏矩阵分解的基本思想是利用矩阵的奇异值分解(SVD)或非负矩阵分解(NMF)等技术,将原始矩阵分解为低秩部分和稀疏部分。

其中,低秩部分包含了主要的信号成分,而稀疏部分则包含了噪声和杂波成分。

通过调整分解算法的参数,可以实现对这两种成分的有效分离。

三、基于低秩稀疏矩阵分解的探地雷达杂波抑制方法本文提出的基于低秩稀疏矩阵分解的探地雷达杂波抑制方法主要包括以下几个步骤:1. 数据预处理:对探地雷达接收到的原始数据进行预处理,包括去除无效数据、归一化等操作,以提高后续处理的准确性。

2. 低秩稀疏矩阵分解:利用低秩稀疏矩阵分解算法对预处理后的数据进行分解,得到低秩部分和稀疏部分。

3. 杂波抑制:根据地下目标的特性,对低秩部分进行重构,同时抑制稀疏部分的杂波成分。

这一步可以通过调整分解算法的参数或采用其他滤波方法来实现。

4. 目标信号提取:从经过杂波抑制处理后的信号中提取出目标信号,以实现对地下目标的准确探测和识别。

四、实验与分析为了验证本文提出的基于低秩稀疏矩阵分解的探地雷达杂波抑制方法的有效性,我们进行了实际实验和分析。

了解机器学习的SVD算法机器学习的SVD算法机器学习是人工智能领域中一个非常重要的分支,其在数据建模、分类与回归、模式识别等领域都有广泛的应用。

其中,矩阵分解是机器学习领域的重要技术之一。

矩阵的分解可以将原始矩阵分解为更多有意义的子矩阵,这些子矩阵可以帮助我们理解和处理数据。

SVD(奇异值分解)算法就是一种矩阵分解的方法,通过将一个大的矩阵分解成三个小的矩阵来实现矩阵的分解。

一、理解SVD算法SVD算法的核心思想是将矩阵分解成三个矩阵的乘积,分别是左奇异矩阵U、奇异值矩阵Σ和右奇异矩阵VT。

其中,U和VT矩阵都是正交矩阵(orthogonal matrix),Σ矩阵是对角矩阵(diagonal matrix)。

下面是SVD算法的数学公式:M=UΣVT其中,M表示原始矩阵,U表示左奇异矩阵,Σ表示奇异值矩阵,VT表示右奇异矩阵。

这个公式的意义是将原始矩阵M分解为三个小矩阵U、Σ和VT的乘积。

在这个分解过程中,U矩阵和VT矩阵都是正交矩阵,Σ矩阵是对角矩阵。

二、SVD算法的应用SVD算法可用于大量机器学习的任务中。

以下是具体应用事例:1. 图像压缩SVD算法是图像压缩中最常用的算法之一。

图像可以表示为一个矩阵,利用SVD算法将一个大的矩阵分解成三个小的矩阵后,可以通过选择奇异值较大的子矩阵来实现图像的压缩。

由于大多数图像中的信息都分布在少数的奇异值中,因此可以大大压缩图像的大小。

2. 推荐系统在推荐系统中,利用SVD算法可以快速计算出用户对物品的评分。

将用户对物品的评分矩阵分解成三个小矩阵后,可以通过计算用户和物品的奇异值矩阵来实现推荐算法。

在实际应用中,SVD算法可以帮助用户发现物品的隐藏特征,从而更好地进行推荐。

3. 协同过滤协同过滤是将用户的偏好关联到其他用户的偏好上,获取物品的推荐评分。

SVD算法可以从偏好矩阵中获取用户的偏好,将原始矩阵分解成三个矩阵,并选择部分奇异值和对应的向量,就可以得到一个低维的奇异向量矩阵。

基于SVD算法的智能新闻推荐系统的设计与实现【摘要】本文介绍了基于SVD算法的智能新闻推荐系统的设计与实现。

在分析了研究背景、研究意义和研究目的。

在首先介绍了SVD算法的原理和应用;然后详细讨论了智能新闻推荐系统的设计,包括数据预处理和推荐算法实现;最后对系统性能进行评估。

在总结了研究成果并提出了未来展望,探讨了技术实践意义。

通过本文的研究,可以为提高新闻推荐系统的推荐效果和用户体验提供参考和借鉴。

.【关键词】智能新闻推荐系统、SVD算法、数据预处理、推荐算法实现、系统性能评估、研究背景、研究意义、研究目的、研究总结、未来展望、技术实践意义1. 引言1.1 研究背景随着互联网的快速发展和信息量的爆炸式增长,人们面临着越来越庞大和复杂的信息量。

在这个信息爆炸的时代,如何有效地获取符合自己需求的信息成为了一个亟待解决的问题。

传统的新闻推荐系统往往只是基于用户的浏览历史或者兴趣标签进行推荐,很难做到个性化和精准推荐。

为了解决这一问题,人们开始尝试引入机器学习和数据挖掘技术,构建更加智能的新闻推荐系统。

本研究旨在借助SVD算法,构建一个智能新闻推荐系统,通过对用户浏览行为和新闻内容进行分析,实现个性化推荐,帮助用户快速获取信息,提高信息获取效率和质量。

1.2 研究意义智能新闻推荐系统的研究具有重要的理论和实践意义。

通过对用户的历史行为数据进行分析,可以挖掘用户的兴趣偏好,从而为用户推荐更加符合其需求的新闻内容,提高了用户体验和满意度。

智能推荐系统的应用可以帮助新闻媒体更好地了解用户行为和需求,为新闻内容的生产和推广提供参考。

智能推荐系统还可以促进新闻产业的发展,提升新闻传播效率,促进媒体产业的数字化转型升级。

对基于SVD算法的智能新闻推荐系统进行深入研究,具有重要的现实意义和广阔的应用前景。

1.3 研究目的研究目的是构建基于SVD算法的智能新闻推荐系统,旨在提高用户的阅读体验和信息获取效率。

通过利用SVD算法对用户行为数据和新闻内容进行分解和降维处理,系统能够更准确地理解用户的兴趣和偏好,从而为用户推荐个性化的新闻内容。

机器学习SVD矩阵分解算法,对矩阵做拆分,然后呢?今天是机器学习专题第28篇文章,我们来聊聊SVD算法。

SVD的英文全称是Singular Value Decomposition,翻译过来是奇异值分解。

这其实是一种线性代数算法,用来对矩阵进行拆分。

拆分之后可以提取出关键信息,从而降低原数据的规模。

因此广泛利用在各个领域当中,例如信号处理、金融领域、统计领域。

在机器学习当中也有很多领域用到了这个算法,比如推荐系统、搜索引擎以及数据压缩等等。

SVD简介我们假设原始数据集矩阵D是一个mxn的矩阵,那么利用SVD 算法,我们可以将它分解成三个部分:这三个矩阵当中U是一个m x n的矩阵,∑是一个m x n的对角矩阵,除了对角元素全为0,对角元素为该矩阵的奇异值。

V是一个n x n的矩阵。

U和V都是酉矩阵,即满足U^TU = I, V^T V = I。

也就是它乘上它的转置等于单位对角矩阵。

我们可以看下下图,从直观上感知一下这三个矩阵。

下面我们来简单推导一下SVD的求解过程,看起来很复杂,概念也不少,但是真正求解起来却并不难。

会需要用到矩阵特征值分解的相关概念,如果不熟悉的同学可以先看下线性代数专题相关内容做个回顾:线性代数精华——讲透矩阵的初等变换与矩阵的秩首先,如果我们计算A^TA可以得到一个n x n的方阵。

对于方阵我们可以对它进行特征分解,假设得到特征值是lambda_i,特征向量是v_i,代入特征值的性质可以得到:这样的特征值和特征向量一共会有n个,我们把它所有的特征向量组合在一起,可以得到一个n x n的矩阵V。

它也就是我们SVD分解结果之后的V,所以有些书上会把它叫做右奇异向量。

同理,我们计算AA^T可以得到一个m x m的方阵,我们同样可以对他进行特征值分解,得到一个特征矩阵U。

U应该是一个m x m 的矩阵,也就是SVD公式中的U,我们可以将它称为A的左奇异向量。

U和V都有了,我们只剩下∑还没求出来了。

稀疏协方差矩阵svd分解

稀疏协方差矩阵的SVD(奇异值分解)是一种常见的数据分解

技术,它在数据处理和降维领域有着重要的应用。

首先,让我们来

了解一下稀疏矩阵和协方差矩阵的概念。

稀疏矩阵是指大部分元素为零的矩阵,它在实际数据中很常见,例如在自然语言处理、推荐系统和网络分析等领域。

协方差矩阵则

是描述随机变量之间线性关系的矩阵,它在统计学和机器学习中被

广泛应用。

SVD是一种矩阵分解的方法,可以将一个矩阵分解为三个矩阵

的乘积。

对于稀疏协方差矩阵的SVD分解,它可以帮助我们发现数

据中的潜在结构和模式,从而进行数据降维、去噪或者特征提取。

在稀疏协方差矩阵的SVD分解中,我们首先需要处理稀疏性,

可以利用稀疏矩阵的特性进行优化计算。

接着,我们可以利用SVD

分解将协方差矩阵分解为三个矩阵,U、Σ和V。

其中,U和V是正

交矩阵,Σ是一个对角矩阵,它们分别代表了数据的左奇异向量、

奇异值和右奇异向量。

通过SVD分解,我们可以对数据进行降维,只保留最重要的特征,从而减少数据的复杂度和噪声,提高模型的泛化能力。

此外,SVD分解还可以用于矩阵的压缩和重构,使得数据更易于处理和分析。

总之,稀疏协方差矩阵的SVD分解是一种重要的数据分解技术,它可以帮助我们理解数据的结构和模式,从而进行数据降维、特征

提取和模型优化。

在实际应用中,我们需要根据具体情况选择合适

的算法和参数,以获得最佳的分解效果。

矩阵svd分解算法SVD全称为Singular Value Decomposition(奇异值分解),是一种非常重要的矩阵分解方法,被广泛应用于信号处理、图像处理、机器学习等领域。

本文将介绍SVD的定义、求解方法以及应用。

一、SVD定义矩阵SVD分解,指将一个复矩阵A分解成如下的形式:A = UΣV^T其中,U和V是正交矩阵,Σ是一个对角矩阵,对角线上的元素称为奇异值,通常用σ1 ≥ σ2 ≥ … ≥ σr > 0来表示。

二、SVD求解方法下面我们针对mxn的矩阵A,讲述一下SVD的求解步骤。

1. 首先求A^T·A的特征值和特征向量,设A^T·A的特征值为λ1, λ2, …, λm,对应的特征向量为v1, v2, …, vm 。

其中λ1≥λ2≥…≥λr>0。

2. 接着我们对v1, v2, …, vm进行标准化。

3. 将标准化后的v1, v2, …, vm组成正交矩阵V,即:V=[v1, v2, …, vm]。

特别的,当A为实矩阵时,可得到实特征向量和实奇异值,此时V 是一个正交矩阵。

4. 由于λ1, λ2, …, λr是A^T·A的非负特征值,我们可以得到A^T·A的奇异值:σ1=√λ1, σ2=√λ2, …, σr=√λr。

并将非零奇异值按照从大到小降序排列。

5. 求解奇异值对应的左奇异向量,设A^T·A的第i大特征值对应的特征向量为vi,i=1,2,...,r。

则A的左奇异向量为:ui=1/σi·Avi,i=1,2,...,r。

将u1, u2, …, ur组成正交矩阵U,即:U=[u1, u2, …, ur]。

特别的,当A为实矩阵时,可得到实左奇异向量。

6. 当m>n时,需要计算A·A^T的右奇异向量。

根据定义可得:vi=1/σi·A^Tui,i=1,2,...,r。

这些向量也组成了一个正交矩阵V,将它们作为A的右奇异向量。

svd分解方法SVD (Singular Value Decomposition) is a powerful mathematical tool that can be used for various purposes in data analysis, signal processing, and machine learning. SVD分解是一种强大的数学工具,可用于数据分析,信号处理和机器学习等多种用途。

It is a factorization of a matrix into three other matrices, and it has important applications in areas such as image compression, recommendation systems, and dimensionality reduction. 这是将矩阵分解为另外三个矩阵,具有在图像压缩、推荐系统和降维等领域的重要应用。

One of the key benefits of SVD is its ability to reduce matrix dimensionality while preserving important information. SVD的一个关键优点是它能够在保留重要信息的同时减小矩阵的维度。

By retaining only the most relevant features, it can be used to extract underlying patterns and structures from large datasets. 通过仅保留最相关的特征,它可以用来从大型数据集中提取潜在的模式和结构。

This makes it a valuable tool for tasks such as image and audio processing, where reducing the amount of data without losing critical details is essential. 这使其成为图像和音频处理等任务的有价值工具,因为在不丢失关键细节的情况下减少数据量是至关重要的。

l1svd算法基本原理

L1SVD算法基本原理

L1SVD算法是一种基于奇异值分解(SVD)的稀疏表示方法,它可以将高维数据降维并提取出数据的主要特征。

该算法的基本原理是通过对数据矩阵进行SVD分解,得到数据的主要特征向量和奇异值,然后通过L1正则化方法对特征向量进行稀疏化处理,从而得到数据的稀疏表示。

具体来说,L1SVD算法的步骤如下:

1. 对数据矩阵进行SVD分解,得到数据的主要特征向量和奇异值。

2. 对特征向量进行L1正则化处理,使得大部分特征向量的系数为0,从而得到数据的稀疏表示。

3. 将稀疏表示的数据矩阵进行重构,得到降维后的数据矩阵。

L1SVD算法的优点是可以有效地降低数据的维度,并提取出数据的主要特征。

同时,由于L1正则化方法可以使得大部分特征向量的系数为0,因此可以实现数据的稀疏表示,从而减少数据的存储和计算量。

L1SVD算法在实际应用中有广泛的应用,例如图像处理、语音识别、文本分类等领域。

在图像处理中,L1SVD算法可以用于图像压缩和去噪等方面;在语音识别中,L1SVD算法可以用于语音信号的特征

提取和降噪等方面;在文本分类中,L1SVD算法可以用于文本特征的提取和分类等方面。

L1SVD算法是一种基于SVD分解和L1正则化的稀疏表示方法,它可以有效地降低数据的维度并提取出数据的主要特征,具有广泛的应用前景。

稀疏矩阵svd分解简化算法

稀疏矩阵的SVD(奇异值分解)是一种重要的矩阵分解方法,

用于在矩阵中发现潜在的模式和结构。

在处理稀疏矩阵时,传统的SVD算法可能会面临计算复杂度高和存储空间需求大的问题。

因此,针对稀疏矩阵的SVD分解,通常会采用一些简化算法来提高效率和

降低计算成本。

一种常见的简化算法是截断SVD(Truncated SVD),它通过仅

计算最大的奇异值和对应的奇异向量来近似原始矩阵的SVD分解。

这种方法可以有效地降低计算复杂度,并且适用于处理大规模的稀

疏矩阵。

另外,截断SVD还可以用于降维和特征提取,对于机器学

习和数据分析等领域有着重要的应用价值。

除了截断SVD,还有一些其他简化算法,如随机SVD (Randomized SVD)和迭代SVD(Iterative SVD)。

这些算法通过

引入随机性或迭代优化的方式,来加速稀疏矩阵的SVD分解过程,

同时保持较高的精度。

总的来说,针对稀疏矩阵的SVD分解,简化算法在提高计算效

率和降低存储成本方面发挥着重要作用。

不同的简化算法适用于不

同的场景,可以根据实际需求选择合适的算法来进行稀疏矩阵的SVD分解。