离散K—L变换在路标识别中的应用

- 格式:pdf

- 大小:172.65 KB

- 文档页数:5

基于K-L 变换的iris 数据分类一、实验原理K-L 变换是一种基于目标统计特性的最佳正交变换。

它具有一些优良的性质:即变换后产生的新的分量正交或者不相关;以部分新的分量表示原矢量均方误差最小;变换后的矢量更趋确定,能量更集中。

这一方法的目的是寻找任意统计分布的数据集合之主要分量的子集。

设n 维矢量12,,,Tn x x x ⎡⎤⎣⎦=x ,其均值矢量E ⎡⎤⎣⎦=μx ,协方差阵()T x E ⎡⎤⎣⎦=--C x u)(x u ,此协方差阵为对称正定阵,则经过正交分解克表示为x =T C U ΛU ,其中12,,,[]n diag λλλ=Λ,12,,,n u u u ⎡⎤⎣⎦=U 为对应特征值的特征向量组成的变换阵,且满足1T -=U U 。

变换阵T U 为旋转矩阵,再此变换阵下x 变换为()T -=x u y U ,在新的正交基空间中,相应的协方差阵12[,,,]x n diag λλλ==x UC U C 。

通过略去对应于若干较小特征值的特征向量来给y 降维然后进行处理。

通常情况下特征值幅度差别很大,忽略一些较小的值并不会引起大的误差。

对经过K-L 变换后的特征向量按最小错误率bayes 决策和BP 神经网络方法进行分类。

二、实验步骤(1)计算样本向量的均值E ⎡⎤⎣⎦=μx 和协方差阵()T x E ⎡⎤⎣⎦=--C x u)(x u 5.8433 3.0573 3.7580 1.1993⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦=μ,0.68570.0424 1.27430.51630.04240.189980.32970.12161.27430.3297 3.1163 1.29560.51630.1216 1.29560.5810x ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦----=--C (2)计算协方差阵x C 的特征值和特征向量,则4.2282 , 0.24267 , 0.07821 , 0.023835[]diag =Λ-0.3614 -0.6566 0.5820 0.3155 0.0845 -0.7302 -0.5979 -0.3197 -0.8567 0.1734 -0.0762 -0.4798 -0.3583 0.0755 -0.5458 0.7537⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦=U 从上面的计算可以看到协方差阵特征值0.023835和0.07821相对于0.24267和4.2282很小,并经计算个特征值对误差影响所占比重分别为92.462%、5.3066%、1.7103%和0.52122%,因此可以去掉k=1~2个最小的特征值,得到新的变换阵12,,,new n k u u u -⎡⎤⎣⎦=U 。

Karhunen-Loeve 变换的应用摘要:本文对Karhunen-Loeve 变换的原理进行了说明,重点分析了K-L 变换的性质,结合K-L 变换的性质,对K-L 变换的具体应用进行了展示。

利用K-L 变换在人脸识别、遥感图像特征提取、地震波噪声抑制、数字图像压缩、语音信号增强中的具体利用,深入总结了K-L 变换在模式识别、噪声抑制和数据压缩领域的重要性。

关键字: Karhunen-Loeve 变换 K-L 变换 K-L 展开1、 Karhunen-Loeve 变换定义1.1Karhunen-Loeve 变换的提出在模式识别和图像处理等现实问题中,需要解决的一个主要的问题就是降维,通常我们选择的特征彼此相关,而在识别这些特征时,数据量大且效率低下。

如果我们能减少特征的数量,即减少特征空间的维数,那么我们将以更少的存储和计算复杂度获得更好的准确性。

于是我们需要一种合理的综合性方法,使得原本相关的特征转化为彼此不相关,并在特征量的个数减少的同时,尽量不损失或者稍损失原特征中所包含的信息。

Karhunen-Loeve 变换也常称为主成分变换(PCA)或霍特林变换,就可以简化大维数的数据集合,而且它的协方差矩阵除对角线以外的元素都是零,消除了数据之间的相关性。

所以可以用于信息压缩、图像处理、模式识别等应用中。

Karhunen-Loeve 变换,是以矢量信号X 的协方差矩阵Ф的归一化正交特征矢量q 所构成的正交矩阵Q ,来对该矢量信号X 做正交变换Y=QX ,则称此变换为K-L 变换(K-LT 或KLT ),K-LT 是Karhuner-Loeve Transform 的简称,有的文献资料也写作KLT 。

可见,要实现KLT ,首先要从信号求出其协方差矩阵Ф,再由Ф求出正交矩阵Q 。

Ф的求法与自相关矩阵求法类似。

1.2Karhunen-Loeve 展开及其性质设零均值平稳随机过程u(n)构成的M 维随机向量为u(n),相应的相关矩阵为R ,则向量u(n)可以表示为R 的归一化特征向量M 21q ,q ,q 的线性组合,即iMi i q c n u ∑==1)(,此式称为u(n)的Karhunen-Loeve 展开式,展开式的系数i c 是由内积 )(c i n u q Hi =M ,1,2,i =定义的随机变量,且有{}0E =i c ,{}⎩⎨⎧≠==l i li c c i li ,0,E *λ。

K-L变换在面部识别中的应用摘要:人脸识别技术是当今的热门研究课题,本文对人脸识别技术在国内外的研究现状做了大致的介绍。

介绍了一种特征提取的方法K-L变换,并对此进行了应用举例。

关键字:人脸识别,K-L变换The Application of K-L transformin Human Face RecognitionCollege of Information Science and Technology,DongHua University Abstract:Nowadays,human face recognition technology is a hot research topic.This paper introduce the research status of face recognition technology at our country and overseas. Introducing a method the K-L transform which uses to extract features of face,and make a example of this method.Key word: human face recognition,K-L transform随着科技的不断进步,生物识别技术的发展也越来越受到人们的广泛关注。

在众多生物识别技术中,人脸识别技术以其使用方便、识别精确度高、速度快、用户接受度高、直观性突出和易于推广使用等诸多优点成为了当前最有发展潜力的生物别技术之一。

人脸识别特指利用分析比较人脸视觉特征信息进行身份鉴别的计算机技术。

人脸识别(Human Face Recognition)技术是一个涉及到模式识别、图像处理、计算机视觉、心理学以及认知科学等诸多方面的课题,并与其他的生物特征的身份鉴别方法以及计算机人机交互领域都密切联系[1]。

K-L变换的性质。

归结起来,它消除了各分量之间的相关性,因而用它来描述事物时,可以减少描述量的冗余性,做到用最经济有效的方法描述事物。

下面结合一些应用实例来说明如何运用K-L变换的这一性质。

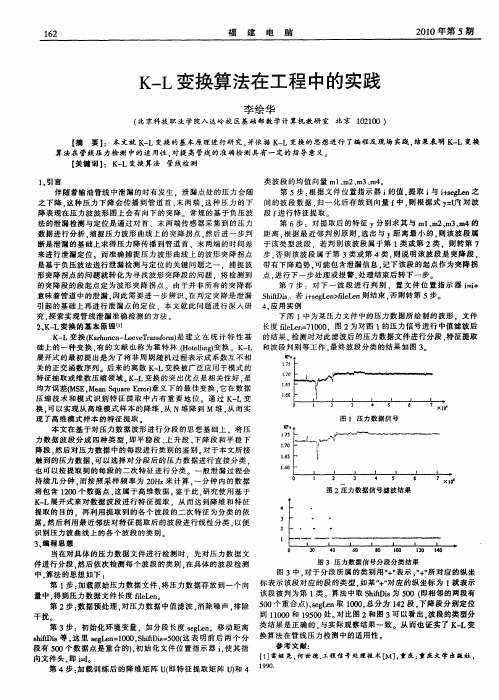

1.降维与压缩以人脸图象这个例子看,K-L变换的降维效果是十分明显的。

对一幅人脸图象,如果它由M行与N到象素组成,则原始的特征空间维数就应为M×N。

而如果在K-L变换以及只用到30个基,那么维数就降至30,由此可见降维的效果是极其明显的。

另一方面降维与数据压缩又是紧密联系在一起的。

譬如原训练样本集的数量为V,而现采用30个基,每个基实质上是一幅图象,再加上每幅图象的描述参数(式(补4-3)中的C),数据量是大大降低,尤其是图象数很大时,压缩量是十分明显的。

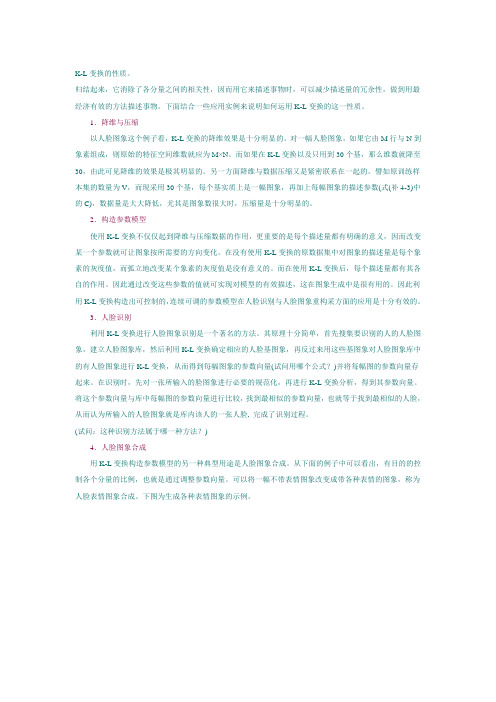

2.构造参数模型使用K-L变换不仅仅起到降维与压缩数据的作用,更重要的是每个描述量都有明确的意义,因而改变某一个参数就可让图象按所需要的方向变化。

在没有使用K-L变换的原数据集中对图象的描述量是每个象素的灰度值,而弧立地改变某个象素的灰度值是没有意义的。

而在使用K-L变换后,每个描述量都有其各自的作用。

因此通过改变这些参数的值就可实现对模型的有效描述,这在图象生成中是很有用的。

因此利用K-L变换构造出可控制的,连续可调的参数模型在人脸识别与人脸图象重构采方面的应用是十分有效的。

3.人脸识别利用K-L变换进行人脸图象识别是一个著名的方法。

其原理十分简单,首先搜集要识别的人的人脸图象,建立人脸图象库,然后利用K-L变换确定相应的人脸基图象,再反过来用这些基图象对人脸图象库中的有人脸图象进行K-L变换,从而得到每幅图象的参数向量(试问用哪个公式?)并将每幅图的参数向量存起来。

在识别时,先对一张所输入的脸图象进行必要的规范化,再进行K-L变换分析,得到其参数向量。

将这个参数向量与库中每幅图的参数向量进行比较,找到最相似的参数向量,也就等于找到最相似的人脸,从而认为所输入的人脸图象就是库内该人的一张人脸, 完成了识别过程。

k l变换原理

KL变换原理是一种基于信息论的数学方法,用于解决信号处理和模式识别问题。

它最早由著名的信息论学家Claude Shannon提出,得名于他的名字和信息熵的首字母。

KL变换原理可以用来衡量两个概率分布之间的差异。

它通过计算两个分布的KL散度来度量这种差异。

KL散度是一个非对称的度量,意味着它用来衡量一个概率分布相对于另一个分布的“信息损失”。

在信号处理中,KL变换可以将一个信号从一个域(如时域或空域)转换到另一个域(如频域或小波域)。

这种变换可以提取信号中的特征,并且常常用于信号压缩、图像处理和模式识别等应用中。

KL变换的基本思想是通过最小化KL散度的方式来找到最佳的变换。

这样做可以最大限度地保留信号中的信息,并且能够减少噪声和冗余。

根据KL变换原理的定义,当两个概率分布相同时,KL散度为0,即两个分布完全相同。

在实际应用中,KL变换原理可以应用于多种领域,如图像处理、语音识别、数据挖掘等。

它为处理复杂的信号和数据提供了一种有效且理论上坚实的方法。

然而,由于KL变换原理的计算复杂度较高,对于大规模数据和高维信号的处理仍然面临一定的挑战。

总之,KL变换原理是一种重要的数学方法,用于解决信号处

理和模式识别问题。

它通过度量概率分布之间的差异来提取信号中的特征,并且在多个领域中得到广泛应用。

K-L 变换在人脸识别中的应用控制理论与控制工程 杨宪强 学号:2008011629摘要主成分分析(PCA)是自动人脸识别的常用方法,其基本原理就是用较少数量的特征对样本进行描述以达到降低特征空间维数的方法,方法的基础是Karhunen-Loeve 展开式简称K-L 展开式。

文中介绍了K-L 变换的基本原理,及其应用该方法进行人脸识别的基本步骤,最后给出基于总体散布矩阵和类间散布矩阵做为产生矩阵的K-L 变换进行人脸识别的matlab 程序,并对识别率进行了统计。

1. K-L 变换的基本原理特征脸方法是基于K-L 变换的人脸识别方法,K-L 变换是图像压缩的一种最优正交变换。

高维的图像空间经过K-L 变换后得到一组新的正交基,保留其中重要的正交基,由这些基可以张成低维线性空间。

如果假设人脸在这些低维线性空间的投影具有可分性,就可以将这些投影用作识别的特征矢量,这就是特征脸方法用于人脸识别的基本思想。

在人脸识别中,可以用离散K-L 变换对人脸图像的原始空间进行转换,即构造人脸图像数据集的协方差矩阵,对之进行正交变换,求出协方差矩阵的特征向量,再依据特征值的大小对这些特征向量进行排序,每一个向量表示人脸图像中一个不同数量的变量,这些特征向量表示特征的一个集合,它们共同表示一个人脸图像。

在人脸识别领域,人们常称这些特征向量为特征脸。

每一个体人脸图像都可以确切地表示为一组特征脸的线性组合。

这样我们首先通过有指导的训练(给定训练样本集已知分类)得到样本集在特征脸空间中的坐标。

训练完成后,输入待辨识图像,求得在特征脸空间的坐标,采用最近邻法,就可以实现人脸识别。

2.K-L 变换进行人脸识别的基本步骤2.1 训练过程1.给定样本集,在这里样本集的大小为360,一共是40人,每人9张图片。

我选取每人5张图片一共200张作为训练集,训练集的大小是可选的,它的大小将直接影响到识别的正确率,在后面我对采用不同大小的训练集进行识别的正确率进行了统计。

K-L 变换(Karhunen-Lo éve )离散K-L 展开式的矩阵表示设非周期随机过程)(t x ,在采样区间[a, b]作均匀采样,采样样本表示为向量⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=)()()(21D t x t x t x x (理解为每个样本向量有D 个特征)其相关函数][T xx E 为D 维方阵,有D 个线性无关的特征向量。

【假如有N 个采样样本,⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎣⎡=⨯DN D D N N ND x x x x x x x x x212222111211x , 相关函数][Txx E =TN D N D N⨯⨯x x 1】 则采样序列x 的展开式仅含有D 项∑-=Dj j c 1jx ϕ,式中,j ϕ为第j 个正交基函数(也叫基向量),j c 为对应的展开式系数。

【对于“K-L 展开式满足正交变换,且是最小均方误差的”证明如下:】假设向量集合),2,1}({ =i i x 中的x 可以用完备正交归一向量系或者称为变换基向量),,2,1(∞= j i u 来展开,则有∑∞==1j j j c u x基向量满足正交性⎩⎨⎧≠==i j ij j T i ,0,1u u在离散情况下使用有限基向量集合来表示,即∑==dj jj c 1ˆux其均方误差为][)]()[()]ˆ()ˆ[(1211∑∑∑∞+=∞+=∞+===--=d j jd j jjT d j jjTcE c c E E u u x x xx ξ将展开式系数x u Tj j c =(理解为x 在基坐标上的投影,而展开式系数就是坐标值)代入均方误差表达式,有∑∑∑∞+=∞+=∞+====111)(][d j jT jd j j TT jd j j TT jE E ψuu u xx uu xx u ξ(理解上式中j TT j j c u x x u ==,因为是行向量和列向量))(T E xx ψ=为自相关矩阵(这是一个对称矩阵,因为T T T xx xx =)()由拉格朗日条件极值法求均方误差的极限,相应的拉格朗日函数为]1[)(11--=∑∑∞+=∞+=jT jd j jd j j Tjj L u u ψu uu λ令0)(=j jL d du u (理解j 从的d +1取到无穷,总共就有这么多方程) 则022=-j j j u ψu λ得0)(=-j j u E ψλ,∞+=,,1 d j 【 这是矩阵的导数问题!相关概念知识如下: 令A 是一个与列向量x 无关的矩阵,则T ∂=∂x A A x , ()T T T ∂=+=+∂x AxAx A x A A x x 特别地,若A 为对称矩阵,则有2T ∂=∂x AxAx x证明:前半部分:假设111221112222111112212211122111222222()()()()Tx a x a x a x a x x a a aa x a x a x a x a x x ∂∂⎡⎤++⎢⎥∂∂⎡⎤∂⎢⎥===⎢⎥∂∂∂⎢⎥⎣⎦++⎢⎥∂∂⎣⎦x A A x 后半部分:11nnTij i j i j A x x ===∑∑x Ax — 一个多项式梯度T ∂∂x Axx(是一个列向量)的第k 个分量为1111[]T n n n nk ij ijik ikjji j i j kA x x A x A xx ====∂∂==+∂∂∑∑∑∑x Ax x()T T T ∂=+=+∂x AxA x Ax A A x x】 其解就是使均方误差为极小的基向量j u ,同时求得的j u 为矩阵ψ的特征向量,其对应的特征值为j λ,则截断均方误差为∑∞+==1d j jλξ(此处用矩阵对角化的概念理解j j T j λ=ψu u ),式中j λ为矩阵ψ的特征值。