信息论与编码-概述-思维导图

- 格式:pdf

- 大小:560.70 KB

- 文档页数:1

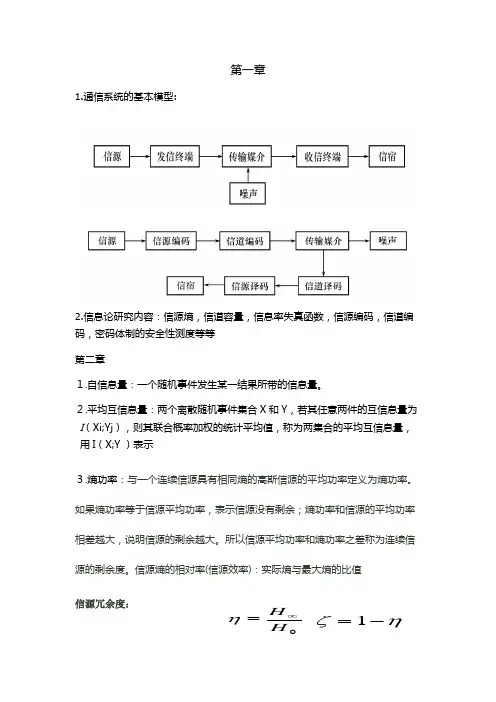

第一章1.通信系统的基本模型:2.信息论研究内容:信源熵,信道容量,信息率失真函数,信源编码,信道编码,密码体制的安全性测度等等第二章1.自信息量:一个随机事件发生某一结果所带的信息量。

2.平均互信息量:两个离散随机事件集合X 和Y ,若其任意两件的互信息量为 I (Xi;Yj ),则其联合概率加权的统计平均值,称为两集合的平均互信息量,用I (X;Y )表示3.熵功率:与一个连续信源具有相同熵的高斯信源的平均功率定义为熵功率。

如果熵功率等于信源平均功率,表示信源没有剩余;熵功率和信源的平均功率相差越大,说明信源的剩余越大。

所以信源平均功率和熵功率之差称为连续信源的剩余度。

信源熵的相对率(信源效率):实际熵与最大熵的比值信源冗余度:0H H ∞=ηηζ-=1意义:针对最大熵而言,无用信息在其中所占的比例。

3.极限熵:平均符号熵的N 取极限值,即原始信源不断发符号,符号间的统计关系延伸到无穷。

4.5.离散信源和连续信源的最大熵定理。

离散无记忆信源,等概率分布时熵最大。

连续信源,峰值功率受限时,均匀分布的熵最大。

平均功率受限时,高斯分布的熵最大。

均值受限时,指数分布的熵最大6.限平均功率的连续信源的最大熵功率:称为平均符号熵。

定义:即无记忆有记忆N X H H X H N X H X NH X H X H X H N N N N N N )()()()()()()(=≤∴≤≤若一个连续信源输出信号的平均功率被限定为p ,则其输出信号幅度的概率密度分布是高斯分布时,信源有最大的熵,其值为1log 22ep π.对于N 维连续平稳信源来说,若其输出的N 维随机序列的协方差矩阵C 被限定,则N 维随机矢量为正态分布时信源的熵最大,也就是N 维高斯信源的熵最大,其值为1log ||log 222N C e π+ 7.离散信源的无失真定长编码定理:离散信源无失真编码的基本原理原理图说明: (1) 信源发出的消息:是多符号离散信源消息,长度为L,可以用L 次扩展信源表示为: X L =(X 1X 2……X L )其中,每一位X i 都取自同一个原始信源符号集合(n 种符号): X={x 1,x 2,…x n } 则最多可以对应n L 条消息。

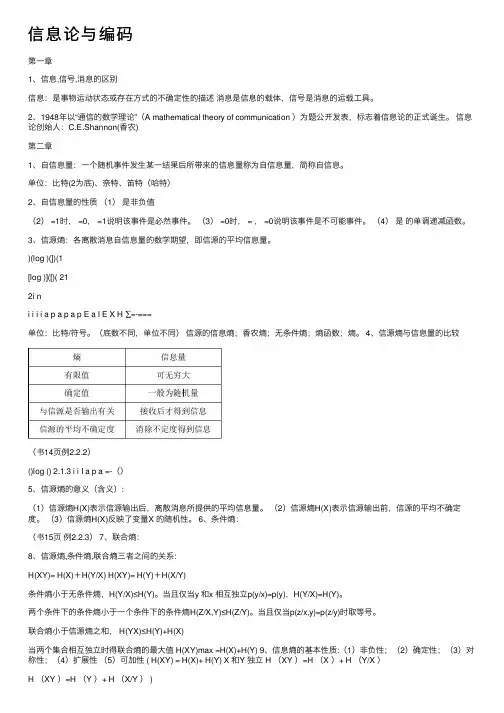

信息论与编码第⼀章1、信息,信号,消息的区别信息:是事物运动状态或存在⽅式的不确定性的描述消息是信息的载体,信号是消息的运载⼯具。

2、1948年以“通信的数学理论”(A mathematical theory of communication )为题公开发表,标志着信息论的正式诞⽣。

信息论创始⼈:C.E.Shannon(⾹农)第⼆章1、⾃信息量:⼀个随机事件发⽣某⼀结果后所带来的信息量称为⾃信息量,简称⾃信息。

单位:⽐特(2为底)、奈特、笛特(哈特)2、⾃信息量的性质(1)是⾮负值(2) =1时, =0, =1说明该事件是必然事件。

(3) =0时, = , =0说明该事件是不可能事件。

(4)是的单调递减函数。

3、信源熵:各离散消息⾃信息量的数学期望,即信源的平均信息量。

)(log )(])(1[log )]([)( 212i ni i i i a p a p a p E a I E X H ∑=-===单位:⽐特/符号。

(底数不同,单位不同)信源的信息熵;⾹农熵;⽆条件熵;熵函数;熵。

4、信源熵与信息量的⽐较(书14页例2.2.2)()log () 2.1.3 i i I a p a =-()5、信源熵的意义(含义):(1)信源熵H(X)表⽰信源输出后,离散消息所提供的平均信息量。

(2)信源熵H(X)表⽰信源输出前,信源的平均不确定度。

(3)信源熵H(X)反映了变量X 的随机性。

6、条件熵:(书15页例2.2.3) 7、联合熵:8、信源熵,条件熵,联合熵三者之间的关系:H(XY)= H(X)+H(Y/X) H(XY)= H(Y)+H(X/Y)条件熵⼩于⽆条件熵,H(Y/X)≤H(Y)。

当且仅当y 和x 相互独⽴p(y/x)=p(y),H(Y/X)=H(Y)。

两个条件下的条件熵⼩于⼀个条件下的条件熵H(Z/X,Y)≤H(Z/Y)。

当且仅当p(z/x,y)=p(z/y)时取等号。

联合熵⼩于信源熵之和, H(YX)≤H(Y)+H(X)当两个集合相互独⽴时得联合熵的最⼤值 H(XY)max =H(X)+H(Y) 9、信息熵的基本性质:(1)⾮负性;(2)确定性;(3)对称性;(4)扩展性(5)可加性 ( H(XY) = H(X)+ H(Y) X 和Y 独⽴ H (XY )=H (X )+ H (Y/X )H (XY )=H (Y )+ H (X/Y ) )(6)(重点)极值性(最⼤离散熵定理):信源中包含n 个不同离散消息时,信源熵H(X)有当且仅当X 中各个消息出现的概率全相等时,上式取等号。