全局最优化算法

- 格式:pdf

- 大小:588.97 KB

- 文档页数:30

⼏种常见的优化算法⼏种常见的优化算法:参考:我们每个⼈都会在我们的⽣活或者⼯作中遇到各种各样的最优化问题,⽐如每个企业和个⼈都要考虑的⼀个问题“在⼀定成本下,如何使利润最⼤化”等。

最优化⽅法是⼀种数学⽅法,它是研究在给定约束之下如何寻求某些因素(的量),以使某⼀(或某些)指标达到最优的⼀些学科的总称。

随着学习的深⼊,博主越来越发现最优化⽅法的重要性,学习和⼯作中遇到的⼤多问题都可以建模成⼀种最优化模型进⾏求解,⽐如我们现在学习的机器学习算法,⼤部分的机器学习算法的本质都是建⽴优化模型,通过最优化⽅法对⽬标函数(或损失函数)进⾏优化,从⽽训练出最好的模型。

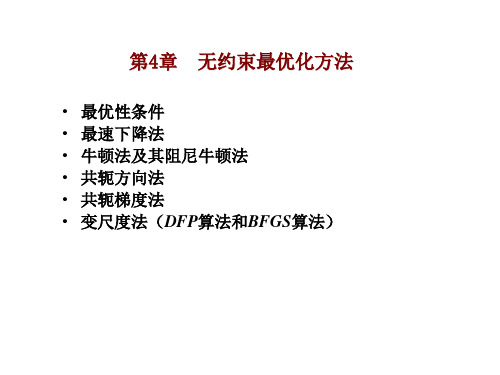

常见的最优化⽅法有梯度下降法、⽜顿法和拟⽜顿法、共轭梯度法等等。

1. 梯度下降法(Gradient Descent)梯度下降法是最早最简单,也是最为常⽤的最优化⽅法。

梯度下降法实现简单,当⽬标函数是凸函数时,梯度下降法的解是全局解。

⼀般情况下,其解不保证是全局最优解,梯度下降法的速度也未必是最快的。

梯度下降法的优化思想是⽤当前位置负梯度⽅向作为搜索⽅向,因为该⽅向为当前位置的最快下降⽅向,所以也被称为是”最速下降法“。

最速下降法越接近⽬标值,步长越⼩,前进越慢。

梯度下降法的搜索迭代⽰意图如下图所⽰:梯度下降法的缺点: (1)靠近极⼩值时收敛速度减慢,如下图所⽰; (2)直线搜索时可能会产⽣⼀些问题; (3)可能会“之字形”地下降。

从上图可以看出,梯度下降法在接近最优解的区域收敛速度明显变慢,利⽤梯度下降法求解需要很多次的迭代。

在机器学习中,基于基本的梯度下降法发展了两种梯度下降⽅法,分别为随机梯度下降法和批量梯度下降法。

⽐如对⼀个线性回归(Linear Logistics)模型,假设下⾯的h(x)是要拟合的函数,J(theta)为损失函数,theta是参数,要迭代求解的值,theta求解出来了那最终要拟合的函数h(theta)就出来了。

其中m是训练集的样本个数,n是特征的个数。

五种最优化方法范文最优化是一个数学领域,在解决实际问题时,通过寻找最优解的方法,使得目标函数的值最小或最大化。

在最优化问题中,有许多不同的方法可以用来求解。

以下是五种常见的最优化方法。

1.梯度下降法梯度下降法是一种基于梯度信息的迭代算法,用于求解最小化目标函数的最优解。

其基本思想是从初始点开始,根据负梯度方向进行迭代求解,直到达到预定的停止条件或收敛到最优解。

梯度下降法的优点是简单易实现,适用于大规模问题。

缺点是容易陷入局部最优或鞍点,并且收敛速度可能较慢。

2.牛顿法牛顿法是一种基于二阶导数信息的迭代算法,用于求解非线性最优化问题。

其基本思想是通过二阶泰勒展开近似目标函数,以牛顿法的更新方程进行迭代求解。

与梯度下降法相比,牛顿法收敛速度更快。

但牛顿法的缺点是需要计算目标函数的二阶导数矩阵,计算代价较大,并且需要满足一定的收敛条件。

3.拟牛顿法拟牛顿法是一种通过拟合目标函数的局部特征来逼近牛顿法的方法。

常用的拟牛顿法有DFP(Davidon-Fletcher-Powell)方法和BFGS (Broyden-Fletcher-Goldfarb-Shanno)方法。

拟牛顿法利用目标函数的一阶导数信息来近似目标函数的二阶导数矩阵,从而避免了计算二阶导数的复杂性,且收敛速度比梯度下降法更快。

拟牛顿法的缺点是需要存储和更新一个Hessian矩阵的逆或近似逆。

4.线性规划线性规划是一种最优化问题的形式,其中目标函数和约束条件都是线性的。

线性规划问题可以通过线性规划算法求解,如单纯形法、内点法等。

线性规划问题具有良好的理论基础和高效的求解方法。

线性规划在工业、供应链管理、运输问题等方面有广泛的应用。

5.整数规划整数规划是一种最优化问题的形式,其中决策变量只能取整数值。

整数规划问题可以通过整数规划算法求解,如分支定界法、割平面法等。

整数规划在许多实际情况下具有重要的应用,例如在生产计划、线路设计、货物装载等问题中。

最优化理论与算法(数学专业研究生)第一章 引论§1.1 引言一、历史与现状最优化理论最早可追溯到古老的极值问题,但成为一门独立的学科则是在20世纪四十年代末至五十年代初。

其奠基性工作包括Fritz John 最优性条件(1948),Kuhn-Tucker 最优性条件(1951),和Karush 最优性条件(1939)。

近几十年来最优化理论与算法发展十分迅速,应用也越来越广泛。

现在已形成一个相当庞大的研究领域。

关于最优化理论与方法,狭义的主要指非线性规划的相关内容,而广义的则涵盖:线性规划、非线性规划、动态规划、整数规划、几何规划、多目标规划、随机规划甚至还包括变分、最优控制等动态优化内容。

本课程所涉及的内容属于前者。

二、最优化问题的一般形式 1、无约束最优化问题min ()nx Rf x ∈ (1.1) 2、约束最优化问题min ()()0, ..()0, i i f x c x i E s t c x i I=∈⎧⎨≥∈⎩ (1.2)这里E 和I 均为指标集。

§1.2数学基础一、 范数 1. 向量范数max i x x ∞= (l ∞范数) (1.3)11ni i x x ==∑ (1l 范数) (1.4)12221()ni i x x ==∑ (2l 范数) (1.5)11()np pi pi xx ==∑ (p l 范数) (1.6)12()TAxx Ax = (A 正定) (椭球范数) (1.7)事实上1-范数、2-范数与∞-范数分别是 p -范数当 p =1、2和p →∞时情形。

2.矩阵范数定义1.1 方阵A 的范数是指与A 相关联并记做A 的一个非负数,它具有下列性质: ① 对于0A ≠都有0A >,而0A =时0A =; ② 对于任意k R ∈,都有kA k A =; ③ A B A B +≤+; ④ AB A B ≤; 若还进一步满足: ⑤ pp AxA x ≤则称之为与向量范数p相协调(相容)的方阵范数。

最优化基础理论与⽅法⽬录1.最优化的概念与分类 (2)2. 最优化问题的求解⽅法 (3)2.1线性规划求解 (3)2.1.1线性规划模型 (3)2.1.2线性规划求解⽅法 (3)2.1.3 线性规划算法未来研究⽅向 (3)2.2⾮线性规划求解 (4)2.2.1⼀维搜索 (4)2.2.2⽆约束法 (4)2.2.3约束法 (4)2.2.4凸规划 (5)2.2.5⼆次规划 (5)2.2.6⾮线性规划算法未来研究⽅向 (5)2.3组合规划求解⽅法 (5)2.3.1 整数规划 (5)2.3.2 ⽹络流规划 (7)2.4多⽬标规划求解⽅法 (7)2.4.1 基于⼀个单⽬标问题的⽅法 (7)2.4.2 基于多个单⽬标问题的⽅法 (8)2.4.3多⽬标规划未来的研究⽅向 (8)2.5动态规划算法 (8)2.5.1 逆推解法 (8)2.5.2 顺推解法 (9)2.5.3 动态规划算法的优点及研究⽅向 (9)2.6 全局优化算法 (9)2.6.1 外逼近与割平⾯算法 (9)2.6.2 凹性割⽅法 (9)2.6.3 分⽀定界法 (9)2.6.4 全局优化的研究⽅向 (9)2.7随机规划 (9)2.7.1 期望值算法 (10)2.7.2 机会约束算法 (10)2.7.3 相关机会规划算法 (10)2.7.4 智能优化 (10)2.8 最优化软件介绍 (11)3 最优化算法在电⼒系统中的应⽤及发展趋势 (12)3.1 电⼒系统的安全经济调度问题 (12)3.1.1电⼒系统的安全经济调度问题的介绍 (12)3.1.2电⼒系统的安全经济调度问题优化算法的发展趋势 (12)2. 最优化问题的求解⽅法最优化⽅法是近⼏⼗年形成的,它主要运⽤数学⽅法研究各种优化问题的优化途径及⽅案,为决策者提供科学决策的依据。

最优化⽅法的主要研究对象是各种有组织系统的管理问题及其⽣产经营活动。

最优化⽅法的⽬的在于针对所研究的系统,求得⼀个合理运⽤⼈⼒、物⼒和财⼒的最佳⽅案,发挥和提⾼系统的效能及效益,最终达到系统的最优⽬标。

求全局最优化的几种确定性算法全局最优化是一个在给定约束条件下寻找函数全局最小或最大值的问题。

确定性算法是指每次运行算法都能得到相同的结果,且结果能确保接近全局最优解。

以下是几种常见的确定性算法:1. 梯度下降法(Gradient Descent)梯度下降法是一种迭代优化算法,通过沿负梯度方向逐步调整参数值,直至找到函数的最小值或最大值。

该算法对于凸函数是有效的,但可能会陷入局部最优解。

可以通过调整学习率和选择不同的初始参数值来改进算法的效果。

2. 牛顿法(Newton's Method)牛顿法利用函数的二阶导数信息来找到函数的最小值或最大值。

它基于泰勒级数展开,通过使用当前点的一阶和二阶导数来逼近函数,然后迭代地更新参数值。

牛顿法通常比梯度下降法更快地收敛到全局最优解,但它可能需要计算和存储较大的二阶导数矩阵。

3. 共轭梯度法(Conjugate Gradient)共轭梯度法是一种迭代法,用于求解线性方程组或优化问题。

它利用问题的海森矩阵或其逼近的特殊性质,在有限次迭代后得到准确解。

共轭梯度法在解决大规模问题时具有可伸缩性,且不需要存储大规模矩阵。

4. BFGS算法(Broyden–Fletcher–Goldfarb–Shanno Algorithm)BFGS算法是一种拟牛顿法,用于解决无约束非线性优化问题。

它通过近似目标函数的海森矩阵的逆矩阵来逼近最优解,从而避免了计算海森矩阵的复杂性。

BFGS算法具有快速的收敛性和较好的全局收敛性。

5. 遗传算法(Genetic Algorithms)遗传算法是一种模拟生物进化过程的优化方法,通过模拟自然界的选择、交叉和变异过程来最优解。

它将问题表示成一个个基因型,通过使用选择、交叉和变异等操作来产生新的个体,并根据适应度函数评估每个个体的好坏。

遗传算法具有全局能力,可以处理非线性、非凸函数以及离散优化问题。

6. 粒子群优化算法(Particle Swarm Optimization)粒子群优化算法是一种模拟鸟群或鱼群行为的优化算法。

几种典型仿生优化算法的比较及混沌蚁群算法介绍1、几种典型仿生优化算法的比较自上世纪50年代以来,人们从生物进化的机理中受到启发,构造和设计出许多仿生优化算法,如遗传算法、蚁群算法、粒子群算法、捕食搜索算法等,它们都属于一类模拟自然界生物系统、完全依赖生物体自身体能、通过无意识寻优行为来优化其生存状态以适应环境需要的最优化智能算法。

它们都有着自已的特点,适合不同类型的实际问题。

1.1共同点1、都是一类不确定的概率型全局优化算法。

仿生优化算法的不确定性是伴随其随机性而来的,其主要步骤含有随机因素,有更多的机会求得全局最优解,比较灵活。

2、都不依赖于优化问题本身的严格数学性质,都具有稳健性。

在优化过程中都不依赖于优化问题本身的严格数学性质以及目标函数和约束条件的精确数学描述。

因此在求解许多不同问题时,只需要设计相应的评价函数,基本无需修改算法的其它部分,在不同条件和环境下算法的适用性和有效性很强。

3、都是一种基于多个智能体的仿生算法,表现出与环境交互的能力。

仿生优化算法中的各个智能体之间通过相互协作来更好地适应环境,表现出与环境交互的能力。

4、都具有本质并行性。

一是仿生优化的内在并行性,即非常适合大规模并行;二是仿生优化计算的内含并行性,能使其以较少的计算获得较大的收益。

5、都具有突现性。

即仿生算法总目标的完成是在多个智能体个体行为运动过程中突现出来的。

6、都具有自组织性和进化性。

在不确定的环境中,可通过自学习不断提高算法中个体的适应性。

1.2不同点1、遗传算法:以决策变量的编码作为运算对象,借鉴了生物学的染色体概念,模拟自然界中生物遗传和进化的精英策略,采用个体评价函数进行选择操作,并采用交叉、变异算子产生新的个体,使算法具有较大的灵活性和可扩展性。

缺点:求解到一定范围时往往做大量无为的冗余迭代,求精确解效率低。

2、蚁群算法:采用正反馈机制或称是一种增强性学习系统,通过不断更新信息素达到最终收敛于最优路径的目的,这是其不同于其它仿生优化算法的显著特点。

全面而强大的设计优化算法库数值优化、直接搜索、全局优化、多目标优化算法,是工程师开展设计优化工作的利器。

数值优化通常的工程优化问题具有非线性、连续的特点,数值优化是解决这类问题的理想方法。

数值优化算法能够利用函数的导数、梯度等数学特征,实现高效的优化。

数值优化算法的优点是:ü能有效探索初始设计点周围局部区域ü如果设计空间是连续、单峰的形态,能够沿最快下降方向快速探索ü特定条件下,能从数学上证明其收敛性。

梯度算法的缺点是:ü非常依赖初始设计点,有可能落入局部解ü当变量数增加时,求解梯度的计算代价急剧增加ü如果无法求得解析的梯度公式,则必需采用有限差分算法求解梯度算法简称算法全称MMFD 修正可行方向法(Modified Method of Feasible Directions)LSGRG 广义下降梯度法(Large Scale Generalized Reduced Gradient)NLPQL 序列二次规划(Schittkowski改良版,Sequential Quadratic Programming )MOST 多功能优化系统技术(Multifunction Optimization System Tool)MISQP 混合整型序列二次规划(Mixed-Integer Squential Quadratic Programming)直接搜索法直接搜索法无须计算任何函数梯度,当优化问题中的目标函数较为复杂或者不能用变量显函数描述时,可采用直接搜索的方法搜索到最优点。

Isight中提供的直接法包括:算法简称算法全称HJ 霍克-吉维斯直接搜索法(Hooke-Jeeves Direct Search Method)DS 下山单纯形法(Downhill Simplex)直接法特点如下:优点缺点1) 能有效探索初始设计点周围局部区域2) 探索阶段采用大步长,因此能够探索到比梯度优化算法更大的设计空间。