第五章贝叶斯估计

- 格式:docx

- 大小:256.84 KB

- 文档页数:9

第五章贝叶斯估计例题

第五章贝叶斯估计例题:

这是一个关于抽样分析的贝叶斯估计问题。

考虑总体N及其未知

的总体参数θ,设定如下模型:

在集合A中,X~Binomial(n,θ),θ~Beta(α,β) , α>0, β>0

在本题中,要求求出θ的贝叶斯估计量。

首先,设定一个合理的先验分布,记作π(θ),π(θ)~beta(α,β),∵α>0, β>0,所以可知α=1, β=1.

之后再计算条件概率分布P(A|θ),即根据已知条件求得θ的后

验分布,此时

P(θ|A)=P(A|θ)π(θ)/P(A)=P(A|θ)π(θ)

由此可知

P(θ|A)=P(A|θ)π(θ)=[θ^x(1-θ)^(n-x)]*[Beta(θ;

α,β)]/P(A)

最后再根据后验分布的表示式,计算后验期望值E(θ|A), 即为贝

叶斯估计量

E(θ|A)=∫θ·P(θ|A)dθ

由此计算,考虑到先验分布π(θ)的特殊形式,可知

E(θ|A)=(x+α)/(n+α+β)

因此,求得θ的贝叶斯估计量为:(x+α)/(n+α+β)。

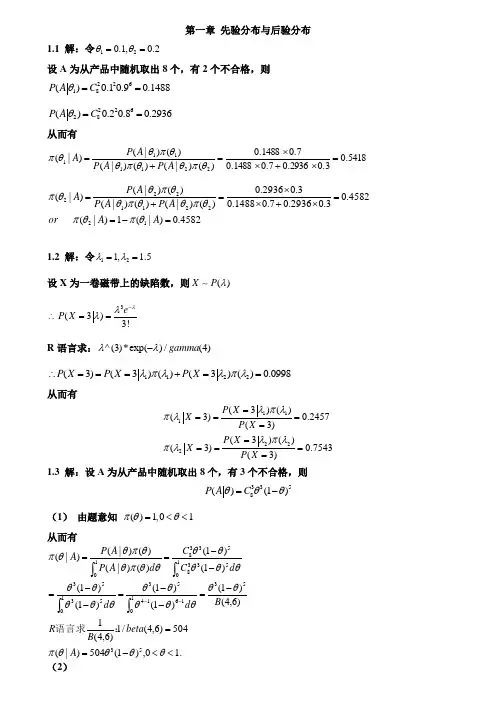

第一章 先验分布与后验分布1.1 解:令120.1,0.2θθ==设A 为从产品中随机取出8个,有2个不合格,则22618()0.10.90.1488P A C θ== 22628()0.20.80.2936P A C θ== 从而有5418.03.02936.07.01488.07.01488.0)()|()()|()()|()|(2211111=⨯+⨯⨯=+=θπθθπθθπθθπA P A P A P A 4582.0)|(1)|(4582.03.02936.07.01488.03.02936.0)()|()()|()()|()|(122211222=-==⨯+⨯⨯=+=A A or A P A P A P A θπθπθπθθπθθπθθπ1.2 解:令121, 1.5λλ==设X 为一卷磁带上的缺陷数,则()XP λ∴3(3)3!e P X λλλ-==R 语言求:)4(/)exp(*)3(^gamma λλ-1122(3)(3)()(3)()0.0998P X P X P X λπλλπλ∴===+== 从而有111222(3)()(3)0.2457(3)(3)()(3)0.7543(3)P X X P X P X X P X λπλπλλπλπλ==========1.3 解:设A 为从产品中随机取出8个,有3个不合格,则3358()(1)P A C θθθ=-(1) 由题意知 ()1,01πθθ=<< 从而有.10,)1(504)|(504)6,4(/1)6,4(1)6,4()1()1()1()1()1()1()1()()|()()|()|(535311614531535315338533810<<-==-=--=--=--==⎰⎰⎰⎰--θθθθπθθθθθθθθθθθθθθθθθθθπθθπθθπA beta B R B d d d C C d A P A P A :语言求(2).10,)1(840)|(840)7,4(/1)7,4(1)7,4()1()1()1()1()1()1(2)1()1(2)1()()|()()|()|(636311714631636315338533810<<-==-=--=--=----==⎰⎰⎰⎰--θθθθπθθθθθθθθθθθθθθθθθθθθθπθθπθθπA beta B R B d d d C C d A P A P A :语言求1.5 解:(1)由已知可得.5.125.11,110110/1)()|()()|()|(,2010,101)(5.125.111)|(2112211)|(12,2121,1)|(5.125.11201011111111<<===<<=<<=+<<-==+<<-=⎰⎰θθθθπθθπθθπθθπθθθθθθθθd d x p x p x x p x p x x x p ,,即,时,当(2)由已知可得.6.115.11,1010110/1)()|,,()()|,,(),,|(,2010,101)(6.115.111)|,,(,219.1121,214.1121,211.1121,217.1121215.11212112211)|,,(9.11,4.11,1.11,7.11,5.11,0.12,6,2,1,2121,1)|,,(6.115.112010621621621621621654321621<<===<<=<<=+<<-+<<-+<<-+<<-+<<-+<<-========+<<-=⎰⎰θθθθπθθπθθπθθπθθθθθθθθθθθθθθθθθθd d x x x p x x x p x x x x x x p x x x p x x x x x x i x x x x p i ,即,,时,当【原答案:由已知可得 ()1,0.50.5P x x θθθ=-<<+1(),102010πθθ=<< 11.611.51()0.0110m x d θ==⎰从而有()()()10,11.511.6()P x x m x θπθπθθ==<< 】1.6 证明:设随机变量()XP λ,λ的先验分布为(,)Ga αβ,其中,αβ为已知,则即得证!),(~),,|()()|,,(),,|(,0,)()(,!!)|,,(121)(121211112111βαλπλλπλλπλλαβλπλλλλβαβλααλλ++∑∑∝•∝>Γ=∑===+--+--=-=-==∏∏n x Ga x x x ex x x p x x x e x e x ex x x p ni i n n x n n ni in x ni i x n ni i ni ii【原答案: (),0!x e P x x λλλλ-=>1(),0()e ααβλβπλλλα--=>Γ 因此 11(1)()()()x x x P x e e e λαβλαβλπλλπλλλλ---+--+∝•∝= 所以 (,1)x Ga x λαβ++】 1.7 解:(1)由题意可知.1},max{,1)/(1)/(122)()|,,()()|,,(),,|(,10,1)(,,2,1,10,22)|,,(121},max{221},max{2121121212112122111<<∝===<<==<<<==⎰⎰∏∏⎰∏∏====θθθθθθθθθθπθθπθθπθθπθθθθn nx x nn x x nni in nni inn n n ni i nni inin x x d d x xd x x x p x x x p x x x n i x xx x x x p n n【原答案:由题意可知 ()1,01πθθ=<< 因此122()12(1)xxm x d x θθ=•=-⎰因此 2()()1(),1()1P x x x x m x x θπθπθθθ==<<- (实质是新解当n=1的情形)】(2) 由题意可知.1},max{,1)/(1)/(13232)()|,,()()|,,(),,|(,10,3)(,,2,1,10,22)|,,(12-21},max{2-22-21},max{2212211212121212122111<<∝=⨯⨯==<<==<<<==⎰⎰∏∏⎰∏∏====θθθθθθθθθθθθπθθπθθπθθθπθθθθn n x x n n x x nni in nni inn n n ni i nni inin x x d d x xd x x x p x x x p x x x n i x xx x x x p n n【原答案:由题意可知 1222()36xm x d x θθθ=•=⎰因此 ()()()1,01()P x x m x θπθπθθ==<<】 1.8 解:设A 为100个产品中3个不合格,则3397100()(1)P A C θθθ=-由题意可知 199(202)()(1),01(200)πθθθθΓ=-≤≤Γ 因此 3971994296()()()(1)(1)(1)A P A πθθπθθθθθθθ∝•∝--=- 由上可知)297,5(~)|(Be A θπ1.9 解:设X 为某集团中人的高度,则2(,5)XN θ∴25(,)10XNθ ∴2(176.53)5()p x θθ--=由题意可知 2(172.72)5.08()θπθ--=又由于X 是θ的充分统计量,从而有()()()()x x p x πθπθθπθ=∝•222(176.53)(172.72)(174.64)55.0821.26eeeθθθ------⨯∝•∝因此 (174.64,1.26)x N θ1.10 证明:设22(,),,N u u θσσ其中为已知又由于X 是θ的充分统计量,从而有()()()()x x p x πθπθθπθ=∝•222222251()()11252()11225252u x x u eeeσθθθσσσ+----+⨯--⨯+⨯∝∝因此 222251(,)112525u x xN σθσσ+++又由于21112525σ≤+ 所以 θ的后验标准差一定小于151.11 解:设X 为某人每天早上在车站等候公共汽车的时间,则(0,)X U θ.8,861)/(1192192)()|,,()()|,,(),,|(,4,192)(.81)|,,(8,8,5.3,2,1,0,1)|,,(768778774321321321433213213321>⨯====≥=>=====<<=⎰⎰⎰∞∞∞θθθθθθθθθθπθθπθθπθθθπθθθθθθd d d x x x p x x x p x x x x x x p x x x i x x x x p i ,时,当【原答案:设X 为某人每天早上在车站等候公共汽车的时间,则(0,)XU θ∴1(),0p x x θθθ=<<当8θ>时,31()p x θθ=43819211()8192m x d θθθ+∞==⎰从而有 7()()3()()128p x x m x θπθπθθ==, 计算错误】1.12 证明:由题意可知 1(),0,1,2,...,i np x x i n θθθ=<<=从而有 ()()()()x x p x πθπθθπθ∝•00111n n n ααααθθθθθ++++∝•∝ 因此 θ的后验分布仍是Pareto 分布。

贝叶斯方法估计推断决策引言在数据分析与决策中,贝叶斯方法是一种基于概率统计的推理与决策方法。

贝叶斯方法通过给定观察到的数据,结合先验知识或假设,计算后验概率分布,从而进行推断与决策。

本文将介绍贝叶斯方法的基本原理、相关公式和应用场景。

贝叶斯方法的基本原理贝叶斯方法的基本原理可以用贝叶斯定理来表示。

贝叶斯定理是一种条件概率的计算方法,可以用来更新先验概率分布。

$$ P(A|B) = \\frac{{P(B|A) \\cdot P(A)}}{{P(B)}} $$其中,P(A|B)表示在已知事件 B 发生的条件下事件 A 发生的概率,P(B|A)表示在已知事件 A 发生的条件下事件 B 发生的概率,P(A)和P(B)分别表示事件 A和事件 B 的先验概率。

贝叶斯方法通过计算先验概率和条件概率,可以得到后验概率分布,从而进行推断和决策。

贝叶斯方法的基本步骤包括:确定先验分布,计算似然函数,计算后验概率分布,进行推断与决策。

贝叶斯方法的相关公式贝叶斯定理的推导贝叶斯定理可以通过联合概率的定义和条件概率的定义推导得到。

假设事件 A 和事件 B 是两个相互独立的事件,其联合概率可以表示为 $P(A, B) = P(A) \\cdot P(B)$。

根据条件概率的定义,$P(A|B) = \\frac{{P(A, B)}}{{P(B)}}$,代入联合概率的表达式可以得到 $P(A|B) = \\frac{{P(A) \\cdot P(B)}}{{P(B)}}$。

同样地,根据条件概率的定义,$P(B|A) = \\frac{{P(A, B)}}{{P(A)}}$,代入联合概率的表达式可以得到 $P(B|A) = \\frac{{P(A) \\cdot P(B)}}{{P(A)}}$。

由两个等式可得 $P(A|B) = \\frac{{P(B|A) \\cdot P(A)}}{{P(B)}}$,即贝叶斯定理。

朴素贝叶斯分类器朴素贝叶斯分类器是贝叶斯方法的一种应用,常用于文本分类等任务。

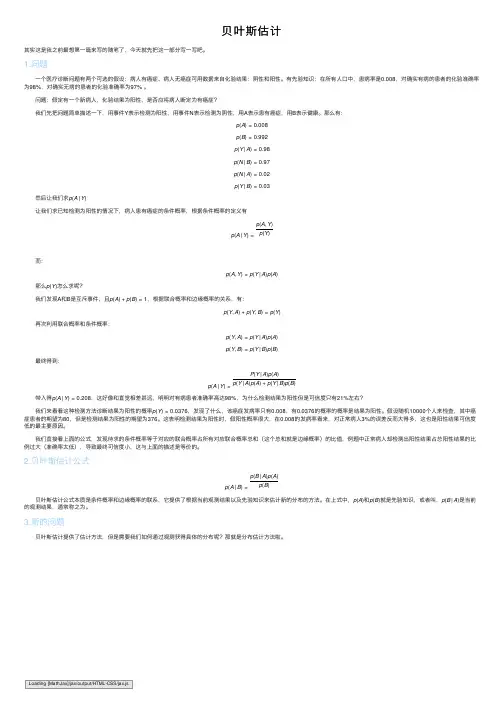

贝叶斯估计其实这是我之前最想第⼀篇来写的随笔了,今天就先把这⼀部分写⼀写吧。

1.问题 ⼀个医疗诊断问题有两个可选的假设:病⼈有癌症、病⼈⽆癌症可⽤数据来⾃化验结果:阴性和阳性。

有先验知识:在所有⼈⼝中,患病率是0.008,对确实有病的患者的化验准确率为98%,对确实⽆病的患者的化验准确率为97% 。

问题:假定有⼀个新病⼈,化验结果为阳性,是否应将病⼈断定为有癌症? 我们先把问题简单描述⼀下,⽤事件Y表⽰检测为阳性,⽤事件N表⽰检测为阴性,⽤A表⽰患有癌症,⽤B表⽰健康。

那么有:p(A)=0.008p(B)=0.992p(Y|A)=0.98p(N|B)=0.97p(N|A)=0.02p(Y|B)=0.03 然后让我们求p(A|Y) 让我们求已知检测为阳性的情况下,病⼈患有癌症的条件概率,根据条件概率的定义有p(A|Y)=p(A,Y) p(Y) ⽽:p(A,Y)=p(Y|A)p(A) 那么p(Y)怎么求呢? 我们发现A和B是互斥事件,且p(A)+p(B)=1,根据联合概率和边缘概率的关系,有:p(Y,A)+p(Y,B)=p(Y) 再次利⽤联合概率和条件概率:p(Y,A)=p(Y|A)p(A)p(Y,B)=p(Y|B)p(B) 最终得到:p(A|Y)=P(Y|A)p(A)p(Y|A)p(A)+p(Y|B)p(B) 带⼊得p(A|Y)=0.208,这好像和直觉相差甚远,明明对有病患者准确率⾼达98%,为什么检测结果为阳性但是可信度只有21%左右? 我们来看看这种检测⽅法诊断结果为阳性的概率p(Y)=0.0376,发现了什么,该癌症发病率只有0.008,有0.0376的概率的概率是结果为阳性。

假设随机10000个⼈来检查,其中癌症患者的期望为80,但是检测结果为阳性的期望为376。

这表明检测结果为阳性时,假阳性概率很⼤,在0.008的发病率看来,对正常病⼈3%的误差反⽽⼤得多,这也是阳性结果可信度低的最主要原因。

独创性声明本人声明所呈交的学位论文是我个人在导师指导下进行的研究工作及取得的研究成果。

尽我所知,除文中已经标明引用的内容外,本论文不包含任何其他个人或集体已经发表或撰写过的研究成果。

对本文的研究做出贡献的个人和集体,均已在文中以明确方式标明。

本人完全意识到本声明的法律结果由本人承担。

学位论文作者签名:日期:年月日学位论文版权使用授权书本学位论文作者完全了解学校有关保留、使用学位论文的规定,即:学校有权保留并向国家有关部门或机构送交论文的复印件和电子版,允许论文被查阅和借阅。

本人授权华中科技大学可以将本学位论文的全部或部分内容编入有关数据库进行检索,可以采用影印、缩印或扫描等复制手段保存和汇编本学位论文。

保密□,在年解密后适用本授权书。

本论文属于不保密□。

(请在以上方框内打 “ √ ” )学位论文作者签名:指导教师签名:日期:年月日日期:年月日1 绪论1.1 选题背景一位统计学家曾经这样说过:作为一名统计工作者,不论其是否是贝叶斯学派的支持者,都应该了解贝叶斯统计方法的思想,并将贝叶斯统计推断作为其统计推断的基本讨论之一。

特别是在现代统计分析中,综合各种不同资源、条件,从中寻找信息变得越来越重要,贝叶斯方法和经验贝叶斯方法就是达到这一目标的有力工具。

另外,贝叶斯方法由于计算上的优势更易于实现,而且,贝叶斯模型与贝叶斯过程通常显示出更好的性质。

因此,贝叶斯方法在各个学科领域的应用越来越广泛,特别是在社会科学和经济商业活动中,贝叶斯方法取得了成功,形成了一股不容忽视的力量,受到了更多统计工作者的重视。

客观世界具有多样性,自然现象呈现错综复杂的景象,了解真相需要统计工作者充分、完全地利用各方面的有用信息。

经典的统计方法直接利用样本信息,这样的经典推断大多不考虑所作的推断将被应用的领域。

而贝叶斯分析将先验信息正式地纳入统计学中并探索如何利用这种信息的。

贝叶斯方法可以在实践中检验正确性,并不断地完善。

虽然,很多实践证明这些先验信息可以帮助做出更好统计推断,但是先验的寻找和确定并不是一件容易的事情。

贝叶斯估计最小最大原理1.引言1.1 概述贝叶斯估计和最小最大原理是概率论和统计学中两个重要的概念和方法。

它们在不同的领域和问题中具有广泛的应用,并且相互关联和影响。

贝叶斯估计是统计推断的一种方法,是基于贝叶斯定理的思想发展而来的。

其核心思想是在已知观测数据的情况下,通过计算参数的后验概率分布来进行参数估计。

贝叶斯估计可以将先验知识和观测数据进行有效的结合,提供了一种更加准确和全面的参数估计方法。

最小最大原理是决策论中的一种方法,用于确定最优的决策策略。

最小最大原理的核心思想是在面临不确定性和风险的情况下,通过最小化最大损失来选择最佳策略。

该原理要求在任何可能的情况下,所选择的策略都能使最坏情况下的损失最小化。

本文将围绕贝叶斯估计和最小最大原理展开详细阐述。

首先,我们将介绍贝叶斯估计的基本原理,包括贝叶斯定理和后验概率的计算方法。

然后,我们将介绍最小最大原理的概念和应用,包括最小最大损失和最优策略的确定方法。

最后,我们将着重探讨贝叶斯估计与最小最大原理之间的关系,探讨它们在统计推断和决策制定中的相互作用和互补。

通过对贝叶斯估计和最小最大原理的深入理解和研究,我们可以更好地应对不确定性和风险,并进行更准确和有效的参数估计和决策制定。

本文将为读者提供有关贝叶斯估计和最小最大原理的全面介绍和理解,并为进一步研究和应用这两种方法奠定基础。

在未来的研究中,我们还可以思考和展望贝叶斯估计和最小最大原理的更多潜在应用和改进方向。

1.2文章结构文章结构的目的是为了清晰地呈现文章的逻辑结构和内容框架,帮助读者更好地理解文章的主旨和论证过程。

通过准确的文章结构,读者可以迅速找到所需信息,并更好地理解文章的脉络。

本文将分为引言、正文和结论三个部分。

在引言部分,将对贝叶斯估计最小最大原理的背景和意义进行概述,并介绍文章的结构和目的。

在正文部分,将深入讨论贝叶斯估计的基本原理,以及最小最大原理的概念和应用。

在此基础上,将探讨贝叶斯估计与最小最大原理之间的关系,并展望贝叶斯估计最小最大原理未来的发展方向。

第五章贝叶斯决策分析

贝叶斯决策分析(Bayesian Decision Analysis)是一种基于贝叶斯统计推理的决策方法。

它以数据作为输入,利用贝叶斯统计推理以及现实世界中的模型参数等,建立统计学模型,分析不同决策情况的可能性,最终指导决策者进行最优决策。

贝叶斯决策分析采用了极大似然估计(Maximum Likelihood Estimation)和贝叶斯统计推理(Bayesian Statistical Inference)的方法,从而给出了可行的决策结果。

贝叶斯决策分析模型假设了有一个无穷大的条件概率分布集,即根据历史观测值估计的各种情况及其发生概率。

模型的输入包括现有信息的观测值,如目标对象或数据的性质,环境和模型参数的估计值等,以及决策者的系统目标函数。

这些输入被用来估计条件概率,即感兴趣的决策性问题中每一个状态的发生概率,以及状态特征随时间变化的概率。

有了所有的输入信息之后,贝叶斯决策分析可以给出最优决策,它是针对模型的描述做出的。

例如,一个简单的决策模型可以表示为,有两个观测变量X和Y,每个观测变量有三种状态,共有九种模式(3×3=9)。

贝叶斯估计与贝叶斯学习贝叶斯估计是概率密度估计的一种参数估计,它将参数估计看成随机变量,它需要根据观测数据及参数鲜艳概率对其进行估计。

一 贝叶斯估计(1)贝叶斯估计贝叶斯估计的本质是通过贝叶斯决策得到参数θ的最优估计,使总期望风险最小。

设()p θ是待估计参数θ的先验概率密度,且θ取值与样本集1{,,}n x x X =L 有关,设样本的取值空间d E ,参数取值空间Θ,ˆ(,)λθθ是ˆθ作为θ的估计量时的损失函数,本节我们取2ˆˆ(,)()λθθθθ=-。

则此时的总期望风险为: ˆ(,)()(),d E R p x p x d dx λθθθθΘ=⎰⎰定义样本x 下的条件风险为:ˆˆ()(,)(),R x p x d θλθθθθΘ=⎰ 则有:ˆ()(),d E R R x p x dx θ=⎰ 又ˆ()R x θ非负,则又贝叶斯决策知求R 最小即求ˆ()R x θ最小,即: ˆargmin (),R x θθ*=可求得最优估计:().p x d θθθθ*Θ=⎰(2)贝叶斯估计步骤总结1. 获得θ的先验分布()p θ;2. 已知x 的密度分布()p x θ得样本集的联合分布:1()();Nn n p p x θθ=X =∏3. 由贝叶斯公式得θ的后验分布:()()();()()p X p p X p X p d θθθθθθΘ=⎰4. 得到θ的最优估计:().p x d θθθθ*Θ=⎰(3)样本概率密度函数()p x X 估计我们是在假设样本概率密度已知下对参数进行估计的,由贝叶斯估计步骤3可以直接得到样本概率密度函数估计:()()().p x X p x p X d θθθΘ=⎰对上式可以理解为:()p x X 在所有可能参数下取值下样本概率密度的加权平均,权值为θ的后验概率。

二 贝叶斯学习贝叶斯学习本质是参数值随着样本增多趋近于真实值的过程。

对于贝叶斯学习由下面过程得到:记样本集为NX ,其中N 代表样本集内样本的个数。

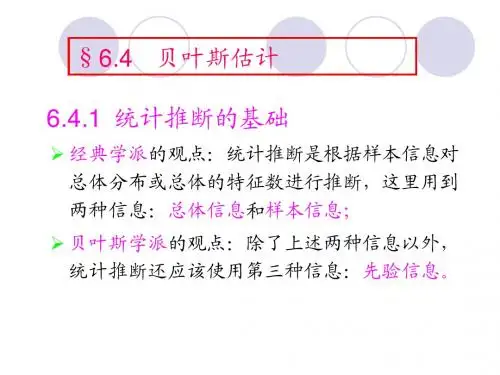

第五章贝叶斯统计5.1 简介到目前为止,我们已经知道了大量的不同的概率模型,并且我们前面已经讨论了如何用它们去拟合数据等等。

前面我们讨论了如何利用各种先验知识,计算MAP参数来估计θ=argmax p(θ|D)。

同样的,对于某种特定的请况,我们讨论了如何计算后验的全概率p(θ|D)和后验的预测概率密度p(x|D)。

当然在以后的章节我们会讨论一般请况下的算法。

5.2 总结后验分布后验分布总结关于未知变量θ的一切数值。

在这一部分,我们讨论简单的数,这些数是可以通过一个概率分布得到的,比如通过一个后验概率分布得到的数。

与全面联接相比,这些统计汇总常常是比较容易理解和可视化。

5.2.1最大后验估计通过计算后验的均值、中值、或者模型可以轻松地得到未知参数的点估计。

在5.7节,我们将讨论如何利用决策理论从这些模型中做出选择。

典型的后验概率均值或者中值是估计真实值的恰当选择,并且后验边缘分布向量最适合离散数值。

然而,由于简化了优化问题,算法更加高效,后验概率模型,又名最大后验概率估计成为最受欢迎的模型。

另外,通过对先验知识的取对数来正则化后,最大后验概率可能被非贝叶斯方法解释(详情参考6.5节)。

最大后验概率估计模型在计算方面该方法虽然很诱人,但是他有很多缺点,下面简答介绍一下。

在这一章我们将更加全面的学习贝叶斯方法。

图5.1(a)由双峰演示得到的非典型分布的双峰分布,其中瘦高蓝色竖线代表均值,因为他接近大概率,所以对分布有个比较好的概括。

(b)由伽马绘图演示生成偏态分布,它与均值模型完全不同。

5.2.1.1 无法衡量不确定性最大后验估计的最大的缺点是对后验分布的均值或者中值的任何点估计都不能够提供一个不确定性的衡量方法。

在许多应用中,知道给定估计值的置信度非常重要。

我们在5.22节将讨论给出后验估计置信度的衡量方法。

5.2.1.2 深耕最大后验估计可能产生过拟合在机器学习中,相比于解释模型的参数,我们能够得到精确预测结果。

然而,如果我们不能衡量参数的不确定性,那么可能过分信任预测的分布。

在第三章我们介绍了几个例子,之后还有更多这样的例子。

预测中的过度自信对于我们的风险规避很成问题;在随后的5.7节我们将详细介绍。

5.2.1.3 模型是一个非典型的点由于现实模型常常是一个区别于均值或者中值的非典型分布,所以选择一个模型来概括后验分布的效果往往很差。

对于一个一维连续空间图5.1(a)中很好的说明了这一点。

该模型的一个根本问题在于它是一个0-1的测量值,而中值和均值是在空间体积上的考虑。

图5.1(b)给出了另一个例子:图中模型结果是0.但是均值非零。

这样的偏态分布经常在推断方差参数时出现,尤其是在分层模型中。

在这样的例子中,最大后验估计(最大似然估计例外)明显的是一个非常不好的估计方法。

假如模型不是一个很好的选择项,那么我们应该如何概括后验概率呢?在5.7节中讨论的决策理论将会解答这一疑问。

其基本思想是指定一个损失函数,如果你对真实的θ的估计是ˆθ那么损失函数为L(θ, ˆθ) 。

如果我们使用0-1损失L(θ, ˆθ) = I(θ = ˆθ),那么最优估计便是后验模型。

0-1损失意味着,如果没有估计错误那么就是正确的,否则就是错误的。

再这样的损失函数下没有所谓的“部分可信”!对于连续变量,我们偏好用误差平方来表征损失函数即:L(θ, ˆθ) = (θ−ˆθ)2。

对应的最优估计是后验均值,详细参见5.7节。

或者,我们可以使用一个更可靠地损失函数:L(θ, ˆθ) = |θ−ˆθ|,他考虑的是后验的中位数(中值)。

5.2.1.4最大后验估计不是做改变的重新参数化最大后验估计的一个更加微妙的是其结果依赖于概率模型的参数。

从一个表达形式转化为另一个等效的表达形式,例如测量单位的变化(长度的度量,我们可以用厘米也可以用英尺),其结果会变化,这是我们不希望看到的。

为了更好地理解这一问题,假定我们要计算X的后验,如果我们定义y= f(x),其中y的分布为公式(2.87),为方便描述抄写如下公式5.1:|Dx/dy|项我们成为雅可比(Jacobian),他通过f来衡量单位体积大小的变化。

则X的最大后验估计为ˆx = argmaxx px(x)。

通常情况下,f(x)不是y=argmaxypy(y).举个例子来说:x~N(6,1),y=f(x),利用蒙特卡洛仿真能够得到y的分布(见2.7.1节)。

其结果如图5.2.我们看到原始的高斯分布已经被非线性的S曲线乘方。

特别的指出的是,我们看到转化后的分布模型不完全等同于原始模型的形式。

图5.2 在非线性转换下的密度转化形式示例。

注意转化后的分布函数与原始分布的区别。

以练习1.4为例(bishop 2006b)。

图形由方差的贝叶斯变化生成。

为了了解最大后验估计中如何产生这一问题的,考虑如下例子。

伯努利分布是典型的均值μ参数化模型,所以,p(y = 1|μ) = μ, 其中,y ∈{0, 1}。

在每个单元间隔,假定我们有一个统一的先验:pμ(μ) = 1 I(0 ≤μ≤1)。

如果这里没有数据,那么最大后验估计仅仅是前验知识的模型,他们可以是在0 、1之间的任意值。

现在,我们开始介绍参数化的不同能够在这一任意区间挑选出不同的点。

首先,则新的先验为:因此,最大后验估计依赖于参数化。

因为似然度是一个函数而不是概率密度,所以最大似然估计与参数无关。

贝叶斯推断也不受参数化的影响,因为贝叶斯推断在整合参数空间的时候已经考虑了度量方面变化。

解决上述问题的一个方法是最优化下面的目标函数:I(θ)是与P有关的费舍尔信息矩阵(参见6.2.2节)。

这个估计参数是独立的,原因参见(Jermyn 2005;。

不幸运的是,优化方程常常很复杂,这很大限度上降低了该方法的吸引力。

5.2.2 置信区间除了点估计,我们经常想得到可信度的度量。

一个标准的可信度度量形式是数据theta的后验分布的宽度。

我们可以利用置信区间100(1 −α)%度量,就是说,在C = ( l, u),区域中包括1 –α的后验概率的量。

这里可能有许多这样的区间,所以我们选择区域是(1−α)/2,位于分布尾端的区间,并把他称为置信区间。

图5.3(a)中心区域和(b)HPD区域的beta(3,9)检验。

置信区间是(0.06,0.52)和HPD是(0.04,0.48)。

上图是在图3.6的基础上,利用betaHPD生成的。

如果后验是已知的函数形式,我们可以利用l= F−1(α/2) and u = F−1(1−α/2),计算后验分布的中心区间,F为后验分布的累计密度曲线。

例如,如果后验是高斯分布,5.2.2.1 后验密度最高的区域中心区间的存在的一个问题是很有可能这里有一个点它的概率密度很高但是不在置信区间。

图5.3中处于左侧置信区间外的点比刚刚好处于右侧区间的点的概率密度高很多。

这便促使了一个替代变量,称之为最高的后验概率密度或者最高的后验概率密度区间。

这被定义为(一组)最可能的点,这是总的概率的100(1-α)%。

更正式的,我们发现概率分布函数阈值P为:并且定义HPD区域为:在ld,最大概率密度区间有时候被称作最高密度区间或者HDI。

例如,图5.3(b)表明BETA的95%的HDI是(0.04,0.48)。

我们看到这个区间比置信区间狭窄,但即使这样,他依然包含了总量的95%;而且,区间内的每一点都比区间外的概率密度高。

对于单峰分布,最大密度区间将是包含总量95%的最狭窄的区间。

为了看到这个,想想“充水”的反过程,直到全部的95%显示出来,只剩下5%被淹没在水下。

在Id情况下,方便计算使用简单的算法:用最小的宽度简单的搜索满足包含总量的95%的区间。

如果我们知道累计分布曲线的,这个可以通过数值最优化来实现。

或者如果我们有大量样本(从betaHPD图形表示),通过搜索排序的数据点。

如果后验是多峰的分布,最大概率密度区间可能不是一个连续的区域:例如见图5.4(b)。

然而,总结概括多峰后验经常是很难的。

5.2.3 不同比例的推断有时候我们有多个参数,并且想利用这些参数计算出一些函数的后验概率分布。

例如,假如你要从亚马逊上买东西,并且有两个售货商提供相同的价格。

售货商1有90的正面评论,10个反面评论。

售货商2有两条正面评论0条负面评论。

那你想要买谁的?表面上看,我们应该选择销售商2,但是我们不能非常确信销售商2一定比1好,因为他的评论太少了。

在这一方面,我们构筑贝叶斯方法来分析这个问题。

相似的方法可以用来比较不同设置下的群体比例或比率。

假定theta1和theta2是可靠度未知的两个销售商。

因为我们不了解他们更多的信息,我们赋予他们统一的先验分布θi ∼ Beta(1, 1). 后验概率是p(θ1|D1)= eta(91, 11) 和p(θ2|D2) = Beta(3, 1).我们想要计算p(θ1 > θ2|D). 为方便起见,定义δ= θ1 −θ2为比率方面的不同(另外,我们不妨想)利用数值积分,我们可以计算期望值:我们发现p(δ > 0|D) = 0.710,这表明你应该从销售商1哪里买。

代码参见amazonsellerDemo。

一个简单的解决方法是利用蒙特卡洛采样得到近似的后验概率。

这是容易的,因为theta1和theta2在后验概率分布中是相互独立的,并且两者都有beta分布,这样就可以利用标准方法来采样。

p(θi|Di)的分布如图5.5(b)。

通过计算theta1大于theta2的部分能够得到一个p(δ > 0|D)的近似值;结果是0.718,非常接近真实值。

图5.5(a)确切的后验概率分布p(θi|Di). (b)蒙特卡洛近似p(δ|D). 我们运用核密度估计得到一个平滑曲线。

垂直线围住的是中间95%的区间。

5.3 贝叶斯模型选择在图1.18中,我们知道使用过高的多项式导致过拟合,使用过低的多项式又导致欠拟合的发生。

相似的,在图7.8(a)中,我们知道使用太小的正则化参数导致过拟合,使用太大的参数又导致欠拟合。

通常情况,当面对一系列不同复杂性的模型时(相似的参数化分布),怎样才能选择一个最好的呢?这样一个难题称为模型选择问题。

一个方法是利用交叉验证的方法去估计所有候选模型的泛化误差,然后挑选一个看起来最好的。

然而,这需要对每个模型拟合K次,其中,K是训练集交叉验证的次数。

一个更加高效的方法是计算关于模型的后验概率分布通过上式,我们可以容易的计算出最大后验估计模型,称为贝叶斯模型选择。

如果我们在模型中使用了统一的先验,p(m) ∝1,这相当于挑选模型中的最大值对于模型M,这个数被称为边际似然度,集成的似然度或者证据。

在5.3.2中将要详细的介绍如何操作这个积分。

但是首先我们要给出这个值的直观解释。