基于运动目标特征的关键帧提取算法

- 格式:pdf

- 大小:1.38 MB

- 文档页数:8

基于运动活力的视频分镜中关键帧的提取

张新春

【期刊名称】《电子与电脑》

【年(卷),期】2005(000)003

【摘要】通常在我们描述一种关键帧提取方法时,总会有这样一种印象,即视频描述的运动强度越高,就越需要更多的关键帧才能表述其内容.实验证明,通过引用MPEG-7运动活力描述子和可靠性标准可以使用运动活力的强度值标示一个视频段.通过把该视频分镜分割成几个具有相同图像帧数的片断,然后对于每个片段取其位于中间的一帧图像为该段的关键帧,这样我们就可以得到整个视频分镜的关键帧.进一步的,我们可以根据经验分割出不同的片段数然后通过该方法,得到了需要的关键帧数并计算它们.相对于传统的基于颜色特征的关键帧提取算法,我们的这种方法要快速的多,因为它只是通过简单的计算和压缩区域提取就得到了关键帧.因此,确切来说它接近于理论上的最优方法.

【总页数】3页(P125-127)

【作者】张新春

【作者单位】无

【正文语种】中文

【相关文献】

1.监控视频中基于运动目标显著性的关键帧提取方法 [J], 胡圆圆;干宗良;陈昌红;崔子冠;刘峰

2.基于运动轨迹分析的监控视频关键帧提取 [J], 张云佐

3.基于运动序列分割的运动捕获数据关键帧提取 [J], 朱登明;王兆其

4.基于关键帧提取的视频分割方法 [J], 王彦(木冈);马驷良

5.基于运动目标特征的关键帧提取算法 [J], 田丽华; 张咪; 李晨

因版权原因,仅展示原文概要,查看原文内容请购买。

基于关键帧提取的视频检索算法研究随着网络技术的不断发展和普及,大量的视频数据被上传和产生,视频检索技术也逐渐成为研究的热点。

传统的视频检索技术主要是基于文本匹配的方式进行搜索,但是对于大规模视频数据,文本检索的效率和精度都不能满足需求。

因此,基于图像处理和机器学习的视频检索算法得到了广泛的关注和研究。

关键帧是视频的重要组成部分,它是一帧能够概括整个视频内容的重要帧。

由于一个视频通常包括大量的帧,而只要关键帧即可代表整个视频,因此关键帧提取是基于关键帧进行视频检索的重要技术手段。

本文将从关键帧提取的角度探讨基于关键帧提取的视频检索算法的研究进展。

一、关键帧提取方法关键帧提取方法包括基于图像局部特征的方法、基于运动分析的方法和基于机器学习的方法等。

其中基于图像局部特征的方法较为常用,其基本思想是在视频序列中提取出局部特征,再通过聚类的方法将这些局部特征组合成关键帧。

在局部特征提取方面,目前较为流行的方法是SIFT (Scale-Invariant Feature Transform) 和SURF (Speeded-Up Robust Feature)。

基于运动分析的关键帧提取主要是在视频序列中提取运动向量,将运动向量与视频序列同步融合,然后根据一定的规则从运动向量序列中选取关键帧。

同样的,基于机器学习的关键帧提取,其目标是将多个的帧通过机器学习的方法进行聚类或分类,选取能够代表视频内容的关键帧。

二、基于关键帧提取的视频检索算法基于关键帧提取的视频检索算法主要是在视频序列中提取关键帧,通过关键帧进行视频检索。

随着深度学习技术的不断发展,解决视频检索中的困难问题的新方法不断涌现。

目前基于关键帧提取的视频检索算法主要有以下几种:1、基于传统的图像检索技术该方法利用图像检索技术,对视频中的所有关键帧进行特征提取,之后通过特征匹配的方法进行视频检索,寻找满足用户需求的视频。

由于该方法只利用静态图像信息,因此在处理视频中的动态与变化内容时,其检索效果不尽令人满意,并且此种方法易受视频中噪点或者异常帧干扰而影响检索准确度。

视频序列中镜头关键帧提取方法研究摘要计算机、网络技术和数字视频技术的不断发展,使得视频数据快速增长,如何对大量视频数据进行有效的组织、管理和检索成为视频检索研究领域的热点问题。

关键帧是一段视频中包含重要视频内容的一组离散的帧序列。

基于关键帧的视频摘要技术被广泛应用于网络视频检索和高效动画渲染中。

同时,关键帧的选取算法也在近年来成为在理论和应用方面都有着重要意义的研究课题。

关键帧提取是基于内容的视频检索中的一个重要技术。

本文在总结前人的工作基础上,提出了一种利用视频帧之间互信息量算法来提取关键帧的方法。

该方法结合两个连续图像帧的特征互信息量的变化关系来提取关键帧,并与视频聚类的关键帧提取方法进行了比较。

实验结果表明,利用该方法提取的关键帧能较好地代表镜头内容且提取关键帧的速度比视频聚类的关键帧提取方法快。

关键词:关键帧图像特征视频聚类法互信息量1.1 研究背景和意义随着计算机图形图像理论和技术的高速发展,视频动画的制作、编辑和发布已经不再仅仅属于专业人士。

人们用手中的DV 拍摄工具和各种各样的图像视频软件可以随心所欲的拍摄和编辑视频,并发布到互联网上去。

今天,互联网的普及和超大容量的存储硬件使得视频网站存储大量的数字视频资源,供人们在线观看和下载。

在大量的视频信息中,如何帮助用户高效的浏览和搜索他们所需要的和所感兴趣的视频成为一个在理论研究和实际应用中都有重要意义的研究课题。

基于关键帧(key frame) 的视频摘要(video summarization) 技术是一种索引(indexing)和检索(retrieval)视频内容的有效方法。

关键帧是原始视频中一些包含重要内容信息的帧。

基于关键帧的视频摘要技术就是把选取出的关键帧作为视频摘要呈现给用户,以帮助他们了解和感知视频的基本内容。

基于关键帧的视频摘要技术最主要的优点在于:由于关键帧只是一些图像,相对于它所出自的视频,其所需要的存储空间很小,在有限的带宽下能很大程度上缩短网络传输时间,从而提高视频检索的效率。

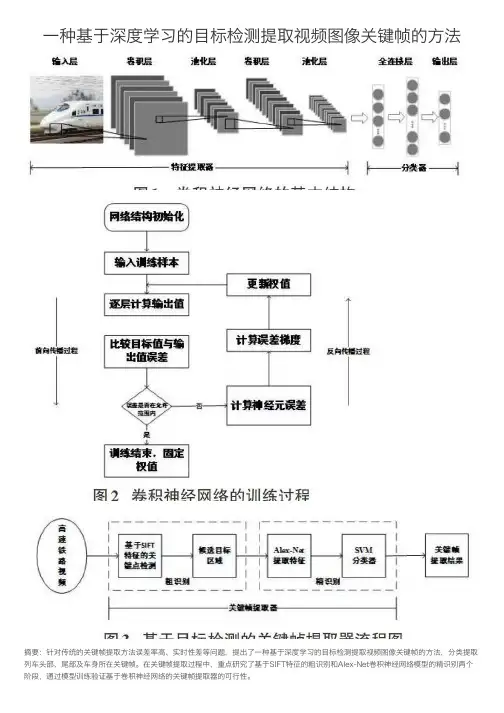

⼀种基于深度学习的⽬标检测提取视频图像关键帧的⽅法摘要:针对传统的关键帧提取⽅法误差率⾼、实时性差等问题,提出了⼀种基于深度学习的⽬标检测提取视频图像关键帧的⽅法,分类提取列车头部、尾部及车⾝所在关键帧。

在关键帧提取过程中,重点研究了基于SIFT特征的粗识别和Alex-Net卷积神经⽹络模型的精识别两个阶段,通过模型训练验证基于卷积神经⽹络的关键帧提取器的可⾏性。

关键词:卷积神经⽹络(CNN);关键帧;⽬标检测中图分类号:TP391 ⽂献标识码:A ⽂章编号:1009-3044(2018)36-0201-031 概述随着我国铁路的不断发展,铁路在运⾏过程中的安全性问题⽇益凸显,视频监控在铁路交通安全中起着⾄关重要的作⽤。

通过摄像头监控、互联⽹的传播,监控画⾯实时显⽰,铁路部门可以利⽤视频中的有效图像信息,对视频流进⾏处理,从⽽有效地保证铁路系统的正常运营。

因此,如何快速有效地提取铁路视频图像中的关键帧信息,是本⽂研究的重点。

考虑到视频中相邻帧的重复率⼀般⽐较⾼,关键帧的提取可以减少帧数,进⽽提升图像特征点检测和匹配效率,同时也为图像拼接提供⼀个组织框架。

针对这项关键技术,得到了研究者们的⼴泛关注,并取得了⼀定研究成果。

⽂献[1]从相邻帧间的颜⾊或纹理信息变化程度出发,提出了基于视频内容的⽅法。

⽂献[2]通过计算当前帧与类⼼之间特征值的距离,将视频中所有帧进⾏聚类分析,得到基于视频聚类的分析⽅法。

⽂献[3]提出基于运动特征分析的算法,其基本原理是利⽤光流分析,将视频中运动量最⼩的⼀帧作为关键帧。

上述的三类传统算法主要基于图像整体信息的变化来选定关键帧,容易造成关键帧选取错误、计算量⼤、实时性差等问题。

因此,本⽂在此基础上使⽤⼀种基于深度学习的⽬标检测⽅法,通过建⽴卷积神经⽹络(Convolutional Neural Network,CNN)模型,分类提取视频中列车头部、尾部及车⾝所在关键帧,使得基于深度学习的⽬标检测在关键帧提取的应⽤中成为可能。

视频内容分析与关键帧提取算法研究随着互联网的高速发展,视频成为了人们生活中必不可少的媒体之一。

在大量的视频数据中,如何高效地提取出关键信息,成为了研究的重要课题之一。

视频内容分析与关键帧提取算法的研究,正是为了解决这一问题而展开的。

一、视频内容分析视频内容分析是指通过对视频中的图像和音频进行解析,从而获取视频的各种特征和信息。

通过视频内容分析,我们可以实现视频检索、视频摘要、视频分类等应用。

1. 视频特征提取视频特征提取是视频内容分析的基础工作。

常用的视频特征包括颜色特征、纹理特征、形状特征、运动特征等。

其中,颜色特征可以通过提取关键帧的颜色直方图来得到,纹理特征可以通过提取关键帧的纹理特征描述符来得到,形状特征可以通过提取目标物体的轮廓信息来得到,运动特征可以通过分析关键帧之间的光流变化来得到。

2. 视频目标检测视频目标检测是视频内容分析的一个重要应用领域。

目标检测的目的是在视频中自动识别出特定的目标物体。

常用的目标检测方法包括基于帧间差分的运动目标检测、基于光流的运动目标检测、基于深度学习的物体检测等。

3. 视频关键帧提取关键帧是视频中具有代表性和信息丰富程度高的帧,提取关键帧可以减少视频数据量,提高视频处理的效率,并且方便快速浏览和检索。

关键帧提取一般基于图像质量评价和关键帧选取策略。

图像质量评价可以通过计算图像的清晰度、对比度、亮度等指标来进行,关键帧选取策略可以采用基于颜色分布、运动特征、局部相似性等方法。

二、关键帧提取算法研究关键帧提取算法的目标是从视频序列中自动选择具有代表性和信息变化较大的图像帧。

关键帧提取算法的研究旨在提高关键帧的准确性和有效性。

1. 基于图像质量评价的关键帧提取算法图像质量评价是判断图像的视觉质量的重要指标。

基于图像质量评价的关键帧提取算法通过计算帧间差异、帧内相似性等指标来评估每个帧的质量,从而选取出具有代表性的关键帧。

常用的图像质量评价方法包括均方差(MSE)、结构相似性指数(SSIM)、峰值信噪比(PSNR)等。

第16卷第5期2004年5月计算机辅助设计与图形学学报JOURNAL OF COMPU TER 2AIDED DESIGN &COMPU TER GRAPHICSVol 116,No 15May ,2004原稿收到日期:2003204201;修改稿收到日期:20032062261本课题得到国家重点基础研究发展计划(2002CB312106)和广东省自然科学基金(033323)资助1沈军行,男,1978年生,硕士研究生,主要研究方向为虚拟人、计算机图形学、计算机视觉1孙守迁,男,1963年生,博士,教授,博士生导师,主要研究方向为计算机辅助工业设计与概念设计、网络化媒体设计、虚拟人、数字化产品开发等1潘云鹤,男,1946年生,教授,博士生导师,中国工程院院士,主要研究方向为CAD &CG 、人工智能1从运动捕获数据中提取关键帧沈军行 孙守迁 潘云鹤(浙江大学计算机科学与技术学院 杭州 310027)(浙江大学CAD &CG 国家重点实验室 杭州 310027)摘要 在四元数表示下导出了两个旋转之间差异的一种简单形式,将人体各关节上总的旋转变化作为帧间距,设计了一种从运动捕获数据中提取关键帧的高效算法1通过向量的线性插值和四元数的球面线性插值重建了原始动画1实验表明,该算法具有很好的数据压缩效果,而且提取出的关键帧在视觉上对原始动画具有概括力1关键词 计算机动画;运动捕获;运动编辑;四元数;关键帧中图法分类号 TP391141K ey 2Frame Extraction from Motion C apture DataShen J unxing Sun Shouqian Pan Yunhe(College of Com puter Science and Technology ,Zhejiang U niversity ,Hangz hou 310027)(State Key L aboratory of CA D &CG ,Zhejiang U niversity ,Hangz hou 310027)Abstract A compact form of the difference between two rotations represented by quaternion is de 2rived ,and the total rotation differences in all joints are taken as the distance between two frames 1Based on this frame distance ,an efficient algorithm is presented to extract key 2frames from motion capture da 2ta 1The whole animation process is reconstructed by simple linear interpolation of root joint translation and spherical linear interpolation of all joint rotations 1Running experiment show that the original mo 2tion capture data can be compressed in a high ratio ,the extracted key frames give a good visual summa 2rization of the original animation and are useful for storing ,transferring and browsing the motion data 1K ey w ords computer animation ;motion capture ;motion editing ;quaternion ;key 2frame1 引 言由于通过运动捕获技术获得的动画具有高度的逼真性,因此该技术目前在计算机游戏、影视制作等领域得到了广泛的应用1但同传统的关键帧技术和动态仿真技术相比,运动捕获记录的是一堆庞大的原始数据,缺少结构化信息,因此对其进行编辑具有较大难度1Bruderlin 等[1]将运动数据作为信号来处理,并采用多分辨率思想在不同细节层次上对运动进行控制1Motion Displacement Mapping 技术[123]将由于编辑调整所引起的运动变化同原始运动分离开来,独立选择表示变化的插值曲线,从而避免了引入不必要的高频分量,使原始运动的细节得以保留1Witkin 等提出了时空约束方法[4],该方法运用非线性最优化求解生成满足用户所指定约束的动画1G leicher将时空约束方法应用于运动编辑[5]和运动重定向[6],并通过简化提高了问题求解速度1Rose 等应用时空约束方法产生了两段运动之间的平滑过渡[7]1信号处理方法虽然思想简单,但无法从高层次上对运动进行编辑,在很多情况下不能预知参数的调整会对运动产生什么样的影响;时空约束方法求解困难,一般很难达到交互的要求1在传统的关键帧动画中,由动画师先编辑一些关键帧,然后通过插值生成一段连续的动画;另外,关键帧提取在基于内容的视频检索中有着很广泛的应用[829],而三维动画和二维视频之间存在一定的相似性1受上述两个关键帧应用技术的启发,本文研究了从运动捕获得到的三维人体动画中提取关键帧的算法12 四元数及其间距人体是一种关节链结构,其状态可用根关节的平移和所有关节的旋转表示1平移即是一般的三维向量,旋转可用旋转矩阵、欧拉角或四元数来表示[10]1由于四元数在插值方面的优越性,目前广泛应用于计算机动画中1211 四元数的定义设s=w∈R,V=(x,y,z)∈R3,四元数q∈S4定义为q=[s,V]=[w,x,y,z]1q的共轭 q= [s,-V],q的模‖q‖=w2+x2+y2+z2,q的逆q-1= q/‖q‖1记q1=[s1,V1],q2=[s2,V2],四元数乘法定义为q1q2=[s1s2-V1・V2,s1V2+ s2V1+V1×V2],不难证明四元数乘法可结合但不可交换,且满足(qq2)-1=q-12q-111若‖q‖=1,则称q为单位四元数,两个单位四元数相乘结果仍为单位四元数1所有单位四元数组成的集合记为S3,不难想像S3应该是4维空间上的一个单位超球面1若有单位四元数q=[cosθ,u sinθ],其中u为R3上的一个单位向量1设有向量P,P′∈R3,满足[0,P′]=q[0,P]q-1(1)则可证明P′与P绕轴u旋转2θ角度的结果一致[10211],式(1)即为用四元数表示旋转的形式1从旋转意义上来讲,q与-q是等同的,即q[0,P]q-1 =(-q)[0,P](-q)-11212 四元数之间的距离设参考向量P0∈R3,单位四元数q1将P0旋转到P1,q2将P0旋转到P2(如图1所示),即有[0,P1]=q1[0,P0]q-11和[0,P2]=q2[0,P0]q-121设单位四元数q2q-11=[w,x,y,z]=[cosθ,sinθ(a,b,c)](‖(a,b,c)‖=1,θ=arccos w∈[0,π]),现将其作用于向量P1:(q2q-11)[0,P〗W TB X〗1](q2q-11)-1=(q2q-11)(q1[0,P0]q-11)(q2q-11)-1=(q2q-11)(q1[0,P0]q-11)(q1q-12)=q2(q-11q1)[0,P0](q-11q1)q-12=q2[0,P0]q-12=[0,P2](2) 由式(2)可见,q2q-11将P1转到P2(即P1绕轴(a,b,c)旋转2θ角到P2),这就说明为了将q1产生的旋转变换到q2产生的旋转须通过q2q-11作一额外旋转1因此θ自然就可用来衡量q1和q2之间的距离,同时表示q1,q2所产生的旋转之间的差异(如图1所示)1图1 四元数之间的距离定义11q1,q2为两个单位四元数,若q2q-11= [w,x,y,z],则q1,q2之间的距离定义为d(q1,q2)=arccos w(3) 3 从运动捕获数据中提取关键帧为了连续地记录表演者的动作,要求运动捕获设备有很高的采样速率,一些光学运动捕获设备的采样速率可达1000帧/s以上1如此高的速率,以至记录的数据量过于庞大,对其进行编辑也显得非常困难1一种简单的方法是对原数据进行等间隔重采样,但是通常表演者在整个表演过程中其动作节奏或者说频率不是恒定的,如一段舞蹈表演时而缓慢抒情,时而激烈奔放1等间隔重采样必然在缓慢部分过采样,造成数据冗余;而在激烈部分欠采样,丢失动作细节1为了能够进行插值重建,希望两个关键帧之间呈线性变化1经典的曲线分裂算法[9]检测曲线中的“尖角”作为关键帧,“尖角”之间近似线性,算法递归进行,如图2所示1但是该算法计算量比较大,且很难推广到高维1为此我们设计了一种高效的近似算法1027计算机辅助设计与图形学学报2004年图2 曲线分裂算法 人体运动可由一离散时间向量函数m(t)=[p(t),q1(t),q2(t),…,q n(t)](1≤t≤T)表示,其中,p(t)∈R3表示根关节的平移运动,q i(t)∈S3(i=1,2,…,n)表示关节i的旋转运动1下面引入帧间距用来衡量两帧之间人体姿势的差异1定义21设m(t1),m(t2)分别为不同时刻t1,t2上的两帧,它们之间的距离定义为D(t1,t2)=‖m(t1)-m(t2)‖=∑n i=1αid(q i(t1),q i(t2))(4)其中,αi(i=1,2,…,n)为加权系数,表示各关节的重要度;d(q i(t1),q i(t2))根据式(3)算得1因为人体结构是一种树状的关节链,父关节的运动会带动子关节一起运动,所以从运动上来讲父关节显得更加重要1算法11设动态数组KeyArray用来记录提取出的关键帧,last表示目前为止最后找到的关键帧, T表示总帧数,δ为事先设定的一阈值1Step11将第一帧作为关键帧加入到KeyArray,并置last =1,初始化循环变量t=21Step21若t>T,则算法结束;否则,按式(4)计算帧间距dist=D(t,last)1Step31若dist>δ,则第t帧作为关键帧加到KeyArray,并置last=t1Step41t=t+1,返回Step21算法结束时KeyArray记录了所有提取出的关键帧1因为运动捕获具有较高的采样速率,所以数据在局部上是近似线性变化的1算法不断考察当前帧同最后一个关键帧之间的差异情况,若超过阈值δ则认为已超越线性变化范围并作为新关键帧加入14 重建动画重建即是在关键帧之间的插值过程,根关节的平移用一般的线性插值,而所有关节的旋转用四元数的球面线性插值Slerp算法[10]1若q1=[w1,x1, y1,z1],q2=[w2,x2,y2,z2]为两个单位四元数,它们之间的球面线性插值为[10211]S lerp(q1,q2;u)=sin(1-u)θsinθq1+sin uθsinθq2(5)其中θ=arccos(w1w2+x1x2+y1y2+z1z2)1算法21算法1中得到的结果KeyArray记录了所有提取出的关键帧,记num为关键帧数目,对两相邻关键帧之间的非关键帧进行线性插值重建步骤如下:Step11初始化循环变量k=01Step21若k>=num-1,算法停止;否则,取其中两相邻关键帧t1=KeyArray[k],t2=KeyArray[k+1]1 Step31对t1和t2之间的所有非关键帧t(t1<t<t2)插值u=(t-t1)/(t2-t1);根关节平移p(t)=(1-u)p(t1)+ (u)p(t2);所有关节的旋转按式(5)q i(t)=Slerp(q i(t1), q i(t2);u),i=1,2,…,n)1Step41k=k+1,返回Step215 实验结果我们用Visual C++610和Open G L开发了一个运动编辑系统,命名为Eidolon,其中包含了在引言中提到的一些运动编辑技术1本文提出的算法已在Eidolon中实现和验证1如图3所示,其中人体行走动画原始共有163帧,速率为30帧/s,表演者开始快速行走,然后慢慢停下来1用算法1在δ= 11105下共提取出18帧关键帧,压缩率达11%1为了作比较,用等间隔重采样法也提取了18帧1图3所示为原始动画和插值重建结果,可见关键帧提取的重建结果基本没有失真,而等间隔重采样的重建结果有明显失真1图4所示为从一段具有198帧的运动捕获动画中用本文方法提取出的8帧关键帧(δ=410),可见这些关键帧在视觉上对原始动画具有概括力11275期沈军行等:从运动捕获数据中提取关键帧a 原始动画中的第5,15,25,35,45,55帧b 用本文方法进行关键帧提取后插值重建结果中的第5,15,25,35,45,55帧c 等间隔重采样后插值重建结果中的第5,15,25,35,45,55帧图3 原始动画和插值重建结果图4 提取出的关键帧在视觉上对原始动画具有概括力帧0帧45帧50帧73帧95帧149帧155帧197227计算机辅助设计与图形学学报2004年6 总 结算法1作为对曲线分裂算法的一种近似,有效地克服了等间隔采样的缺点1但算法1中的阈值δ由用户指定,不同的δ值给出不同的关键帧1我们将进一步研究使算法具备自适应能力,即用户只需给出所要提取的关键帧数目,算法自动给出相应的阈值δ1本文所做的从运动捕获数据中提取关键帧的研究工作具有如下三个方面的意义:(1)运动编辑可集中在关键帧上,降低了运动编辑复杂度;(2)通过关键帧之间的插值可重建原始动画,起到数据压缩的作用;(3)关键帧对原始动画具有概括力,可用于三维动画片断的检索1参 考 文 献[1]Bruderlin A ,Williams L 1Motion signal processing [A ]1In :Computer Graphics Proceedings ,Annual Conference Series ,ACM SIGGRAPH ,Los Angeles ,California ,1996197~115[2]Witkin Andrew ,Popovic Z oran 1Motion warping [A ]1In :Computer Graphics Proceedings ,Annual Conference Series ,ACM SIGGRAPH ,Los Angeles ,California ,19951105~108[3]Lee J H ,Shin S Y 1A hierarchical approach to interactive mo 2tion editing for human 2like figures [A ]1In :Computer Graphics Proceedings ,Annual Conference Series ,ACM SIGGRAPH ,Los Angeles ,California ,1999139~48[4]Witkin A ,K ass M 1Spacetime constraints [J ]1Computer Graphics ,1988,22(4):159~168[5]G leicher M 1Motion editing with spacetime constraints [A ]1In :Proceedings of Symposium on Interactive 3D Graphics ,Provi 2dence ,Rhode Island ,19971139~148[6]G leicher M 1Retargeting motion to new characters [A ]11In :Computer Graphics Proceedings ,Annual Conference Series ,ACM SIGGRAPH ,Orlando ,Florida ,1998133~42[7]Rose C ,Guenter B ,Bodenheimer B ,et al 1Efficient generation of motion transition using spacetime constraints [A ]1In :Com 2puter Graphics Proceedings ,Annual Conference Series ,ACM SIGGRAPH ,New Orleans ,Louisiana ,19961147~154[8]deMenthon D ,K obla V ,Doermann David 1Video summariza 2tion by curve simplification [A ]1In :Proceedings of ACM Mul 2timedia ’98,Bristol ,U K ,19981211~218[9]Zhao Li ,Qi Wei ,Li Stan Z ,et al 1K ey 2frame extraction and shot retrieval using nearest feature line (NFL )[A ]1In :Proceed 2ings of the 2000ACM workshops on Multimedia ,Los Angeles ,California ,20001217~220[10]Shoemake K 1Animating rotation with quaternion curves [J ]1Computer Graphics ,1985,19(3):245~254[11]Bao Hujun ,Jin Xiaogang ,Peng Qunsheng 1Fundamental Prin 2ciples for Computer Animation [M ]1Hangzhou :Zhejiang Uni 2versity Press ,20001196~222(in Chinese )(鲍虎军,金小刚,彭群生1计算机动画的算法基础[M ]1杭州:浙江大学出版社,20001196~222)3275期沈军行等:从运动捕获数据中提取关键帧。

关键帧提取方法在视频编辑和动画制作中,关键帧起到了至关重要的作用。

它们是定义动画或视频序列中重要位置的帧,通过关键帧,我们可以轻松地控制运动的轨迹和物体的变化。

本文将详细介绍几种常见的关键帧提取方法,帮助读者更好地掌握这一技术。

一、手动提取关键帧1.观察法:通过观看视频或动画序列,手动挑选出具有重要意义的帧作为关键帧。

这种方法简单直观,但需要耗费较多的时间和精力,适用于关键帧数量较少的情况。

2.时间间隔法:按照固定的时间间隔提取关键帧,如每秒提取一帧。

这种方法适用于关键动作或变化较为均匀的场景,但可能导致关键帧遗漏或冗余。

二、自动提取关键帧1.基于阈值的方法:通过设定像素变化阈值,自动检测出相邻帧之间的差异,当差异超过设定阈值时,将该帧作为关键帧。

这种方法适用于画面变化较为明显的场景,但可能对细微的变化不够敏感。

2.基于光流的方法:利用光流算法计算相邻帧之间的像素运动,根据运动信息提取关键帧。

这种方法可以较好地捕捉到物体的运动轨迹,但对计算资源要求较高。

3.基于图像特征的方法:通过提取图像特征(如SIFT、SURF等)来表示帧之间的相似性,根据相似性提取关键帧。

这种方法具有较强的鲁棒性,适用于多种场景。

4.基于深度学习的方法:利用卷积神经网络(CNN)等深度学习模型,自动提取关键帧。

这种方法具有较高的准确性和效率,但需要大量的训练数据和计算资源。

三、关键帧提取技巧1.结合多种方法:在实际应用中,可以结合多种关键帧提取方法,以提高准确性和效率。

2.优化关键帧数量:根据实际需求,适当调整关键帧数量,避免冗余和遗漏。

3.关键帧插值:在关键帧之间进行插值处理,使动画或视频过渡更加平滑。

4.人机交互:在自动提取关键帧的基础上,进行人工调整和优化,确保关键帧的质量。

总结:关键帧提取是视频编辑和动画制作中的一项重要技术。

通过掌握不同的关键帧提取方法,我们可以更高效地完成创作任务,提高作品的质量。

监控视频中基于运动目标显著性的关键帧提取方法胡圆圆;干宗良;陈昌红;崔子冠;刘峰【期刊名称】《南京邮电大学学报(自然科学版)》【年(卷),期】2016(036)001【摘要】文中提出了一种监控视频中基于运动目标显著性的关键帧提取方法.该方法首先对监控视频中的行人进行检测和跟踪,分别提取行人的颜色、纹理与形状3种底层特征并借助肤色模型得到能够凸显人脸区域的肤色置信图,然后将3种特征图像和肤色置信图动态加权融合得到多特征融合图像,最后以行人目标的多特征融合图像以及跟踪结果为参考,选取出目标显著性程度最大的融合图像对应的视频帧为关键帧.实验结果表明,文中提出的关键帧提取算法能够快速掌握监控视频中的行人信息,为视频后处理提供运动目标有效的处理样本.【总页数】8页(P34-41)【作者】胡圆圆;干宗良;陈昌红;崔子冠;刘峰【作者单位】南京邮电大学江苏省图像处理与图像通信重点实验室,江苏南京210003;南京邮电大学江苏省图像处理与图像通信重点实验室,江苏南京210003;南京邮电大学江苏省图像处理与图像通信重点实验室,江苏南京210003;南京邮电大学江苏省图像处理与图像通信重点实验室,江苏南京210003;南京邮电大学江苏省图像处理与图像通信重点实验室,江苏南京210003【正文语种】中文【中图分类】TN919.8【相关文献】1.基于聚散熵及运动目标检测的监控视频关键帧提取 [J], 马利克;彭进业;冯晓毅2.一种道路车辆监控视频中的关键帧提取方法 [J], 袁晶;王炜;杨建;刘煜;张茂军3.基于目标变化的监控视频关键帧提取方法 [J], 周萍4.一种基于关键帧技术的监控视频摘要提取方法 [J], 王璐5.基于视觉显著性车辆监控视频关键帧提取方法 [J], 仲梦洁;张艳彬因版权原因,仅展示原文概要,查看原文内容请购买。

基于帧间距的运动关键帧提取李顺意;侯进;甘凌云【摘要】运动捕获数据中有大量的冗余数据,不利于运动数据的压缩、存储、检索以及进一步重用。

为此,提出一种基于帧间距的运动关键帧提取方法,提取代表运动捕获数据内容的关键姿势。

利用四元数之间的距离表示人体姿态差异,将人体各个关节上的总变化作为帧间距,以运动数据首帧作为第一个关键帧。

通过不断计算当前帧同最后一个关键帧之间的差异,消除差异小于阈值的帧,差异超过阈值的帧被当作为新关键帧。

对提取关键帧集合采用四元数球面插值方法重构。

为表现人体运动特征,在重构误差中引入关节速度分量,用人体姿势误差位置与人体关节运动速率之和表示原始运动与重建运动序列之间的重构误差。

实验结果表明,该方法对原始运动既有较高的压缩率,又有较强的视觉概括效果。

%To solve the problem that the motion capture data has a large number of data redundancy,this paper proposes a key frame extraction method based on inter-frame pitch. In order to compress, storage, reconstruct and further reuse motion data,key-frame is needed to be extracted which represents the content of the motion. Quaternion is introduced to represent the difference between two rotations. The distance between two frames is defined by the total rotation differences and first frame is regarded as the first key frame. Then,calculate the difference between the current frame and the last key frame continuously. The frame is eliminated when the difference is smaller than the set threshold or the opposite is reserved for the new key frame. Spherical linear interpolation is used to reconstruct the sequence. To express the characteristics of human motion, the jointvelocity is introduced. Reconstruction error is defined by the human body posture error of position and the motion speed error between the original frame and the reconstructed frame. Experimental result demonstrates that the original motion capture can be compressed in a high ratio and gives a good visual summary performance.【期刊名称】《计算机工程》【年(卷),期】2015(000)002【总页数】6页(P242-247)【关键词】运动捕获;关键帧提取;帧间距;球面线性插值;重构误差;视觉概括力【作者】李顺意;侯进;甘凌云【作者单位】西南交通大学信息科学与技术学院,成都610031;西南交通大学信息科学与技术学院,成都610031; 南京大学计算机软件新技术国家重点实验室,南京210093;西南交通大学信息科学与技术学院,成都610031【正文语种】中文【中图分类】TP391在计算机动画中,人体角色动画是很重要的组成部分,但也因人体包含自由度多、维数高,创建一个真实的和逼真的运动模型是非常困难的,人体角色动画一直是计算机动画技术中的难点[1]。