信源及信源熵习题答案

- 格式:doc

- 大小:607.00 KB

- 文档页数:16

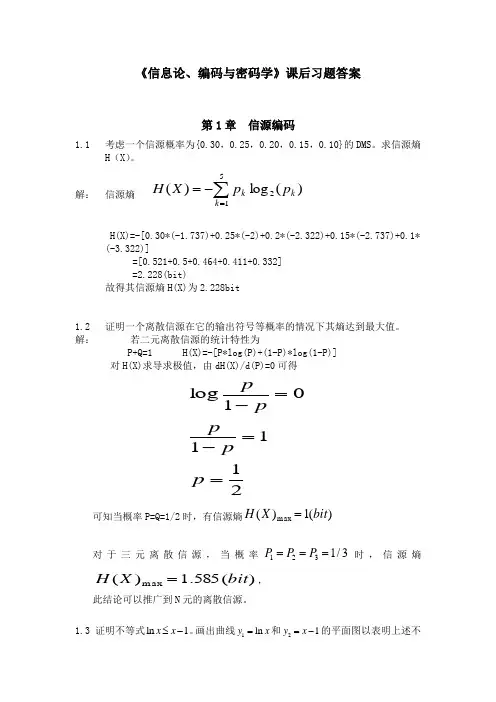

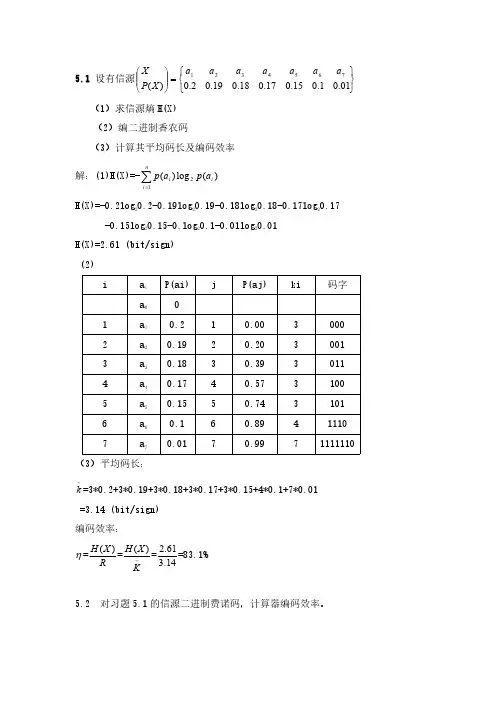

5.1设有信源⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛01.01.015.017.018.019.02.0)(7654321a a a a a a a X P X (1)求信源熵H(X)(2)编二进制香农码(3)计算其平均码长及编码效率解:(1)H(X)=-)(log )(21i ni i a p a p ∑=H(X)=-0.2log 20.2-0.19log 20.19-0.18log 20.18-0.17log 20.17-0.15log 20.15-0.log 20.1-0.01log 20.01H(X)=2.61(bit/sign)(2)ia i P(ai)jP(aj)ki码字a 001a 10.210.0030002a 20.1920.2030013a 30.1830.3930114a 40.1740.5731005a 50.1550.7431016a 60.160.89411107a 70.0170.9971111110(3)平均码长:-k =3*0.2+3*0.19+3*0.18+3*0.17+3*0.15+4*0.1+7*0.01=3.14(bit/sign)编码效率:η=R X H )(=-KX H )(=14.361.2=83.1%5.2对习题5.1的信源二进制费诺码,计算器编码效率。

⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛0.01 0.1 0.15 0.17 0.18 0.19 2.0 )(7654321a a a a a a a X P X 解:Xi)(i X P 编码码字ik 1X 0.2000022X 0.191001033X 0.18101134X 0.17101025X 0.151011036X 0.110111047X 0.01111114%2.9574.2609.2)()(74.2 01.0.041.0415.0317.0218.0319.032.02 )(/bit 609.2)(1.5=====⨯+⨯+⨯+⨯+⨯+⨯+⨯===∑KX H R X H X p k K sign X H ii i η已知由5.3、对信源⎭⎬⎫⎩⎨⎧=⎪⎪⎭⎫ ⎝⎛01.01.015.017.018.019.02.0)(7654321x x x x x x x X P X 编二进制和三进制赫夫曼码,计算各自的平均码长和编码效率。

1. 有一个马尔可夫信源,已知p(x 1|x 1)=2/3,p(x 2|x 1)=1/3,p(x 1|x 2)=1,p(x 2|x 2)=0,试画出该信源的香农线图,并求出信源熵。

解:该信源的香农线图为:1/3○ ○2/3 (x 1) 1 (x 2)在计算信源熵之前,先用转移概率求稳固状态下二个状态x 1和 x 2 的概率)(1x p 和)(2x p 立方程:)()()(1111x p x x p x p =+)()(221x p x x p=)()(2132x p x p +)()()(1122x p x x p x p =+)()(222x p x x p =)(0)(2131x p x p + )()(21x p x p +=1 得431)(=x p 412)(=x p马尔可夫信源熵H = ∑∑-IJi j i jix x p x xp x p )(log )()( 得 H=0.689bit/符号2.设有一个无经历信源发出符号A 和B ,已知4341)(.)(==B p A p 。

求:①计算该信源熵;②设该信源改成发出二重符号序列消息的信源,采纳费诺编码方式,求其平均信息传输速度; ③又设该信源改成发三重序列消息的信源,采纳霍夫曼编码方式,求其平均信息传输速度。

解:①∑-=Xiix p x p X H )(log )()( =0.812 bit/符号②发出二重符号序列消息的信源,发出四种消息的概率别离为1614141)(=⨯=AA p 1634341)(=⨯=AB p1634143)(=⨯=BA p 1694343)(=⨯=BB p用费诺编码方式 代码组 b i BB 0 1 BA 10 2 AB 110 3 AA 111 3无经历信源 624.1)(2)(2==X H X H bit/双符号 平均代码组长度 2B =1.687 bit/双符号BX H R )(22==0.963 bit/码元时刻③三重符号序列消息有8个,它们的概率别离为641)(=AAA p 643)(=AAB p 643)(=BAA p 643)(=ABA p 649)(=BBA p 649)(=BAB p 649)(=ABB p 6427)(=BBB p用霍夫曼编码方式 代码组 b iBBB 6427 0 0 1 BBA 649 0 )(6419 1 110 3BAB 649 1 )(6418 )(644 1 101 3ABB 649 0 0 100 3AAB 6431 )(6461 11111 5 BAA 643 0 1 11110 5ABA6431 )(6440 11101 5 AAA641 0 11100 5)(3)(3X H X H ==2.436 bit/三重符号序列 3B =2.469码元/三重符号序列3R =BX H )(3=0.987 bit/码元时刻3.已知符号集合{ 321,,x x x }为无穷离散消息集合,它们的显现概率别离为 211)(=x p ,412)(=x p 813)(=x p ···ii x p 21)(=···求: ① 用香农编码方式写出各个符号消息的码字(代码组); ② 计算码字的平均信息传输速度; ③ 计算信源编码效率。

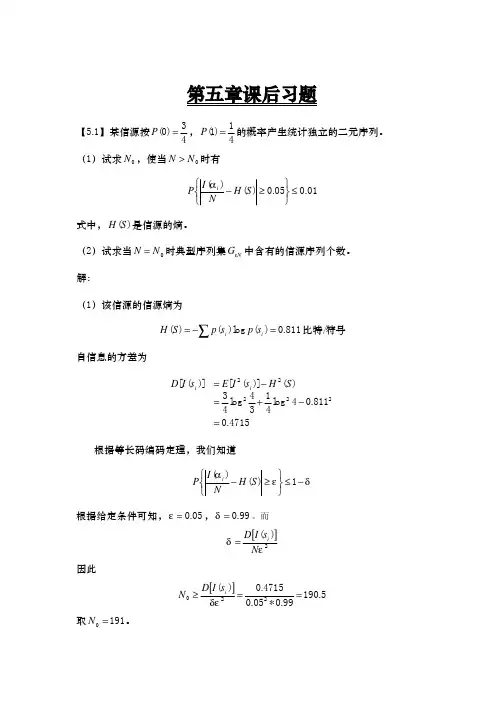

第五章课后习题【5.1】某信源按43)0(=P ,41)1(=P 的概率产生统计独立的二元序列。

(1)试求0N ,使当0N N >时有01.005.0)()(≤≥−S H N I P i α 式中,)(S H 是信源的熵。

(2)试求当0N N =时典型序列集N G ε中含有的信源序列个数。

解:(1)该信源的信源熵为811.0)(log )()(=−=∑i i s p s p S H 比特/符号自信息的方差为4715.0811.04log 4134log 43)()]([)]([22222=−+=−=S H s I E s I D i i 根据等长码编码定理,我们知道δεα−≤≥−1)()(S H N I P i 根据给定条件可知,05.0=ε,99.0=δ。

而[]2)(εδN s I D i =因此[]5.19099.0*05.04715.0)(220==≥δεi s I D N 取1910=N 。

(2)ε典型序列中信源序列个数取值范围为:])([])([22)1(εεεδ+−<<−S H N N S H N G代入上述数值得451.164351.1452201.0<<×N G ε【5.2】有一信源,它有六个可能的输出,其概率分布如下表所示,表中给出了对应的码A 、B 、C 、D 、E 和F 。

表5.2消息 )(i a P A B C D E F 1a 1/2 000 0 0 0 0 0 2a 1/4 001 01 10 10 10 100 3a 1/16 010 011 110 110 1100 101 4a 1/16 011 0111 1110 1110 1101 110 5a 1/16 100 01111 11110 1011 1110 111 6a1/1610101111111111011011111011(1) 求这些码中哪些是惟一可译码; (2) 求哪些码是非延长码(即时码); (3) 求对所有惟一可译码求出其平均码长L 。

第1讲2、信息论创始人是谁?香农。

3、信息和消息、信号有什么联系与区别?从信息理论角度上看,信号是消息的载体,信息含藏在消息之中,有信号有消息不一定有信息。

4、通信系统的主要性能指标是什么? 有效性、可靠性和安全性。

5、举例说明信息论有哪些应用?为信息传送和处理系统提供数学模型和评估方法,在通信和信息处理领域是一门基础理论,在其它领域如语言学、生物学、医学、神经网络、经济学方面的应用也很成功。

具体应用实例有:语音、图像和数据信息的压缩,通信信道有效性和可靠性的提高,或信道传输功率指标要求的降低,通信或计算机系统可靠性和安全性的提高,信息处理领域的信号重建和模式识别等。

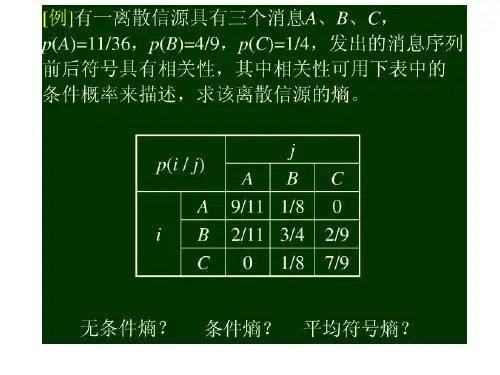

2.4 (求车牌自信息量)某车牌号的概率是(1/26)3×(1/10)3,24bit/牌,后一种概率为(1/36)6,31bit/牌, 第2讲设二元对称信道的传递矩阵(条件概率矩阵)为⎥⎥⎥⎦⎤⎢⎢⎢⎣⎡32313132若P(0) = 3/4, P(1) = 1/4,求H(X), H(Y), H(X/Y), H(Y/X)和I(X;Y);先求P(Y)=∑X P(XY)和P(XY)=P(X)P(Y|X),再得各种熵和互信息。

H(X)=H(3/4,1/4), H(Y)=H(7/12,5/12);H(XY)=H(1/2,1/4,1/12,1/6); H(X/Y)=H(XY)-H(Y)H(Y/X)=H(XY)-H(X);或H(Y/X)=∑P(X=a)H(Y/a)=H(3/4,1/4) I(X;Y)=H(X)-H(X/Y)=H(X)+H(Y)-H(XY); 2.2(求条件信息量)1.6米以上女孩是条件,某个1.6米以上的女大学生是概率事件,得条件概率为:P=0.25×0.75/0.5=0.375=3/8,信息量为I= -log0.375=1.42比特。

2.52.10(1)(2)(由联合概率分布求熵、联合熵和条件熵)(1)思路:先求出X 、Y 、Z 、XZ 、YZ 、XYZ 的概率或联合分布,再求其熵。

1. 有一个马尔可夫信源,已知p(x 1|x 1)=2/3,p(x 2|x 1)=1/3,p(x 1|x 2)=1,p(x 2|x 2)=0,试画出该信源的香农线图,并求出信源熵。

解:该信源的香农线图为: 1/3○○2/3(x 1) 1 (x 2)在计算信源熵之前,先用转移概率求稳定状态下二个状态x 1和 x 2的概率)(1x p 和)(2x p 立方程:)()()(1111x p x x p x p =+)()(221x p x x p=)()(2132x p x p + )()()(1122x p x x p x p =+)()(222x p x x p=)(0)(2131x p x p + )()(21x p x p +=1 得431)(=x p 412)(=x p 马尔可夫信源熵H = ∑∑-IJi j i jix x p x xp x p )(log )()( 得 H=0.689bit/符号2.设有一个无记忆信源发出符号A 和B ,已知4341)(.)(==B p A p 。

求: ①计算该信源熵;②设该信源改为发出二重符号序列消息的信源,采用费诺编码方法,求其平均信息传输速率; ③又设该信源改为发三重序列消息的信源,采用霍夫曼编码方法,求其平均信息传输速率。

解:①∑-=Xiix p x p X H )(log )()( =0.812 bit/符号②发出二重符号序列消息的信源,发出四种消息的概率分别为1614141)(=⨯=AA p 1634341)(=⨯=AB p 1634143)(=⨯=BA p 1694343)(=⨯=BB p 用费诺编码方法 代码组 b iBB 0 1 BA 10 2 AB 110 3 AA 111 3 无记忆信源 624.1)(2)(2==X H X H bit/双符号 平均代码组长度 2B =1.687 bit/双符号BX H R )(22==0.963 bit/码元时间③三重符号序列消息有8个,它们的概率分别为641)(=AAA p 643)(=AAB p 643)(=BAA p 643)(=ABA p 649)(=BBA p 649)(=BAB p 649)(=ABB p 6427)(=BBB p用霍夫曼编码方法 代码组 b i BBB 6427 0 0 1 BBA 649 0 )(6419 1 110 3 BAB 649 1 )(6418)(644 1 101 3 ABB 649 0 0 100 3AAB 643 1 )(646 1 11111 5 BAA 643 0 1 11110 5ABA 643 1 )(6440 11101 5AAA 6410 11100 5)(3)(3X H X H ==2.436 bit/三重符号序列 3B =2.469码元/三重符号序列3R =BX H )(3=0.987 bit/码元时间 3.已知符号集合{ 321,,x x x }为无限离散消息集合,它们的出现概率分别为 211)(=x p ,412)(=x p 813)(=x p ···i i x p 21)(=···求: ① 用香农编码方法写出各个符号消息的码字(代码组); ② 计算码字的平均信息传输速率; ③ 计算信源编码效率。

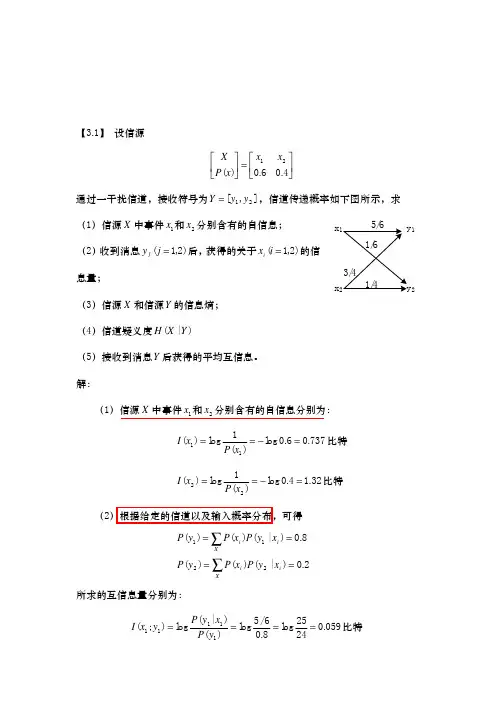

3-1 设有一离散无记忆信源,其概率空间为12()0.60.4X x x P x ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦,信源发出符号通过一干扰信道,接收符号为12{,}Y y y =,信道传递矩阵为51661344P ⎡⎤⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦,求: (1) 信源X 中事件1x 和2x 分别含有的自信息量;(2) 收到消息j y (j =1,2)后,获得的关于i x (i =1,2)的信息量; (3) 信源X 和信宿Y 的信息熵;(4) 信道疑义度(/)H X Y 和噪声熵(/)H Y X ; (5) 接收到消息Y 后获得的平均互信息量(;)I X Y 。

解:(1)12()0.737,() 1.322I x bit I x bit ==(2)11(;)0.474I x y bit =,12(;) 1.263I x y bit =-,21(;) 1.263I x y bit =-,22(;)0.907I x y bit =(3)()(0.6,0.4)0.971/H X H bit symbol ==()(0.6,0.4)0.971/H Y H bit symbol ==(4)()(0.5,0.1,0.1,0.3) 1.685/H XY H bit symbol ==(/) 1.6850.9710.714/H X Y bit symbol =-= (/)0.714/H Y X bit symbol =(5)(;)0.9710.7140.257/I X Y bit symbol =-=3-2 设有扰离散信道的输入端是以等概率出现的A 、B 、C 、D 四个字母。

该信道的正确传输概率为0.5,错误传输概率平均分布在其他三个字母上。

验证在该信道上每个字母传输的平均信息量为0.21比特。

证明:信道传输矩阵为:11112666111162661111662611116662P ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦,信源信宿概率分布为:1111()(){,,,}4444P X P Y ==, H(Y/X)=1.79(bit/符号),I(X;Y)=H(Y)- H(Y/X)=2-1.79=0.21(bit/符号)3-3 已知信源X 包含两种消息:12,x x ,且12()() 1/2P x P x ==,信道是有扰的,信宿收到的消息集合Y 包含12,y y 。

1、 熵 是香农信息论最基本最重要的概念。

2、 单符号离散信源一般用随机变量描述,而多符号离散信源一般用 随机矢量 描述。

3、 两个相互独立的随机变量的联合自信息量等于 两个自信息量之和 。

4、 离散平稳无记忆信源X 的N 次扩展信源的熵等于离散信源X 的熵的 N 倍 。

5、 对于n 元m 阶马尔可夫信源,其状态空间共有 n m 个不同的状态。

6、 若一离散无记忆信源的信源熵H (X )等于4.2,对信源进行等长的无失真二进制编码,则编码长度至少为 5 。

7、 同时掷两个正常的骰子,各面呈现的概率都为1/6,则“3和6同时出现”这件事的自信息量是 log 218或(1+2 log 23)。

8、 一副充分洗乱的扑克牌(52张),从中任意抽取1张,然后放回,若把这一过程看作离散无记忆信源,则其信源熵为 52log 2 。

9、 具有一一对应关系的无噪信道的信道容量C= log 2n 。

10、 信道编码定理是一个理想编码的存在性定理,即:信道无失真传递信息的条件是 信息率小于信道容量 。

11、 信源的消息通过信道传输后的误差或失真越大,信宿收到消息后对信源存在的不确定性就 越大 ,获得的信息量就越小12、 平均失真度的下限取0的条件是失真矩阵的 每一行至少有一个零元素 。

13、 率失真函数对允许的平均失真度是 单调递减和连续的 。

14、 对于离散无记忆信源的率失真函数的最大值是 log 2n 。

15、 信源编码的目的是: 提高通信的有效性 。

16、 对具有8个消息的单符号离散无记忆信源进行4进制哈夫曼编码时,为使平均码长最短,应增加 2 个概率为0的消息。

17、 对于香农编码、费诺编码和哈夫曼编码,编码方法惟一的是 香农编码 。

18、 游程序列的熵 等于 原二元序列的熵。

19、 n 位重复码的编码效率是 1/n 。

20、 若纠错码的最小距离为d min ,则可以纠正任意小于等于t= ⎥⎦⎥⎢⎣⎢-21min d 个差错。

第1章 绪论1-2 设信源X 由4个符号a,b,c,d 组成,各符号出现概率分别为3/8,1/4,1/8,1/4,每个符号的出现是独立的,求(1)信源熵H(X);(2)一个消息babcacaddabbcdcaabdcb 的信息量I 。

解:(1)符号/bit .log log log log )x (p log )x (p )x (H i i i 906141418181414183832222241=----=-=∑= (2)4148154168362222412log log log log )x (p log N I i i i ----=-=∑=bit ..494381512498=+++=若 bit ..)x (H 0264021906121=⨯=⨯个符号 是统计平均,与题意不符,为错的。

1-4 八进制数字信号在3分钟内共传送72000个码元,求码元速率和每个码元所含的信息量。

解:码元速率: B R B 40060372000=⨯=每个码元所含的信息量:bit log I 382==1-5 已知信源X 含有两个符号x 1,x 2,它们的出现概率分别为p(x 1)=q ,p(x 2)=1-q ,设信源每秒向信道发出1000个符号,求此无扰离散信道的信道容量。

解:符号/bit )q (log )q (q log q )x (p log)x (p )x (H i i i----=-=∑=1122212当21=q 时,信源熵有最大值:符号/bit H max 1= 每秒发送1000个符号,所以最大信息速率:s /bit R max b =⨯=10001信道容量:s /bit R C max b 1000==第2章 预备知识2-4 (a )试写出图P2-3(a )所示方波波形的复数傅里叶级数表示式;(b )用(a )中所得结果写出图P2-3(b )所示三角形波的复数傅里叶级数表示式。

解:(a )t n j n e n Aj t f 0)12(1)12(2)(ωπ+∞-∞=∑⋅+= (b )∑∞-∞=+⋅++=n t n j e n AT AT t f 0)12(22002)12(4)(ωπ2-9 已知)(t f 的频谱函数如图P2-5所示,画出t t fcos )(ω的频谱函数图,设τωω50=。

4。

1 某集源按P (0)=3/4,P(1)=1/4的概率产生统计独立的二元序列.(1) 试求N 0,使当N>N 0时有: P {|I(a i )/N -H(S )| ≥0.05}≤0.01其中H (S)是信源的熵。

(2)试求当N= N 0时典型序列集G εN 中含有的信源序列个数.解:(1) H(S)= —∑Pi ㏒Pi= -3/4㏒(3/4)—1/4㏒(1/4) =0.811 比特/符号根据契比雪夫不等式,对于任意ε>0,当N >N0时,P {∣I(αi)/N – H(S )∣≥ε}≤D[I(Si )]/N ε2现有ε=0.05,欲证原式,只要 D [I(Si )]/N ε2≤0。

01根据信源,D [I (Si)]=∑P (Si )[㏒P(Si)]2– H 2(S)=3/4(㏒3/4)2+1/4(㏒1/4)2—(0。

811)2=0。

471∴N0= D[I(Si)]/0。

01ε2=0.471/0。

01×(0.05)2=18840(2) 序列G εN 是所有N 长的ε典型序列集合,(1-δ)2N [H (S )—ε]≤‖G εN ‖≤2N[H (S )-ε]0.99×214342。

5≤‖G εN ‖≤216226。

54。

2 设无记忆二元信源,其概率为P1=0.005, P0=0。

995.信源输出N =100的二元序列.在长为N =100的信源序列中只对含有3个或小于3个“1”的各信源序列构成一一对应的一组等长码。

(1)求码字所需的最小长度。

(2)计算式(4.27a )中的ε。

(3)考虑没有给予编码的信源序列出现的概率,该等长码引起的错误概率PE 是多少?若从契比雪夫不等式(4。

22)考虑,PE 应是多少?试加以比较。

解:(1)无记忆二元信源()⎢⎣⎡⎥⎦⎤=⎢⎣⎡⎥⎦⎤005.0995.01,0i s P S N=100的扩展信源()()()()()⎢⎢⎢⎣⎡⎥⎥⎦⎤⨯⨯=====⎢⎢⎣⎡⎥⎦⎤--N N N N NN N N i N N N P S 005.0,005.0995.0005.0995.0,995.0111,1011010001121221,,,,,- ααααα 现只对含有3个或小于3个“1”的各信源序列构成一一对应的一组二元等长码。

第二章:试问四进制、八进制脉冲所含信息量是二进制脉冲的多少倍解:四进制脉冲可以表示4个不同的消息,例如:{0, 1, 2, 3}八进制脉冲可以表示8个不同的消息,例如:{0, 1, 2, 3, 4, 5, 6, 7} 二进制脉冲可以表示2个不同的消息,例如:{0, 1} 假设每个消息的发出都是等概率的,则:四进制脉冲的平均信息量H(X 1) = log 2n = log 24 = 2 bit/symbol 八进制脉冲的平均信息量H(X 2) = log 2n = log 28 = 3 bit/symbol 二进制脉冲的平均信息量H(X 0) = log 2n = log 22 = 1 bit/symbol 所以:四进制、八进制脉冲所含信息量分别是二进制脉冲信息量的2倍和3倍。

居住某地区的女孩子有25%是大学生,在女大学生中有75%是身高160厘米以上的,而女孩子中身高160厘米以上的占总数的一半。

假如我们得知“身高160厘米以上的某女孩是大学生”的消息,问获得多少信息量解:设随机变量X 代表女孩子学历X x 1(是大学生) x 2(不是大学生) P(X)设随机变量Y 代表女孩子身高Y y 1(身高>160cm ) y 2(身高<160cm ) P(Y)已知:在女大学生中有75%是身高160厘米以上的 即:p(y 1/ x 1) =求:身高160厘米以上的某女孩是大学生的信息量 即:bit y p x y p x p y x p y x I 415.15.075.025.0log )()/()(log )/(log )/(2111121111=⎪⎭⎫⎝⎛⨯-=⎥⎦⎤⎢⎣⎡-=-=一副充分洗乱了的牌(含52张牌),试问(1) 任一特定排列所给出的信息量是多少(2) 若从中抽取13张牌,所给出的点数都不相同能得到多少信息量解:(1) 52张牌共有52!种排列方式,假设每种排列方式出现是等概率的则所给出的信息量是:bit x p x I i i 581.225!52log )(log )(2==-=(2) 52张牌共有4种花色、13种点数,抽取13张点数不同的牌的概率如下:bit C x p x I C x p i i i 208.134log )(log )(4)(13521322135213=-=-==设离散无记忆信源⎭⎬⎫⎩⎨⎧=====⎥⎦⎤⎢⎣⎡8/14/1324/18/310)(4321x x x x X P X ,其发出的信息为(202032),求 (1) 此消息的自信息量是多少(2) 此消息中平均每符号携带的信息量是多少解:(1) 此消息总共有14个0、13个1、12个2、6个3,因此此消息发出的概率是:62514814183⎪⎭⎫ ⎝⎛⨯⎪⎭⎫ ⎝⎛⨯⎪⎭⎫ ⎝⎛=p此消息的信息量是:bit p I 811.87log 2=-=(2) 此消息中平均每符号携带的信息量是:bit n I 951.145/811.87/==从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为%,如果你问一位男士:“你是否是色盲”他的回答可能是“是”,可能是“否”,问这两个回答中各含多少信息量,平均每个回答中含有多少信息量如果问一位女士,则答案中含有的平均自信息量是多少解: 男士:symbolbit x p x p X H bitx p x I x p bit x p x I x p i i i N N N Y Y Y / 366.0)93.0log 93.007.0log 07.0()(log )()( 105.093.0log )(log )(%93)( 837.307.0log )(log )(%7)(22222222=+-=-==-=-===-=-==∑女士:symbol bit x p x p X H ii i / 045.0)995.0log 995.0005.0log 005.0()(log )()(2222=+-=-=∑设信源⎭⎬⎫⎩⎨⎧=⎥⎦⎤⎢⎣⎡17.016.017.018.019.02.0)(654321x x x x x x X P X ,求这个信源的熵,并解释为什么H(X) > log6不满足信源熵的极值性。

解:585.26log )(/ 657.2)17.0log 17.016.0log 16.017.0log 17.018.0log 18.019.0log 19.02.0log 2.0()(log )()(222222262=>=+++++-=-=∑X H symbol bit x p x p X H ii i 不满足极值性的原因是107.1)(6>=∑iix p 。

证明:H(X 3/X 1X 2) ≤ H(X 3/X 1),并说明当X 1, X 2, X 3是马氏链时等式成立。

证明:log 1)/()(log )()/()(log 1)/()/()()/()/(log)()/(log )()/(log )()/(log )()/(log )()/()/(2123132121233211231321123221313321123213133211231332112321332113133112321332113213=⎪⎪⎭⎫⎝⎛-⎥⎦⎤⎢⎣⎡=⎪⎭⎫⎝⎛-=⎪⎪⎭⎫⎝⎛-≤=+-=+-=-∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑e x x p x x p ex x x p x x p x x p e x x x p x x p x x x p x x x p x x p x x x p x x p x x x p x x x p x x x p x x p x x p x x x p x x x p X X H X X X H i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i氏链是马等式成立的条件是时等式成立当_,,)/()/()/()()/()/()()()/()/()()/()/(01)/()/()/()/(321132131232113121212131321213132131313213X X X x x x p x x p x x p x x x p x x p x x p x p x x p x x x p x x p x x p x x x p x x p x x x p x x p X X H X X X H i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i i ∴=⇒=⇒=⇒=⇒=-≤∴证明:H(X 1X 2 。

X n ) ≤ H(X 1) + H(X 2) + … + H(X n )。

证明:)(...)()()()...().../()(0)...;(...)/()(0);()/()(0);().../(...)/()/()()...(3212112112121332131221212121312121N N N N N N N N N N X H X H X H X H X X X H X X X X H X H X X X X I X X X H X H X X X I X X H X H X X I X X X X H X X X H X X H X H X X X H ++++≤∴≥⇒≥≥⇒≥≥⇒≥++++=---设有一个信源,它产生0,1序列的信息。

它在任意时间而且不论以前发生过什么符号,均按P(0) = ,P(1) = 的概率发出符号。

(1) 试问这个信源是否是平稳的 (2) 试计算H(X 2), H(X 3/X 1X 2)及H ∞;(3) 试计算H(X 4)并写出X 4信源中可能有的所有符号。

解: (1)这个信源是平稳无记忆信源。

因为有这些词语:“它在任意时间....而且不论以前发生过什么符号...........……” (2)symbolbit X H H symbol bit x p x p X H X X X H symbolbit X H X H ii i / 971.0)(/ 971.0)6.0log 6.04.0log 4.0()(log )()()/(/ 942.1)6.0log 6.04.0log 4.0(2)(2)(2223213222===+-=-===+⨯-==∞∑(3)1011111111101101110010101001100001110110010101000011001000010000的所有符号:/ 884.3)6.0log 6.04.0log 4.0(4)(4)(4224X symbol bit X H X H =+⨯-==一阶马尔可夫信源的状态图如下图所示。

信源X 的符号集为{0, 1, 2}。

(1) 求平稳后信源的概率分布; (2) 求信源的熵H ∞。

PP解: (1)⎪⎩⎪⎨⎧===⎩⎨⎧=++==⎪⎪⎩⎪⎪⎨⎧⋅+⋅=⋅+⋅=⋅+⋅=⎪⎩⎪⎨⎧+=+=+=3/1)(3/1)(3/1)(1)()()()()()()()()()()()()()()()/()()/()()()/()()/()()()/()()/()()(321321321133322211131333332322222121111e p e p e p e p e p e p e p e p e p e p p e p p e p e p p e p p e p e p p e p p e p e e p e p e e p e p e p e e p e p e e p e p e p e e p e p e e p e p e p⎭⎬⎫⎩⎨⎧=⎥⎦⎤⎢⎣⎡⎪⎪⎩⎪⎪⎨⎧=+=⋅+⋅=+==+=⋅+⋅=+==+=⋅+⋅=+=3/123/113/10)(3/13/)()()()/()()/()()(3/13/)()()()/()()/()()(3/13/)()()()/()()/()()(131313333323232222212121111X P X p p e p p e p p e x p e p e x p e p x p p p e p p e p p e x p e p e x p e p x p p p e p p e p p e x p e p e x p e p x p (2)()symbolbit p p p p p p p p p p p p p p p p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e e p e p H iji j i j i / log log log 31log 31log 31log 31log 31log 31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/(31)/(log )/()(2222222233233322323123123223222222122113213122121121133⋅+⋅-=⎥⎦⎤⎢⎣⎡⋅⋅+⋅⋅+⋅⋅+⋅⋅+⋅+⋅⋅-=⎥⎦⎤++++++⎢⎣⎡++-=-=∑∑∞黑白气象传真图的消息只有黑色和白色两种,即信源X ={黑,白}。