前向多层人工神经网络.

- 格式:ppt

- 大小:1.02 MB

- 文档页数:43

bp网络原理BP网络,即反向传播神经网络(Backpropagation Neural Network),是一种基于梯度下降算法的前馈神经网络。

它是一种常用的人工神经网络模型,被广泛应用于模式识别、预测和分类等任务中。

BP网络的基本原理是建立一个多层的神经网络结构,包括输入层、隐藏层和输出层。

每个神经元都与下一层的所有神经元连接,并通过权重连接进行信息传递。

输入信号从输入层经过权重连接传递到隐藏层,再经过隐藏层的激活函数作用后传递到输出层。

BP网络的训练过程主要分为前向传播和反向传播两个阶段。

在前向传播阶段,输入样本经过网络的各层神经元,得到输出结果。

每个神经元将输入信号与权重相乘并累加,然后经过激活函数进行非线性转换,得到该神经元的输出。

在反向传播阶段,通过计算输出层和期望输出之间的误差,按照梯度下降的方法不断调整每个神经元的权重,以最小化误差。

误差通过链式法则从输出层回传到隐藏层和输入层,根据权重的梯度进行更新。

反复迭代上述的前向传播和反向传播过程,直到网络的输出误差满足要求或训练次数达到指定值为止。

BP网络具有较好的非线性拟合能力和学习能力。

它的优点在于能够通过训练样本自动调整权重,从而对输入样本进行分类和预测。

然而,BP网络也存在一些问题,如容易陷入局部最小值、训练速度慢等。

为了克服BP网络的局限性,研究者们提出了一些改进方法,如改进的激活函数、正则化技术、自适应学习率等。

这些方法在提高网络性能和加速训练过程方面起到了积极的作用。

总结起来,BP网络是一种基于梯度下降算法的前馈神经网络,通过前向传播和反向传播的方式不断调整神经元的权重,以实现输入样本的分类和预测。

虽然存在一些问题,但通过改进方法可以提高其性能和训练速度。

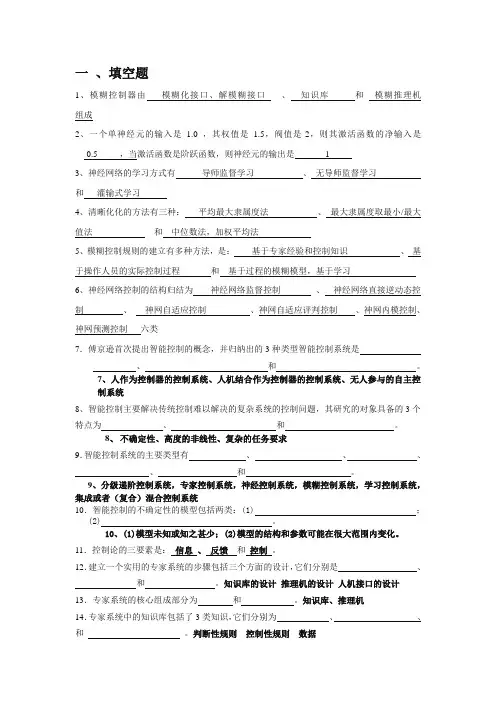

一、填空题1、模糊控制器由模糊化接口、解模糊接口、知识库和模糊推理机组成2、一个单神经元的输入是1.0 ,其权值是1。

5,阀值是—2,则其激活函数的净输入是-0。

5 ,当激活函数是阶跃函数,则神经元的输出是 13、神经网络的学习方式有导师监督学习、无导师监督学习和灌输式学习4、清晰化化的方法有三种:平均最大隶属度法、最大隶属度取最小/最大值法和中位数法,加权平均法5、模糊控制规则的建立有多种方法,是:基于专家经验和控制知识、基于操作人员的实际控制过程和基于过程的模糊模型,基于学习6、神经网络控制的结构归结为神经网络监督控制、神经网络直接逆动态控制、神网自适应控制、神网自适应评判控制、神网内模控制、神网预测控制六类7.傅京逊首次提出智能控制的概念,并归纳出的3种类型智能控制系统是、和.7、人作为控制器的控制系统、人机结合作为控制器的控制系统、无人参与的自主控制系统8、智能控制主要解决传统控制难以解决的复杂系统的控制问题,其研究的对象具备的3个特点为、和。

8、不确定性、高度的非线性、复杂的任务要求9.智能控制系统的主要类型有、、、、和。

9、分级递阶控制系统,专家控制系统,神经控制系统,模糊控制系统,学习控制系统,集成或者(复合)混合控制系统10.智能控制的不确定性的模型包括两类:(1);(2) 。

10、(1)模型未知或知之甚少;(2)模型的结构和参数可能在很大范围内变化。

11.控制论的三要素是:信息、反馈和控制。

12.建立一个实用的专家系统的步骤包括三个方面的设计,它们分别是、和。

知识库的设计推理机的设计人机接口的设计13.专家系统的核心组成部分为和.知识库、推理机14.专家系统中的知识库包括了3类知识,它们分别为、、和。

判断性规则控制性规则数据15.专家系统的推理机可采用的3种推理方式为推理、和推理。

15、正向推理、反向推理和双向推理16.根据专家控制器在控制系统中的功能,其可分为和。

16、直接型专家控制器、间接型专家控制器17.普通集合可用函数表示,模糊集合可用函数表示。

人工神经网络理论简介人工神经网络是基于模仿生物大脑结构和功能而构成的一种信息处理系统。

由于人工神经网络具有复杂的动力学特性、并行处理机制、学习、联想和记忆等功能,以及它的高度自组织、自适应能力和灵活活性而受到自然科学领域学者和各行业应用专家的广泛重视[31]。

4.1 神经网络的特点神经网络实际上是由大量简单元件相互连接而成的复杂网络,具有高度的非线性,能够进行复杂的逻辑操作和非线性关系实现的系统。

神经网络吸取了生物神经网络的许多优点,因而有其固有的特点[32]:1、分布式存储信息。

其信息的存储分布在不同的位置,神经网络是用大量神经元的连接及对各连接权值的分布来表示特定的信息,从而使网络在局部网络受损或输入信号因各种原因发生部分畸变时,仍然能够保证网络的正确输出,提高网络的容错性和鲁棒性。

2、并行协同处理信息。

神经网络中的每个神经元都可根据接收到的信息进行独立的运算和处理,并输出结果,同一层中的各个神经元的输出结果可被同时计算出来,然后传输给下一层做进一步处理,这体现了神经网络并行运算的特点,这个特点使网络具有非常强的实时性。

虽然单个神经元的结构及其简单,功能有限,但大量神经元构成的网络系统所能实现的行为是极其丰富多彩的。

3、良好的容错性与联想记忆功能。

神经网络通过自身的网络结构能够实现对信息的记忆。

而所记忆的信息是存储在神经元之间的权值中。

从单个权值中看不出所存储的信息内容,因而是分布式的存储方式。

这使得网络具有良好的容错性,并能进行聚类分析、特征提取、缺损模式复原等模式信息处理工作;又宜于做模式分类、模式联想等模式识别工作。

4、对信息的处理具有自组织、自学习的特点,便于联想、综合和推广。

神经网络的神经元之间的连接强度用权值大小表示,这种权值可以通过对训练样本的学习不断变化,而且随着训练样本量的增加和反复学习,这些神经元之间的连接强度会不断增加,从而提高神经元对这些样本特征的反应灵敏度。

4.2 神经网络的结构与泛化能力4.2.1 神经元模型神经元是人工神经网络的基本处理单元,它一般是一个多输入单输出的非线性元件。

人工智能–多层感知器基础知识解读今天我们重点探讨一下多层感知器MLP。

感知器(Perceptron)是ANN人工神经网络的一个概念,由Frank Rosenblatt于1950s第一次引入。

单层感知器(Single Layer Perceptron)是最简单的ANN人工神经网络。

它包含输入层和输出层,而输入层和输出层是直接相连的。

单层感知器仅能处理线性问题,不能处理非线性问题。

今天想要跟大家探讨的是MLP多层感知器。

MLP多层感知器是一种前向结构的ANN人工神经网络,多层感知器(MLP)能够处理非线性可分离的问题。

MLP概念:MLP多层感知器(MulTI-layerPerceptron)是一种前向结构的人工神经网络ANN,映射一组输入向量到一组输出向量。

MLP可以被看做是一个有向图,由多个节点层组成,每一层全连接到下一层。

除了输入节点,每个节点都是一个带有非线性激活函数的神经元。

使用BP反向传播算法的监督学习方法来训练MLP。

MLP是感知器的推广,克服了感知器不能对线性不可分数据进行识别的弱点。

相对于单层感知器,MLP多层感知器输出端从一个变到了多个;输入端和输出端之间也不光只有一层,现在又两层:输出层和隐藏层。

基于反向传播学习的是典型的前馈网络,其信息处理方向从输入层到各隐层再到输出层,逐层进行。

隐层实现对输入空间的非线性映射,输出层实现线性分类,非线性映射方式和线性判别函数可以同时学习。

MLP激活函数MLP可使用任何形式的激活函数,譬如阶梯函数或逻辑乙形函数(logisTIc sigmoid funcTIon),但为了使用反向传播算法进行有效学习,激活函数必须限制为可微函数。

由于具有良好可微性,很多乙形函数,尤其是双曲正切函数(Hyperbolictangent)及逻辑乙形函数,被采用为激活函数。

多层感知器AI技术中的多层感知器结构与模式识别多层感知器(Multi-Layer Perceptron, MLP)技术是人工智能(Artificial Intelligence, AI)领域中非常重要的一种技术。

它是一种前向人工神经网络,通过多个神经元层次的连接来模拟人脑中的神经元网络,并用于实现模式识别。

本文将介绍多层感知器的结构以及在模式识别中的应用。

一、多层感知器的结构多层感知器是由多个神经元层次组成的人工神经网络。

典型的多层感知器包括输入层、隐藏层和输出层。

1. 输入层输入层接收来自外部的数据输入,并将其传递到隐藏层。

输入层通常是根据具体问题设定的,可以是一组数字、图像或者其他形式的数据。

2. 隐藏层隐藏层是多层感知器中的核心部分。

它由多个神经元(节点)组成,每个神经元都与前一层的所有神经元相连。

隐藏层的层数以及每层的神经元数量都是可以调整的。

隐藏层通过对输入数据的加权求和和激活函数的作用,将处理后的数据输出到下一层。

3. 输出层输出层接收隐藏层的输出,并生成最终的输出结果。

输出层通常根据具体问题需要选择不同的激活函数,比如用于二分类问题的Sigmoid 函数或者用于多分类问题的Softmax函数。

二、多层感知器在模式识别中的应用多层感知器在模式识别领域有广泛的应用。

以下列举几个常见的应用场景。

1. 图像识别多层感知器可以用于图像识别任务,比如人脸识别、车牌识别等。

通过将图像数据输入到多层感知器中,隐藏层的神经元可以学习到图像的特征,输出层可以输出对应的分类结果。

2. 文本分类多层感知器可以用于文本分类任务,比如垃圾邮件过滤、情感分析等。

将文本数据表示成向量形式,输入到多层感知器中进行分类,可以实现对文本的自动分类。

3. 语音识别多层感知器可以用于语音识别任务,比如语音指令识别、语音转文字等。

将语音信号转换为频谱图或其他形式的特征表示,并输入到多层感知器进行识别,可以实现对语音的自动识别。

一、填空题1、模糊控制器由模糊化接口、解模糊接口、知识库和模糊推理机组成2、一个单神经元的输入是 1.0 ,其权值是 1.5,阀值是-2,则其激活函数的净输入是-0.5 ,当激活函数是阶跃函数,则神经元的输出是 13、神经网络的学习方式有导师监督学习、无导师监督学习和灌输式学习4、清晰化化的方法有三种:平均最大隶属度法、最大隶属度取最小/最大值法和中位数法,加权平均法5、模糊控制规则的建立有多种方法,是:基于专家经验和控制知识、基于操作人员的实际控制过程和基于过程的模糊模型,基于学习6、神经网络控制的结构归结为神经网络监督控制、神经网络直接逆动态控制、神网自适应控制、神网自适应评判控制、神网内模控制、神网预测控制六类7.傅京逊首次提出智能控制的概念,并归纳出的3种类型智能控制系统是、和。

7、人作为控制器的控制系统、人机结合作为控制器的控制系统、无人参与的自主控制系统8、智能控制主要解决传统控制难以解决的复杂系统的控制问题,其研究的对象具备的3个特点为、和。

8、不确定性、高度的非线性、复杂的任务要求9.智能控制系统的主要类型有、、、、和。

9、分级递阶控制系统,专家控制系统,神经控制系统,模糊控制系统,学习控制系统,集成或者(复合)混合控制系统10.智能控制的不确定性的模型包括两类:(1) ;(2) 。

10、(1)模型未知或知之甚少;(2)模型的结构和参数可能在很大范围内变化。

11.控制论的三要素是:信息、反馈和控制。

12.建立一个实用的专家系统的步骤包括三个方面的设计,它们分别是、和。

知识库的设计推理机的设计人机接口的设计13.专家系统的核心组成部分为和。

知识库、推理机14.专家系统中的知识库包括了3类知识,它们分别为、、和。

判断性规则控制性规则数据15.专家系统的推理机可采用的3种推理方式为 推理、 和 推理。

15、正向推理、反向推理和双向推理16.根据专家控制器在控制系统中的功能,其可分为 和 。

第一章前向神经网络一、感知器1、感知器网络结构设网络输入模式向量为:对应的输出为:连接权向量为:2、感知器的学习➢初始化连接权向量及输出单元的阈值赋予(-1,+1)区间内的随机值,一般为较小的随机非零值。

➢连接权的修正每个输入模式作如下计算:(a)计算网络输出:(b)计算输出层单元希望输出与实际输出y之间的误差:(c)修正各单元与输出层之间的连接权与阈值:➢对m个输入模式重复步骤,直到误差k d(k=1,2,…,m)趋于零或小于预先给定的误差限ε。

3、感知器的图形解释➢整个学习和记忆过程,就是根据实际输出与希望输出之间的误差调整参数w 和θ,即调整截割平面的空间位置使之不断移动,直到它能将两类模式恰当划分的过程。

➢学习过程可看作是由式决定的n维超平面不断向正确划分输入模式的位置移动的过程。

4、感知器的局限性➢两层感知器只能解决线性可分问题➢增强分类能力的唯一出路是采用多层网络,即在输入及输出层之间加上隐层构成多层前馈网络。

➢Kolmogorov理论经过严格的数学证明:双隐层感知器足以解决任何复杂的分类问题。

➢简单的感知器学习过程已不能用于多层感知器,必须改进学习过程。

二、BP 神经网络 1、反向传播神经网络1) 误差逆传播神经网络是一种具有三层或三层以上的阶层型神经网络: ➢ 上、下层之间各神经元实现全连接,即下层的每一个单元与上层的每个单元都实现权连接;➢ 而每层各神经元之间无连接; ➢ 网络按有监督的方式进行学习。

2)➢ 当一对学习模式提供给网络后,神经元的激活值,从输入层经各中间层向输出层传播,在输出层的各神经元获得网络的输入响应。

➢ 在这之后,按减小希望输出与实际输出误差的方向,从输出层经各中间层逐层修正各连接权,最后回到输入层,故得名“误差逆传播算法”。

➢ 随着这种误差逆传播修正的不断进行,网络对输入模式响应的正确率也不断上升。

2、梯度下降法1)梯度法是一种对某个准则函数的迭代寻优算法。

多层感知器算法在数据分类中的应用论文素材多层感知器算法在数据分类中的应用多层感知器(Multilayer Perceptron,简称MLP)是一种常见的人工神经网络模型,在数据分类领域得到了广泛应用。

本论文将介绍MLP算法的基本原理和在数据分类中的应用。

一、MLP算法的基本原理多层感知器算法是一种前向人工神经网络(Feedforward Artificial Neural Network)模型。

它由输入层、隐藏层和输出层构成,每个层由多个人工神经元(Artificial Neuron)组成。

1. 输入层:接收原始数据作为神经网络的输入,并负责传递数据到下一层。

2. 隐藏层:它是介于输入层和输出层之间的一层或多层,用于提取输入数据的特征信息。

每个神经元都通过一定的连接权重将输入传递给下一层。

3. 输出层:对于分类问题,输出层的神经元数量通常与分类的类别数量相同,每个神经元对应一个类别。

根据传递到输出层的信号强度,可以确定数据属于哪个类别。

在MLP算法中,每个神经元都由一个激活函数(Activation Function)来处理输入信号。

常用的激活函数包括Sigmoid函数、ReLU 函数和Softmax函数等。

MLP算法通过不断调整连接权重和阈值,使得神经网络能够学习并改进自己的性能。

训练过程通常采用反向传播算法(Backpropagation Algorithm)来更新网络参数。

二、MLP算法在数据分类中的应用MLP算法在数据分类中具有广泛的应用,尤其在图像和文本分类领域取得了显著的成果。

1. 图像分类图像分类是指将输入的图像划分到不同的类别,比如人脸识别、车辆检测等。

MLP算法可以用于图像特征提取和分类。

通过在隐藏层中设计合适的神经元数量和激活函数,MLP模型能够学习到图像的高级特征,从而提高分类的准确性。

2. 文本分类文本分类是将一段文本划分到不同的类别,比如垃圾邮件过滤、情感分析等。

MLP算法可以将文本表示为向量形式,并通过隐藏层学习到文本的语义信息。

多层前向网络及BP学习算法多层前向网络(Multilayer Feedforward Network)是一种常用的人工神经网络结构,用于解决各种分类和回归问题。

它由多个层次组成,每一层都包含多个神经元(节点),并且每个神经元都与前一层的所有神经元相连。

\[z_{j}^{(l)} = \sum_{i=1}^{n^{(l-1)}}w_{ij}^{(l)}x_{i}^{(l-1)} + b_{j}^{(l)}\]\[x_{j}^{(l)}=f(z_{j}^{(l)})\]其中,\(z_{j}^{(l)}\) 是第 \(l\) 层的第 \(j\) 个神经元的加权和,\(w_{ij}^{(l)}\) 是第 \(l-1\) 层的第 \(i\) 个神经元到第 \(l\) 层的第 \(j\) 个神经元的权重,\(x_{i}^{(l-1)}\) 是第 \(l-1\) 层的第 \(i\) 个神经元的输出,\(b_{j}^{(l)}\) 是第 \(l\) 层的第 \(j\) 个神经元的偏置项,\(f(\cdot)\) 是激活函数。

在训练多层前向网络时,可以使用反向传播(Backpropagation)学习算法。

反向传播算法基于梯度下降法,通过计算损失函数对网络参数的偏导数,来更新参数以最小化损失函数。

反向传播算法的主要步骤如下:1.前向传播:将训练样本输入网络,逐层计算每个神经元的输出。

3.反向传播:逐层计算每个神经元的误差信号,从输出层开始向输入层反向传播。

4.更新参数:根据误差信号和学习率,更新每个神经元的权重和偏置项。

5.重复步骤1-4,直到达到收敛条件或达到最大迭代次数。

尽管多层前向网络和反向传播算法是非常优秀的模型和学习算法,但它们也面临一些挑战和限制。

例如,多层前向网络可能会陷入局部最优解,而非全局最优解。

反向传播算法可能因为梯度消失或梯度爆炸的问题而导致训练不稳定。

此外,对于大规模复杂的问题,网络的深度和规模可能需要很大的计算资源和训练时间。