R语言学习系列25-K-S分布检验与正态性检验

- 格式:docx

- 大小:227.34 KB

- 文档页数:10

k-s正态检验原理

K-S正态检验(Kolmogorov-Smirnov 正态性检验)是一个统计学

工具,用于检测样本是否来自正态分布。

它是根据Kolmogorov和Smirnov统计学家的研究而发展出来的。

K-S正态检验的主要原理是比

较样本的累积分布函数(CDF)和理论上的正态分布的CDF之间的最大绝

对差异。

K-S正态检验的具体原理如下:

1、计算给定样本数据的累积分布函数Fn(x),这里只需要将样本

数据从小到大进行排序,然后根据公式计算出累积分布函数。

2、计算假设正态分布的累积分布函数F0(x),可以使用正态分布

函数的公式进行计算。

3、计算样本累积分布函数Fn(x)和假设正态分布的累积分布函数

F0(x)的最大绝对差异Dn。

4、将最大绝对差异Dn 与已知的概率值Dα相比较,如果Dn <

Dα,则说明样本符合正态分布,反之则表明样本不符合正态分布。

K-S正态检验是一种非参数性检验,它不受极值和样本偏斜的影响,检验时样本量少也会得出准确的结果,并可以检测简单的非正态性假设,因此应用范围很广泛。

K-S正态检验通过比较样本数据的累积分布

函数和理论上假设的正态分布的累积分布函数之间的最大绝对差异,

来检验样本是否符合正态分布,从而确定样本抽样信息的有效性。

r语言正态分布函数正态分布(Normal Distribution)是应用最广泛的概率分布之一,在统计学与概率论中具有重要的地位。

它也被称为高斯分布(Gaussian Distribution),由于其形状像一个钟形曲线,因此也常被称为钟形曲线。

正态分布的概率密度函数(Probability Density Function, PDF)如下:\[ f(x) = \frac{1}{\sqrt{2\pi\sigma^2}}e^{-\frac{(x-\mu)^2}{2\sigma^2}} \]其中,\( \mu \) 表示均值(mean),\( \sigma \) 表示标准差(standard deviation),\( \pi \) 是圆周率。

正态分布函数的特征:1.它是单峰的且呈对称分布,左右两侧的概率密度相等。

2. 均值 \( \mu \) 决定着正态分布的中心位置,标准差 \( \sigma \) 决定着曲线的陡峭程度。

当 \( \sigma \) 较小时,曲线较陡峭;当\( \sigma \) 较大时,曲线较平缓。

3. 标准正态分布是均值 \( \mu = 0 \) ,标准差 \( \sigma = 1 \) 的正态分布。

在R语言中,可以使用以下函数进行正态分布相关的计算。

(1)dnorm(:计算给定取值的概率密度函数值。

具体用法如下:\[ dnorm(x, mean = \mu, sd = \sigma) \]其中,x 表示指定的取值,mean 表示均值,sd 表示标准差。

示例代码:```#计算x=2的概率密度dnorm(2, mean = 0, sd = 1)```(2)pnorm(:计算给定取值的累积分布函数值。

具体用法如下:\[ pnorm(x, mean = \mu, sd = \sigma) \]其中,x 表示指定的取值,mean 表示均值,sd 表示标准差。

示例代码:```#计算x≤2的累积概率pnorm(2, mean = 0, sd = 1)```(3)qnorm(:给定一个概率值,计算对应的分位点。

正态检验方法一、前言正态检验是统计学中常用的一种方法,用于检验数据是否符合正态分布。

正态分布是指在概率论和统计学中经常出现的一种连续概率分布,其特点是对称、单峰、钟形曲线。

正态分布在实际应用中具有很重要的意义,因此对数据进行正态检验就显得尤为重要。

本文将详细介绍正态检验的方法以及如何使用R语言进行正态检验。

二、什么是正态检验?正态检验(Normality Test)是指通过某些统计量对数据样本进行假设检验,判断样本是否符合正态分布。

常见的统计量有Kolmogorov-Smirnov (K-S) 检验、Shapiro-Wilk 检验、Anderson-Darling (A-D) 检验等。

三、K-S检验K-S检验(Kolmogorov–Smirnov test)是一种非参数假设检验方法,主要用于判断一个样本是否来自某个已知分布。

在正态性检查中,我们可以使用K-S测试来比较观察值与标准正态分布之间的差异。

1. K-S测试原理在使用K-S测试时,我们首先需要确定一个假设H0:该样本来自一个已知分布。

通常情况下,该已知分布是标准正态分布。

我们可以使用样本的均值和标准差来估计标准正态分布的参数。

接下来,我们需要计算出观察值与标准正态分布之间的最大偏差(D)。

这个偏差是指在统计学上,观察值与标准正态分布之间的最大距离。

最后,我们需要根据样本大小和显著性水平确定临界值。

如果D大于临界值,则拒绝假设H0,即该样本不符合正态分布。

2. 使用R语言进行K-S检验在R语言中,我们可以使用ks.test()函数进行K-S检验。

该函数包含两个参数:x表示要检验的数据向量;y表示用于比较的已知分布。

例如:```R# 生成一个随机数向量set.seed(123)x <- rnorm(100)# 进行K-S检验ks.test(x, "pnorm")```输出结果为:```ROne-sample Kolmogorov-Smirnov testdata: xD = 0.0863, p-value = 0.4814alternative hypothesis: two-sided```其中,D表示最大偏差;p-value表示拒绝原假设的显著性水平。

1.Kolmogorov-Smirnov正态性检验Kolmogorov-Smirnov是比较一个频率分布f(x)与理论分布g(x)或者两个观测值分布的检验方法,若两者间的差距很小,则推论该样本取自某特定分布族或两个观测值分布相同使用函数:ks.test()在默认安装的stats包中说明:ks.test有四个参数,第一个参数x为观测值向量,第二个参数y为第二观测值向量或者累计分布函数或者一个真正的累积分布函数,如pnorm(正态分布函数,一般做正态检测的时候直接输入pnorm),只对连续CDF有效。

第三个参数为指明是单侧检验还是双侧检验,exact参数为NULL或者一个逻辑值,表明是否需要计算精确的P值。

结果解释:结果中会出现统计量D值和p-value,D值越小,越接近0,表示样本数据越接近正态分布p值,如果p-value小于显著性水平α(0.05),则拒绝H0注意:在做单样本K-S检验或者正态检验时,有时会有错误提示“Kolmogorov - Smirnov 检验里不应该有连结”,这是因为K-S检验只对连续CDF有效,而连续CDF中出现相同值的概率为0,因此R会报错。

这也提醒我们,在做正态性检验之前,要先对数据进行描述性分析,对数据整体要先有个大致的认识,这也才后续才能选择正确的检验方法。

2.Shapiro-Wilk检验Shapiro-Wilk检验在小样本情况下,是很普通的正态性检验方法。

使用函数:Shapiro.test()在默认安装的stats包中说明: Shapiro.test()只有一个参数x,并且只要是数字向量即可,也可以有缺失值,但是非缺失值数量必须在3-5000之间,这是R的规定。

结果解释:结果中会出现统计量W值和p-value:W值越小,越接近0,表示样本数据越接近正态分布p值,如果p-value小于显著性水平α(0.05),则拒绝H03.Lilliefor检验是Kolmogorov-Smirnov正态性检验修正,可用于正态性检验使用函数:lillie.test()在nortest包中说明: lillie.test()只有一个参数x,只要是数字向量即可,也可以有缺失值,但是非缺失值数量必须>4,这是R的规定结果解释:结果中会出现统计量D值和p-value:D值越小,越接近0,表示样本数据越接近正态分布p值,如果p-value小于显著性水平α(0.05),则拒绝H0注意:在R中使用lillefor检验,就相当于在SPSS探索分析中的正态性检验的Kolmogorov-Smirnov的lilliefors的修正值,二者结果是相同的。

R已经成为当前国际学术界最流行的统计和绘图软件之一,该语言较为简单易学,统计分析功能强大,且具有很强的绘图功能,能够绘制学术出版要求的多种图表.R语言在生物信息学,进化生物学、生态学与环境、经济学、语言学等领域有着极为广泛的应用。

R软件是跨平台的,可以在Linux, MacOs, Windows等多种系统上运行。

针对每个研究方向,有大量的科研人员编写了相关的程序包,可以导入到基本的程序平台上运行。

现有的程序包已经超过了1800个,并且还在增加中。

学习并掌握R语言,对于需要用到统计学的研究人员和学生都是非常必要的。

这里选取了R语言中若干操作实例,所有的命令行均可以在R中运行,并得到结果。

正态总体均值的假设检验t检验单个总体例一某种元件的寿命X(小时),服从正态分布,N(mu,sigma^2),其中mu,sigma^2均未知,16只元件的寿命如下:问是否有理由认为元件的平均寿命大于255小时。

命令:X<-c(159, 280, 101, 212, 224, 379, 179, 264,222, 362, 168, 250, 149, 260, 485, 170)t.test(X, alternative = "greater", mu = 225)两个总体例二X为旧炼钢炉出炉率,Y为新炼钢炉出炉率,问新的操作能否提高出炉率命令:X<-c(78.1,72.4,76.2,74.3,77.4,78.4,76.0,75.5,76.7,77.3)Y<-c(79.1,81.0,77.3,79.1,80.0,79.1,79.1,77.3,80.2,82.1)t.test(X, Y, var.equal=TRUE, alternative = "less")成对数据t检验例三对每个高炉进行配对t检验命令:X<-c(78.1,72.4,76.2,74.3,77.4,78.4,76.0,75.5,76.7,77.3)Y<-c(79.1,81.0,77.3,79.1,80.0,79.1,79.1,77.3,80.2,82.1)t.test(X-Y, alternative = "less")正态总体方差的假设检验例四从小学5年级男生中抽取20名,测量其身高(厘米)如下:问,在0.05显著性水平下,平均值是否等于149sigma^2 是否等于 75命令:X<-scan()136 144 143 157 137 159 135 158 147 165158 142 159 150 156 152 140 149 148 155var.test(X,Y)例五对炼钢炉的数据进行分析命令:X<-c(78.1,72.4,76.2,74.3,77.4,78.4,76.0,75.5,76.7,77.3)Y<-c(79.1,81.0,77.3,79.1,80.0,79.1,79.1,77.3,80.2,82.1)var.test(X,Y)二项分布的总体检验例六有一批蔬菜种子的平均发芽率为P=0.85,现在随机抽取500粒,用种衣剂进行浸种处理,结果有445粒发芽,问种衣剂有无效果。

R知识点总结R知识点复习第⼆章:R软件的使⽤⼀、向量1、">"是命令提⽰符,“<-”或“=”表⽰赋值运算符;“+”表⽰加,“-”表⽰减法,“*”表⽰乘法,“/”表⽰除法,“%/%”表⽰整除,“%%”表⽰取余数,“**”或“^”表⽰乘⽅;2、函数:sqrt() #开⽅log() #取对数exp() #取指数sin();cos();tan() #三⾓函数max();min() #求最⼤最⼩值mean() #求均值sum() #计算⾃变量向量的元素和var(), sd() #计算样本⽅差,计算标准差c() #把数据组合为⼀个向量rang() #返回包含最⼩值和最⼤值的向量sort() #返回按x的元素从⼩到⼤排序的结果向量order() #返回使得x的元素从⼩到⼤排序的元素下表的向量numeric(n) #产⽣有规律的数列seq() #等差数列函数rep() #重复第⼀个⾃变量若⼲次paste () #把⾃变量连城字符串,中间⽤空格隔开3、例如(1)绘制余弦函数图x1=1:100;x1x2<-x1*2*pi/100;x2y=cos(x2);yplot(x1,y,type='l') #type=‘l’是字母l(2)函数c()⽤来把数据组合为⼀个向量vect<-c(10,6,4,7,8)boxplot(vect) #绘制数据的盒形图(3)函数rep表⽰重复第⼀个⾃变量若⼲次,如:rep(w,2)[1] 4 -2 7 0 4 -2 7 0rep(c(10,28),c(2,3))⼆、矩阵与多维数组1、“+”“-”“*”“/”“^”矩阵的四则运算“A%*%B”表⽰矩阵A乘以矩阵B“x%*%A%*%x”表⽰⼀个⼆次型2、matrix() #⽤来⽣成矩阵c(A) #得到将矩阵A的元素按列排列的向量 cbind() #把⾃变量横向拼成⼀个⼤矩阵rbing() #把⾃变量纵向拼成⼀个⼤矩阵t() #求矩阵的转置crossprod() #求内积solve() #求矩阵的逆eigen() #计算特征向量和特征值;diag(vector) #返回以⾃变量为主对⾓元素的对⾓矩阵;diag(matrix)) #返回由矩阵的主对⾓元素组成的矩阵;diag(k) #返回k阶单位矩阵。

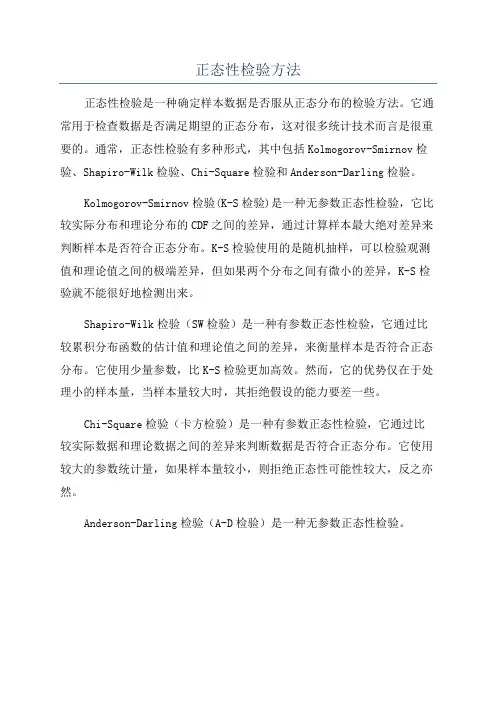

正态性检验方法

正态性检验是一种确定样本数据是否服从正态分布的检验方法。

它通常用于检查数据是否满足期望的正态分布,这对很多统计技术而言是很重要的。

通常,正态性检验有多种形式,其中包括Kolmogorov-Smirnov检验、Shapiro-Wilk检验、Chi-Square检验和Anderson-Darling检验。

Kolmogorov-Smirnov检验(K-S检验)是一种无参数正态性检验,它比较实际分布和理论分布的CDF之间的差异,通过计算样本最大绝对差异来判断样本是否符合正态分布。

K-S检验使用的是随机抽样,可以检验观测值和理论值之间的极端差异,但如果两个分布之间有微小的差异,K-S检验就不能很好地检测出来。

Shapiro-Wilk检验(SW检验)是一种有参数正态性检验,它通过比较累积分布函数的估计值和理论值之间的差异,来衡量样本是否符合正态分布。

它使用少量参数,比K-S检验更加高效。

然而,它的优势仅在于处理小的样本量,当样本量较大时,其拒绝假设的能力要差一些。

Chi-Square检验(卡方检验)是一种有参数正态性检验,它通过比较实际数据和理论数据之间的差异来判断数据是否符合正态分布。

它使用较大的参数统计量,如果样本量较小,则拒绝正态性可能性较大,反之亦然。

Anderson-Darling检验(A-D检验)是一种无参数正态性检验。

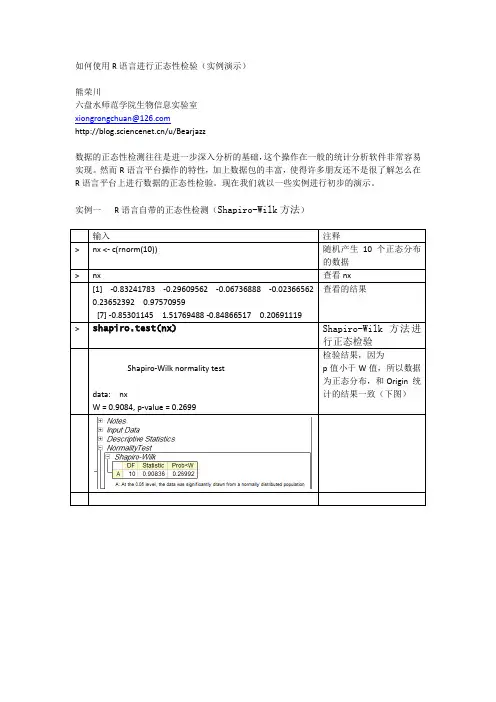

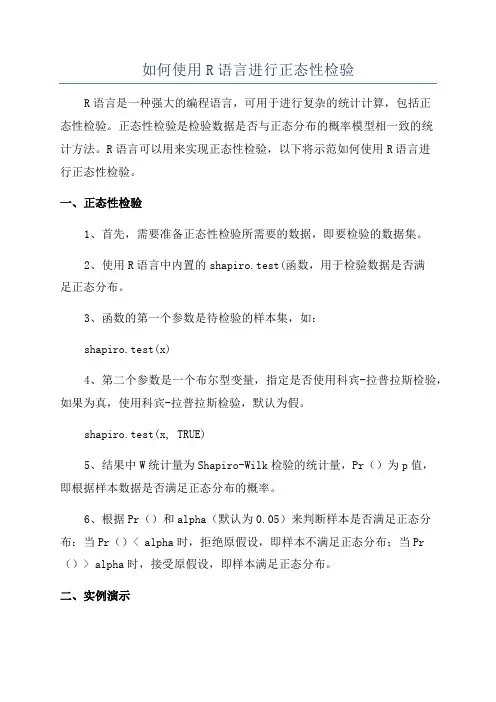

如何使用R语言进行正态性检验

R语言是一种强大的编程语言,可用于进行复杂的统计计算,包括正

态性检验。

正态性检验是检验数据是否与正态分布的概率模型相一致的统

计方法。

R语言可以用来实现正态性检验,以下将示范如何使用R语言进

行正态性检验。

一、正态性检验

1、首先,需要准备正态性检验所需要的数据,即要检验的数据集。

2、使用R语言中内置的shapiro.test(函数,用于检验数据是否满

足正态分布。

3、函数的第一个参数是待检验的样本集,如:

shapiro.test(x)

4、第二个参数是一个布尔型变量,指定是否使用科宾-拉普拉斯检验,如果为真,使用科宾-拉普拉斯检验,默认为假。

shapiro.test(x, TRUE)

5、结果中W统计量为Shapiro-Wilk检验的统计量,Pr()为p值,

即根据样本数据是否满足正态分布的概率。

6、根据Pr()和alpha(默认为0.05)来判断样本是否满足正态分布:当Pr()< alpha时,拒绝原假设,即样本不满足正态分布;当Pr ()> alpha时,接受原假设,即样本满足正态分布。

二、实例演示

以下以一个正态性检验实例进行演示,先创建一个长度为20的正太分布序列,数列代表班学生分数:

x<-rnorm(20, mean = 75, sd = 10)。

r语言正态分布检验正态分布检验是统计学中非常重要的一种检验方法,通过对数据进行正态分布检验可以判断样本数据是否符合正态分布假设。

在R语言中,我们可以使用多种方法来进行正态分布检验,包括基于图形的方法和基于统计量的方法。

1. 基于图形的正态分布检验在R语言中,我们可以使用qqnorm()和qqline()函数来绘制QQ图,通过观察QQ图中的点是否落在直线上来判断样本数据是否符合正态分布假设。

如果大多数点都落在直线上,则说明样本数据符合正态分布假设;如果点不均匀地散布在直线两侧,则说明样本数据不符合正态分布假设。

下面是一个简单的例子:```r# 生成100个随机数data <- rnorm(100)# 绘制QQ图qqnorm(data)qqline(data)```上述代码会生成一个QQ图,我们可以通过观察该图来判断样本数据是否符合正态分布假设。

2. 基于统计量的正态分布检验在R语言中,我们还可以使用多种统计量来进行正态分布检验,包括Shapiro-Wilk检验、Kolmogorov-Smirnov检验、Anderson-Darling检验等。

这些方法都有各自的优缺点,选择哪种方法取决于具体的数据情况和研究目的。

下面以Shapiro-Wilk检验为例,介绍如何在R语言中进行正态分布检验:```r# 生成100个随机数data <- rnorm(100)# 进行Shapiro-Wilk检验shapiro.test(data)```上述代码会输出Shapiro-Wilk检验的结果,包括W统计量和p值。

如果p值小于显著性水平(通常为0.05),则说明样本数据不符合正态分布假设;否则,我们无法拒绝正态分布假设。

需要注意的是,虽然正态分布检验可以帮助我们判断样本数据是否符合正态分布假设,但并不意味着只有符合正态分布假设的数据才能进行统计分析。

在实际应用中,我们经常会遇到一些非正态分布的数据,这时候我们可以考虑使用非参数方法来进行统计分析。

R语言中的ks.test()函数是用来检验数据是否符合正态分布的常用工具之一。

通过对数据进行Kolmogorov-Smirnov检验,我们可以对数据的分布进行合理的判断,从而为后续的数据分析和建模提供重要依据。

在本文中,我们将介绍ks.test()函数的使用方法及其在正态分布检验中的应用。

一、ks.test()函数的基本用法在R语言中,ks.test()函数是stats包中自带的函数,用于进行Kolmogorov-Smirnov检验。

其基本用法如下所示:```Rks.test(x, "pnorm", mean = m, sd = s)```其中,参数x为待检验的数据,"pnorm"表示所要检验的理论分布,mean和sd分别为理论分布的均值和标准差。

该函数返回一个包含检验统计量和p值的结果。

二、ks.test()函数的参数说明1. x:待检验的样本数据,可以是一个数值向量或一个数据框,但必须是一维的。

2. y:要检验的理论分布,如"pnorm"表示正态分布。

还可以指定其他的分布,如"unif"表示均匀分布。

3. alternative:可取"two.sided"(默认值), "less" 或 "greater",分别表示双侧检验、左侧检验和右侧检验。

4. mu:理论分布的均值。

当y为"pnorm"时,mu表示正态分布的均值。

5. sd:理论分布的标准差。

当y为"pnorm"时,sd表示正态分布的标准差。

三、ks.test()函数的示例接下来,我们通过一个简单的示例来演示ks.test()函数的使用。

假设我们有一个样本数据x,我们想要检验它是否符合均值为0、标准差为1的正态分布。

代码如下所示:```Rset.seed(123)x <- rnorm(100, mean = 0, sd = 1)ks.test(x, "pnorm", mean = 0, sd = 1)```运行以上代码,我们可以得到如下输出:```One-sample Kolmogorov-Smirnov testdata: xD = 0.0, p-value = 0.5816alternative hypothesis: two-sided```从输出结果可以看出,检验统计量D为0.0,p值为0.5816,显著大于显著水平α=0.05,因此我们无法拒绝样本数据符合正态分布的原假设。

k-s正态检验原理K-S正态检验原理是一种统计方法,用于检验一组数据是否服从正态分布。

正态分布是统计学中最为常见的概率分布之一,具有可靠的推断和预测性能,因此在许多实际问题中都有着广泛的应用。

K-S正态检验原理基于Kolmogorov-Smirnov(K-S)检验方法,该方法是由Andrei Kolmogorov和Nikolai Smirnov于1933年提出的,用于检验是否有理由相信数据来自一个特定的分布。

K-S正态检验是K-S检验方法在检验正态分布时的一种应用。

具体而言,K-S正态检验原理首先计算给定数据样本的累积分布函数(CDF),然后将其与已知的正态分布的理论累积分布函数进行比较。

如果两个累积分布函数之间的差异较小,那么我们可以得出结论,样本数据很可能来自正态分布。

相反,如果差异较大,那么我们可以否定样本数据来自正态分布的假设。

具体步骤如下:1. 收集和准备数据样本。

通常,我们需要一个满足随机性和独立性假设的大样本来进行正态检验。

2. 计算CDF。

对于给定的数据样本,我们计算每个数据点的累积分布函数。

这可以通过计算每个数据点的排名百分比(即数据点在整个数据集中的百分位数)来实现。

3. 计算理论CDF。

根据正态分布的参数(均值和标准差),我们计算给定数据样本的理论累积分布函数。

4. 比较CDF。

将计算得到的CDF与理论CDF进行比较。

通常,我们使用K-S统计量来衡量两个CDF之间的最大差异。

K-S统计量定义为两个CDF之间的最大垂直距离。

5. 进行假设检验。

根据K-S统计量的大小和置信水平(一般取0.05),我们可以进行假设检验。

如果K-S统计量小于临界值,我们可以接受原假设,即数据样本来自正态分布。

反之,如果K-S统计量大于临界值,我们可以拒绝原假设,即数据样本不来自正态分布。

K-S正态检验原理的优点是简单易行,且不需要对数据进行任何变换。

它可以直接判断数据是否服从正态分布,而不需要进行参数估计。

ks检验代码r语言在R语言中,进行K-S检验(Kolmogorov-Smirnov test)可以使用内置的ks.test()函数。

这个函数可以用来检验一个样本是否来自特定的分布。

例如,如果你想要检验一个样本是否来自正态分布,你可以使用ks.test()函数来进行K-S检验。

下面是一个简单的示例代码,演示如何在R中使用ks.test()函数进行K-S检验:R.# 生成一个服从正态分布的随机样本数据。

data <rnorm(100)。

# 进行K-S检验,检验样本数据是否来自正态分布。

ks_result <ks.test(data, "pnorm")。

# 输出K-S检验的结果。

print(ks_result)。

在这个示例中,我们首先生成了一个服从正态分布的随机样本数据,然后使用ks.test()函数对这个样本数据进行K-S检验,检验是否来自正态分布。

ks.test()函数的第一个参数是样本数据,第二个参数是用来指定所假设的分布的字符串,"pnorm"表示正态分布。

ks.test()函数会返回K-S检验的结果,包括检验统计量和p值等信息。

需要注意的是,K-S检验对于样本量较大的样本具有较高的功效,但对于样本量较小的样本可能不够敏感。

因此,在进行K-S检验时,需要考虑样本量的大小以及所假设的分布是否合理。

除了正态分布外,ks.test()函数还可以用来检验样本是否来自其他分布,例如均匀分布、指数分布等。

需要根据具体情况选择合适的分布类型进行K-S检验。

总之,通过使用ks.test()函数,我们可以在R语言中方便地进行K-S检验,从而对样本数据的分布进行检验和分析。

23。

K—S分布检验与正态性检验(一)假设检验1. 什么是假设检验?实际中,我们只能得到抽取的样本(部分)的统计结果,要进一步推断总体(全部)的特征,但是这种推断必然有可能犯错,犯错的概率为多少时应该接受这种推断呢?为此,统计学家就开发了一些统计方法进行统计检定,通过把所得到的统计检定值,与统计学家树立了一些随机变量的概率分布进行对比,我们可以知道在百分之多少的机遇下会得到目前的结果。

倘若经比较后发现,涌现这结果的机率很少,即是说,是在时机很少、很罕有的情况下才出现;那我们便可以有信念地说,这不是巧合,该推断结果是具有统计学上的意义的。

否则,就是推断结果不具有统计学意义。

2. 假设检验的基本思想——小概率反证法思想小概率思想是指小概率事件(P<α, α=0.05或0.01)在一次试验中基本上不会发生。

反证法思想是先提出原假设(H0),再用适当的统计方法确定假设成立的可能性(P值)大小,如可能性小(P≤α),则认为原假设不成立,若可能性大,则还不能认为备择假设(H1)成立。

3. 原假设与备择假设原假设与备择假设是完备且相互独立的事件组,一般,原假设(H0)——研究者想收集证据予以反对的假设;备择假设(H1)—-研究者想收集证据予以支持的假设;假设检验的P值,就是在H0为真时,观察到的差异来源于抽样误差的可能性大小。

假设检验判断方法有:临界值法、P值检验法.四、假设检验分类及步骤(以t检验为例)1. 双侧检验I. 原假设H0:μ=μ0, 备择假设H1:μ≠μ0;Ⅱ。

根据样本数据计算出统计量t的观察值t0;Ⅲ. P值= P{|t| ≥|t0|} = t0的双侧尾部的面积;Ⅳ. 若P值≤α(在双尾部分),则在显著水平α下拒绝H0;若P值〉α,则在显著水平α下接受H0;注意:α为临界值,看P值在不在阴影部分(拒绝域),空白部分为接受域。

2. 左侧检验I。

原假设H0:μ≥μ0, 备择假设H1:μ<μ0;Ⅱ。

R语⾔系列学习(各种检验)1、W检验(Shapiro–Wilk (夏⽪罗–威克尔 ) W统计量检验)检验数据是否符合正态分布,R函数:shapiro.test().结果含义:当p值⼩于某个显著性⽔平α(⽐如0.05)时,则认为样本不是来⾃正态分布的总体,否则则承认样本来⾃正态分布的总体。

2、K检验(经验分布的Kolmogorov-Smirnov检验)R函数:ks.test(),如果P值很⼩,说明拒绝原假设,表明数据不符合F(n,m)分布。

3、相关性检验:R函数:cor.test()cor.test(x, y,alternative = c("two.sided", "less", "greater"),method = c("pearson", "kendall", "spearman"),exact = NULL, conf.level = 0.95, ...)结果含义:如果p值很⼩,则拒绝原假设,认为x,y是相关的。

否则认为是不相关的。

4、T检验⽤于正态总体均值假设检验,单样本,双样本都可以。

t.test()t.test(x, y = NULL,alternative = c("two.sided", "less", "greater"),mu = 0, paired = FALSE, var.equal = FALSE,conf.level = 0.95, ...)结果意义:P值⼩于显著性⽔平时拒绝原假设,否则,接受原假设。

具体的假设要看所选择的是双边假设还是单边假设(⼜分⼩于和⼤于)5、正态总体⽅差检验t.test(x, y = NULL,alternative = c("two.sided", "less", "greater"),mu = 0, paired = FALSE, var.equal = FALSE,conf.level = 0.95, ...)结果含义:P值⼩于显著性⽔平时拒绝原假设,否则,接受原假设。

23. K-S分布检验与正态性检验(一)假设检验1. 什么是假设检验?实际中,我们只能得到抽取的样本(部分)的统计结果,要进一步推断总体(全部)的特征,但是这种推断必然有可能犯错,犯错的概率为多少时应该接受这种推断呢?为此,统计学家就开发了一些统计方法进行统计检定,通过把所得到的统计检定值,与统计学家树立了一些随机变量的概率分布进行对比,我们可以知道在百分之多少的机遇下会得到目前的结果。

倘若经比较后发现,涌现这结果的机率很少,即是说,是在时机很少、很罕有的情况下才出现;那我们便可以有信念地说,这不是巧合,该推断结果是具有统计学上的意义的。

否则,就是推断结果不具有统计学意义。

2. 假设检验的基本思想——小概率反证法思想小概率思想是指小概率事件(P<α, α=0.05或0.01)在一次试验中基本上不会发生。

反证法思想是先提出原假设(H0),再用适当的统计方法确定假设成立的可能性(P值)大小,如可能性小(P≤α),则认为原假设不成立,若可能性大,则还不能认为备择假设(H1)成立。

3. 原假设与备择假设原假设与备择假设是完备且相互独立的事件组,一般,原假设(H0)——研究者想收集证据予以反对的假设;备择假设(H1)——研究者想收集证据予以支持的假设;假设检验的P值,就是在H0为真时,观察到的差异来源于抽样误差的可能性大小。

假设检验判断方法有:临界值法、P值检验法。

四、假设检验分类及步骤(以t检验为例)1. 双侧检验I. 原假设H0: μ=μ0, 备择假设H1:μ≠μ0;Ⅱ. 根据样本数据计算出统计量t的观察值t0;Ⅲ. P值= P{|t| ≥|t0|} = t0的双侧尾部的面积;Ⅳ. 若P值≤α(在双尾部分),则在显著水平α下拒绝H0;若P值>α,则在显著水平α下接受H0;注意:α为临界值,看P值在不在阴影部分(拒绝域),空白部分为接受域。

2. 左侧检验I. 原假设H0: μ≥μ0, 备择假设H1:μ<μ0;Ⅱ. 根据样本数据计算出统计量t的观察值t0(< 0);Ⅲ. P值= P{t ≤t0} = t0的左侧尾部的面积;Ⅳ. 若P值≤α(在左尾部分),则在显著水平α下拒绝H0; 若P值>α,则在显著水平α下接受H0;3. 右侧检验I. 原假设H0: μ≤μ0, 备择假设H1:μ>μ0;Ⅱ. 根据样本数据计算出统计量t的观察值t0(> 0);Ⅲ. P值= P{t ≥t0} = t0的右侧尾部的面积;Ⅳ. 若P值≤α(在右尾部分),则在显著水平α下拒绝H0; 若P值>α,则在显著水平α下接受H0;(二)K-S 分布检验Kolmogorov-Smirnov 检验,用来检验一组样本数据是否服从某已知分布,或两组样本数据是否服从相同分布。

用函数ks.test()实现,基本格式为:ks.test(x, y, ...,alternative=,exact=NULL)其中,x 为样本数据;y 为分布名(此时…为该分布的参数)或样本数据;alternative 设置是"two.sided"双侧检验(默认)、"less"左侧检验、"greater"右侧检验;exact 设置是否计算精确p 值,默认NULL 。

1. K-S 单样本总体分布检验用来检验样本数据是否服从某已知分布。

它是一种基于经验分布函数的检验,令0sup |()()|n n nD F x F x =-其中,()n F x 为一组随机样本的累计概率分布函数,0()F x 为真实的分布函数。

当n→∞时,nD的极限分布满足:22(1)exp(2), 0}()0, 0njjnjP Kλλλλλ=-∞⎧-->⎪<→=⎨⎪≤⎩∑原假设H0:nF F=即分布相同;备择假设H1:二者分布不同。

X=c(420,500,920,1380,1510,1650,1760,2100,2300,2350) #某设备10次无故障工作时间的数据lambda<-mean(X)lambda[1] 1489ks.test(X,"pexp",1/lambda)#检验是否服从参数为1/1489的指数分布One-sample Kolmogorov-Smirnov testdata: XD = 0.30418, p-value = 0.2563alternative hypothesis: two-sidedP值=0.2563>0.05,接受原假设H0,即服从指数分布。

2. 两独立样本K-S同分布检验假定有分别来自两个独立总体的两个样本,要检验是否服从同一分布。

设两个样本的样本量分别为1n和2n,累积经验分布函数分别为1()F x和2()F x,令12()()j j jD F x F x=-,则统计量max||jjZ D=近似服从正态分布。

原假设H0:12F F=服从同一分布;备择假设H1:不服从同一分布。

xx=c(0.61,0.29,0.06,0.59,-1.73,-0.74,0.51,-0.56,0.39, 1.64,0.05,-0.06,0.64,-0.82,0.37,1.77,1.09,-1.28,2.36,1.31, 1.05,-0.32,-0.40,1.06,-2.47)yy=c(2.20,1.66,1.38,0.20,0.36,0.00,0.96,1.56,0.44,1.5 0,-0.30,0.66,2.31,3.29,-0.27,-0.37,0.38,0.70,0.52,-0.71) ks.test(xx,yy) #检验两组数据是否服从同一分布Two-sample Kolmogorov-Smirnov testdata: xx and yyD = 0.23, p-value = 0.5286alternative hypothesis: two-sidedP值=0.5286>0.05, 接受原假设,即两组数据服从同一分布。

注1:在做K-S检验时,有时会有错误提示“Kolmogorov - Smirnov 检验里不应该有连结”,这是因为K-S检验只对连续CDF有效,而连续CDF中出现相同值的概率为0,因此R会报错。

这也提醒我们,在做正态性检验之前,要先对数据进行描述性分析,对数据整体要先有个大致的认识,这也才后续才能选择正确的检验方法。

注2:K-S检验主要用于定量数据,而卡方同质性检验主要用于分类数据。

(三)正态性检验原假设H0:服从正态分布;备择假设H1:不服从正态分布一、Shapiro-Wilk检验(W检验)适合在样本量8≤n≤50时使用。

W检验是建立在次序统计量的基础上,对n个独立观测值按非降排序,记为12,,,n x x x ,检验统计量:21121[()]()ni n i i i ni i a x x W x x +-==-=-∑∑当总体分布为正态分布时,W 值应该接近于1。

用函数shapiro.test()实现,基本格式为:shapiro.test(x)其中,x 为样本数据。

attach(mtcars)shapiro.test(mpg)Shapiro-Wilk normality testdata: mpgW = 0.94756, p-value = 0.1229detach(mtcars)P 值=0.1229>0.05, 接受原假设,即服从正态分布。

二、Kolmogorov-Smirnov 检验(D 检验)适合在样本量50≤n ≤1000时使用。

即将前文的K-S 单样本总体分布检验的已知分布,设为正态分布即可。

或者使用Lilliefor 检验,它是Kolmogorov-Smirnov 正态性检验修正,使用nortest 包中的函数lillie.test()实现。

基本格式为:lillie.test(x)其中x 为样本数据。

lillie.test(mpg)Lilliefors (Kolmogorov-Smirnov) normality testdata: mpgD = 0.1263, p-value = 0.2171detach(mtcars)P 值=0.2171>0.05, 接受原假设,即服从正态分布。

三、Jarque-Bera 正态性检验是基于偏度和峰度的联合分布检验法。

记偏度为S ,峰度为K ,则统计量:222()~(2)64n k K JB S χ-=+ 用tseries 包中的使用函数jarque.bera.test()实现,基本格式:jarque.bera.test(x)其中,x 为样本数据。

library(tseries)attach(mtcars)jarque.bera.test(mpg)JarqueBera Testdata: mpgX-squared = 2.2412, df = 2, p-value = 0.3261detach(mtcars)P 值=0.2412>0.05, 接受原假设,即服从正态分布。

注:还可以使用nromtest 包中的函数jb.norm.test()和ajb.norm.test(),前者参数除了x 之外,多了一个蒙特卡罗模拟值,默认是2000,后者是J-B 检验的修正,主要解决JB 统计量收敛速度慢的缺点。

四、其它正态性检验nortest包中还提供了:1. AD正态性检验函数ad.test(x), 计算统计量A值(越接近0越服从正态分布)和P值。

2. Cramer-von Mises正态性检验函数cvm.test(x)3. Pearson卡方正态性检验函数pearson.test(x)4. Shapiro-Francia正态性检验函数sf.test(x)五、多元正态性检验W检验shapiro.test()可推广到多元正态性检验,使用mvnormtest包中的函数mshapiro.test()或者使用Q-Q图检验,若有一个p×1的多元正态随机向量x,均值为μ,协方差矩阵为Σ,那么x与μ的马氏距离的平方服从自由度为p的卡方分布。

Q-Q图展示卡方分布的分位数,横纵坐标分别是样本量与马氏距离平方值。

如果点全部落在斜率为1、截距项为0的直线上,则表明数据服从多元正态分布。

library(MASS)attach(UScereal)y<-cbind(calories, fat, sugars)head(y)calories fat sugars[1,] 212.1212 3.030303 18.18182[2,] 212.1212 3.030303 15.15151[3,] 100.0000 0.000000 0.00000[4,] 146.6667 2.666667 13.33333[5,] 110.0000 0.000000 14.00000[6,] 173.3333 2.666667 10.66667#mshapiro.test()函数检验多元正态性library(mvnormtest)mshapiro.test(t(y))#注意要对y转置Shapiro-Wilk normality testdata: ZW = 0.6116, p-value = 7.726e-12#Q-Q图检验多元正态性center<-colMeans(y)n<-nrow(y)p<-ncol(y)cov<-cov(y)d<-mahalanobis(y, center, cov)coord<-qqplot(qchisq(ppoints(n),df=p), d, main="QQ Plot Assessing Multivariate Normality", ylab="Mahalanobis D2") abline(a=0, b=1)identify(coord$x, coord$y, labels=s(UScereal))。