3 多元线性回归模型-2

- 格式:ppt

- 大小:1.06 MB

- 文档页数:76

多元线性回归的计算模型多元线性回归模型的数学表示可以表示为:Y=β0+β1X1+β2X2+...+βkXk+ε,其中Y表示因变量,Xi表示第i个自变量,βi表示第i个自变量的回归系数(即自变量对因变量的影响),ε表示误差项。

1.每个自变量与因变量之间是线性关系。

2.自变量之间相互独立,即不存在多重共线性。

3.误差项ε服从正态分布。

4.误差项ε具有同方差性,即方差相等。

5.误差项ε之间相互独立。

为了估计多元线性回归模型的回归系数,常常使用最小二乘法。

最小二乘法的目标是使得由回归方程预测的值与实际值之间的残差平方和最小化。

具体步骤如下:1.收集数据。

需要收集因变量和多个自变量的数据,并确保数据之间的正确对应关系。

2.建立模型。

根据实际问题和理论知识,确定多元线性回归模型的形式。

3.估计回归系数。

利用最小二乘法估计回归系数,使得预测值与实际值之间的残差平方和最小化。

4.假设检验。

对模型的回归系数进行假设检验,判断自变量对因变量是否显著。

5. 模型评价。

使用统计指标如决定系数(R2)、调整决定系数(adjusted R2)、标准误差(standard error)等对模型进行评价。

6.模型应用与预测。

通过多元线性回归模型,可以对新的自变量值进行预测,并进行决策和提出建议。

多元线性回归模型的计算可以利用统计软件进行,例如R、Python中的statsmodels库、scikit-learn库等。

这些软件包提供了多元线性回归模型的函数和方法,可以方便地进行模型的估计和评价。

在计算过程中,需要注意检验模型的假设前提是否满足,如果不满足可能会影响到模型的可靠性和解释性。

总而言之,多元线性回归模型是一种常用的预测模型,可以分析多个自变量对因变量的影响。

通过最小二乘法估计回归系数,并进行假设检验和模型评价,可以得到一个可靠的模型,并进行预测和决策。

多元线性回归模型原理Y=β0+β1*X1+β2*X2+...+βn*Xn+ε其中,Y表示因变量,X1、X2、..、Xn表示自变量,β0、β1、β2、..、βn表示模型的参数,ε表示误差项。

通过对数据进行拟合,即最小化误差平方和,可以估计出模型的参数。

多元线性回归模型的原理是基于最小二乘法,即通过最小化残差平方和来估计参数的值。

残差是指模型预测值与真实值之间的差异,最小二乘法的目标是找到一组参数,使得所有数据点的残差平方和最小。

通过求解最小二乘估计,可以得到模型的参数估计值。

为了评估模型的拟合程度,可以使用各种统计指标,例如R方值、调整R方值、标准误差等。

R方值表示模型解释因变量方差的比例,取值范围在0到1之间,值越接近1表示模型对数据的拟合程度越好。

调整R方值考虑了模型中自变量的个数和样本量之间的关系,可以更准确地评估模型的拟合程度。

标准误差表示模型预测值与真实值之间的标准差,可以用于评估模型的预测精度。

在建立多元线性回归模型之前,需要进行一些前提条件的检查,例如线性关系、多重共线性、异方差性和自变量的独立性。

线性关系假设要求自变量与因变量之间存在线性关系,可以通过散点图、相关系数等方法来检验。

多重共线性指的是自变量之间存在高度相关性,会导致参数估计的不稳定性,可以使用方差膨胀因子等指标来检测。

异方差性指的是残差的方差不恒定,可以通过残差图、方差齐性检验等方法来检验。

自变量的独立性要求自变量之间不存在严重的相关性,可以使用相关系数矩阵等方法来检验。

当满足前提条件之后,可以使用最小二乘法来估计模型的参数。

最小二乘法可以通过不同的方法来求解,例如解析解和数值优化方法。

解析解通过最小化误差平方和的一阶导数为零来求解参数的闭式解。

数值优化方法通过迭代来求解参数的数值估计。

除了最小二乘法,还有其他方法可以用于估计多元线性回归模型的参数,例如岭回归和lasso回归等。

岭回归和lasso回归是一种正则化方法,可以对模型进行约束,可以有效地避免过拟合问题。

§5.1 多元线性回归模型及其假设条件 1.多元线性回归模型 多元线性回归模型:εi pi p iiix b xb x b b y +++++= 2211,n i ,,2,1 =2.多元线性回归模型的方程组形式 3.多元线性回归模型的矩阵形式4.回归模型必须满足如下的假设条件:第一、有正确的期望函数。

即在线性回归模型中没有遗漏任何重要的解释变量,也没有包含任何多余的解释变量。

第二、被解释变量等于期望函数与随机干扰项之和。

第三、随机干扰项独立于期望函数。

即回归模型中的所有解释变量Xj与随机干扰项u 不相关。

第四、解释变量矩阵X 是非随机矩阵,且其秩为列满秩的,即:n k k X rank 〈=,)(。

式中k 是解释变量的个数,n 为观测次数。

第五、随机干扰项服从正态分布。

第六、随机干扰项的期望值为零。

()0=u E 第七、随机干扰项具有方差齐性。

()σσ22=u i(常数)第八、随机干扰项相互独立,即无序列相关。

()()u u u u jiji,cov ,=σ=0§5.2 多元回归模型参数的估计建立回归模型的基本任务是:求出参数bb b p,,,,1σ的估计值,并进行统计检验。

残差:yy e iiiˆ-=;残差平方和:Q=()∑-∑==y y e i i ni iˆ212矩阵求解:X=⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎣⎡x xxx x x x x x pn nnp p212221212111111,⎥⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎢⎣⎡=b b b b p B ˆˆˆˆ210ˆ ,⎥⎥⎥⎥⎥⎥⎥⎦⎤⎢⎢⎢⎢⎢⎢⎢⎣⎡=-y y y y n n Y 121 ,()YB X X X ττ1ˆ-=1ˆ2--=p n Qσ要通过四个检验:经济意义检验、统计检验、计量经济学检验、模型预测检验。

§5.4 多元线性回归模型的检验一、R2检验1.R2检验定义R2检验又称复相关系数检验法。

是通过复相关系数检验一组自变量xx x m,,,21与因变量y 之间的线性相关程度的方法。

二、多元线性回归模型在多要素的地理环境系统中,多个(多于两个)要素之间也存在着相互影响、相互关联的情况。

因此,多元地理回归模型更带有普遍性的意义。

(一)多元线性回归模型的建立假设某一因变量y 受k 个自变量k x x x ,...,,21的影响,其n 组观测值为(ka a a a x x x y ,...,,,21),n a ,...,2,1=。

那么,多元线性回归模型的结构形式为:a ka k a a a x x x y εββββ+++++=...22110(3。

2。

11)式中:k βββ,...,1,0为待定参数; a ε为随机变量。

如果k b b b ,...,,10分别为k ββββ...,,,210的拟合值,则回归方程为ŷ=k k x b x b x b b ++++...22110(3。

2.12)式中:0b 为常数;k b b b ,...,,21称为偏回归系数。

偏回归系数i b (k i ,...,2,1=)的意义是,当其他自变量j x (i j ≠)都固定时,自变量i x 每变化一个单位而使因变量y 平均改变的数值。

根据最小二乘法原理,i β(k i ,...,2,1,0=)的估计值i b (k i ,...,2,1,0=)应该使()[]min (2)12211012→++++-=⎪⎭⎫⎝⎛-=∑∑==∧n a ka k a a a na a a xb x b x b b y y y Q (3。

2.13)有求极值的必要条件得⎪⎪⎩⎪⎪⎨⎧==⎪⎭⎫ ⎝⎛--=∂∂=⎪⎭⎫⎝⎛--=∂∂∑∑=∧=∧n a ja a a jn a a a k j x y y b Q y y b Q 110),...,2,1(0202(3.2.14) 将方程组(3。

2.14)式展开整理后得: ⎪⎪⎪⎪⎪⎩⎪⎪⎪⎪⎪⎨⎧=++++=++++=++++=++++∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑∑===================na a ka k n a ka n a ka a n a ka a n a ka n a aa k n a ka a n a a n a a a na a na aa k n a ka a n a a a n a a n a a na ak n a ka n a a n a a y x b x b x x b x x b x y x b x x b x b x x b x yx b x x b x x b x b x y b x b x b x nb 11221211101121221221121012111121211121011112121110)(...)()()(...)(...)()()()(...)()()()(...)()( (3.2。

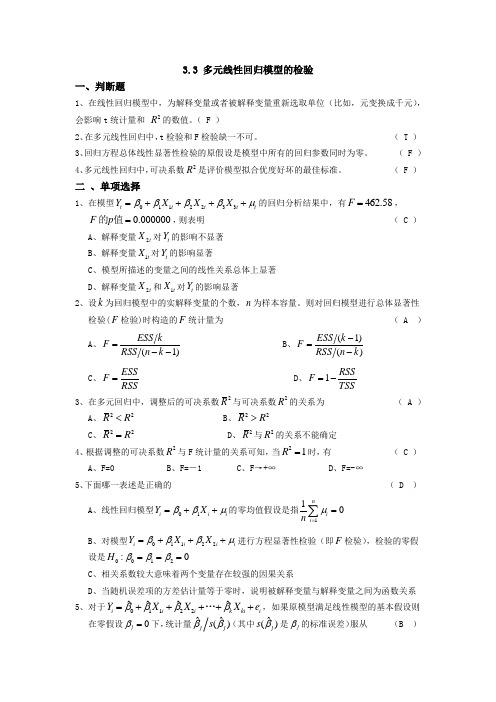

3.3 多元线性回归模型的检验一、判断题1、在线性回归模型中,为解释变量或者被解释变量重新选取单位(比如,元变换成千元),会影响t 统计量和 2R 的数值。

( F )2、在多元线性回归中,t 检验和F 检验缺一不可。

( T )3、回归方程总体线性显著性检验的原假设是模型中所有的回归参数同时为零。

( F )4、多元线性回归中,可决系数2R 是评价模型拟合优度好坏的最佳标准。

( F )二 、单项选择1、在模型0112233t t t t t Y X X X ββββμ=++++的回归分析结果中,有462.58F =,0.000000F p =的值,则表明 ( C )A 、解释变量2t X 对t Y 的影响不显著B 、解释变量1t X 对t Y 的影响显著C 、模型所描述的变量之间的线性关系总体上显著D 、解释变量2t X 和1t X 对t Y 的影响显著2、设k 为回归模型中的实解释变量的个数,n 为样本容量。

则对回归模型进行总体显著性 检验(F 检验)时构造的F 统计量为 ( A )A 、1)ESS k F RSS n k =--B 、(1)()ESS k F RSS n k -=- C 、ESS F RSS = D 、1RSS F TSS=- 3、在多元回归中,调整后的可决系数2R 与可决系数2R 的关系为 ( A ) A 、22R R < B 、22R R >C 、22R R =D 、2R 与2R 的关系不能确定4、根据调整的可决系数2R 与F 统计量的关系可知,当21R =时,有 ( C )A 、F=0B 、F=-1C 、F →+∞D 、F=-∞5、下面哪一表述是正确的 ( D ) A 、线性回归模型01i i i Y X ββμ=++的零均值假设是指110ni i n μ==∑ B 、对模型01122i i i i Y X X βββμ=+++进行方程显著性检验(即F 检验),检验的零假 设是0012:0H βββ===C 、相关系数较大意味着两个变量存在较强的因果关系D 、当随机误差项的方差估计量等于零时,说明被解释变量与解释变量之间为函数关系5、对于01122ˆˆˆˆi i i k ki iY X X X e ββββ=+++++…,如果原模型满足线性模型的基本假设则 在零假设0j β=下,统计量ˆˆ()j j s ββ(其中ˆ()js β是j β的标准误差)服从 (B )A 、()t n k -B 、(1)t n k --C 、(1,)F k n k --D 、(,1)F k n k --6、在由的一组样本估计的、包含3个解释变量的线性回归模型中,计算得多重可决系数为0.8500,则调整后的多重可决系数为( D )A 、8603B 、 0.8389C 、0.8655D 、0.83277、可决系数R 2=0.8,说明回归直线能解释被解释变量总变差的:( A )A 、 80%B 、 64%C 、 20%D 、 89%8、线性回归模型01122......t t t k kt t y b b x b x b x u =+++++ 中,检验0:0(0,1,2,...)t H b i k ==时,所用的统计量服从( C )A.t(n-k+1)B.t(n-k-2)C.t(n-k-1)D.t(n-k+2)三、多项选择题1、对模型满足所有假定条件的模型01122i i i i Y X X βββμ=+++进行总体显著性检验,如果检验结果总体线性关系显著,则很可能出现 ( BCD )A 、120ββ==B 、120,0ββ≠=C 、120,0ββ≠≠D 、120,0ββ=≠E 、120,0ββ==2、设k 为回归模型中的参数个数(包含截距项)则总体线性回归模型进行显著性检验时所 用的F 统计量可以表示为 ( BC )A 、()()()∑∑---1k e k n Y Y 2i 2i i //ˆ B 、()()()∑∑---k n e 1k Y Y 2i2ii //ˆ C 、()()()k n R 11k R 22---// D 、()()()1k R k n R 122---// 30n =E 、()()()1k R 1k n R 22---// 3、在多元回归分析中,调整的可决系数2R 与可决系数2R 之间 ( AD )A 、22R R <B 、22R R ≥C 、2R 只可能大于零D 、2R 可能为负值E 、2R 不可能为负值四、简答题1.在多元线性回归分析中,为什么用修正的可决系数衡量估计模型对样本观测值的拟合优度?答:因为人们发现随着模型中解释变量的增多,多重可决系数2R 的值往往会变大,从而增加了模型的解释功能。

多元线性回归模型国晓雯 10628003一. 模型设定根据房地产销售数据,考察住房总居住面积与估价对住房售价的影响程度。

1.被解释变量名称:Y 含义:住房售价 单位:1000美元 2.解释变量名称:1Z 含义:住房总居住面积 单位:100平方英尺 名称:2Z含义:住房估价 单位:1000美元3.数学形式εβββ+++=23121Z Z Y二. 样本 资料来源于[美]Rechard A.Johnson and Dean W.Wichern 《实用多元统计分析》表7.1 房地产数据三. 回归结果1 (1)模型由 F Value 可知,模型整体是显著的(2)截距由Intercept 的t Value ,显著性水平下,截距项是显著的 (3)2β由Z1的t Value ,显著性水平下, 1Z 的系数是显著的 (3)3β由Z2的t Value ,显著性水平下, 2Z 的系数是不显著的,接受原假设 (4) 由调整的8149.02=R ,说明模型的变差解释了总变差的8149.0,模型拟合效果比较理想2.样本回归超平面2104518.06344.287024.31Z Z Y t ++=四.经济分析回归的结果显示出住房房价是居住面积和房屋估价的线性函数。

由上面的模型,回归方程和显著性指标可以看出住房售价与住房面积显著相关,住房估价对住房售价的影响并不显著。

住房售价会随着住房面积的提高而提高,具体说来,住房面积每增加100平方英尺,住房售价会增加2634.4美元。

我们可以由此根据住房面积来预测售价。

五.附录1.1Z 对Y 的散点图2Z 对Y 的散点图3.原始数据4.程序代码(SAS)data estate;infile'd:\duoyuan\multidisk\multidisk\T7-1.dat'; input z1 z2 y;run;proc reg data=estate;model y=z1 z2/selection=none r dw influence; output out=regresult p=pre r=res ;run;proc plot data=regresult;plot res*pre;run;quit;。

第三章多元线性回归模型的参数估计多元线性回归模型的参数估计是指通过给定的数据样本,使用其中一种方法来计算出回归模型的参数值。

在多元线性回归模型中,我们有多个自变量与一个因变量之间的关系,因此需要估计出每个自变量的系数。

参数估计是回归模型的核心内容之一,它能够通过对样本数据的分析和处理,得到模型中的参数值,从而建立起模型与实际数据之间的映射关系。

常用的多元线性回归模型的参数估计方法有最小二乘法和最大似然估计法。

最小二乘法是一种最常用的参数估计方法。

它的基本思想是通过最小化因变量的观测值与模型预测值之间的平方误差,来确定模型参数的最佳估计值。

最小二乘法的优点是数学上简单且易于计算,但对于异常值的敏感性较强。

最大似然估计法是另一种常用的参数估计方法。

它的基本思想是找到最能使观测数据发生的概率最大的模型参数,从而得到最优的参数估计值。

最大似然估计法具有较好的统计性质,但它的计算复杂度较高,需要对似然函数进行极大化求解。

在实际应用中,我们需要根据实际情况选择合适的参数估计方法。

通常情况下,最小二乘法是首选的方法,因为它具有简单和直观的优点,适用于大多数情况。

但当样本数据存在异常值或者数据分布不符合正态分布假设时,最大似然估计法可能是更好的选择。

无论是最小二乘法还是最大似然估计法,其核心问题都是通过最优化方法找到使得模型和观测数据之间的误差最小的参数值。

这一过程需要使用数学工具和计算方法进行求解,可以使用迭代算法,如牛顿法或梯度下降法,来逐步逼近最优解。

参数估计的结果可以告诉我们每个自变量对因变量的贡献程度。

因此,一个良好的参数估计能够帮助我们更好地理解数据,预测因变量,以及识别自变量之间是否存在相互影响。

总而言之,多元线性回归模型的参数估计是通过最小化模型与观测数据之间的误差,找到最佳的模型参数值的过程。

合理选择参数估计方法,并进行有效的数学计算,能够为我们提供有关数据和模型之间的重要信息,并为进一步的分析和应用提供基础。

多元线性回归的计算方法 摘要在实际经济问题中,一个变量往往受到多个变量的影响。

例如,家庭消费支出,除了受家庭可支配收入的影响外,还受诸如家庭所有的财富、物价水平、金融机构存款利息等多种因素的影响,表现在线性回归模型中的解释变量有多个。

这样的模型被称为多元线性回归模型。

多元线性回归的基本原理和基本计算过程与一元线性回归相同,但由于自变量个数多,计算相当麻烦,一般在实际中应用时都要借助统计软件。

这里只介绍多元线性回归的一些基本问题。

但由于各个自变量的单位可能不一样,比如说一个消费水平的关系式中,工资水平、受教育程度、职业、地区、家庭负担等等因素都会影响到消费水平,而这些影响因素(自变量)的单位显然是不同的,因此自变量前系数的大小并不能说明该因素的重要程度,更简单地来说,同样工资收入,如果用元为单位就比用百元为单位所得的回归系数要小,但是工资水平对消费的影响程度并没有变,所以得想办法将各个自变量化到统一的单位上来。

前面学到的标准分就有这个功能,具体到这里来说,就是将所有变量包括因变量都先转化为标准分,再进行线性回归,此时得到的回归系数就能反映对应自变量的重要程度。

这时的回归方程称为标准回归方程,回归系数称为标准回归系数,表示如下:Zy=β1Zx1+β2Zx2+…+βkZxk注意,由于都化成了标准分,所以就不再有常数项a 了,因为各自变量都取平均水平时,因变量也应该取平均水平,而平均水平正好对应标准分0,当等式两端的变量都取0时,常数项也就为0了。

多元线性回归模型的建立多元线性回归模型的一般形式为Yi=β0+β1X1i+β2X2i+…+i i i i h x υβ+ =1,2,…,n其中 k 为解释变量的数目,j β=(j=1,2,…,k)称为回归系数(regression coefficient)。

上式也被称为总体回归函数的随机表达式。

它的非随机表达式为E(Y∣X1i,X2i,…Xki,)=β0+β1X1i+β2X2i+…+βkXkiβj 也被称为偏回归系数(partial regression coefficient) 多元线性回归的计算模型一元线性回归是一个主要影响因素作为自变量来解释因变量的变化,在现实问题研究中,因变量的变化往往受几个重要因素的影响,此时就需要用两个或两个以上的影响因素作为自变量来解释因变量的变化,这就是多元回归亦称多重回归。

案例2多元线性回归模型的计算过程及多元线性回归是一种统计学中常用的模型,用于探究自变量与因变量之间的关系。

它可以同时考虑多个自变量对因变量的影响,并提供一个拟合的线性方程来描述这种关系。

2.设定数学模型:在多元线性回归中,需要选择一个数学模型来描述自变量和因变量之间的关系。

一般来说,数学模型可以表示为:Y=β0+β1X1+β2X2+...+βnXn+ε,其中Y是因变量,Xi是第i个自变量,βi是对应的回归系数,ε是误差。

3.估计回归系数:为了得到回归系数的估计值,需要使用最小二乘法进行估计。

最小二乘法的目标是最小化实际观测值和回归模型预测值之间的残差平方和。

通过求解最小二乘法的正规方程组,可以得到回归系数的估计值。

4.检验模型的显著性:在得到回归系数的估计值后,需要进行模型的显著性检验。

常用的方法是计算F统计量或t统计量,检验回归模型的整体显著性或回归系数的个别显著性。

5. 模型拟合度检验:为了评估模型的拟合度,需要计算拟合优度指标,如决定系数(R-squared)和调整决定系数(adjusted R-squared)。

决定系数表示自变量解释因变量变异的比例,范围从0到1,值越接近1表示模型拟合得越好。

6.模型诊断:在进行多元线性回归分析后,需要对模型进行诊断,以验证模型是否符合统计假设。

常见的诊断方法包括检验残差的正态性、检验残差的独立性和检验残差的等方差性。

7.预测和解释:通过多元线性回归模型,可以进行新样本的预测,并解释自变量对因变量的影响。

使用回归系数和新样本的自变量值,可以计算出预测的因变量值。

总结:多元线性回归模型的计算过程是一个复杂的统计分析过程,包括数据收集、数学模型的设定、回归系数的估计、模型显著性检验、拟合度检验、模型诊断以及预测和解释等步骤。

通过这些计算过程,可以得到一个拟合的线性方程,用于描述多个自变量对因变量的影响。

最终,这个模型可以用于预测和解释新样本的观测结果。

线性回归模型的经典假定及检验、修正一、线性回归模型的基本假定1、一元线性回归模型一元线性回归模型是最简单的计量经济学模型,在模型中只有一个解释变量,其一般形式是Y =β0+β1X 1+μ其中,Y 为被解释变量,X 为解释变量,β0与β1为待估参数,μ为随机干扰项。

回归分析的主要目的是要通过样本回归函数(模型)尽可能准确地估计总体回归函数(模型)。

为保证函数估计量具有良好的性质,通常对模型提出若干基本假设。

假设1:回归模型是正确设定的。

模型的正确设定主要包括两个方面的内容:(1)模型选择了正确的变量,即未遗漏重要变量,也不含无关变量;(2)模型选择了正确的函数形式,即当被解释变量与解释变量间呈现某种函数形式时,我们所设定的总体回归方程恰为该函数形式。

假设2:解释变量X 是确定性变量,而不是随机变量,在重复抽样中取固定值。

这里假定解释变量为非随机的,可以简化对参数估计性质的讨论。

假设3:解释变量X 在所抽取的样本中具有变异性,而且随着样本容量的无限增加,解释变量X 的样本方差趋于一个非零的有限常数,即∑(X i −X ̅)2n i=1n→Q,n →∞ 在以因果关系为基础的回归分析中,往往就是通过解释变量X 的变化来解释被解释变量Y 的变化的,因此,解释变量X 要有足够的变异性。

对其样本方差的极限为非零有限常数的假设,旨在排除时间序列数据出现持续上升或下降的变量作为解释变量,因为这类数据不仅使大样本统计推断变得无效,而且往往产生伪回归问题。

假设4:随机误差项μ具有给定X 条件下的零均值、同方差以及无序列相关性,即E(μi|X i)=0Var(μi|X i)=σ2Cov(μi,μj|X i,X j)=0, i≠j随机误差项μ的条件零均值假设意味着μ的期望不依赖于X的变化而变化,且总为常数零。

该假设表明μ与X不存在任何形式的相关性,因此该假设成立时也往往称X为外生性解释变量随机误差项μ的条件同方差假设意味着μ的方差不依赖于X的变化而变化,且总为常数σ2。

3.2 多元线性回归模型的估计一、判断题1.满足基本假设条件下,样本容量略大于解释变量个数时,可以得到各参数的唯一确定的 估计值,但参数估计结果的可靠性得不到保证 ( T )二 、单项选择题1、线性回归模型的参数估计量ˆβ是随机向量Y 的函数,即1ˆ()X X X Y β-''=。

ˆβ是 (A )A 、随机向量B 、非随机向量C 、确定性向量D 、常量2.已知含有截距项的四元线性回归模型估计的残差平方和为∑=800e 2i ,样本容量为25,则其随机误差项i u 的方差的普通最小二乘估计为 (A )。

A 、40B 、32C 、38.095D 、36.364 三 、多项选择题1、对于二元样本回归模型12233ˆˆˆˆi i i iY X X e βββ=+++,下列各式成立的有(ABC ) A 、0e i =∑ B 、0X e i 2i =∑C 、0X e i 3i =∑D 、0Y e i i =∑E 、0X X i3i 2=∑四、计算题1、某地区通过一个样本容量为722的调查数据得到劳动力受教育年数的一个回归方程为10.360.0940.1310.210i i i i edu sibs medu fedu =-++ R 2=0.214式中,edu 为劳动力受教育年数,sibs 为劳动力家庭中兄弟姐妹的个数,medu 与fedu 分别为母亲与父亲受到教育的年数。

问(1)sibs 是否具有预期的影响?为什么?若medu 与fedu 保持不变,为了使预测的受教育水平减少一年,需要sibs 增加多少?(2)请对medu 的系数给予适当的解释。

(3)如果两个劳动力都没有兄弟姐妹,但其中一个的父母受教育的年数均为12年,另一个的父母受教育的年数均为16年,则两人受教育的年数预期相差多少年?解:(1)预期sibs 对劳动者受教育的年数有影响。

因此在收入及支出预算约束一定的条件下,子女越多的家庭,每个孩子接受教育的时间会越短。