人工神经网络-第一章

- 格式:pdf

- 大小:365.48 KB

- 文档页数:11

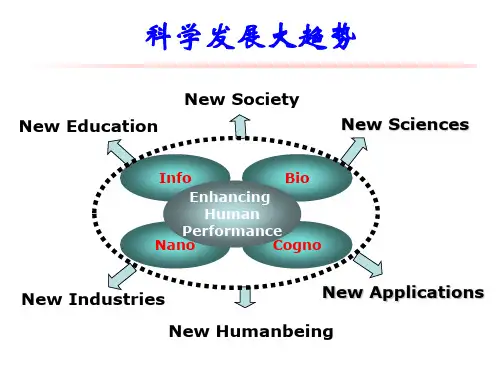

人工神经网络学习总结笔记主要侧重点:1.概念清晰2.进行必要的查询时能从书本上找到答案第一章:绪论1.1人工神经网络的概述“认识脑”和“仿脑”:人工智能科学家在了解人脑的工作机理和思维的本质的基础上,探索具有人类智慧的人工智能系统,以模拟延伸和扩展脑功能。

我认为这是人工神经网络研究的前身。

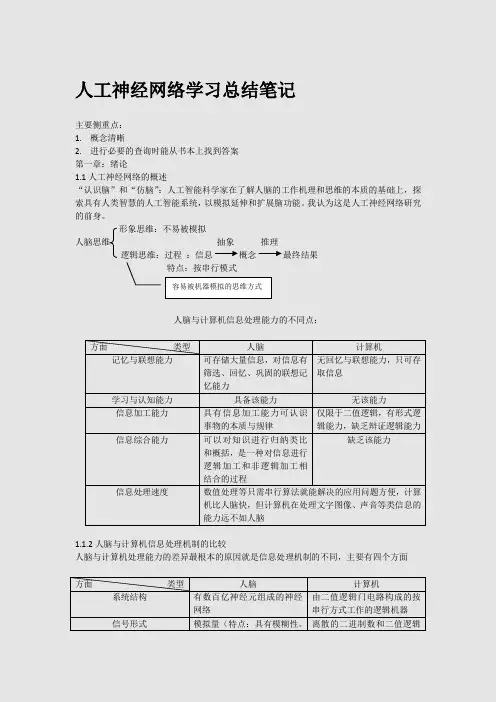

形象思维:不易被模拟人脑思维抽象推理逻辑思维:过程:信息概念最终结果特点:按串行模式人脑与计算机信息处理能力的不同点:方面类型人脑计算机记忆与联想能力可存储大量信息,对信息有筛选、回忆、巩固的联想记忆能力无回忆与联想能力,只可存取信息学习与认知能力具备该能力无该能力信息加工能力具有信息加工能力可认识事物的本质与规律仅限于二值逻辑,有形式逻辑能力,缺乏辩证逻辑能力信息综合能力可以对知识进行归纳类比和概括,是一种对信息进行逻辑加工和非逻辑加工相结合的过程缺乏该能力信息处理速度数值处理等只需串行算法就能解决的应用问题方便,计算机比人脑快,但计算机在处理文字图像、声音等类信息的能力远不如人脑1.1.2人脑与计算机信息处理机制的比较人脑与计算机处理能力的差异最根本的原因就是信息处理机制的不同,主要有四个方面方面类型人脑计算机系统结构有数百亿神经元组成的神经网络由二值逻辑门电路构成的按串行方式工作的逻辑机器信号形式模拟量(特点:具有模糊性。

离散的二进制数和二值逻辑容易被机器模拟的思维方式难以被机器模拟)和脉冲两种形式形式信息储存人脑中的信息分布存储于整个系统,所存储的信息是联想式的有限集中的串行处理机制信息处理机制高度并行的非线性信息处理系统(体现在结构上、信息存储上、信息处理的运行过程中)1.1.3人工神经网络的概念:在对人脑神经网络的基本认识的基础上,用数理方法从信息处理的角度对人脑神经网络进行抽象,并建立某种简化模型,称之为人工神经网络,是对人脑的简化、抽象以及模拟,是一种旨在模仿人脑结构及其功能的信息处理系统。

其他定义:由非常多个非常简单的处理单元彼此按某种方式相互连接而形成的计算系统,外部输入信息之后,系统产生动态响应从而处理信息。

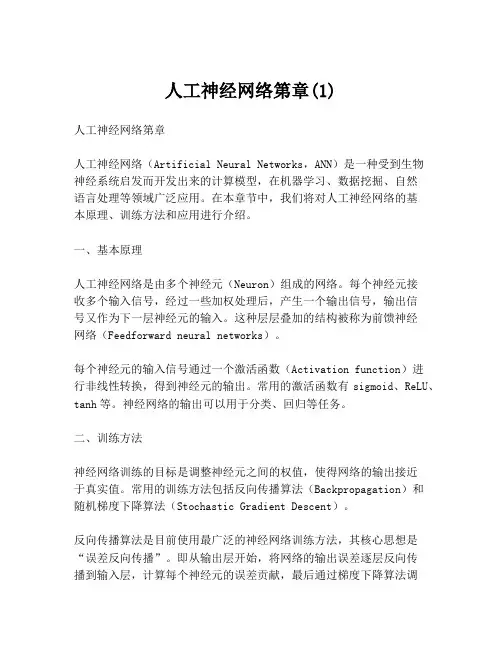

人工神经网络第章(1)人工神经网络第章人工神经网络(Artificial Neural Networks,ANN)是一种受到生物神经系统启发而开发出来的计算模型,在机器学习、数据挖掘、自然语言处理等领域广泛应用。

在本章节中,我们将对人工神经网络的基本原理、训练方法和应用进行介绍。

一、基本原理人工神经网络是由多个神经元(Neuron)组成的网络。

每个神经元接收多个输入信号,经过一些加权处理后,产生一个输出信号,输出信号又作为下一层神经元的输入。

这种层层叠加的结构被称为前馈神经网络(Feedforward neural networks)。

每个神经元的输入信号通过一个激活函数(Activation function)进行非线性转换,得到神经元的输出。

常用的激活函数有sigmoid、ReLU、tanh等。

神经网络的输出可以用于分类、回归等任务。

二、训练方法神经网络训练的目标是调整神经元之间的权值,使得网络的输出接近于真实值。

常用的训练方法包括反向传播算法(Backpropagation)和随机梯度下降算法(Stochastic Gradient Descent)。

反向传播算法是目前使用最广泛的神经网络训练方法,其核心思想是“误差反向传播”。

即从输出层开始,将网络的输出误差逐层反向传播到输入层,计算每个神经元的误差贡献,最后通过梯度下降算法调整神经元权值。

随机梯度下降算法是一种在线学习算法,每次选择一个样本进行训练,通过计算损失函数的梯度方向,调整网络权值,直到收敛。

随机梯度下降算法能够处理大规模数据训练,但更容易陷入局部极小值。

三、应用领域人工神经网络在图像识别、语音识别、自然语言处理、机器翻译等领域取得了广泛应用。

在图像识别领域,卷积神经网络(CNN)被广泛应用,已经实现了在ImageNet等数据集上的超越人类表现的成果。

在自然语言处理领域,循环神经网络(RNN)和长短时记忆网络(LSTM)能够处理变长序列数据,已经成功应用于机器翻译、情感分析等任务。

第一章前向神经网络一、感知器1、感知器网络结构设网络输入模式向量为:对应的输出为:连接权向量为:2、感知器的学习➢初始化连接权向量及输出单元的阈值赋予(-1,+1)区间内的随机值,一般为较小的随机非零值。

➢连接权的修正每个输入模式作如下计算:(a)计算网络输出:(b)计算输出层单元希望输出与实际输出y之间的误差:(c)修正各单元与输出层之间的连接权与阈值:➢对m个输入模式重复步骤,直到误差k d(k=1,2,…,m)趋于零或小于预先给定的误差限ε。

3、感知器的图形解释➢整个学习和记忆过程,就是根据实际输出与希望输出之间的误差调整参数w 和θ,即调整截割平面的空间位置使之不断移动,直到它能将两类模式恰当划分的过程。

➢学习过程可看作是由式决定的n维超平面不断向正确划分输入模式的位置移动的过程。

4、感知器的局限性➢两层感知器只能解决线性可分问题➢增强分类能力的唯一出路是采用多层网络,即在输入及输出层之间加上隐层构成多层前馈网络。

➢Kolmogorov理论经过严格的数学证明:双隐层感知器足以解决任何复杂的分类问题。

➢简单的感知器学习过程已不能用于多层感知器,必须改进学习过程。

二、BP 神经网络 1、反向传播神经网络1) 误差逆传播神经网络是一种具有三层或三层以上的阶层型神经网络: ➢ 上、下层之间各神经元实现全连接,即下层的每一个单元与上层的每个单元都实现权连接;➢ 而每层各神经元之间无连接; ➢ 网络按有监督的方式进行学习。

2)➢ 当一对学习模式提供给网络后,神经元的激活值,从输入层经各中间层向输出层传播,在输出层的各神经元获得网络的输入响应。

➢ 在这之后,按减小希望输出与实际输出误差的方向,从输出层经各中间层逐层修正各连接权,最后回到输入层,故得名“误差逆传播算法”。

➢ 随着这种误差逆传播修正的不断进行,网络对输入模式响应的正确率也不断上升。

2、梯度下降法1)梯度法是一种对某个准则函数的迭代寻优算法。