第3章_离散信源()题与答案

- 格式:docx

- 大小:64.10 KB

- 文档页数:10

信息论与编码理论习题答案LG GROUP system office room 【LGA16H-LGYY-LGUA8Q8-LGA162】第二章 信息量和熵八元编码系统,码长为3,第一个符号用于同步,每秒1000个码字,求它的信息速率。

解:同步信息均相同,不含信息,因此 每个码字的信息量为 2⨯8log =2⨯3=6 bit因此,信息速率为 6⨯1000=6000 bit/s掷一对无偏骰子,告诉你得到的总的点数为:(a) 7; (b) 12。

问各得到多少信息量。

解:(1) 可能的组合为 {1,6},{2,5},{3,4},{4,3},{5,2},{6,1})(a p =366=61得到的信息量 =)(1loga p =6log = bit (2) 可能的唯一,为 {6,6})(b p =361得到的信息量=)(1logb p =36log = bit 经过充分洗牌后的一副扑克(52张),问:(a) 任何一种特定的排列所给出的信息量是多少?(b) 若从中抽取13张牌,所给出的点数都不相同时得到多少信息量?解:(a) )(a p =!521信息量=)(1loga p =!52log = bit (b) ⎩⎨⎧⋯⋯⋯⋯花色任选种点数任意排列13413!13)(b p =1352134!13A ⨯=1352134C 信息量=1313524log log -C = bit 随机掷3颗骰子,X 表示第一颗骰子的结果,Y 表示第一和第二颗骰子的点数之和,Z 表示3颗骰子的点数之和,试求)|(Y Z H 、)|(Y X H 、),|(Y X Z H 、)|,(Y Z X H 、)|(X Z H 。

解:令第一第二第三颗骰子的结果分别为321,,x x x ,1x ,2x ,3x 相互独立,则1x X =,21x x Y +=,321x x x Z ++=)|(Y Z H =)(3x H =log 6= bit )|(X Z H =)(32x x H +=)(Y H=2⨯(361log 36+362log 18+363log 12+364log 9+365log 536)+366log 6= bit )|(Y X H =)(X H -);(Y X I =)(X H -[)(Y H -)|(X Y H ]而)|(X Y H =)(X H ,所以)|(Y X H = 2)(X H -)(Y H = bit或)|(Y X H =)(XY H -)(Y H =)(X H +)|(X Y H -)(Y H 而)|(X Y H =)(X H ,所以)|(Y X H =2)(X H -)(Y H = bit),|(Y X Z H =)|(Y Z H =)(X H = bit )|,(Y Z X H =)|(Y X H +)|(XY Z H =+= bit设一个系统传送10个数字,0,1,…,9。

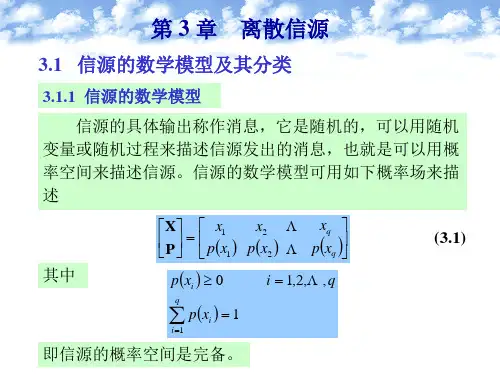

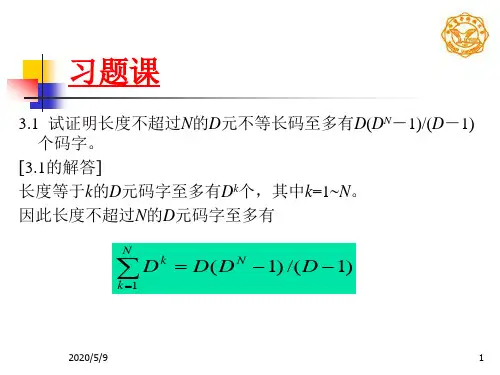

第三章 离散信源无失真编码3.2离散无记忆信源,熵为H[x],对信源的L 长序列进行等长编码,码字是长为n 的D 进制符号串,问:(1)满足什么条件,可实现无失真编码。

(2)L 增大,编码效率 也会增大吗? 解:(1)当log ()n D LH X ≥时,可实现无失真编码;(2)等长编码时,从总的趋势来说,增加L 可提高编码效率,且当L →∞时,1η→。

但不一定L 的每次增加都一定会使编码效率提高。

3.3变长编码定理指明,对信源进行变长编码,总可以找到一种惟一可译码,使码长n 满足D X H log )(≤n <D X H log )(+L 1,试问在n >D X H log )(+L1时,能否也找到惟一可译码? 解:在n >D X H log )(+L1时,不能找到惟一可译码。

证明:假设在n >D X H log )(+L1时,能否也找到惟一可译码,则由变长编码定理当n 满足D X H log )(≤n <D X H log )(+L 1,总可以找到一种惟一可译码知:在n ≥DX H log )( ① 时,总可以找到一种惟一可译码。

由①式有:Ln ≥L X H )(logD ② 对于离散无记忆信源,有H(x)=L X H )( 代入式②得:n L ≥ Dx H log )( 即在nL≥Dx H log )(时,总可以找到一种惟一可译码;而由定理给定熵H (X )及有D 个元素的码符号集,构成惟一可译码,其平均码长满足D X H log )(≤n L <DX H log )(+1 两者矛盾,故假设不存在。

所以,在n >D X H log )(+L1时,不能找到惟一可译码。

3.7对一信源提供6种不同的编码方案:码1~码6,如表3-10所示表3-10 同一信源的6种不同编码 信源消息 消息概率 码1 码2 码3 码4 码5 码6 u1 1/4 0 001 1 1 00 000 u2 1/4 10 010 10 01 01 001 U3 1/8 00 011 100 001 100 011 u4 1/8 11 100 1000 0001 101 100 u5 1/8 01 101 10000 00001 110 101 u6 1/16 001 110 100000 000001 1110 1110 u71/161111111000000000000111111111(1) 这些码中哪些是惟一可译码? (2) 这些码中哪些是即时码?(3) 对所有唯一可译码求出其平均码长。

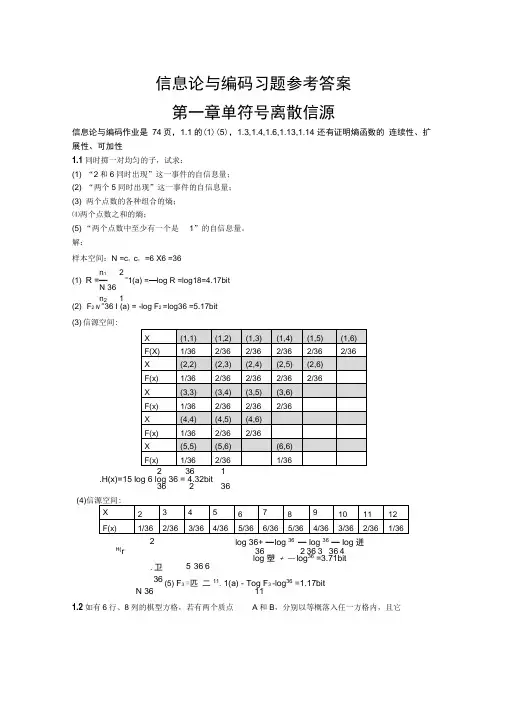

信息论与编码习题参考答案 第一章单符号离散信源信息论与编码作业是 74页,1.1的(1)(5),1.3,1.4,1.6,1.13,1.14 还有证明熵函数的 连续性、扩展性、可加性1.1同时掷一对均匀的子,试求:(1) “2和6同时出现”这一事件的自信息量; (2) “两个5同时出现”这一事件的自信息量; (3) 两个点数的各种组合的熵; ⑷两个点数之和的熵;(5) “两个点数中至少有一个是 1”的自信息量。

解:样本空间:N =c ;c ; =6 X6 =36n 12(1) R =—”1(a) =—log R =log18=4.17bitN 36 n 2 1(2) F 2 N =36 I (a) = -log F 2 =log36 =5.17bit (3) 信源空间:2 36 1.H(x)=15 log 6 log 36 = 4.32bit36 2 36(4)log 36+ — l og 36 — log 36 — log 迸36 2 36 3 36 4 log 塑 + — log 36 =3.71bit5 36 6 (5) F 3 =匹 二11. 1(a) - Tog F 3 -log 36 =1.17bit N 36 111.2如有6行、8列的棋型方格,若有两个质点A 和B ,分别以等概落入任一方格内,且它2H(r.卫36们的坐标分别为(Xa,Ya) , (Xb,Yb),但A,B不能同时落入同一方格内。

(1)若仅有质点A,求A落入任一方格的平均信息量;(2)若已知A已落入,求B落入的平均信息量;(3)若A,B是可辨认的,求A,B落入的平均信息量。

解:1(1) 幕A落入任一格的概率:P(a i) I (aj =-log P(aJ = log 484848.H(a) - P(a j)log P(aJ = log 48 =5.58biti 41(2) ;在已知A落入任一格的情况下,B落入任一格的概率是:P(bJ = —47.I(b) - -logP(b i) =log4748.H(b) = -' P(b i)log P(b i) =log47 =5.55biti -11 1(3) AB同时落入某两格的概率是P(ABJ二一一48 47.I(ABJ =-log P(AB i)48 47H(AB」-八P(ABJIog P(ABJ =log(48 47)=11.14biti 二1.3从大量统计资料知道,男性中红绿色盲的发病率为7%,女性发病率为0.5%.如果你问一位男士:“你是否是红绿色盲?”他的回答可能是:“是”,也可能“不是”。

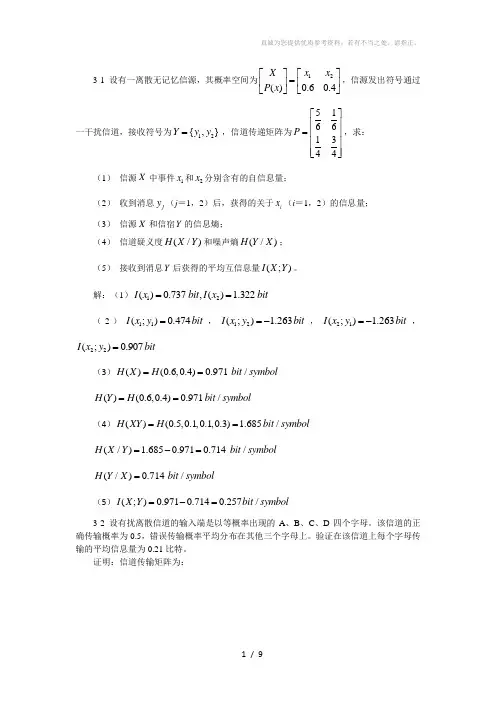

3-1 设有一离散无记忆信源,其概率空间为12()0.60.4X x x P x ⎡⎤⎡⎤=⎢⎥⎢⎥⎣⎦⎣⎦,信源发出符号通过一干扰信道,接收符号为12{,}Y y y =,信道传递矩阵为51661344P ⎡⎤⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦,求: (1) 信源X 中事件1x 和2x 分别含有的自信息量;(2) 收到消息j y (j =1,2)后,获得的关于i x (i =1,2)的信息量; (3) 信源X 和信宿Y 的信息熵;(4) 信道疑义度(/)H X Y 和噪声熵(/)H Y X ; (5) 接收到消息Y 后获得的平均互信息量(;)I X Y 。

解:(1)12()0.737,() 1.322I x bit I x bit ==(2)11(;)0.474I x y bit =,12(;) 1.263I x y bit =-,21(;) 1.263I x y bit =-,22(;)0.907I x y bit =(3)()(0.6,0.4)0.971/H X H bit symbol ==()(0.6,0.4)0.971/H Y H bit symbol ==(4)()(0.5,0.1,0.1,0.3) 1.685/H XY H bit symbol ==(/) 1.6850.9710.714/H X Y bit symbol =-= (/)0.714/H Y X bit symbol =(5)(;)0.9710.7140.257/I X Y bit symbol =-=3-2 设有扰离散信道的输入端是以等概率出现的A 、B 、C 、D 四个字母。

该信道的正确传输概率为0.5,错误传输概率平均分布在其他三个字母上。

验证在该信道上每个字母传输的平均信息量为0.21比特。

证明:信道传输矩阵为:11112666111162661111662611116662P ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦,信源信宿概率分布为:1111()(){,,,}4444P X P Y ==, H(Y/X)=1.79(bit/符号),I(X;Y)=H(Y)- H(Y/X)=2-1.79=0.21(bit/符号)3-3 已知信源X 包含两种消息:12,x x ,且12()() 1/2P x P x ==,信道是有扰的,信宿收到的消息集合Y 包含12,y y 。

3.1 设有一离散无记忆信源,其概率空间为⎭⎬⎫⎩⎨⎧=====⎥⎦⎤⎢⎣⎡8/14/1324/18/310)(4321x x x x X P X 该信源发出的信息序列为(202 120 130 213 001 203 210 110 321 010 021 032 011 223 210)。

求:(1) 此消息的自信息量是多少?(2) 此消息中平均每符号携带的信息量是多少?解: (1)此消息总共有14个0、13个1、12个2、6个3,因此消息发出的概率是:62514814183⎪⎭⎫ ⎝⎛⨯⎪⎭⎫ ⎝⎛⨯⎪⎭⎫ ⎝⎛=p此消息的信息量是:bit p I 811.87log =-=(2)此消息中平均每符号携带的信息量是:bit n I 951.145/811.87/==3.2 某一无记忆信源的符号集为{0, 1},已知信源的概率空间为⎭⎬⎫⎩⎨⎧=⎥⎦⎤⎢⎣⎡4/34/110)(X P X(1) 求信息符号的平均熵;(2) 由100个符号构成的序列,求某一特定序列(例如有m 个“0”和(100 - m )个“1”)的自信息量的表达式; (3) 计算(2)中序列的熵。

解: (1)bit x p x p X H ii i 811.043log 4341log 41)(log )()(=⎪⎭⎫ ⎝⎛+-=-=∑(2)bit m x p x I x p mi i m mm i 585.15.4143log)(log )(434341)(100100100100100+=-=-==⎪⎭⎫ ⎝⎛⨯⎪⎭⎫ ⎝⎛=---(3)bit X H X H 1.81811.0100)(100)(100=⨯==3.5 某信源的消息符号集的概率分布和二进制代码如题表3.2所列。

题表 3.2(1) (2) 求每个消息符号所需要的平均二进制码的个数或平均代码长度。

进而用这一结果求码序列中的一个二进制码的熵;(3) 当消息是由符号序列组成时,各符号之间若相互独立,求其对应的二进制码序列中出现0和1的无条件概率0p 和1p ,求相邻码间的条件概率1/0p 、0/1p 、1/1p 、0/0p 。

3.1 设信源⎥⎦⎤⎢⎣⎡)(x P X =⎥⎦⎤⎢⎣⎡4.06.021x x 通过一干扰信道,接收符号Y=[]21y y ,信道传递概率如图3.33所示。

求:(1) 信源X 中事件x1,和x2分别含有的自信息。

(2) 收到消息yj(j=1,2)后,获得的关于xi(i=1,2)的信息量。

(3) 信源X 和信源Y 的信息熵。

(4) 信道疑义度H (X|Y )和噪声熵H (Y|X )。

(5) 接收到消息Y 后获得的平均互信息。

解:(1)由定义得:I (X1)= -log0.6=0.74bitI (X2)= -log0.4=1.32bit(2)P (y1)= 0.6×5/6+0.4×3/4=0.8 P (y2)= 0.6×1/6+0.4×1/4=0.2I (xi ;xj )= I (xi )-I (xi|yj )=log[P (xi|yj )/p (xi )]= log[P (yj|xi )/p (yj )]则 I (x1;y1)= log[P (y1|x1)/p (y1)]=log5/6/0.8=0.059bit I (x1;y2)= log[P (y2|x2)/p (y2)]=log1/6/0.2=-0.263bit I (x2;y1)= log[P (y1|x2)/p (y1)]=log3/4/0.8=-0.093bit I (x2;y2)= log[P (y2|x2)/p (y2)]=log1/4/0.2=0.322bit(3)由定义显然 H (X )=0.97095bit/符号H (Y )=0.72193bit/符号(4)H (Y|X )=∑P (xy )log[1/P (y|x )]=2211i j ==∑∑p (xi )P (yj|xi )log[1/P (yj|xi )]=0.6·5/6·log6/5+0.6·1/6·log6+0.4·3/4·log4/3+0.4·1/4·log4 =0.7145bit/符号H (X|Y )= H (X )+H (Y|X )-H (Y )=0.9635bit/符号(5) I (X ;Y )= H (X )-H (X|Y )=0.00745 bit/符号图3.1 二元信道1/63/41/45/6x 1y 1y 2x 23.2设8个等概率分布的消息通过传递概率为p 的BSC 进行传送。

第三章作业1、将某六进制信源进行二进制编码,如表所示,求: (1)哪些是唯一可译码? (2)哪些是非延长码(即时码)?(3)所有唯一可译码的平均码长和编码效率。

解:(1)C1,C2,C3,C6是唯一可译码。

(2)C1, C3,C6是即时码。

(3)H(X)=2bit/符号,符号码元/31=l ,%7.6632)(11===l X H η 符号码元/125.2)(612==∑=i i i l u p l ,%1.94125.22)(22===l X H η 符号码元/125.2)(613==∑=i i i l u p l ,%1.94125.22)(33===l X H η 符号码元/5.2)(616==∑=i i i l u p l ,%805.22)(66===l X H η 2、某信源有8个符号{x 1,x 2,…,x 8},概率分别为1/2,1/4,1/8,1/16,1/32,1/64,1/128,1/128,编成这样的码:000,001,010,011,100,101,110,111。

求: (1)信源的符号熵; (2)出现一个1或0的概率; (3)这种码的编码效率; (4)相应的香农码和费诺码; (5)该码的编码效率。

解:(1)符号/98.1)(log )()(bit x p x p X H iii=-=∑(2)8.03/)1*12811*6412*3211*1612*812*413*21()0()0(=++++++==l l p 2.0)0(1)1(=-=p p(3)%66398.1)(===l X H η费诺码:(码字不唯一)(5)符号码元/98.1)(81==∑=ii i lx p l ,因此香农码和费诺码的编码效率均为:%10098.198.1)(===l X H η 4、设有离散无记忆信源p(X)={0.37,0.25,0.18,0.10,0.07,0.03}。

(1)求信源符号熵(2)用霍夫曼编成二元变长码,计算编码效率。

该信源发出的信息序列为(202 120 130 213 001 203 210 110 321 010 021 032 011 223 210)。

求:

(1)此消息的自信息量是多少?

(2)此消息中平均每符号携带的信息量是多少?

解:

(1)

此消息总共有14个0、13个1、12个2、6个3,因此消息发出的概率是:

此消息的信息量是:I二-log p =87.811 bit

3.2某一无记忆信源的符号集为{0, 1},已知信源的概率空间为

;x 口0 1:

]P(X)」J/4 3/4:

(1)求信息符号的平均熵;

⑵ 由100个符号构成的序列,求某一特定序列(例如有m个“0”和(100 - m个“1”)

的自信息量的表达式;

⑶计算⑵中序列的熵。

解:

(1)

丁"133、

H(X)二一p(X|) log p(X|) log log 0.811 bit

i\_4 4 4 4 J

100 -m

3

—,100

4

3〔00 -m

l(xj - -log p(xj - -log 10厂=41.5 1.585m bit

4

H(X100) =100H(X) =100 0.811 =81.1 bit

其概率空间为

;X L X1 = 0 X2 =1 X3 = 2 X4 = 3

J P(X)J '、3/8 1/4 1/4

1/8

离散无记忆信源

⑵

此消息中平均每符号携带的信息量是: I /n =87.811/45=1.951 bit

z-m 100 -m

g盯(4〕

3.5某信源的消息符号集的概率分布和二进制代码如题表 3.2所列

(1)求信息的符号熵;

(2)求每个消息符号所需要的平均二进制码的个数或平均代码长度。

进而用这一结果求码序列中的一个二进制码的熵;

(3)当消息是由符号序列组成时,各符号之间若相互独立,求其对应的二进制码序列中出现

0和1的无条件概率P o和P i,求相邻码间的条件概率P o/1、P l/0、P i/1、P o/o。

解:

(1)

「1 1 1 1 1 1 1 1 \

H(X) - p(xjlogp(x) log log log log 1.75 bit

i(2 2448888 丿

⑵

- 丁1111

L =E(h)=為p(x)h 1 ——2 — 3 — 3=1.75

i 2 4 8 8

1 1

H N(X) H (X) H(X) =1 bit

N L

设消息序列长为N,则u0、u1、u2、u3的个数分别为N/2, N/4, N /8, N/8个。

N N N N 7N

则0的个数为一1 — 1 — 1 — 0 =——

2 4 8 8 8

N N N N 7N

而1的个数为0 1 2 3 =

2 4 8 8 8

因而p0 = p1 = 0.5

P0/1 二P10 / P1 =屮P

0/0 = P00 / P0

P1/0 二p

01

/ p

1

二2__2

1

P1/1 二

p

11

/ p

1

3.7设有一个信源,它产生0, 1序列的信息。

该信源在任意时间而且不论以前发生过什么消息符号,均按P(0) = 0.4 ,P(1) = 0.6 的概率发出符号。

(1)试问这个信源是否是平稳的;

⑵ 试计算出乂),H(X3/X I XQ及Hs

(3)试计算出乂)并写出乂信源中可能有的所有符号。

解:

⑴

这个信源是平稳无记忆信源。

因为有这些词语:“它在任意时间而且不论以前发生过什么符号

⑵

2

H(X ) =2H(X) 一2 (0.4log0.4 0.6log0.6) =1.942 bit

H(X3/X!X2)=H(X3)-八P(xjlog p(xj (0.4log0.4 0.6log0.6) =0.971 bit

i

H 一- 二lim H(X N/X!X2...X NI^H(X N^0.971 bit

-N _^O

⑶

H(X4) =4H (X) —4 (0.4log 0.4 0.6log 0.6) = 3.884 bit

X4的所有符号:

0000 0001 0010 0011

0100 0101 0110 0111

1000 1001 1010 1011

1100 1101 1110 1111

3.11有一马尔可夫信源,已知转移概率为p(S/S1)=2/3,p(S2/S)=1/3,p(S/S2)=1,P(S2/S2)= 0。

试画出状态转移图,并求出信源熵。

解:

P

(S

1

)

= p(S i

) p(S l / S

1

)+

p(S 2

) p(S 1

/ S 2

)

p( S 2

) = p(S 2

)p(S 2

/ S 2

) + p(

S )

p(S

2

/ S j ) 2

p(S 1 )

P(S

2) 3 1 -3 p(S 1) 1 p(S 1)

3 p(S i )

P

(S 2) P (S 2

) P(SJ p(S 2) =1 jp(S 1)=3/4 :p(S 2)=1/4 H ::-八、p(S)p(S j /S)log p(S j /S i ) i j 3 2 2 3 1 1 log log 4 3 3 4 3 3 = 0.689 bit 3.21黑白传真机的信息元只有黑色和白色两种 X={黑,白},一般气象图上黑色出现的概率为 P(黑)=0.3,白色出现的概率为P(白)=0.7,黑白消息前后没有关联,其转移概率为 P(白 /白)=0.9,P(黑/白)=0.1 ,P(白/黑)=0.2,P(黑/黑)=0.8。

求该一阶马尔可夫信源 的不确定性H(X/X),并画出该信源的状态转移图 解: ds) = p(S 1)p(S 1/sj + p(S 2)p(s/S 2) < 、P( S 2 ) = P(S 2 ) P( S 2 / S 2 )

* p( S 1 ) p( S 2 / S 1 )

;P(SJ =0.8p(SJ +0.1p(S 2)

p©) =0.9p(S 2)+0.2p(SJ ;p(S 2)=2p(S) PS 1) +p(S 2)=1 :P(SJ =1/3 PS 2) =2/3 H ::-八 ' p(S i )p(S j /S)log p(S j /S i ) i j ,Z

1 1

2 2〕 —汉 0.8log0.8 + —汉 0.2log0.2+—^0.1log0.1 + — ^0.9log0.9 1 <

3 3 3 3 J = 0.553 bit I

S 2

-/ p(白/

白)=0.9

)=°.2

3.23 设信源产生 A, B, C 三种符号 p(B/B)=1/2,p(A/B) = p(C / B) = 1/4,p(A/A) = 5/8, p(B/A)=1/4, p(C/A)=1/8,p(C/C)=5/8, p(B/C) =1/4,p(A/C) =1/8。

试计算冗余 度。

解:

5 11 P(S A )=石 P(S A )+;P(S B )

P(S c )

8 4

8 1

1

1

^P(S B ) = :P (S A ) +;;P (S B )

P(S C )

4 2 4 115

p(S c )=匚 P(S A ) P(S B ) +匚 P(S C )

8 4 8

P(S A )二 P(S B )二 P(S C ) P(S A ) P(S B ) p(S c ) =1

3

3

3

H 比=—E Z Z p(e)p(q /e)log p(e j /ej

j k

1 5 1

r 1111 log log p log — |I3 8

8 3 4 4 3 8 8

1 1 1 1 1 1 1 1 1

log log log- 3 4 4 3 2 2 3 4 4 11111115 5

log log log 3 8 8 3 4 4 3 8 8 = 1.366 bit

R =1_H

―迦=o.138

H o log 3

P(S A ) P(S B ) .P(S C ) = 1/3 = 1/3

= 1/3

3.26 一阶马尔可夫信源的状态图如下图所示。

信源X的符号集为{0, 1,2}

(1)求平稳后信源的概率分布;

⑵求信源的熵比。

3

3

3

H 八 p(e)p(n / e)log p(e j /e)

i j

k

4

3 3

4 1 1 log log — _11 4 4 114 4 3^2311

log

log - 11 3 3 113 3

—1 log 1 — -log-

解:

⑴ P(S i

) P (S 2) P (S 3) P(S i ) P (S 2) P (S 1) P (S 2) P (S 3) ⑵

3 1 p(sj - P(S 3)

4 4 2 1

=3 P(S 2) 4 P(S 1) 1 3 =3 P(S 2) 4 P(S 3) 二 P (S 3)

十S 1

) =4/11

=

3/11 =4/11

11 4 4 114 4 = 0.840 bit。