应用回归分析课后习题

- 格式:docx

- 大小:93.42 KB

- 文档页数:8

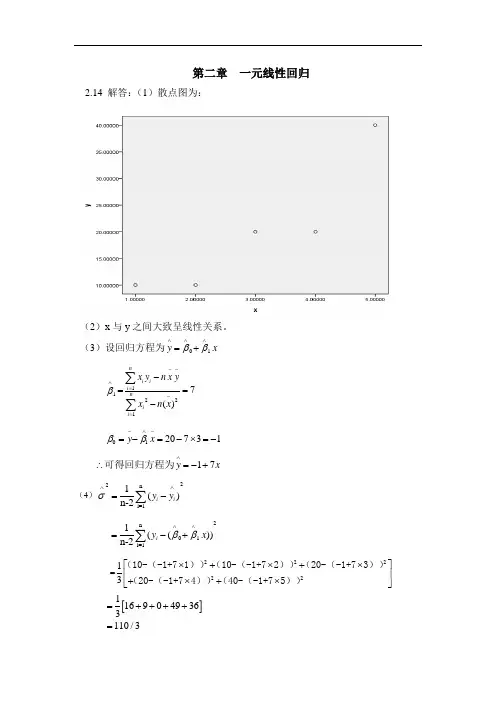

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=6.1σ∧=(5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2||(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)2201()(,())xxx Nn L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()ni i nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈/2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

应⽤回归分析-第9章课后习题答案第9章含定性变量的回归模型思考与练习参考答案9.1 ⼀个学⽣使⽤含有季节定性⾃变量的回归模型,对春夏秋冬四个季节引⼊4个0-1型⾃变量,⽤SPSS 软件计算的结果中总是⾃动删除了其中的⼀个⾃变量,他为此感到困惑不解。

出现这种情况的原因是什么?答:假如这个含有季节定性⾃变量的回归模型为:tt t t kt k t t D D D X X Y µαααβββ++++++=332211110其中含有k 个定量变量,记为x i 。

对春夏秋冬四个季节引⼊4个0-1型⾃变量,记为D i ,只取了6个观测值,其中春季与夏季取了两次,秋、冬各取到⼀次观测值,则样本设计矩阵为:=000110010110001010010010100011)(616515414313212111k k k k k k X X X X X X X X X X X XD X,显然,(X,D)中的第1列可表⽰成后4列的线性组合,从⽽(X,D)不满秩,参数⽆法唯⼀求出。

这就是所谓的“虚拟变量陷井”,应避免。

当某⾃变量x j 对其余p-1个⾃变量的复判定系数2j R 超过⼀定界限时,SPSS 软件将拒绝这个⾃变量x j 进⼊回归模型。

称Tol j =1-2j R 为⾃变量x j 的容忍度(Tolerance ),SPSS 软件的默认容忍度为0.0001。

也就是说,当2j R >0.9999时,⾃变量x j 将被⾃动拒绝在回归⽅程之外,除⾮我们修改容忍度的默认值。

=k βββ 10β=4321ααααα⽽在这个模型中出现了完全共线性,所以SPSS软件计算的结果中总是⾃动删除了其中的⼀个定性⾃变量。

9.2对⾃变量中含有定性变量的问题,为什么不对同⼀属性分别建⽴回归模型,⽽采取设虚拟变量的⽅法建⽴回归模型?答:原因有两个,以例9.1说明。

⼀是因为模型假设对每类家庭具有相同的斜率和误差⽅差,把两类家庭放在⼀起可以对公共斜率做出最佳估计;⼆是对于其他统计推断,⽤⼀个带有虚拟变量的回归模型来进⾏也会更加准确,这是均⽅误差的⾃由度更9.3 研究者想研究采取某项保险⾰新措施的速度y对保险公司的规模x1和保险公司类型的关系(参见参考⽂献【3】)。

实用回归分析第四版 第一章 回归分析概述1.3 回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y 与x1,x2…..xp 的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp 是非随机的,观测值xi1.xi2…..xip 是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:其中:∑∑+-=-=nii i n i X Y Y Y Q 121021))ˆˆ(()ˆ(ββ01ˆˆˆˆi i i i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂即: ∑e i =0 ,∑e i X i =02.5 证明0ˆβ是β0的无偏估计。

实用回归分析第四版第一章回归分析概述1.3回归模型中随机误差项ε的意义是什么?答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么?答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2…. Cov(εi,εj)={σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.第二章一元线性回归分析思考与练习参考答案2.1一元线性回归有哪些基本假定?答:假设1、解释变量X是确定性变量,Y是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性:E(εi)=0 i=1,2, …,nVar (εi)=σ2i=1,2, …,nCov(εi,εj)=0 i≠j i,j= 1,2, …,n假设3、随机误差项ε与解释变量X之间不相关:Cov(X i, εi)=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布εi~N(0, σ2) i=1,2, …,n2.3 证明(2.27式),∑e i =0 ,∑e i X i=0 。

证明:∑∑+-=-=niiiniXYYYQ12121))ˆˆ(()ˆ(ββ其中:01ˆˆˆˆi i i i iY X e Y Yββ=+=-0100ˆˆQ Qββ∂∂==∂∂即: ∑e i =0 ,∑e i X i =02.5 证明0ˆβ是β0的无偏估计。

证明:)1[)ˆ()ˆ(1110∑∑==--=-=ni i xx i n i iY L X X X Y n E X Y E E ββ )] )(1([])1([1011i i xx i n i i xx i ni X L X X X n E Y L X X X n E εββ++--=--=∑∑==1010)()1(])1([βεβεβ=--+=--+=∑∑==i xx i ni i xx i ni E L X X X nL X X X n E 2.6 证明 证明:)] ()1([])1([)ˆ(102110i i xx i ni i xx i ni X Var L X X X nY L X X X n Var Var εβββ++--=--=∑∑== 222212]1[])(2)1[(σσxxxx i xx i ni L X n L X X X nL X X X n +=-+--=∑=2.7证明平方和分解公式:SST=SSE+SSR证明:2.8 验证三种检验的关系,即验证: (1)21)2(r r n t --=;(2)2221ˆˆ)2/(1/t L n SSE SSR F xx ==-=σβ 证明:(1)())1()1()ˆ(222122xx ni iL X n X XX nVar +=-+=∑=σσβ()()∑∑==-+-=-=n i ii i n i i Y Y Y Y Y Y SST 1212]ˆ()ˆ[()()()∑∑∑===-+--+-=ni ii ni i i i ni iY Y Y Y Y Y Y Y 12112)ˆˆ)(ˆ2ˆ()()SSESSR )Y ˆY Y Y ˆn1i 2ii n1i 2i +=-+-=∑∑==ˆt======(2)2222201111 1111ˆˆˆˆˆˆ()()(())(()) n n n ni i i i xxi i i iSSR y y x y y x x y x x Lβββββ=====-=+-=+--=-=∑∑∑∑2212ˆ/1ˆ/(2)xxLSSRF tSSE nβσ∴===-2.9 验证(2.63)式:2211σ)L)xx(n()e(Varxxii---=证明:0112222222ˆˆˆvar()var()var()var()2cov(,)ˆˆˆvar()var()2cov(,())()()11[]2[]()1[1]i i i i i i ii i i ii ixx xxixxe y y y y y yy x y y x xx x x xn L n Lx xn Lβββσσσσ=-=+-=++-+---=++-+-=--其中:222221111))(1()(1))(,()()1,())(ˆ,(),())(ˆ,(σσσββxxixxiniixxiiiniiiiiiiiLxxnLxxnyLxxyCovxxynyCovxxyCovyyCovxxyyCov-+=-+=--+=-+=-+∑∑==2.10 用第9题证明2ˆ22-=∑neiσ是σ2的无偏估计量证明:2221122112211ˆˆ()()()22()111var()[1]221(2)2n ni ii in niii i xxE E y y E en nx xen n n Lnnσσσσ=====-=---==----=-=-∑∑∑∑第三章1.一个回归方程的复相关系数R=0.99,样本决定系数R2=0.9801,我们能判断这个回归方程就很理想吗? 答:不能断定这个回归方程理想。

![《应用回归分析》课后题答案[整理版]](https://uimg.taocdn.com/603529c1f242336c1eb95eca.webp)

《应用回归分析》课后题答案[整理版] 《应用回归分析》部分课后习题答案第一章回归分析概述 1.1 变量间统计关系和函数关系的区别是什么, 答:变量间的统计关系是指变量间具有密切关联而又不能由某一个或某一些变量唯一确定另外一个变量的关系,而变量间的函数关系是指由一个变量唯一确定另外一个变量的确定关系。

1.2 回归分析与相关分析的联系与区别是什么, 答:联系有回归分析和相关分析都是研究变量间关系的统计学课题。

区别有a.在回归分析中,变量y称为因变量,处在被解释的特殊地位。

在相关分析中,变量x和变量y处于平等的地位,即研究变量y与变量x的密切程度与研究变量x与变量y的密切程度是一回事。

b.相关分析中所涉及的变量y与变量x全是随机变量。

而在回归分析中,因变量y是随机变量,自变量x可以是随机变量也可以是非随机的确定变量。

C.相关分析的研究主要是为了刻画两类变量间线性相关的密切程度。

而回归分析不仅可以揭示变量x 对变量y的影响大小,还可以由回归方程进行预测和控制。

1.3 回归模型中随机误差项ε的意义是什么, 答:ε为随机误差项,正是由于随机误差项的引入,才将变量间的关系描述为一个随机方程,使得我们可以借助随机数学方法研究y与x1,x2…..xp的关系,由于客观经济现象是错综复杂的,一种经济现象很难用有限个因素来准确说明,随机误差项可以概括表示由于人们的认识以及其他客观原因的局限而没有考虑的种种偶然因素。

1.4 线性回归模型的基本假设是什么,答:线性回归模型的基本假设有:1.解释变量x1.x2….xp是非随机的,观测值xi1.xi2…..xip是常数。

2.等方差及不相关的假定条件为{E(εi)=0 i=1,2….Cov(εi,εj)=,σ^23.正态分布的假定条件为相互独立。

4.样本容量的个数要多于解释变量的个数,即n>p.1.5 回归变量的设置理论根据是什么,在回归变量设置时应注意哪些问题,答:理论判断某个变量应该作为解释变量,即便是不显著的,如果理论上无法判断那么可以采用统计方法来判断,解释变量和被解释变量存在统计关系。

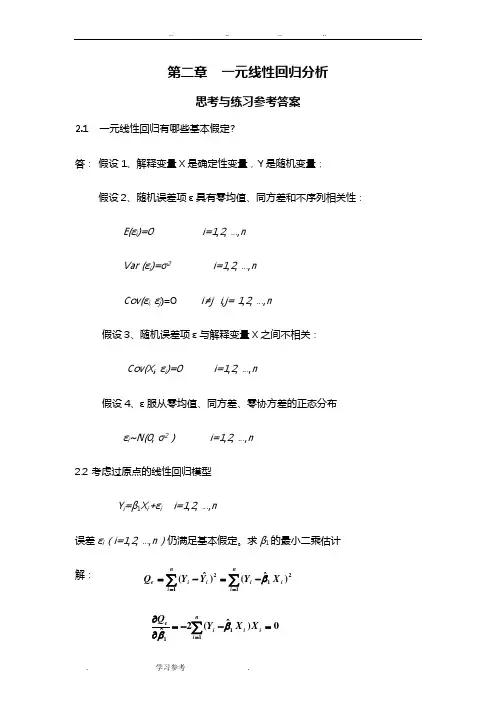

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n 假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n)仍满足基本假定。

求β1的最小二乘估计 解: 得:2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:其中:即: ∑e i =0 ,∑e i X i =0∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ21112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂2.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?给出证明。

答:由于εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函数:使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,上式恰好就是最小二乘估计的目标函数相同。

值得注意的是:最大似然估计是在εi ~N (0, σ2 )的假设下求得,最小二乘估计则不要求分布假设。

第二章 一元线性回归分析思考与练习参考答案2.1 一元线性回归有哪些基本假定?答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=σ2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, σ2 ) i=1,2, …,n 2.2 考虑过原点的线性回归模型 Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n)仍满足基本假定。

求β1的最小二乘估计 解:21112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=得:2.3 证明(2.27式),∑e i =0 ,∑e i X i =0 。

证明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中:即: ∑e i =0 ,∑e i X i =02.4回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价?给出证明。

答:由于εi ~N(0, σ2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , σ2 ) 最大似然函数:)()(ˆ1211∑∑===ni ini ii XY X β01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ上式恰好就是最小二乘估计的目标函数相同。

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=6.1σ∧=≈ (5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)2201()(,())xxx Nn L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()nii nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈ /2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

第二章 一元线性回归2.14 解答:(1)散点图为:(2)x 与y 之间大致呈线性关系。

(3)设回归方程为01y x ββ∧∧∧=+1β∧=12217()ni ii nii x y n x yxn x --=-=-=-∑∑0120731y x ββ-∧-=-=-⨯=-17y x ∧∴=-+可得回归方程为(4)22ni=11()n-2i i y y σ∧∧=-∑ 2n 01i=11(())n-2i y x ββ∧∧=-+∑=2222213⎡⎤⨯+⨯+⨯⎢⎥+⨯+⨯⎣⎦(10-(-1+71))(10-(-1+72))(20-(-1+73))(20-(-1+74))(40-(-1+75)) []1169049363110/3=++++=6.1σ∧=≈ (5)由于211(,)xxN L σββ∧t σ∧==服从自由度为n-2的t 分布。

因而/2|(2)1P t n αασ⎡⎤⎢⎥<-=-⎢⎥⎣⎦也即:1/211/2(p t t ααβββ∧∧∧∧-<<+=1α-可得195%β∧的置信度为的置信区间为(7-2.3537+2.353 即为:(2.49,11.5)2201()(,())xxx Nn L ββσ-∧+t ∧∧==服从自由度为n-2的t 分布。

因而/2(2)1P t n αα∧⎡⎤⎢⎥⎢⎥<-=-⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦即0/200/2()1p βσββσα∧∧∧∧-<<+=- 可得195%7.77,5.77β∧-的置信度为的置信区间为()(6)x 与y 的决定系数22121()490/6000.817()nii nii y y r y y ∧-=-=-==≈-∑∑(7)由于(1,3)F F α>,拒绝0H ,说明回归方程显著,x 与y 有显著的线性关系。

(8)t σ∧==其中2221111()22n ni i i i i e y y n n σ∧∧====---∑∑ 7 3.661==≈ /2 2.353t α= /23.66t t α=>∴接受原假设01:0,H β=认为1β显著不为0,因变量y 对自变量x 的一元线性回归成立。

1、变量间统计关系和函数关系的区别是什么?答:函数关系是一种确定性的关系,一个变量的变化能完全决定另一个变量的变化;统计关系是非确定的,尽管变量间的关系密切,但是变量不能由另一个或另一些变量唯一确定。

2、回归分析与相关分析的区别和联系是什么?答:联系:刻画变量间的密切联系;区别:一、回归分析中,变量y 称为因变量,处在被解释的地位,而在相关分析中,变量y 与x 处于平等地位;二、相关分析中y 与x 都是随机变量,而回归分析中y 是随机的,x 是非随机变量。

三、回归分析不仅可以刻画线性关系的密切程度,还可以由回归方程进行预测和控制。

3、回归模型中随机误差项ε的意义是什么?主要包括哪些因素?答:随机误差项ε的引入,才能将变量间的关系描述为一个随机方程。

主要包括:时间、费用、数据质量等的制约;数据采集过程中变量观测值的观测误差;理论模型设定的误差;其他随机误差。

4、线性回归模型的基本假设是什么?答:1、解释变量非随机;2、样本量个数要多于解释变量(自变量)个数;3、高斯-马尔科夫条件;4、随机误差项相互独立,同分布于2(0,)N σ。

5、回归变量设置的理论根据?在设置回归变量时应注意哪些问题?答:因变量与自变量之间的因果关系。

需注意问题:一、对所研究的问题背景要有足够了解;二、解释变量之间要求不相关;三、若某个重要的变量在实际中没有相应的统计数据,应考虑用相近的变量代替,或者由其他几个指标复合成一个新的指标;四、解释变量并非越多越好。

6、收集、整理数据包括哪些内容?答:一、收集数据的类型(时间序列、截面数据);二、数据应注意可比性和数据统计口径问题(统计范围);三、整理数据时要注意出现“序列相关”和“异方差”的问题;四、收集数据的样本量应大于解释变量;四、整理数据包括:拆算、差分、对数化、标准化以及提出极端值,有缺失值时的处理。

7、构造回归理论模型的基本根据是什么?答:收集到的数据变量之间的数学关系(线性、非线性)以及所研究问题背景的相关模型,例如数理经济中的投资函数、生产函数、需求函数、消费函数等。

第二章 一元线性回归分析思考与练习参考答案一元线性回归有哪些基本假定答: 假设1、解释变量X 是确定性变量,Y 是随机变量;假设2、随机误差项ε具有零均值、同方差和不序列相关性: E(εi )=0 i=1,2, …,n Var (εi )=2 i=1,2, …,n Cov(εi, εj )=0 i≠j i,j= 1,2, …,n 假设3、随机误差项ε与解释变量X 之间不相关: Cov(X i , εi )=0 i=1,2, …,n 假设4、ε服从零均值、同方差、零协方差的正态分布 εi ~N(0, 2 ) i=1,2, …,n 考虑过原点的线性回归模型Y i =β1X i +εi i=1,2, …,n误差εi (i=1,2, …,n)仍满足基本假定。

求β1的最小二乘估计 解: 得:证明(式),e i =0 ,e i X i =0 。

证明:∑∑+-=-=nii i ni X Y Y Y Q 121021))ˆˆ(()ˆ(ββ其中:即: e i =0 ,e i X i =021112)ˆ()ˆ(ini i ni i i e X Y Y Y Q β∑∑==-=-=0)ˆ(2ˆ111=--=∂∂∑=ii ni i eX X Y Q ββ)()(ˆ1211∑∑===ni i ni ii X Y X β01ˆˆˆˆi ii i iY X e Y Y ββ=+=-0100ˆˆQQββ∂∂==∂∂回归方程E (Y )=β0+β1X 的参数β0,β1的最小二乘估计与最大似然估计在什么条件下等价给出证明。

答:由于εi ~N(0, 2 ) i=1,2, …,n所以Y i =β0 + β1X i + εi ~N (β0+β1X i , 2 ) 最大似然函数:使得Ln (L )最大的0ˆβ,1ˆβ就是β0,β1的最大似然估计值。

同时发现使得Ln (L )最大就是使得下式最小,∑∑+-=-=nii i n i X Y Y Y Q 121021))ˆˆ(()ˆ(ββ上式恰好就是最小二乘估计的目标函数相同。

2.1 一元线性回归模型有哪些基本假定?答:1. 解释变量 1x , ,2x ,p x 是非随机变量,观测值,1i x ,,2 i x ip x 是常数。

2. 等方差及不相关的假定条件为⎪⎪⎩⎪⎪⎨⎧⎪⎩⎪⎨⎧≠=====j i n j i j i n i E j i i ,0),,2,1,(,),cov(,,2,1,0)(2 σεεε 这个条件称为高斯-马尔柯夫(Gauss-Markov)条件,简称G-M 条件。

在此条件下,便可以得到关于回归系数的最小二乘估计及误差项方差2σ估计的一些重要性质,如回归系数的最小二乘估计是回归系数的最小方差线性无偏估计等。

3. 正态分布的假定条件为⎩⎨⎧=相互独立n i n i N εεεσε,,,,,2,1),,0(~212 在此条件下便可得到关于回归系数的最小二乘估计及2σ估计的进一步结果,如它们分别是回归系数的最及2σ的最小方差无偏估计等,并且可以作回归的显著性检验及区间估计。

4. 通常为了便于数学上的处理,还要求,p n >及样本容量的个数要多于解释变量的个数。

在整个回归分析中,线性回归的统计模型最为重要。

一方面是因为线性回归的应用最广泛;另一方面是只有在回归模型为线性的假设下,才能的到比较深入和一般的结果;再就是有许多非线性的回归模型可以通过适当的转化变为线性回归问题进行处理。

因此,线性回归模型的理论和应用是本书研究的重点。

1. 如何根据样本),,2,1)(;,,,(21n i y x x x i ip i i =求出p ββββ,,,,210 及方差2σ的估计;2. 对回归方程及回归系数的种种假设进行检验;3. 如何根据回归方程进行预测和控制,以及如何进行实际问题的结构分析。

2.2 考虑过原点的线性回归模型 n i x y i i i ,,2,1,1 =+=εβ误差n εεε,,,21 仍满足基本假定。

求1β的最小二乘估计。

答:∑∑==-=-=ni ni i i i x y y E y Q 1121121)())(()(ββ∑∑∑===+-=--=∂∂n i n i ni i i i i i i x y x x x y Q111211122)(2βββ 令,01=∂∂βQ 即∑∑===-n i ni i i i x y x 11210β 解得,ˆ1211∑∑===ni ini ii xyx β即1ˆβ的最小二乘估计为.ˆ1211∑∑===ni ini ii xyx β2.3 证明: Q (β0,β1)= ∑(y i-β0-β1x i )2因为Q (∧β0,∧β1)=min Q (β0,β1 )而Q (β0,β1) 非负且在R 2上可导,当Q 取得最小值时,有即-2∑(y i-∧β0-∧β1x i )=0 -2∑(y i-∧β0-∧β1x i ) x i =0又∵e i =yi -( ∧β0+∧β1x i )= yi -∧β0-∧β1x i ∴∑e i =0,∑e i x i =0(即残差的期望为0,残差以变量x 的加权平均值为零)2.4 解:参数β0,β1的最小二乘估计与最大似然估计在εi~N(0, 2 ) i=1,2,……n 的条件下等价。

应用回归分析第2章课后习题参考答案解析应用回归分析-第2章课后习题参考答案解析完美word格式2.1一元线性重回模型存有哪些基本假设?答:1.解释变量x1,x2,?xp,是非随机变量,观测值xi1,xi2,?,xip是常数。

2.等方差及不相关的假设条件为i?1,2,?,n?e(?i)?0,2,i?jcov(?,?)?(i,j?1,2,?,n)?ij??0,i?j这个条件称为高斯-马尔柯夫(gauss-markov)条件,简称g-m条件。

在此条件下,便可以得到关于回归系数的最小二乘估计及误差项方差?2估计的一些重要性质,如回归系数的最小二乘估计是回归系数的最小方差线性无偏估计等。

3.正态分布的假设条件为i~n(0,?2),i?1,2,?,n?1,?2,?,?n相互独立在此条件下便可得到关于回归系数的最小二乘估计及?2估计的进一步结果,如它们分别是回归系数的最及?2的最小方差无偏估计等,并且可以作回归的显著性检验及区间估计。

4.通常为了易于数学上的处置,还建议n?p,及样本容量的个数必须多于表述变量的个数。

在整个回归分析中,线性回归的统计模型最为重要。

一方面是因为线性回归的应用最广泛;另一方面是只有在回归模型为线性的假设下,才能的到比较深入和一般的结果;再就是有许多非线性的回归模型可以通过适当的转化变为线性回归问题进行处理。

因此,线性回归模型的理论和应用是本书研究的重点。

1.如何根据样本(xi1,xi2,?,xip;yi)(i?1,2,?,n)求出?0,?1,?2,?,?p及方差?2的估计;2.对回归方程及回归系数的种种假设展开检验;3.如何根据回归方程进行预测和控制,以及如何进行实际问题的结构分析。

2.2考虑过原点的线性重回模型yi??1xi??i,乘坐估算。

答:q(?1)??(yi?e(yi))??(yi??1x1)22i?1i?1nni?1,2,?,n误差?1,?2,?,?n仍满足用户基本假设。

y1 1 x11 x12 x1p 0 1

3.1 y2 1 x21 x22 x2p 1 + 2 即y=x +

yn 1 xn1 xn2 xnp p n

基本假定

(1)解释变量x1,x2…,xp 是确定性变量,不是随机变量,且要求

rank(X)=p+1<n,表明设计矩阵X中自变量列之间不相关,样本量的个数应大于解释变量的个数

(2)随机误差项具有零均值和等方差,即高斯马尔柯夫条件

(3)对于多元线性回归的正态分布假定条件的矩阵模型为

~N( 0,2I n) 随即向量y~N(X , 2I n)

3.2

当(X T X)1存在时,回归参数的最小二乘估计为&収)収丁丫,

要求出回归参数,即要求X T X是一个非奇异矩阵,|x T X 0,所以

可逆矩阵X T X为P+1阶的满秩矩阵,又根据两个矩阵乘积的秩不大于每一因子的秩rank(X) p+1,而X为n (p+1)阶矩阵,于是应有n p+1 结论说明,要想用最小二乘法估计多元线性回归模型的未知参数,样本量n必须大于模型自变量p的个数。

3.3

n

注 tr(H) h

1

3.4不能断定这个方程一定很理想,因为样本决定系数与回归方程中

自变量的数目以及样本量n 有关,当样本量个数n 太小,而自变量又较 多,使样本量与自变量的个数接近时, R 2易接近1,其中隐藏一些虚 假成分。

3.5当接受H o 时,认定在给定的显着性水平

下,自变量x1,x2, xp

对因变量y 无显着影响,于是通过x1,x2,

xp 去推断y 也就无多大意

义,在这种情况下,一方面可能这个问题本来应该用非线性模型去描 述,而误用了线性模型,使得自变量对因变量无显着影响;另一方面 可能是在考虑自变量时,把影响因变量y 的自变量漏掉了,可以重新 考虑建模问题。

当拒绝H o 时,我们也不能过于相信这个检验,认为这个回归模型 已经完美了,当拒绝H o 时,我们只能认为这个模型在一定程度上说明 了自变量x1,x2,

xp 与自变量y 的线性关系,这时仍不能排除排除我

们漏掉了一些重要的自变量。

3.6中心化经验回归方程的常数项为0,回归方程只包含p 个参数估计

值1, 2,

p

比一般的经验回归方程减少了一个未知参数,在变量较

SSE (y y)2

e12 e22

1

2

1 E( ) E( -

SSE*

n p 1 n p n

2 [D(e) (E(e))2]

1 n

(1

1 n

2

en

n

E( e

1

1

n p 1 1 n p 1

1

"1 1 n p 1

J (n

D(e)

1

(p 1))

1_ p 1 1

1 n p 1

2 2

n

E(e 2)

(1 h ) 2

1

多时,减少一个未知参数,计算的工作量会减少许多,对手工计算尤为重要。

在用多元线性回归方程描述某种经济现象时,由于自变量所用的

单位大都不同,数据的大小差异也往往很大,这就不利于在同一标准

上进行比较,为了消除量纲不同和数量级的差异带来的影响,就需要

化回归系数。

3.7

对y o 1X1 2x2 P X P进行中心化处理得

y y 1(x 1 X1)2(x 2 X2

)

p(x p X P)再将等式除以因变量的样

* y y 1

y 二一---------- (x1x1) V L yy V L yy

2

------ (X 2

L yy

X2

)

p

----- (x p x p)

L yy

1 . L ii (x 1 X1)

2 •. L22

(X 2 X2)

v L11 L yy L22 p . L pp (x p x p) i L yy L pp

2X2 p X p

所以

3.8 (j为相关阵(r j)p p第i行,第j列的代数余子式)

r

i2;3

12 11 ? 22

3.9

F j =

将样本数据标准化处理, 然后用最小二乘法估计未知参数,求得标准

1

SSE SSR SSE

SSR SSE SSE SST

空R 2

SST

SSE

3.11

SSR j) 1 SSE (n P 1)

SSR (j)

"SST

(n p

八

SSE (j) SSE

(n

1) (SSE (j)

(

SSE (j) SSE (j\ SSE (n P 1)

(n P 1) (SSE (j)

(

SSE (j)

SSE (j )

SSR j)

SSE (j)) (n P 1)

(r

:

TT

2

)

yj

2

r

yj

(n p 1) ( J)

1 r

yj

r y2小于i , F j 与

2 r

yj

对应, 所以F j 与r ;等价

3.10

SSR n

F (n P

1) P

SSR _P

n P 1

SSE

P 1 SSE

SSR SSR 证得

R 2

F (n P 1) P

SSE

1 回归方程为 y= -348.280+3.754x1+7.101x2+12.447x3 2复相关系数R=0.898,决定系数为0.806,拟合度较高。

3方差分析表,F=8.283 , P 值=0.015<0.05 ,表明回归方程高度显着, 说明x1,x2,x3,整体上对y

有高度显着的线性影响

X2农业总产值的P 值=0.049 X3居民非产品支出的 P 值=0.284

模型汇总

模型

R R 方 调整R 方 标准估计的误

差 1

.872 a

.761

.692

24.08112

⑵(3)( 4)( 5)( 6)

输入/移去的变量b

模型 输入的变量 移去的变量

方法 1

x2, x1 a

输入

a.已输入所有请求的变量。

b.因变量:y

在0.1的显着性水平上,

x3未通过检验,应将其剔除掉

4回归系数的显着性检验

x1工业总产值的P 值=0.100

a.预测变量:(常量),x2, x1

1 回归方程为y= -459.624+4.676x1+8.971x2

2复相关系数R=0.872,决定系数为0.761,由决定系数看回归方程接近高度相关

3方差分析表,F=11.117, P值=0.007,表明回归方程高度显着说明x1,x2,整体上对y有高度显着的线性影响

4回归系数的显着性检验x1工业总产值的P值=0.037

X2农业总产值的P值=0.008

在0.05的显着性水平上,自变量x1,x2对y均有显着影响

(8 )标准化回归方程y=0.479x1+0.676x2

(9)把x0仁75,x02=42 带入y= -459.624+4.676x1+8.971x2 得

y=267.86

y置信水平95%的区间估计为(211.09492,324.57506)

y置信水平95%的近似区间估计为(219.6978,316.0222)

E (y)置信水平95%的区间估计为(245.00541 ,290.66457)

(10)由于X3的回归系数显着性检验未通过,所以居民非商品支出对货运总量影响不大,但是回归方程整体对数据拟合较好。

3.12

b

a. 预测变量:(常量),x2, x1

表中第三行xO(常数项),x1,x2的系数分别为0.73,1.00,0.97 ,说明

x0(常数项),x1,x2之间存在多重共线性。

回归方程为y=2914.646+0.607x1+1.709x2,

第一产业的增加值x1的P® =0.065

第二产业的增加值x2的P t =0.000在0.05的显着性水平上x1对y无显着影响。