第三章:前向网络(1)

- 格式:ppt

- 大小:472.00 KB

- 文档页数:43

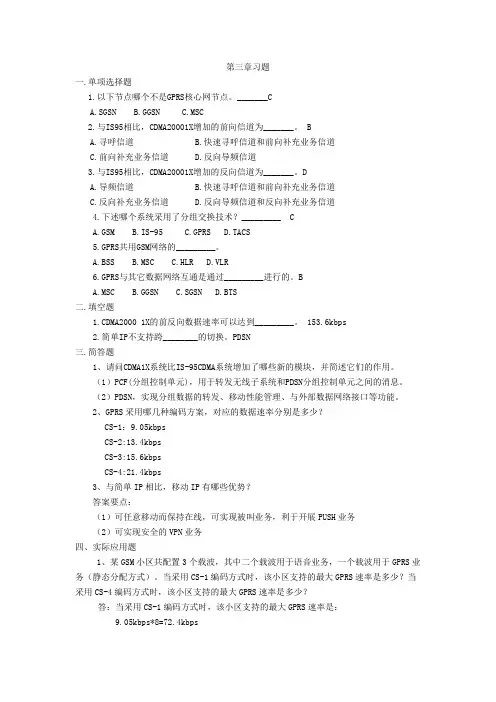

第三章习题一.单项选择题1.以下节点哪个不是GPRS核心网节点。

_______CA.SGSNB.GGSNC.MSC2.与IS95相比,CDMA20001X增加的前向信道为_______。

BA.寻呼信道B.快速寻呼信道和前向补充业务信道C.前向补充业务信道D.反向导频信道3.与IS95相比,CDMA20001X增加的反向信道为_______。

DA.导频信道B.快速寻呼信道和前向补充业务信道C.反向补充业务信道D.反向导频信道和反向补充业务信道4.下述哪个系统采用了分组交换技术?_________ CA.GSMB.IS-95C.GPRSD.TACS5.GPRS共用GSM网络的_________。

A.BSSB.MSCC.HLRD.VLR6.GPRS与其它数据网络互通是通过_________进行的。

BA.MSCB.GGSNC.SGSND.BTS二.填空题1.CDMA2000 1X的前反向数据速率可以达到_________。

153.6kbps2.简单IP不支持跨________的切换。

PDSN三.简答题1、请问CDMA1X系统比IS-95CDMA系统增加了哪些新的模块,并简述它们的作用。

(1)PCF(分组控制单元),用于转发无线子系统和PDSN分组控制单元之间的消息。

(2)PDSN,实现分组数据的转发、移动性能管理、与外部数据网络接口等功能。

2、GPRS采用哪几种编码方案,对应的数据速率分别是多少?CS-1:9.05kbpsCS-2:13.4kbpsCS-3:15.6kbpsCS-4:21.4kbps3、与简单IP相比,移动IP有哪些优势?答案要点:(1)可任意移动而保持在线,可实现被叫业务,利于开展PUSH业务(2)可实现安全的VPN业务四、实际应用题1、某GSM小区共配置3个载波,其中二个载波用于语音业务,一个载波用于GPRS业务(静态分配方式)。

当采用CS-1编码方式时,该小区支持的最大GPRS速率是多少?当采用CS-4编码方式时,该小区支持的最大GPRS速率是多少?答:当采用CS-1编码方式时,该小区支持的最大GPRS速率是:9.05kbps*8=72.4kbps当采用CS-4编码方式时,该小区支持的最大GPRS速率是:21.4kbps*8=171.2kbps2、某GSM小区共配置2个载波,其中F0用于语音业务,F1上6个时隙以动态分配方式分配给GPRS业务使用,2个时隙以静态分配方式分配给GPRS业务使用。

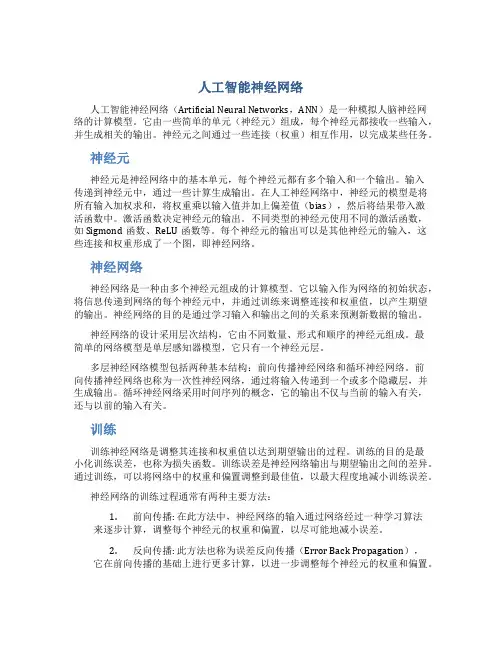

人工智能神经网络人工智能神经网络(Artificial Neural Networks,ANN)是一种模拟人脑神经网络的计算模型。

它由一些简单的单元(神经元)组成,每个神经元都接收一些输入,并生成相关的输出。

神经元之间通过一些连接(权重)相互作用,以完成某些任务。

神经元神经元是神经网络中的基本单元,每个神经元都有多个输入和一个输出。

输入传递到神经元中,通过一些计算生成输出。

在人工神经网络中,神经元的模型是将所有输入加权求和,将权重乘以输入值并加上偏差值(bias),然后将结果带入激活函数中。

激活函数决定神经元的输出。

不同类型的神经元使用不同的激活函数,如Sigmond函数、ReLU函数等。

每个神经元的输出可以是其他神经元的输入,这些连接和权重形成了一个图,即神经网络。

神经网络神经网络是一种由多个神经元组成的计算模型。

它以输入作为网络的初始状态,将信息传递到网络的每个神经元中,并通过训练来调整连接和权重值,以产生期望的输出。

神经网络的目的是通过学习输入和输出之间的关系来预测新数据的输出。

神经网络的设计采用层次结构,它由不同数量、形式和顺序的神经元组成。

最简单的网络模型是单层感知器模型,它只有一个神经元层。

多层神经网络模型包括两种基本结构:前向传播神经网络和循环神经网络。

前向传播神经网络也称为一次性神经网络,通过将输入传递到一个或多个隐藏层,并生成输出。

循环神经网络采用时间序列的概念,它的输出不仅与当前的输入有关,还与以前的输入有关。

训练训练神经网络是调整其连接和权重值以达到期望输出的过程。

训练的目的是最小化训练误差,也称为损失函数。

训练误差是神经网络输出与期望输出之间的差异。

通过训练,可以将网络中的权重和偏置调整到最佳值,以最大程度地减小训练误差。

神经网络的训练过程通常有两种主要方法:1.前向传播: 在此方法中,神经网络的输入通过网络经过一种学习算法来逐步计算,调整每个神经元的权重和偏置,以尽可能地减小误差。

现代通信网概论第三章课后答案1、什么是信令?为什么说它是通信网的神经系统?答:信令是终端和交换机之间以及交换机和交换机之间传递的一种信息。

这种信息可以指导终端、交换系统、传输系统协同运行,在指定的终端间建立和拆除临时的通信隧道,并维护网络本身正常运行,所以说它是通信网的神经系统。

2,按照工作区域信令可分为哪两类?各自功能特点是什么?答:可以分为用户线信令和局间信令。

用户线信令指在终端和交换机之间用户线上传输的信令,主要包括用户终端向交换机发送的监视信令和地址信令。

局间信令指在交换机和交换机之间、交换机与业务控制节点之间等传递的信令,主要用来控制链接的建立、监视、释放、网络的监控、测试等功能。

3,按照功能信令可分为哪几类?答:可以分为监视信令、地址信令和维护管理信令。

4,什么是随路信令?什么是公共信道信令?与随路信令相比,公共信道信令有哪些优点?答:随路信令是指信令与用户信息在同一条信道上传送。

公共信道信令是信令在一条与用户信息信道分开的信道上传送,并且该信令信道并非专用,而是为一群用户信息信道所共享。

由于公共信道信令传输通道与话路完全分开,因此为随路信令更灵活、信令传送速度快,更适应新业务的要求,利于向综合业务数字网过渡。

5、什么是信令方式?答:指在通信网上,不同厂商的设备要相互配合工作,要求设备之间传递的信令遵守一定的规则和约定。

6、画图说明心里在多段路由上的传送方式。

答:图p57页,(包括:端到端方式、逐段转发方式和混合方式)7、信令控制方式有哪几种?各有何特点?答:主要方式有三种:非互控方式、半互控方式和全互控方式。

各自特点:(1)非互控方式:发端连续向收端发送信令,而不必等待收端的证实信号。

该方法控制机制简单,发码速度快,适用于误码率很低费数字信道。

(2)半互控方式:发端向收端发送一个或一组信令后,必须等待收到收端回送的证实信令号后,才能接着发送下一个信号。

办互控方式中前向信令的发送受控于后向证实信令。

人工智能导论-各章习题答案第一章习题解答1. 什么是人工智能?人工智能(Artificial Intelligence,简称AI)是指使机器具有类似或超过人类智能的能力。

人工智能研究的目标是使计算机能够进行人类智力活动,例如学习、理解、推理和决策等。

2. 人工智能的基本分类人工智能可以分为弱人工智能(Narrow AI)和强人工智能(General AI)两类。

弱人工智能是指针对特定任务开发的人工智能系统,比如语音识别、图像处理和机器翻译等。

弱人工智能系统有特定的输入和输出,其能力局限于特定任务。

强人工智能是指能够在各种智力活动中与人类媲美或超越人类的人工智能系统。

强人工智能拥有自主学习、理解、推理和决策的能力,可以应对复杂的问题和情境。

3. 人工智能的应用领域人工智能已经在多个领域得到应用,包括但不限于以下几个方面:•机器学习:基于数据和统计方法,让计算机自动学习并改进性能。

•自然语言处理:使计算机能够理解和处理人类语言。

•机器视觉:使计算机能够理解和处理图像和视频。

•专家系统:建立基于规则和知识的推理系统,用于解决复杂的问题和决策。

•智能机器人:让机器拥有感知、决策和执行的能力,用于自主操作和交互。

•数据挖掘:发现数据中的模式和关联,用于预测和决策支持。

4. 人工智能的发展历史人工智能的发展可以追溯到20世纪50年代,随着计算机技术和算法的进步,人工智能开始逐渐崭露头角。

在1956年,达特茅斯会议举行,标志着人工智能的诞生。

随后,人工智能经历了繁荣期、低谷期和复兴期等不同的发展阶段。

繁荣期(1956-1974)中,很多初期的人工智能算法被提出,比如逻辑推理、机器学习和专家系统等。

然而,由于计算能力限制和算法的局限性,人工智能在这个时期受到了限制。

低谷期(1975-1980)是由于在之前的繁荣期中,人们对人工智能过于乐观,但实际应用和成果不如预期,导致了人工智能的寒冬。

复兴期(1980-至今)是人工智能的复苏和突破阶段。

移动通信复习资料移动通信原理与系统复习资料第⼀章:1.在4G系统中,⽹元间的协议是基于IP的,每⼀个MT(移动终端)都有各⾃的IP地址。

2.IP核⼼⽹:它不是专门⽤作移动通信,⽽是作为⼀种统⼀的⽹络,⽀持有线和⽆线接⼊。

主要功能是:完成位置管理和控制、呼叫控制和业务控制。

3.4G⽹络应该是⼀个⽆缝连接的⽹络,也就是说各种有线和⽆线⽹都能以IP协议为基础连接到IP核⼼⽹。

当然为了与传统的⽹络互联则需要⽤⽹关建⽴⽹络的互联,所以将来的4G⽹络将是⼀个复杂的多协议的⽹络。

4.移动通信的定义:指通信双⽅或⾄少有⼀⽅处于运动中进⾏信息交换的通信⽅式。

5.移动通信系统包括:⽆绳电话、⽆线寻呼、陆地蜂窝移动通信、卫星移动通信等。

6.⽆线通信是移动通信的基础。

7.移动通信所受⼲扰种类:(1):互调⼲扰:指两个或多个信号作⽤在通信设备的⾮线性器件上,产⽣与有⽤信号频率相近的组合频率。

从⽽对通信系统构成⼲扰的现象。

(2):邻道⼲扰:指相邻或邻近的信道之间的⼲扰,是由于⼀个强信号串扰弱信号⽽造成的⼲扰。

(3):同频⼲扰:指相同频率电台之间的⼲扰。

8.移动通信的⼯作⽅式:(1):单⼯通信:指通信双⽅电台交替地进⾏收信和发信。

它常⽤于点到点通信。

(2)双⼯通信:指通信双⽅。

收发信机均同时⼯作。

即任⼀⽅讲话时都可以听到对⽅的话⾳,没有“按-讲”开关。

(3)半双⼯通信第⼆章:1. 移动通信的信道:指基站天线、移动⽤户天线和两幅天线之间的传播路径。

2. 从某种意义上来说,对移动⽆线电波传播特性的研究就是对移动信道的研究。

(判断)3. 移动信道的基本特性就是衰落特性。

4. ⽆线电波的传播⽅式:直射、反射、绕射和散射以及它们的合成。

5. 移动信道是⼀种时变信道。

在这种信道中传播表现出来的衰落⼀般为:随信号传播距离变化⽽导致的传播损耗和弥散。

6. (1)阴影衰落:由于传播环境中的地形起伏、建筑物及其它障碍物对电磁波的遮蔽所引起的衰落。

第三章习题解答简述数据链路层的功能。

答:数据链路层是在物理层提供的比特流传送服务的基础上,通过一系列的控制和管理,构成透明的、相对无差错的数据链路,向网络层提供可靠、有效的数据帧传送的服务。

其主要功能包括:链路管理,帧定界,流量控制,差错控制,数据和控制信息的识别,透明传输,寻址。

试解释以下名词:数据电路,数据链路,主站,从站,复合站。

答:数据电路是一条点到点的,由传输信道及其两端的DCE构成的物理电路段,中间没有交换节点。

数据电路又称为物理链路,或简称为链路。

数据链路是在数据电路的基础上增加传输控制的功能构成的。

一般来说,通信的收发双方只有建立了一条数据链路,通信才能够有效地进行。

在链路中,所连接的节点称为“站”。

发送命令或信息的站称为“主站”,在通信过程中一般起控制作用;接收数据或命令并做出响应的站称为“从站”,在通信过程中处于受控地位。

同时具有主站和从站功能的,能够发出命令和响应信息的站称为复合站。

数据链路层流量控制的作用和主要功能是什么答:流量控制简称“流控”,是协调链路两端的发送站、接收站之间的数据流量,以保证双方的数据发送和接收达到平衡的一种技术。

在计算机网络中,由于接收方往往需要对接收的信息进行识别和处理,需要较多的时间,通常发送方的发送速率要大于接收方的接收能力。

当接收方的接收处理能力小于发送方的发送能力时,必须限制发送方的发送速率,否则会造成数据的丢失。

流量控制就是一种反馈机制,接收方随时向发送方报告自己的接收情况,限制发送方的发送速率。

保证接收方能够正常、有序地接收数据。

在停止-等待协议中,确认帧是否需要序号为什么答:在停止-等待协议中,由于每次只确认一个已经发送的帧,确认帧可以不需要序号。

但在一些特殊情况下会出现问题。

如果发送方在超时重发一个帧后又收到了迟到的确认,就不能确定该应答是对哪一个帧的确认,并可能导致随后的传送过程重新差错。

解释为什么要从停止-等待协议发展到连续ARQ协议。

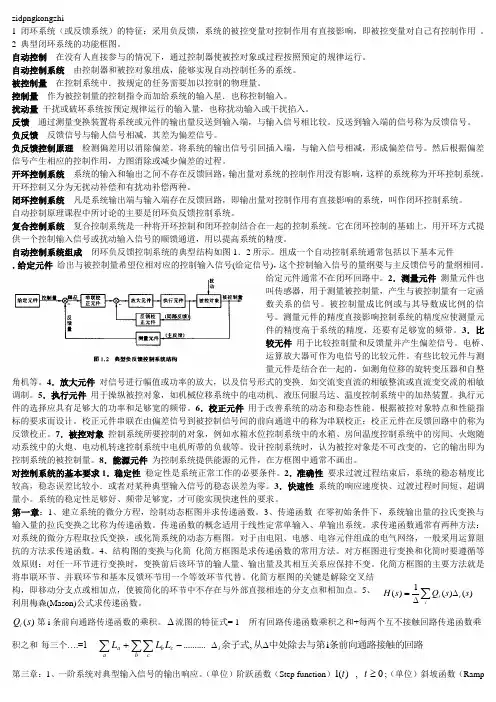

∑∆∆=i i i s s Q s H )()(1)(zidpngkongzhi1 闭环系统(或反馈系统)的特征:采用负反馈,系统的被控变量对控制作用有直接影响,即被控变量对自己有控制作用 。

2 典型闭环系统的功能框图。

自动控制 在没有人直接参与的情况下,通过控制器使被控对象或过程按照预定的规律运行。

自动控制系统 由控制器和被控对象组成,能够实现自动控制任务的系统。

被控制量 在控制系统中.按规定的任务需要加以控制的物理量。

控制量 作为被控制量的控制指令而加给系统的输入星.也称控制输入。

扰动量 干扰或破坏系统按预定规律运行的输入量,也称扰动输入或干扰掐入。

反馈 通过测量变换装置将系统或元件的输出量反送到输入端,与输入信号相比较。

反送到输入端的信号称为反馈信号。

负反馈 反馈信号与输人信号相减,其差为偏差信号。

负反馈控制原理 检测偏差用以消除偏差。

将系统的输出信号引回插入端,与输入信号相减,形成偏差信号。

然后根据偏差信号产生相应的控制作用,力图消除或减少偏差的过程。

开环控制系统 系统的输入和输出之间不存在反馈回路,输出量对系统的控制作用没有影响,这样的系统称为开环控制系统。

开环控制又分为无扰动补偿和有扰动补偿两种。

闭环控制系统 凡是系统输出端与输入端存在反馈回路,即输出量对控制作用有直接影响的系统,叫作闭环控制系统。

自动控制原理课程中所讨论的主要是闭环负反馈控制系统。

复合控制系统 复合控制系统是一种将开环控制和闭环控制结合在一起的控制系统。

它在闭环控制的基础上,用开环方式提供一个控制输入信号或扰动输入信号的顺馈通道,用以提高系统的精度。

自动控制系统组成 闭环负反馈控制系统的典型结构如图1.2所示。

组成一个自动控制系统通常包括以下基本元件 .给定元件 给出与被控制量希望位相对应的控制输入信号(给定信号),这个控制输入信号的量纲要与主反馈信号的量纲相同。

给定元件通常不在闭环回路中。

2.测量元件 测量元件也叫传感器,用于测量被控制量,产生与被控制量有一定函数关系的信号。

第一章1.全互连式网络有何特点?为什么通信网不直接采用这种方式?全互连式网络把所有终端两两相连;这种方式的缺点是:1)所需线路数量大且效率低。

所需线路对数与通话用户数间的关系是:N(N-1)/2。

2)选择困难。

每一个用户和N-1个用户之间用线路连接,由电话机来选择需要通话的用户连线比较困难。

3)安装维护困难。

每个用户使用的电话机的通话导线上要焊接N-1对线,困难。

2.在通信网中引入交换机的目的是什么?完成需要通信的用户间的信息转接,克服全互连式连接存在的问题。

3.无连接网络和面向连接网络各有何特点?a)面向连接网络用户的通信总要经过建立连接、信息传送、释放连接三个阶段;无连接网络不为用户的的通信过程建立和拆除连接。

b)面向连接网络中的每一个节点为每一个呼叫选路,节点中需要有维持连接的状态表;无连接网络中的每一个节点为每一个传送的信息选路,节点中不需要维持连接的状态表。

c)用户信息较长时,采用面向连接的通信方式的效率高;反之,使用无连接的方式要好一些。

4.OSI参考模型分为几层?各层的功能是什么?分为7层:物理层:提供用于建立、保持和断开物理接口的条件,以保证比特流的透明传输。

数据链路层:数据链路的建立、维持和拆除;分组信息成帧;差错控制功能;流量控制功能。

网络层:寻址、路由选择、数据包的分段和重组以及拥塞控制。

运输层:1)建立、拆除和管理端系统的会话连接2)进行端到端的差错纠正和流量控制。

会话层:1)会话连接的建立与拆除;2)确定会话类型(两个方向同时进行,交替进行,或单向进行)3)差错恢复控制。

表示层:数据转换:编码、字符集和加密转换;格式转换:数据格式修改及文本压缩;语法选择:语法的定义及不同语言之间的翻译。

应用层:提供网络完整透明性,用户资源的配置,应用管理和系统管理,分布式信息服务及分布式数据库管理等。

5.网络分层模型的意义是什么?各层设计对交换机有什么益处?意义是为异种计算机互联提供一个共同的基础和标准框架,并为保持相关标准的一致性和兼容性提供共同的参考连。

42.简述网络协议的概念及其三要素。

第二章2012.4计算机网络中为进行数据交换而建立的规则, 标准或约定的集合就称为网络协议。

网络协议的三要素:语法, 语义, 定时40.简述多路复用技术的概念及分类。

第三章2009.4在数据通信系统或计算机网络系统中,传输介质的带宽或容量往往超过传输单一信号的需求,为了有效地利用通信线路,盼望一个信道同时传输多路信号,这就是所谓的多路复用技术。

频分多路复用FDM 和时分多路复用TDM 是两种最常用的多路复用技术。

41.简述三种数据交换技术的主要特点。

第三章2011.7电路交换:在数据传送开始之前先设置一条专用的通路。

在线路释放之前,该通路由一对用户完全占用。

对于猝发式的通信,电路交换效率不高。

报文交换:传送报文时采纳“存储—转发”方式,且一个时刻仅占用一段通道。

在交换节点中须要缓冲存储,报文须要排队。

不能满意实时通信的要求。

分组交换:交换方式和报文交换方式类似,但是报文被分成分组传送,并规定了最大的分组长度。

41.简述停等协议的实现过程。

第四章2009.4停等协议的实现过程如下:(1)发送方每次仅将当前信息帧作为待确认帧保留在缓冲存储器中;(2)当发送方开始发送信息帧时,给予该信息帧一个帧序号,随即启动计时器;(3)当接收方收到无差错的信息帧后,即向发送方返回一个及该帧序号相同序号的ACK确认帧;(4)当接收方检测到一个含有差错的信息帧时,便舍弃该帧。

(5)若发送方在规定时间内收到ACK 确认帧,即将计时器清零,继而开始下一帧的发送;(6)若发送方在规定的时间内未收到ACK 确认帧(即计时器超时),则应重发存于缓冲器中的待确认信息帧。

42.简述家庭用户利用PPP协议及Internet服务供应商网络的连接过程。

第四章2011.4(1)家庭用户利用PC机通过调制解调器呼叫供应商的路由器;(2)路由器的调制解调器回答用户呼叫,并建立物理连接之后,PC机给路由器发送一系列的LCP分组;(3)这些分组及它们的应答信息将选定所运用的PPP参数;(4)双方对PPP参数达成一样后,将发送一系列的NCP分组,用于配置网络层;(5)针对IP协议的NCP负责动态安排IP地址。

第一章思考与练习1.选择题1.B2.C3.C4.C5.D6.A7.B2.填空题1从宏观角度来看,移动互联网是由移动终端和移动子网、接入网络、核心网络3部分组成。

2.移动互联网是指以各种类型的移动终端作为接入设备,使用各种移动网络作为接入网络,从而实现包括传统移动通信、传统互联网及其各种融合创新服务的新型业务模式。

3.简答题1.移动互联网的基本特征有哪些?(1)终端移动性:相对于固定互联网,移动互联网灵活、便捷、高效。

移动终端体积小且易于携带;移动互联网里包含了各种适合移动应用的各类信息,用户可以随时随地地进行采购、交易、质询、决策、交流等各类活动。

移动性带来接入便捷、无所不在的连接以及精确的位置信息,而位置信息与其他信息的结合蕴藏着巨大的业务潜力。

(2)个性化:移动互联网创造了一种全新的个性化服务理念和商业运作模式。

对于不同用户群体和个人的不同爱好和需求,为他们量身定制出多种差异化的信息,并通过不受时空地域限制的渠道,随时随地传送给用户。

终端用户可以自由自在地控制所享受服务的内容、时间和方式等,移动互联网充分体现了个性化的服务。

(3)业务及时性:用户使用移动互联网能够随时随地获取自身或其他终端的信息,及时获取所需的服务和数据;(4)服务便利性:由于移动终端的限制,移动互联网服务要求操作简便,响应时间短;(5)业务使用的私密性:在使用移动互联网业务时,所使用的内容和服务更私密,如手机支付业务等。

(6)融合性:首先,移动语音和移动互联网业务的一体化导致了业务融合;其次,手机终端趋向于变成人们随身携带的唯一的电子设备,其功能集成度越来越高。

2.移动互联网的发展经历了哪几个时期?(1)萌芽期(2000-2007年)(2)成长培育期(2008-2011年)(3)高速成长期(2012-2013年)(4)全面发展期(2014年--至今)3.简述移动互联网的3个构成要素。

(1)移动终端,包括手机、专用移动互联网终端和数据卡方式的便携电脑等;(2)移动通信网络接入,包括2G、3G甚至4G等;(3)公众互联网服务,包括Web,WAP方式等。

BP神经网络在数据挖掘中的应用第一章数据挖掘及现代神经网络1.1 数据挖掘数据挖掘(Data Mining)是20世纪90年代中期兴起的一项新技术,是多门学科和多种技术相结合的产物。

1989年8月,在美国底特律召开的第11 届国际人工智能联合会议的专题讨论会上,首次提出了知识发现KDD(Knowledge Discovery in Database)这个概念。

1995年,美国计算机学会(ACM)会议提出了数据挖掘,它形象地把大型数据库看成是存放有价值信息的矿藏,通过有效的知识发现技术,从中挖掘或开采出有用的信息。

由于数据挖掘是KDD过程中的关键步骤,所以常不加区分地使用知识发现KDD和数据挖掘DM这两个术语。

而所谓数据挖掘,就是对观测到的数据集(经常是很庞大的)进行分析,目的是发现未知的关系和以数据拥有者可以理解并对其有价值的新颖方式来总结数据。

数据挖掘常采用的算法及理论有粗糙集(Rough sets)、人工神经网络(Artificial neural networks)、决策树(Decision trees )、遗传算法(Genetic algorithms)等。

数据挖掘技术主要来源于四个领域:统计分析、机器学习、神经网络和数据库。

所以,数据挖掘的主要方法可以粗分为:统计方法、机器学习方法、神经网络方法和数据库方法。

统计方法主要包括:回归分析(多元回归、自回归等)、判别分析(贝叶斯判别、费歇尔判别、非参数判别等)、聚类分析(系统聚类、动态聚类等)、探索性分析(主元分析法、相关分析法等)、以及模糊集、粗集、支持向量机等。

模糊集方法即利用模糊集合理论对实际问题进行模糊评判、模糊决策、模糊模式识别和模糊聚类分析。

系统的复杂性越高,模糊性越强,一般模糊集合理论是用隶属度来刻画模糊事物的亦此亦彼性的。

粗集方法建立在粗集理论上。

粗集理论是一种研究不精确、不确定知识的数学工具。

粗集方法有几个优点:不需要给出额外信息;简化输入信息的表达空间;算法简单,易于操作。

第三章战略选择1.(2018年·多选题)甲公司是一家特种钢材生产企业,其产品主要用于大型采矿机械、采油设备的生产。

为了增强对钢铁市场需求变化的敏感性,甲公司决定把前向一体化作为发展战略。

下列各项中,符合该公司发展战略的有()。

A.参股海城矿山机械公司B.与东港石油公司签订集研发、生产、销售为一体的合作协议C.投资建立铁矿资源开发和生产企业D.与南岗煤炭集团建立战略联盟『正确答案』AB『答案解析』前向一体化战略是指获得分销商或零售商的所有权或加强对他们的控制权的战略。

甲公司的产品主要用于大型采矿机械、采油设备的生产。

所以参股海城矿山机械公司、与东港石油公司签订合作协议,属于前向一体化战略。

选项AB正确。

投资建立铁矿资源开发和生产企业,属于后向一体化战略。

与南岗煤炭集团建立战略联盟,属于后向一体化战略。

2.(2019年·多选题)京川餐饮公司近期实行了新的经营方式,顾客既可以按照公司提供的菜谱点餐,也可以自带菜谱和食材请公司的厨师加工烹饪,还可以在支付一定学习费用后在厨师指导下自己操作,从而在享受美食的同时提高厨艺。

这些新的经营方式使该公司的顾客数量和营业收入均增长20%以上。

从密集型战略角度看,京川餐饮公司的上述做法属于()。

A.市场开发战略B.市场渗透战略C.产品开发战略D.一体化战略『正确答案』ABC『答案解析』顾客可以按照公司提供的菜谱点餐,体现了市场渗透。

顾客可以自带菜谱和食材请公司的厨师加工烹饪,体现了产品开发。

顾客可以在支付一定学习费用后在厨师指导下自己操作,在享受美食的同时提高厨艺,体现了市场开发。

3.(2018年·单选题)长森公司是一家从事智能化产品研发和生产的高科技公司,最初的产品是智能手机。

近两年来,公司业务范围扩展到智能家电和智能机器人制造等领域。

长森公司的发展战略类型属于()。

A.同心多元化B.离心多元化C.市场渗透D.产品开发『正确答案』A『答案解析』智能家电和智能机器人制造等领域是新产品、新市场,属于多元化战略,而且与智能手机同属于智能化产品,所以属于相关多元化(同心多元化)。

一、填空题1、模糊控制器由模糊化接口、解模糊接口、知识库和模糊推理机组成2、一个单神经元的输入是1.0 ,其权值是1。

5,阀值是—2,则其激活函数的净输入是-0。

5 ,当激活函数是阶跃函数,则神经元的输出是 13、神经网络的学习方式有导师监督学习、无导师监督学习和灌输式学习4、清晰化化的方法有三种:平均最大隶属度法、最大隶属度取最小/最大值法和中位数法,加权平均法5、模糊控制规则的建立有多种方法,是:基于专家经验和控制知识、基于操作人员的实际控制过程和基于过程的模糊模型,基于学习6、神经网络控制的结构归结为神经网络监督控制、神经网络直接逆动态控制、神网自适应控制、神网自适应评判控制、神网内模控制、神网预测控制六类7.傅京逊首次提出智能控制的概念,并归纳出的3种类型智能控制系统是、和.7、人作为控制器的控制系统、人机结合作为控制器的控制系统、无人参与的自主控制系统8、智能控制主要解决传统控制难以解决的复杂系统的控制问题,其研究的对象具备的3个特点为、和。

8、不确定性、高度的非线性、复杂的任务要求9.智能控制系统的主要类型有、、、、和。

9、分级递阶控制系统,专家控制系统,神经控制系统,模糊控制系统,学习控制系统,集成或者(复合)混合控制系统10.智能控制的不确定性的模型包括两类:(1);(2) 。

10、(1)模型未知或知之甚少;(2)模型的结构和参数可能在很大范围内变化。

11.控制论的三要素是:信息、反馈和控制。

12.建立一个实用的专家系统的步骤包括三个方面的设计,它们分别是、和。

知识库的设计推理机的设计人机接口的设计13.专家系统的核心组成部分为和.知识库、推理机14.专家系统中的知识库包括了3类知识,它们分别为、、和。

判断性规则控制性规则数据15.专家系统的推理机可采用的3种推理方式为推理、和推理。

15、正向推理、反向推理和双向推理16.根据专家控制器在控制系统中的功能,其可分为和。

16、直接型专家控制器、间接型专家控制器17.普通集合可用函数表示,模糊集合可用函数表示。