最近邻域法

- 格式:ppt

- 大小:3.29 MB

- 文档页数:54

k-近邻域密度法全文共四篇示例,供读者参考第一篇示例:k-近邻域密度法是一种常用的分类算法,它基于实例之间的距离来判断样本的类别。

该算法在机器学习领域广泛应用,特别在数据挖掘、模式识别和图像处理等方面有着重要的作用。

本文将介绍k-近邻域密度法的原理、应用和优缺点,以及如何在实际问题中应用这一算法。

一、原理k-近邻域密度法的基本原理是基于样本在特征空间中的距离来进行分类。

该算法首先需要计算每个样本与其它样本的距离,然后根据样本之间的距离决定样本的类别。

通常情况下,我们可以根据样本的k 个最近邻来决定该样本的类别,即选择离该样本最近的k个样本作为其最近邻,并根据这k个最近邻的类别来判断该样本的类别。

二、应用k-近邻域密度法在实际生活中有着广泛的应用。

例如在电商行业中,我们可以根据用户购买的商品和浏览记录来为用户推荐相似的商品;在医学领域中,可以利用该算法来对病例进行分类和诊断;在金融领域中,可以基于客户的行为数据来预测客户的信用评级等。

在图像处理领域中,也常常会使用k-近邻域密度法来识别图像中的物体或人脸,通过计算图像特征之间的距离来实现图像分类和检测。

在文本处理中,该算法也可以用于文档分类和信息检索等任务。

三、优缺点虽然k-近邻域密度法在许多领域有着广泛的应用,但该算法也存在一些不足之处。

该算法在处理大规模数据时效率较低,因为需要计算每个样本与其它所有样本的距离。

k-近邻域密度法对数据中的噪声和异常值较为敏感,容易受到非相关特征的影响。

该算法在处理高维数据时也存在维度灾难的问题,即由于维度过高导致样本之间的距离计算变得困难。

但与此相对应的是,k-近邻域密度法具有简单、易于理解和实现的特点,且对于非线性和非平稳数据具有较好的适应性。

该算法还可以方便地处理多类别的分类问题和概率估计等需求,因此在许多实际问题中仍然被广泛应用。

四、结语k-近邻域密度法是一种简单而有效的分类算法,它基于实例之间的距离来进行分类,适用于多个领域。

第一章1.连续图像中,图像为一个二维平面,(x,y)图像中的任意一点,f(x,y)为图像于(x,y)于处的值。

连续图像中,(x,y)的取值是连续的,f(x,y)也是连续的数字图像中,图像为一个由有限行有限列组成的二维平面,(i,j)为平面中的任意一点,g(i,j)则为图像在(i,j)处的灰度值,数字图像中,(i,j) 的取值是不连续的,只能取整数,对应第i行j列,g(i,j) 也是不连续的,表示图像i行j列处图像灰度值。

联系:数字图像g(i,j)是对连续图像f(x,y)经过采样和量化这两个步骤得到的。

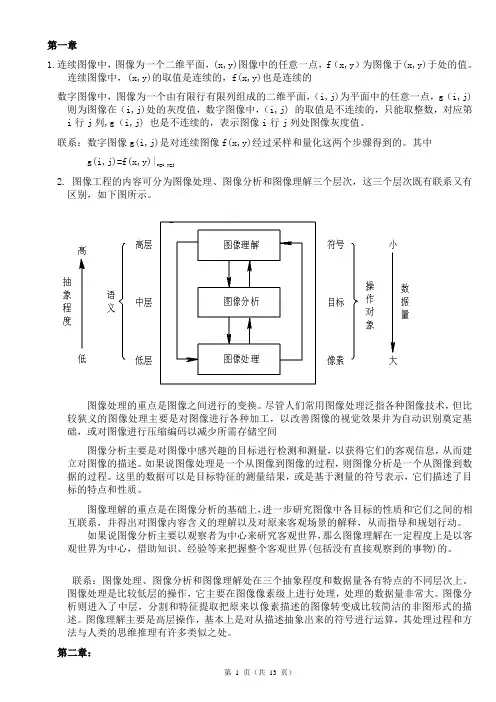

其中g(i,j)=f(x,y)|x=i,y=j2. 图像工程的内容可分为图像处理、图像分析和图像理解三个层次,这三个层次既有联系又有区别,如下图所示。

图像处理的重点是图像之间进行的变换。

尽管人们常用图像处理泛指各种图像技术,但比较狭义的图像处理主要是对图像进行各种加工,以改善图像的视觉效果并为自动识别奠定基础,或对图像进行压缩编码以减少所需存储空间图像分析主要是对图像中感兴趣的目标进行检测和测量,以获得它们的客观信息,从而建立对图像的描述。

如果说图像处理是一个从图像到图像的过程,则图像分析是一个从图像到数据的过程。

这里的数据可以是目标特征的测量结果,或是基于测量的符号表示,它们描述了目标的特点和性质。

图像理解的重点是在图像分析的基础上,进一步研究图像中各目标的性质和它们之间的相互联系,并得出对图像内容含义的理解以及对原来客观场景的解释,从而指导和规划行动。

如果说图像分析主要以观察者为中心来研究客观世界,那么图像理解在一定程度上是以客观世界为中心,借助知识、经验等来把握整个客观世界(包括没有直接观察到的事物)的。

联系:图像处理、图像分析和图像理解处在三个抽象程度和数据量各有特点的不同层次上。

图像处理是比较低层的操作,它主要在图像像素级上进行处理,处理的数据量非常大。

图像分析则进入了中层,分割和特征提取把原来以像素描述的图像转变成比较简洁的非图形式的描述。

k近邻邻域平均距离

k近邻邻域平均距离是机器学习中常用的距离度量指标之一,用于衡量数据点之间的相似性或差异性。

k近邻指的是距离该数据点最近的k个数据点,邻域平均距离则是计算这k个数据点之间的平均距离。

k近邻算法是一种基于实例的学习方法,通过找到最相似的k个邻居来预测新数据点的属性。

在使用k近邻算法时,需要选择合适的距离度量方法来衡量数据点之间的相似性或差异性。

邻域平均距离是一种比较简单而且直观的度量方法,适用于数据比较密集和维度较小的情况。

计算k近邻邻域平均距离需要先确定k值,然后找到距离该数据点最近的k个数据点,计算它们之间的距离并求平均值。

这个平均距离就是该数据点的邻域平均距离。

邻域平均距离越小,说明该数据点与其邻居越相似,反之则越不相似。

在实际应用中,k值的选择很重要。

如果选择的k值过小,容易受到噪声的影响,导致模型过拟合;如果选择的k值过大,容易忽略局部特征,导致模型欠拟合。

因此需要通过交叉验证等方法来确定最优的k值。

- 1 -。

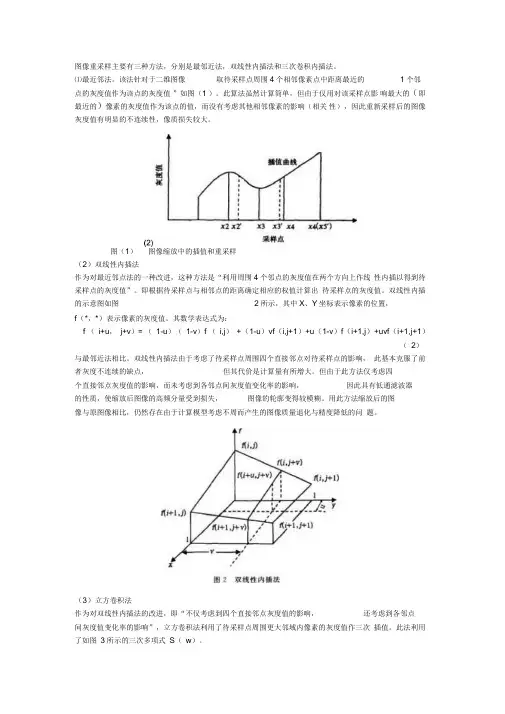

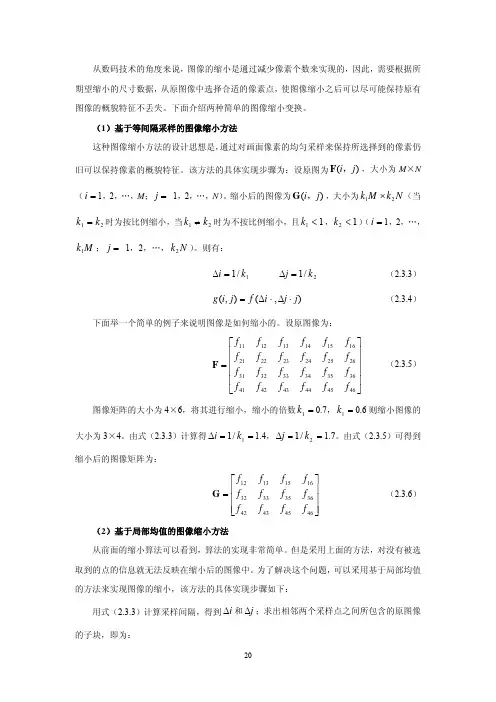

图像重采样主要有三种方法,分别是最邻近法,双线性内插法和三次卷积内插法。

⑴最近邻法。

该法针对于二维图像取待采样点周围4个相邻像素点中距离最近的1个邻点的灰度值作为该点的灰度值”如图(1 )。

此算法虽然计算简单,但由于仅用对该采样点影响最大的(即最近的)像素的灰度值作为该点的值,而没有考虑其他相邻像素的影响(相关性),因此重新采样后的图像灰度值有明显的不连续性,像质损失较大。

图(1)图像缩放中的插值和重采样(2)双线性内插法作为对最近邻点法的一种改进,这种方法是“利用周围4个邻点的灰度值在两个方向上作线性内插以得到待采样点的灰度值”。

即根据待采样点与相邻点的距离确定相应的权值计算出待采样点的灰度值。

双线性内插的示意图如图2所示,其中X、Y坐标表示像素的位置,f(*,*)表示像素的灰度值。

其数学表达式为:f (i+u,j+v)= (1-u)(1-v)f (i,j)+(1-u)vf(i,j+1)+u(1-v)f(i+1,j)+uvf(i+1,j+1)(2)与最邻近法相比。

双线性内插法由于考虑了待采样点周围四个直接邻点对待采样点的影响,此基本克服了前者灰度不连续的缺点,但其代价是计算量有所增大。

但由于此方法仅考虑四个直接邻点灰度值的影响,而未考虑到各邻点间灰度值变化率的影响,因此具有低通滤波器的性质,使缩放后图像的高频分量受到损失,图像的轮廓变得较模糊。

用此方法缩放后的图像与原图像相比,仍然存在由于计算模型考虑不周而产生的图像质量退化与精度降低的问题。

(3)立方卷积法作为对双线性内插法的改进,即“不仅考虑到四个直接邻点灰度值的影响,还考虑到各邻点间灰度值变化率的影响”,立方卷积法利用了待采样点周围更大邻域内像素的灰度值作三次插值。

此法利用了如图3所示的三次多项式S(w)。

y )为f (x, y) =A • B • C(3)S (1+u)S 5S U-v)C-1 (1-*T~GT厂BR2)厂R-----1r----/>/ct»7)IJ-I;i(田"1----- T ------ T------ '—1 i—I~1 (/+2J+2)f-S (w)的数学表达式为:I —2 w p ui 11I xv |V 1S<w) .4- 8 | w | + 5 | w P T w 1」I Cl w |C 2 0 I u. |>2式中,w为自变量,S (w)为三次多项式的值。

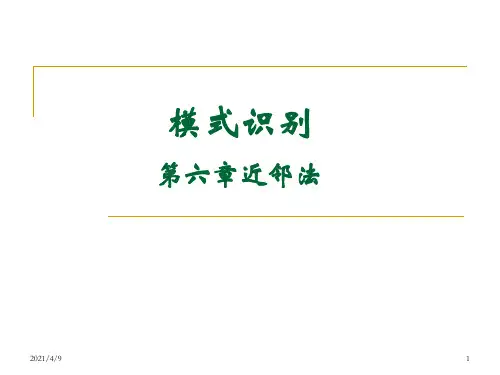

k-近邻域密度法是一种非参数的机器学习方法,主要用于分类和回归任务。

该方法基于数据点之间的距离或相似性来划分数据集,并根据每个数据点的k个最近邻域的类别或值进行预测。

具体来说,该方法会根据输入数据点,在训练数据集中找到k个最近邻域,并基于这些邻居的类别或值进行预测。

在密度法中,密度是一个关键概念,它描述了数据点在空间中的分布情况。

密度估计是一种非参数化的方法,它假设未知的真实分布可以用概率密度函数来表示。

这种方法不需要预先设定概率分布的具体形式,而是通过样本数据来估计密度函数。

k-近邻域密度法在分类任务中通常采用投票机制,即根据k个最近邻的类别数量进行预测。

在回归任务中,则可以采用平均值、中位数等统计方法来预测输出值。

值得注意的是,k-近邻域密度法的性能取决于k值的选择和距离度量的准确性。

选择合适的k值和距离度量方法对于分类和回归任务的准确性和稳定性至关重要。

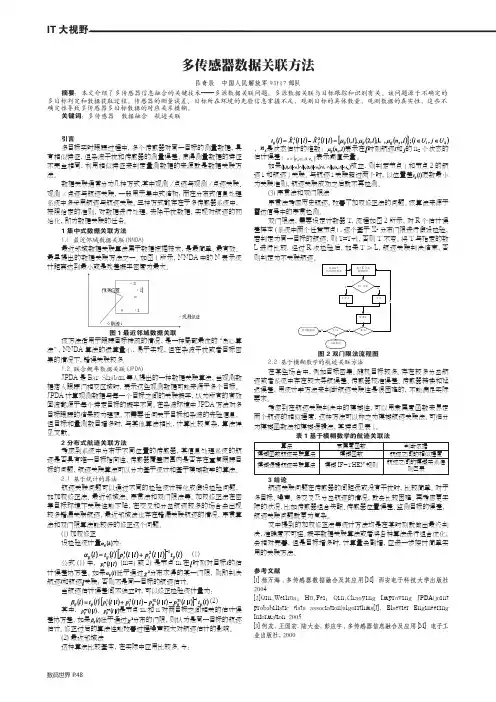

IT大视野数码世界 P.48多传感器数据关联方法吕奇辰 中国人民解放军93117部队摘要:本文介绍了多传感器信息融合的关键技术——多源数据关联问题。

多源数据关联与目标跟踪和识别有关。

该问题源于不确定的多目标判定和数据获取过程。

传感器的测量误差、目标所在环境的先验信息掌握不足,观测目标的具体数量,观测数据的真实性,这些不确定性导致多传感器多目标数据的对应关系模糊。

关键词:多传感器 数据融合 航迹关联引言多目标实时跟踪过程中,多个传感器对同一目标的测量数据,具有相似特征,但杂波干扰和传感器的测量误差,使得测量数据的特征不完全相同,利用相似特征来判定量测数据的来源就是数据关联方法。

数据关联通常分为几种方式,其中观测/点迹与观测/点迹关联、观测/点迹与航迹关联,一般用于集中式结构;而在分布式信息处理系统中多采用航迹与航迹关联。

三种方式都存在于多传感器系统中,按照给定的准则,对数据进行处理,去除干扰数据,实现对航迹的初始化,即为数据关联的任务。

1 集中式数据关联方法1.1 最近邻域数据关联(NNDA)最近邻域数据关联算法属于数据挖掘技术,是最简单、最有效、最早提出的数据关联方法之一。

如图1所示,NNDA中的N表示统计距离达到最小或是残差概率密度为最大。

图1最近邻域数据关联该方法适用于跟踪目标稀疏的情况,是一种局部最优的“贪心算法”,NNDA算法的运算量小,易于实现,但在杂波干扰或者目标密集的情况下,错误关联较多。

1.2 联合概率数据关联(JPDA)JPDA是Bar Shalom等人提出的一种数据关联算法,当观测数据落入跟踪门相交区域时,表示这些观测数据可能来源于多个目标。

JPDA计算观测数据与每一个目标之间的关联概率,认为所有的有效回波都源于每个特定目标的概率不同。

在杂波环境中JPDA方法对多目标跟踪的结果较为理想,不需要任何关于目标和杂波的先验信息,但目标和量测数目增多时,与其他算法相比,计算比较复杂,算法详见文献。

监督分类中常用的具体分类法包括:最小距离分类法(minimum distance classifier):最小距离分类法是用特征空间中的距离作为像元分类依据的。

最小距离分类包括最小距离判别法和最近邻域分类法。

最小距离判别法要求对遥感图像中每一个类别选一个具有代表意义的统计特征量(均值),首先计算待分象元与已知类别之间的距离,然后将其归属于距离最小的一类。

最近邻域分类法是上述法在多波段遥感图像分类的推广。

在多波段遥感图像分类中,每一类别具有多个统计特征量。

最近邻域分类法首先计算待分象元到每一类中每一个统计特征量间的距离,这样,该象元到每一类都有几个距离值,取其中最小的一个距离作为该象元到该类别的距离,最后比较该待分象元到所有类别间的距离,将其归属于距离最小的一类。

最小距离分类法原理简单,分类精度不高,但计算速度快,它可以在快速浏览分类概况中使用。

多级切割分类法(multi-level slice classifier):是根据设定在各轴上值域分割多维特征空间的分类法。

通过分割得到的多维长体对应各分类类别。

经过反复对定义的这些长体的值域进行外判断而完成各象元的分类。

这种法要求通过选取训练区详细了解分类类别(总体)的特征,并以较高的精度设定每个分类类别的光谱特征上限值和下限值,以便构成特征子空间。

多级切割分类法要求训练区样本选择必须覆盖所有的类型,在分类过程中,需要利用待分类像元光谱特征值与各个类别特征子空间在每一维上的值域进行外判断,检查其落入哪个类别特征子空间中,直到完成各像元的分类。

多级分割法分类便于直观理解如分割特征空间,以及待分类像元如与分类类别相对应。

由于分类中不需要复杂的计算,与其它监督分类法比较,具有速度快的特点。

但多级分割法要求分割面总是与各特征轴正交,如果各类别在特征空间中呈现倾斜分布,就会产生分类误差。

因此运用多级分割法分类前,需要先进行主成分分析,或采用其它法对各轴进行相互独立的正交变换,然后进行多级分割。

基于邻域的算法基于邻域的算法是一种常用的数据挖掘和机器学习方法,它主要是基于某个样本的邻居来推断该样本的特征或标签。

在实际应用中,基于邻域的算法被广泛应用于分类、聚类、推荐系统等领域。

基于邻域的算法有很多种,其中最常见的包括k最近邻算法、均值漂移算法和DBSCAN算法等。

下面将分别介绍这几种算法的原理和应用。

1. k最近邻算法(k-Nearest Neighbor,简称kNN)是最简单、最常用的基于邻域的算法之一。

其基本原理是通过计算待分类样本与训练集中各个样本之间的距离,找出距离最近的k个邻居,然后根据这k个邻居的标签来预测待分类样本的标签。

kNN算法适用于多分类和二分类问题,且对样本的分布情况没有太高要求。

2. 均值漂移算法(Mean Shift)是一种基于邻域密度的密度估计方法。

其原理是通过计算样本点周围邻域内点的密度分布情况,将样本点向密度高的方向移动,直到达到局部最大密度。

均值漂移算法的应用比较广泛,包括图像分割、无监督聚类等。

3. DBSCAN算法(Density-Based Spatial Clustering of Applications with Noise)是一种基于密度的聚类算法,可以自动发现具有各种形状的聚类,并能够将孤立点(噪声)排除在外。

该算法的核心是通过计算样本点周围邻域内的密度,并通过设置一定的密度阈值和最小样本数来划分聚类。

DBSCAN算法广泛应用于图像分割、异常检测等领域。

基于邻域的算法有以下几个特点:1. 算法简单易于实现:基于邻域的算法通常基于简单的原理,易于理解和实现,不需要太多的数学基础。

2. 高效处理大规模数据:由于基于邻域的算法主要关注于局部信息,而不需要全局计算,因此适用于处理大规模数据。

3. 对数据分布要求较低:基于邻域的算法对数据的分布情况没有太高要求,可以处理各种形状和密度的数据。

在实际应用中,基于邻域的算法被广泛应用于各个领域。

例如,在推荐系统中,可以利用基于邻域的算法来为用户推荐相似的商品或用户;在文本分类中,可以利用kNN算法来根据文本的内容将其分类至相应的类别;在图像处理中,可以利用均值漂移算法来实现图像分割等。

图像拉伸算法一快速拉伸但是逆向映射法同样会出现映射到源图像坐标时不是整数的问题。

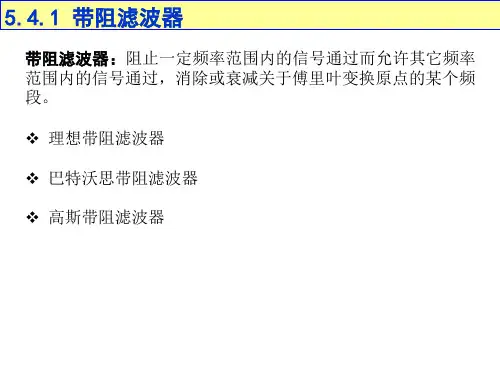

这里就需要"重采样滤波器"。

这个术语看起来很专业,其实不过是因为它借用了电子信号处理中的惯用说法(在大多数情况下,它的功能类似于电子信号处理中的带通滤波器),理解起来也不复杂,就是如何确定这个非整数坐标处的点应该是什么颜色的问题。

前面说到的三种方法:最近邻域法,线性插值法和三次样条法都是所谓的"重采样滤波器"。

所谓"最近邻域法"就是把这个非整数坐标作一个四舍五入,取最近的整数点坐标处的点的颜色。

而"线性插值法"就是根据周围最接近的几个点(对于平面图像来说,共有四点)的颜色作线性插值计算(对于平面图像来说就是二维线性插值)来估计这点的颜色,在大多数情况下,它的准确度要高于最近邻域法,当然效果也要好得多,最明显的就是在放大时,图像边缘的锯齿比最近邻域法小非常多。

当然它同时还带业个问题:就是图像会显得比较柔和。

这个滤波器用专业术语来说(呵呵,卖弄一下偶的专业^_^)叫做:带阻性能好,但有带通损失,通带曲线的矩形系数不高。

至于三次样条法我就不说了,复杂了一点,可自行参考数字图像处理方面的专业书籍,如本文的参考文献。

再来讨论一下坐标变换的算法。

简单的空间变换可以用一个变换矩阵来表示:[x',y',w']=[u,v,w]*T其中:x',y'为目标图像坐标,u,v为源图像坐标,w,w'称为齐次坐标,通常设为1,T为一个3X3的变换矩阵。

这种表示方法虽然很数学化,但是用这种形式可以很方便地表示多种不同的变换,如平移,旋转,缩放等。

对于缩放来说,相当于:[Su00][x,y,1]=[u,v,1]*|0Sv0|[001]其中Su,Sv分别是X轴方向和Y轴方向上的缩放率,大于1时放大,大于0小于1时缩小,小于0时反转。

点云法向量公式

点云法向量(Normal)是三维空间中一个非常重要的概念,它描述了一个点或一个平面的方向信息。

在计算机视觉、计算

机图形学以及三维重建等领域中,点云法向量的计算是常见的

任务之一。

下面我将介绍一种常用的方法——最近邻法(NearestNeighbor)来计算点云的法向量。

最近邻法是一种基于点云中点之间的几何关系来计算法向量

的方法。

具体的计算步骤如下:

1.对于点云中的每一个点P,选择一个半径r内的邻域集合

N(P)。

这个邻域集合可以通过欧氏距离或者kd树等算法来获取。

选择合适的邻域半径r很关键,过小的r会导致法向量的

噪声增加,而过大的r会导致法向量的模糊性增加。

2.对于邻域集合N(P)中的每一个点Q,计算P和Q之间的

向量V=QP。

3.将所有的向量V进行平均,得到平均向量M。

4.对平均向量M进行归一化,得到最终的法向量。

这种最近邻法计算法向量的方法简单直接,可以广泛地应用

于各种点云数据。

然而,它也存在一些问题,比如计算效率低、对邻域半径敏感等。

因此,在实际应用中,还有其他更加高效

和精确的方法可以使用,比如曲面拟合法、迭代最近点法等。

通过点云法向量的计算,我们可以获得点云表面的几何结构信息,进而可以进行点云的形状分析、特征提取、物体识别等任务。

点云法向量在三维重建、三维场景理解以及机器人视觉等领域都有广泛的应用。

2002年3月 陕 西 工 学 院 学 报Mar.2002第18卷第1期 Journal of Shaanxi Institute of Technology Vol.18 No.1[文章编号]1002-3410(2002)01-0030-03一种高效的插值算法黄 文(湖南省零陵师范专科学校计算机系,湖南零陵 425006)[摘 要] 通过对一般图像及传统插值算法的分析讨论,提出了高低阶结合的插值算法。

从而有条件地解决了运算量与插值质量之间的根本矛盾。

[关 键 词] 插值; 算法; 图像; 颜色[中图分类号] TP311 [文献标识码] A收稿日期:2001-11-07 作者简介:黄文(1967-),男,湖南人,零陵师范专科学校讲师,主要研究方向为网络多媒体。

在计算机图形图像处理中,很少有不用到插值的;因此插值算法成为数字图像处理中不可回避的课题。

目前,插值算法的方法种类繁多,比较传统的有:点位移算法、线性插值算法、三次样条插值算法、加窗Sinc 函数插值算法等。

一般说来,高阶算法具有较小的误差,在图像处理时会产生较小的失真;但同时也有着较大的运算量,这种算法的开销有时甚至是惊人的。

本文将讨论如何将高阶算法与低阶算法相结合,以接近低阶算法的运算开销,获得高阶算法的插值质量。

1 背景知识插值是确定某个函数在两个采样点之间的数值时采用的运算过程。

插值通常是利用曲线拟合的方法,通过离散的输入采样点建立一个连续函数,用这个重建的函数求出任意位置处的函数值。

这个过程可以看作是采样的逆过程。

插值在图像处理中的应用几乎是无处不在;比如图像放大,若不采用内插值则会出现空洞,致使图像严重失真。

对于等间隔采样数据,插值可以表示为:f (x )=∑C k h (x -x k )(1) 其中h 为插值核,C k 为权系数,卷积对k 个数据作处理。

在实际应用中,h 总是对称的,即有h (x )=h (-x ),C k 即为采样值。

k最近邻域法

K最近邻域法(K-Nearest Neighbor,KNN)是一种基于统计的分类方法,也是最简单的机器学习算法之一。

它的核心思想是:如果一个样本在特征空间中的k个最相似(即特征空间中最邻近)的样本中的大多数属于某一个类别,则该样本也属于这个类别。

KNN算法可以用官方的话来描述,即给定一个训练数据集,对新的输入实例,在训练数据集中找到与该实例最邻近的K个实例(也就是上面所说的K个邻居),这K个实例的多数属于某个类,就把该输入实例分类到这个类中。

由于KNN方法主要靠周围有限的邻近的样本,而不是靠判别类域的方法来确定所属类别的,因此对于类域的交叉或重叠较多的待分样本集来说,KNN方法较其他方法更为适合。

以上内容仅供参考,建议查阅关于K最近邻域法的书籍或文献获取更专业的信息。