§4.3多重共线性

- 格式:ppt

- 大小:343.50 KB

- 文档页数:35

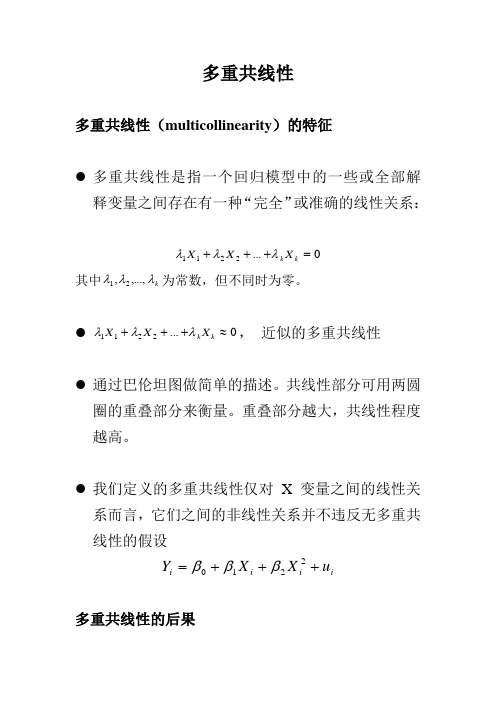

多重共线性多重共线性(multicollinearity )的特征● 多重共线性是指一个回归模型中的一些或全部解释变量之间存在有一种“完全”或准确的线性关系:0...2211=+++k k X X X λλλ其中k λλλ,...,,21为常数,但不同时为零。

● 0...2211≈+++k k X X X λλλ, 近似的多重共线性● 通过巴伦坦图做简单的描述。

共线性部分可用两圆圈的重叠部分来衡量。

重叠部分越大,共线性程度越高。

● 我们定义的多重共线性仅对X 变量之间的线性关系而言,它们之间的非线性关系并不违反无多重共线性的假设i i i i u X X Y +++=2210βββ多重共线性的后果●如果多重共线性是完全的,诸X变量的回归系数将是不正确的,并且它们的标准误差为无穷大●如果多重共线性是不完全的,那末,虽然回归系数可以确定,却有较大的标准误差,意思是,系数不能以很高的精确或准精确加以估计,这会导致:-参数估计不精确,也不稳定-参数估计量的标准差较大,影响系数的显著性检验●多重共线性产生的后果具有一定的不确定性●在近似的多重共线性的情况下,只要模型满足CLRM 假定,回归系数就为BLUE,但特定的样本估计量并不一定等于真值。

多重共线性的来源(1)许多经济变量在时间上由共同变动的趋势,如:收入,投资,消费(2)把一些经济变量的滞后值也作为解释变量在模型中使用,而解释变量和滞后变量通常相关,如:消费和过去的收入多重共线性一般与时间序列有关,但在横截面数据中也经常出现多重共线性的检验● 多重共线性是普遍存在的,造成的后果也比较复杂,对多重共线性的检验缺少统一的准则- 对有两个解释变量的模型,作散点图,或相 关系数,或拟和优度R平方。

- 对有多个解释变量的模型,分别用一个解释 变量对其它解释变量进行线性回归,计算拟 和优度22221,...,,k R R R- 考察参数估计值的符号,符不符合理论 - 增加或减少解释变量,考察参数估计值的变 化- 对比拟和优度和t检验值多重共线性的修正方法● 增加样本观测值,如果多重共线性是由样本引起的,可以通过收集更多的观测值增加样本容量。

计量经济学课程教案第四章 多重共线性§ 什么是多重共线性 一、多重共线性的概念 对于模型Y i =1+2X 2i +3X 3i++k X ki+ii=1,2,…,n其基本假设之一是解释变量是互相独立的。

如果存在c 1X 1i +c 2X 2i +…+c k X ki =0 i=1,2,…,n其中: c i 不全为0,则称为解释变量间存在完全共线性(perfectmulticollinearity )。

在矩阵表示的线性回归模型 Y=X+中,完全共线性指:秩(X)<k+1,即⎪⎪⎪⎪⎪⎭⎫⎝⎛=kn nn k k X X XX X X X X X X 212221212111111二、实际经济问题中的多重共线性一般地,产生多重共线性的主要原因有以下三个方面: (1)经济变量相关的共同趋势时间序列样本:经济繁荣时期,各基本经济变量(收入、消费、投资、价格)都趋于增长;衰退时期,又同时趋于下降。

横截面数据:生产函数中,资本投入与劳动力投入往往出现高度相关情况,大企业二者都大,小企业都小。

(2)滞后变量的引入在经济计量模型中,往往需要引入滞后经济变量来反映真实的经济关系。

例如,消费=f(当期收入, 前期收入) 显然,两期收入间有较强的线性相关性。

(3)样本资料的限制由于完全符合理论模型所要求的样本数据较难收集,特定样本可能存在某种程度的多重共线性。

一般经验:时间序列数据样本:简单线性模型,往往存在多重共线性。

截面数据样本:问题不那么严重,但多重共线性仍然是存在的。

§ 多重共线性产生的后果一、完全共线性下参数估计量不存在μX βY +=的OLS 估计量为:Y X X X β''=-1)(ˆ如果存在完全共线性,则(X’X)-1不存在,无法得到参数的估计量。

二、近似共线性下OLS 估计量非有效 近似共线性下,可以得到OLS 参数估计量, 但参数估计量方差的表达式为12)()ˆ(-'=X X βσCov由于|X’X|0,引起(X’X)-1主对角线元素较大,使参数估计值的方差增大,OLS参数估计量非有效。

什么是多重共线性如何进行多重共线性的检验多重共线性是指在统计模型中,独立变量之间存在高度相关性或者线性依赖关系,从而给模型的解释和结果带来不确定性。

在回归分析中,多重共线性可能导致系数估计不准确、标准误差过大、模型的解释变得复杂等问题。

因此,对于多重共线性的检验和处理是非常重要的。

一、多重共线性的检验多重共线性的检验可以通过以下几种方式进行:1. 相关系数矩阵:可以通过计算独立变量之间的相关系数,判断它们之间的关系强度。

当相关系数超过0.8或-0.8时,可以视为存在高度相关性,即可能存在多重共线性问题。

2. 方差扩大因子(VIF):VIF是用来检验自变量之间是否存在共线性的指标。

计算每一个自变量的VIF值,当VIF值大于10或者更高时,可以视为存在多重共线性。

3. 条件数(Condition index):条件数也是一种用来检验多重共线性的指标。

它度量了回归矩阵的奇异性或者相对不稳定性。

当条件数超过30时,可以视为存在多重共线性。

4. 特征值(Eigenvalues):通过计算特征值,可以判断回归矩阵的奇异性。

如果存在特征值接近于零的情况,可能存在多重共线性。

以上是常用的多重共线性检验方法,可以根据实际情况选择合适的方法进行检验。

二、多重共线性的处理在检测到存在多重共线性问题后,可以采取以下几种方式进行处理:1. 去除相关性强的变量:在存在高度相关变量的情况下,可以选择去除其中一个或多个相关性较强的变量。

2. 聚合相关变量:将相关性强的变量进行加权平均,得到一个新的变量来替代原来的变量。

3. 主成分分析(PCA):主成分分析是一种降维技术,可以将相关性强的多个变量合并成为一个或多个无关的主成分。

4. 岭回归(Ridge Regression):岭回归是一种缓解多重共线性的方法,通过加入一个正则化项,来使得共线性变量的系数估计更加稳定。

5. Lasso回归(Lasso Regression):Lasso回归也是一种缓解多重共线性的方法,通过对系数进行稀疏化,来选择重要的变量。