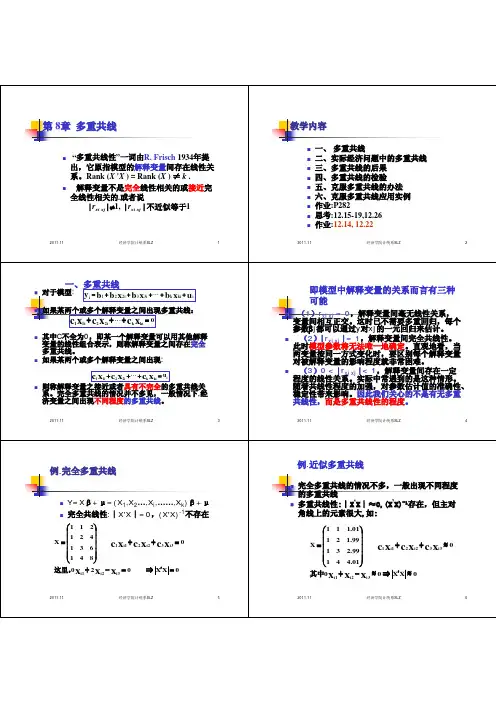

8多重共线性 问题

- 格式:ppt

- 大小:853.50 KB

- 文档页数:43

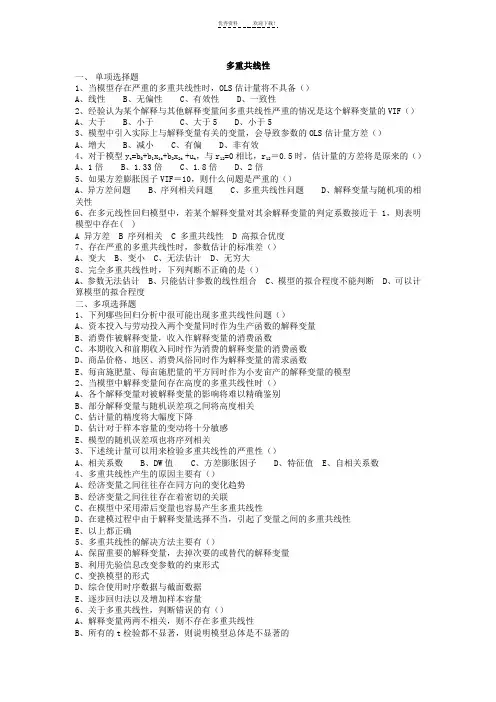

多重共线性一、单项选择题1、当模型存在严重的多重共线性时,OLS估计量将不具备()A、线性B、无偏性C、有效性D、一致性2、经验认为某个解释与其他解释变量间多重共线性严重的情况是这个解释变量的VIF()A、大于B、小于C、大于5D、小于53、模型中引入实际上与解释变量有关的变量,会导致参数的OLS估计量方差()A、增大B、减小C、有偏D、非有效4、对于模型y t=b0+b1x1t+b2x2t+u t,与r12=0相比,r12=0.5时,估计量的方差将是原来的()A、1倍B、1.33倍C、1.8倍D、2倍5、如果方差膨胀因子VIF=10,则什么问题是严重的()A、异方差问题B、序列相关问题C、多重共线性问题D、解释变量与随机项的相关性6、在多元线性回归模型中,若某个解释变量对其余解释变量的判定系数接近于1,则表明模型中存在( )A 异方差B 序列相关C 多重共线性D 高拟合优度7、存在严重的多重共线性时,参数估计的标准差()A、变大B、变小C、无法估计D、无穷大8、完全多重共线性时,下列判断不正确的是()A、参数无法估计B、只能估计参数的线性组合C、模型的拟合程度不能判断D、可以计算模型的拟合程度二、多项选择题1、下列哪些回归分析中很可能出现多重共线性问题()A、资本投入与劳动投入两个变量同时作为生产函数的解释变量B、消费作被解释变量,收入作解释变量的消费函数C、本期收入和前期收入同时作为消费的解释变量的消费函数D、商品价格、地区、消费风俗同时作为解释变量的需求函数E、每亩施肥量、每亩施肥量的平方同时作为小麦亩产的解释变量的模型2、当模型中解释变量间存在高度的多重共线性时()A、各个解释变量对被解释变量的影响将难以精确鉴别B、部分解释变量与随机误差项之间将高度相关C、估计量的精度将大幅度下降D、估计对于样本容量的变动将十分敏感E、模型的随机误差项也将序列相关3、下述统计量可以用来检验多重共线性的严重性()A、相关系数B、DW值C、方差膨胀因子D、特征值E、自相关系数4、多重共线性产生的原因主要有()A、经济变量之间往往存在同方向的变化趋势B、经济变量之间往往存在着密切的关联C、在模型中采用滞后变量也容易产生多重共线性D、在建模过程中由于解释变量选择不当,引起了变量之间的多重共线性E、以上都正确5、多重共线性的解决方法主要有()A、保留重要的解释变量,去掉次要的或替代的解释变量B、利用先验信息改变参数的约束形式C、变换模型的形式D、综合使用时序数据与截面数据E、逐步回归法以及增加样本容量6、关于多重共线性,判断错误的有()A、解释变量两两不相关,则不存在多重共线性B、所有的t检验都不显著,则说明模型总体是不显著的C、有多重共线性的计量经济模型没有应用的意义D、存在严重的多重共线性的模型不能用于结构分析7、模型存在完全多重共线性时,下列判断正确的是()A、参数无法估计B、只能估计参数的线性组合C、模型的判定系数为0D、模型的判定系数为1三、简述1、什么是多重共线性?产生多重共线性的原因是什么?2、什么是完全多重共线性?什么是不完全多重共线性?3、完全多重共线性对OLS估计量的影响有哪些?4、不完全多重共线性对OLS估计量的影响有哪些?5、从哪些症状中可以判断可能存在多重共线性?6、什么是方差膨胀因子检验法?四、判断(1)如果简单相关系数检测法证明多元回归模型的解释变量两两不相关,则可以判断解释变量间不存在多重共线性。

回归分析是统计学中常用的一种分析方法,它用于研究一个或多个自变量与一个因变量之间的关系。

然而,在进行回归分析时,经常会面临一个多重共线性的问题。

多重共线性是指在回归模型中,自变量之间存在高度相关性的情况。

当自变量之间存在多重共线性时,就会导致回归系数估计不准确,增加了回归模型的不稳定性。

这对于研究者来说是一个很大的困扰,因为他们很难判断自变量之间到底是有关系还是无关系,从而无法准确地分析自变量对因变量的影响。

多重共线性问题的存在会使得回归系数的估计值变得不稳定,回归系数的符号可能会与理论上相悖,使得回归模型的解释性大大降低。

同时,多重共线性还会增加回归系数的标准误差,导致对回归系数的假设检验结果不可信。

那么,如何解决多重共线性问题呢?首先,我们可以通过计算自变量之间的相关系数来判断是否存在多重共线性。

如果自变量之间的相关系数较高,就需要考虑采取一些措施来解决多重共线性问题。

一种解决方法是通过方差膨胀因子(VIF)来检验多重共线性。

VIF是用来判断自变量之间存在多重共线性的一个指标,通常VIF大于10就表示存在多重共线性。

其次,我们可以采取一些方法来解决多重共线性问题。

一种解决方法是通过主成分分析(PCA)来降维。

主成分分析是一种常用的降维方法,它可以将原始的自变量通过线性变换转换为一组新的主成分,从而减少自变量之间的相关性。

通过主成分分析,可以将原始的自变量转换为一组新的主成分,从而减少自变量之间的相关性,解决多重共线性问题。

另一种解决多重共线性问题的方法是通过岭回归(Ridge Regression)。

岭回归是一种常用的回归分析方法,它通过对回归系数进行惩罚,可以减少自变量之间的相关性,从而解决多重共线性问题。

通过岭回归,可以对自变量的回归系数进行缩减,从而减少多重共线性对回归系数估计的影响。

此外,我们还可以通过逐步回归法(Stepwise Regression)来解决多重共线性问题。

逐步回归法是一种常用的变量选择方法,它可以通过逐步添加或删除自变量来选择最优的回归模型。

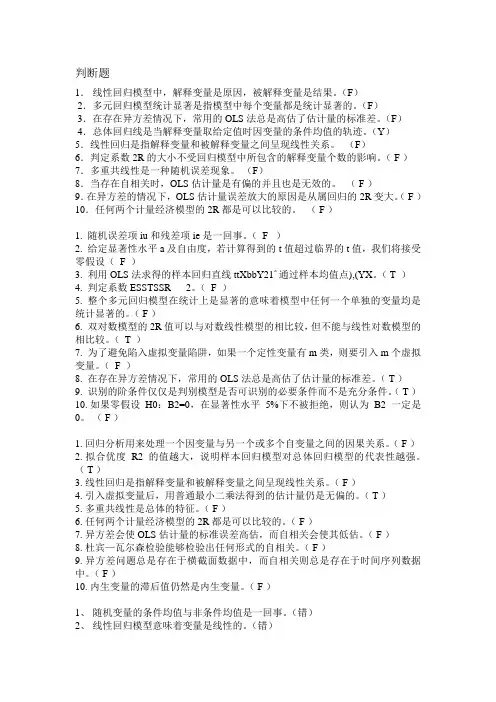

判断题1.线性回归模型中,解释变量是原因,被解释变量是结果。

(F)2.多元回归模型统计显著是指模型中每个变量都是统计显著的。

(F)3.在存在异方差情况下,常用的OLS法总是高估了估计量的标准差。

(F)4.总体回归线是当解释变量取给定值时因变量的条件均值的轨迹。

(Y)5.线性回归是指解释变量和被解释变量之间呈现线性关系。

(F)6.判定系数2R的大小不受回归模型中所包含的解释变量个数的影响。

( F )7.多重共线性是一种随机误差现象。

(F)8.当存在自相关时,OLS估计量是有偏的并且也是无效的。

( F )9.在异方差的情况下, OLS估计量误差放大的原因是从属回归的2R变大。

( F )10.任何两个计量经济模型的2R都是可以比较的。

( F )1. 随机误差项iu和残差项ie是一回事。

( F )2. 给定显著性水平a及自由度,若计算得到的t值超过临界的t值,我们将接受零假设( F )3. 利用OLS法求得的样本回归直线ttXbbY21ˆ通过样本均值点),(YX。

( T )4. 判定系数ESSTSSR2。

( F )5. 整个多元回归模型在统计上是显著的意味着模型中任何一个单独的变量均是统计显著的。

( F )6. 双对数模型的2R值可以与对数线性模型的相比较,但不能与线性对数模型的相比较。

( T )7. 为了避免陷入虚拟变量陷阱,如果一个定性变量有m类,则要引入m个虚拟变量。

( F )8. 在存在异方差情况下,常用的OLS法总是高估了估计量的标准差。

( T )9. 识别的阶条件仅仅是判别模型是否可识别的必要条件而不是充分条件。

( T )10. 如果零假设H0:B2=0,在显著性水平5%下不被拒绝,则认为B2一定是0。

( F )1. 回归分析用来处理一个因变量与另一个或多个自变量之间的因果关系。

( F )2. 拟合优度R2的值越大,说明样本回归模型对总体回归模型的代表性越强。

( T )3. 线性回归是指解释变量和被解释变量之间呈现线性关系。

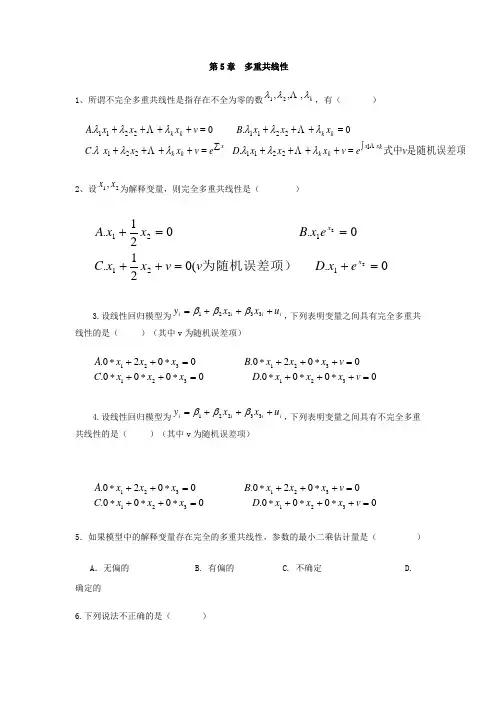

第5章 多重共线性1、所谓不完全多重共线性是指存在不全为零的数kλλλ,,,21 ,有( )是随机误差项式中v e v x x x .D e v x x x .C x x x .B v x x x .A k x x k k xk k k k k k ⎰∑=++++=++++=+++=++++ 122112212211221100λλλλλλλλλλλλ2、设21,x x 为解释变量,则完全多重共线性是( ).(021.0.021.22121121=+=++==+x x ex D v v x x C ex B x x A 为随机误差项)3.设线性回归模型为ii i i u x x y +++=33221βββ,下列表明变量之间具有完全多重共线性的是( )(其中v 为随机误差项)000.0000.0020.0020.321321321321=+*+*+*=*+*+*=+*++*=*++*v x x x D x x x C v x x x B x x x A4.设线性回归模型为ii i i u x x y +++=33221βββ,下列表明变量之间具有不完全多重共线性的是( )(其中v 为随机误差项)000.0000.0020.0020.321321321321=+*+*+*=*+*+*=+*++*=*++*v x x x D x x x C v x x x B x x x A5.如果模型中的解释变量存在完全的多重共线性,参数的最小二乘估计量是( )A .无偏的 B. 有偏的 C. 不确定 D. 确定的 6.下列说法不正确的是( )A.多重共线性产生的原因有模型中大量采用滞后变量B.多重共线性是样本现象C.检验多重共线性的方法有DW 检验法D.修正多重共线性的方法有增加样本容量7.在线性回归模型中,若解释变量1x 和2x 的观测值成比例,即有i2i 1kxx =,其中k 为非零常数,则表明模型中存在( )A. 异方差B. 多重共线性C. 序列自相关D. 设定误差 8.多重共线性是一种( )A .样本现象 B.随机误差现象 C .被解释变量现象 D.总体现象 9.逐步回归法既检验又修正了( )A .异方差性 B.自相关性 C .随机解释变量 D.多重共线性 二、多项选择1、设线性回归模型为ii i i u x x y +++=33221βββ,下列表明变量之间具有多重共线性的是( )(其中v 为随机误差项)31.031.0000.0000.0020.0020.3232321321321321=++=+=+*+*+*=*+*+*=+*++*=*++*v x x F x x E v x x x D x x x C v x x x B x x x A2.下列说法正确的是( )A. 多重共线性分为完全和不完全B. 多重共线性是一种样本现象C. 在共线性程度不严重的时候可进行预测分析D. 多重共线性的存在是难以避免的 3.能够检验多重共线性的方法有( )A.简单相关系数矩阵法B. DW 检验法C. 逐步回归法D.ARCH 检验法E.辅助回归法(又待定系数法)F. t 检验与F 检验综合判断法 4.能够修正多重共线性的方法有( )A.增加样本容量B. 数据的结合C.变换模型的函数形式D.逐步回归法E.差分模型 三、判断(见习题集)四、计算分析:在研究生产函数时,得到如下两个模型估计式:(1)LnL LnK Q Ln 893.0887.004.5ˆ++-=se=(1.40)(0.087)(0.137)21,878.02==n R(2)LnL LnK t QLn 285.1460.00272.057.8ˆ+++-=se=(2.99)(0.0204)(0.333)(0.324)21,889.02==n R其中,Q=产量,K=资本,L=劳动时间(技术指标),n=样本容量。

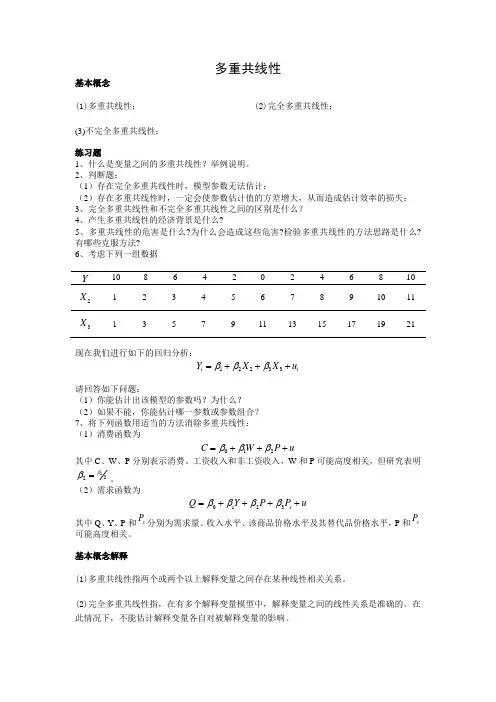

多重共线性基本概念(1)多重共线性; (2)完全多重共线性;(3)不完全多重共线性;练习题1、什么是变量之间的多重共线性?举例说明。

2、判断题:(1)存在完全多重共线性时,模型参数无法估计;(2)存在多重共线性时,一定会使参数估计值的方差增大,从而造成估计效率的损失; 3、完全多重共线性和不完全多重共线性之间的区别是什么? 4、产生多重共线性的经济背景是什么?5、多重共线性的危害是什么?为什么会造成这些危害?检验多重共线性的方法思路是什么?有哪些克服方法?6、考虑下列一组数据Y-10 -8 -6 -4 -2 0 2 4 6 8 10 2X 1 2 3 4 5 6 7 8 9 10 11 3X13579111315171921现在我们进行如下的回归分析:12233i i Y X X u βββ=+++请回答如下问题:(1)你能估计出该模型的参数吗?为什么? (2)如果不能,你能估计哪一参数或参数组合? 7、将下列函数用适当的方法消除多重共线性: (1)消费函数为012C W P u βββ=+++其中C 、W 、P 分别表示消费、工资收入和非工资收入,W 和P 可能高度相关,但研究表明122ββ=。

(2)需求函数为0123s Q Y P P u ββββ=++++其中Q 、Y 、P 和s P 分别为需求量、收入水平、该商品价格水平及其替代品价格水平,P 和s P可能高度相关。

基本概念解释(1)多重共线性指两个或两个以上解释变量之间存在某种线性相关关系。

(2)完全多重共线性指,在有多个解释变量模型中,解释变量之间的线性关系是准确的。

在此情况下,不能估计解释变量各自对被解释变量的影响。

(3)不完全多重共线性指,在实际经济活动中,多个解释变量之间存在多重共线性问题,但解释变量之间的线性关系是近似的,而不是完全的。

练习题答案1、如果在经典回归模型Y X U β=+中,如果基本假定6遭到破坏,则有()1k r x k <+,此时称解释变量之间存在完全多重共线性。

多重共线性解决方法

多重共线性是指在回归模型中,自变量之间存在高度相关性的情况,这会导致模型的解释能力下降,系数估计不准确,模型的稳定性受到影响。

以下是一些解决多重共线性问题的方法:

1.增加样本量:通过增加样本量可以减少模型中的抽样误差,从而减轻多重共线性的影响。

2.删除冗余变量:通过剔除高度相关的自变量,可以降低共线性的程度。

可以使用相关性矩阵或者变量膨胀因子(VIF)来判断哪些自变量之间存在高相关性,并选择保留一个或几个相关性较为弱的变量。

3.主成分分析(PCA):主成分分析可以将高度相关的自变量转换成一组无关的主成分,从而降低共线性的影响。

可以选择保留其中的几个主成分作为新的自变量,代替原始的自变量。

4.岭回归(Ridge Regression):岭回归是在普通最小二乘法的基础上加入一个正则化项,通过缩小系数估计的幅度,减少共线性对系数估计的影响。

岭回归可以通过交叉验证选择合适的正则化参数。

5.套索回归(Lasso Regression):套索回归也是在普通最小二乘法的基础上加入一个正则化项,不同的是套索回归使用L1范数作为正则化项,可以将一些系

数估计缩减为零,从而实现变量选择的效果。

6.弹性网回归(Elastic Net Regression):弹性网回归是岭回归和套索回归的结合,同时使用L1和L2范数作为正则化项,可以在预测准确性和变量选择之间进行权衡。

以上方法可以根据具体问题的特点和需求选择合适的方法来解决多重共线性问题。

计量经济学习题四一、单选题1、容易产生异方差的数据是( )A 、时间序列数据B 、虚变量数据C 、横截面数据D 、年度数据2、下列哪种方法不能检验异方差( )A 、哥德费尔特—夸特检验B 、怀特检验C 、戈里瑟检验D 、D-W 检验3、如果回归模型中的随机误差项存在异方差,则模型参数的OLS 估计量是( )A 、无偏、有效估计B 、无偏、非有效估计C 、有偏、有效估计D 、有偏、非有效估计4、设回归模型i i i X Y μβ+=,其中i i X Var 2)(σμ=,则β的最有效估计量为( )A 、∑∑=2ˆX XY βB 、∑∑∑∑∑--=22)(ˆX X n Y X XY n β C 、X Y =βˆ D 、∑=XY n 1ˆβ 5、当模型出现异方差现象时,估计模型参数的适当方法是( )A 、加权最小二乘法B 、工具变量法C 、广义差分法D 、使用非样本先验信息6、加权最小二乘法克服异方差的主要原理是通过赋予不同观测点以不同的权重,从而提高估计精确度,即( )A 、重视大误差的作用,轻视小误差的作用B 、重视小误差的作用,轻视大误差的作用C 、重视小误差和大误差的作用D 、轻视小误差和大误差的作用7、如果Glejser 检验表明,OLS 估计结果的残差与解释变量有显著的形式为i i i X e ε+=457.0||的相关关系,则用WLS 估计模型参数时,权数为( )A 、i XB 、21i XC 、i X 1D 、iX 1 8、假设回归模型为i i i X Y μββ++=10,其中22)(i i X Var σμ=,则用WLS 估计模型时,应将模型变为( )A 、X X X X Yμββ++=10B 、X X X Yμββ++=10C 、X X X Y μββ++=10D 、21202X X XX Y μββ++= 9、下列哪种形式的序列相关可用D.W.统计量(i ε为具有零均值,常数方差且不存在序列相关的随机变量)( )A 、t t t ερμμ+=-1B 、t t t t εμρμρμ+++=-- 2211C 、t t ρεμ=D 、 ++=-12t t t ερρεμ10、假定某企业的生产决策是由模型t t t P S μββ++=10描述的(其中S 为产量,P 为价格),又知如果该企业在t-1期生产过剩,经济人员会削减t 期的产量,由此判断上述模型存在( )A 、异方差问题B 、序列相关问题C 、多重共线性问题D 、随机解释变量问题11、给定的显著性水平,若D.W.统计量的下和上临界值分别为L d 和U d ,则当U L d W D d <<..时,可认为随机误差项( )A 、存在一阶正相关B 、存在一阶负相关C 、不存在序列相关D 、存在序列相关与否不能确定12、采用一阶差分模型克服一阶线性自相关问题适用于下列哪种情况( )A 、0≈ρB 、1≈ρC 、01<<-ρD 、10<<ρ13、根据一个样本容量为30的样本估计i i i e X Y ++=^1^0ββ后计算得到2.1..=W D ,已知在5%的显著性水平下,35.1=L d ,49.1=U d ,则认为原模型( )A 、不存在一阶序列自相关B 、不能判断是否存在一阶自相关C 、存在正的一阶自相关D 、存在负的一阶自相关14、对于原模型i i i X Y μββ++=10广义差分模型是指( )A 、)()()(1)(10t tt t t t tX f X f X X f X f Y μββ++=B 、t t t X Y μβ∆+∆=∆1 B 、t t t X Y μββ∆+∆+=∆10D 、)()()1(11101----+-+-=-t t t t t t X X Y Y ρμμρβρβρ15、用矩阵形式表示的广义最小二乘参数估计量为Y X X X B 111)(ˆ---Ω'Ω'=,此估计量为( )A 、有偏、有效的估计量B 、有偏、非有效的估计量C 、无偏、非有效的估计量D 、无偏、有效的估计量16、对于模型i i i e X Y ++=^1^0ββ,以ρ表示t e 与1-t e 之间的线性相关系数(n t ,,2,1 =),则下面明显错误的是( )A 、4.0..,8.0==W D ρB 、4.0..,8.0-=-=W D ρC 、2..,0==WD ρ D 、0..,1==W D ρ17、采用GLS 关键的一步是得到随机误差项的方差协方差矩阵Ω,这就需要对原模型μ+=XB Y 首先采用( )以求得随机误差项的近似估计值,从而构成矩阵Ω的估计量。

多重共线性名词解释多重共线性多重共线性,是指同一条曲线在不同时期反映了同一经济行为。

从外部看来,这些具有相同特征或因素的影响在不同的经济行为中是互不相关的。

但是,这些事物之间却存在着内在联系:外在表象或因素之间存在的线性关系可以用一个概念进行解释,就是说,事物在不同时期的不同影响因素是有机整体。

从更广泛的意义上说,每一个影响因素都具有相同的行为,并且,与其他影响因素有机地结合起来,构成一个统一的模式,而该模式又反过来对另一类型的影响因素产生决定性的影响。

11、地方政府支出变动; 12、总统选举(赢者通吃); 13、结构变迁,也叫结构演化; 14、创新系统; 15、全球化; 16、文化遗产。

2、现代主义的城市设计理念,将都市视为由“住宅区—商业区—工业区”三部分组成的体系。

3、城市设计必须考虑城市空间的问题,即研究如何使人们的生活活动与各种建筑要素、城市的生态环境之间保持协调和融洽,从而达到舒适、安全、健康、卫生和高效率的目的。

4、城市形象是城市的面子。

5、美国城市设计师查尔斯·罗奇(Charles Lorich)最早提出这个概念,认为当代城市不仅需要考虑功能、技术和经济的问题,而且还应考虑空间和社会层面的问题。

6、区域化导致市场分割。

7、超大城市化正在发展。

8、现代主义强调标准化、简约化和功能性,注重形式逻辑、数字技术和系统分析,因此在城市设计领域颇受推崇。

9、我国正处于城镇化快速发展阶段。

10、“城乡规划是一门为公众利益服务的艺术。

”6、区域化导致市场分割,尤其在资本积累时期。

城市边缘化现象严重。

7、目前的城市空间扩张伴随着高成本、高风险和高消耗。

8、现代主义空间追求便捷、开放和轻松。

9、城市结构理论的发展与新城市主义思潮的兴起。

10、美国城市设计师查尔斯·罗奇(Charles Lorich)最早提出这个概念,认为当代城市不仅需要考虑功能、技术和经济的问题,而且还应考虑空间和社会层面的问题。

多重共线性问题的几种解决方法在多元线性回归模型经典假设中,其重要假定之一是回归模型的解释变量之间不存在线性关系,也就是说,解释变量X1,X2,……,X k中的任何一个都不能是其他解释变量的线性组合。

如果违背这一假定,即线性回归模型中某一个解释变量与其他解释变量间存在线性关系,就称线性回归模型中存在多重共线性。

多重共线性违背了解释变量间不相关的古典假设,将给普通最小二乘法带来严重后果。

这里,我们总结了8个处理多重共线性问题的可用方法,大家在遇到多重共线性问题时可作参考:1、保留重要解释变量,去掉次要或可替代解释变量2、用相对数变量替代绝对数变量3、差分法4、逐步回归分析5、主成份分析6、偏最小二乘回归7、岭回归8、增加样本容量这次我们主要研究逐步回归分析方法是如何处理多重共线性问题的。

逐步回归分析方法的基本思想是通过相关系数r、拟合优度R2和标准误差三个方面综合判断一系列回归方程的优劣,从而得到最优回归方程。

具体方法分为两步:第一步,先将被解释变量y对每个解释变量作简单回归:对每一个回归方程进行统计检验分析(相关系数r、拟合优度R2和标准误差),并结合经济理论分析选出最优回归方程,也称为基本回归方程。

第二步,将其他解释变量逐一引入到基本回归方程中,建立一系列回归方程,根据每个新加的解释变量的标准差和复相关系数来考察其对每个回归系数的影响,一般根据如下标准进行分类判别:1.如果新引进的解释变量使R2得到提高,而其他参数回归系数在统计上和经济理论上仍然合理,则认为这个新引入的变量对回归模型是有利的,可以作为解释变量予以保留。

2.如果新引进的解释变量对R2改进不明显,对其他回归系数也没有多大影响,则不必保留在回归模型中。

3.如果新引进的解释变量不仅改变了R2,而且对其他回归系数的数值或符号具有明显影响,则认为该解释变量为不利变量,引进后会使回归模型出现多重共线性问题。

不利变量未必是多余的,如果它可能对被解释变量是不可缺少的,则不能简单舍弃,而是应研究改善模型的形式,寻找更符合实际的模型,重新进行估计。