Kinect原理及介绍

- 格式:ppt

- 大小:232.50 KB

- 文档页数:8

kinect原理

Kinect原理是基于一种称为结构光的技术。

它通过发送红外光和红外点阵投影器上的深度传感器,来感知和捕捉环境中的物体和人体的位置信息。

具体原理如下:

1. 红外点阵投影器:Kinect在其前面板上使用了一个点阵投影器,它在红外光谱范围内发射一系列红外点阵。

2. 相机:Kinect还包含一个红外摄像头,它用于观察红外点阵投影在环境上的细微变化。

3. 红外摄像头观察红外点阵:红外摄像头观察红外点阵在环境中的变化,并记录下这些变化。

4. 计算深度:通过计算红外点阵在环境中的偏移量和投影点之间的距离,Kinect可以计算出物体和人体相对于传感器的深度信息。

这样,它就可以确定物体和人体的位置。

5. RGB摄像头:Kinect还包含一个RGB摄像头,用于捕捉环境中的彩色图像。

通过结构光技术,Kinect能够实时获取环境中的深度信息和彩色图像,从而实现了对人体和物体的识别和跟踪等功能。

这使得Kinect可以被广泛应用于游戏、虚拟现实、人机交互和计算机视觉等领域。

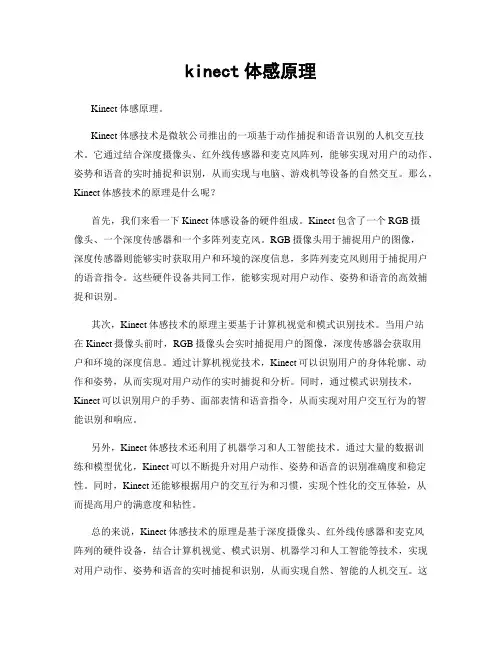

kinect体感原理Kinect体感原理。

Kinect体感技术是微软公司推出的一项基于动作捕捉和语音识别的人机交互技术。

它通过结合深度摄像头、红外线传感器和麦克风阵列,能够实现对用户的动作、姿势和语音的实时捕捉和识别,从而实现与电脑、游戏机等设备的自然交互。

那么,Kinect体感技术的原理是什么呢?首先,我们来看一下Kinect体感设备的硬件组成。

Kinect包含了一个RGB摄像头、一个深度传感器和一个多阵列麦克风。

RGB摄像头用于捕捉用户的图像,深度传感器则能够实时获取用户和环境的深度信息,多阵列麦克风则用于捕捉用户的语音指令。

这些硬件设备共同工作,能够实现对用户动作、姿势和语音的高效捕捉和识别。

其次,Kinect体感技术的原理主要基于计算机视觉和模式识别技术。

当用户站在Kinect摄像头前时,RGB摄像头会实时捕捉用户的图像,深度传感器会获取用户和环境的深度信息。

通过计算机视觉技术,Kinect可以识别用户的身体轮廓、动作和姿势,从而实现对用户动作的实时捕捉和分析。

同时,通过模式识别技术,Kinect可以识别用户的手势、面部表情和语音指令,从而实现对用户交互行为的智能识别和响应。

另外,Kinect体感技术还利用了机器学习和人工智能技术。

通过大量的数据训练和模型优化,Kinect可以不断提升对用户动作、姿势和语音的识别准确度和稳定性。

同时,Kinect还能够根据用户的交互行为和习惯,实现个性化的交互体验,从而提高用户的满意度和粘性。

总的来说,Kinect体感技术的原理是基于深度摄像头、红外线传感器和麦克风阵列的硬件设备,结合计算机视觉、模式识别、机器学习和人工智能等技术,实现对用户动作、姿势和语音的实时捕捉和识别,从而实现自然、智能的人机交互。

这项技术的问世,为电脑、游戏机等设备的交互方式带来了革命性的变化,也为人们的生活和娱乐带来了全新的体验。

Kinect体感技术的不断发展和应用,也将为人机交互领域带来更多的可能性和机遇。

kinect的工作原理

Kinect是一种利用红外线、深度感测器和摄像头的设备,用于

在游戏、虚拟现实和其他交互式应用程序中跟踪用户的动作和声音。

Kinect的工作原理是通过红外线投射、深度感测和图像

识别技术来捕捉用户的动作和声音。

首先,Kinect通过红外线投射系统发出红外线光束。

这些红外

线光束穿过房间,照射在用户身上和周围的物体上。

然后,Kinect的深度感测器接收反射光,并计算光的飞行时间来确定

距离。

它可以准确地测量每个像素的距离,从而创建一个深度图像。

同时,Kinect的摄像头捕捉用户的图像。

这些图像可以通过计

算机视觉算法来识别和跟踪用户的身体部位,如头部、手臂、腿部等。

通过分析深度图像和彩色图像之间的关系,Kinect可

以实现对用户动作的精确定位和追踪。

此外,Kinect还配备了一个麦克风阵列,用于捕捉用户的声音。

这些麦克风可以聚焦在用户的位置,过滤掉背景噪音,并提供清晰的语音输入。

最后,Kinect将捕捉到的用户数据传输到连接的设备上,如游

戏主机、电脑等。

这些设备可以根据接收到的数据来实现相应的交互和反馈,如游戏角色的移动、手势控制等。

总而言之,Kinect利用红外线、深度感测器和摄像头,通过光

线投射、深度探测和图像识别来捕捉用户的动作和声音,实现

与电子设备的交互。

它的工作原理基于先进的传感器技术,为用户提供身临其境的虚拟交互体验。

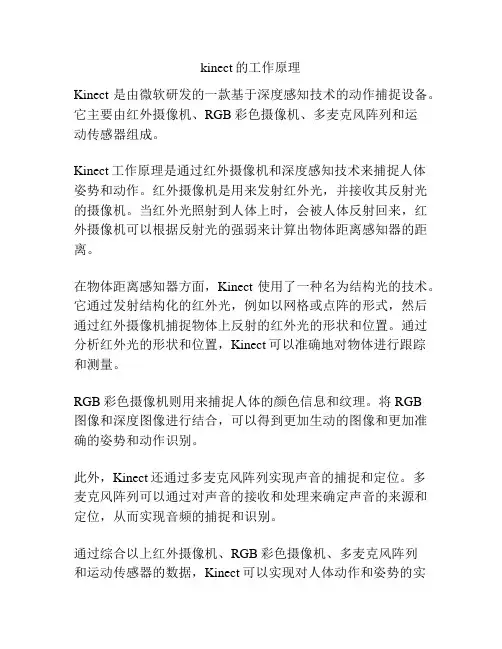

kinect的工作原理

Kinect是由微软研发的一款基于深度感知技术的动作捕捉设备。

它主要由红外摄像机、RGB彩色摄像机、多麦克风阵列和运

动传感器组成。

Kinect工作原理是通过红外摄像机和深度感知技术来捕捉人体

姿势和动作。

红外摄像机是用来发射红外光,并接收其反射光的摄像机。

当红外光照射到人体上时,会被人体反射回来,红外摄像机可以根据反射光的强弱来计算出物体距离感知器的距离。

在物体距离感知器方面,Kinect使用了一种名为结构光的技术。

它通过发射结构化的红外光,例如以网格或点阵的形式,然后通过红外摄像机捕捉物体上反射的红外光的形状和位置。

通过分析红外光的形状和位置,Kinect可以准确地对物体进行跟踪

和测量。

RGB彩色摄像机则用来捕捉人体的颜色信息和纹理。

将RGB

图像和深度图像进行结合,可以得到更加生动的图像和更加准确的姿势和动作识别。

此外,Kinect还通过多麦克风阵列实现声音的捕捉和定位。

多

麦克风阵列可以通过对声音的接收和处理来确定声音的来源和定位,从而实现音频的捕捉和识别。

通过综合以上红外摄像机、RGB彩色摄像机、多麦克风阵列

和运动传感器的数据,Kinect可以实现对人体动作和姿势的实

时捕捉和跟踪,并将其应用于虚拟现实、互动游戏和人机交互等领域。

Kinect相机是一款由微软推出的深度感知设备,最早用于游戏控制,后来也被广泛应用于计算机视觉、机器人技术、虚拟现实等领域。

它的原理是通过红外光、RGB摄像头和深度传感器的组合,实现对环境和物体的三维感知。

具体来说,Kinect相机的工作原理如下:

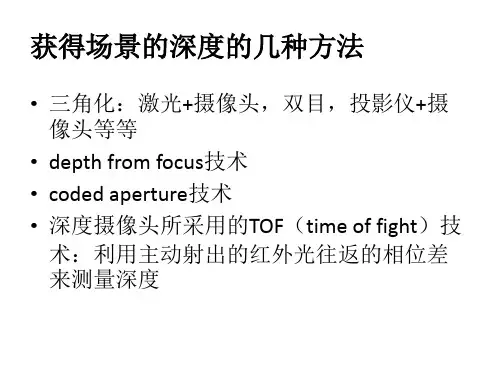

1. **红外光投影和时间飞行法(Time of Flight):** Kinect使用一个红外光发射器发射红外光束,然后通过时间飞行法测量红外光从发射到返回的时间,从而计算出物体与相机的距离。

这种技术可以实现对物体的深度感知。

2. **RGB摄像头:** Kinect相机内置了一个普通的RGB摄像头,用于捕捉场景的彩色图像。

这些图像可以与深度数据结合,实现更丰富的场景分析和虚拟现实应用。

3. **图像处理和计算:** Kinect相机内部的图像处理单元对从深度传感器和RGB摄像头获得的数据进行处理和计算,生成具有深度信息的图像,例如点云(Point Clouds)等。

4. **骨骼追踪和人体识别:** Kinect相机可以根据深度数据进行骨骼追踪和人体识别。

通过分析物体的深度图像,可以识别出人体的关节位置和姿势,从而用于游戏控制、姿势识别等应用。

总之,Kinect相机利用红外光的投影和时间飞行法,结合RGB摄像头和图像处理技术,实现了对物体和环境的深度感知。

这使得Kinect相机在计算机视觉、虚拟现实、人机交互等领域有广泛的应用潜力。

不过值得注意的是,随着时间的推移,微软已经停止了Kinect相机的生产和销售,并将重点放在其他技术领域。

kinect 工作原理

Kinect是一种类似摄像头的设备,它能够将人体的动作和声音

转化为数字信号,并通过计算机进行处理和识别。

Kinect的工

作原理主要通过以下几个组件实现:

1. 深度传感器(Depth Sensor):Kinect通过红外技术和RGB

摄像机的结合来生成深度图像。

红外光源发射红外光,然后红外摄像头捕捉反射回来的红外光,并通过红外摄像头的图像来计算物体与摄像头之间的距离。

2. RGB摄像头:Kinect内置有一台RGB彩色摄像头,用于捕

捉人体或物体的彩色图像。

RGB图像可以用于计算物体的形

状和颜色信息。

3. 声音传感器:Kinect还包含了麦克风阵列,用于捕捉周围环

境中的声音,并通过声音识别算法对声音进行分析和识别。

4. 运动追踪算法:Kinect内置了一套先进的运动追踪算法,可

以对深度图像和RGB图像进行分析,以识别人体的关节位置、姿势和动作。

通过对捕捉到的图像和声音进行实时处理和分析,Kinect能够将用户的动作和声音实时转化为数字信号。

5. 数据传输和处理:Kinect通过USB接口与计算机相连,将

捕捉到的图像和声音数据传输给计算机进行处理和分析。

计算机上的软件可以根据用户的动作和声音输出相应的指令或产生互动效果。

综上所述,Kinect的工作原理是通过深度传感器、RGB摄像头、声音传感器和运动追踪算法来捕捉和识别用户的动作和声音,从而实现与计算机的互动。

kinect原理

Kinect原理。

Kinect是由微软公司开发的一款基于体感技术的设备,可以实现人体姿势识别、语音识别和深度感知等功能。

它的原理是通过红外线投影器和红外线摄像头来获取用户的深度信息,同时通过彩色摄像头来获取用户的图像信息,再通过内置的传感器和算法进行数据处理,最终实现对用户动作的捕捉和识别。

首先,红外线投影器会发射一束红外线,这些红外线会在场景中形成一种结构光,投影到用户身上形成一张网格。

然后,红外线摄像头会捕捉到这些被用户身体表面反射的红外线,通过计算被反射的红外线与投影时的位置偏差,就可以得到用户与设备之间的距离,从而实现对用户的深度感知。

其次,彩色摄像头会捕捉到用户的图像信息,这些图像信息会与深度信息进行

融合,通过算法进行分析处理,识别用户的身体轮廓和姿势,从而实现对用户动作的捕捉和识别。

最后,通过内置的传感器和算法对获取的深度信息和图像信息进行处理,可以

实现对用户的手势、动作和语音的识别。

用户可以通过手势来操作游戏、应用程序或者电视,也可以通过语音来控制设备的操作,实现更加自然、便捷的交互方式。

总的来说,Kinect的原理是基于红外线投影器、红外线摄像头和彩色摄像头获

取用户的深度信息和图像信息,通过内置的传感器和算法进行数据处理和分析,最终实现对用户动作和语音的识别和交互。

它的出现极大地丰富了人机交互的方式,为游戏、娱乐和健康等领域带来了许多创新应用,也为未来的科技发展带来了更多可能性。

Kinect的原理虽然复杂,但它的应用却是如此简单、直观,让人们更加自然地与设备进行交互,为我们的生活带来了更多便利和乐趣。

1.侦测3D影像不同于普通的通过计算得到物体3D坐标的设备,Kinect可以直接获取物体与摄像头之间的距离,这是Kinect最受人瞩目的一个功能。

微软先后于2009年和2010年收购了3DV Systems(TOF)和PrimeSense(Light Coding)这两家以色列公司,并最终采用了Light Coding技术作为Kinect体感设备的深度摄像功能的基础。

Light Coding技术理论是利用连续光(近红外线)对测量空间进行编码,经感应器读取编码的光线,交由晶片运算进行解码后,产生一张具有深度的图像。

Light Coding技术说到底还是结构光技术。

但与传统的结构光方法不同的是,他的光源打出去的并不是一副周期性变化的二维的图像编码,而是一个具有三维纵深的“体编码”。

这种光源叫做激光散斑(laser speckle),是当激光照射到粗糙物体或穿透毛玻璃后形成的随机衍射斑点。

这些散斑具有高度的随机性,而且会随着距离的不同变换图案,空间中任何两处的散斑都会是不同的图案,等于是将整个空间加上了标记,所以任何物体进入该空间以及移动时,都可确切记录物体的位置。

光源标定:测量前对原始空间的散斑图案做记录,先做一次光源的标定,方法是每隔一段距离,取一个参考平面,把参考平面上的散斑图案记录下来;假设Kinect规定的用户活动范围是距离摄像头1~4m,每隔10cm取一个参考平面,标定后保存了30幅散斑图像;测量时拍摄一幅待测场景的散斑图案,将这幅图像和保存的30幅参考图像依次做互相关运算,得到30幅相关度图像;空间中有物体存在的位置,在相关度图像上就会显示出峰值。

把这些峰值一层层叠在一起,经过插值运算,即可得到整个场景的三维形状。

Kinect就是以红外线发出人眼看不见的class 1镭射光,透过镜头前的diffuser(光栅)将镭射光均匀分布投射在测量空间中,再透过红外线CMOS传感器记录下空间中的每个散斑,结合原始散斑图案,再透过晶片计算成具有3D深度的图像。

Kinectv2参数1. 介绍Kinectv2是微软开发的一款体感控制器,是Kinect系列的第二代产品。

它通过使用红外线和摄像头等传感器,可以实时捕捉人体动作和声音,并将其转化为对应的数据。

这些数据可以用于游戏、虚拟现实、姿势识别等应用领域。

2. 技术原理Kinectv2采用了一系列传感器来实现人体动作的捕捉。

其中包括了RGB摄像头、深度传感器、红外线发射器和接收器等。

通过这些传感器,Kinectv2可以同时获取人体的外形轮廓、深度信息以及骨骼关节的位置。

•RGB摄像头:用于拍摄彩色图像,提供人体外形轮廓。

•深度传感器:利用红外光与物体之间的反射时间差来计算物体到相机的距离,提供物体的深度信息。

•红外线发射器和接收器:发射红外线光束并接收其反射回来的信号,用于计算骨骼关节位置。

3. 参数说明3.1 彩色图像参数•分辨率:Kinectv2的彩色图像分辨率为1920x1080,可以提供清晰的图像。

•帧率:彩色图像的帧率为30帧/秒,可以实现流畅的实时显示。

3.2 深度图像参数•分辨率:Kinectv2的深度图像分辨率为512x424,可以提供高精度的深度信息。

•帧率:深度图像的帧率为30帧/秒,可以实现实时捕捉人体动作。

3.3 骨骼关节参数Kinectv2可以同时追踪身体上的25个关键骨骼关节,包括头部、颈部、肩膀、手臂、手腕、手掌、脊柱、髋部、大腿、小腿和脚等。

每个关节都有自己的位置和方向信息。

3.4 声音参数Kinectv2内置了一个多阵列麦克风系统,可用于捕捉环境中的声音。

它支持语音识别和语音指令功能,并能够消除背景噪声。

4. 应用领域Kinectv2广泛应用于游戏、虚拟现实和姿势识别等领域。

4.1 游戏Kinectv2可以将玩家的动作实时转化为游戏中的角色动作,使游戏更加互动和真实。

玩家可以通过手势控制、身体动作和声音指令来操作游戏。

4.2 虚拟现实Kinectv2可以用于虚拟现实环境中的身体追踪和手势识别。

kinect深度传感器原理

Kinect深度传感器采用了结构光的原理,其基本原理为在场景中发射一束光,并利用相机来捕捉被投射在场景上的结构光,并生成一个深度图像。

具体来说,Kinect深度传感器发射一条红外线激光,在被扫描的房间中自动徘徊,到处寻找物体。

当激光束收到反射信号时,Kinect会测量被反射回的激光的时间达到计算它的距离。

这个时间可以转换成一个唯一的像素值,用于创建深度图像。

这个深度图像被人类或机器人用来定位阴影或真实世界中的物体,从而更准确地将它们捕捉到3D建模、虚拟现实或其他应用程序中。

Kinect深度传感器是通过结合提供不同角度和方向的不同设备(投射器和相机)中的深度数据来创建3D场景。

Kinect深度传感器也可以跟踪并识别人体姿势和位置,并让设备上的奇妙应用程序,如Kinect体育节目,Kinect舞蹈中心和Kinect Star Wars等游戏体验变得更真实和有趣。

kinect生成点云原理一、Kinect技术的基本原理Kinect是由微软公司开发的一种基于深度感应的人体动作感应器。

它包含了红外线发射器、红外线深度传感器、彩色摄像头等硬件设备。

Kinect通过发射红外线光束,然后测量光束的反射时间来计算物体与Kinect之间的距离。

同时,彩色摄像头可以捕捉到物体的纹理信息。

二、点云的概念点云是指由大量的点组成的三维空间中的几何信息。

每个点都有自己的位置坐标和其他的属性信息,如颜色、法线等。

点云可以用来表示物体的形状、表面特征等。

三、Kinect生成点云的过程1. 深度图像获取Kinect通过红外线深度传感器获取到物体与Kinect之间的距离信息,并将其转换为深度图像。

深度图像是一个二维数组,每个像素点表示该位置与Kinect的距离。

2. 彩色图像获取Kinect的彩色摄像头会获取到物体的纹理信息,生成彩色图像。

彩色图像是由RGB三个分量组成的,可以用来给点云添加颜色属性。

3. 点云生成通过深度图像和彩色图像,Kinect可以将每个像素点的深度信息和颜色信息对应起来,从而生成点云数据。

具体的方法是将深度图像中的每个像素点的深度值转换为相对于Kinect坐标系的三维坐标,然后将对应的RGB颜色值添加到相应的点上。

4. 点云处理生成的点云数据可能存在一些噪点或者不完整的情况,因此需要进行一些处理。

常见的处理方法包括滤波、去噪、补洞等。

这些处理方法可以提高点云的质量和准确性。

四、点云应用领域点云技术在计算机图形学、计算机视觉、虚拟现实、机器人等领域有着广泛的应用。

例如,在计算机图形学中,点云可以用来重建三维模型或者进行形状分析;在计算机视觉中,点云可以用来进行目标检测、跟踪等任务;在虚拟现实中,点云可以用来创建真实感的场景;在机器人领域,点云可以用来进行环境感知和导航等。

总结:本文介绍了Kinect技术的基本原理,点云的概念以及Kinect如何生成点云的过程。

通过深度图像和彩色图像的获取,Kinect可以将物体的三维位置和颜色信息对应起来,生成点云数据。

kinect原理Kinect原理。

Kinect是微软公司推出的一款基于体感技术的游戏设备,它可以通过摄像头、红外线传感器和麦克风等硬件设备,实现对玩家的动作和声音的捕捉和识别,从而实现与游戏的互动。

那么,Kinect是如何实现这些功能的呢?接下来,我们将深入探讨Kinect的原理。

首先,Kinect的摄像头采用了RGB摄像头和红外深度传感器相结合的设计。

RGB摄像头可以捕捉玩家的图像,而红外深度传感器则可以测量物体与摄像头之间的距离,从而实现对玩家的动作进行精确的捕捉。

通过这两种传感器的协同工作,Kinect可以实现对玩家在三维空间内的动作进行实时跟踪,包括身体的姿势、手部的动作等。

其次,Kinect还配备了多阵列麦克风,用于声音的捕捉和识别。

这些麦克风可以实现对玩家的语音指令进行识别,并将其转化为游戏内的操作或者交互。

通过声音的捕捉和识别,Kinect可以实现更加智能化的游戏体验,让玩家可以通过语音来控制游戏的进行。

此外,Kinect还采用了复杂的算法和软件来处理传感器采集到的数据。

这些算法和软件可以对图像、深度和声音等数据进行处理和分析,从而实现对玩家动作和声音的识别。

通过不断地优化和改进这些算法和软件,Kinect可以实现更加精准和可靠的体感交互体验。

总的来说,Kinect能够实现对玩家动作和声音的捕捉和识别,主要依靠摄像头、红外深度传感器和多阵列麦克风等硬件设备,以及复杂的算法和软件的支持。

通过这些技术手段的结合,Kinect可以实现更加智能化、精准化的体感交互体验,为玩家带来全新的游戏乐趣。

在未来,随着技术的不断进步和发展,Kinect的原理也将得到进一步的完善和提升,为玩家带来更加丰富多彩的游戏体验。

相信随着体感技术的发展,Kinect将会在游戏领域发挥越来越重要的作用,成为游戏娱乐的新宠。

Kinect的原理,正是这样一个不断进化的过程,为游戏世界注入了新的活力和活力。

kinect 工作原理Kinect是由Microsoft开发的一种体感控制设备,它基于深度摄像头技术,可以实时获取用户的姿势、动作和语音等信息,并将其用于与电脑、游戏控制台等设备的交互中。

Kinect的工作原理主要涉及以下几个方面:1. 深度摄像头:Kinect内置了一台深度摄像头,它通过发射红外线光束来感知场景中的物体,并根据光的反射时间来计算物体的距离。

深度摄像头可以实时捕捉场景中不同物体的深度信息,从而构建物体和用户的三维模型。

2. 红外发射器和红外摄像头:在Kinect的摄像头中,还有一个专用的红外发射器和红外摄像头组件。

红外发射器会发出结构光,形成一种特殊的纹理网格,这些纹理将投射到用户身上,并在红外摄像头中进行捕捉。

通过分析红外图像中与结构光相对应的图案,Kinect可以推断出用户与设备之间的距离、位置和动作等信息。

3. 麦克风阵列:Kinect还配备了一组高质量的麦克风,通常以圆形或线性阵列的形式排列。

这种阵列设计可以捕捉到来自不同方向的声音,并利用声音的强度差异来判断声源的位置。

通过麦克风阵列,Kinect可以实现语音识别和语音指令功能。

4. 软件处理:Kinect的软件部分包括驱动程序和算法库。

驱动程序负责连接Kinect与电脑或游戏控制台,并实现数据传输。

算法库负责对从摄像头和麦克风阵列获得的原始数据进行实时处理和分析,从而提取出用户的姿势、动作、语音等关键信息。

总的来说,Kinect的工作原理是通过深度摄像头、红外发射器和摄像头、麦克风阵列以及软件处理等部分的协同工作,实时捕捉和分析用户的姿势、动作和语音等数据,从而实现人机交互和体感控制的功能。

kinect体感原理Kinect体感原理。

Kinect是微软公司推出的一款基于体感技术的设备,它可以通过摄像头、红外线传感器和麦克风等硬件设备,实现对用户的动作、声音和姿态的识别,从而实现与电脑和游戏主机的交互。

其原理主要包括深度感知、骨骼追踪和语音识别三个方面。

首先,深度感知是Kinect体感原理的基础。

Kinect设备内置了红外线发射器和红外线摄像头,通过发射和接收红外线,可以实现对用户周围环境的深度感知。

利用这一技术,Kinect可以准确地识别出用户身体的轮廓和姿态,从而实现对用户动作的跟踪和识别。

其次,骨骼追踪是Kinect体感原理的核心。

在深度感知的基础上,Kinect可以通过对用户骨骼的追踪,实现对用户动作的精准识别。

通过对用户关节的角度和位置的监测,Kinect可以实时地捕捉用户的动作,并将其转化为电脑或游戏主机的控制指令,从而实现对游戏、应用程序甚至操作系统的控制。

最后,语音识别是Kinect体感原理的另一个重要方面。

Kinect设备内置了高品质的麦克风阵列,可以实现对用户语音的精准识别。

通过对用户语音的识别和理解,Kinect可以实现语音控制功能,用户可以通过语音指令来控制游戏、应用程序甚至操作系统,实现更加便捷和自然的交互体验。

总的来说,Kinect体感原理是基于深度感知、骨骼追踪和语音识别等技术的综合应用,通过对用户动作、姿态和语音的识别和理解,实现与电脑和游戏主机的自然、直观的交互。

随着体感技术的不断发展和完善,Kinect设备在游戏、娱乐、医疗、教育等领域的应用前景将会更加广阔。

Kinect体感原理的深入理解和应用,将会为我们的生活带来更多的便利和乐趣。

kinect深度传感器原理Kinect深度传感器是一种通过红外线和红外光学技术来感知物体距离和形状的设备。

它是由微软公司开发的一款传感器,最早用于Xbox游戏机的运动控制。

由于其强大的功能和广泛的应用领域,Kinect深度传感器已经成为许多计算机视觉和人机交互领域的关键技术。

Kinect深度传感器利用了时间飞行(Time-Of-Flight,TOF)原理来计算物体与传感器之间的距离。

它通过向场景中发射红外光脉冲,然后测量光脉冲的往返时间来计算出物体到传感器的距离。

具体的工作流程如下:首先,Kinect深度传感器向场景发送一束红外光脉冲。

这个光脉冲包含了特定的模式,这样传感器可以通过后续的光脉冲接收来识别哪些光脉冲是它发出的。

然后,红外光脉冲被传感器发射出去后,它将会与场景中的物体发生相互作用。

当光线到达物体并被反射或散射时,它的时间会有所改变。

传感器会接收到光脉冲的反射信号,并记录下它的到达时间。

通过测量光脉冲发射和反射之间的时间差,传感器可以计算出物体到传感器的距离。

最后,传感器将获取到的深度图像和距离信息传输给计算机,计算机可以通过这些数据来重建场景的三维模型。

在Kinect深度传感器的工作过程中,还需要解决一些技术挑战。

例如,传感器需要能够准确地测量红外光脉冲的时间,因为即使很小的误差也会导致深度测量的不准确。

为了解决这个问题,传感器会使用高速时钟来精确测量光脉冲的到达时间。

此外,传感器需要对深度图像进行校准,以消除传感器内部的误差和外部环境的干扰。

校准的过程通常需要使用特殊的校准工具或算法来准确地将深度图像映射为真实世界的物体距离。

Kinect深度传感器的应用非常广泛。

它可以用于人机交互,例如通过检测手势和动作来进行游戏控制、手势识别和人脸识别等。

此外,Kinect深度传感器还可以应用于计算机视觉领域,例如三维建模、虚拟现实和增强现实等。

总之,Kinect深度传感器利用红外线和光学技术来感知物体距离和形状。