最小二乘估计

- 格式:ppt

- 大小:1.24 MB

- 文档页数:19

简述参数最小二乘估计的基本原理

参数最小二乘估计是一种常用的统计方法,用于确定一组参数的最优值,以便最小化模型的预测误差。

该方法的基本原理是,在给定一组有限的观测数据下,通过拟合一个数学模型,估计模型中的参数值,使得模型的预测误差最小。

具体地说,参数最小二乘估计的基本原理是通过最小化残差平方和来确定参数的最优值。

这里的残差是指观测值与模型预测值之间的差异,平方和则是所有残差平方的总和。

通过最小化残差平方和,可以得到最优的参数值,使得预测误差最小。

参数最小二乘估计的优点是简单易懂、计算方便、可解释性好,并且在实际应用中广泛使用。

但是,该方法也存在一些限制,例如它要求模型中的误差服从正态分布,且假设模型的参数是固定的,而不是随机变量。

因此,在实际应用中需要对这些限制进行考虑,并结合实际情况选择合适的方法进行参数估计。

- 1 -。

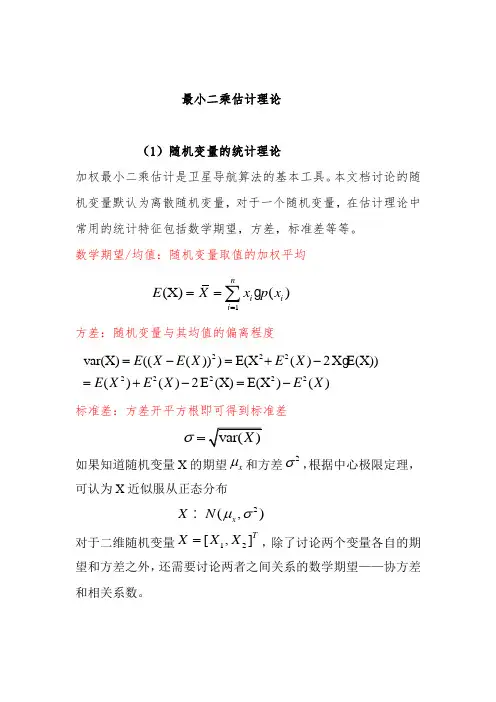

最小二乘估计理论(1)随机变量的统计理论加权最小二乘估计是卫星导航算法的基本工具。

本文档讨论的随机变量默认为离散随机变量,对于一个随机变量,在估计理论中常用的统计特征包括数学期望,方差,标准差等等。

数学期望/均值:随机变量取值的加权平均1(X)()ni i i E X x p x ===∑ 方差:随机变量与其均值的偏离程度22222222var(X)((()))E(X ()2X E(X))()()2E (X)E(X )()E X E X E X E X E X E X =-=+-=+-=-标准差:方差开平方根即可得到标准差σ=如果知道随机变量X 的期望x μ和方差2σ,根据中心极限定理,可认为X 近似服从正态分布2(,)x X N μσ对于二维随机变量12[,]T X X X =,除了讨论两个变量各自的期望和方差之外,还需要讨论两者之间关系的数学期望——协方差和相关系数。

1X 和2X 的协方差定义为12121122121221121212(X ,)((()(())E(X ()()()())E(X X )()()x x Cov X E X E X X E X X X E X X E X E X E X E X E X σ=--=--+=-=1X 和2X 相关系数定义为:121212x x x x x x σρσσ= 相关系数的取值范围为[-1,1]之间,其绝对值越小表明两随机变量的相关性越小。

则二维随机变量X 的均值和方差为:1122()()()()X E X E X E X E X ⎡⎤⎡⎤==⎢⎥⎢⎥⎣⎦⎣⎦11212211112222211112221122222,2,()((())(()))()E([()()])()((())),((()(())((()(()),((())),,T x x x x x x D X E X E X X E X X E X X E X X E X X E X E X E X E X E X X E X E X E X X E X E X E X σσσσ=---⎡⎤=--⎢⎥-⎣⎦⎡⎤---=⎢⎥---⎢⎥⎣⎦⎡⎤=⎢⎥⎢⎥⎣⎦同理对于多维随机变量123[,,......]T n X X X X X =同理有1122()()()()..()n n X E X X E X E X E X E X ⎡⎤⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥==⎢⎥⎢⎥⎢⎥⎢⎥⎣⎦⎣⎦21111221121122222211((())(()))((())),((()(())...((()(())((()(()),((()))...((()(()).........((()(())...................T xx n n n n n n D E X E X X E X E X E X E X E X X E X E X E X X E X E X E X X E X E X E X E X E X X E X E X E X X E X =------------=-- 211..................................((()))E X E X ⎡⎤⎢⎥⎢⎥⎢⎥⎢⎥⎢⎥-⎣⎦1121122212,,2,,2,,,......,,...........,..............n n nn x x x x x x x x x x x x x σσσσσσσσ⎡⎤⎢⎥⎢⎥=⎢⎥⎢⎥⎢⎥⎣⎦(实对称矩阵)现在讨论多维随机变量函数的期望和方差现在假设函数11220........n n Z k X k X k X k =++++ ,可令123[,,......]T n X X X X X =123[k ,k ,k ......k ]n K =则函数值Z 可表示为0Z K X k =+则随机变量Z 的期望和方差可表示为00()()()E Z E K X k K E X k =+=+((Z E(Z))(Z E(Z)))(K(X E(X))(K(X E(X)))((X E(X))(X E(X)))T zz T T T Txx D E E K E K K D K =--=--=--=已知随机变量的方差,可以求得随机变量函数的方差这个过程称为误差传播定律。

最小二乘估计的基本假设1. 引言嘿,大家好!今天咱们来聊聊一个听上去有点复杂,但其实很有趣的话题——最小二乘估计。

可能你会想:“这是什么鬼?”其实,简单来说,它就是一种统计方法,帮助我们找到一条最能贴合数据的线。

想象一下,你在玩抛沙包,想找到一个最稳的投篮角度,最小二乘估计就能帮你找出最佳的“抛沙包”策略。

不过,嘿,要想玩得开心,得有几个基本的假设在前面,不然就像打麻将没带牌一样,别扭得很。

2. 最小二乘估计的基本假设2.1 线性关系首先,最重要的一点就是,咱们得假设变量之间是线性关系。

也就是说,如果你画个图,数据点大概会在一条直线上上下波动。

举个例子,如果你觉得每天吃的冰淇淋越多,心情就越好,这俩东西之间可能就有线性关系。

但如果你发现,吃冰淇淋过多反而心情糟糕,那就不符合咱们的假设了,可能还得调整一下“吃冰淇淋”的策略呢。

2.2 随机误差接下来,咱们得假设误差是随机的。

这就像你每次去外面吃饭,总有可能遇到服务慢、菜不好之类的意外情况,这些情况是不确定的,也不是你能控制的。

最小二乘估计要求这些误差是独立的、随机的,就像你的朋友突然告诉你今晚的电影没法看,这种意外不能影响你之前的计划。

要是误差有规律,比如总是偏高或偏低,那就会让估计的结果变得不靠谱,简直像开车不看路,肯定得出事故!3. 误差的正态分布3.1 正态分布再来,误差得服从正态分布。

这就像大多数人的身高,通常都是围绕着一个平均值分布的,高矮都有,但大部分人都在平均值附近。

正态分布的好处是,我们可以用一些简单的统计方法来进行推断。

要是数据点像个“波浪”一样,波动得不规则,那估计的效果就像一杯搅拌得太猛的奶昔,难以下咽。

3.2 同方差性最后,咱们还得考虑同方差性。

这听上去有点复杂,但其实就是要求误差的波动幅度在各个地方都差不多。

想象一下,如果你在做菜,调味料的味道在每一口都差不多,那大家都能接受。

可要是有的一口特别咸,有的特别淡,那就容易让人怀疑这菜是谁做的,肯定得有人埋怨“这是什么鬼东西?”所以,保持方差一致是很重要的,只有这样才能保证模型的可靠性。

简述参数最小二乘估计的基本原理

参数最小二乘估计是一种常见的回归分析方法,其基本原理是通过最小化残差平方和来估计模型中的所有参数。

具体地说,最小二乘估计的基本思想是,假设我们有一个线性模型y = β0 + β1x1 + β2x2 + … + βkxk + ε,其中,y表示因变量,x1、x2、…、xk表示自变量,β0、β1、β2、…、βk表示模型中的参数,ε表示误差项。

在最小二乘估计中,我们的目标是通过最小化残差平方和来确定模型中的参数,即使得∑(yi - β0 - β1x1i - β2x2i - … - βkxki)2最小。

为了实现最小二乘估计,我们通常使用矩阵代数的方法,将模型的参数估计值表示为(XX)-1Xy的形式,其中,X是自变量数据的矩阵,y是因变量数据的向量,而(XX)-1是矩阵(XX)的逆矩阵。

在实际应用中,最小二乘估计可以用于多种类型的回归分析,比如简单线性回归、多元线性回归、非线性回归等。

它的优点是简单易懂、计算方便,因此被广泛应用于统计学、经济学、工程学等领域。

- 1 -。

最小二乘估计的推导最小二乘估计是一种常用的参数估计方法,尤其在统计学和经济学领域得到广泛应用。

它的推导涉及到一些数学推理和统计原理,我将在本文中逐步解释和展示最小二乘估计的推导过程,并探讨其应用和优势。

1. 引言最小二乘估计是一种通过最小化观测值与预测值之间的差异来估计参数的方法。

它的基本思想是找到一组参数值,使得观测值与对应的预测值之间的平方差最小化。

这种方法在数据分析和回归分析中非常有用,因为它能够提供可靠的参数估计和预测模型。

2. 最小二乘估计的基本原理最小二乘估计的推导涉及到线性回归模型,即因变量Y与自变量X之间的线性关系。

假设我们有n个观测值,表示为(Xi,Yi),i=1,2,...,n。

我们的目标是找到一条直线Y=aX+b,使得所有观测值到这条直线的距离之和最小化。

距离的平方和可以表示为:S = Σ(Yi - (aXi + b))²我们的目标是最小化这个平方和。

为了找到最优的参数估计,我们需要找到使得S最小的a和b的值。

3. 最小化平方和我们可以通过对S求导,令导数等于零,来求解a和b的值。

具体地,我们分别对a和b求导,并令导数等于零:∂S/∂a = -2ΣXi(Yi - (aXi + b)) = 0∂S/∂b = -2Σ(Yi - (aXi + b)) = 0通过求解以上两个方程,我们可以得到最小二乘估计的闭合解:a = (ΣXiYi - n X̄Ȳ) / (ΣXi² - n X̄²)b = Ȳ - a X̄其中,X̄和Ȳ分别表示X和Y的均值,Σ表示求和符号。

4. 应用和优势最小二乘估计在实际应用中具有广泛的用途。

在经济学中,我们可以通过最小二乘估计来估计需求曲线和供给曲线的参数,从而预测市场的走势和变化。

在统计学中,最小二乘估计可以用于拟合数据并构建预测模型。

它是最经典的回归分析方法之一,可用于解释和预测变量之间的关系。

最小二乘估计具有一些优势。

最小二乘估计随着空间技术的发展,人类的活动开始进入了太空,对航天器(包括人造地球卫星、宇宙飞船、空间站和空间探测器等)的观测手段和轨道确定提出了很高的精度要求。

在计算技术高速发展的推动下,各种估计理论也因此引入到轨道估计方法中。

大约在1795年高斯在他那著名的星体运动轨道预报研究工作中提出了最小二乘法。

最小二乘法就成了估计理论的奠基石。

最小二乘估计不涉及观测数据的分布特性,它的原理不复杂,数学模型和计算方法也比较简单,编制程序不难,所以它颇受人们的重视,应用相当广泛。

对于严格的正态分布数据,最小二乘估值具有最优一致无偏且方差最小的特性。

实践证明,在没有粗差的情况下,大部分测量数据基本上符合正态分布。

这是最小二乘估计至今仍作为估计理论核心的基础。

最早的轨道确定就是利用最小二乘法,用全部观测数据确定某一历元时刻的轨道状态的“最佳”估值,即所谓的批处理算法定轨。

长期以来,在整个天体力学领域之中,各种天体的定轨问题,几乎都是采用这一方法。

卫星精密定轨的基本原理为:利用含有误差的观测资料和不精确的数学模型,通过建立观测量与卫星状态之间的数学关系,参数估计得到卫星状态及有关参数的最佳估值。

参数估计的基本问题就是对一个微分方程并不精确知道的动力学过程,用不精确的初始状态X0和带有误差的观测资料,求解其在某种意义下得卫星运动状态的“最佳”估值X。

常用的参数估计方法有两种,最小二乘法和卡尔曼滤波方法。

最小二乘法是在得到所有的观测数据之后,利用这些数据来估计初始时刻状态量的值,由于用到的观测数据多、计算方法具有统计特性,因此该方法精度高。

卡尔曼滤波在观测数据更新后,利用新的观测数据对状态量进行改进得到这一观测时刻的状态量,卡尔曼滤波适用于实时处理。

卫星精密定轨输运高精度的事后数据处理,通常采用最小二乘法进行参数估计。

记观测量的权阵为P。

利用加权最小二乘法计算总的观测方程方程y二Hx0•;,得x =(H T PH)JH T py卫星的参考状态为X; = X0 x0在精密定轨的过程中,由于状态方程和观测方程在线性化过程中会产生误差,上式的解算需要通过不断的迭代。

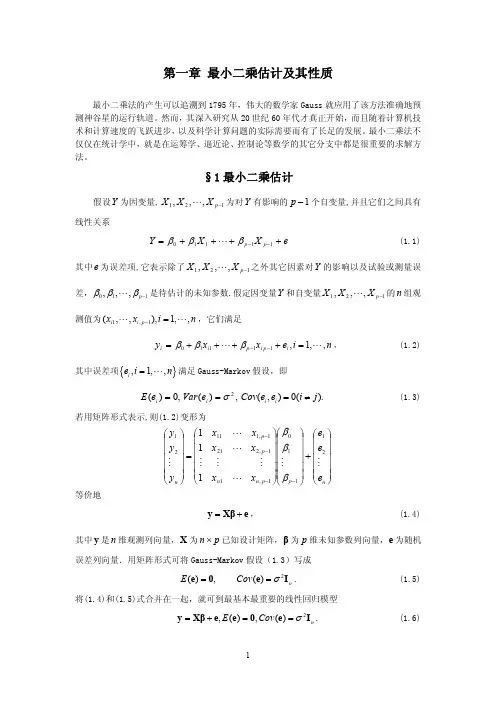

第1篇一、引言最小二乘法(Least Squares Method)是统计学中一种常用的参数估计方法,尤其在回归分析中得到了广泛的应用。

最小二乘法通过最小化残差平方和来估计模型参数,其中b1是线性回归模型中自变量对因变量的斜率估计量。

本文将推导最小二乘估计量b1的方差,以期为线性回归分析提供理论支持。

二、线性回归模型线性回归模型的一般形式为:Y = β0 + β1X1 + β2X2 + ... + βkXk + ε其中,Y是因变量,X1, X2, ..., Xk是自变量,β0是截距,β1, β2, ...,βk是回归系数,ε是误差项。

三、最小二乘估计量根据最小二乘法,估计量b1可以通过以下公式计算:b1 = (X'X)^(-1)X'Y其中,X是设计矩阵,Y是观测值向量,(X'X)^(-1)是X的协方差矩阵的逆矩阵。

四、b1的方差推导为了推导b1的方差,我们需要考虑以下步骤:1. 残差平方和残差平方和(Residual Sum of Squares,RSS)是衡量模型拟合程度的重要指标,其计算公式为:RSS = ∑(Yi - Yi^)²其中,Yi是观测值,Yi^是模型预测值。

2. 残差协方差矩阵残差协方差矩阵(Residual Covariance Matrix,CR)是衡量残差之间关系的矩阵,其计算公式为:CR = (X'X)^(-1)X'X(X'X)^(-1)3. b1的方差根据线性回归模型和残差协方差矩阵,b1的方差可以表示为:Var(b1) = CR[1,1]其中,CR[1,1]表示残差协方差矩阵的第1行第1列元素。

4. 推导过程为了推导Var(b1),我们需要考虑以下步骤:(1)计算残差协方差矩阵CRCR = (X'X)^(-1)X'X(X'X)^(-1)(2)计算CR[1,1]CR[1,1] = (X'X)^(-1)X'X[1,1](X'X)^(-1)其中,[1,1]表示矩阵的第1行第1列元素。

一,什么是最小二乘估计least-square estimation例:y = ax + (其中:y,x 可测;( —不可测的干扰项;a —未知参数.通过N 次实验,得到测量数据yk 和xk k = 1,2,3 …,确定未知参数a 称"参数估计".使准则J 为最小:令:( J ( ( a = 0 ,导出a =称为"最小二乘估计",即残差平方总和为最小的估计,Gauss于1792晏岢? 二,多元线性回归线性模型y = a0+ a1x1+(+ anx n + ( 式(2 - 1- 1)引入参数向量:( = [ a0,a1,(a n ]T (n+1)(1进行N 次试验,得出N 个方程:yk = (kT ( + (k ; k=1,2…,N 式(2 -1- 2)其中:(k = [ 1,x1,x2,(,x N ] T (n+1) (1方程组可用矩阵表示为y = ( ( + ( 式(2 -1- 3)其中:y = [ y1,y2,...,y N ] T (N (1)( = [ (1,(2,...,( N ] T (N 1)N (n+1)估计准则:有:= (y —( ()T( y —( ()(1(N) ( N(1)J = yTy + (T (T ( ( -yT ( ( - (T (T y= yTy + (T (T ( ( - 2 (T (T y 式(2 -1- 4)假设:((T ()(n+1)(n+1) 满秩,由利用线性代数的以下两个矩阵对向量求偏导数的公式:和有:和所以:解出参数估计向量:( Ls =((T ()-1 (T y 式(2 -1- 5)令:P = ((T ()-1 则参数估计向量( Ls = P (T y参数估计向量( Ls 被视为以下"正则方程"的解:((T ()( = (T y 式(2 -1- 6)注:为了便于区别,我们用红体字符表示估计量或计算值,而用黑体表示为参数真值或实际测量值.三,关于参数最小二乘估计Ls 性质的讨论以上求解参数最小二乘估计( Ls 时并为对{ (k }的统计特性做任何规定,这是最小二乘估计的优点.当{ (k }为平稳零均值白噪声时,则( Ls 有如下良好的估计性质:参数最小二乘估计( Ls 是y 的线性估计( Ls = P (T y 是y 的线性表出;b) 参数最小二乘估计( Ls 是无偏估计,即E ( Ls= ( (参数真值)[ 证明]:E ( Ls= E[ P (T y ]= P (T E( y ) = P (T E ( (( + ( ) =P (T ( ( + E( ( ) = ( + 0 = (最小二乘估计( Ls 的估计误差协方差阵是(2P (n+1)(n+1)即:E [ ( ( Ls- ( ) ( ( Ls- ( )T ] = (2P[ 证明]:E [ ( ( Ls - ( ) ( ( Ls - ( )T ] = E [ P (T ( y -( () ( y- ( ()T (P ] = E [ P (T ( (T (P ] = P (T E ( ( (T) (P =P (T (2 IN(N (P = (2P若{ (k }为正态分布零均值白噪声时,则( Ls 是线性无偏最小方差估计(证明从略).如若{ (k }是有色噪声,则( Ls 不具有上述性质,即为有偏估计.四,最小二乘估计( Ls 的的几何意义和计算问题1.最小二乘估计的几何意义最小二乘估计的模型输出值为yk = ( kT ( Ls k = 1,2,…N输出实际测量值与模型输出值之差叫残差:(k = yk –yk模型输出向量为y = ( ( Ls ,而残差向量为:( = y –y = y –( ( Ls(T ( k = (T y –(T (((T ()-1 (T y = (T y –(T y = 0即残差向量( 与由测量数据矩阵( 的各个向量:( 1,( 2 ,…,( N 张成的超平面(估计空间)正交,而最小二乘模型输出向量y 为实际输出向量y 在估计空间上的正交投影,这就是最小二乘估计的几何意义.---------------------------------------------最小二乘法是一种数学优化技术,它通过最小化误差的平方和找到一组数据的最佳函数匹配. 最小二乘法是用最简的方法求得一些绝对不可知的真值,而令误差平方之和为最小.最小二乘法通常用于曲线拟合.很多其他的优化问题也可通过最小化能量或最大化熵用最小二乘形式表达.比如从最简单的一次函数y=kx+b讲起已知坐标轴上有些点(1.1,2.0),(2.1,3.2),(3,4.0),(4,6),(5.1,6.0),求经过这些点的图象的一次函数关系式.当然这条直线不可能经过每一个点,我们只要做到5个点到这条直线的距离的平方和最小即可,这就需要用到最小二乘法的思想.然后就用线性拟合来求.。

矩估计与最小二乘估计

矩估计与最小二乘估计是统计学中常用的两种参数估计方法。

它们都是通过样本数据来估计总体参数,但是它们的计算方法和应用场景有所不同。

矩估计是一种基于矩的方法,它的核心思想是利用样本矩来估计总体矩,从而得到总体参数的估计值。

矩估计的优点是计算简单,不需要对总体分布做出任何假设,因此适用范围广泛。

但是矩估计的缺点是估计值的精度较低,尤其是在样本量较小的情况下容易产生偏差。

最小二乘估计是一种基于最小二乘法的方法,它的核心思想是通过最小化样本数据与总体模型之间的误差来估计总体参数。

最小二乘估计的优点是估计值的精度较高,尤其是在样本量较大的情况下可以得到较为准确的估计结果。

但是最小二乘估计的缺点是需要对总体分布做出一定的假设,如果假设不准确可能会导致估计结果的偏差。

在实际应用中,矩估计和最小二乘估计都有其适用的场景。

例如,在回归分析中,最小二乘估计常用于线性回归模型的参数估计,而矩估计则常用于非线性回归模型的参数估计。

此外,在信号处理、图像处理等领域中,最小二乘估计也是常用的参数估计方法。

矩估计和最小二乘估计都是统计学中常用的参数估计方法,它们各

有优缺点,应根据具体情况选择合适的方法进行参数估计。

最小二乘估计过程推导

最小二乘估计是一种常用的参数估计方法,它可以用来估计线性回归模型中的系数。

其核心思想是通过最小化误差平方和来确定最优的模型参数。

下面是最小二乘估计过程的详细推导。

假设我们有一个包含n个数据点的线性回归模型,其中每个数据点由以下形式的观测值组成:

y_i = β_0 + β_1 x_i + ε_i

其中,y_i是因变量(或响应变量),x_i是自变量(或解释变量),β_0和β_1是回归系数,ε_i是误差项。

我们的目标是通过这些观测值来估计回归系数。

我们可以使用最小二乘法来估计回归系数,该方法通过最小化误差平方和来确定最优的模型参数。

误差平方和定义为:

SSE = ∑(y_i - _i)^2

其中,_i是用回归模型预测的y_i值。

我们的目标是通过最小化SSE来确定最优的β_0和β_1。

偏导数为:

SSE/β_0 = -2 ∑(y_i - β_0 - β_1 x_i)

SSE/β_1 = -2 ∑(y_i - β_0 - β_1 x_i) x_i

将偏导数设为0,并解出β_0和β_1,得到最优的回归系数估计:β_1 = (∑x_i y_i - n x y) / (∑x_i^2 - n x^2)

β_0 = y - β_1 x

其中,x和y分别是x_i和y_i的平均值。

这就是最小二乘估计的推导过程。

总的来说,最小二乘估计是一种简单而有效的参数估计方法,适用于线性回归模型。

通过最小化误差平方和来确定最优的模型参数,可以得到非常准确的回归系数估计,从而更好地理解变量之间的关系。

最小二乘估计过程推导在统计学和数学领域中,最小二乘法是一种常用的估计方法,用于拟合一个数学模型与观测数据之间的关系。

它的主要目标是通过最小化残差的平方和来找到最佳的参数估计值。

本文将介绍最小二乘估计的基本原理和推导过程。

最小二乘法的核心思想是找到一组参数,使得模型预测值与观测值之间的差异最小化。

在线性回归问题中,最小二乘估计通过最小化观测值与模型预测值之间的残差平方和来求解最佳参数估计值。

假设我们有一个线性回归模型,其中y表示因变量,X表示自变量,β表示待估计的参数向量。

模型可以表示为:y = Xβ + ε其中ε表示误差项,我们假设它是一个服从正态分布的随机变量。

我们的目标是找到最佳的参数估计值β,使得模型的预测值与观测值之间的差异最小化。

为了求解最佳参数估计值,我们需要定义一个误差函数,通常选择残差的平方和作为误差函数。

我们将所有观测值的残差平方和表示为:S(β) = ∑(y - Xβ)²为了找到最小化误差函数的参数估计值,我们需要对误差函数进行求导,并令导数等于零。

通过求解这个方程组,我们可以得到最佳的参数估计值。

为了简化计算,我们可以将误差函数表示为矩阵形式。

令Y表示观测值的向量,X表示自变量矩阵,β表示参数向量,e表示误差向量,则误差函数可以表示为:S(β) = (Y - Xβ)ᵀ(Y - Xβ)对误差函数进行求导,并令导数等于零,我们得到以下的方程:XᵀXβ = XᵀY这个方程被称为正规方程,它可以用来求解最佳的参数估计值。

当XᵀX是可逆的时候,我们可以通过计算逆矩阵来求解参数估计值:β = (XᵀX)⁻¹XᵀY当XᵀX不可逆时,我们可以通过广义逆矩阵来求解参数估计值。

最小二乘估计方法的优点在于它是一个无偏估计,即当样本量趋向于无穷大时,估计值收敛于真实的参数值。

同时,最小二乘估计方法还具有最小方差性质,即在所有无偏估计中,它的方差是最小的。

最小二乘法是统计学中最常用的估计方法之一。